02/05/2026

În era digitală, cantitatea de informație textuală disponibilă este vastă și în continuă creștere. De la recenzii online la articole de știri și postări pe rețelele sociale, textul domină o mare parte din conținutul digital. Însă, pentru ca mașinile să poată înțelege și procesa aceste date, textul brut trebuie convertit într-un format numeric. Această conversie este esențială pentru orice sarcină de Procesare a Limbajului Natural (NLP), de la clasificarea documentelor la analiza sentimentelor. Unul dintre cele mai fundamentale și utilizate instrumente pentru această transformare este CountVectorizer, o componentă puternică a bibliotecii scikit-learn din Python.

Acest articol îți va oferi o înțelegere aprofundată a funcționării CountVectorizer, explorând avantajele și dezavantajele sale, comparându-l cu TfidfVectorizer și prezentând alte alternative avansate. Pregătește-te să descoperi cum textul tău poate fi transformat într-o formă inteligibilă pentru algoritmii de învățare automată!

- Ce este CountVectorizer și cum funcționează?

- Avantajele Utilizării CountVectorizer

- Dezavantajele și Limitările CountVectorizer

- CountVectorizer vs. TfidfVectorizer: O Analiză Comparativă

- Dincolo de Numărare: Alternative Avansate de Vectorizare a Textului

- Întrebări Frecvente Despre CountVectorizer și Vectorizarea Textului

- Ce înseamnă o "matrice rară" (sparse matrix) și de ce este importantă?

- Poate CountVectorizer să gestioneze mai multe limbi?

- Cum se tratează cuvintele oprite (stop words) în CountVectorizer?

- Ce sunt n-gramele și cum le folosește CountVectorizer?

- Este CountVectorizer potrivit pentru analiza sentimentelor?

- Concluzie

Ce este CountVectorizer și cum funcționează?

CountVectorizer este un instrument esențial în arsenalul oricărui specialist în NLP, conceput pentru a converti o colecție de documente text într-o reprezentare numerică. Această tehnică se bazează pe conceptul de "sac de cuvinte" (bag-of-words), unde ordinea cuvintelor într-un document este ignorată, iar accentul se pune doar pe frecvența termenilor.

Principiul de Bază

La nivel fundamental, CountVectorizer parcurge toate documentele dintr-un corp de text și identifică toate cuvintele unice. Aceste cuvinte unice formează vocabularul. Apoi, pentru fiecare document din colecție, CountVectorizer numără de câte ori apare fiecare cuvânt din vocabular în acel document. Rezultatul acestei operațiuni este o matrice document-termen (sau matrice de frecvență), în care fiecare rând corespunde unui document, iar fiecare coloană corespunde unui cuvânt unic din vocabular. Valoarea din fiecare celulă a matricei reprezintă numărul de apariții ale unui anumit cuvânt (termen) într-un anumit document.

De exemplu, să luăm în considerare trei fraze simple:

- "Un programator ajută doi programatori."

- "Doi programatori ajută patru programatori."

- "Fiecare programator ajută mulți alți programatori la GeeksforGeeks."

CountVectorizer va construi un vocabular din cuvintele unice, cum ar fi: "ajută", "alți", "fiecare", "mulți", "patru", "programator", "programatori", "un", "doi", "geeksforgeeks". Apoi, va crea o matrice unde fiecare rând va reprezenta o frază, iar fiecare coloană un cuvânt din vocabular. Valoarea din celulă va fi numărul de apariții. Observații cheie sunt:

- Toate cuvintele sunt convertite în litere mici pentru a standardiza reprezentarea (ex: "Programator" și "programator" sunt tratate la fel).

- Cuvintele din coloane sunt aranjate alfabetic.

- Matricea rezultată este adesea o matrice rară (sparse matrix), deoarece majoritatea celulelor vor conține zero (majoritatea cuvintelor nu apar în toate documentele). Această reprezentare rară este crucială pentru eficiența memoriei și a calculului, mai ales când se lucrează cu seturi mari de date.

Procesul în Python

În Python, utilizarea CountVectorizer este simplă. Se creează o instanță a clasei CountVectorizer. Apoi, se folosește metoda .fit() pe colecția de documente pentru a învăța vocabularul (adică, pentru a identifica toate cuvintele unice și a le atribui un index). După ce vocabularul este învățat, metoda .transform() este utilizată pentru a converti documentele în reprezentarea numerică (matricea de frecvență a termenilor). De asemenea, proprietatea .vocabulary_ permite vizualizarea vocabularului identificat și a indexurilor asociate.

Avantajele Utilizării CountVectorizer

Deși este un instrument relativ simplu, CountVectorizer oferă o serie de avantaje semnificative care îl fac o alegere populară pentru multe sarcini de NLP:

- Simplitate și Ușurință în Utilizare: CountVectorizer este extrem de intuitiv și necesită o configurație minimă pentru a începe preprocesarea textului. Această simplitate îl face ideal pentru începători și pentru prototiparea rapidă.

- Viteză și Eficiență Computațională: Datorită utilizării matricilor rare, CountVectorizer este remarcabil de eficient din punct de vedere computațional. Poate gestiona seturi mari de date text cu numeroase documente fără a consuma resurse excesive de memorie sau timp de procesare.

- Versatilitate în Tokenizare: Oferă opțiuni flexibile pentru tokenizare, cum ar fi gestionarea n-gramelor (secvențe consecutive de cuvinte), filtrarea cuvintelor oprite (stop words) și controlul dimensiunii vocabularului. Aceste caracteristici permit o adaptare precisă la nevoile specifice ale proiectului.

- Rezultate Interpretare: Matricea document-termen generată de CountVectorizer este direct interpretabilă. Fiecare celulă reprezintă numărul de apariții al unui cuvânt într-un document, permițând o analiză directă și ușoară a frecvenței cuvintelor.

Dezavantajele și Limitările CountVectorizer

În ciuda simplității și eficienței sale, CountVectorizer are și limitări importante, în special în ceea ce privește înțelegerea semantică a textului:

- Ignoră Informațiile Semantice: Abordarea "sacului de cuvinte" tratează fiecare cuvânt ca o entitate independentă, fără a capta relațiile semantice sau contextul dintre cuvinte. Nu distinge între cuvinte cu sensuri similare (sinonime) sau cuvinte care apar în contexte diferite (polisemie).

- Bias față de Cuvintele Frecvente: Atribuie o importanță mai mare cuvintelor care apar frecvent în documente. Prin urmare, cuvintele comune precum "și", "sau", "este" pot domina spațiul de caracteristici, potențial ignorând cuvinte mai rare, dar mai semnificative pentru sensul real al documentului.

- Lipsa Normalizării Lungimii Documentului: Nu ia în considerare lungimea documentului. Documentele mai lungi pot avea un număr mai mare de apariții ale cuvintelor decât documentele mai scurte, chiar dacă abordează aceleași subiecte. Această lipsă de normalizare poate afecta anumite analize și algoritmi care depind de lungimea documentului.

- Informații Limitate: Surprinde doar frecvența aparițiilor cuvintelor într-un document. Nu ia în considerare ordinea sau secvența cuvintelor, ceea ce poate fi relevant în sarcini complexe precum analiza sentimentelor sau modelarea limbajului, unde contextul și sintaxa sunt cruciale.

CountVectorizer vs. TfidfVectorizer: O Analiză Comparativă

Pentru a depăși unele dintre limitările CountVectorizer, a fost dezvoltat TfidfVectorizer. Acesta se bazează pe conceptul CountVectorizer, dar încorporează o schemă de ponderare TF-IDF (Term Frequency-Inverse Document Frequency), care reflectă importanța unui termen într-un document în cadrul unui întreg corpus.

Înțelegerea TF-IDF

Valoarea TF-IDF pentru un termen într-un document este calculată prin înmulțirea a două componente:

- Frecvența Termenului (TF): Reprezintă de câte ori apare un termen într-un document. Se calculează, de obicei, ca numărul de apariții al termenului în document împărțit la numărul total de termeni din document. Aceasta standardizează frecvența pentru a ține cont de lungimea documentului.

- Frecvența Inversă a Documentului (IDF): Măsoară raritatea unui termen în întregul corpus. Se calculează ca logaritmul numărului total de documente împărțit la numărul de documente care conțin termenul. Un IDF mare indică un termen rar, în timp ce un IDF mic indică un termen comun.

TfidfVectorizer tokenizează textul, calculează frecvențele termenilor și apoi aplică transformarea IDF pentru a obține o reprezentare ponderată. Astfel, cuvintele frecvente într-un document, dar rare în întregul corpus, primesc o pondere mai mare, fiind considerate mai informative.

Tabel Comparativ: CountVectorizer vs. TfidfVectorizer

| Caracteristică | CountVectorizer | TfidfVectorizer |

|---|---|---|

| Scop Principal | Numără frecvența absolută a cuvintelor. | Ponderează importanța cuvintelor pe baza frecvenței și rarității. |

| Valori Matrice | Număr întreg (numărul de apariții). | Valori în virgulă mobilă (ponderi TF-IDF). |

| Importanța Cuvintelor Comune | Mare (cuvintele comune au un număr mare de apariții). | Mică (cuvintele comune sunt depunctate prin IDF). |

| Consideră Lungimea Documentului | Nu direct (numărul de apariții crește cu lungimea). | Da (prin componenta TF și normalizarea implicită). |

| Utilizare Tipică | Clasificare text simplă, clustering bazat pe frecvență. | Recuperare informații, clasificare, rezumare, ranking documente. |

| Complexitate | Simplu și direct. | Mai complex, dar oferă o reprezentare mai nuanțată. |

Când să Alegi Care?

- Alege CountVectorizer atunci când simplitatea este prioritară și ai nevoie doar de o reprezentare directă a frecvenței cuvintelor. Este potrivit pentru sarcini în care simpla prezență sau frecvență a cuvintelor este suficientă, cum ar fi anumite tipuri de clasificare a textului sau crearea de nori de cuvinte. De asemenea, poate fi util ca punct de plecare rapid pentru explorarea datelor.

- Alege TfidfVectorizer atunci când importanța contextuală a cuvintelor este crucială. Este superior pentru sarcini precum recuperarea informațiilor (motoare de căutare), unde cuvintele rare, dar relevante, ar trebui să aibă o pondere mai mare. De asemenea, este adesea preferat pentru clasificarea textului și analiza sentimentelor, deoarece reduce impactul cuvintelor "zgomotoase" și pune accent pe termenii distinctivi.

Dincolo de Numărare: Alternative Avansate de Vectorizare a Textului

Deși CountVectorizer și TfidfVectorizer sunt instrumente puternice, progresele recente în NLP au adus metode de vectorizare mai sofisticate, capabile să capteze informații semantice și contextuale. Iată câteva alternative populare:

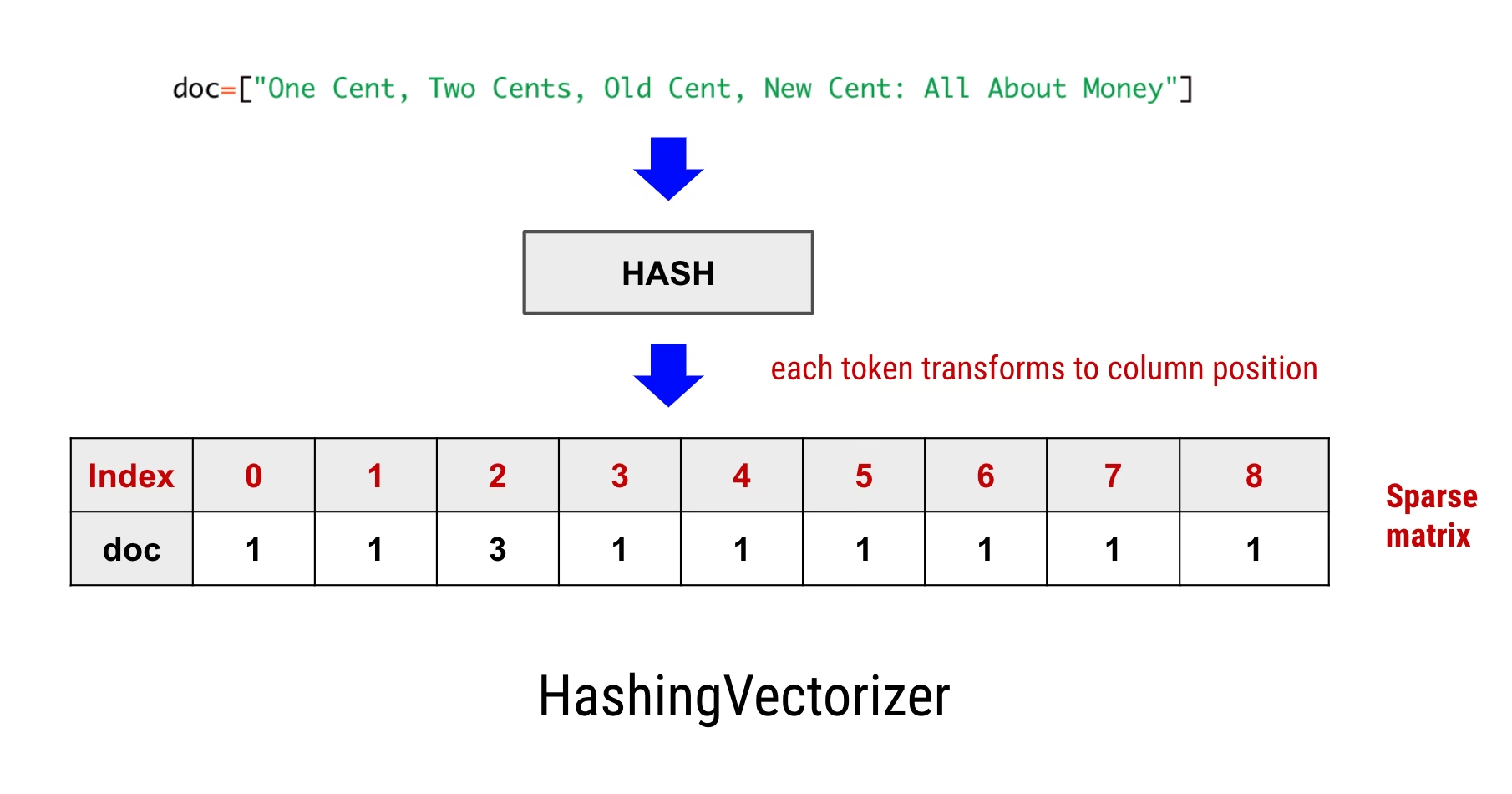

- HashingVectorizer: O alternativă eficientă din punct de vedere al memoriei la CountVectorizer și TfidfVectorizer. În loc să construiască și să stocheze un vocabular, folosește o funcție de hashing pentru a converti direct token-urile în reprezentări numerice. Această abordare evită necesitatea de a păstra întregul vocabular în memorie, dar poate duce la coliziuni (diferite token-uri fiind hash-uite la aceeași valoare).

- Word2Vec: O tehnică de încadrare a cuvintelor (word embedding) care reprezintă cuvintele ca vectori denși într-un spațiu vectorial continuu. Word2Vec surprinde relațiile semantice dintre cuvinte, ținând cont de contextul lor în corporații mari de text. Modelele pre-antrenate Word2Vec sunt disponibile și pot fi utilizate pentru transfer de învățare în diverse sarcini NLP, oferind reprezentări dense, cu dimensiuni reduse, care codifică informații semantice.

- GloVe (Global Vectors for Word Representation): O altă tehnică de încadrare a cuvintelor care învață vectori de cuvinte prin factorizarea unei matrici de co-ocurență a cuvintelor. GloVe combină avantajele contextului global (capturarea relațiilor globale între cuvinte) și contextului local (capturarea relațiilor locale între cuvinte). Vectorii de cuvinte GloVe pre-antrenați sunt disponibili pentru diverse limbi și pot fi utilizați pentru o gamă largă de sarcini NLP.

- BERT (Bidirectional Encoder Representations from Transformers): Un model de limbaj de ultimă generație care utilizează o arhitectură Transformer pentru a capta informații contextuale din text. BERT generează încorporări de cuvinte care iau în considerare atât contextul stâng, cât și cel drept al fiecărui cuvânt. Această capacitate de încadrare contextuală face ca BERT să fie extrem de puternic pentru înțelegerea nuanțată a limbajului. BERT poate fi ajustat fin pentru sarcini specifice sau utilizat ca extractor de caracteristici pentru a obține reprezentări contextuale ale cuvintelor, reprezentând un salt semnificativ în performanța NLP.

Aceste alternative oferă abordări și capabilități diferite pentru vectorizarea textului. Alegerea depinde de sarcina specifică, datele disponibile, importanța informațiilor semantice și resursele computaționale pe care le ai la dispoziție.

Întrebări Frecvente Despre CountVectorizer și Vectorizarea Textului

Ce înseamnă o "matrice rară" (sparse matrix) și de ce este importantă?

O matrice rară este o matrice în care majoritatea elementelor sunt zero. În contextul CountVectorizer, o matrice document-termen este adesea rară deoarece majoritatea cuvintelor din vocabular nu apar în fiecare document. Stocarea explicită a tuturor acestor zerouri ar consuma o cantitate enormă de memorie. Prin urmare, biblioteci precum scikit-learn utilizează formate de stocare optimizate pentru matrici rare, care stochează doar valorile non-zero și coordonatele acestora. Acest lucru economisește semnificativ memorie și accelerează operațiile computaționale, fiind crucial pentru lucrul cu seturi mari de date text.

Poate CountVectorizer să gestioneze mai multe limbi?

Da, CountVectorizer poate fi aplicat textelor în orice limbă. Cu toate acestea, el nu "înțelege" limba în sine. Funcționează pe baza cuvintelor (token-urilor) pe care le identifică. Pentru limbi diferite, vocabularul generat va fi specific acelei limbi. Pentru o preprocesare mai avansată, cum ar fi eliminarea cuvintelor oprite (stop words) sau stemizarea/lematizarea, va trebui să furnizezi liste de cuvinte oprite specifice limbii sau să utilizezi instrumente de preprocesare multilingve.

Cum se tratează cuvintele oprite (stop words) în CountVectorizer?

Implicit, CountVectorizer include toate cuvintele. Pentru a elimina cuvintele oprite (cuvinte comune precum "și", "sau", "este" care adesea nu adaugă mult sens), poți folosi parametrul stop_words. Poți specifica o listă predefinită de cuvinte oprite (de exemplu, stop_words='english' pentru engleză) sau poți furniza o listă personalizată de cuvinte pe care vrei să le excluzi.

Ce sunt n-gramele și cum le folosește CountVectorizer?

N-gramele sunt secvențe consecutive de N cuvinte dintr-un text. De exemplu, "sac de cuvinte" este o 3-gramă (sau trigramă). Utilizarea n-gramelor permite CountVectorizer să captureze un anumit grad de context sau relații între cuvinte adiacente, depășind limitarea abordării "sacului de cuvinte" pure care tratează fiecare cuvânt individual. Poți specifica intervalul de n-grame folosind parametrul ngram_range (de exemplu, ngram_range=(1, 2) va include atât unigrame, cât și bigrame).

Este CountVectorizer potrivit pentru analiza sentimentelor?

CountVectorizer poate fi un punct de plecare pentru analiza sentimentelor, dar are limitări. Deși poate identifica cuvinte frecvente asociate cu un sentiment (ex: "excelent" pentru pozitiv, "teribil" pentru negativ), ignoră ordinea cuvintelor și contextul, ceea ce este crucial pentru nuanțele sentimentului (ex: "nu este rău" vs. "este rău"). Pentru o analiză a sentimentelor mai precisă, sunt adesea preferate metode care captează contextul și semantica, cum ar fi TfidfVectorizer sau chiar încorporările de cuvinte (Word2Vec, BERT).

Concluzie

CountVectorizer este o tehnică de preprocesare a textului fundamentală și eficientă, care transformă documentele text brute într-o reprezentare numerică bazată pe frecvența token-urilor. Acesta furnizează o matrice document-termen care reprezintă apariția token-urilor în fiecare document, fiind ușor de utilizat, eficient din punct de vedere computațional și versatil în ceea ce privește opțiunile de tokenizare.

Cu toate acestea, CountVectorizer are limitări semnificative. Îi lipsește înțelegerea semantică, tratând fiecare token separat fără a capta relațiile semantice dintre ele. Ca urmare, poate fi părtinitor față de cuvintele frecvente, ignorând potențial cuvinte mai rare, dar mai semnificative. De asemenea, nu ia în considerare lungimea documentului și nu surprinde ordinea sau contextul cuvintelor.

Pentru a aborda aceste limitări, au apărut tehnici alternative precum TfidfVectorizer, HashingVectorizer, Word2Vec, GloVe și BERT. Aceste alternative oferă ponderare TF-IDF, eficiență a memoriei, înțelegere semantică, încorporări de cuvinte contextualizate și capacități mai avansate de modelare a limbajului. Alegerea tehnicii de vectorizare a textului depinde de sarcina specifică, de setul de date și de cerințele proiectului tău. Este esențial să iei în considerare compromisurile dintre simplitate, eficiență, interpretare, înțelegere semantică și capabilități avansate de modelare a limbajului pentru a selecta cea mai potrivită tehnică pentru o anumită sarcină de NLP.

Dacă vrei să descoperi și alte articole similare cu Transformă Textul în Date: Ghid CountVectorizer, poți vizita categoria Fitness.