11/12/2023

În lumea fitnessului și a performanței sportive, datele sunt noul aur. Fie că monitorizăm progresul în antrenament, analizăm eficiența unei diete sau prezicem performanțele viitoare, capacitatea de a interpreta corect informațiile numerice este crucială. Dar cum putem găsi tipare și tendințe într-un set de date aparent haotic? Răspunsul stă adesea într-o tehnică matematică puternică, dar surprinzător de intuitivă: Metoda Celor Mai Mici Pătrate. Această metodă este coloana vertebrală a multor analize predictive, de la estimarea prețurilor locuințelor până la optimizarea programelor de antrenament. Pregătește-te să înțelegi cum poți transforma simple puncte de date în predicții valoroase și strategii informate.

- Ce este Metoda Celor Mai Mici Pătrate?

- Cum funcționează: Regresia Liniară Simplă

- Ajustarea Verticală prin Metoda Celor Mai Mici Pătrate

- Extinderea la Modele Polinomiale

- Condiții și Limitări ale Metodei Celor Mai Mici Pătrate

- De ce este Metoda Celor Mai Mici Pătrate atât de populară?

- Aplicații Practice ale Metodei Celor Mai Mici Pătrate

- Întrebări Frecvente

- Concluzie

Ce este Metoda Celor Mai Mici Pătrate?

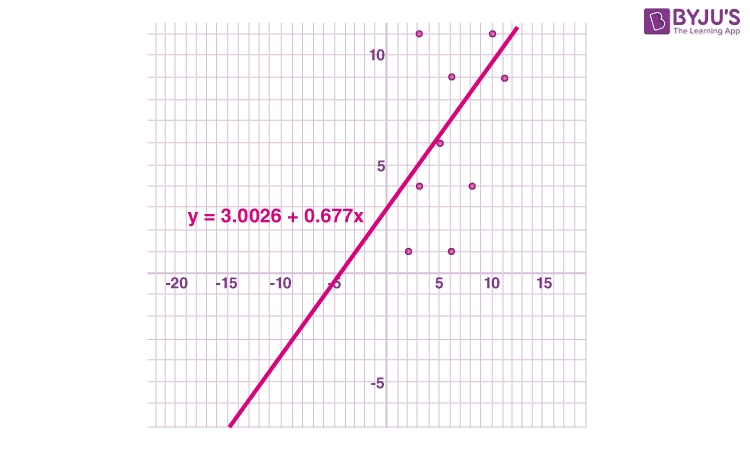

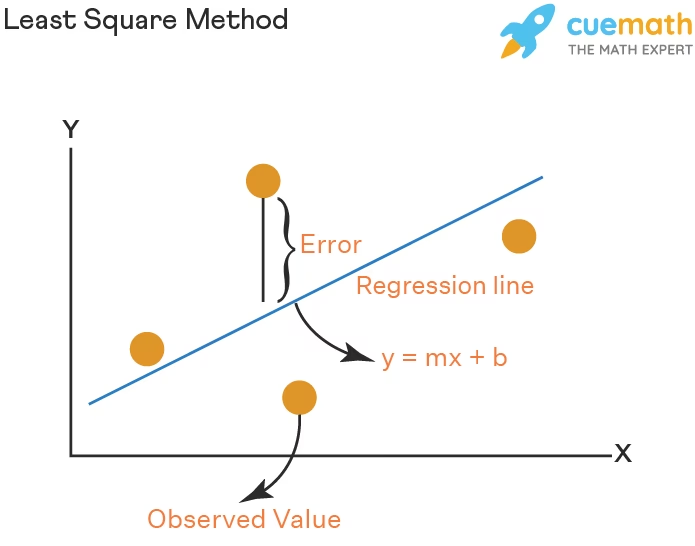

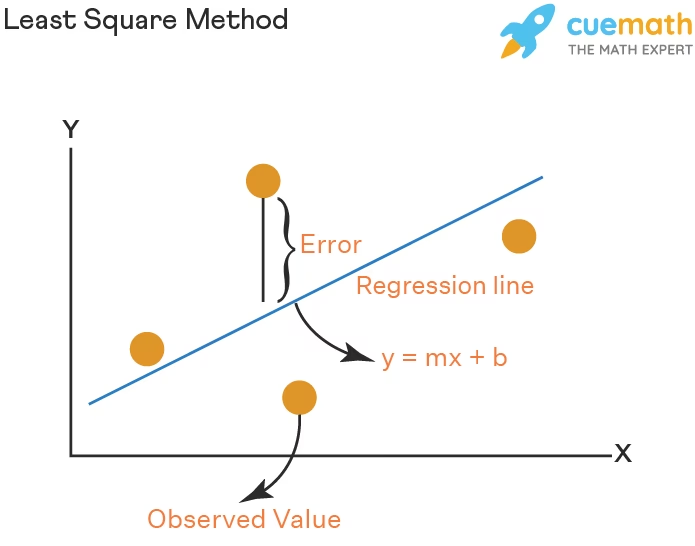

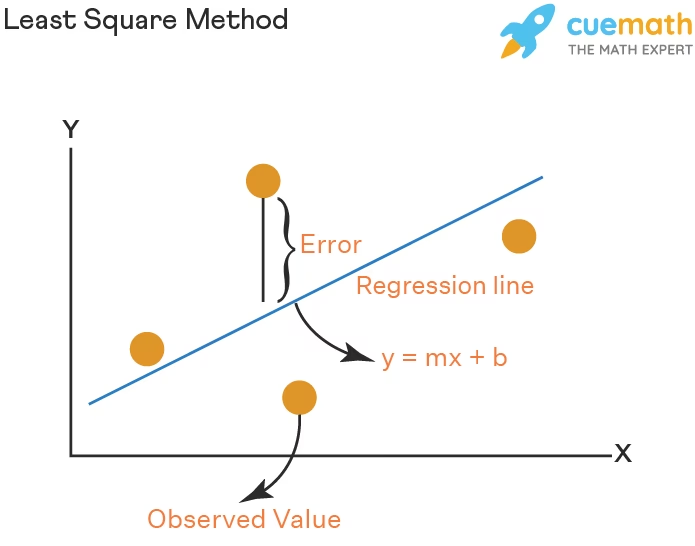

Metoda Celor Mai Mici Pătrate (MCMMP) este o procedură matematică fundamentală utilizată pentru a găsi funcția care se potrivește cel mai bine unui set de date observate. În esență, scopul său este de a minimiza suma pătratelor erorilor (sau reziduurilor), care reprezintă diferența verticală dintre valorile observate și cele prezise de modelul nostru. Gândește-te la ea ca la o modalitate de a trasa o linie (sau o curbă) printr-un nor de puncte, astfel încât distanța totală (pătrată) de la fiecare punct la acea linie să fie cât mai mică posibil.

În termeni mai simpli, dacă ai un set de puncte (x₁, y₁), (x₂, y₂), și așa mai departe, această metodă te ajută să găsești panta și ordonata la origine a unei linii de forma y = mx + q care se potrivește cel mai bine datelor tale. Aceasta se realizează prin minimizarea sumei erorilor pătrate (S):

S = ∑i=1n e²ᵢ = ∑i=1n [yᵢ - f(xᵢ)]²

Unde eᵢ este eroarea pentru fiecare punct, iar f(xᵢ) este valoarea prezisă de funcția noastră. Această abordare este utilizată în mod obișnuit în regresia liniară pentru a estima parametrii unei funcții liniare sau a altor tipuri de modele care descriu relațiile dintre variabile. Este important de reținut că, în general, această metodă poate fi aplicată pentru a găsi o curbă (nu doar o linie dreaptă) care aproximează cel mai bine un set de date observate, minimizând suma diferențelor pătrate (distanțelor verticale) dintre valorile observate și cele prezise de model.

Cum funcționează: Regresia Liniară Simplă

Să luăm în considerare un set de puncte (xᵢ, yᵢ) pentru i = 1, 2, ..., n. Scopul nostru este să găsim parametrii m (panta) și q (ordonata la origine) care minimizează funcția obiectiv, presupunând o relație liniară: y = mx + q.

Aici, y este variabila dependentă (ceea ce încercăm să prezicem), iar x este variabila independentă (ceea ce folosim pentru a prezice). Parametrii m și q sunt aleși pentru a minimiza eroarea, măsurată ca suma diferențelor pătrate dintre valorile observate yᵢ și valorile prezise yprezis. Funcția pe care o minimizăm este:

S(m, q) = ∑i=1n (yᵢ - (mxᵢ + q))²

Pentru a găsi valorile lui m și q care minimizează această sumă, se folosesc derivatele parțiale, dar pentru ușurința înțelegerii, vom prezenta direct formulele rezultate din aceste calcule. Primul pas este calcularea pantei m:

m = (n × ∑(xᵢyᵢ) - ∑xᵢ × ∑yᵢ) / (n × ∑xᵢ² - (∑xᵢ)²)

Unde:

- n este numărul de puncte,

- ∑xᵢ este suma tuturor valorilor x,

- ∑yᵢ este suma tuturor valorilor y,

- ∑xᵢ² este suma pătratelor valorilor x,

- ∑(xᵢyᵢ) este suma produselor xᵢ și yᵢ.

Apoi, calculăm ordonata la origine q:

q = (∑yᵢ - m × ∑xᵢ) / n

Odată ce m și q sunt determinate, putem scrie ecuația liniei de regresie: y = mx + q. Aceasta este funcția liniară care se potrivește cel mai bine datelor.

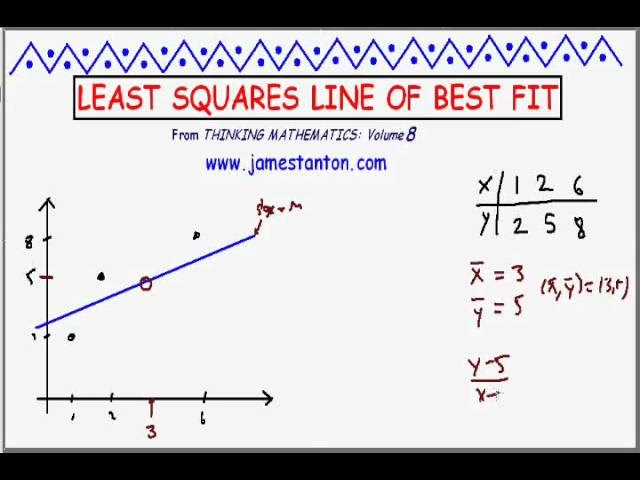

Exemplu Practic de Regresie Liniară

Să parcurgem un exemplu practic cu un set de date experimentale pentru o variabilă independentă x și o variabilă dependentă y:

| x | y |

|---|---|

| 1 | 2 |

| 2 | 3 |

| 3 | 5 |

| 4 | 4 |

| 5 | 6 |

Avem n = 5 puncte. Vrem să găsim linia de regresie y = mx + q care se potrivește cel mai bine acestor puncte.

Mai întâi, calculăm valorile necesare pentru formule:

- ∑xᵢ = 1 + 2 + 3 + 4 + 5 = 15

- ∑yᵢ = 2 + 3 + 5 + 4 + 6 = 20

- ∑xᵢ² = 1² + 2² + 3² + 4² + 5² = 1 + 4 + 9 + 16 + 25 = 55

- ∑(xᵢyᵢ) = (1×2) + (2×3) + (3×5) + (4×4) + (5×6) = 2 + 6 + 15 + 16 + 30 = 69

Acum, substituim aceste valori în formula pentru pantă (m), ținând cont că n = 5:

m = (5 × 69 - 15 × 20) / (5 × 55 - 15²)

m = (345 - 300) / (275 - 225)

m = 45 / 50

m = 0.9

Panta m = 0.9 indică faptul că pentru fiecare creștere de 1 unitate în x, y crește cu aproximativ 0.9 unități.

Apoi, calculăm ordonata la origine (q):

q = (∑yᵢ - m × ∑xᵢ) / n

q = (20 - 0.9 × 15) / 5

q = (20 - 13.5) / 5

q = 6.5 / 5

q = 1.3

Ordonata la origine q = 1.3 este valoarea lui y atunci când x = 0.

Cu panta m = 0.9 și ordonata la origine q = 1.3, ecuația liniei de regresie este:

y = 0.9x + 1.3

Această linie minimizează suma erorilor pătrate dintre valorile observate yᵢ și valorile prezise yprezis. Să calculăm aceste erori:

| x | y | y prezis (0.9x + 1.3) | e = y - y prezis | e² |

|---|---|---|---|---|

| 1 | 2 | 0.9(1) + 1.3 = 2.2 | 2 - 2.2 = -0.2 | 0.04 |

| 2 | 3 | 0.9(2) + 1.3 = 3.1 | 3 - 3.1 = -0.1 | 0.01 |

| 3 | 5 | 0.9(3) + 1.3 = 4.0 | 5 - 4.0 = 1.0 | 1.00 |

| 4 | 4 | 0.9(4) + 1.3 = 4.9 | 4 - 4.9 = -0.9 | 0.81 |

| 5 | 6 | 0.9(5) + 1.3 = 5.8 | 6 - 5.8 = 0.2 | 0.04 |

| Suma erorilor pătrate (S) | 1.90 | |||

Suma erorilor pătrate este S = 0.04 + 0.01 + 1.00 + 0.81 + 0.04 = 1.9. Această valoare este cea mai mică posibilă pentru acest set de date cu un model liniar.

Ajustarea Verticală prin Metoda Celor Mai Mici Pătrate

În practică, aproape întotdeauna se minimizează abaterile verticale (reziduurile) de la o linie (sau polinom, suprafață, hiperplan etc.), în loc de abaterile perpendiculare. Această alegere are mai multe avantaje:

- Oferă o funcție de ajustare pentru variabila dependentă care estimează y pentru un x dat (ceea ce un experimentator dorește cel mai adesea).

- Permite încorporarea simplă a incertitudinilor punctelor de date de-a lungul axelor x și y.

- Oferă o formă analitică mult mai simplă pentru parametrii de ajustare decât ar fi obținută folosind o ajustare bazată pe abateri perpendiculare.

- Tehnica de ajustare poate fi generalizată ușor de la o linie de potrivire optimă la un polinom de potrivire optimă atunci când se utilizează sume de distanțe verticale.

Deși suma distanțelor ne-pătrate ar putea părea o cantitate mai adecvată de minimizat, utilizarea valorii absolute rezultă în derivate discontinue care nu pot fi tratate analitic. Prin urmare, abaterile pătrate de la fiecare punct sunt însumate, iar reziduul rezultat este apoi minimizat pentru a găsi linia de ajustare optimă. Un aspect important al acestei abordări este că punctele aberante (outliers) pot avea un efect disproporționat asupra ajustării, o proprietate care poate fi sau nu de dorit, în funcție de problema în cauză.

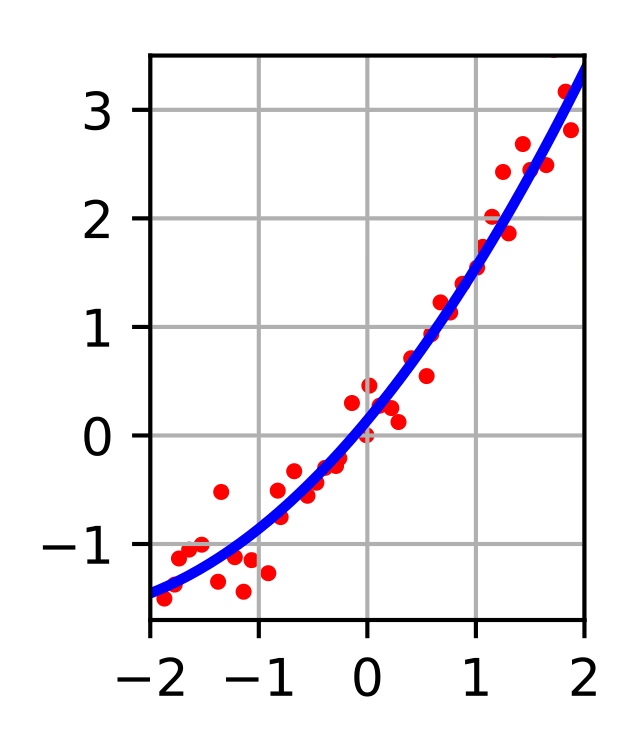

Extinderea la Modele Polinomiale

Metoda Celor Mai Mici Pătrate nu se limitează doar la linii drepte. Ea poate fi extinsă la modele polinomiale (curbe în loc de linii) sau la modele mai complexe, printr-o versiune mai avansată numită metoda generalizată a celor mai mici pătrate. Ideea rămâne aceeași: găsim parametrii modelului care minimizează suma pătratelor erorilor.

De exemplu, dacă datele tale par să urmeze o curbă, ai putea alege un model polinomial de gradul doi (o parabolă), de forma: y = θ₁ + θ₂x + θ₃x². Aici, θ₁, θ₂, θ₃ sunt parametrii pe care trebuie să-i găsim. Procesul implică definirea unor funcții de bază (în acest caz, 1, x și x²) și apoi rezolvarea unui sistem de ecuații liniare pentru a găsi coeficienții θ.

Să luăm un exemplu de date unde o curbă ar fi mai potrivită:

| x | y |

|---|---|

| -4 | 5 |

| 0 | 1 |

| 1 | 3 |

| 2 | 9 |

| -6 | 10 |

Vizualizând aceste puncte, o parabolă pare o potrivire bună. Modelul nostru ar fi &hatf(x) = θ₁ + θ₂x + θ₃x². Pentru a rezolva acest sistem, am crea o matrice A unde fiecare rând corespunde unui punct de date, iar coloanele sunt valorile funcțiilor de bază (1, x, x²) evaluate la acel punct. De exemplu, pentru primul punct (-4, 5), rândul ar fi [1, -4, 16]. Vectorul y ar fi [5, 1, 3, 9, 10]T. Atunci am rezolva sistemul Aθ = y folosind metoda celor mai mici pătrate. Deși calculul manual devine extrem de complex pentru astfel de cazuri, software-uri precum Python sau MATLAB pot găsi rapid soluția. Pentru acest exemplu, coeficienții (vectorul θ) ar fi aproximativ:

- θ₁ ≈ 1.861

- θ₂ ≈ 1.809

- θ₃ ≈ 0.550

Astfel, funcția polinomială de ajustare ar fi &hatf(x) = 1.861 + 1.809x + 0.550x².

Condiții și Limitări ale Metodei Celor Mai Mici Pătrate

Deși Metoda Celor Mai Mici Pătrate este extrem de versatilă, aplicarea sa optimă depinde de îndeplinirea anumitor condiții:

- Liniaritate: Datele ar trebui să prezinte o tendință liniară (sau să poată fi transformate într-o formă liniară, cum ar fi logaritmarea, pentru modele exponențiale). Dacă există o tendință non-liniară evidentă și nu se aplică un model polinomial adecvat, rezultatele pot fi înșelătoare.

- Reziduurile aproape normale: Deși nu este o cerință strictă pentru calculul parametrilor, se presupune adesea că reziduurile (erorile) sunt distribuite aproximativ normal. Abaterile semnificative de la această condiție pot indica prezența unor valori aberante sau a unui model inadecvat.

- Variabilitate constantă (Homoscedasticitate): Variația punctelor în jurul liniei de regresie ar trebui să rămână aproximativ constantă pe tot parcursul intervalului de date. Dacă variabilitatea crește sau scade odată cu valoarea variabilei independente, aceasta este o problemă numită heteroscedasticitate și poate afecta validitatea inferențelor statistice.

- Fără erori de măsurare semnificative în variabila independentă: Metoda presupune că variabila independentă (x) este măsurată fără erori sau cu erori neglijabile.

- Independența observațiilor: Fiecare observație ar trebui să fie independentă de celelalte. Acest lucru este important, mai ales în cazul seriilor de timp, unde observațiile succesive pot fi corelate.

O limitare majoră este extrapolarea. Aplicarea modelului estimat la valori din afara intervalului datelor originale este riscantă. Un model liniar este doar o aproximare a relației reale dintre două variabile, iar această aproximare poate să nu fie valabilă în afara domeniului observat. De exemplu, prezicerea ajutorului financiar pentru un venit familial extrem de mare ar putea duce la un ajutor negativ, ceea ce este absurd.

De ce este Metoda Celor Mai Mici Pătrate atât de populară?

Popularitatea MCMMP se datorează mai multor factori:

- Simplitate computațională: Formulele pentru calculul coeficienților sunt relativ simple și pot fi implementate ușor, chiar și manual pentru cazuri simple, sau eficient cu ajutorul computerelor pentru seturi mari de date.

- Proprietăți statistice: Sub anumite presupuneri (cum ar fi erorile normal distribuite), estimează parametrii cu cea mai mică varianță posibilă, făcându-l un estimator eficient.

- Diferențiabilitate: Utilizarea pătratelor erorilor face ca funcția de minimizat să fie continuă și diferențiabilă, ceea ce permite utilizarea calculului diferențial pentru a găsi soluția analitică. Aceasta este esențială pentru derivarea formulelor de calcul.

- Interpretare intuitivă: Conceptul de a minimiza distanțele (pătrate) este ușor de înțeles și de explicat, chiar și pentru cei fără un background matematic aprofundat.

Aplicații Practice ale Metodei Celor Mai Mici Pătrate

Metoda Celor Mai Mici Pătrate are o multitudine de aplicații în diverse domenii:

- În Fitness și Sport:

- Prezicerea performanței: Analiza relației dintre orele de antrenament și rezultatele la competiții (ex: timpul la maraton, greutatea ridicată).

- Monitorizarea progresului: Urmărirea evoluției greutății corporale, a procentului de grăsime sau a forței musculare în funcție de durata unui program de antrenament.

- Optimizarea antrenamentelor: Identificarea parametrilor de antrenament (volum, intensitate) care duc la cele mai bune rezultate, minimizând riscul de supracompensare sau accidentări.

- Analiza dietei: Corelarea aportului caloric sau a macronutrienților cu modificările compoziției corporale.

- În Economie și Finanțe: Estimarea tendințelor pieței bursiere, previzionarea vânzărilor, modelarea inflației.

- În Știință și Inginerie: Ajustarea curbelor pentru date experimentale în fizică și chimie, calibrarea senzorilor, modelarea creșterii populației.

- În Științele Sociale: Analiza relațiilor dintre variabile demografice, comportamentale sau psihologice.

Întrebări Frecvente

Datorită complexității aparente a metodei, apar adesea anumite neclarități. Iată câteva dintre cele mai comune întrebări:

Care este diferența dintre Metoda Celor Mai Mici Pătrate și Regresia Liniară?

Regresia liniară este o tehnică statistică utilizată pentru a modela relația liniară dintre o variabilă dependentă și una sau mai multe variabile independente. Metoda Celor Mai Mici Pătrate este metoda specifică (algoritmul) folosită pentru a găsi parametrii (panta și ordonata la origine) ai acelei linii de regresie. Cu alte cuvinte, regresia liniară este scopul, iar Metoda Celor Mai Mici Pătrate este mijlocul prin care se atinge acel scop, asigurând că linia rezultată este cea mai bună potrivire posibilă conform criteriului de minimizare a erorilor pătrate.

De ce se folosesc erorile pătrate în loc de erorile absolute?

Există două motive principale: primul, și cel mai important din punct de vedere matematic, este că funcția de sumă a erorilor pătrate este continuă și diferențiabilă. Această proprietate permite utilizarea calculului diferențial pentru a găsi o soluție analitică exactă pentru parametrii optimi. În contrast, suma erorilor absolute are derivate discontinue, ceea ce face mult mai dificilă găsirea unei soluții analitice. Al doilea motiv este că pătratul erorilor penalizează mai mult abaterile mari. O eroare de 2 unități contribuie cu 4 la suma totală, în timp ce o eroare de 4 unități contribuie cu 16. Acest lucru înseamnă că modelul va fi puternic influențat de punctele care sunt departe de linia de regresie, încercând să le "tragă" mai aproape de linie.

Poate fi folosită Metoda Celor Mai Mici Pătrate pentru date neliniare?

Absolut! Deși exemplul principal este regresia liniară, conceptul poate fi extins la modele neliniare în două moduri: fie prin transformarea datelor pentru a le face liniare (de exemplu, logaritmarea datelor pentru a se potrivi unui model exponențial), fie prin utilizarea regresiei polinomiale (cum am discutat) sau a unor forme mai avansate de regresie neliniară. În aceste cazuri, deși relația dintre variabile poate fi neliniară, modelul în sine este "liniar în parametri", permițând aplicarea variațiilor metodei celor mai mici pătrate.

Care sunt limitările principale ale acestei metode?

Principalele limitări includ sensibilitatea la outliers (valori aberante), care pot distorsiona semnificativ linia de regresie din cauza penalizării mari a erorilor pătrate. De asemenea, presupune că erorile sunt independente și au varianță constantă. Dacă aceste presupuneri sunt încălcate, modelul poate să nu fie cel mai eficient sau să ofere predicții înșelătoare. Extrapolarea (previzionarea în afara intervalului datelor observate) este, de asemenea, o limitare majoră, deoarece modelul liniar este doar o aproximare și poate să nu fie valabil în domenii neobservate.

Concluzie

Metoda Celor Mai Mici Pătrate este un instrument incredibil de puternic și versatil în arsenalul oricărui pasionat de date, fie că ești un analist financiar, un cercetător științific sau un entuziast al fitnessului. Prin minimizarea erorilor pătrate, această metodă ne permite să extragem tendințe clare din seturi complexe de date, oferind o bază solidă pentru predicții și decizii informate. Înțelegând cum funcționează și care sunt limitările sale, poți folosi MCMMP pentru a-ți îmbunătăți semnificativ capacitatea de a interpreta lumea din jurul tău și, mai ales, de a-ți optimiza propria călătorie către performanță și sănătate.

Dacă vrei să descoperi și alte articole similare cu Metoda Celor Mai Mici Pătrate: Ghid Complet, poți vizita categoria Fitness.