15/05/2022

În era digitală, volumul de date generat crește exponențial. De la imagini și videoclipuri la texte complexe și seturi de date numerice, nevoia de a prelucra, stoca și analiza eficient aceste informații devine crucială. Aici intervin autoencoderele, o clasă puternică de rețele neuronale care oferă soluții inovatoare pentru compresia datelor și reducerea zgomotului. Acestea reprezintă o abordare de învățare nesupravegheată care permite unei rețele neuronale să învețe cum să encodeze și să decodeze cel mai bine anumite date, descoperind reprezentări compacte și semnificative ale acestora.

Deși există o varietate de tipuri de autoencodere, cum ar fi autoencoderele variaționale (VAE) sau cele sparse, în acest articol ne vom concentra pe două dintre cele mai utilizate și fundamentale tipuri: Autoencoderele Convoluționale și Autoencoderele de Denoisare. Vom explora principiile lor de funcționare, arhitecturile specifice și aplicațiile practice, demonstrând cum pot simplifica inputul pentru modele mai complexe și pot îmbunătăți calitatea datelor.

- Ce Sunt Autoencoderele și Cum Funcționează?

- Autoencoderele Convoluționale (CAE)

- Autoencoderele de Denoisare (DAE)

- Comparație: Autoencodere Convoluționale vs. Autoencodere de Denoisare

- De Ce Să Folosim Autoencoderele?

- Întrebări Frecvente (FAQ)

- 1. Sunt autoencoderele o formă de învățare supravegheată sau nesupravegheată?

- 2. Care este diferența cheie între un autoencoder și PCA (Analiza Componentelor Principale)?

- 3. Pot fi folosite autoencoderele pentru generare de date?

- 4. Ce biblioteci Python sunt folosite pentru implementarea autoencoderelor?

- 5. Ce este "spațiul latent" într-un autoencoder?

Ce Sunt Autoencoderele și Cum Funcționează?

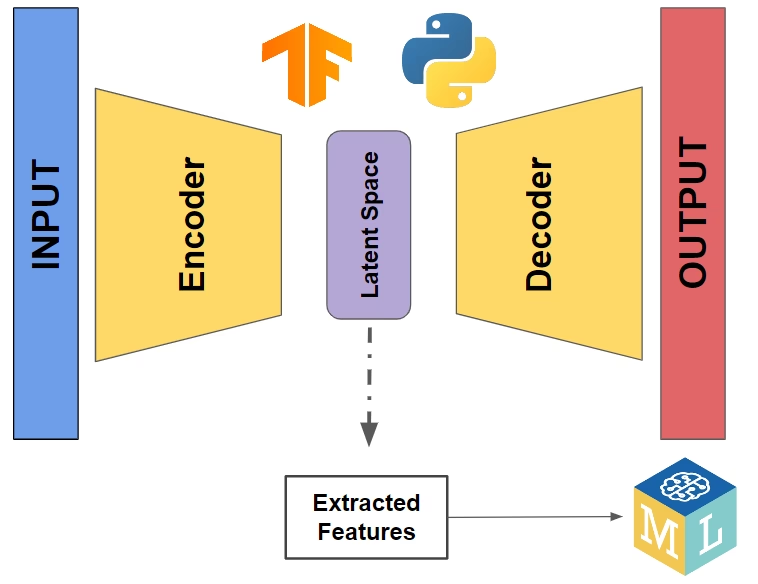

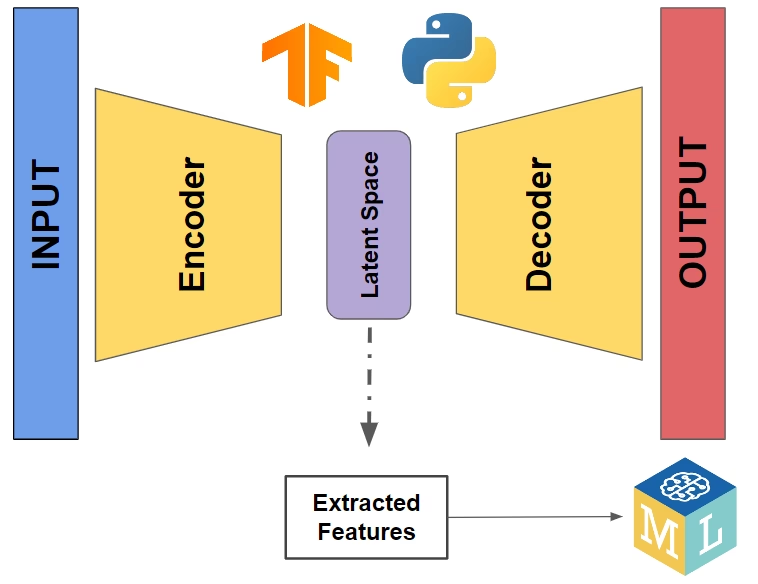

La baza lor, autoencoderele sunt rețele neuronale concepute pentru a învăța o reprezentare compactă (sau "cod") a datelor de intrare. Ele sunt structurate în două părți principale:

- Encoderul: Această parte a rețelei ia datele de intrare și le transformă într-o reprezentare de dimensiune mai mică, adesea numită spațiu latent sau cod. Procesul de codificare implică extragerea celor mai relevante caracteristici și eliminarea redundanței. Gândiți-vă la el ca la un filtru inteligent care distilează esența informației.

- Decoderul: Această parte ia codul generat de encoder și încearcă să reconstruiască datele de intrare originale cât mai fidel posibil. Misiunea decoderului este de a învăța cum să "despacheteze" informația comprimată pentru a o readuce la forma inițială.

Întregul proces este antrenat prin minimizarea erorii de reconstrucție, adică diferența dintre datele de intrare originale și datele reconstruite. Deoarece nu necesită etichete de ieșire (output labels), autoencoderele se încadrează în categoria algoritmilor de învățare nesupravegheată. Ele sunt deosebit de utile pentru sarcini precum:

- Compresia datelor: Reducerea dimensionalității datelor fără a pierde informații semnificative.

- Reducerea zgomotului: Eliminarea elementelor nedorite sau irelevante din date.

- Extracția de caracteristici: Învățarea unor reprezentări bogate și abstracte ale datelor care pot fi utilizate apoi de alte modele de învățare automată.

Un avantaj major al autoencoderelor este capacitatea lor de a învăța reprezentări neliniare ale datelor, spre deosebire de tehnici liniare precum PCA (Analiza Componentelor Principale). Acest lucru le permite să capteze relații complexe în date, făcându-le extrem de versatile.

Autoencoderele Convoluționale (CAE)

Autoencoderele convoluționale, sau CAE (Convolutional Autoencoders), sunt o variantă specializată a autoencoderelor, optimizată pentru procesarea datelor cu o structură spațială, cum ar fi imaginile. Ele utilizează straturi convoluționale atât în partea de encoder, cât și în cea de decoder, profitând de capacitatea acestor straturi de a detecta caracteristici locale și de a menține informațiile spațiale.

Arhitectura și Funcționarea CAE

Encoderul CAE: Partea de encoder a unui CAE este, în esență, o rețea neuronală convoluțională (CNN) tipică. Aceasta include:

- Straturi Convoluționale: Aplică filtre pentru a extrage caracteristici locale (margini, texturi, forme). Fiecare filtru scanează imaginea, creând hărți de caracteristici. Acestea permit rețelei să înțeleagă tiparele spațiale din date.

- Straturi de Pooling (ex: MaxPooling): Reduc dimensiunea spațială a hărților de caracteristici, ajutând la generalizare și la reducerea numărului de parametri. Acest proces creează un "gât de sticlă" informațional, forțând encoderul să învețe o reprezentare extrem de compactă și eficientă, adică spațiul latent.

- Straturi Dense (opțional): La finalul encoderului, hărțile de caracteristici sunt adesea aplatizate și trecute printr-un strat dens pentru a forma vectorul final al spațiului latent.

Decoderul CAE: Partea de decoder este o imagine în oglindă a encoderului, având rolul de a reconstrui imaginea originală din vectorul spațiului latent. Acesta utilizează:

- Straturi Deconvoluționale (sau Transposed Convolutional): Acestea sunt opuse straturilor convoluționale, având rolul de a mări dimensiunea spațială a hărților de caracteristici. Ele "extind" informația din spațiul latent pentru a recrea detalii vizuale, învățând cum să "umple" spațiile și să genereze structura imaginii.

- Straturi de Unpooling (opțional): Complementare straturilor de pooling, ajută la restaurarea dimensiunilor spațiale, ghidând procesul de reconstrucție.

- Straturi Convoluționale Finale: Reconstruiesc imaginea pixel cu pixel, încercând să minimizeze diferențele față de original.

Aplicații ale CAE

CAE-urile sunt extrem de eficiente pentru:

- Compresia imaginilor: Pot comprima imagini la reprezentări mult mai mici, menținând un nivel ridicat de fidelitate la reconstrucție. Aceasta este o formă de compresie cu pierderi, dar optimizată pentru învățare, permițând stocarea și transmiterea eficientă a datelor vizuale.

- Reducerea dimensionalității pentru date vizuale: Extragerea de caracteristici semnificative din imagini care pot fi apoi folosite pentru sarcini de clasificare, detectare de obiecte sau recunoaștere facială. Encoderul devine un extractor de caracteristici puternic.

- Denoising-ul imaginilor: Deși există autoencodere dedicate pentru denoisare, CAE-urile pot fi adaptate pentru a curăța imagini prin învățarea de a ignora zgomotul și de a reconstrui imaginea curată.

- Generare de imagini (cu modificări): Deși nu sunt VAE-uri, prin manipularea spațiului latent, pot fi folosite pentru a genera noi imagini sau pentru a modifica atributele imaginilor existente, oferind un control fin asupra proprietăților vizuale.

Autoencoderele de Denoisare (DAE)

Autoencoderele de Denoisare, sau DAE (Denoising Autoencoders), sunt o altă variantă specială de autoencodere, concepute pentru a învăța o reprezentare robustă a datelor prin eliminarea zgomotului. Scopul lor principal este să reconstruiască o intrare "curată" dintr-o intrare "coruptă" sau zgomotoasă.

Cum Funcționează DAE

Spre deosebire de autoencoderele standard care încearcă să reconstruiască intrarea originală, DAE-urile sunt antrenate printr-un proces ingenios, care le permite să învețe să distingă semnalul de zgomot:

- Coruperea Intenționată a Datelor: Înainte de a fi introduse în rețea, datele originale sunt corupte în mod intenționat. Aceasta poate implica adăugarea de zgomot Gaussian (valori aleatorii distribuite normal), zgomot "sare și piper" (salt-and-pepper noise, unde pixeli aleatori devin albi sau negri), mascarea aleatorie a unor pixeli sau chiar inversarea aleatorie a valorilor. Gradul și tipul de zgomot adăugat sunt cruciale pentru performanța DAE.

- Procesul de Codificare și Decodificare: Datele corupte sunt apoi transmise prin encoder și decoder, la fel ca într-un autoencoder standard. Encoderul încearcă să extragă caracteristicile esențiale din datele zgomotoase, iar decoderul încearcă să le reconstruiască.

- Reconstrucția Datelor Originale: Obiectivul rețelei nu este de a reconstrui datele corupte, ci de a reconstrui versiunea originală, curată a datelor de intrare. Prin antrenament repetat pe mii de exemple de date corupte și curate, rețeaua învață să identifice și să ignore zgomotul, extrăgând doar caracteristicile esențiale și robuste ale datelor. Această capacitate de a "curăța" inputul este fundamentul utilității DAE.

Acest mecanism forțează autoencoderul să învețe o reprezentare a datelor care este mai puțin sensibilă la perturbațiile minore și la zgomot, deoarece trebuie să "recupereze" informația curată dintr-o intrare imperfectă. Prin urmare, spațiul latent învățat de un DAE este mai robust și mai semnificativ pentru reprezentarea datelor reale, fiind un instrument excelent pentru reducerea zgomotului.

Aplicații ale DAE

DAE-urile sunt extrem de utile în scenarii unde datele sunt adesea zgomotoase sau incomplete, contribuind semnificativ la îmbunătățirea calității datelor:

- Reducerea Zgomotului (Noise Reduction): Curățarea imaginilor medicale (pentru o diagnosticare mai precisă), a înregistrărilor audio (pentru o claritate sporită), a datelor de senzori (pentru fiabilitate) sau a oricărui tip de date cu zgomot. Aceasta este o aplicație directă și foarte eficientă, esențială în multe domenii.

- Imputarea Datelor (Data Imputation): Completarea valorilor lipsă într-un set de date, tratând valorile lipsă ca pe un tip de zgomot sau corupere a datelor. DAE-ul poate prezice valorile lipsă pe baza contextului datelor existente.

- Pre-antrenare pentru Rețele Neuronale Profunde: O reprezentare robustă învățată de un DAE poate servi ca o bună inițializare pentru straturile unei rețele neuronale mai profunde, ajutând la convergența mai rapidă și la performanțe mai bune, în special în sarcinile de clasificare.

- Extracția de Caracteristici: Codul învățat de un DAE este o reprezentare de înaltă calitate, fără zgomot, a datelor, utilă pentru sarcini ulterioare de învățare automată, cum ar fi clustering-ul sau clasificarea.

Comparație: Autoencodere Convoluționale vs. Autoencodere de Denoisare

Deși ambele sunt autoencodere și pot avea aplicații care se suprapun, ele sunt optimizate pentru scopuri ușor diferite și utilizează mecanisme de antrenament specifice, ceea ce le face potrivite pentru diverse scenarii.

| Caracteristică | Autoencoder Convoluțional (CAE) | Autoencoder de Denoisare (DAE) |

|---|---|---|

| Scop Principal | Compresia datelor spațiale (ex: imagini), extracția de caracteristici spațiale relevante. | Reducerea zgomotului, învățarea reprezentărilor robuste ale datelor prin curățare. |

| Tipuri de Date Optime | Imagini, date video, date medicale (RMN, CT), semnale unidimensionale (audio). | Orice tip de date afectate de zgomot (imagini, text, audio, date numerice structurate). |

| Mecanism de Antrenament | Reconstruiește intrarea originală curată din aceeași intrare curată, prin compresie. | Reconstruiește intrarea originală curată dintr-o versiune coruptă/zgomotoasă a intrării. |

| Beneficiu Cheie | Eficiență în capturarea ierarhiilor spațiale și reducerea dimensionalității pentru vizualizare. | Robustete la zgomot și capacitatea de a curăța datele, sporind calitatea. |

| Arhitectură Tipică | Folosește predominant straturi convoluționale și de deconvoluție, cu pooling/unpooling. | Poate folosi straturi dense sau convoluționale, în funcție de tipul datelor și de complexitatea zgomotului. |

| Natura Reprezentării | Reprezentare densă, compactă, optimizată pentru compresie și relevanță spațială. | Reprezentare robustă, rezistentă la perturbații, ideală pentru date din lumea reală. |

De Ce Să Folosim Autoencoderele?

Utilitatea autoencoderelor transcende simpla compresie sau curățare. Ele oferă soluții elegante pentru o serie de provocări în inteligența artificială, optimizând fluxurile de lucru și îmbunătățind performanța modelelor:

- Reducerea Dimensionalității și Compresia Datelor: Prin învățarea unei reprezentări compacte în spațiul latent, autoencoderele pot reduce drastic numărul de caracteristici necesare pentru a descrie datele, fără a pierde informații critice. Acest lucru este esențial pentru gestionarea seturilor de date mari, reducând cerințele de stocare și timpul de procesare.

- Pre-antrenare Eficientă: Encoderul unui autoencoder antrenat poate fi utilizat ca un extractor de caracteristici puternic pentru alte modele de învățare automată. De exemplu, un encoder antrenat pe un set mare de imagini poate fi atașat unui model Transformer (care preferă inputuri vectoriale) pentru sarcini de viziune computerizată, iar parametrii săi pot fi înghețați sau ajustați fin. Această tehnică de transfer de învățare accelerează antrenamentul și îmbunătățește performanța, mai ales pe seturi de date mai mici.

- Curățarea și Restaurarea Datelor: Capacitatea autoencoderelor de denoisare de a elimina zgomotul și de a completa datele lipsă le face indispensabile în aplicații unde calitatea datelor este o problemă critică, cum ar fi în imagistica medicală sau în sistemele de senzori.

- Detectarea Anomaliilor: Autoencoderele pot fi utilizate pentru a detecta anomalii. Dacă o intrare este neobișnuită (adică nu se conformează pattern-urilor învățate), autoencoderul va avea o eroare de reconstrucție mare, semnalând o potențială anomalie, util în detecția fraudelor sau a defectelor de fabricație.

Întrebări Frecvente (FAQ)

1. Sunt autoencoderele o formă de învățare supravegheată sau nesupravegheată?

Autoencoderele sunt o formă de învățare nesupravegheată. Deși au o "țintă" (datele de intrare în sine, sau o versiune curată a acestora), ele nu necesită etichete manuale. Ele învață să reconstruiască datele de intrare, ceea ce le permite să descopere structuri interne și reprezentări fără supraveghere explicită umană.

2. Care este diferența cheie între un autoencoder și PCA (Analiza Componentelor Principale)?

Atât autoencoderele, cât și PCA sunt folosite pentru reducerea dimensionalității. Diferența fundamentală este că PCA este o tehnică liniară, ceea ce înseamnă că poate găsi doar transformări liniare ale datelor. Autoencoderele, fiind rețele neuronale, pot învăța transformări neliniare complexe, permițându-le să capteze relații mult mai complicate în date și să obțină o compresie mai eficientă în multe cazuri, mai ales cu date de înaltă dimensionalitate precum imaginile.

3. Pot fi folosite autoencoderele pentru generare de date?

Autoencoderele standard (CAE, DAE) nu sunt concepute primar pentru generare de date noi, ci pentru reconstrucție și compresie. Cu toate acestea, variante precum Autoencoderele Variaționale (VAE) sunt special concepute pentru generare probabilistică de date, permițând crearea de noi instanțe de date care seamănă cu cele din setul de antrenament prin eșantionarea din spațiul latent.

4. Ce biblioteci Python sunt folosite pentru implementarea autoencoderelor?

Cele mai populare biblioteci Python pentru construirea și antrenarea autoencoderelor includ Keras (care rulează pe TensorFlow) și PyTorch. Acestea oferă API-uri intuitive și flexibile pentru definirea arhitecturilor de rețele neuronale și pentru gestionarea eficientă a procesului de antrenament pe diverse tipuri de hardware.

5. Ce este "spațiul latent" într-un autoencoder?

Spațiul latent (sau "latent space" în engleză) este reprezentarea comprimată și abstractă a datelor de intrare, generată de encoder. Este un vector de dimensiune mult mai mică decât datele originale, dar care conține esența informației, adică cele mai relevante caracteristici. Calitatea spațiului latent determină cât de bine poate decoderul reconstrui datele originale. Este, în esență, "limbajul" intern al autoencoderului pentru a descrie datele, într-o formă densă și semnificativă.

Autoencoderele reprezintă o piatră de temelie în domeniul învățării automate nesupravegheate, oferind soluții elegante pentru provocările legate de volumul și calitatea datelor. De la compresia imaginilor la curățarea seturilor de date zgomotoase, capacitatea lor de a învăța reprezentări eficiente și robuste le face instrumente indispensabile în arsenalul oricărui specialist în inteligență artificială. Prin înțelegerea și aplicarea variantelor precum Autoencoderele Convoluționale și cele de Denoisare, deschidem noi orizonturi pentru prelucrarea și analiza inteligentă a informației, contribuind la avansul continuu al tehnologiei.

Dacă vrei să descoperi și alte articole similare cu Descoperă Autoencoderele: Compresie și Curățare a Datelor, poți vizita categoria Fitness.