29/10/2025

În lumea dinamică a procesării limbajului natural (NLP), capacitatea de a extrage sens din volume mari de text este crucială. Două tehnici fundamentale care au revoluționat acest domeniu sunt Latent Dirichlet Allocation (LDA) pentru modelarea subiectelor și Word2Vec pentru crearea de reprezentări vectoriale ale cuvintelor. Ambele sunt implementate eficient în biblioteca Python Gensim, oferind instrumente puternice pentru analiza textului. Acest articol explorează în detaliu cum să optimizăm antrenamentul modelelor LDA și să înțelegem mecanismele și aplicațiile Word2Vec, asigurându-vă că obțineți cele mai bune rezultate din datele dumneavoastră.

- Optimizarea Antrenamentului Modelelor LDA în Gensim: Pasi și Iterații

- Pasi (passes): Antrenamentul pe Întregul Corpus

- Iterații (iterations): Profunzimea Antrenamentului per Document

- Importanța Alegerii Hiperparametrilor Corecți

- Utilizarea Callback-urilor pentru Monitorizare și Optimizare

- Metrici Cheie pentru Evaluarea Modelelor LDA

- Monitorizarea Convergenței Documentelor

- Word2Vec: Revoluția Reprezentării Cuvintelor în NLP

- Întrebări Frecvente (FAQ)

- Concluzie

Optimizarea Antrenamentului Modelelor LDA în Gensim: Pasi și Iterații

Calitatea unui model LDA depinde în mare măsură de modul în care este antrenat, iar Gensim oferă două hiperparametri cheie care influențează direct acest proces: passes și iterations. Înțelegerea și ajustarea acestora este esențială pentru a obține un model robust și semnificativ.

Pasi (passes): Antrenamentul pe Întregul Corpus

Parametrul passes se referă la numărul de ori când modelul este antrenat pe întregul corpus de documente. Valoarea implicită în Gensim este 1, ceea ce poate fi suficient pentru corpusuri foarte mari, dar adesea este benefic să se mărească această valoare. Un număr mai mare de passes permite modelului să „vadă” datele de mai multe ori, oferindu-i mai multe oportunități de a învăța și de a îmbunătăți convergența subiectelor pentru fiecare document. Cu toate acestea, un număr excesiv de passes va prelungi inutil timpul de antrenament, fără a aduce îmbunătățiri semnificative odată ce modelul a atins un platou de performanță.

Iterații (iterations): Profunzimea Antrenamentului per Document

Pe de altă parte, iterations este legat mai mult de frecvența cu care o anumită „cale” printr-un document este parcursă în timpul antrenamentului. Mai tehnic, controlează câte iterații ale algoritmului Variational Bayes sunt permise în pasul E (Expectation) fără convergență. Există o limită maximă pentru cât timp va rula procesul dacă toate documentele nu au atins convergența. Valoarea implicită în Gensim este 50. Un număr mai mare de iterații permite modelului să exploreze mai multe configurații posibile pentru alocarea subiectelor în cadrul unui document, contribuind la o înțelegere mai profundă a structurii sale interne.

Importanța Alegerii Hiperparametrilor Corecți

Alegerea valorilor optime pentru passes și iterations este o artă și o știință. O abordare simplistă ar fi setarea lor la valori foarte mari, dar acest lucru ar duce la timpi de antrenament excesivi. Antrenarea mai multor modele cu niveluri diferite și compararea lor este o metodă, dar necesită resurse considerabile.

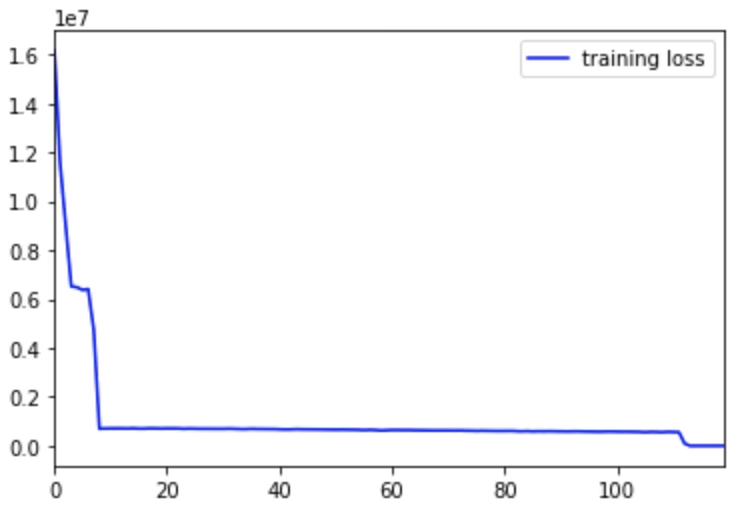

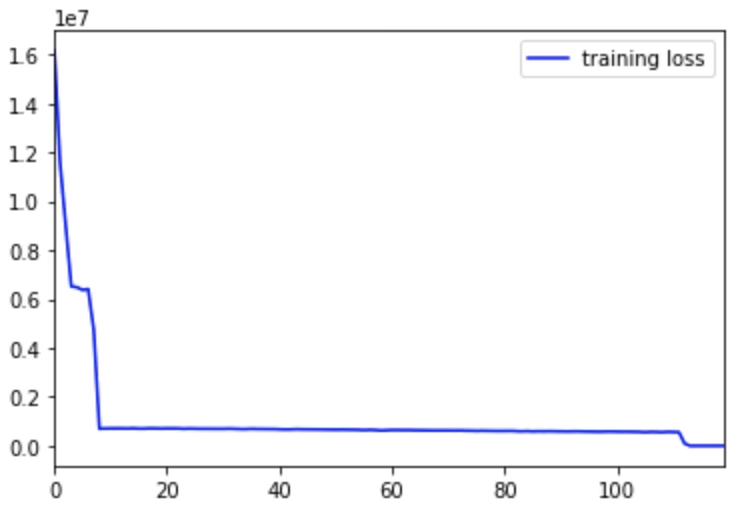

Utilizarea Callback-urilor pentru Monitorizare și Optimizare

Cea mai eficientă modalitate de a alege numărul de passes este prin utilizarea callback-urilor. Acestea vă permit să antrenați un singur model și să obțineți metricile de interes la fiecare pas (pass). Astfel, puteți vizualiza cu ușurință modul în care metricile se modifică pe măsură ce numărul de passes crește. Puteți confirma dacă o metrică a atins un platou, indicând că treceri suplimentare nu vor aduce îmbunătățiri notabile, sau chiar dacă performanța începe să scadă. Acest lucru este deosebit de util pentru a găsi punctul optim unde performanța se stabilizează, fără a irosi timp de antrenament inutil. Deși iterations poate fi verificat doar pentru o singură valoare la un moment dat, combinarea selecției passes și iterations prin antrenarea câtorva modele cu valori diferite de iterations și utilizarea callback-urilor pentru a compara performanța pe parcursul passes este o strategie recomandată. Rețineți că adăugarea callback-urilor crește timpul de antrenament, deci utilizați-le doar atunci când intenționați să le revizuiți datele.

Metrici Cheie pentru Evaluarea Modelelor LDA

Callback-urile Gensim oferă acces la mai multe metrici importante pentru evaluarea calității modelului LDA:

- Coerența (Coherence): Măsoară similaritatea semantică între cuvintele cu scoruri mari dintr-un subiect. Versiunea

c_veste des utilizată. Scorurile sunt între 0 și 1, unde valori mai aproape de 1 indică subiecte mai coerente și mai ușor de interpretat de către oameni. - Perplexitatea (Perplexity): O măsură statistică ce indică log-likelihood-ul normalizat al unui set de date de test, neobservat în timpul antrenamentului. Un scor mic sugerează un model care se adaptează mai bine la datele noi. Totuși, un studiu din 2009 a constatat că perplexitatea și judecata umană nu sunt întotdeauna corelate, deci nu este întotdeauna cea mai bună metrică, în funcție de scop.

- Diferența Topic (Topic Diff): Evaluează unicitatea cuvintelor de top din fiecare sub-subiect comparativ cu toate celelalte sub-subiecte. Un scor de 1 indică o unicitate totală. Este o metrică „igienică”, asigurându-vă că modelul nu are performanțe slabe, dar alte metrici sunt adesea folosite pentru decizia finală.

- Convergența (Convergence): Suma scorurilor Topic Diff. În practică, nu este necesar să rulați ambele, deoarece Convergența este derivată din Topic Diff. Pentru a compara modele cu numere diferite de subiecte, aceste scoruri ar trebui normalizate (ex: prin împărțirea la numărul de subiecte).

Iată o comparație a metricilor principale:

| Metrică | Descriere | Interval | Interpretare Ideală |

|---|---|---|---|

| Coerența (c_v) | Similaritatea semantică a cuvintelor din subiecte | 0 - 1 | Mai aproape de 1 (mai bun) |

| Perplexitatea | Probabilitatea datelor noi, neobservate | Variabil | Mai mic (mai bun) |

| Diferența Topic | Unicitatea cuvintelor de top între subiecte | 0 - 1 | Mai aproape de 1 (mai bun) |

| Convergența | Suma scorurilor de Diferență Topic | Variabil | Mai mic (mai bun, după normalizare) |

Monitorizarea Convergenței Documentelor

Pe lângă metricile oferite de callback-uri, poate fi util să monitorizați și numărul de documente care au convergit la fiecare pass. În mod ideal, doriți să opriți antrenamentul atunci când o majoritate notabilă a documentelor a convergit. Această informație poate fi adesea extrasă din log-urile Gensim.

Word2Vec: Revoluția Reprezentării Cuvintelor în NLP

Word2Vec este o tehnică fundamentală în procesarea limbajului natural care permite mașinilor să înțeleagă limbajul uman într-un mod mai similar cu cel uman. Aceasta transformă cuvintele în vectori numerici, capturând relațiile semantice și contextuale dintre ele.

Ce este Word2Vec?

La bază, Word2Vec este o tehnică pentru transformarea cuvintelor în vectori numerici, cunoscuți și sub denumirea de embeddings de cuvinte. Acești vectori sunt aranjați în așa fel încât cuvintele cu semnificații comparabile sunt poziționate aproape una de alta în spațiul vectorial. Această reprezentare densă, continuă și distribuită este mult mai eficientă și informativă decât metodele tradiționale, cum ar fi codificarea one-hot, care sunt sparse și lipsite de informații semantice.

Cum Funcționează Word2Vec? Arhitecturi Principale

Tehnica funcționează prin antrenarea unei rețele neuronale pentru a prezice un cuvânt pe baza cuvintelor sale învecinate. Rețeaua neuronală poate fi construită utilizând una dintre cele două arhitecturi principale:

CBOW (Continuous Bag of Words)

CBOW prezice cuvântul central pe baza cuvintelor înconjurătoare (context). Funcționează prin definirea unei ferestre de context în jurul fiecărui cuvânt țintă. De exemplu, pentru cuvântul „măr” în propoziția „Îmi place să mănânc mere”, contextul ar putea fi [„Îmi”, „place”, „să”, „mănânc”]. Intrarea este reprezentată ca un vector codificat one-hot pentru fiecare cuvânt din context, iar ieșirea este un vector codificat one-hot pentru cuvântul țintă. Prin ajustarea ponderilor dintre straturile de intrare și cele ascunse (care devin embeddings-urile cuvintelor) și apoi cele de ieșire, rețeaua neuronală este antrenată pentru a se asigura că cuvântul prezis este cât mai aproape posibil de cuvântul real. CBOW este eficient și potrivit în special pentru scenariile în care frecvența cuvintelor în corpus este relativ mare.

Skip-Gram

Skip-Gram, pe de altă parte, prezice cuvintele înconjurătoare (context) pe baza cuvântului central. Pentru fiecare cuvânt țintă, Skip-Gram generează perechi de antrenament (cuvânt țintă, cuvânt context) în cadrul unei ferestre fixe. Obiectivul este de a maximiza probabilitatea de a observa cuvintele din context, având în vedere cuvântul țintă. Procesul de antrenament implică ajustarea vectorialilor de embedding folosind backpropagation și gradient descent pentru a minimiza log-likelihood-ul negativ al observării cuvintelor contextuale reale. După antrenament, vectorii de embedding captează relații semantice între cuvinte. Cuvintele care apar frecvent în contexte similare vor avea embedding-uri similare în spațiul vectorial. Skip-Gram tinde să funcționeze bine pe corpusuri textuale mari și diverse și este deosebit de eficient în captarea semnificației cuvintelor rare și a relațiilor lor cu alte cuvinte. Deși necesită mai mult timp de antrenament comparativ cu CBOW, Skip-Gram este adesea preferat pentru modele lingvistice complexe sau sarcini care necesită o înțelegere mai profundă a semanticii cuvintelor.

Iată o comparație a celor două arhitecturi:

| Caracteristică | CBOW (Continuous Bag of Words) | Skip-Gram |

|---|---|---|

| Obiectiv | Prezice cuvântul central pe baza contextului | Prezice contextul pe baza cuvântului central |

| Intrare | Vectori one-hot pentru cuvintele contextuale | Vector one-hot pentru cuvântul țintă |

| Ieșire | Vector one-hot pentru cuvântul țintă | Vectori one-hot pentru cuvintele contextuale |

| Viteză | Mai rapid pentru corpusuri mari | Mai lent pentru corpusuri mari |

| Performanță | Bun pentru cuvinte frecvente | Bun pentru cuvinte rare și relații semantice complexe |

| Complexitate | Mai puțin complex | Mai complex |

Aplicații ale Word2Vec

Aplicațiile Word2Vec sunt vaste și variate, extinzându-se în numeroase domenii ale NLP:

- Clasificarea Textului: Utilizat pentru a clasifica textul pe baza semnificației cuvintelor.

- Analiza Sentimentelor: Determină sentimentul unui text prin analiza semnificației cuvintelor folosite.

- Traducerea Automată: Ajută la îmbunătățirea acurateței traducerilor prin identificarea semnificațiilor corecte ale cuvintelor.

- Sisteme de Recomandare: Recomandă produse sau servicii pe baza semnificației interogărilor utilizatorului.

- Recunoașterea Entităților Numite (NER): Îmbunătățește detectarea entităților specifice în text.

Metode Utile Word2Vec în Gensim

Biblioteca Gensim oferă o implementare robustă a Word2Vec, împreună cu metode utile pentru lucrul cu embeddings de cuvinte:

Word2Vec(sentences, size, window, min_count, workers): Clasa principală pentru antrenarea unui model Word2Vec. Parametrii includ lista de propoziții tokenizate, dimensiunea vectorilor de cuvinte (`size`), distanța maximă între cuvinte (`window`), frecvența minimă a unui cuvânt pentru a fi inclus în vocabular (`min_count`) și numărul de thread-uri (`workers`).model.wv.most_similar(positive=None, negative=None, topn=10): Returnează cele mai similare cuvinte unui cuvânt sau set de cuvinte.positiveșinegativeinfluențează rezultatul, iartopnspecifică numărul de rezultate.model.wv.similarity(w1, w2): Returnează similaritatea cosinusului între doi vectori de cuvinte.model.wv[word]: Returnează reprezentarea vectorială a unui cuvânt specific.model.wv.vocab: Returnează un dicționar cu toate cuvintele din vocabular și frecvența lor asociată.model.train(sentences, total_examples, epochs): Continuă antrenamentul unui model Word2Vec existent pe propoziții noi.

Biblioteci Python Relevante pentru Word2Vec

Pe lângă Gensim, alte biblioteci Python utile pentru Word2Vec includ:

- NLTK (Natural Language Toolkit): Oferă instrumente pentru preprocesarea textului, cum ar fi tokenizarea (

word_tokenize,sent_tokenize), care sunt esențiale înainte de antrenarea Word2Vec. - spaCy: O bibliotecă modernă de NLP care oferă modele pre-antrenate și capacități de calcul a similarității folosind embeddings.

- TensorFlow: O bibliotecă populară de învățare automată care permite construirea și antrenarea de modele Word2Vec la un nivel mai granular, oferind control asupra arhitecturii rețelei neuronale.

Seturi de Date Utile pentru Antrenarea Word2Vec

Antrenarea unui model Word2Vec necesită un corpus mare de text. Iată câteva seturi de date populare:

- Wikipedia Dump: Conține textul complet din toate articolele Wikipedia. Este o sursă bogată de text natural, disponibilă în mai multe limbi. Gensim.downloader poate facilita accesul.

- Text8: Un set de date mai mic, dar popular, folosit pentru testarea modelelor Word2Vec. Constă într-o versiune curățată și preprocesată a unui corpus mare de text englezesc.

Concepte Importante în Word2Vec

Pentru a înțelege pe deplin Word2Vec, este util să aveți o familiaritate cu următoarele concepte:

- Rețele neuronale

- Algoritmul backpropagation

- Funcții de activare

- Embeddings (încorporări)

- Continuous Bag of Words (CBOW)

- Skip-Gram

- Date de antrenament

- Similaritatea cuvintelor

- Similaritatea cosinusului

- Reducerea dimensionalității

Ce Trebuie Să Știi Înainte de a Învăța Word2Vec?

Pentru a beneficia la maximum de Word2Vec și de NLP în general, este recomandat să aveți cunoștințe de bază în:

- Limbajul de programare Python

- Elemente fundamentale de învățare automată

- Algebră liniară

- Probabilitate și statistici

- Procesarea Limbajului Natural (NLP)

- Tehnici de preprocesare a datelor text

- Familiaritate cu rețelele neuronale și aplicațiile lor în NLP

- Experiență cu biblioteci de deep learning precum TensorFlow sau PyTorch

- Experiență cu instrumente de vizualizare a datelor

- Confort cu interfața linie de comandă și controlul versiunilor de cod

Întrebări Frecvente (FAQ)

Cât de multe "passes" ar trebui să folosesc în antrenamentul unui model LDA?

Numărul optim de passes depinde de dimensiunea și complexitatea corpusului dumneavoastră. Valoarea implicită este 1, dar adesea este necesar să o măriți. Cea mai bună abordare este să folosiți callback-uri în Gensim pentru a monitoriza metrici precum Coerența și Perplexitatea pe măsură ce numărul de passes crește. Opriți antrenamentul când metricile ating un platou sau încep să scadă, indicând că modelul nu mai învață semnificativ.

Ce este mai bun, CBOW sau Skip-Gram pentru Word2Vec?

Alegerea între CBOW și Skip-Gram depinde de specificul sarcinii și al datelor. CBOW este, în general, mai rapid de antrenat și funcționează bine pentru cuvintele frecvente. Skip-Gram, deși mai lent, este mai eficient în captarea semnificației cuvintelor rare și a relațiilor semantice complexe. Dacă aveți un corpus foarte mare și doriți să capturați subtilități, Skip-Gram poate fi o alegere mai bună.

Cum aleg numărul optim de topicuri pentru modelul meu LDA?

Deși nu este direct legat de passes și iterations, numărul de topicuri (num_topics) este un hiperparametru crucial pentru LDA. Cea mai comună metodă este de a antrena mai multe modele cu diferite numere de topicuri și de a le evalua folosind metrici de coerență (cum ar fi c_v coherence). Alegeți numărul de topicuri care maximizează coerența și produce subiecte interpretabile.

Pot folosi Word2Vec pentru alte limbi decât engleza?

Absolut! Word2Vec este o tehnică agnostică față de limbă. Atâta timp cât aveți un corpus suficient de mare și bine tokenizat în limba dorită, puteți antrena un model Word2Vec pentru orice limbă. Conceptul de similaritate contextuală se aplică universal.

De ce este importantă coerența topicurilor în LDA?

Coerența topicurilor este importantă deoarece măsoară cât de „inteligibile” sunt subiectele generate de model pentru un om. Un scor mare de coerență indică faptul că cuvintele dintr-un subiect sunt semantic legate și formează un concept clar, facilitând interpretarea și utilizarea rezultatelor modelului.

Concluzie

Gensim oferă instrumente puternice pentru a naviga prin complexitatea datelor textuale. Prin stăpânirea hiperparametrilor passes și iterations pentru modelele LDA și prin înțelegerea profundă a arhitecturilor CBOW și Skip-Gram în Word2Vec, veți putea antrena modele mai eficiente și mai precise. Utilizarea callback-urilor și a metricilor de evaluare vă va ghida în procesul de optimizare, asigurându-vă că extrageți cele mai valoroase informații din datele dumneavoastră. Aceste tehnici au transformat modul în care mașinile procesează și înțeleg limbajul uman, deschizând noi orizonturi pentru aplicații în diverse domenii.

Dacă vrei să descoperi și alte articole similare cu Gensim: Stăpânirea Modelelor LDA și Word2Vec, poți vizita categoria Fitness.