24/04/2024

În lumea rapidă a inteligenței artificiale și a învățării automate, TensorFlow se impune ca un cadru open-source de top, esențial pentru construirea, antrenarea și implementarea modelelor de deep learning. Capacitatea sa de a transforma seturi vaste de date în predicții revelatoare este remarcabilă. Indiferent dacă ești un începător entuziast care dorește să prezică prețurile locuințelor sau un veteran care dezvoltă un chatbot sofisticat, TensorFlow îți pune la dispoziție instrumentele necesare. Acest articol va explora procesul de antrenare a modelelor TensorFlow în Python, abordând diverse strategii, de la cele mai simple la cele care oferă un control granular.

Procesul de antrenare a unui model de învățare automată implică ajustarea parametrilor interni ai modelului (greutăților și bias-urilor) pentru a minimiza o funcție de pierdere, care măsoară discrepanța dintre predicțiile modelului și valorile reale. Această ajustare se face iterativ, folosind algoritmi de optimizare. Să explorăm principalele metode prin care poți realiza acest lucru în TensorFlow.

- Metoda 1: Antrenarea Simplistă cu API-ul Secvențial Keras

- Metoda 2: Flexibilitatea API-ului Funcțional Keras

- Metoda 3: Bucla de Antrenament Personalizată – Control Absolut

- Metoda 4: Transfer Learning cu TensorFlow Hub

- Metoda 5: Antrenarea Eficientă cu API-ul Dataset

- Comparație: model.fit() vs. Buclă de Antrenament Personalizată

- Întrebări Frecvente (FAQ)

- Concluzie

Metoda 1: Antrenarea Simplistă cu API-ul Secvențial Keras

API-ul Secvențial din Keras, parte integrantă a TensorFlow, este cea mai directă metodă de a construi modele, strat cu strat. Este ideal pentru structuri simple, liniare, unde un singur input duce la un singur output. Această abordare permite o proiectare rapidă și intuitivă a modelului.

Pașii de bază pentru antrenarea unui model cu API-ul Secvențial sunt:

- Importarea Bibliotecilor Necesare: Pe lângă TensorFlow, vei avea nevoie adesea și de alte biblioteci, cum ar fi NumPy pentru manipularea datelor sau Matplotlib pentru vizualizare.

- Încărcarea și Pregătirea Setului de Date: Acesta este un pas crucial care include curățarea datelor, preprocesarea, normalizarea și împărțirea lor în seturi de antrenament și validare. TensorFlow funcționează eficient cu array-uri NumPy sau cu obiecte

tf.data.Dataset. De exemplu, setul de date CIFAR-10 este un benchmark popular în viziunea computerizată, constând în 60.000 de imagini color de 32x32 pixeli, împărțite în 10 clase. Imaginile trebuie normalizate (scalate între 0 și 1) pentru a facilita antrenamentul. - Construirea Modelului: Definește arhitectura modelului tău. API-ul Secvențial îți permite să adaugi straturi precum

Conv2D(pentru operații convoluționale),MaxPooling2D(pentru downsampling),Flatten(pentru a transforma datele multidimensionale într-un vector 1D) șiDense(straturi complet conectate). Funcțiile de activare precum ReLU sau Softmax sunt esențiale pentru a introduce neliniarități și a produce distribuții de probabilitate. - Compilarea Modelului: În această etapă, specifici trei componente cheie: optimizatorul (algoritmul care ajustează greutățile modelului, cum ar fi 'adam'), funcția de pierdere (ce măsoară eroarea, de exemplu

SparseCategoricalCrossentropypentru clasificări multi-clasă) și metricile pe care vrei să le urmărești (cum ar fi 'accuracy'). - Antrenarea Modelului: Folosești metoda

model.fit(), transmițându-i datele de antrenament și etichetele, împreună cu numărul dorit de epoci (iterații complete peste întregul set de date). Poți include și un set de date de validare pentru a monitoriza performanța modelului pe date nevăzute. - Evaluarea Modelului: După antrenament, utilizează

model.evaluate()pe datele de test pentru a obține informații despre pierdere și acuratețe. - Realizarea Predicțiilor: Metoda

model.predict()îți permite să folosești modelul antrenat pentru a face predicții pe date noi.

Această abordare este extrem de eficientă pentru majoritatea cazurilor de utilizare și reprezintă punctul de plecare pentru mulți dezvoltatori.

Metoda 2: Flexibilitatea API-ului Funcțional Keras

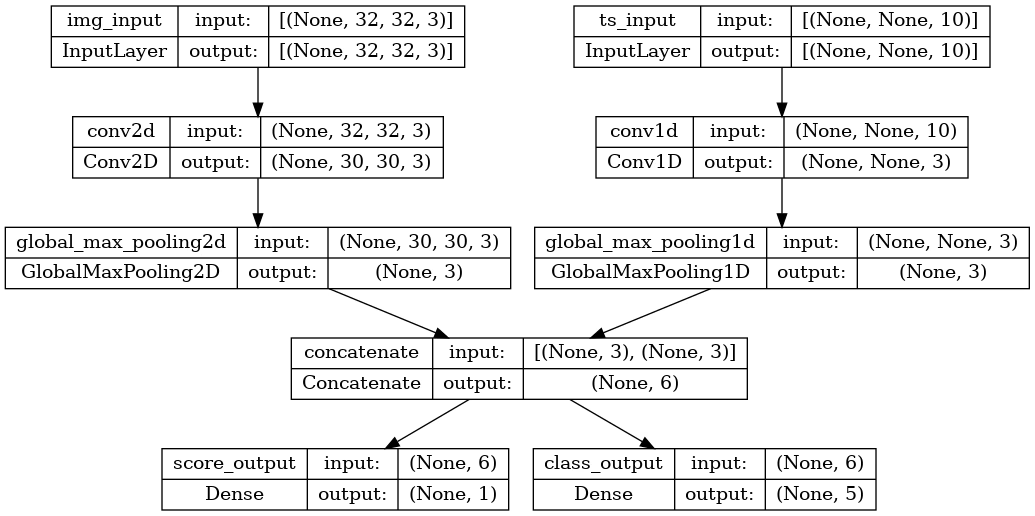

Pentru modele cu o topologie mai complexă, care pot include multiple intrări și ieșiri, straturi partajate sau conexiuni reziduale, API-ul Funcțional este soluția ideală. Spre deosebire de API-ul Secvențial, acesta permite o definire non-liniară a fluxului de date.

De exemplu, poți defini două intrări separate, fiecare procesată de același strat (strat partajat), iar apoi rezultatele pot fi concatenate înainte de a trece printr-un strat final. Acest nivel de control asupra fluxului de date și a arhitecturii face API-ul Funcțional indispensabil pentru rețele neuronale avansate.

Metoda 3: Bucla de Antrenament Personalizată – Control Absolut

Deși model.fit() este extraordinar de convenabil, există scenarii în care este necesar un control maximal asupra procesului de antrenament. Aici intervin buclele de antrenament personalizate. Ele permit ajustări complicate ale procesului de antrenament, gestionarea metricilor personalizate și oferă o înțelegere mai profundă a ceea ce se întâmplă sub capotă.

O buclă de antrenament personalizată în TensorFlow implică gestionarea manuală a fiecărui pas al procesului de optimizare:

- Pasul 1: Definirea Modelului, Optimizatorului și Funcției de Pierdere. Acestea sunt aceleași componente ca și în cazul

model.compile(), dar le vei gestiona explicit. - Pasul 2: Iterarea pe Epoci și Batch-uri. Vei folosi bucle Python standard (

for epoch in range(epochs):șifor step, (x_batch, y_batch) in enumerate(dataset):). - Pasul 3: Calcularea Pierderii cu

tf.GradientTape. Acesta este mecanismul central pentru diferențierea automată în TensorFlow. Într-un contextwith tf.GradientTape() as tape:, toate operațiile efectuate pe variabilele antrenabile ale modelului sunt înregistrate. Apoi, modelul este apelat (rulare forward), iar funcția de pierdere este calculată pe baza predicțiilor și a etichetelor reale. - Pasul 4: Calcularea Gradienților. Ieșind din contextul

GradientTape, poți apelatape.gradient(loss_value, model.trainable_weights). Aceasta calculează gradienții funcției de pierdere în raport cu toate variabilele antrenabile ale modelului. - Pasul 5: Actualizarea Greutăților Modelului. Cu gradienții obținuți, optimizatorul (e.g., Adam) este folosit pentru a actualiza greutățile modelului în direcția care minimizează pierderea, prin

optimizer.apply_gradients(zip(grads, model.trainable_weights)).

Gestionarea Metricilor în Bucla Personalizată

Chiar și în buclele personalizate, poți refolosi metricile Keras încorporate sau cele personalizate. Fluxul este simplu:

- Instanțiază metrica la începutul buclei (ex:

keras.metrics.SparseCategoricalAccuracy()). - Apelează

metric.update_state()după fiecare batch pentru a actualiza starea metricii. - Apelează

metric.result()când vrei să afișezi valoarea curentă a metricii (de obicei la sfârșitul unei epoci). - Apelează

metric.reset_state()pentru a șterge starea metricii (de obicei la sfârșitul unei epoci, înainte de a începe următoarea).

Accelerarea cu tf.function

Runtime-ul implicit în TensorFlow este execuția eager, care este excelentă pentru depanare. Cu toate acestea, compilarea graficului static oferă un avantaj semnificativ de performanță. Poți compila orice funcție care primește tensori ca intrare adăugând decoratorul @tf.function. Acesta transformă codul Python într-un grafic TensorFlow optimizat, ceea ce poate reduce dramatic timpul de antrenament, mai ales pentru buclele iterative.

Gestionarea Pierderilor Urmărite de Model

Straturile și modelele Keras pot urmări recursiv orice pierderi create în timpul rulării forward de către straturile care apelează self.add_loss(value). Această listă de valori scalare de pierdere este disponibilă prin proprietatea model.losses. Dacă dorești să utilizezi aceste componente de pierdere (cum ar fi pierderile de regularizare), ar trebui să le sumezi și să le adaugi la pierderea principală în pasul tău de antrenament.

Exemplu Avansat: Antrenarea unui GAN de la Zero

Un exemplu clasic unde buclele de antrenament personalizate sunt esențiale este antrenarea Rețelelor Generative Adversariale (GAN-uri). Un GAN este compus dintr-un generator (care creează imagini false din zgomot aleator) și un discriminator (un clasificator care încearcă să distingă imaginile reale de cele false). Procesul de antrenament al unui GAN este un joc cu sumă nulă:

- Antrenarea Discriminatorului: Se generează imagini false, se combină cu imagini reale, iar discriminatorul este antrenat să le clasifice corect (real vs. fals).

- Antrenarea Generatorului: Generatorul este antrenat să „păcălească” discriminatorul, adică să creeze imagini false atât de convingătoare încât discriminatorul să le clasifice ca fiind reale.

Acest proces în doi pași, cu obiective de optimizare diferite pentru fiecare sub-model, nu poate fi gestionat eficient cu model.fit() și necesită o buclă de antrenament personalizată, demonstrând puterea și necesitatea acestei abordări pentru arhitecturi complexe.

Metoda 4: Transfer Learning cu TensorFlow Hub

Transfer learning-ul este o tehnică puternică, mai ales când lucrezi cu seturi de date mici. Aceasta implică utilizarea unui model pre-antrenat pe un set de date mare (cum ar fi ImageNet) și adaptarea acestuia la o sarcină specifică. TensorFlow Hub oferă o bibliotecă vastă de module de învățare automată reutilizabile, permițându-ți să încarci straturi pre-antrenate și să le adaugi la modelul tău, adesea „înghețând” greutățile acestora și antrenând doar un strat nou, deasupra, pentru sarcina ta particulară. Aceasta accelerează semnificativ timpul de antrenament și îmbunătățește performanța.

Metoda 5: Antrenarea Eficientă cu API-ul Dataset

API-ul Dataset din TensorFlow oferă o modalitate extrem de eficientă și scalabilă de a construi pipeline-uri de date pentru alimentarea modelului tău. Este crucial pentru gestionarea seturilor de date mari care nu încap în memorie și poate îmbunătăți semnificativ viteza procesului de antrenament prin pipelining și prefetching. Prin crearea unui obiect Dataset, gruparea datelor în batch-uri și prefetch-ing, se optimizează transferul de memorie între CPU și GPU, ceea ce este un factor decisiv pentru performanță.

Comparație: model.fit() vs. Buclă de Antrenament Personalizată

| Caracteristică | model.fit() (API-uri Keras) | Buclă de Antrenament Personalizată |

|---|---|---|

| Simplicitate | Extrem de ridicată, abstractizare completă. | Moderată spre complexă, necesită înțelegere profundă. |

| Control | Scăzut spre moderat, opțiuni predefinite. | Maximal, fiecare aspect al antrenamentului este controlabil. |

| Flexibilitate | Limitate la scenarii standard de antrenament. | Nelimitată, permite algoritmi de antrenament unici. |

| Depanare | Mai dificilă, procesul intern este o „cutie neagră”. | Mai ușoară, datorită execuției eager și controlului explicit. |

| Performanță | Optimizată implicit de Keras. | Necesită tf.function pentru a atinge performanțe optime. |

| Cazuri de utilizare | Majoritatea modelelor de clasificare/regresie, prototipare rapidă. | GAN-uri, Reinforcement Learning, cercetare avansată, algoritmi non-standard. |

Întrebări Frecvente (FAQ)

Ce este tf.GradientTape?

tf.GradientTape este un API în TensorFlow care înregistrează operațiile efectuate într-un context pentru calcularea diferențialelor (gradienților). Este esențial pentru backpropagation, permițând modelului să-și ajusteze greutățile pe baza erorii.

Când ar trebui să folosesc o buclă de antrenament personalizată?

Ar trebui să folosești o buclă personalizată atunci când model.fit() nu oferă suficientă flexibilitate. Exemple includ antrenarea GAN-urilor, algoritmi de învățare prin consolidare (Reinforcement Learning), logici complexe de antrenament (ex: antrenament multi-task cu pierderi diferite, actualizări condiționate de greutăți) sau atunci când vrei să înțelegi și să controlezi fiecare detaliu al procesului de optimizare.

Care este diferența principală dintre model.fit() și o buclă personalizată?

Diferența cheie este nivelul de abstractizare și control. model.fit() este o metodă de nivel înalt, predefinită, care gestionează automat majoritatea aspectelor antrenamentului, ideală pentru scenarii standard. O buclă personalizată îți oferă un control explicit asupra fiecărui pas – calculul pierderii, gradienților și actualizarea greutăților – dar necesită mai mult cod și o înțelegere mai profundă.

Cum optimizez performanța unei bucle de antrenament personalizate?

Cel mai important pas este utilizarea decoratorului @tf.function pentru a compila pașii de antrenament și evaluare într-un grafic TensorFlow. De asemenea, asigură-te că utilizezi API-ul Dataset pentru a construi pipeline-uri eficiente de date, cu batch-ing și prefetching activate.

Pot folosi metrici Keras în bucle de antrenament personalizate?

Da, absolut! Metricile Keras (tf.keras.metrics) sunt concepute pentru a fi modulare și pot fi instanțiate și utilizate independent în buclele tale personalizate, prin apelarea metodelor update_state(), result() și reset_state().

Concluzie

TensorFlow oferă o gamă largă de instrumente pentru antrenarea modelelor, de la simplitatea și eficiența API-urilor Keras până la controlul granular oferit de buclele de antrenament personalizate. Alegerea metodei potrivite depinde de complexitatea modelului tău, de cerințele specifice ale sarcinii și de nivelul de control pe care îl dorești. Pentru majoritatea aplicațiilor, model.fit() este suficient. Însă, pentru scenarii avansate, cum ar fi antrenarea GAN-urilor sau dezvoltarea de noi algoritmi, buclele personalizate, combinate cu optimizări precum tf.function și API-ul Dataset, deschid uși către posibilități nelimitate, transformând viziunea ta în realitate computațională.

Dacă vrei să descoperi și alte articole similare cu Antrenarea Modelelor TensorFlow: Control Total, poți vizita categoria Fitness.