25/08/2024

Inteligența Artificială (AI) a trecut de la un concept futurist la o realitate cotidiană, iar în centrul acestei transformări stau Rețelele Neuronale Profunde (DNN). Aceste sisteme avansate permit mașinilor să învețe modele și reprezentări complexe din volume imense de date cu o precizie fără precedent. De la interpretarea imaginilor la mimarea vorbirii umane și chiar generarea de artă, DNN-urile sunt motorul multor inovații care ne modelează lumea.

- Ce este o Rețea Neuronală Profundă (DNN)?

- Scurt Istoric al Rețelelor Neuronale

- Cum Funcționează Rețelele Neuronale Profunde?

- Utilizări ale Rețelelor Neuronale Profunde

- Provocări în Antrenarea și Utilizarea DNN-urilor

- Cele Mai Bune Practici pentru Antrenarea DNN-urilor

- Întrebări Frecvente (FAQ) despre Rețelele Neuronale Profunde

- Un Viitor Plin de Oportunități

Ce este o Rețea Neuronală Profundă (DNN)?

O Rețea Neuronală Profundă (DNN), cunoscută și sub numele de "deep net", este un tip de rețea neuronală artificială (ANN) caracterizată prin prezența a mai multor straturi ascunse între straturile sale de intrare și ieșire. Fiecare strat este compus din multiple noduri (neuroni) care efectuează calcule pe datele de intrare. Termenul "profund" se referă tocmai la aceste straturi ascunse multiple, care permit rețelei să învețe reprezentări complexe din datele de intrare, o capacitate pe care rețelele artificiale "superficiale" nu o pot atinge.

Straturile ascunse dintr-o DNN sunt, de regulă, straturi dense (complet conectate), unde fiecare neuron dintr-un strat este conectat la fiecare neuron din stratul anterior și cel ulterior. Această interconectare le face extrem de potrivite pentru a învăța relații complexe în date. Este important de reținut că straturile ascunse nu sunt simple copii identice; o DNN are o structură complexă cu o varietate de tipuri de straturi, inclusiv:

- Straturi Convoluționale: Aplică o serie de filtre învățabile datelor de intrare, fiind esențiale pentru procesarea imaginilor.

- Straturi Long Short-Term Memory (LSTM): Captează dependențe pe termen lung în datele secvențiale, ideale pentru texte sau serii temporale.

- Straturi Gated Recurrent Unit (GRU): Similar cu LSTM, utilizează porți pentru a controla fluxul de informații în rețea.

- Straturi de Atenție: Se concentrează pe părți specifice ale secvenței de intrare atunci când fac predicții, îmbunătățind performanța în sarcini complexe.

- Straturi de Normalizare: Stabilizează și accelerează antrenamentul rețelei neuronale profunde.

Cu cât o rețea profundă are mai multe straturi ascunse, cu atât devine mai bună în învățarea și procesarea datelor de intrare. Deși o rețea necesită doar două straturi pentru a fi considerată "profundă", DNN-urile moderne au adesea peste 100 de straturi ascunse între nodurile de intrare și ieșire.

Scurt Istoric al Rețelelor Neuronale

Conceptul de rețele neuronale are o istorie de peste 70 de ani. Cercetătorii Warren McCulloch și Walter Pitts au pus bazele conceptuale la sfârșitul anilor 1940, propunând unități computaționale simple care imitau comportamentul neuronilor umani. Lipsa hardware-ului adecvat a limitat progresul, dar aceste idei timpurii au fundamentat rețelele de astăzi.

În anii 1960 și 1970, interesul a crescut odată cu dezvoltarea Perceptronului, o ANN cu un singur strat ascuns, capabilă să clasifice datele. Această invenție a fost una dintre primele rețele antrenabile și a demonstrat potențialul recunoașterii modelelor.

Descoperiri ulterioare au avut loc în anii 1980 și 1990, când Paul Werbos și David Rumelhart au dezvoltat backpropagation (propagarea inversă a erorilor). Aceasta a oferit o metodă eficientă de antrenare a rețelelor multi-strat prin ajustarea conexiunilor neuronale pe baza erorilor de ieșire.

Anii 2000 au fost o perioadă de stagnare relativă pentru rețelele neuronale, deoarece alte tehnici de învățare automată le-au umbrit. Resursele computaționale erau încă insuficiente, iar seturile de date la scară mare necesare pentru antrenament lipseau.

Punctul de cotitură a venit în anii 2010. Progresele în hardware, în special disponibilitatea unităților de procesare grafică (GPU) puternice, au permis antrenarea mai eficientă a rețelelor profunde. Explozia "Big Data" a furnizat, de asemenea, seturile de date necesare pentru antrenarea DNN-urilor, deschizând calea pentru revoluția AI pe care o vedem astăzi.

Cum Funcționează Rețelele Neuronale Profunde?

Rețelele profunde sunt compuse din multiple straturi de noduri interconectate, numite neuroni sau unități. Există trei tipuri principale de straturi într-o DNN:

- Stratul de Intrare: Primește datele brute. Fiecare nod din acest strat reprezintă o caracteristică sau un atribut al datelor de intrare. De exemplu, pentru a interpreta imagini de 28x28 pixeli, stratul de intrare ar necesita 784 de noduri, fiecare reprezentând intensitatea unui pixel.

- Straturile Ascunse: O DNN are două sau mai multe straturi ascunse intercalate între straturile de intrare și ieșire. Fiecare strat ascuns cuprinde neuroni care sunt conectați la neuronii din ambele straturi adiacente. Neuronii din același strat nu sunt însă conectați între ei.

- Stratul de Ieșire: Produce predicțiile finale ale rețelei. Numărul de neuroni din stratul de ieșire depinde de sarcina pe care o îndeplinește rețeaua (ex: un neuron pentru clasificare binară, mai mulți pentru clasificare multi-clasă).

Procesul de Propagare Înainte (Forward Propagation)

Odată ce furnizați date brute, acestea sunt propagate înainte prin rețea, strat cu strat. La fiecare strat, neuronii aplică funcții de activare atribuite și transmit ieșirea procesată către stratul următor. Câteva funcții de activare comune sunt:

- Sigmoid: Comprimă valorile de intrare între 0 și 1, potrivită pentru probleme de clasificare binară.

- Tanh (Tangenta Hiperbolică): Comprimă valorile de intrare între -1 și 1, utilizată atât pentru clasificare, cât și pentru regresie.

- ReLU (Rectified Linear Unit): Setează valorile de intrare negative la zero și le lasă pe cele pozitive neschimbate. Este preferată pentru straturile ascunse datorită eficienței sale computaționale.

- Softmax: Convertește scorurile brute în probabilități, asigurându-se că valorile de ieșire însumează 1, ideală pentru clasificarea multi-clasă.

Ponderile Neuronale și Procesul de Învățare

Într-o rețea neuronală profundă, fiecare conexiune între neuroni din straturile adiacente este asociată cu o pondere. Ponderile sunt valori numerice care reprezintă forța conexiunii neuronului și determină cât de multă influență are ieșirea unui neuron asupra intrării altuia. Ponderile pot fi pozitive sau negative:

- Ponderi Pozitive: O creștere a ieșirii neuronului expeditor duce la o creștere a activării neuronului receptor.

- Ponderi Negative: O creștere a ieșirii neuronului expeditor duce la o scădere a activării neuronului receptor (inhibare).

Inițial, ponderile sunt atribuite aleatoriu. În timpul antrenamentului, DNN-ul ajustează ponderile iterativ, ca răspuns la diferența dintre ieșirea așteptată și cea reală. Această diferență este cuantificată de o funcție de cost (sau de pierdere). Erorile sunt apoi propagate înapoi prin rețea (backpropagation), ajustând conexiunile neuronale pentru a minimiza erorile. Optimizarea ponderilor este crucială, deoarece ele determină cât de bine învață rețeaua din datele de antrenament și cât de precise sunt predicțiile sale.

Utilizări ale Rețelelor Neuronale Profunde

DNN-urile au devenit un instrument puternic într-o multitudine de domenii, datorită capacității lor de a învăța modele complexe din volume mari de date. Iată câteva cazuri de utilizare comune:

| Domeniu | Aplicații DNN |

|---|---|

| Recunoașterea Imaginilor | Detecția obiectelor, clasificarea imaginilor, sisteme de supraveghere, controlul calității industriale. |

| Procesarea Limbajului Natural (NLP) | Analiza sentimentelor, traducere automată, sumarizarea textului, chatbot-uri, asistenți virtuali. |

| Sinteza Vorbirii | Generarea de vorbire umană din text, sisteme de text-to-speech. |

| Sisteme de Recomandare | Analiza preferințelor utilizatorilor pentru a oferi recomandări de produse/conținut (e-commerce, streaming). |

| Sănătate | Detectarea anomaliilor în imagini medicale, identificarea modelelor în date genomice, detectarea timpurie a bolilor. |

| Finanțe și Tranzacționare | Detectarea tranzacțiilor frauduloase, evaluarea riscurilor, predicția tendințelor pieței, optimizarea strategiilor de tranzacționare. |

| Vehicule Autonome | Identificarea obiectelor, detectarea benzilor de circulație, recunoașterea pietonilor. |

| Monitorizarea Mediului | Analiza imaginilor satelitare și a datelor senzorilor pentru monitorizarea deforestării, modelelor climatice. |

Provocări în Antrenarea și Utilizarea DNN-urilor

Deși rețelele profunde oferă capacități semnificative, această tehnologie vine și cu provocări pe care trebuie să le cunoașteți înainte de a începe antrenarea unei DNN.

Calitatea și Cantitatea Datelor de Antrenament

Antrenarea unei DNN necesită volume mari de date etichetate de înaltă calitate pentru a se asigura că modelul generalizează bine la intrări noi. Obținerea datelor de calitate este costisitoare și consumatoare de timp, mai ales în domenii unde datele etichetate sunt greu de procurat. Datele injectate în stratul de intrare al unei rețele profunde trebuie să aibă un nivel ridicat de:

- Acuratețe: Erorile de etichetare duc la învățarea unor modele incorecte.

- Reprezentativitate: Datele de antrenament trebuie să acopere întreaga gamă de variații și scenarii. Lacunele duc la predicții părtinitoare sau incomplete.

- Curățenie: Punctele de date zgomotoase sau aberante introduc confuzie și degradează capacitățile modelului.

Tehnici precum augmentarea datelor (generarea de exemple suplimentare prin transformări precum rotația, scalarea, decuparea sau adăugarea de zgomot) pot ajuta la creșterea dimensiunii și diversității setului de date de antrenament.

Cerințe Computaționale și de Memorie

Antrenarea DNN-urilor necesită investiții în hardware scump, cum ar fi GPU-uri (Graphics Processing Units) și TPU-uri (Tensor Processing Units), care oferă capacitatea de calcul paralel esențială. Consumul de memorie este, de asemenea, semnificativ și scalează cu dimensiunea arhitecturii rețelei, dimensiunea lotului (batch size) și dimensiunea datelor de intrare. Cerințele ridicate duc și la un consum considerabil de energie, ceea ce subliniază importanța algoritmilor de antrenament eficienți energetic și a optimizărilor de model.

Probleme de Antrenament ale DNN-urilor

Două dintre cele mai comune provocări sunt supra-antrenarea (overfitting) și sub-antrenarea (underfitting), care afectează capacitatea modelului de a generaliza.

- Supra-antrenarea: Apare atunci când un model învață să memoreze zgomotul și modelele specifice din datele de antrenament, în loc să surprindă relațiile subiacente. Performanța este excelentă pe datele de antrenament, dar slabă pe datele nevăzute. Se previne prin metode de regularizare (L1, L2), dropout, oprire timpurie, augmentarea datelor sau reducerea complexității modelului.

- Sub-antrenarea: Apare când un model este prea simplu pentru a capta structura subiacentă a datelor, ducând la performanțe slabe atât pe seturile de antrenament, cât și pe cele de validare/test. Se previne prin creșterea complexității modelului (mai multe straturi/neuroni), furnizarea de caracteristici de intrare mai informative sau creșterea dimensiunii/diversității setului de date.

O altă problemă comună este gradientul evanescent (vanishing gradient), unde gradienții devin prea mici pe măsură ce se propagă prin rețea, îngreunând sau încetinind antrenamentul.

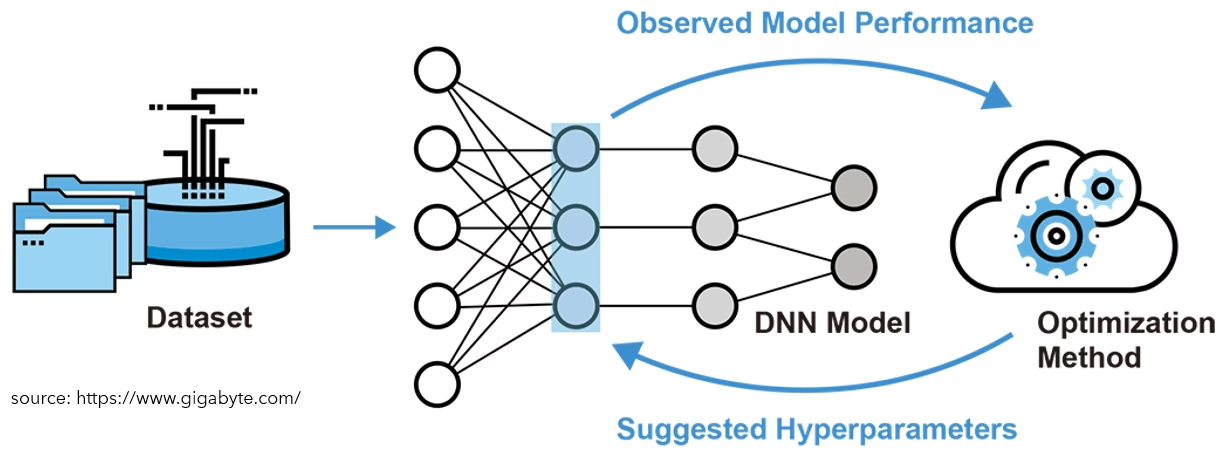

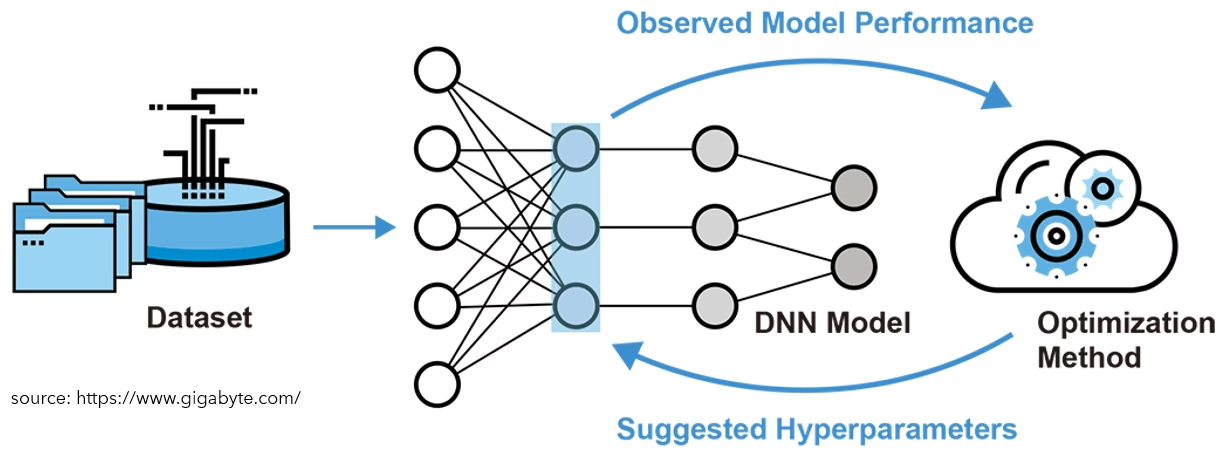

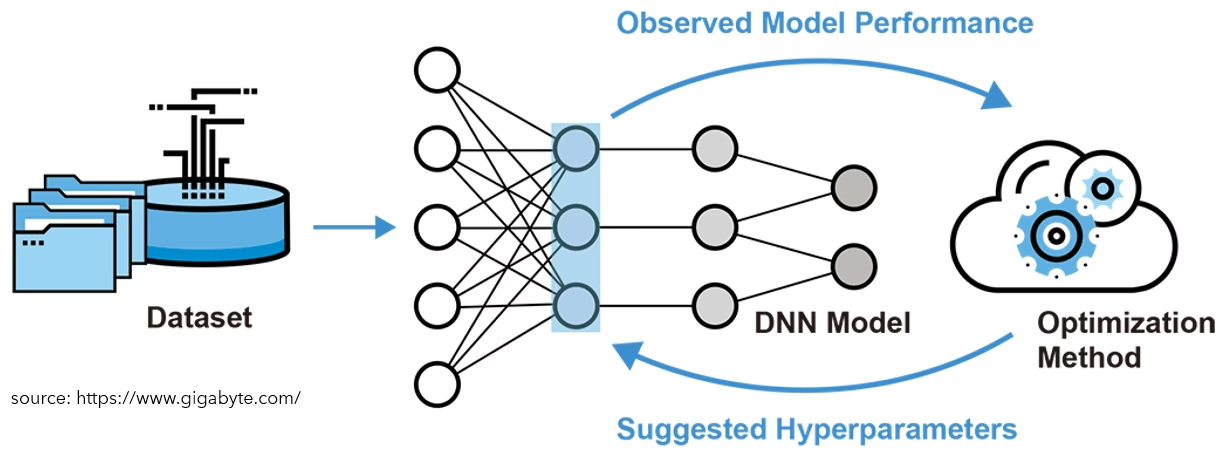

Reglarea Hiperparametrilor

Hiperparametrii DNN-ului (rata de învățare, dimensiunea lotului, numărul de straturi, numărul de neuroni per strat, puterea regularizării, rata de dropout, funcțiile de activare, algoritmii de optimizare) guvernează comportamentul și performanța rețelei. Setările suboptimale pot duce la convergență lentă, performanțe slabe și dificultăți în generalizare. Interacțiunile complexe dintre hiperparametri complică și mai mult căutarea unei configurații optime. Căutarea aleatorie (Random Search) este adesea preferată în detrimentul căutării în grilă (Grid Search) pentru eficiența sa.

Atacuri Adversariale

Atacurile adversariale sunt încercări malițioase de a înșela sau manipula o rețea profundă antrenată prin alterări subtile ale datelor de intrare (perturbații). Acestea pot fi non-țintite (cauzează clasificări greșite fără a viza o clasă specifică) sau țintite (determină modelul să clasifice greșit o mostră ca o clasă țintă specifică). Prevenirea implică augmentarea setului de date cu exemple adversariale, antrenarea modelului pe logituri înmuiate, ascunderea gradienților modelului sau combinarea predicțiilor de la mai multe modele.

Cele Mai Bune Practici pentru Antrenarea DNN-urilor

Pentru a antrena eficient rețele neuronale profunde, există o serie de practici recomandate:

- Preprocesarea Datelor: Asigurați-vă că datele sunt pregătite corect (redimensionare, normalizare a valorilor pixelilor prin împărțirea la 255 etc.). Aceasta ajută rețeaua să învețe eficient și să generalizeze bine.

- Inițializarea Ponderilor: Inițializați ponderile cu numere aleatorii mici pentru a sparge simetria și pentru a preveni probleme precum gradientul exploziv sau saturarea funcțiilor de activare. Biasele sunt de obicei inițializate la zero.

- Alegerea Funcțiilor de Activare: ReLU este frecvent utilizată pentru straturile ascunse datorită proprietăților sale bune de învățare și eficienței. Tanh este adesea o alternativă mai bună la Sigmoid, fiind centrată pe zero.

- Numărul de Unități și Straturi Ascunse: Este mai sigur să aveți un număr mai mare de unități ascunse decât cel optim, deoarece metodele de regularizare pot gestiona unitățile în exces. Adăugați straturi până când eroarea de testare nu se mai îmbunătățește.

- Ratele de Învățare: Unul dintre cei mai importanți hiperparametri. O rată prea mică încetinește convergența, una prea mare poate duce la instabilitate. Rata de 0.01 este un punct de pornire sigur, dar ratele adaptative (Adam, Adagrad, RMSProp) sunt adesea preferate, deoarece ajustează rata pentru fiecare parametru individual.

- Antrenament pe Mini-Batch-uri: Utilizați mini-batch-uri (de obicei între 16 și 128 de exemple) în loc de antrenament stocastic (un exemplu la rând) pentru a profita de puterea de calcul paralelă, păstrând în același timp suficient zgomot pentru a preveni supra-antrenarea.

- Amestecarea Exemplarelor de Antrenament: Amestecați ordinea exemplelor de antrenament în diferite epoci sau mini-batch-uri pentru a îmbunătăți convergența și a evita ca modelul să vadă aceleași modele secvențiale.

- Dropout pentru Regularizare: O metodă eficientă de regularizare care previne supra-antrenarea prin "dezactivarea" aleatorie a unui procent de neuroni în timpul antrenamentului. O valoare implicită de 0.5 este un bun punct de pornire.

- Monitorizarea și Vizualizarea Procesului de Antrenament: Urmăriți valorile pierderilor și erorilor de antrenament/testare. Vizualizați istoricul ponderilor pentru a detecta probleme precum gradientul evanescent sau exploziv.

- Utilizarea GPU-urilor și a Bibliotecilor Avansate: GPU-urile sunt esențiale pentru antrenarea eficientă a DNN-urilor datorită capacității lor de a efectua operații matriciale la scară largă. Biblioteci precum TensorFlow și PyTorch oferă suport pentru GPU și diferențiere automată, simplificând dezvoltarea.

- Pre-antrenarea Nesupravegheată: Utilizați reprezentări pre-antrenate (ex: Word Vectors în NLP, modele antrenate pe ImageNet pentru viziune computerizată) pentru a inițializa modelul, îmbunătățind performanța și timpul de antrenament pentru sarcini specifice.

Întrebări Frecvente (FAQ) despre Rețelele Neuronale Profunde

Q: Care este diferența principală între o rețea neuronală "normală" și una "profundă"?

A: Diferența cheie constă în numărul de straturi ascunse. O rețea neuronală "normală" sau "superficială" are de obicei doar unul sau câteva straturi ascunse, în timp ce o rețea "profundă" are multiple straturi ascunse (de la două la sute), permițându-i să învețe reprezentări mult mai complexe ale datelor.

Q: De ce sunt DNN-urile atât de eficiente în sarcini complexe precum recunoașterea imaginilor?

A: Datorită structurii lor multi-strat, DNN-urile pot extrage caracteristici ierarhice din date. De exemplu, în imagini, primele straturi pot detecta margini simple, straturile următoare pot combina aceste margini în forme, iar straturile superioare pot recunoaște obiecte complete. Această capacitate de abstractizare progresivă le face extrem de puternice.

Q: Este necesar un hardware special pentru a antrena o DNN?

A: Da, antrenarea DNN-urilor mari și complexe necesită resurse computaționale semnificative. GPU-urile (Graphics Processing Units) și TPU-urile (Tensor Processing Units) sunt esențiale, deoarece permit calculul paralel, accelerând considerabil procesul de antrenament care altfel ar dura săptămâni sau chiar luni pe un CPU obișnuit.

Un Viitor Plin de Oportunități

Rețelele Neuronale Profunde reprezintă o resursă fantastică, permițându-ne să executăm sarcini avansate de învățare automată cu o precizie record. Acum că înțelegeți cum funcționează DNN-urile și ce implică utilizarea lor, aveți toate informațiile necesare pentru a evalua dacă organizația dumneavoastră ar beneficia de implementarea și antrenarea unei rețele neuronale profunde. Potențialul lor este imens și abia începem să zgâriem suprafața a ceea ce pot realiza.

Dacă vrei să descoperi și alte articole similare cu Rețele Neuronale Profunde: Puterea din Spatele AI, poți vizita categoria Fitness.