21/06/2024

În lumea complexă a datelor și a analizei, fie că vorbim despre eficacitatea unui nou program de antrenament, impactul unei diete specifice sau chiar despre performanța echipamentelor sportive, este crucial să ne asigurăm că modelele statistice pe care le construim reflectă cu adevărat realitatea. Aici intervine conceptul de Bunătate a Potrivirii (Goodness of Fit), o piatră de temelie în validarea oricărui model. Dar ce înseamnă exact această „bunătate” și cum o putem măsura? Pe scurt, bunătatea potrivirii este o măsură statistică ce evaluează cât de bine se potrivește un model ipotetic sau o distribuție teoretică cu datele observate în realitate. Este ca și cum am încerca să potrivim o cheie într-o broască: vrem să știm dacă cheia (modelul) deschide ușa (explică datele) fără efort și precis.

În esență, testele de bunătate a potrivirii ne spun dacă diferențele dintre datele noastre eșantion și distribuția teoretică sunt semnificative din punct de vedere statistic. Dacă sunt, atunci modelul nu se potrivește adecvat datelor. Rezultatele acestor teste pot ghida procedurile analitice ulterioare, asigurându-ne că tragem concluzii valide și că deciziile bazate pe aceste modele sunt fundamentate pe o înțelegere solidă a datelor.

Înțelegerea Măsurilor de Bunătate a Potrivirii

Există diverse metode și indici pentru a evalua bunătatea potrivirii, fiecare cu aplicațiile și interpretările sale specifice. Alegerea metodei potrivite depinde de tipul de date și de natura modelului analizat. Să explorăm câteva dintre cele mai comune și importante dintre ele.

Testul Chi-Pătrat al lui Pearson

Unul dintre cele mai cunoscute și utilizate teste de bunătate a potrivirii este testul Chi-Pătrat (χ²) al lui Pearson. Acesta este folosit în special pentru datele categorice și ne ajută să determinăm dacă există o diferență semnificativă între frecvențele observate și cele așteptate într-o distribuție. Să ne imaginăm că testăm eficacitatea unui nou supliment nutritiv. Am putea avea date despre numărul de persoane care au raportat o creștere a masei musculare (observat) și am putea avea o ipoteză despre câte ar trebui să raporteze (așteptat) pe baza unor studii anterioare sau a unui model teoretic. Testul Chi-Pătrat ne va spune dacă diferența dintre aceste două seturi de numere este pur și simplu întâmplătoare sau dacă este suficient de mare pentru a indica o nepotrivire.

Măsura de bunătate a potrivirii utilizată în testul Chi-Pătrat al lui Pearson este suma diferențelor dintre frecvențele observate (Oi) și cele așteptate (Ei), fiecare ridicată la pătrat și împărțită la frecvența așteptată:

χ² = Σi=1n ((Oi - Ei)² / Ei)

Unde:

- Oi = o frecvență observată pentru categoria (bin) i

- Ei = o frecvență așteptată pentru categoria (bin) i, conform ipotezei nule

Frecvența așteptată este calculată folosind funcția de distribuție cumulativă (F) a distribuției testate, limitele superioare (Yu) și inferioare (Yl) ale fiecărei categorii și dimensiunea eșantionului (N):

Ei = (F(Yu) - F(Yl)) * N

Valoarea rezultată χ² poate fi comparată cu o distribuție Chi-Pătrat pentru a determina bunătatea potrivirii. Numărul gradelor de libertate pentru distribuția Chi-Pătrat este (k - c), unde k este numărul de categorii non-goale, iar c este numărul de parametri estimați pentru distribuție (inclusiv parametrii de locație, scară și formă), plus unu. De exemplu, pentru o distribuție Weibull cu 3 parametri, c = 4.

Cazul Binomial

Într-un experiment binomial, avem o secvență de încercări independente, fiecare cu două rezultate posibile: succes sau eșec. Dacă avem n încercări, fiecare cu probabilitatea p de succes, și dacă npi este semnificativ mai mare decât 1 pentru fiecare categorie i (unde i = 1, 2, ..., k), atunci statistica Chi-Pătrat poate fi calculată ca:

χ² = Σi=1k ((Ni - npi)² / npi) = Σtoate categoriile ((O - E)² / E)

Această valoare are aproximativ o distribuție Chi-Pătrat cu k - 1 grade de libertate. Faptul că există k - 1 grade de libertate este o consecință a restricției că suma tuturor numărului de observații în categorii (ΣNi) trebuie să fie egală cu dimensiunea totală a eșantionului (n). Practic, dacă știm valorile pentru k - 1 categorii, valoarea pentru ultima categorie este determinată unic, lăsând doar k - 1 categorii determinate liber.

Testul G (G-test)

Testele G sunt teste de semnificație statistică bazate pe raportul de verosimilitate și sunt din ce în ce mai mult recomandate în situațiile în care anterior se foloseau testele Chi-Pătrat ale lui Pearson. Formula generală pentru G este:

G = 2 * Σi (Oi * ln(Oi / Ei))

Unde Oi și Ei sunt aceleași ca și pentru testul Chi-Pătrat, ln denotă logaritmul natural, iar suma este luată peste toate categoriile non-goale. De asemenea, numărul total de observații trebuie să fie egal cu numărul total așteptat de observații: ΣOi = ΣEi = N, unde N este numărul total de observații. Testele G sunt considerate a fi mai precise în anumite condiții, în special când frecvențele așteptate sunt mici.

Indici de Potrivire în Analiza de Regresie și Modelare cu Ecuații Structurale

Pe lângă testele menționate mai sus, există și indici specifici utilizați în analiza de regresie și, mai ales, în modelarea cu ecuații structurale (SEM), o tehnică statistică complexă care examinează relațiile dintre variabile multiple. Acești indici oferă o perspectură mai nuanțată asupra cât de bine un model teoretic se potrivește datelor observate.

Indicele de Bunătate a Potrivirii (GFI) și Indicele de Bunătate a Potrivirii Ajustat (AGFI)

Indicele de Bunătate a Potrivirii (GFI) este o măsură statistică ce evaluează cât de bine un model se potrivește datelor observate în modelarea cu ecuații structurale. Dezvoltat de Jöreskog și Sörbom la începutul anilor 1980, GFI a devenit o metrică importantă pentru evaluarea potrivirii modelului în diverse domenii, inclusiv în cercetarea fitness-ului, unde am putea modela relația dintre tipul de antrenament, nutriție și rezultatele de performanță.

GFI este exprimat ca o valoare între 0 și 1, unde valorile mai mari indică o potrivire mai bună. O valoare GFI mai aproape de 1 sugerează că modelul explică o proporție mare din varianța datelor, în timp ce o valoare mai aproape de 0 implică faptul că modelul nu se potrivește bine datelor. În practică, cercetătorii caută de obicei o valoare GFI de 0.90 sau mai mare pentru a indica o potrivire acceptabilă a modelului, deși unii preferă un prag mai strict de 0.95 sau mai mare pentru o potrivire foarte bună.

GFI compară discrepanța dintre matricea de covarianță observată (care reprezintă relațiile reale dintre variabile) și matricea de covarianță prezisă (care reprezintă relațiile prezise de model). Practic, GFI cuantifică cât de mult din structura datelor observate este explicată de model.

O variație importantă a GFI este Indicele de Bunătate a Potrivirii Ajustat (AGFI), care ajustează valoarea GFI pentru a ține cont de complexitatea modelului. AGFI penalizează modelele cu mai mulți parametri, ajutând la prevenirea supra-adaptării (overfitting), unde un model se potrivește prea strâns datelor eșantion, dar nu se generalizează bine la alte seturi de date. AGFI, la fel ca GFI, variază de la 0 la 1, cu valori mai aproape de 1 indicând o potrivire mai bună. Cercetătorii folosesc adesea AGFI alături de GFI pentru a se asigura că nu supra-adaptează modelul datelor.

Indicele de Potrivire Normat (NFI)

Indicele de Potrivire Normat (NFI), cunoscut și sub numele de Bentler-Bonett NFI, este un alt indice de potrivire incremental. Acesta variază de la 0 la 1, unde 1 reprezintă o potrivire perfectă. NFI este calculat ca diferența dintre Chi-Pătratul modelului nul (un model de bază care presupune că nu există relații între variabile) și Chi-Pătratul modelului țintă, împărțită la Chi-Pătratul modelului nul. O valoare de peste 0.9 este considerată o potrivire bună.

Alți Indici Importanți de Potrivire

Pe lângă GFI, AGFI și NFI, există și alți indici de potrivire pe care cercetătorii îi utilizează pentru a obține o evaluare completă a potrivirii modelului. Câțiva dintre aceștia includ:

- Indicele de Potrivire Comparativ (CFI): Compară potrivirea modelului țintă cu un model de bază independent. Este considerat mai robust la dimensiunea eșantionului decât NFI. Valori peste 0.90 sau 0.95 sunt considerate bune.

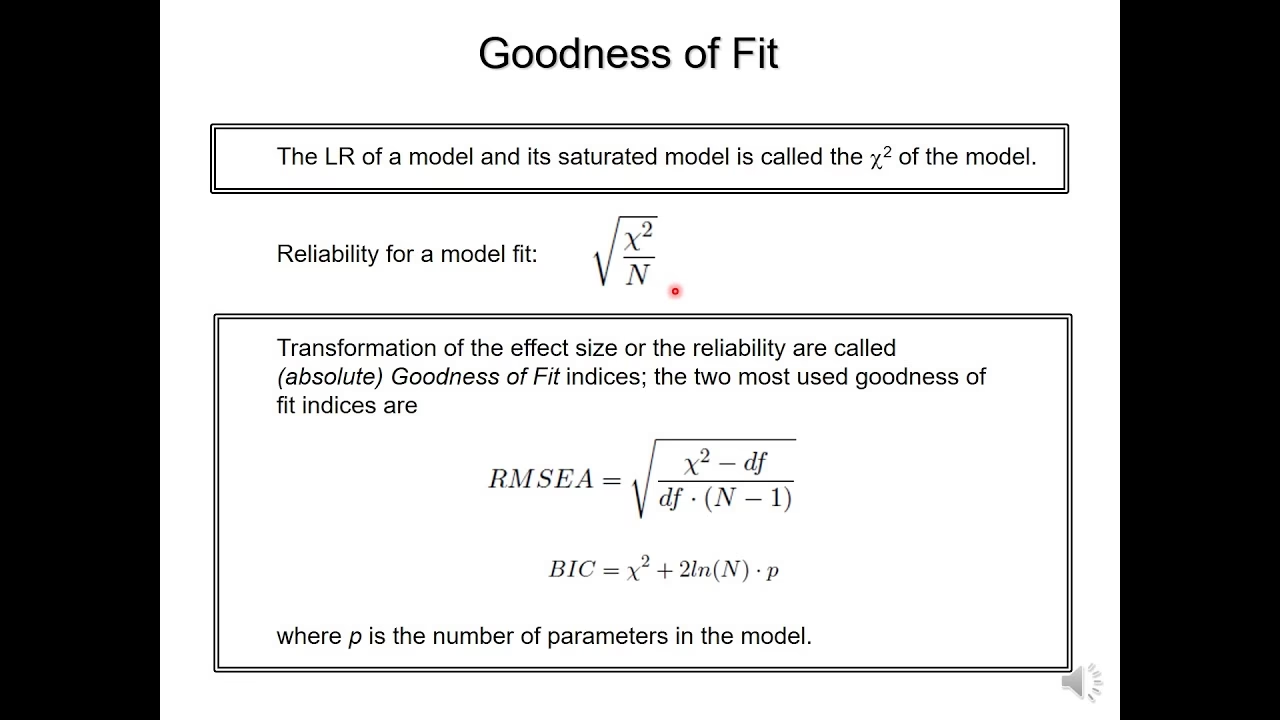

- Eroarea Rădăcinii Pătrate Medii de Aproximare (RMSEA): Evaluează cât de bine modelul, cu estimări de parametri necunoscute, dar optim alese, se potrivește matricei de covarianță a populației. Valori sub 0.08 indică o potrivire bună, iar sub 0.05 o potrivire foarte bună.

Folosirea unui singur indice nu este suficientă; o abordare holistică, care implică analiza mai multor indici, este întotdeauna recomandată pentru a trage concluzii robuste despre potrivirea unui model.

Tabel Comparativ: Indici Cheie de Bunătate a Potrivirii

| Indice | Interval de Valori | Interpretare Generală | Considerații |

|---|---|---|---|

| GFI (Goodness of Fit Index) | 0 - 1 | > 0.90 (bun), > 0.95 (foarte bun) | Sensibil la dimensiunea eșantionului, nu penalizează complexitatea. |

| AGFI (Adjusted Goodness of Fit Index) | 0 - 1 | > 0.90 (bun), > 0.95 (foarte bun) | Ajustat pentru complexitatea modelului, previne supra-adaptarea. |

| NFI (Normed Fit Index) | 0 - 1 | > 0.90 (bun) | Compară modelul cu un model nul, poate fi sensibil la dimensiunea eșantionului. |

| CFI (Comparative Fit Index) | 0 - 1 | > 0.90 (bun), > 0.95 (foarte bun) | Robust la dimensiunea eșantionului, comparație cu modelul de bază. |

| RMSEA (Root Mean Square Error of Approximation) | 0 - Infinit | < 0.08 (bun), < 0.05 (foarte bun) | Evaluează eroarea de aproximare în populație, mai puțin sensibil la dimensiunea eșantionului. |

Limitări și Considerații

Deși indicii de bunătate a potrivirii sunt instrumente valoroase, este esențial să fim conștienți de limitările lor pentru a evita concluziile incorecte. O limitare majoră este sensibilitatea la dimensiunea eșantionului. De exemplu, GFI poate indica o potrivire bună pentru eșantioane mici, chiar dacă modelul nu este o reprezentare exactă a datelor. Invers, cu eșantioane foarte mari, chiar și discrepanțe minore pot duce la un GFI mai mic, deși modelul ar putea fi rezonabil de precis.

De asemenea, GFI nu penalizează în mod intrinsec complexitatea modelului. Modelele cu mai mulți parametri pot „umfla” artificial valoarea GFI, ducând la supra-adaptare. De aceea, AGFI este adesea preferat sau utilizat în paralel. Cel mai important, niciun indice nu ar trebui utilizat izolat. O evaluare cuprinzătoare a potrivirii modelului necesită examinarea mai multor indici, deoarece fiecare oferă o perspectivă ușor diferită asupra potrivirii. Prin combinarea GFI, AGFI, NFI, CFI și RMSEA, cercetătorii pot obține o imagine mult mai clară și mai fiabilă asupra cât de bine se potrivește modelul lor cu datele.

Întrebări Frecvente (FAQ)

Q: Ce este bunătatea potrivirii și de ce este importantă?

A: Bunătatea potrivirii este o măsură statistică ce evaluează cât de bine se potrivește un model teoretic sau o distribuție ipotetică cu datele observate. Este crucială pentru a valida modelele, asigurându-ne că acestea reflectă cu precizie realitatea și că deciziile bazate pe ele sunt solide și fiabile. Fără o bună potrivire, concluziile noastre ar putea fi eronate.

Q: Care este diferența dintre un test de bunătate a potrivirii și un indice de potrivire?

A: Un test de bunătate a potrivirii (precum Chi-Pătrat sau G-test) produce o valoare p care ne ajută să decidem dacă diferențele dintre datele observate și cele așteptate sunt statistic semnificative. Un indice de potrivire (precum GFI, AGFI, NFI, CFI, RMSEA) oferă o măsură continuă a cât de bine se potrivește modelul, adesea pe o scară de la 0 la 1, și este folosit în special în modelarea cu ecuații structurale pentru a compara modele sau a evalua potrivirea generală.

Q: Ce valoare a GFI sau AGFI este considerată „bună”?

A: În general, o valoare de 0.90 sau mai mare pentru GFI și AGFI este considerată a indica o potrivire acceptabilă. Mulți cercetători țintesc spre 0.95 sau mai mare pentru o potrivire foarte bună. Totuși, aceste praguri sunt orientative și ar trebui interpretate în contextul specific al studiului și al altor indici de potrivire.

Q: De ce nu ar trebui să mă bazez pe un singur indice de potrivire?

A: Fiecare indice de potrivire are punctele sale forte și slabe și poate fi influențat diferit de factori precum dimensiunea eșantionului sau complexitatea modelului. Bazându-vă pe mai mulți indici, obțineți o imagine mai completă și mai robustă a potrivirii modelului, minimizând riscul de a trage concluzii incorecte din cauza unei singure metrici.

Q: Pot aplica aceste concepte în analiza datelor din fitness?

A: Absolut! Fie că dezvoltați un model pentru a prezice succesul unui program de slăbire, eficacitatea unui anumit tip de antrenament pentru creșterea forței, sau relația dintre aportul caloric și performanța atletică, aplicarea testelor și indicilor de bunătate a potrivirii este esențială. Ele vă ajută să vă asigurați că modelele dvs. statistice sunt valide și că pot fi utilizate pentru a face predicții de încredere și pentru a ghida decizii informate în domeniul fitness-ului și bunăstării.

Concluzie

Conceptul de Bunătate a Potrivirii este indispensabil în arsenalul oricărui analist de date, de la cercetătorii științifici la antrenorii personali care doresc să optimizeze programele de antrenament pe baza datelor. Prin înțelegerea și aplicarea corectă a testelor precum Chi-Pătrat și G-test, precum și a indicilor precum GFI, AGFI, NFI, CFI și RMSEA, putem evalua cu rigurozitate cât de bine modelele noastre statistice se aliniază cu realitatea. Această validare este fundamentală pentru a construi modele robuste și fiabile, capabile să ofere perspective semnificative și să susțină decizii bazate pe dovezi. Într-o lume din ce în ce mai bazată pe date, asigurarea „bunătății potrivirii” este cheia pentru a transforma informațiile brute în înțelepciune acționabilă și pentru a progresa în orice domeniu, inclusiv în cel al fitness-ului și al sănătății.

Dacă vrei să descoperi și alte articole similare cu Bunătatea Potrivirii: Validarea Modelelor Statistice, poți vizita categoria Fitness.