13/01/2026

În peisajul dinamic al inteligenței artificiale și învățării automate, rețelele neuronale reprezintă un pilon fundamental, având capacitatea de a învăța din date și de a realiza predicții complexe. De la recunoașterea imaginilor și procesarea limbajului natural, până la sisteme de recomandare și diagnostic medical, aplicațiile lor sunt vaste și în continuă expansiune. Procesul de "antrenare" a unei rețele neuronale este esențial pentru ca aceasta să-și îndeplinească funcția. Însă, ce înseamnă cu adevărat să antrenezi o rețea neuronală? Care este scopul suprem al acestui efort intens de calcul și optimizare? Contrar unei percepții comune, obiectivul nu este pur și simplu de a face rețeaua să performeze impecabil pe setul de date pe care a fost antrenată. Adevărata măsură a succesului constă în capacitatea sa de a generaliza, adică de a face predicții precise pe date noi, nevăzute anterior.

Antrenarea unei rețele neuronale este procesul prin care modelul ajustează ponderile și bias-urile sale interne, minimizând o funcție de eroare (sau funcție de cost) care măsoară discrepanța dintre predicțiile sale și valorile reale ale datelor de antrenament. Acest proces iterativ implică de obicei utilizarea unor algoritmi de optimizare, cum ar fi descendența gradientului și variantele sale. Pe măsură ce rețeaua "vede" din ce în ce mai multe exemple, ea învață să identifice tipare și relații complexe în date.

Așa cum am menționat, scopul principal al antrenării unei rețele neuronale nu este doar să obțină o eroare minimă pe setul de antrenament. O rețea care memorează pur și simplu exemplele de antrenament, fără a înțelege principiile subiacente, este inutilă în scenarii reale. Gândiți-vă la un student care memorează răspunsurile la toate întrebările dintr-un manual, dar nu înțelege conceptele. La un examen cu întrebări noi, acest student ar eșua.

Același principiu se aplică și rețelelor neuronale. Obiectivul final este generalizarea. Aceasta înseamnă că rețeaua trebuie să fie capabilă să facă predicții corecte și fiabile pe date noi, care nu au fost incluse în setul de antrenament. O rețea bine antrenată ar trebui să poată extrage caracteristici relevante și să aplice cunoștințele dobândite la situații necunoscute. Dacă o rețea performează excelent pe datele de antrenament, dar slab pe datele noi, atunci suferă de o problemă critică numită supraînvățare (overfitting).

Pe de altă parte, există și problema subînvățării (underfitting), unde rețeaua nu este suficient de complexă pentru a capta tiparele din date, rezultând o performanță slabă atât pe setul de antrenament, cât și pe cel de testare. Balanța dintre supraînvățare și subînvățare este cheia pentru atingerea unei bune capacități de generalizare.

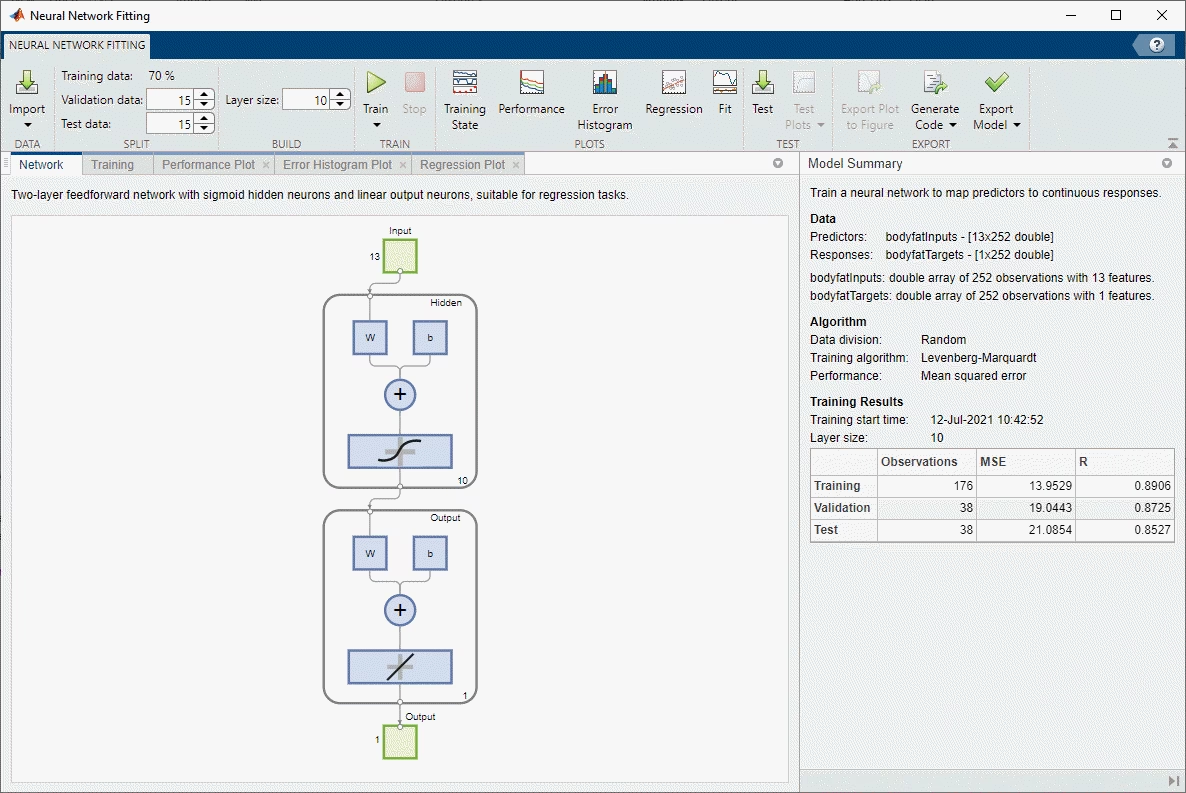

Pentru a evalua corect capacitatea de generalizare a unei rețele, este absolut esențial să împărțim datele disponibile în trei seturi distincte:

- Setul de Antrenament: Acesta este setul de date pe care rețeaua îl "vede" și din care învață. Ponderile și bias-urile sunt ajustate pe baza erorii calculate pe acest set.

- Setul de Validare: Acest set este folosit pentru a monitoriza performanța rețelei în timpul antrenării și pentru a ajusta hiperparametrii (cum ar fi rata de învățare, numărul de epoci, arhitectura rețelei). Este crucial ca rețeaua să nu fie antrenată direct pe acest set, ci doar evaluată periodic. Dacă performanța pe setul de validare începe să scadă, în timp ce performanța pe setul de antrenament continuă să se îmbunătățească, este un semnal clar de supraînvățare.

- Setul de Test: Acesta este "examenul final" pentru rețea. Este un set de date complet nou, pe care rețeaua nu l-a văzut niciodată, nici în timpul antrenării, nici în timpul validării. Performanța pe setul de test oferă cea mai realistă estimare a capacității de generalizare a modelului în lumea reală. Odată ce rețeaua a fost antrenată și hiperparametrii au fost optimizați folosind setul de validare, ea este evaluată o singură dată pe setul de test.

Calitatea și cantitatea datelor sunt factori determinanți pentru succesul antrenării unei rețele neuronale. Fără date relevante și suficiente, chiar și cea mai sofisticată arhitectură de rețea neuronală va eșua în a învăța tipare utile.

Există o multitudine de seturi de date disponibile public, care sunt utilizate frecvent pentru antrenarea și testarea algoritmilor de învățare automată. Printre cele mai cunoscute se numără:

- Seturi de date clasice: Funcțiile

sin(x)șisinC(x)(unde sinC(x) = sin(x)/x pentru x != 0 și 1 pentru x = 0) sunt exemple simple, dar eficiente, pentru testarea capacității de regresie a rețelelor. Testele de paritate n (n-parity tests) sunt adesea folosite pentru a evalua capacitatea de clasificare pe probleme neliniare. - Seturi de date de referință: Celebrul set de date Iris (pentru clasificarea florilor Iris în trei specii), setul de date Semeion (cifre scrise de mână), și multe altele pot fi găsite în UCI Machine Learning Repository. Acesta este o sursă inestimabilă de date pentru cercetare.

- Seturi de date pentru regresie: Multe seturi de date pentru probleme de regresie sunt disponibile, multe dintre ele fiind, de asemenea, găsite în depozitul UCI.

- Platforme de date practice: Pentru seturi de date mai mari și mai diverse, orientate spre aplicații practice, platforme precum Kaggle oferă o multitudine de competiții și depozite de date din diverse domenii.

Înainte de a alimenta o rețea neuronală cu date, este aproape întotdeauna necesară o etapă de preprocesare. Aceasta asigură că datele sunt într-un format adecvat și optim pentru învățare. Câteva aspecte importante includ:

- Normalizarea și Scalarea: Mulți algoritmi de învățare automată, inclusiv rețelele neuronale, performează mai bine atunci când valorile numerice sunt scalate într-un anumit interval (de exemplu, între 0 și 1 sau cu medie zero și varianță unitară). În R, funcția

normalizeDatadin pachetul RSNNS poate fi utilizată. În alte medii, cum ar fi Octave sau MATLAB, s-ar putea să fie necesară implementarea manuală a acestor funcții. Scalarea previne ca atributele cu valori mari să domine procesul de învățare. - Gestionarea variabilelor categorice: Atributele categorice (cum ar fi "genul" sau "culoarea") nu pot fi introduse direct într-o rețea neuronală. Ele trebuie transformate în reprezentări numerice. O metodă comună este "one-hot encoding". De exemplu, pentru setul de date Abalone, atributul "Gen" are valorile "M" (masculin), "F" (feminin) și "I" (infant). Acestea pot fi transformate în vectori binari: "M" -> [1,0,0], "F" -> [0,1,0], "I" -> [0,0,1]. Această transformare poate fi realizată rapid chiar și cu un editor de text prin înlocuiri multiple (Ctrl+R).

- Gestionarea valorilor lipsă: Valorile lipsă trebuie fie imputate (înlocuite cu o valoare estimată), fie rândurile respective eliminate, în funcție de context și volumul de date.

Odată preprocesare, datele ar trebui salvate într-un format ușor accesibil pentru a facilita experimentele ulterioare.

Deși scopul este clar, atingerea unei bune capacități de generalizare poate fi o provocare. Câteva obstacole comune includ:

- Supraînvățarea (Overfitting): Rețeaua învață "zgomotul" din datele de antrenament, nu doar tiparele relevante. Rezultă o performanță excelentă pe setul de antrenament, dar slabă pe datele noi.

- Subînvățarea (Underfitting): Rețeaua este prea simplă pentru a modela complexitatea datelor, sau nu a fost antrenată suficient. Performanța este slabă pe ambele seturi (antrenament și test).

- Ponderea datelor: Seturile de date dezechilibrate pot duce la modele care favorizează clasa majoritară.

- Hiperparametrii: Alegerea corectă a ratei de învățare, a numărului de straturi, a numărului de neuroni per strat și a funcțiilor de activare este crucială și adesea necesită experimentare.

Există diverse strategii și tehnici pentru a combate supraînvățarea și a promova o bună generalizare:

- Regularizarea: Adăugarea unui termen de penalizare la funcția de cost pentru a descuraja ponderile mari (L1 și L2 regularization).

- Dropout: În timpul antrenării, un anumit procent de neuroni sunt "dezactivați" aleatoriu, forțând rețeaua să învețe reprezentări mai robuste și mai puțin dependente de neuroni individuali.

- Oprirea timpurie (Early Stopping): Monitorizarea performanței pe setul de validare și oprirea antrenării atunci când eroarea pe acest set începe să crească, chiar dacă eroarea pe setul de antrenament continuă să scadă.

- Augmentarea datelor: Crearea artificială de date de antrenament suplimentare prin transformări minore ale datelor existente (ex: rotirea, scalarea, decuparea imaginilor).

- Validarea încrucișată (Cross-Validation): O tehnică statistică pentru a estima performanța unui model, împărțind datele în mai multe sub-seturi pentru antrenament și testare, și rotind rolurile acestora.

Pentru a ști dacă o rețea a atins scopul de generalizare, trebuie să măsurăm performanța pe setul de test folosind metrici adecvate. Alegerea metricii depinde de tipul problemei (clasificare, regresie etc.):

- Pentru Clasificare: Acuratețe (Accuracy), Precizie (Precision), Rechemare (Recall), Scorul F1, Matricea de Confuzie (Confusion Matrix), Curba ROC AUC.

- Pentru Regresie: Eroarea Medie Pătratică (Mean Squared Error - MSE), Rădăcina Pătrată a Erorii Medii Pătratice (Root Mean Squared Error - RMSE), Eroarea Absolută Medie (Mean Absolute Error - MAE), R-squared.

| Aspect | Supraînvățare (Overfitting) | Subînvățare (Underfitting) | Generalizare Ideală |

|---|---|---|---|

| Performanță pe Setul de Antrenament | Foarte bună / Excelentă | Slabă | Bună |

| Performanță pe Setul de Test | Slabă | Slabă | Foarte bună / Excelentă |

| Complexitate Model | Prea complexă (memorează zgomot) | Prea simplă (nu captează tipare) | Optimă (captează tiparele esențiale) |

| Problemă Principală | Memorare, nu învățare | Incapacitate de a învăța | Echilibru optim |

| Soluții | Regularizare, Dropout, Oprire timpurie, Mai multe date | Model mai complex, Antrenare mai lungă, Mai multe caracteristici | Experimentare și ajustare fină |

Întrebări Frecvente (FAQ)

Q: De ce este supraînvățarea o problemă atât de mare?

A: Supraînvățarea înseamnă că modelul tău a memorat datele de antrenament, inclusiv zgomotul și particularitățile lor, în loc să învețe tiparele generale. Când întâlnește date noi, care nu au aceleași "particularități memorate", performanța sa scade drastic. Este ca și cum ai învăța pentru un examen memorând fiecare virgulă dintr-un text, fără să înțelegi conceptul. La o întrebare formulată diferit, nu vei ști să răspunzi.

Q: Câte date am nevoie pentru a antrena o rețea neuronală?

A: Nu există un număr fix, depinde de complexitatea problemei și a modelului. Cu cât problema este mai complexă și modelul mai mare, cu atât vei avea nevoie de mai multe date pentru a preveni supraînvățarea și a asigura o bună generalizare. Regula generală este "cu cât mai multe, cu atât mai bine", dar calitatea datelor primează întotdeauna cantității.

Q: Pot folosi același set de date pentru antrenament și testare?

A: Nu, sub nicio formă! Aceasta ar duce la o evaluare extrem de optimistă și înșelătoare a performanței modelului. Dacă testezi pe datele pe care rețeaua le-a văzut deja, nu vei măsura capacitatea de generalizare, ci doar capacitatea de memorare. Este esențial să ai un set de test complet separat și nevăzut.

Q: Ce este o "epocă" în antrenarea rețelelor neuronale?

A: O epocă reprezintă o trecere completă a întregului set de date de antrenament prin rețeaua neuronală. În timpul unei epoci, rețeaua procesează fiecare exemplu din setul de antrenament, ajustează ponderile și bias-urile, și apoi trece la următoarea epocă. Antrenarea se desfășoară pe un număr de epoci, până când modelul converge sau atinge o performanță optimă pe setul de validare.

Q: Cum știu că rețeaua mea generalizează bine?

A: Prin evaluarea performanței pe un set de date de test separat și nevăzut, folosind metrici relevante pentru problema ta (precum acuratețea pentru clasificare sau RMSE pentru regresie). Dacă performanța pe setul de test este similară cu cea de pe setul de antrenament (fără o diferență semnificativă), și ambele sunt bune, atunci modelul tău generalizează probabil bine.

În concluzie, deși antrenarea unei rețele neuronale implică minimizarea erorii pe datele de antrenament, adevăratul obiectiv și cel mai important criteriu de succes este capacitatea modelului de a face predicții precise pe date complet noi. Această capacitate de generalizare este ceea ce transformă un algoritm dintr-un "memorator" într-un "învățător" inteligent, capabil să aducă valoare în aplicații reale. Prin înțelegerea profundă a acestui principiu și prin aplicarea diligentă a tehnicilor de preprocesare, validare și regularizare, putem construi rețele neuronale robuste și fiabile, pregătite să abordeze provocările lumii reale.

Dacă vrei să descoperi și alte articole similare cu Scopul Final al Antrenării Rețelelor Neuronale, poți vizita categoria Fitness.