21/12/2023

În era digitală, unde granițele dintre realitate și ficțiune devin tot mai fluide, un instrument se impune ca lider în domeniul manipulării faciale video: DeepFaceLab. Acest software avansat a devenit pilonul central pentru oricine dorește să exploreze universul deepfake-urilor, permițând înlocuirea fețelor în videoclipuri cu o precizie și un realism remarcabile. Dar ce este mai exact DeepFaceLab și cum se utilizează pentru a atinge rezultate profesionale? Acest articol detaliat vă va ghida prin complexitatea sa, de la conceptele de bază la tehnicile avansate de optimizare.

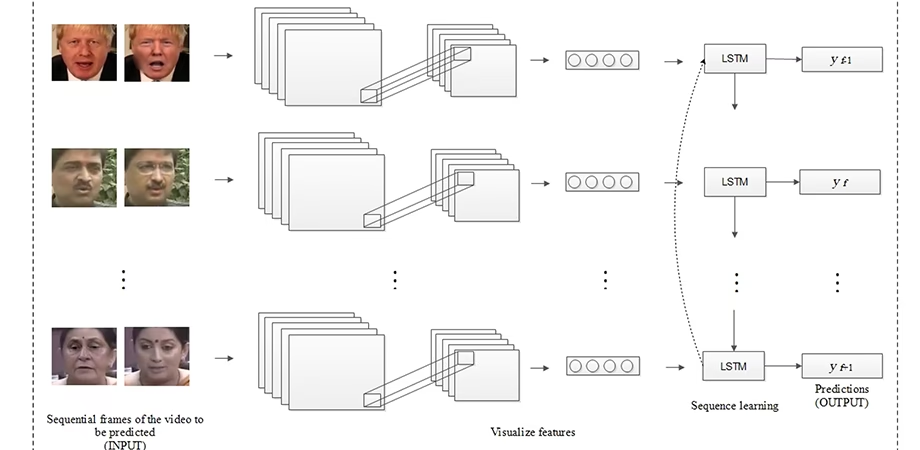

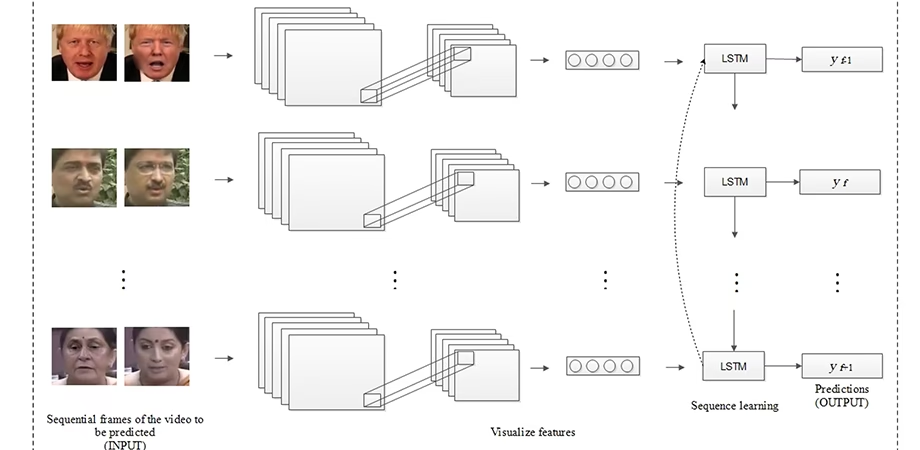

DeepFaceLab este o suită software robustă și open-source, proiectată pentru crearea de conținut media sintetic, în special videoclipuri deepfake. Funcționalitatea sa principală constă în capacitatea de a înlocui fața unei persoane cu fața altei persoane, utilizând algoritmi de învățare profundă. Unul dintre avantajele sale majore este includerea unui set de fețe implicit, derivat din setul de date Flickr Faces HQ, ceea ce elimină necesitatea de a adăuga imagini sau videoclipuri suplimentare pentru pre-antrenarea modelelor. Acest aspect este crucial, deoarece pre-antrenarea accelerează semnificativ procesul de creare a deepfake-urilor, oferind o bază solidă pe care se poate construi ulterior.

- Înțelegerea Fundamentelor: Modele Pre-antrenate și Seturi de Date

- Antrenorul SAE HD: Standardul de Înaltă Definiție

- Gestionarea Resurselor: VRAM și Dimensiunea Batch-ului

- Rezoluția și Arhitectura Modelului: Detaliu și Versatilitate

- Autoencoderele și Modul de Pre-antrenare: Precizie și Bază Solidă

- Îmbunătățirea Realismului Modelelor DeepFaceLab

- Tabel Comparativ: Arhitecturi DeepFaceLab

- Întrebări Frecvente (FAQ)

- Concluzie

Înțelegerea Fundamentelor: Modele Pre-antrenate și Seturi de Date

Piatra de temelie a oricărui deepfake de succes o reprezintă modelul pre-antrenat. Un model pre-antrenat este, în esență, un model de inteligență artificială care a fost deja expus la un volum vast de date – în cazul DeepFaceLab, imagini cu fețe, sub diverse unghiuri, expresii și condiții de iluminare. Această expunere preliminară îi conferă modelului o înțelegere fundamentală a structurii faciale umane, permițându-i să recunoască și să reproducă trăsături complexe. Utilizarea unui model pre-antrenat reduce drastic timpul necesar pentru a obține rezultate decente, deoarece nu trebuie să începeți de la zero. Practic, modelul are deja o „educație” generală despre fețe și trebuie doar „specializat” pe fețele specifice pe care doriți să le schimbați.

Setul de date Flickr Faces HQ (FFHQ) este o colecție de imagini faciale de înaltă calitate, recunoscută în comunitatea de învățare profundă pentru diversitatea și calitatea sa excepțională. DeepFaceLab integrează un subset din acest set de date pentru scopuri de pre-antrenare. Bogăția și varietatea imaginilor din FFHQ asigură că modelele antrenate cu DeepFaceLab pot gestiona o gamă largă de trăsături faciale și expresii, contribuind la realismul și versatilitatea deepfake-urilor generate.

Antrenorul SAE HD: Standardul de Înaltă Definiție

DeepFaceLab oferă diverse configurații de antrenament, dar antrenorul SAE HD (Self-Attention Encoder High Definition) este considerat standardul de aur pentru crearea de modele deepfake de înaltă definiție. Spre deosebire de modelele „quick 96” sau „amp”, care nu suportă opțiuni de pre-antrenare, SAE HD permite utilizarea completă a capacităților de pre-antrenare, esențiale pentru obținerea unor rezultate superioare. Acest antrenor este proiectat să proceseze și să genereze imagini la rezoluții mai mari, capturând detalii fine și expresii subtile, ceea ce este vital pentru un deepfake convingător. Alegerea antrenorului SAE HD este primul pas către obținerea unui realism vizual impresionant.

Gestionarea Resurselor: VRAM și Dimensiunea Batch-ului

Un aspect critic în lucrul cu DeepFaceLab este gestionarea eficientă a resurselor hardware, în special a memoriei video (VRAM) a plăcii grafice (GPU). VRAM este memoria dedicată plăcii grafice pentru stocarea datelor imagistice necesare randării. Modelele de înaltă rezoluție și setările complexe necesită o cantitate semnificativă de VRAM. Fără suficientă VRAM, procesul de antrenament poate fi lent, instabil sau chiar imposibil.

Ajustarea setărilor în funcție de capacitatea VRAM-ului plăcii grafice este esențială. Parametri precum dimensiunea batch-ului și rezoluția modelului au un impact direct asupra consumului de VRAM. Dimensiunea batch-ului se referă la numărul de imagini procesate per iterație în timpul antrenamentului modelului. O dimensiune mai mare a batch-ului poate accelera antrenamentul, dar necesită mai mult VRAM. Este recomandat să alegeți o dimensiune a batch-ului care să fie divizibilă cu numărul de GPU-uri utilizate (dacă aveți mai multe), pentru o eficiență optimă a antrenamentului. O dimensiune a batch-ului prea mare pentru VRAM-ul disponibil va duce la erori de tip 'out of memory', în timp ce una prea mică poate încetini antrenamentul.

Rezoluția și Arhitectura Modelului: Detaliu și Versatilitate

Rezoluția în contextul DeepFaceLab se referă la claritatea și nivelul de detaliu al imaginilor deepfake produse de model. O rezoluție mai mare (ex: 224, 320, 512 pixeli sau mai mult) rezultă în deepfake-uri de o calitate superioară, cu detalii faciale mai clare și mai puțină neclaritate. Totuși, calitatea superioară vine cu prețul unui consum crescut de VRAM și al unei puteri de procesare mai mari. Este important să alegeți o rezoluție care să fie divizibilă cu 16 sau 32, în funcție de arhitectura modelului, pentru a optimiza procesul de antrenament și a evita artefactele vizuale.

Arhitectura modelului se referă la designul și structura rețelei neuronale utilizate de DeepFaceLab. Există două arhitecturi principale menționate: DF (DeepFakes) și LIAE. Arhitectura LIAE (Lightweight Invertible Autoencoder) este considerată mai versatilă în capturarea calităților imaginii de destinație și este adesea preferată pentru proiecte care necesită o adaptabilitate mai mare la diverse condiții faciale. Alegerea arhitecturii influențează direct procesul de antrenament și calitatea finală a deepfake-ului.

Autoencoderele și Modul de Pre-antrenare: Precizie și Bază Solidă

Un autoencoder este un tip de rețea neuronală artificială utilizată pentru a învăța codificări eficiente ale datelor neetichetate. În DeepFaceLab, dimensiunile autoencoderului sunt parametri ajustabili care influențează precizia modelului în detectarea și reproducerea trăsăturilor faciale, a culorilor și a altor detalii. Dimensiuni mai mari ale autoencoderului pot îmbunătăți acuratețea modelului, dar, la fel ca în cazul rezoluției, cresc și utilizarea VRAM-ului și timpul de antrenament.

Modul de pre-antrenare în DeepFaceLab este o setare esențială care permite antrenarea inițială a modelelor folosind un set mare de date de imagini (cum ar fi FFHQ). Activarea acestui mod este crucială pentru crearea de modele care pot fi ulterior ajustate fin pentru sarcini specifice de deepfake. Pre-antrenarea oferă o bază solidă de cunoștințe faciale, ceea ce duce la rezultate mult mai bune și mai rapide, comparativ cu antrenarea de la zero.

Îmbunătățirea Realismului Modelelor DeepFaceLab

Odată ce înțelegeți fundamentele, următorul pas este să rafinați modelele pentru a obține un realism cât mai înalt. Iată câteva strategii avansate:

- Utilizarea VRAM-ului Avansat: Modelele de înaltă rezoluție, cum ar fi cele de 512x512 sau chiar mai mari, necesită o cantitate substanțială de VRAM. Investiția într-o placă grafică puternică, cu VRAM generos (ex: 12GB, 24GB sau mai mult), este esențială pentru a rula și antrena eficient aceste modele. Fără suficientă memorie video, veți fi limitat la rezoluții mai mici și la o calitate inferioară.

- Modelul RTT: Un Start Rapid spre Perfecțiune: Modelul RTT (Ready-To-Train) este un model pre-antrenat care a atins deja un număr mare de iterații. Utilizarea unui model RTT ca punct de plecare oferă un avantaj semnificativ, accelerând procesul de antrenament și permițând obținerea unor rezultate superioare într-un timp mai scurt. Este ca și cum ați prelua un proiect deja pe jumătate finalizat, gata de finisare.

- Encoder și Decoder: Motoarele Antrenamentului: Encoderul transformă datele de intrare (imagini) într-un format pe care modelul îl poate înțelege, în timp ce decoderul transformă ieșirea modelului înapoi într-o imagine recunoscută. Utilizarea unor encodere și decodere de calitate superioară, adesea disponibile în modelele RTT sau antrenate pe seturi de date extinse, poate amplifica semnificativ calitatea și realismul rezultatelor.

- Setul de Fețe: Calitate și Diversitate: Calitatea și diversitatea setului de fețe (atât sursă, cât și destinație) sunt factori critici. Asigurați-vă că aveți o colecție vastă de imagini clare, bine iluminate, cu expresii variate și unghiuri diferite ale feței. Un set de fețe sărac în calitate sau diversitate va limita realismul deepfake-ului, indiferent de puterea hardware-ului sau a modelului.

- Iterațiile de Antrenament: Drumul spre Rafinament: Numărul de iterații de antrenament se referă la de câte ori modelul procesează datele pentru a învăța și a se îmbunătăți. Cu cât numărul de iterații este mai mare, cu atât modelul devine mai rafinat. Modelele pre-antrenate, cum ar fi RTT, au deja milioane de iterații, oferind un start rapid. Continuarea antrenamentului pentru un număr substanțial de iterații (sute de mii sau chiar milioane) este esențială pentru a elimina artefactele și a obține o integrare perfectă a fețelor.

- XSeg: Extracția Precisă a Trăsăturilor Faciale: XSeg este un proces în DeepFaceLab care extrage cu precizie trăsăturile faciale din imagini, creând o mască ce izolează fața. Utilizarea unui model XSeg pre-antrenat (disponibil în DeepFaceLab) accelerează semnificativ acest proces de extracție și asigură o delimitare mai precisă a feței, contribuind la o integrare mai lină a feței în deepfake.

- Rezoluția în Detaliu: Impactul asupra Calității Finale: Pe lângă alegerea unei rezoluții optime (divizibile cu 16 sau 32), experimentați cu diferite dimensiuni, cum ar fi 192, 224, 320 sau mai mari. Rețineți că o rezoluție mai mare va produce un videoclip deepfake mai detaliat, dar va crește exponențial cerințele de VRAM și timpul de antrenament. Echilibrul între rezoluție și resurse este cheia.

- Antrenamentul GAN: Reducerea Artefactelor și Rafinarea Calității: Rețelele Generative Adversariale (GAN) sunt un tip de algoritm AI utilizat în DeepFaceLab pentru a genera imagini realiste. Procesul de antrenament GAN implică rafinarea continuă a modelului pentru a reduce artefactele vizuale (cum ar fi petele, distorsiunile sau marginile neregulate) și pentru a îmbunătăți calitatea generală a fețelor generate. Antrenamentul GAN este un pas avansat, dar crucial, pentru a atinge un nivel înalt de realism și pentru a face deepfake-ul aproape imposibil de distins de original.

Tabel Comparativ: Arhitecturi DeepFaceLab

| Caracteristică | Arhitectura DF (DeepFakes) | Arhitectura LIAE (Lightweight Invertible Autoencoder) | Antrenorul SAE HD |

|---|---|---|---|

| Versatilitate | Mai puțin versatilă în capturarea calităților destinației | Mai versatilă în capturarea calităților destinației | Standard pentru HD, suportă pre-antrenare |

| Complexitate | Mai simplă | Mai complexă, dar eficientă | Complexitate medie spre înaltă |

| Calitatea ieșirii | Bună pentru bază | Potențial superior pentru detalii fine | Excelentă, înaltă definiție |

| Suport pre-antrenare | Da | Da | Da (specific pentru el) |

| Utilizare VRAM | Moderat | Moderat spre înalt | Înalt |

| Timp antrenament | Mai rapid (pentru rezoluții mici) | Variabil, depinde de setări | Mai lent (pentru HD) |

Întrebări Frecvente (FAQ)

Q: Cât VRAM am nevoie pentru a rula DeepFaceLab eficient?

A: Pentru proiecte de bază, 8GB de VRAM pot fi suficienți. Pentru modele de înaltă rezoluție (320px+) și un realism sporit, se recomandă minim 12GB, ideal 24GB sau mai mult.

Q: Pot folosi DeepFaceLab fără o placă grafică puternică?

A: Tehnic, da, dar procesul de antrenament va fi extrem de lent (zile sau săptămâni pentru rezultate decente) și veți fi limitat la rezoluții foarte mici. Un GPU dedicat este aproape obligatoriu pentru o experiență practică.

Q: Cât timp durează antrenarea unui model DeepFaceLab?

A: Depinde de puterea GPU-ului, de rezoluție, de dimensiunea setului de date și de numărul de iterații. Poate dura de la câteva ore (pentru rezultate rapide, de bază) la câteva zile sau chiar săptămâni (pentru modele de înaltă calitate și realism maxim).

Q: Ce este un deepfake și este legal să creez unul?

A: Un deepfake este un videoclip sau o imagine modificată digital, de obicei prin înlocuirea feței unei persoane cu fața alteia. Legalitatea deepfake-urilor variază în funcție de jurisdicție și de scopul utilizării. Este esențial să verificați legile locale și să utilizați DeepFaceLab în mod responsabil și etic, evitând crearea de conținut dăunător sau ilegal.

Q: Cum pot evita artefactele vizuale în deepfake-ul meu?

A: Artefactele pot fi reduse prin utilizarea unor seturi de fețe de înaltă calitate, antrenament pe un număr mare de iterații, ajustarea fină a parametrilor autoencoderului, utilizarea antrenamentului GAN și asigurarea unei gestionări adecvate a VRAM-ului și a dimensiunii batch-ului.

Concluzie

DeepFaceLab reprezintă o punte către un domeniu fascinant al creativității digitale și al inteligenței artificiale. De la înțelegerea conceptelor de bază, cum ar fi modelele pre-antrenate și gestionarea VRAM, până la tehnicile avansate de optimizare a rezoluției și a antrenamentului GAN, fiecare pas contribuie la crearea unor deepfake-uri din ce în ce mai realiste. Cu răbdare, experimentare și o înțelegere solidă a principiilor subiacente, oricine poate stăpâni acest instrument puternic. Amintiți-vă că, la fel ca orice tehnologie avansată, DeepFaceLab necesită o utilizare responsabilă și etică. Explorați, creați și inovați, dar întotdeauna cu conștientizarea impactului potențial al creațiilor voastre digitale.

Dacă vrei să descoperi și alte articole similare cu DeepFaceLab: Arta Transformării Digitale, poți vizita categoria Fitness.