08/05/2023

În lumea dinamică a inteligenței artificiale și a învățării automate, construirea unui model este doar jumătate din ecuație. Adevărata provocare și, totodată, secretul succesului rezidă în capacitatea de a înțelege și de a evalua performanța acestor modele pe parcursul procesului de antrenament. Două dintre cele mai fundamentale și esențiale metrici care ne ghidează în această călătorie sunt pierderea (loss) și acuratețea (accuracy). Acestea nu sunt doar simple cifre; ele reprezintă pulsul modelului nostru, indicând dacă învață eficient, dacă generalizează bine pe date noi sau dacă se confruntă cu probleme precum supraantrenarea sau subantrenarea. Fără o înțelegere aprofundată a modului în care se măsoară și se interpretează aceste metrici, procesul de optimizare a unui model ar fi pură ghicitoare. Acest articol vă va introduce în conceptele de bază ale pierderii și acurateței, vă va arăta cum să le monitorizați în timpul antrenamentului și cum să le folosiți pentru a diagnostica și a îmbunătăți performanța modelelor voastre de învățare automată.

- Ce Este Pierderea (Loss) în Antrenament?

- Înțelegerea Acurateții (Accuracy)

- Matricea de Confuzie: O Perspectivă Mai Aprofundată

- Cum Să Măsurați Pierderea și Acuratețea în Practică

- Prevenirea Supraantrenării (Overfitting) și Subantrenării (Underfitting)

- Importanța Generalizării și a Setului de Validare

- Epoci de Antrenament

- Tabel Comparativ: Pierderea și Acuratețea

- Întrebări Frecvente (FAQ)

- Concluzie

Ce Este Pierderea (Loss) în Antrenament?

Pierderea, sau funcția de cost, este o măsură a cât de eronate sunt predicțiile modelului nostru în comparație cu valorile reale. Cu cât valoarea pierderii este mai mică, cu atât modelul face predicții mai precise. Scopul principal al antrenamentului unui model de învățare automată este de a minimiza această valoare a pierderii. Procesul de optimizare ajustează greutățile și biasurile rețelei neuronale pentru a reduce continuu această eroare.

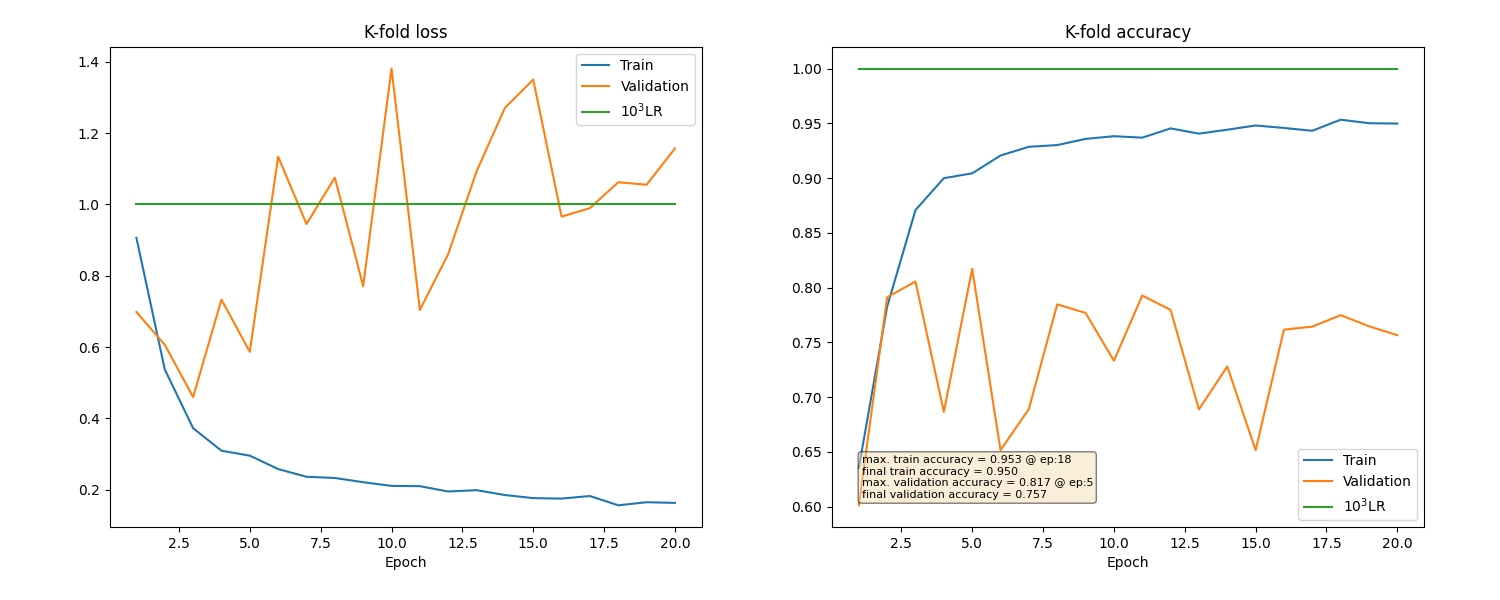

Pierderea de Antrenament vs. Pierderea de Validare

Este crucial să facem distincția între două tipuri de pierdere:

- Pierderea de Antrenament (Training Loss): Aceasta măsoară eroarea modelului pe datele pe care le-a "văzut" și pe care le folosește pentru a învăța. O pierdere de antrenament în scădere constantă indică faptul că modelul învață eficient din datele disponibile.

- Pierderea de Validare (Validation Loss): Aceasta măsoară eroarea modelului pe un set separat de date, pe care modelul nu le-a "văzut" niciodată în timpul antrenamentului. Această metrică este esențială pentru a evalua capacitatea de generalizare a modelului – adică, cât de bine funcționează pe date noi, necunoscute.

Monitorizarea ambelor curbe de pierdere este vitală. În mod ideal, am dori să vedem ambele curbe scăzând constant pe parcursul antrenamentului. Dacă pierderea de antrenament scade, dar cea de validare începe să crească sau stagnează, acesta este un semn clar de supraantrenare (overfitting). Aceasta înseamnă că modelul a "memorat" datele de antrenament, inclusiv zgomotul din ele, și nu mai poate generaliza eficient pe date noi.

Înțelegerea Acurateții (Accuracy)

Acuratețea este, probabil, cea mai intuitivă și ușor de înțeles metrică de performanță, mai ales în sarcinile de clasificare. Ea reprezintă pur și simplu procentul de predicții corecte făcute de model din totalul predicțiilor. Se calculează ca raportul dintre numărul de predicții corecte și numărul total de predicții:

Acuratețe = (Număr de predicții corecte) / (Număr total de predicții)

De exemplu, dacă un model clasifică corect 90 din 100 de imagini, acuratețea sa este de 90%. O acuratețe în creștere, atât pe setul de antrenament, cât și pe cel de validare, este un indicator pozitiv că modelul se îmbunătățește.

Limitările Acurateții Pure

Deși acuratețea este un bun punct de plecare, ea are limitările sale, mai ales în cazul seturilor de date cu distribuție dezechilibrată (skewed data distribution). De exemplu, într-un set de date în care 99% dintre imagini nu conțin fețe și doar 1% conțin fețe, un model ar putea obține o acuratețe de 99% pur și simplu prin prezicerea "non-față" de fiecare dată, fără a clasifica corect vreo față. În astfel de cazuri, acuratețea singură este înșelătoare și nu oferă o imagine completă a performanței modelului. De asemenea, acuratețea nu ne spune ce fel de greșeli a făcut modelul – a prezis "pisică" când era "câine" sau invers?

Matricea de Confuzie: O Perspectivă Mai Aprofundată

Pentru a depăși limitările acurateții, în special în sarcinile de clasificare, se recomandă utilizarea unei matrici de confuzie. Aceasta este o tabelă care vizualizează performanța unui algoritm de clasificare. Fiecare rând al matricii reprezintă clasa reală (ground truth), iar fiecare coloană reprezintă clasa prezisă de model. Elementele din matrice oferă informații detaliate despre performanța clasificatorului pentru fiecare clasă în parte.

De exemplu, într-o matrice de confuzie cu 10 clase, rândul 0 ar arăta câte eșantioane din clasa 0 au fost prezise corect ca clasa 0, și de câte ori au fost greșit prezise ca fiind alte clase (1, 2, ..., 9). Aceasta ne permite să identificăm cu ușurință unde modelul are dificultăți și ce tipuri de erori predomină (de exemplu, fals pozitive sau fals negative).

Cum Să Măsurați Pierderea și Acuratețea în Practică

Implementarea și monitorizarea acestor metrici variază ușor în funcție de framework-ul de învățare automată utilizat. Iată câteva exemple comune:

În Keras/TensorFlow

Când antrenați un model Keras, istoricul antrenamentului este stocat automat în obiectul model.history. După rularea modelului pentru un anumit număr de epoci, puteți accesa ușor pierderea și acuratețea:

history = model.history.history print(history)Acest lucru va returna un dicționar care conține liste cu valorile pierderii și acurateței pentru fiecare epocă, atât pentru setul de antrenament, cât și, dacă este specificat, pentru setul de validare. De exemplu:

{ 'loss': [0.221, 0.097, 0.068, 0.054, 0.043], 'accuracy': [0.934, 0.969, 0.977, 0.982, 0.985] }Acest dicționar vă permite să vizualizați progresul modelului pe parcursul antrenamentului și să identificați rapid tendințele.

În PyTorch

Spre deosebire de Keras, PyTorch oferă o flexibilitate mai mare, dar necesită adesea o implementare manuală a funcțiilor de antrenament, validare și calcul al acurateței. Acest lucru vă oferă control deplin asupra procesului. Iată cum se calculează acuratețea într-o buclă tipică de antrenament PyTorch:

În interiorul buclei de antrenament, după ce obțineți "outputs" (ieșirile modelului, de obicei logit-uri sau probabilități pentru fiecare clasă) și "labels" (clasele reale), puteți calcula acuratețea:

# outputs: [batch_size, nr_classes] -> e.g.: [64,10] _, predicted = torch.max(outputs, 1) # Obține indicele clasei cu probabilitatea maximă # predicted: [batch_size,1] correct += (predicted == labels).sum().item() # Numără predicțiile corecte și le adaugă la total total += labels.size(0) # Adaugă numărul total de etichete din batch train_accuracy = 100 * correct / totalAici, torch.max(outputs, 1) returnează valoarea maximă și indicele acesteia de-a lungul dimensiunii 1 (clasele). Ne interesează doar indicele (clasa prezisă). Apoi, comparăm clasele prezise cu etichetele reale și sumăm numărul de concordanțe. Metoda .item() este folosită pentru a converti un tensor PyTorch cu un singur element într-o valoare numerică standard Python. Aceste valori correct și total sunt acumulate pe parcursul unei epoci pentru a calcula acuratețea totală a antrenamentului sau a validării.

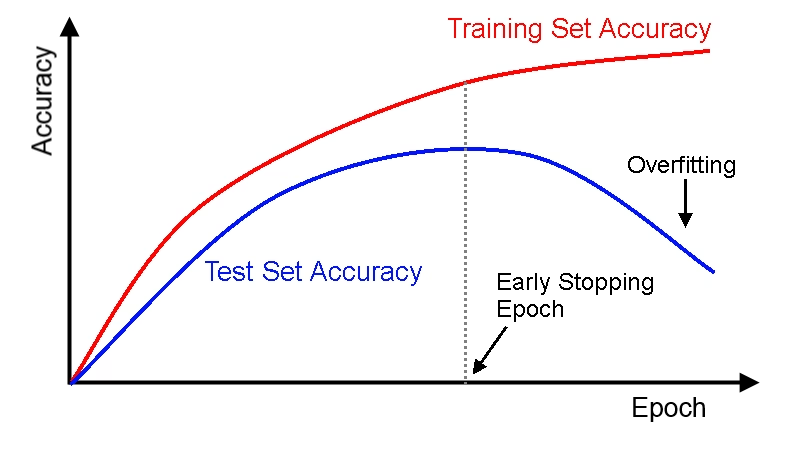

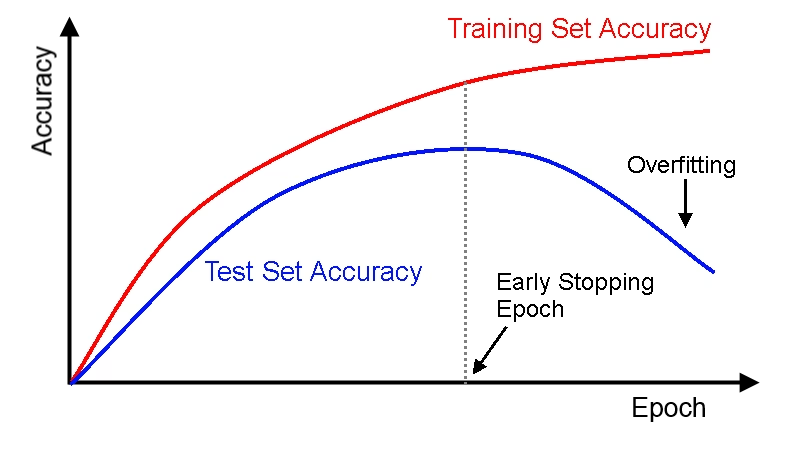

Prevenirea Supraantrenării (Overfitting) și Subantrenării (Underfitting)

Monitorizarea atentă a pierderii și acurateței ne ajută să identificăm două probleme comune:

- Subantrenarea (Underfitting): Apare atunci când modelul nu a învățat suficient din datele de antrenament și, prin urmare, performează slab atât pe setul de antrenament, cât și pe cel de validare. Ambele curbe de pierdere rămân ridicate. Soluții pot include: creșterea complexității modelului, antrenament pentru mai multe epoci, ajustarea ratei de învățare.

- Supraantrenarea (Overfitting): Modelul a învățat prea mult din datele de antrenament, memorând zgomotul și specificul acestora, dar nu generalizează bine pe date noi. Pierderea de antrenament scade, în timp ce pierderea de validare stagnează sau crește. Soluții comune includ: Dropout (dezactivarea aleatorie a neuronilor în timpul antrenamentului pentru a forța modelul să nu se bazeze pe un singur set de neuroni), Regularizare L1/L2 (adaugă o penalizare la funcția de pierdere pentru greutăți mari, descurajând complexitatea excesivă a modelului), creșterea dimensiunii setului de date de antrenament, sau oprirea timpurie a antrenamentului.

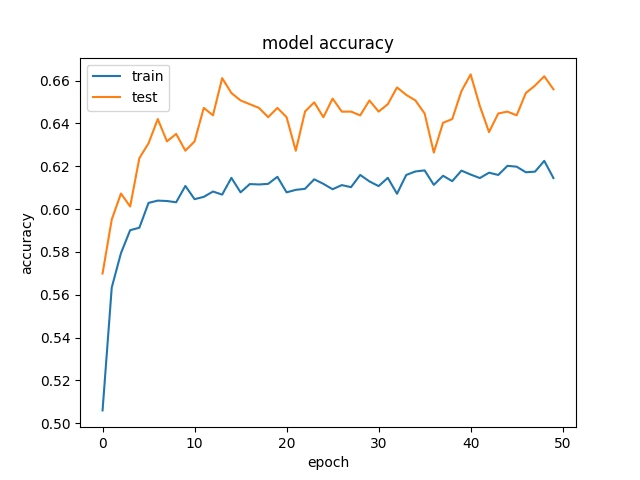

Importanța Generalizării și a Setului de Validare

Un aspect fundamental în evaluarea performanței este conceptul de generalizare. Un model bun nu este cel care memorează perfect datele de antrenament, ci cel care poate face predicții precise pe date nevăzute. De aceea, utilizarea unui set de validare separat este absolut crucială. Acesta acționează ca un "examen" pentru model, testându-i capacitatea de a aplica cunoștințele învățate la situații noi. Dacă modelul performează excelent pe setul de antrenament, dar slab pe cel de validare, știm că avem o problemă de generalizare, cel mai probabil supraantrenare.

Epoci de Antrenament

O epocă reprezintă o trecere completă a întregului set de date de antrenament prin rețeaua neuronală, atât înainte (forward pass), cât și înapoi (backward pass, pentru ajustarea greutăților). Modelele sunt antrenate de obicei pe parcursul mai multor epoci, iar pierderea și acuratețea sunt monitorizate la sfârșitul fiecărei epoci pentru a urmări progresul. Antrenarea pentru prea puține epoci poate duce la subantrenare, în timp ce prea multe epoci pot duce la supraantrenare.

Tabel Comparativ: Pierderea și Acuratețea

| Metrică | Descriere | Interpretare (valoare mai mică/mai mare) | Context de utilizare |

|---|---|---|---|

| Pierdere (Loss) | Măsoară eroarea modelului; cât de departe sunt predicțiile de realitate. | Mai mică: Modelul face predicții mai bune. | Optimizare, diagnosticare sub/supraantrenare. |

| Acuratețe (Accuracy) | Procentul predicțiilor corecte din total. | Mai mare: Mai multe predicții corecte. | Evaluare inițială, performanță generală (atenție la seturi dezechilibrate). |

Întrebări Frecvente (FAQ)

De ce pierderea de validare este uneori mai mică decât pierderea de antrenament?

Acest lucru, deși mai puțin obișnuit, poate apărea. Sugerează adesea că setul de date de antrenament este mai complex sau mai "zgomotos" decât setul de validare. De asemenea, unele tehnici precum Dropout sunt aplicate doar în timpul antrenamentului, dar nu și în timpul validării, ceea ce poate face ca modelul să pară "mai bun" în faza de validare.

Cum afectează Dropout pierderea și acuratețea?

Dropout, prin dezactivarea aleatorie a neuronilor, poate face ca pierderea de antrenament să fluctueze mai mult și să fie ușor mai mare decât fără Dropout. Cu toate acestea, scopul său este de a forța modelul să învețe caracteristici mai robuste și mai generalizabile, ducând la o pierdere de validare mai mică și o acuratețe de validare mai mare pe termen lung, reducând supraantrenarea.

Câte epoci ar trebui să antrenez modelul meu?

Nu există un număr fix. Antrenamentul ar trebui să continue atâta timp cât pierderea de validare continuă să scadă și acuratețea de validare continuă să crească. Odată ce pierderea de validare începe să crească sau acuratețea de validare stagnează, este un semn că modelul începe să se supraantreneze, și ar trebui să opriți antrenamentul (sau să implementați oprirea timpurie).

Pot folosi doar acuratețea pentru a evalua un model?

Deși acuratețea este un bun indicator general, nu este suficientă, mai ales pentru seturi de date dezechilibrate. Este esențial să se utilizeze și alte metrici, cum ar fi matricea de confuzie, precizia, recall, scorul F1, și, desigur, pierderea, pentru o evaluare completă și robustă a performanței modelului.

Concluzie

Pierderea și acuratețea sunt pilonii evaluării performanței în învățarea automată. Înțelegerea profundă a acestor metrici și a modului în care interacționează pe parcursul antrenamentului vă oferă puterea de a diagnostica probleme, de a optimiza modele și de a construi sisteme AI mai robuste și mai eficiente. Prin monitorizarea atentă a curbelor de pierdere și acuratețe, atât pe seturile de antrenament, cât și pe cele de validare, puteți ghida procesul de învățare al modelului, evitând capcanele subantrenării și supraantrenării, și asigurându-vă că modelul vostru este pregătit să performeze în lumea reală. Continuați să explorați și să experimentați, iar modelele voastre vor atinge noi culmi de performanță!

Dacă vrei să descoperi și alte articole similare cu Pierderea și Acuratețea: Cheia Evaluării Modelelor AI, poți vizita categoria Fitness.