07/01/2022

În lumea dinamică a analizei datelor și a inteligenței artificiale, capacitatea de a construi modele predictive și explicative este esențială. Indiferent dacă ești un analist de date experimentat sau un entuziast al programării, probabil ai întâlnit conceptul de „antrenare” sau „potrivire” a unui model. În Python, inima acestui proces este adesea encapsulată într-o singură metodă puternică: fit(). Această metodă magică este cea care dă viață modelelor noastre statistice și de învățare automată, permițându-le să învețe din datele pe care le furnizăm. De la regresii liniare simple la modele complexe de serii temporale și ajustări de curbe, fit() este cheia pentru a debloca potențialul ascuns al datelor tale.

Acest articol îți va dezvălui în detaliu ce face metoda fit(), cum funcționează în contextul unor librării Python populare precum Statsmodels și NumPy, și cum poți folosi această cunoștință pentru a construi modele robuste și precise. Vom explora exemple concrete, vom interpreta rezultatele și vom discuta despre cele mai bune practici pentru a te asigura că modelele tale sunt nu doar potrivite, ci și semnificative.

Ce este Metoda fit()?

La bază, metoda fit() este utilizată pentru a „antrena” un model statistic sau de învățare automată pe un set de date. Procesul de „potrivire” implică estimarea parametrilor interni ai modelului, astfel încât acesta să poată descrie cel mai bine relațiile existente în datele furnizate. Gândește-te la asta ca la un antrenament intensiv: îi oferi modelului tău o mulțime de exemple (datele tale), iar fit() este sesiunea de studiu prin care modelul își ajustează „greutățile” și „bias-urile” interne pentru a minimiza eroarea și a maximiza acuratețea predicțiilor sau explicațiilor sale.

Rezultatul unei operațiuni fit() este un obiect „antrenat” sau „potrivit” care conține toți parametrii estimați și informațiile necesare pentru a face predicții noi sau pentru a analiza în continuare performanța modelului. Fără această etapă fundamentală, un model ar fi doar o structură goală, incapabilă să extragă informații utile din date.

fit() în Statsmodels: Modelare Statistică Riguroasă

Librăria Statsmodels în Python este o resursă neprețuită pentru oricine se ocupă de modelare statistică, regresie, analiză de serii temporale și teste statistice. Spre deosebire de alte librării care se concentrează mai mult pe predicție, Statsmodels pune accentul pe inferența statistică, oferind o înțelegere profundă a relațiilor dintre variabile și a semnificației acestora. Aici, metoda fit() este pilonul central.

Cum Funcționează fit() în Statsmodels?

Pentru a utiliza fit() în Statsmodels, primul pas este să definești tipul de model statistic pe care vrei să-l construiești. Statsmodels oferă o gamă largă de clase de modele, fiecare adaptată pentru un anumit tip de analiză. Cele mai comune includ OLS (Ordinary Least Squares) pentru regresia liniară simplă sau multiplă, GLM (Generalized Linear Models) pentru o gamă mai largă de distribuții ale erorilor și funcții de legătură, sau SARIMAX pentru modele complexe de serii temporale.

Odată ce ai instanțiat un obiect model, îi furnizezi variabilele dependente (ceea ce încerci să prezici sau să explici, de obicei notat cu Y) și variabilele independente (predictori, notate cu X). Apoi, pur și simplu apelezi metoda fit() pe acest obiect model. Această metodă va executa algoritmii necesari pentru a estima coeficienții modelului, minimizând eroarea dintre valorile prezise și cele observate.

Exemplu Practic: Regresie Liniară Simplă cu Statsmodels

Să explorăm un exemplu clasic de regresie liniară, unde încercăm să înțelegem relația dintre două variabile. Vom folosi date sintetice simple pentru a ilustra procesul:

import statsmodels.api as sm import numpy as np # Date eșantion X = np.array([1, 2, 3, 4, 5]) Y = np.array([2, 4, 5, 4, 5]) # Adăugăm o constantă la variabila independentă (necesară pentru termenul de intercept în regresie) X = sm.add_constant(X) # Creăm obiectul model OLS (Ordinary Least Squares) model = sm.OLS(Y, X) # Antrenăm modelul utilizând metoda fit() results = model.fit() # Afișăm sumarul rezultatelor print(results.summary()) În acest cod, am urmat pașii menționați: am importat librăriile necesare, am creat datele, am adăugat o constantă la X (fără aceasta, regresia ar forța linia să treacă prin origine, ceea ce rareori este realist), am definit modelul OLS și, în final, am apelat model.fit(). Rezultatul acestei metode este stocat în variabila results, un obiect complex care conține toate informațiile despre modelul antrenat.

Interpretarea Rezultatelor fit().summary()

Metoda summary() a obiectului results este extrem de utilă, oferind o prezentare detaliată și standardizată a performanței modelului. Iată o privire asupra unor elemente cheie din ieșire:

- Dep. Variable (Variabila Dependentă): Variabila pe care am încercat să o explicăm (

yîn cazul nostru). - R-squared (R-pătrat): O măsură a proporției de variație din variabila dependentă care poate fi explicată de variabilele independente. O valoare mai mare (între 0 și 1) indică o potrivire mai bună.

- Adj. R-squared (R-pătrat ajustat): Similar cu R-pătrat, dar ajustat pentru numărul de predictori din model. Este mai bun pentru compararea modelelor cu un număr diferit de variabile independente, deoarece penalizează adăugarea de predictori irelevanți.

- Method: Metoda de estimare folosită (Least Squares în cazul OLS).

- coef (Coeficienți): Acestea sunt parametrii estimați ai modelului. Pentru

const(intercept) șix1(variabila independentăX), aceștia îți spun cum se modificăYpentru o unitate de modificare înX. - std err (Eroare Standard): Măsoară precizia estimării coeficienților. O valoare mai mică indică o estimare mai precisă.

- t (Valoare t): Statistica t pentru testarea semnificației fiecărui coeficient.

- P>|t| (Valoarea p): Probabilitatea de a observa o statistică t la fel de extremă (sau mai extremă) ca cea calculată, sub ipoteza nulă că coeficientul este zero. O valoare p mică (de obicei sub 0.05) indică faptul că predictorul este semnificativ statistic.

În exemplul nostru, x1 are o valoare p de 0.039, ceea ce este sub 0.05, indicând că x1 este un predictor semnificativ statistic pentru Y. Coeficientul de 0.6000 sugerează că pentru fiecare creștere de o unitate în X, Y crește cu 0.6 unități, menținând constanta.

Statsmodels permite, de asemenea, teste statistice avansate pe obiectul results, cum ar fi wald_test(), f_test() și t_test(), care oferă o flexibilitate enormă pentru testarea ipotezelor.

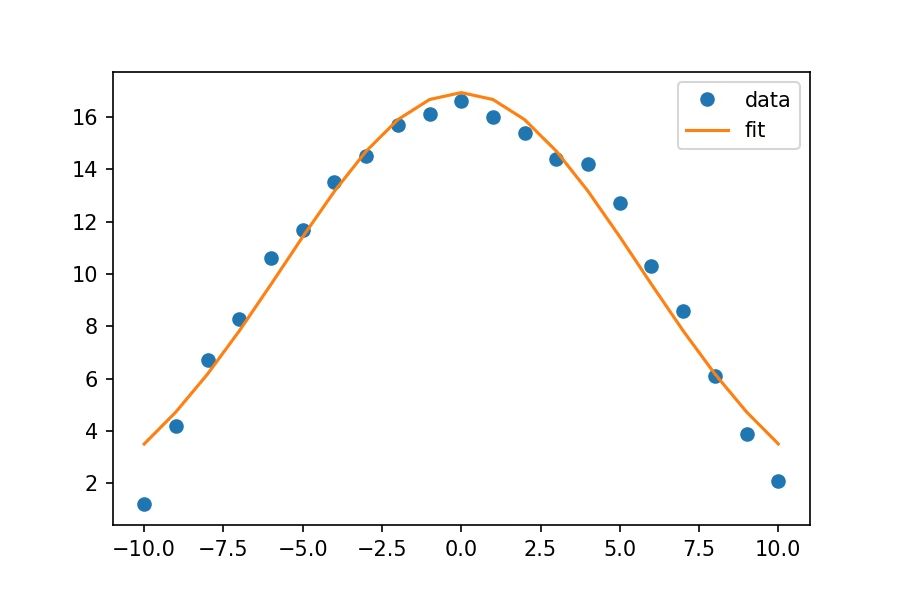

fit() pentru Ajustarea Curbei: Regresie Polinomială cu NumPy

Pe lângă modelarea statistică formală, metoda fit() (sau funcții cu o funcționalitate similară) este crucială pentru ajustarea curbelor la un set de date. Aceasta este o tehnică fundamentală în analiza datelor, utilizată pentru a înțelege tendințele, a interpola valori sau a face predicții pe baza unei relații non-liniare. NumPy, librăria fundamentală pentru calcul numeric în Python, oferă funcția numpy.polyfit() care îndeplinește un rol similar cu fit(), dar pentru regresia polinomială.

Ce este Regresia Polinomială și numpy.polyfit()?

Regresia polinomială este o formă de analiză de regresie în care relația dintre variabila independentă X și variabila dependentă Y este modelată ca un polinom de gradul n. Spre deosebire de regresia liniară care modelează o linie dreaptă, regresia polinomială poate modela curbe complexe, permițând o potrivire mai flexibilă a datelor. Funcția numpy.polyfit(x, y, deg) calculează coeficienții unui polinom de gradul deg care se potrivește cel mai bine punctelor (x, y).

Exemplu Practic: Ajustarea Curbei cu NumPy

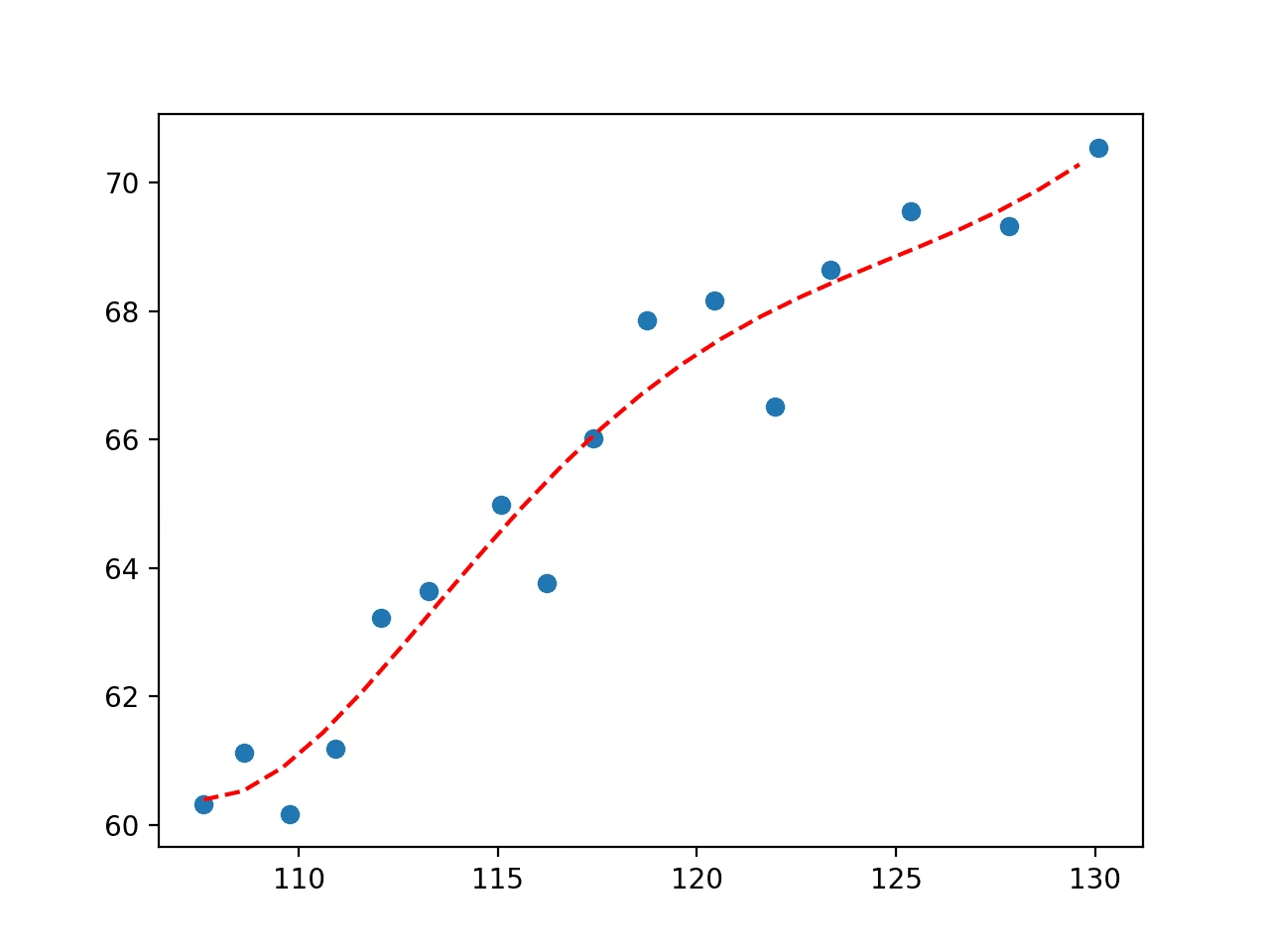

Să generăm un set de date care are o tendință non-liniară și să vedem cum putem ajusta diverse curbe pentru a găsi cea mai bună potrivire.

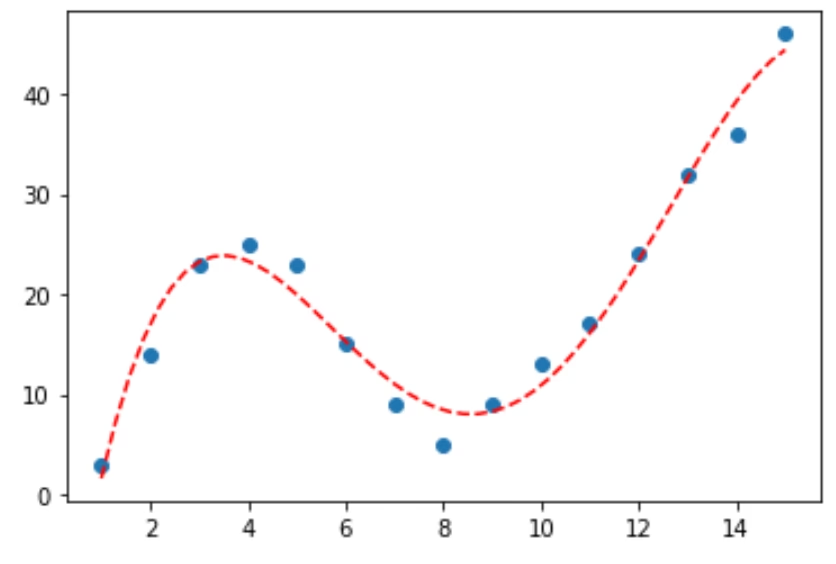

import pandas as pd import matplotlib.pyplot as plt import numpy as np # Creăm un DataFrame cu date eșantion df = pd.DataFrame({'x': [1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 12, 13, 14, 15], 'y': [3, 14, 23, 25, 23, 15, 9, 5, 9, 13, 17, 24, 32, 36, 46]}) # Vizualizăm datele inițiale plt.scatter(df.x, df.y) plt.title('Date Eșantion') plt.xlabel('X') plt.ylabel('Y') plt.show() # Ajustăm mai multe modele polinomiale (de la gradul 1 la 5) model1 = np.poly1d(np.polyfit(df.x, df.y, 1)) # Grad 1 (liniar) model2 = np.poly1d(np.polyfit(df.x, df.y, 2)) # Grad 2 (pătratic) model3 = np.poly1d(np.polyfit(df.x, df.y, 3)) # Grad 3 (cubic) model4 = np.poly1d(np.polyfit(df.x, df.y, 4)) # Grad 4 model5 = np.poly1d(np.polyfit(df.x, df.y, 5)) # Grad 5 # Generăm puncte pentru a desena curbele polyline = np.linspace(1, 15, 50) # Creăm scatterplot-ul și adăugăm liniile potrivite plt.scatter(df.x, df.y) plt.plot(polyline, model1(polyline), color='green', label='Grad 1') plt.plot(polyline, model2(polyline), color='red', label='Grad 2') plt.plot(polyline, model3(polyline), color='purple', label='Grad 3') plt.plot(polyline, model4(polyline), color='blue', label='Grad 4') plt.plot(polyline, model5(polyline), color='orange', label='Grad 5') plt.title('Ajustarea Curbei cu Polinoame de Diverse Grade') plt.xlabel('X') plt.ylabel('Y') plt.legend() plt.show() Funcția np.polyfit() returnează coeficienții polinomului. Pentru a transforma acești coeficienți într-o funcție polinomială ușor de utilizat pentru predicții sau desen, folosim np.poly1d(). Vizualizarea grafică ne ajută să înțelegem vizual cât de bine se potrivește fiecare curbă.

Evaluarea Celei Mai Bune Curbe: R-pătrat Ajustat

Pentru a determina matematic care curbă se potrivește cel mai bine, putem folosi R-pătratul ajustat. Acesta este preferabil R-pătratului simplu atunci când comparăm modele cu un număr diferit de predictori, deoarece penalizează complexitatea inutilă a modelului. O valoare mai mare a R-pătratului ajustat indică o potrivire mai bună, ținând cont de numărul de termeni din polinom.

# Funcție pentru calcularea R-pătratului ajustat def adjR(x, y, degree): coeffs = np.polyfit(x, y, degree) p = np.poly1d(coeffs) yhat = p(x) ybar = np.sum(y)/len(y) ssreg = np.sum((yhat-ybar)**2) sstot = np.sum((y - ybar)**2) # Formula R-pătrat ajustat: 1 - ((1 - R^2) * (n - 1) / (n - k - 1)) # unde n = număr observații, k = număr predictori (degree) results = {'r_squared_adj': 1 - (((1-(ssreg/sstot))*(len(y)-1))/(len(y)-degree-1))} return results # Calculăm R-pătratul ajustat pentru fiecare model print(f"R-pătrat ajustat pentru grad 1: {adjR(df.x, df.y, 1)}") print(f"R-pătrat ajustat pentru grad 2: {adjR(df.x, df.y, 2)}") print(f"R-pătrat ajustat pentru grad 3: {adjR(df.x, df.y, 3)}") print(f"R-pătrat ajustat pentru grad 4: {adjR(df.x, df.y, 4)}") print(f"R-pătrat ajustat pentru grad 5: {adjR(df.x, df.y, 5)}") Din rezultate, vei observa că modelul de gradul patru are cel mai mare R-pătrat ajustat (aproximativ 0.959), indicând că acesta este cel mai bun model pentru a se potrivi datelor noastre.

Vizualizarea Curbei Finale și Obținerea Ecuației

Odată ce ai identificat cel mai bun model, îl poți vizualiza separat și poți obține ecuația sa explicită:

# Ajustăm modelul polinomial de gradul 4 model4 = np.poly1d(np.polyfit(df.x, df.y, 4)) # Definim punctele pentru plotare polyline = np.linspace(1, 15, 50) # Creăm scatterplot-ul și adăugăm curba potrivită plt.scatter(df.x, df.y) plt.plot(polyline, model4(polyline), '--', color='red', label='Grad 4 (Cel mai bun fit)') plt.title('Curba de Regresie Polinomială de Grad 4') plt.xlabel('X') plt.ylabel('Y') plt.legend() plt.show() # Afișăm ecuația curbei print("Ecuația curbei de grad 4:") print(model4) Acest lucru îți va oferi ecuația polinomului (de exemplu: y = -0.01924x^4 + 0.7081x^3 - 8.365x^2 + 35.82x - 26.52). Acum poți folosi această ecuație pentru a face predicții pentru noi valori x.

Alegerea Metodei Corecte: Statsmodels vs. NumPy pentru fit()

Deși ambele librării oferă funcționalități de „potrivire” a modelelor, ele servesc scopuri ușor diferite. Alegerea depinde de obiectivul tău principal:

| Aspect | Statsmodels (.fit()) | NumPy (.polyfit()) |

|---|---|---|

| Scop Principal | Inferență statistică riguroasă, testarea ipotezelor, diagnosticarea modelului. | Ajustarea curbelor, interpolare, explorarea relațiilor polinomiale. |

| Tipuri de Modele | Regresie liniară (OLS), GLM, serii temporale (ARIMA, SARIMAX), modele discrete etc. | Regresie polinomială (ajustarea unui polinom). |

| Output | Obiect results detaliat cu statistici (p-values, erori standard, R-squared, AIC, BIC). | Coeficienții polinomului. Necesită calcul manual al metricilor de potrivire. |

| Complexitate | Mai complex, necesită o înțelegere mai profundă a statisticii. | Mai simplu, ideal pentru ajustări rapide de curbe. |

| Când se folosește? | Când vrei să înțelegi relațiile dintre variabile, să validezi ipoteze, să publici rezultate statistice. | Când vrei să găsești o curbă care să descrie datele, să faci predicții simple bazate pe o formă non-liniară. |

Pe scurt, dacă ai nevoie de o analiză statistică profundă, cu validarea semnificației fiecărui predictor și diagnostice complete ale modelului, Statsmodels este alegerea. Dacă scopul tău este pur și simplu să găsești o ecuație polinomială care să descrie cel mai bine o tendință într-un set de date și să faci predicții pe baza ei, NumPy este mai direct.

Aspecte Avansate și Considerații Critice

Deși metoda fit() este puternică, utilizarea sa eficientă necesită o înțelegere a unor concepte cheie din modelare:

Supratajarea (Overfitting) și Subtajarea (Underfitting)

Un risc major în orice proces de modelare este supratajarea (overfitting), adică situația în care modelul învață „zgomotul” din datele de antrenament, în loc să generalizeze tendințele reale. Un model supratajat va performa excelent pe datele de antrenament, dar slab pe date noi, nevăzute. În contextul numpy.polyfit(), folosirea unui grad polinomial prea mare poate duce la overfitting.

Pe de altă parte, subtajarea (underfitting) apare atunci când modelul este prea simplu pentru a capta relațiile complexe din date. Acest lucru se întâmplă, de exemplu, dacă încerci să ajustezi o linie dreaptă la date care au o tendință clar curbilinie. Modelul va performa slab atât pe datele de antrenament, cât și pe cele noi.

Pentru a evita aceste probleme, este esențial să împarți datele în seturi de antrenament și testare și să evaluezi performanța modelului pe setul de testare. Tehnici precum validarea încrucișată (cross-validation) sunt, de asemenea, extrem de valoroase.

Pre-procesarea Datelor

Calitatea datelor de intrare influențează direct performanța metodei fit(). Datele murdare, lipsa valorilor, valorile aberante (outliers) sau scalarea necorespunzătoare pot duce la estimări incorecte ale parametrilor și la un model slab. Asigură-te că datele tale sunt curățate, normalizate sau standardizate corespunzător înainte de a le introduce în model.

Evaluarea Modelului Dincolo de R-pătrat

Deși R-pătratul este o metrică utilă, nu este singura. În funcție de problema specifică, alte metrici precum Eroarea Medie Pătratică (MSE), Eroarea Absolută Medie (MAE), Eroarea Pătratică Medie Logaritmică (RMSE) sau scorul AIC/BIC (în Statsmodels) pot oferi o imagine mai completă a performanței modelului. Fiecare metrică are punctele sale forte și slabe și este important să alegi cele mai relevante pentru cazul tău de utilizare.

Întrebări Frecvente (FAQ) despre Metoda fit()

1. Ce înseamnă exact „a fita” un model?

„A fita” sau „a antrena” un model înseamnă a-i permite să învețe parametrii sau coeficienții optimi din datele de antrenament. Prin acest proces, modelul își ajustează structura internă pentru a minimiza diferența dintre predicțiile sale și valorile reale din date, astfel încât să poată generaliza și face predicții precise pe date noi.

2. Pot folosi fit() pentru orice tip de date?

Metoda fit(), în esența sa, este adaptată pentru date numerice. Înainte de a o utiliza, datele tale (variabilele independente și dependente) trebuie să fie convertite în formate numerice (array-uri NumPy sau DataFrame-uri Pandas). Variabilele categoriale, de exemplu, trebuie codificate (one-hot encoding, label encoding) înainte de a fi utilizate într-un model.

3. Cum știu dacă modelul meu este „bun” după ce am folosit fit()?

Evaluarea unui model implică mai multe aspecte:

- Metricile de potrivire: R-pătrat ajustat, MSE, MAE, RMSE.

- Semnificația statistică: (în Statsmodels) P-values pentru coeficienți, teste F.

- Reziduurile: Analiza graficelor reziduurilor pentru a verifica ipotezele modelului (normalitate, homoscedasticitate).

- Performanța pe date noi: Cel mai important este să testezi modelul pe un set de date separat (setul de testare) pentru a te asigura că generalizează bine și nu este supratajat.

4. Există alternative la fit() în alte librării Python?

Da, conceptul de „fit” este omniprezent în librăriile de învățare automată din Python. Scikit-learn, de exemplu, folosește, de asemenea, o metodă .fit() pentru a antrena majoritatea modelelor sale (regresie, clasificare, clustering). Deși implementările interne pot varia, scopul rămâne același: antrenarea modelului pe date.

5. Care este diferența dintre fit() și predict()?

fit() este faza de antrenament, în care modelul învață din date și își estimează parametrii. Odată ce modelul a fost „fitat”, poți folosi metoda predict() pentru a genera predicții noi pe baza datelor de intrare. fit() construiește modelul, în timp ce predict() îl folosește.

Concluzie

Metoda fit(), fie în Statsmodels, NumPy sau alte librării Python, este o componentă indispensabilă în arsenalul oricărui analist de date. Ea reprezintă momentul în care datele brute se transformă în informații structurate, iar modelele prind viață, devenind capabile să explice fenomene sau să facă predicții valoroase. Prin înțelegerea aprofundată a modului în care funcționează fit() și a contextului în care este aplicată în diverse librării, îți vei consolida abilitățile de modelare și vei putea extrage cu adevărat valoare din orice set de date. Fie că ajustezi o curbă simplă sau construiești un model statistic complex, fit() este cheia către succesul tău în lumea modelării datelor.

Dacă vrei să descoperi și alte articole similare cu Metoda fit() în Python: Puterea Modelării Datelor, poți vizita categoria Fitness.