23/12/2023

În lumea fitness-ului modern, datele sunt noul aur. De la ceasuri inteligente care monitorizează fiecare pas, la aplicații care urmăresc progresul antrenamentelor și al nutriției, suntem înconjurați de informații menite să ne ajute să ne atingem obiectivele. Adesea, aceste instrumente folosesc algoritmi complecși, sau „modele”, pentru a înțelege și prezice performanța. O întrebare comună, dar adesea derutantă, apare atunci când un model pare să performeze *mai bine* pe datele noi, nevăzute (setul de test), decât pe datele pe care a fost antrenat (setul de antrenament). Acest scenariu, aparent contraintuitiv, merită o analiză aprofundată, mai ales când vorbim de aplicații critice în domeniul sănătății și performanței fizice.

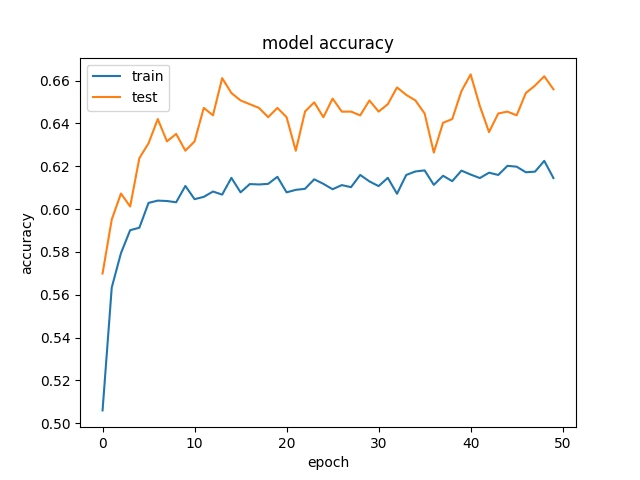

De obicei, ne așteptăm ca un model să atingă cea mai bună performanță pe datele de antrenament, deoarece le-a „văzut” deja și a învățat din ele. O acuratețe perfectă pe setul de antrenament, combinată cu o acuratețe semnificativ mai mică pe setul de test, este un semn clasic de supraînvățare (overfitting) – modelul a memorat datele de antrenament, în loc să învețe tipare generalizabile. Dar ce se întâmplă când situația este inversă? Când acuratețea pe setul de test este de 98,21%, în timp ce pe setul de antrenament este de 95,83%? Acest paradox, deși rar, poate indica mai multe aspecte cruciale despre modul în care datele sunt pregătite și modelul este evaluat.

- Paradoxul Acurateței: Când Testul Depășește Antrenamentul

- Verificarea Fundamentelor: Integritatea Datelor și a Validării Încrucișate

- Regimuri Speciale de Antrenament: Strategii Care Întăresc Modelul

- Subînvățarea Mascată: O Explicație Mai Puțin Evidentă

- Pași Practici pentru Diagnosticare și Optimizare

- Tabel Comparativ: Scenarii de Acuratețe și Semnificația Lor

- Importanța Contextului: Când o Acuratețe Mare Este Cu Adevărat Bună?

- Întrebări Frecvente (FAQ)

Paradoxul Acurateței: Când Testul Depășește Antrenamentul

Fenomenul în care acuratețea pe setul de test depășește pe cea de pe setul de antrenament poate fi deconcertant, dar nu este neapărat un semn de eroare majoră a modelului în sine, ci mai degrabă o indicație a modului în care datele sunt gestionate și interpretate. Iată câteva explicații posibile, de la cele mai comune la cele mai specifice:

Verificarea Fundamentelor: Integritatea Datelor și a Validării Încrucișate

Primul și cel mai important pas este să verificăm dacă procesul de divizare a datelor și de validare încrucișată (cross-validation) a fost executat corect. Validarea încrucișată, cum ar fi cea în 5-fold, implică împărțirea datelor în mai multe subseturi (folduri), antrenarea modelului pe o parte și testarea pe restul, repetând procesul pentru fiecare fold. Acest lucru oferă o estimare mai robustă a performanței modelului pe date nevăzute.

- Dependența Statistică a Seturilor: Una dintre cele mai frecvente erori este o divizare incorectă a datelor, care duce la o lipsă de independență statistică între seturile de antrenament și test. De exemplu, dacă aveți măsurători repetate de la aceiași subiecți (să spunem, date zilnice despre ritmul cardiac de la 150 de persoane), aceste măsurători ar trebui să rămână împreună, fie în setul de antrenament, fie în setul de test. Dacă unele măsurători ale aceleiași persoane ajung în setul de antrenament și altele în setul de test, modelul ar putea „învăța” caracteristici specifice ale acelei persoane din setul de antrenament și apoi să le aplice cu succes în setul de test, creând o iluzie de performanță superioară. Este ca și cum ai antrena un atlet pentru o competiție pe un traseu specific, iar apoi la competiție, o parte din traseu îți este deja familiară din antrenament. Performanța ta ar părea mai bună, dar nu neapărat pentru că ești un atlet mai bun în general.

- Date Duplicitate sau Similare: Dacă setul de date conține intrări duplicate sau extrem de similare, iar acestea sunt distribuite întâmplător între seturile de antrenament și test, modelul ar putea pur și simplu să „memoreze” răspunsurile pentru exemplele duplicate din setul de test, ceea ce va umfla artificial acuratețea testului. Asigurați-vă că fiecare punct de date din setul de test este cu adevărat o dată independentă, pe care modelul nu a „văzut-o” sub nicio formă în timpul antrenamentului.

- Calculul Acurateței: Verificați manual cum sunt calculate acuratețele. O eroare de rotunjire sau o interpretare greșită a numărului de cazuri greșite poate distorsiona rezultatele. De exemplu, 98,21% acuratețe pe 150 de mostre înseamnă aproximativ 2,68 cazuri greșite, ceea ce este imposibil pentru un număr întreg. Astfel de discrepanțe pot semnala erori în raportarea metricilor.

Regimuri Speciale de Antrenament: Strategii Care Întăresc Modelul

Există scenarii specifice în care un model este antrenat într-un mod care face datele de antrenament „mai dificile” pentru a le învăța, rezultând în mod intenționat o acuratețe mai mică pe antrenament decât pe test. Aceste strategii sunt folosite pentru a face modelul mai robust și mai generalizabil în condiții reale.

- Antrenamentul Adversativ: Aceasta este o tehnică în care modelul este antrenat nu doar pe date normale, ci și pe „exemple adversative” – date care au fost ușor modificate pentru a induce erori în model. Scopul este de a face modelul mai rezistent la atacuri sau la date zgomotoase. Prin urmare, modelul învață să proceseze date care sunt intenționat dificile. Când este evaluat pe date „curate” și „benigne” (fără modificări adversative) din setul de test, performanța sa poate părea superioară, deoarece nu mai trebuie să lupte cu exemplele „întortocheate”. Gândiți-vă la un antrenament de forță unde adăugați greutăți suplimentare: exercițiul este mai greu, dar când le scoateți, performanța voastră fără greutăți este mult mai bună.

- Adăugarea de Zgomot Gaussian (sau alt zgomot) la Datele de Antrenament: Similar cu antrenamentul adversativ, adăugarea de zgomot aleatoriu la datele de antrenament forțează modelul să învețe tipare mai robuste și să ignore fluctuațiile minore. Acest lucru poate reduce acuratețea pe setul de antrenament (deoarece modelul trebuie să învețe să generalizeze peste zgomot), dar poate îmbunătăți semnificativ capacitatea sa de a generaliza pe date de test „curate” și realiste.

Subînvățarea Mascată: O Explicație Mai Puțin Evidentă

Dacă decalajul dintre acuratețea antrenamentului și cea a testului este foarte mare (cum ar fi 30% menționat în contextul discuției), în special în cazul regimurilor de antrenament adversativ sau cu zgomot, acest lucru ar putea indica o formă de subînvățare (underfitting). Chiar dacă modelul este antrenat pe date mai dificile, dacă arhitectura sa nu este suficient de complexă (sau „expresivă”) pentru a învăța tiparele subiacente din aceste date dificile, el va subperforma pe setul de antrenament. Însă, pe setul de test (care este compus din exemple „benigne” și mai simple), performanța sa ar putea fi mai bună, deoarece acele tipare sunt mai ușor de recunoscut, iar modelul nu a fost suficient de complex pentru a învăța „complexitatea” zgomotului din antrenament. În cazul Pădurilor Aleatoare (Random Forests), aceasta ar putea însemna că arborii nu sunt suficient de adânci pentru a captura complexitatea datelor antrenamentului zgomotos.

Pași Practici pentru Diagnosticare și Optimizare

Pentru a înțelege și corecta situația, iată o serie de pași pe care îi puteți urma:

- Verificați Împărțirea Datelor: Asigurați-vă că datele sunt divizate aleatoriu și independent. Dacă aveți măsurători repetate sau date de la aceiași subiecți, asigurați-vă că toate datele unui subiect rămân în același set (antrenament sau test).

- Căutați Duplicări: Scanați setul de date pentru rânduri duplicate sau extrem de similare. Eliminați-le sau asigurați-vă că nu ajung atât în antrenament, cât și în test.

- Efectuați Validare Încrucișată Externă: Împărțiți datele manual într-un set de antrenament și un set de test complet separat, pe care programul nu le-a văzut niciodată. Antrenați modelul doar pe setul de antrenament și evaluați-l pe setul de test. Comparați aceste rezultate cu cele raportate.

- Testați cu Intrări Aleatorii/Sintetice: Dacă este posibil, generați date complet aleatorii sau sintetice și vedeți cum se comportă modelul. Acest lucru vă poate ajuta să înțelegeți dacă modelul „învață” ceva semnificativ sau doar reacționează la zgomot.

- Analizați Regimul de Antrenament: Înțelegeți dacă în timpul antrenamentului modelului s-au aplicat tehnici precum antrenamentul adversativ, adăugarea de zgomot sau alte forme de augmentare a datelor care ar putea face setul de antrenament mai dificil.

- Evaluați Complexitatea Modelului: Dacă este vorba de subînvățare, încercați să creșteți complexitatea modelului (ex: mai multe straturi într-o rețea neuronală, adâncime mai mare pentru arborii dintr-o pădure aleatoare) pentru a-i permite să învețe tiparele mai complexe din datele de antrenament.

- Calculați Semnificația Statistică: Cu un set de date de 150 de mostre, diferențele mici de acuratețe pot fi atribuite pur și simplu variabilității aleatorii. Calculați dacă diferența observată este semnificativă statistic. Dacă nu este, optimizările ulterioare pot fi inutile.

Tabel Comparativ: Scenarii de Acuratețe și Semnificația Lor

| Acuratețe Antrenament | Acuratețe Test | Interpretare Comună | Explicație Pentru „Mai Bine pe Test” |

|---|---|---|---|

| Foarte mare (ex: 99-100%) | Semnificativ mai mică (ex: 70%) | Supraînvățare (Overfitting) | Modelul a memorat datele de antrenament, nu generalizează bine. |

| Scăzută (ex: 60%) | Scăzută (ex: 58%) | Subînvățare (Underfitting) | Modelul este prea simplu sau nu a fost antrenat suficient, nu a învățat tiparele de bază. |

| Moderat-mare (ex: 95%) | Moderat-mare (ex: 94%) | Echilibru Bun | Modelul generalizează bine, performanță consistentă. |

| Mai mică (ex: 95.83%) | Mai mare (ex: 98.21%) | Paradoxul observat | Erori în validare, date dependente, antrenament adversativ, zgomot în antrenament, subînvățare mascată. |

Importanța Contextului: Când o Acuratețe Mare Este Cu Adevărat Bună?

O acuratețe de 97% pe setul de test, dacă validarea încrucișată este făcută corect, este în general un rezultat excelent. Aceasta înseamnă că modelul este capabil să clasifice corect aproape 97% din noile date pe care le întâlnește. În contextul fitness-ului, aceasta ar putea însemna o predicție foarte precisă a riscului de accidentare, a performanței într-un anumit exercițiu, sau a răspunsului corpului la un anumit regim alimentar.

Cu toate acestea, „bun” este un termen relativ și depinde de aplicație. De exemplu, într-un scenariu de detectare a unor afecțiuni medicale rare, o acuratețe de 97% ar putea masca o problemă gravă dacă modelul ratează complet cazurile pozitive rare (ceea ce ar necesita analiza unor metrici precum precizia și recall-ul, nu doar acuratețea). Pentru majoritatea aplicațiilor de fitness, unde datele sunt adesea mai echilibrate, 97% este un indicator puternic de succes.

Faptul că există un mic decalaj între acuratețea de test și cea de antrenament (testul fiind puțin mai mare) poate sugera că modelul nu a supraînvățat, ci a învățat tipare suficient de robuste încât să se adapteze bine la date noi, mai „curate” sau mai reprezentative pentru realitate. Însă, dacă acest decalaj este mare, investigația este esențială.

Întrebări Frecvente (FAQ)

Ce este supraînvățarea (overfitting)?

Supraînvățarea apare atunci când un model de învățare automată învață „prea bine” datele de antrenament, inclusiv zgomotul și particularitățile irelevante. Ca urmare, modelul performează excelent pe datele de antrenament, dar foarte slab pe date noi, nevăzute (setul de test), deoarece nu a reușit să generalizeze tiparele reale.

Ce înseamnă subînvățarea (underfitting)?

Subînvățarea se întâmplă atunci când un model este prea simplu sau nu a fost antrenat suficient pentru a captura tiparele relevante din date. Performanța sa este slabă atât pe setul de antrenament, cât și pe cel de test, indicând faptul că modelul nu a învățat suficient de mult pentru a fi util.

Cât de importantă este validarea încrucișată?

Validarea încrucișată este crucială pentru a obține o estimare robustă și fiabilă a performanței unui model pe date nevăzute. Ajută la reducerea varianței în estimarea performanței și la identificarea supraînvățării, oferind o imagine mai realistă a modului în care modelul se va comporta în mediul real.

Este 97% acuratețe întotdeauna un rezultat bun?

În majoritatea cazurilor, 97% acuratețe este un rezultat excelent. Totuși, importanța sa depinde de contextul specific al problemei. Dacă setul de date este puternic dezechilibrat (ex: 99% din cazuri aparțin unei singure clase), un model care prezice întotdeauna clasa majoritară ar putea atinge 99% acuratețe fără a fi de fapt util. În astfel de cazuri, alte metrici precum precizia, recall-ul sau scorul F1 sunt mai relevante.

Cum pot verifica dacă datele mele sunt împărțite corect?

Cel mai simplu mod este să vă asigurați că împărțirea se face aleatoriu și că nu există suprapuneri (duplicări) între seturile de antrenament și test. Dacă aveți grupuri de date (ex: măsurători multiple de la aceeași persoană), asigurați-vă că un întreg grup este alocat unui singur set (antrenament sau test) pentru a preveni „scurgerile” de informații.

În concluzie, deși o acuratețe mai mare pe setul de test decât pe cel de antrenament poate părea un paradox, ea oferă o oportunitate valoroasă de a înțelege mai bine modelul și datele. Fie că este vorba de o eroare în procesul de validare, de o strategie de antrenament deliberată sau de o combinație a ambelor, o investigație atentă va duce la o înțelegere mai profundă și, în cele din urmă, la modele mai robuste și mai fiabile. Pentru pasionații de fitness, înțelegerea acestor nuanțe asigură că datele și algoritmii pe care se bazează deciziile lor sunt cu adevărat optimizați pentru succesul pe termen lung.

Dacă vrei să descoperi și alte articole similare cu Acuratețe Inexplicabilă: Test Mai Bun Decât Antrenament?, poți vizita categoria Fitness.