15/09/2024

În era digitală, suntem asaltați de cantități colosale de date. De la imagini și videoclipuri la texte complexe, gestionarea și înțelegerea acestui potop informațional reprezintă o provocare majoră. Așa cum într-un program de fitness căutăm metode eficiente de a ne optimiza corpul și performanța, în lumea datelor avem nevoie de instrumente care să ne ajute să extragem esența, să reducem complexitatea și să îmbunătățim calitatea informației. Aici intervin autoencoderele, o clasă fascinantă de rețele neuronale artificiale care promit să revoluționeze modul în care interacționăm cu datele.

Ce sunt Autoencoderele și Cum Funcționează?

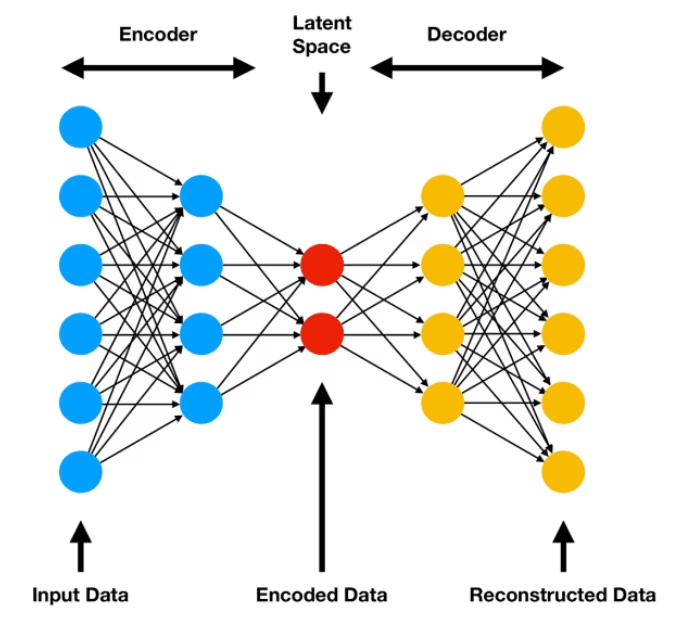

Imaginați-vă un sistem inteligent capabil să ia o imagine complexă, să-i extragă informația esențială într-o formă mult mai compactă, iar apoi, pe baza acestei forme compacte, să o reconstruiască cât mai fidel posibil. Aceasta este esența unui autoencoder. La bază, un autoencoder este o Rețea Neurală Artificială antrenată într-un mod nesupravegheat, având un scop aparent simplu: să copieze intrarea la ieșire. Însă, magia nu stă în copierea directă, ci în constrângerea de a învăța o reprezentare intermediară, comprimată, a datelor.

Procesul se desfășoară în două etape distincte, dar interconectate:

- Codificarea (Encoder): Această parte a rețelei preia datele de intrare (de exemplu, o imagine) și le transformă într-o reprezentare cu dimensiune mai mică, adesea numită 'cod', 'spațiu latent' sau 'vector de caracteristici'. Este ca și cum am distila o esență, păstrând doar informațiile critice.

- Decodificarea (Decoder): A doua parte a rețelei primește acest cod compact și încearcă să reconstruiască datele originale cât mai aproape de intrare. Cu cât reconstrucția este mai fidelă, cu atât autoencoderul a învățat o reprezentare mai bună a datelor.

Un aspect crucial al autoencoderelor este că operațiile de compresie și decompresie sunt considerate cu pierderi (lossy). Aceasta înseamnă că imaginea sau datele reconstruite nu vor fi perfect identice cu originalul, mai ales dacă nivelul de compresie este ridicat. Diferența este mai mare în cazul reconstrucțiilor cu pierderi mai mari. Gândiți-vă la compresia unui fișier JPEG: calitatea scade pe măsură ce dimensiunea fișierului se micșorează. Pe de altă parte, autoencoderele sunt și specifice datelor. Aceasta înseamnă că un autoencoder antrenat pe un anumit tip de date (de exemplu, imagini cu câini) va performa slab dacă i se vor prezenta date dintr-o categorie diferită (cum ar fi imagini cu pisici). Ele învață să comprime și să decomprime eficient doar datele pe care au fost antrenate.

Mecanismul de Bază: Codificare și Decodificare

Să aprofundăm puțin mecanismul. Autoencoderul este, în esență, o rețea neurală feed-forward, unde intrarea este concepută să fie similară cu ieșirea. Pentru a realiza acest lucru, avem nevoie de o metodă de codificare, o funcție de pierdere și o metodă de decodificare. Scopul final este de a replica perfect intrarea cu pierderi minime.

Intrarea este trecută printr-un strat de codificatoare, care sunt de fapt o rețea neurală complet conectată. Această rețea creează un 'cod' sau o reprezentare latentă. Apoi, acest cod este preluat de decodificator, care este o altă rețea neurală complet conectată, ce încearcă să inverseze procesul de codificare și să recreeze intrarea inițială. De obicei, funcția de pierdere (de exemplu, entropia încrucișată binară pentru imagini binare sau eroare pătratică medie pentru date continue) măsoară diferența dintre intrarea originală și ieșirea reconstruită. Prin antrenament repetat (epoci), folosind un optimizator (cum ar fi ADAM) și retropropagare, rețeaua își ajustează ponderile pentru a minimiza această pierdere, învățând astfel o reprezentare din ce în ce mai eficientă a datelor.

Tipuri de Autoencodere: O Analiză Detaliată

Deși conceptul de bază rămâne același, autoencoderele au evoluat în diverse arhitecturi, fiecare optimizată pentru anumite tipuri de date sau sarcini. Vom explora trei dintre cele mai comune și influente tipuri.

1. Autoencoderul Simplu: Fundamentele Compresiei

Acesta este cel mai direct tip de autoencoder, adesea compus din straturi dense (fully connected) de neuroni. Este ideal pentru a înțelege principiile de bază și pentru a lucra cu date tabulare sau imagini aplatizate (transformate într-un vector unidimensional). Arhitectura sa este relativ simplă: un strat de intrare, unul sau mai multe straturi dense pentru codificare, un strat latent cu dimensionalitate redusă, și apoi unul sau mai multe straturi dense pentru decodificare, culminând cu un strat de ieșire de aceeași dimensiune ca intrarea.

Pentru imagini, cum ar fi setul de date MNIST (cifre scrise de mână), fiecare imagine de 28x28 pixeli este transformată într-un vector de 784 de valori. Autoencoderul simplu va comprima acești 784 de pixeli într-o dimensiune mult mai mică (de exemplu, 15 dimensiuni), apoi va încerca să reconstruiască cei 784 de pixeli originali din această reprezentare compactă. Este o demonstrație clară a reducerii dimensionalității și a reconstrucției, arătând cum se pot extrage caracteristici esențiale chiar și cu o arhitectură minimă.

2. Autoencoderul Deep CNN: Maestrul Imaginilor

Când vine vorba de date spațiale, cum ar fi imaginile, rețelele neuronale convoluționale (CNN) sunt alegerea superioară. Prin urmare, are sens să folosim un Autoencoder Deep CNN pentru sarcini legate de imagini. Encoderul acestui tip de autoencoder este construit dintr-o stivă de straturi Conv2D (convoluționale) și straturi MaxPooling2D (de reducere a rezoluției). Aceste straturi sunt excelente pentru a detecta caracteristici locale (margini, texturi) și pentru a reduce progresiv dimensiunea spațială a imaginii, crescând în același timp numărul de filtre (caracteristici detectate).

Decodificatorul este o oglindă a encoderului, folosind straturi Conv2D și straturi UpSampling2D pentru a mări progresiv rezoluția imaginii și a reconstrui imaginea originală din reprezentarea latentă. Această arhitectură este mult mai eficientă pentru imagini decât un autoencoder simplu, deoarece respectă structura spațială a datelor și poate învăța reprezentări mult mai bogate și mai semnificative. Rezultatele reconstrucției sunt adesea de o calitate vizibil superioară, cu detalii mai bine păstrate, chiar și după o compresie semnificativă.

3. Autoencoderul Denoising: Curățarea Datelor cu Precizie

Imaginați-vă că aveți un set de fotografii vechi, pline de zgomot sau imperfecțiuni, și doriți să le restaurați. Aici intervine Autoencoderul Denoising. Spre deosebire de celelalte tipuri, autoencoderul denoising este antrenat să reconstruiască o intrare 'curată' dintr-o versiune 'zgomotoasă' a aceleiași intrări. În timpul antrenamentului, se adaugă în mod artificial zgomot (pixel alb, blur, distorsiuni de culoare) datelor de intrare, iar rețeaua este instruită să producă ieșirea originală, fără zgomot.

Acest proces forțează autoencoderul să învețe caracteristici robuste și să identifice esența datelor, ignorând zgomotul aleatoriu. Straturile sunt adesea similare cu cele ale unui autoencoder CNN profund, dar accentul este pus pe capacitatea de a filtra și de a reconstrui informația de bază. Este extrem de util în aplicații precum restaurarea imaginilor, reducerea zgomotului din semnale audio sau video și chiar detectarea anomaliilor, unde 'zgomotul' poate fi interpretat ca o deviație de la norma învățată.

Tabel Comparativ: Alege Autoencoderul Potrivit

Pentru a înțelege mai bine diferențele și aplicațiile specifice, iată o comparație a celor trei tipuri de autoencodere:

| Tip de Autoencoder | Arhitectură Principală | Cazuri de Utilizare Tipice | Avantaje Cheie |

|---|---|---|---|

| Autoencoder Simplu | Rețele neuronale dense (fully connected) | Reducerea dimensionalității, compresia datelor generale, învățarea reprezentărilor pentru date non-imagini | Simplitate, rapiditate pentru date vectoriale, bază solidă pentru înțelegere |

| Autoencoder Deep CNN | Straturi convoluționale (Conv2D), straturi de pooling și upsampling | Compresia și generarea de imagini, învățarea caracteristicilor vizuale, super-rezoluție | Excelent pentru imagini și date spațiale, captează ierarhic caracteristici locale, performanță superioară în viziunea computerizată |

| Autoencoder Denoising | Similar cu CNN sau simplu, dar antrenat cu date zgomotoase | Curățarea imaginilor, eliminarea zgomotului din semnale, detectarea anomaliilor, restaurarea datelor | Robust la imperfecțiuni, îmbunătățește calitatea datelor, ajută la învățarea reprezentărilor mai rezistente |

Aplicații Practice ale Autoencoderelor

Versatilitatea autoencoderelor le face instrumente valoroase într-o multitudine de domenii, depășind simpla compresie:

- Reducerea Dimensionalității: Aceasta este una dintre cele mai directe aplicații. Prin transformarea datelor de înaltă dimensiune într-o reprezentare compactă (codul latent), autoencoderele pot simplifica procesarea ulterioară, pot reduce cerințele de stocare și pot facilita vizualizarea datelor complexe. Gândiți-vă la un set de date cu sute de caracteristici – autoencoderul poate reduce acestea la doar câteva zeci, păstrând informația esențială.

- Compresia Datelor: Similară cu reducerea dimensionalității, dar cu accent pe stocare și transmisie. Imaginile sau alte tipuri de date pot fi comprimate eficient și apoi decomprimate la nevoie, cu o pierdere minimă de calitate percepută.

- Sisteme de Recomandare: Autoencoderele pot învăța reprezentări ale preferințelor utilizatorilor sau ale articolelor, permițând apoi generarea de recomandări personalizate, fie pentru filme, cântece, produse sau articole de fitness.

- Detectarea Anomaliilor: Deoarece autoencoderele sunt antrenate să reconstruiască datele 'normale' cu pierderi minime, o eroare de reconstrucție mare indică faptul că intrarea este 'anormală'. Această proprietate le face extrem de utile pentru detectarea fraudelor, a defecțiunilor în echipamente sau a comportamentelor neobișnuite în rețele.

- Generarea de Date: Prin manipularea spațiului latent, se pot genera noi instanțe de date care seamănă cu datele de antrenament. De exemplu, se pot genera noi imagini cu fețe umane sau cu cifre scrise de mână.

- Îmbunătățirea Calității Datelor: Autoencoderele denoising sunt perfecte pentru a curăța imaginile sau alte date de zgomot, pentru a completa date lipsă (imputare) sau pentru a îmbunătăți rezoluția (super-rezoluție).

Întrebări Frecvente (FAQ)

- Ce este un autoencoder?

- Un autoencoder este o rețea neurală artificială antrenată să copieze intrarea la ieșire. Însă, pentru a face acest lucru, ea trebuie să învețe o reprezentare internă, comprimată, a datelor, numită 'cod' sau 'spațiu latent'.

- De ce sunt autoencoderele considerate 'cu pierderi'?

- Sunt 'cu pierderi' deoarece procesul de compresie și decompresie implică o anumită pierdere de informație. Reconstrucția nu este perfectă, dar este suficient de bună pentru a capta esența datelor originale, mai ales atunci când se realizează o reducere semnificativă a dimensionalității.

- La ce folosesc autoencoderele în practică?

- Autoencoderele sunt folosite pentru reducerea dimensionalității, compresia datelor, eliminarea zgomotului din imagini sau semnale, detectarea anomaliilor, generarea de date noi și chiar pentru construirea de sisteme de recomandare.

- Pot fi autoencoderele folosite pentru clasificarea imaginilor?

- Nu direct pentru clasificarea imaginilor. Ele sunt antrenate pentru reconstrucție. Însă, stratul de codificare (encoderul) poate fi folosit pentru a extrage caracteristici puternice din imagini, care apoi pot fi introduse într-un alt model (cum ar fi un clasificator) pentru sarcini de clasificare.

- Care este diferența dintre un autoencoder simplu și un autoencoder CNN?

- Un autoencoder simplu folosește straturi dense (fully connected) și este mai potrivit pentru date vectoriale generale. Un autoencoder CNN utilizează straturi convoluționale și este special conceput pentru date spațiale, cum ar fi imaginile, deoarece poate capta mai eficient caracteristicile și structura locală a acestora.

Concluzie

Autoencoderele reprezintă o piatră de temelie în domeniul învățării automate nesupravegheate, oferind soluții elegante pentru probleme complexe de compresie, curățare și înțelegere a datelor. De la simpla reducere a dimensionalității la sarcini sofisticate de denoising și generare de conținut, aceste rețele neuronale demonstrează puterea și flexibilitatea inteligenței artificiale. Pe măsură ce volumul de date continuă să crească exponențial, rolul autoencoderelor în optimizarea și gestionarea informației va deveni tot mai crucial. Ele ne permit să vedem dincolo de zgomot, să extragem esența și să transformăm datele brute în informații valoroase, la fel cum un antrenament bine structurat transformă efortul în rezultate vizibile.

Dacă vrei să descoperi și alte articole similare cu Autoencodere: Optimizarea Datelor la Nivel de Expert, poți vizita categoria Fitness.