13/02/2022

Autoencoder-ele reprezintă o clasă fascinantă de rețele neuronale, adesea trecute cu vederea în comparație cu cele folosite pentru clasificări sau regresii. Acestea fac parte din categoria algoritmi de învățare nesupravegheată, ceea ce înseamnă că nu necesită etichete explicite pentru a învăța. Scopul lor principal este de a învăța o reprezentare compactă a datelor de intrare și, ulterior, de a reconstrui acele date cât mai fidel posibil. Imaginați-vă că aveți un fișier foarte mare și doriți să-l comprimați fără a pierde informații esențiale; autoencoder-ul face exact acest lucru, dar pentru date complexe precum imagini, texte sau serii temporale. Prin procesul de comprimare și decompresie, autoencoder-ul descoperă caracteristici intrinseci și structuri ascunse în date, transformându-le într-o formă mai eficientă și, adesea, mai utilă pentru sarcini ulterioare. De la eliminarea zgomotului din imagini până la identificarea comportamentelor neobișnuite în seturi mari de date, aplicațiile autoencoderelor sunt diverse și de impact.

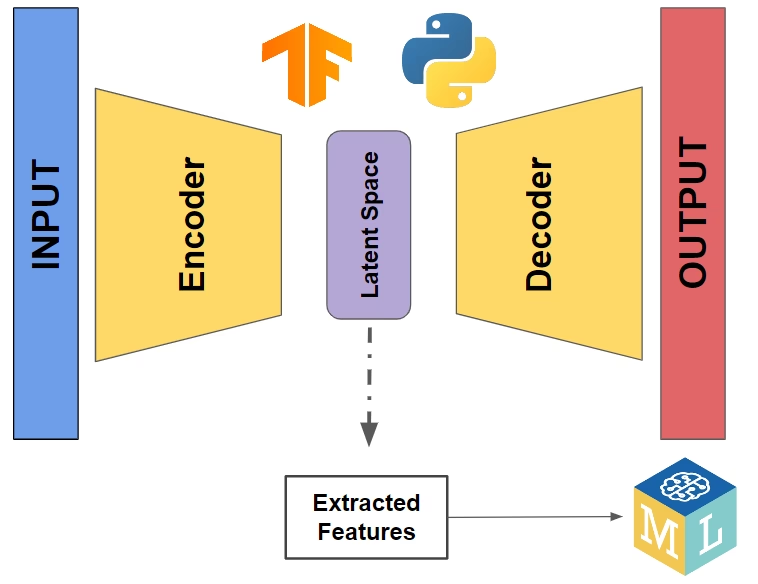

Anatomia unui Autoencoder: Codificator și Decodificator

Structura fundamentală a unui autoencoder este împărțită în două componente principale: codificatorul (encoder) și decodificatorul (decoder). Aceste două părți lucrează în tandem pentru a realiza scopul autoencoderului – de a copia intrarea la ieșire, dar într-un mod inteligent.

Codificatorul (Encoder): Inima Compresiei

Codificatorul este prima parte a autoencoderului și are rolul de a prelua datele de intrare (să le numim x, care au d dimensiuni) și de a le transforma într-o reprezentare de dimensiune mai mică. Această reprezentare, numită și spațiul latent sau cod, este notată cu a și are k dimensiuni, unde k este semnificativ mai mic decât d (k < d). Procesul de codificare poate fi realizat printr-o serie de straturi neuronale (dense, convoluționale etc.), care aplică transformări non-liniare datelor. De exemplu, într-un autoencoder simplu, codificatorul ar putea fi o rețea neuronală cu un singur strat dens, care reduce dimensiunea imaginii de 28x28 pixeli (784 dimensiuni) la un vector de 64 de dimensiuni. Alegerea arhitecturii codificatorului depinde foarte mult de tipul datelor de intrare și de complexitatea relațiilor pe care dorim să le capturăm. Un aspect crucial al codificatorului este crearea unui "gât de sticlă" (bottleneck) în arhitectură. Acest bottleneck forțează rețeaua să învețe cele mai relevante caracteristici ale datelor pentru a le putea reconstrui ulterior. Fără acest constrângere, autoencoderul ar putea pur și simplu să învețe o funcție de identitate, fără a extrage informații utile.

Decodificatorul (Decoder): Arta Reconstrucției

Odată ce datele au fost comprimate în spațiul latent, decodificatorul preia această reprezentare compactă (a) și încearcă să o reconstruiască înapoi la forma originală (x_tilde), care ar trebui să fie cât mai aproape de intrarea inițială (x). Similar codificatorului, decodificatorul este compus din straturi neuronale care realizează transformări inverse. De exemplu, dacă codificatorul a aplatizat o imagine și a redus-o la 64 de dimensiuni, decodificatorul va prelua acest vector de 64 de dimensiuni și îl va transforma înapoi într-o imagine de 28x28 pixeli. Funcțiile de activare utilizate în decodificator (e.g., sigmoid pentru imagini normalizate între 0 și 1) sunt alese pentru a asigura că ieșirea este în același domeniu și format cu intrarea originală. Interacțiunea dintre codificator și decodificator este esențială: codificatorul învață cum să comprime eficient, iar decodificatorul învață cum să extindă acea compresie înapoi la original, ambele părți optimizându-se pentru a minimiza eroarea de reconstrucție.

Cum se Antrenează un Autoencoder?

Antrenarea unui autoencoder este un proces de învățare nesupravegheată, dar care utilizează principiile învățării supervizate. Mecanismul este simplu în concept: autoencoderul este antrenat să copieze intrarea la ieșire. Aceasta înseamnă că datele de intrare sunt folosite simultan și ca "caracteristici" și ca "ținte" pentru rețea.

Funcția de Pierdere și Optimizarea

Piatra de temelie a antrenamentului este definirea unei funcții de pierdere (loss function) care măsoară discrepanța dintre intrarea originală (x) și reconstrucția sa (x_tilde). Scopul antrenamentului este de a minimiza această eroare de reconstrucție.

Pentru date cu valori continue, o funcție de pierdere comună este eroarea pătratică medie (Mean Squared Error - MSE):L(x_tilde, x) = Suma_j(x_j - x_tilde_j)^2

Această funcție penalizează diferențele mari dintre valorile pixelilor (sau punctelor de date) din imaginea originală și cele din imaginea reconstruită. Pentru alte tipuri de date, cum ar fi cele binare, se pot folosi alte funcții de pierdere, cum ar fi entropia încrucișată binară.

Procesul de Antrenament:

- Datele: Se încarcă un set de date (de exemplu, imagini Fashion MNIST). Datele sunt normalizate, de obicei la un interval între 0 și 1, pentru a facilita antrenamentul rețelelor neuronale.

- Modelul: Se definește arhitectura autoencoderului, specificând straturile codificatorului și decodificatorului, precum și dimensiunea spațiului latent.

- Compilarea: Modelul este compilat cu un optimizator (de exemplu,

Adam) și funcția de pierdere aleasă (de exemplu,MeanSquaredError). - Antrenamentul propriu-zis: Modelul este antrenat folosind datele de antrenament ca intrare și ca țintă. Acest lucru se repetă pe parcursul mai multor epoci (epochs), cu o dimensiune a lotului (batch size) specificată. În fiecare epocă, rețeaua procesează datele, calculează eroarea de reconstrucție și ajustează ponderile și bias-urile interne (parametrii

WșiW_0) ale codificatorului și decodificatorului folosind descendentul de gradient stochastic (Stochastic Gradient Descent) sau variantele sale (precum Adam). - Validarea: Performanța modelului este monitorizată pe un set de date de validare (care poate fi similar cu setul de antrenament sau, în cazul detecției anomaliilor, poate include și date anormale). Scopul este de a vedea dacă modelul generalizează bine și dacă eroarea de reconstrucție scade constant.

Antrenamentul continuă până când eroarea de reconstrucție atinge un nivel acceptabil sau până când nu se mai înregistrează îmbunătățiri semnificative pe setul de validare.

Tipuri și Aplicații Practice ale Autoencoderelor

Autoencoder-ele nu sunt doar un concept teoretic; ele au multiple aplicații practice, fiecare adaptată pentru a rezolva probleme specifice. Iată trei exemple ilustrative:

1. Autoencoderul de Bază: Compresia și Învățarea Caracteristicilor

Acesta este cel mai simplu tip de autoencoder, conceput pentru a învăța o reprezentare compactă a datelor.

- Scop: Reducerea dimensionalității și învățarea de caracteristici intrinseci.

- Cum funcționează: Un autoencoder de bază, cum ar fi cel antrenat pe setul de date Fashion MNIST, preia imagini de 28x28 pixeli (784 dimensiuni) și le comprimă într-un vector de dimensiune mult mai mică (de exemplu, 64 de dimensiuni) folosind straturi dense. Apoi, decodificatorul reconstruiește imaginea originală din acest vector comprimat.

- Aplicații:

- Reducerea dimensionalității: Transformarea datelor de înaltă dimensiune în reprezentări de dimensiune mai mică, păstrând informațiile esențiale. Acest lucru poate fi util pentru vizualizare sau pentru a reduce complexitatea modelelor ulterioare.

- Pre-antrenare (Pre-training): Reprezentările învățate pot fi folosite ca input pentru alte modele de învățare supervizată, îmbunătățind performanța acestora, mai ales în cazul seturilor de date mici.

2. Autoencoderul de Dezgomotare (Denoising Autoencoder): Curățarea Imaginilor

Acest tip de autoencoder este specializat în eliminarea zgomotului din date.

- Scop: Reconstruirea datelor originale curate dintr-o versiune zgomotoasă a acestora.

- Cum funcționează: Se adaugă în mod artificial zgomot (de exemplu, zgomot Gaussian) imaginilor originale. Autoencoderul este apoi antrenat să preia imaginea zgomotoasă ca intrare și să o reconstruiască pe cea originală, curată, ca țintă. Prin acest proces, rețeaua învață să distingă semnalul real de zgomot. Adesea, aceste autoencodere utilizează rețele neuronale convoluționale (Conv2D și Conv2DTranspose) pentru a procesa eficient datele de imagine, exploatând structura spațială.

- Aplicații:

- Restaurarea imaginilor: Îmbunătățirea calității imaginilor digitale prin eliminarea zgomotului, petelor sau artefactelor.

- Procesarea semnalului: Curățarea semnalelor audio sau video de interferențe.

- Medicină: Îmbunătățirea imaginilor medicale (RMN, CT) pentru un diagnostic mai precis.

3. Autoencoderul pentru Detecția Anomaliilor: Identificarea Comportamentelor Neobișnuite

Una dintre cele mai puternice aplicații ale autoencoderelor este detecția anomaliilor.

- Scop: Identificarea punctelor de date care se abat semnificativ de la norma stabilită.

- Cum funcționează: Autoencoderul este antrenat exclusiv pe date "normale" sau "fără anomalii". Prin urmare, el învață să reconstruiască foarte bine doar datele care seamănă cu cele normale. Atunci când i se prezintă o dată "anormală", autoencoderul va avea dificultăți în a o reconstrui fidel, rezultând o eroare de reconstrucție mult mai mare. Odată antrenat, se stabilește un prag (threshold) pe baza erorilor de reconstrucție ale datelor normale (de exemplu, media erorilor + o deviație standard). Orice dată cu o eroare de reconstrucție care depășește acest prag este clasificată ca anomalie.

- Aplicații:

- Securitate cibernetică: Detecția intruziunilor sau a activităților suspecte în rețele.

- Monitorizarea echipamentelor: Identificarea defecțiunilor iminente în utilaje industriale prin analiza datelor senzorilor.

- Fraudă financiară: Detectarea tranzacțiilor neobișnuite sau frauduloase.

- Sănătate: Monitorizarea ritmurilor cardiace (ECG) pentru a identifica aritmii sau alte anomalii.

Tabel Comparativ: Tipuri de Autoencodere

| Tip Autoencoder | Intrare | Ieșire | Funcție de Pierdere Tipică | Aplicație Principală | Caracteristică Cheie |

|---|---|---|---|---|---|

| De Bază | Date originale (x) | Reconstrucție (x_tilde) | MSE | Reducerea dimensionalității | Învață o reprezentare compactă a datelor. |

| De Dezgomotare | Date zgomotoase (x_noisy) | Date originale (x) | MSE | Eliminarea zgomotului | Învață să filtreze zgomotul din semnalul util. |

| De Detecție Anomalii | Date (normale și anormale) | Reconstrucție (x_tilde) | MAE sau MSE | Identificarea deviațiilor | Antrenat doar pe date normale; anomalii = eroare mare. |

Evaluarea și Importanța Reprezentărilor Latente

Ce face o reprezentare învățată de un autoencoder să fie "bună"? Nu este suficient ca autoencoderul să poată reconstrui perfect intrarea. De fapt, dacă dimensiunea spațiului latent (k) este egală cu dimensiunea intrării (d), autoencoderul ar putea pur și simplu să învețe o funcție de identitate, fără a oferi nicio compresie sau informație utilă. Secretul stă în constrângerea "gâtului de sticlă" (bottleneck), care forțează autoencoderul să învețe o descriere cât mai simplă și mai relevantă a datelor originale.

Indicatori ai unei Reprezentări Bune:

- Eficiența compresiei: Cât de mult poate fi redusă dimensiunea datelor fără a pierde informații esențiale?

- Calitatea reconstrucției: Cât de fidelă este reconstrucția față de intrarea originală, având în vedere constrângerea de compresie?

- Semnificația semantică a spațiului latent: Într-o reprezentare bună, dimensiunile spațiului latent ar trebui să corespundă unor caracteristici semnificative ale datelor. De exemplu, pentru cifre scrise de mână, o dimensiune ar putea reprezenta grosimea liniei, alta înclinația, etc. Această semantică poate fi explorată prin modificarea controlată a valorilor în spațiul latent și observarea impactului asupra reconstrucției.

Conexiunea cu Analiza Componentelor Principale (PCA):

Este important de menționat că autoencoderele cu codificatoare și decodificatoare liniare (fără funcții de activare non-liniare) sunt echivalente cu Analiza Componentelor Principale (PCA). PCA este o tehnică clasică de reducere a dimensionalității care găsește o soluție în formă închisă (prin descompunerea valorilor singulare - SVD) pentru a găsi cele mai bune axe pentru proiecția datelor. Autoencoderele bazate pe rețele neuronale convoluționale sau cu straturi dense cu activări non-liniare pot fi considerate o generalizare non-lineară a PCA, permițându-le să capteze relații mult mai complexe în date.

Întrebări Frecvente (FAQ):

Q1: Care este diferența principală între un autoencoder și o rețea neuronală tradițională pentru clasificare?

A1: O rețea neuronală tradițională pentru clasificare este antrenată supervizat, având ca scop prezicerea unei etichete specifice (de exemplu, "câine" sau "pisică") pe baza unei intrări. Un autoencoder este antrenat nesupervizat (sau, mai precis, auto-supervizat), având ca scop reconstruirea propriei intrări. Deși scopurile lor sunt diferite, autoencoderele pot fi folosite ca o etapă premergătoare pentru clasificatori, oferind reprezentări de date mai bune.

Q2: De ce este important "gâtul de sticlă" (bottleneck) într-un autoencoder?

A2: Bottleneck-ul, adică dimensiunea redusă a spațiului latent în comparație cu datele de intrare, este crucial. Fără el, autoencoderul ar putea pur și simplu să memoreze intrarea și să o copieze la ieșire fără a învăța nicio compresie utilă sau caracteristici semnificative. Bottleneck-ul forțează rețeaua să învețe cele mai importante și discriminative caracteristici ale datelor pentru a le putea reconstrui.

Q3: Pot fi autoencoderele utilizate pentru generarea de date?

A3: Autoencoderele de bază nu sunt proiectate direct pentru generarea de date noi, deoarece decodificatorul lor este antrenat să reconstruiască date existente. Totuși, există variante, cum ar fi Autoencoderele Variaționale (Variational Autoencoders - VAEs), care învață o distribuție probabilistică a datelor în spațiul latent și pot genera noi exemple prin eșantionarea din această distribuție.

Q4: Ce tip de date pot fi procesate de autoencodere?

A4: Autoencoderele sunt extrem de versatile și pot procesa o gamă largă de tipuri de date, inclusiv imagini (cum am văzut cu Fashion MNIST), serii temporale (ECG-uri), text (pentru embeddings sau sumarizare) și chiar date tabulare, atâta timp cât pot fi reprezentate numeric.

Q5: Cum aleg dimensiunea spațiului latent (k)?

A5: Alegerea dimensiunii k este, adesea, un compromis și depinde de specificul problemei. Un k prea mic poate duce la o pierdere prea mare de informații și o reconstrucție slabă. Un k prea mare poate duce la o compresie insuficientă și la învățarea unei reprezentări mai puțin utile. Se începe de obicei cu valori empirice și se ajustează prin experimentare, monitorizând eroarea de reconstrucție și calitatea reprezentărilor învățate.

Concluzie:

Autoencoderele sunt instrumente puternice și versatile în arsenalul învățării automate. De la reducerea inteligentă a dimensionalității și curățarea datelor, până la identificarea subtilă a anomaliilor, ele oferă o perspectivă unică asupra structurii intrinseci a datelor. Prin înțelegerea modului în care funcționează aceste rețele neuronale, de la anatomia lor cu codificator și decodificator, până la procesul lor de antrenament bazat pe minimizarea eroarei de reconstrucție, putem debloca noi posibilități în analiza și prelucrarea datelor. Pe măsură ce domeniul inteligenței artificiale avansează, autoencoderele vor continua să joace un rol crucial în extragerea de informații valoroase din volume tot mai mari de date complexe.

Dacă vrei să descoperi și alte articole similare cu Autoencodere: Compresia Datelor și Detecția Anomaliilor, poți vizita categoria Fitness.