28/10/2022

În lumea dinamică a învățării profunde, construirea și antrenarea rețelelor neuronale adânci reprezintă o provocare fascinantă, dar adesea plină de obstacole. Pe măsură ce rețelele devin tot mai complexe și mai adânci, apar probleme precum gradienții instabili (vanishing sau exploding gradients) și convergența lentă, care pot împiedica semnificativ procesul de învățare. Din fericire, comunitatea de inteligență artificială a dezvoltat tehnici ingenioase pentru a aborda aceste provocări, iar una dintre cele mai puternice și răspândite este Normalizarea pe Batch (Batch Normalization - BN).

Acest ghid detaliat vă va introduce în conceptul de Normalizare pe Batch, explicând de ce este o tehnică atât de crucială, cum funcționează în profunzime, care sunt beneficiile sale majore și, mai important, cum o puteți implementa eficient folosind cadrul PyTorch. Vom explora impactul său asupra stabilității antrenării, vitezei de convergență și chiar asupra capacității de generalizare a modelului.

- Ce Este Normalizarea pe Batch (Batch Normalization)?

- De Ce Avem Nevoie de Normalizarea pe Batch?

- Cum Funcționează Normalizarea pe Batch?

- Beneficiile Normalizării pe Batch

- Importanța Dimensiunii Batch-ului

- Implementarea Normalizării pe Batch în PyTorch

- Normalizarea pe Batch în Modul de Antrenament vs. Predicție

- Tabel Comparativ: Model Fără BN vs. Model Cu BN

- Întrebări Frecvente (FAQ)

- Pot folosi Normalizarea pe Batch cu orice dimensiune de batch?

- Unde ar trebui să plasez stratul de Normalizare pe Batch într-o rețea?

- Normalizarea pe Batch este un tip de regularizare?

- Normalizarea pe Batch funcționează și pentru Rețele Recurente (RNNs)?

- Este Normalizarea pe Batch întotdeauna benefică?

- Concluzie

Ce Este Normalizarea pe Batch (Batch Normalization)?

Normalizarea pe Batch este o tehnică fundamentală în antrenarea rețelelor neuronale, concepută pentru a aborda problemele de instabilitate și de convergență lentă. La baza sa, BN normalizează intrările fiecărui strat al rețelei neuronale. Gândiți-vă la aceasta ca la un proces de igienizare internă: înainte ca activările (ieșirile) unui strat ascuns să fie transmise stratului următor, Normalizarea pe Batch le ajustează astfel încât să aibă o medie de zero și o deviație standard de unu.

Această transformare asigură că distribuția intrărilor către fiecare strat rămâne consistentă pe parcursul antrenării. Fără BN, distribuția activărilor dintr-un strat se poate schimba semnificativ pe măsură ce ponderile rețelei sunt actualizate, forțând straturile ulterioare să se adapteze continuu. Acest fenomen, cunoscut sub numele de Internal Covariate Shift, este una dintre principalele cauze ale antrenării lente și instabile. Prin standardizarea intrărilor, BN stabilizează procesul de învățare și permite rețelei să învețe mai eficient.

De Ce Avem Nevoie de Normalizarea pe Batch?

Pentru a înțelege pe deplin valoarea Normalizării pe Batch, este esențial să înțelegem problemele pe care le rezolvă:

Probleme cu Gradienții

Gradienții sunt coloana vertebrală a algoritmilor de optimizare în învățarea profundă, dictând modul în care ponderile rețelei sunt ajustate. Însă, într-o rețea neuronală profundă, acești gradienți pot deveni extrem de mici (vanishing gradients) sau extrem de mari (exploding gradients). Gradienții care dispar înseamnă că actualizările ponderilor devin neglijabile, iar rețeaua încetează să mai învețe eficient. Gradienții care explodează, pe de altă parte, duc la actualizări masive și instabile ale ponderilor, împiedicând convergența. Normalizarea pe Batch contribuie la menținerea magnitudinii gradienților într-un interval rezonabil, asigurând un flux stabil de informații și o învățare eficientă.

Problema Internal Covariate Shift

Acesta este un concept cheie pentru înțelegerea BN. Pe măsură ce o rețea neuronală este antrenată și ponderile sale sunt actualizate, distribuția activărilor (ieșirilor) din straturile ascunse se schimbă constant. Imaginați-vă că fiecare strat al rețelei primește date de intrare a căror distribuție se modifică la fiecare iterație de antrenare. Acest lucru înseamnă că straturile ulterioare trebuie să se adapteze continuu la o nouă distribuție de intrare, încetinind drastic procesul de convergență și făcând antrenarea mai dificilă. Normalizarea pe Batch atenuează acest „Internal Covariate Shift” prin standardizarea distribuției activărilor fiecărui strat, oferind astfel o intrare mai consistentă și mai previzibilă pentru straturile următoare. Această consistență permite straturilor să învețe mai independent și mai eficient.

Cum Funcționează Normalizarea pe Batch?

Mecanismul Normalizării pe Batch este inteligent și relativ simplu. În timpul fiecărei iterații de antrenare (epocă), BN ia un mini-batch de date și normalizează activările (ieșirile) unui strat ascuns. Procesul se desfășoară în câțiva pași:

- Calcularea Mediei și Varianței: Pentru fiecare caracteristică (neuron) din mini-batch, BN calculează media (μ) și deviația standard (σ). Acestea sunt estimate pe baza statisticilor curente ale mini-batch-ului.

- Normalizarea Activărilor: Activările sunt apoi transformate pentru a avea o medie de 0 și o deviație standard de 1. Formula de bază este:

x_hat = (x - μ) / sqrt(σ^2 + ε). Termenulε(epsilon) este o constantă mică adăugată la varianță pentru a preveni împărțirea la zero, în cazul în care deviația standard ar fi extrem de mică. - Scalare și Deplasare cu Parametri Învățabili: Deși normalizarea ajută la stabilitate, ea poate, de asemenea, să perturbe informațiile valoroase învățate de rețea. Pentru a compensa acest lucru și a permite rețelei să-și recupereze puterea reprezentativă, BN introduce doi parametri învățabili per caracteristică: gamma (γ) și beta (β). Gamma (γ) este un factor de scalare, iar Beta (β) este un factor de deplasare. Formula finală devine:

y = γ * x_hat + β. Acești parametri sunt antrenați alături de celelalte ponderi ale rețelei, permițând modelului să ajusteze distribuția la o scară și o deplasare optime, adaptându-se la nevoile specifice ale datelor. Aceasta face ca BN să fie mai mult decât o simplă normalizare statică; este o componentă dinamică, adaptabilă a rețelei.

Acest proces asigură că fiecare element sau componentă este în proporția corectă înainte de a distribui intrările în straturi și că fiecare strat este normalizat înainte de a fi transmis stratului următor.

Beneficiile Normalizării pe Batch

Integrarea Normalizării pe Batch în arhitectura unei rețele neuronale aduce o multitudine de beneficii, transformând procesul de antrenare și performanța finală a modelului:

Convergență Mai Rapidă

Prin stabilizarea gradienților și a distribuției activărilor, BN permite utilizarea unor rate de învățare (learning rates) semnificativ mai mari. Aceasta înseamnă că modelul poate face pași mai mari în spațiul parametrilor fără a deveni instabil, accelerând considerabil procesul de antrenare și atingând performanțe optime într-un timp mai scurt.

Reducerea Internal Covariate Shift

Așa cum am discutat, BN atenuează problema Internal Covariate Shift, asigurând că distribuția intrărilor către fiecare strat rămâne relativ consistentă. Acest lucru permite straturilor să învețe mai eficient, deoarece nu trebuie să se adapteze constant la schimbările din distribuția datelor primite de la straturile anterioare. Fiecare strat poate funcționa mai independent și mai stabil.

Insensibilitate la Inițializare

Rețelele neuronale profunde sunt adesea foarte sensibile la valorile inițiale ale ponderilor. O inițializare proastă poate duce la gradienți care dispar sau explodează chiar de la începutul antrenării. Normalizarea pe Batch reduce această dependență, făcând rețeaua mai robustă la inițializările suboptimale și permițând o antrenare mai stabilă și mai ușoară.

Efect de Regularizare

Un beneficiu adesea surprinzător și serendipitous al Normalizării pe Batch este efectul său de regularizare. Deoarece media și varianța sunt calculate pe fiecare mini-batch, ele introduc un anumit grad de zgomot în activările stratului. Acest zgomot aleatoriu acționează similar cu tehnicile de regularizare precum Dropout, ajutând la prevenirea supra-antrenării (overfitting) și îmbunătățind capacitatea modelului de a generaliza la date noi, nevăzute. Acest aspect este deosebit de util pentru rețelele adânci, care sunt mai predispuse la overfitting.

Importanța Dimensiunii Batch-ului

Deoarece Normalizarea pe Batch se bazează pe statisticile calculate pe mini-batch-uri, dimensiunea batch-ului joacă un rol crucial în performanța sa:

- Batch-uri Mari: Produc statistici (medie și varianță) mai precise, mai apropiate de statisticile întregului set de date. Acest lucru poate duce la o convergență mai stabilă, dar reduce efectul de regularizare.

- Batch-uri Mici: Introduc mai mult zgomot în statisticile calculate, ceea ce amplifică efectul de regularizare. Cu toate acestea, batch-urile extrem de mici (ex: dimensiune 1) pot duce la statistici foarte zgomotoase și instabilitate, deoarece media devine întotdeauna zero după normalizare. Batch-urile de dimensiune 1 nu sunt funcționale pentru BN.

- Batch-uri Moderate: Un interval de la 32 la 256, cu 50-100 fiind adesea un „punct dulce”, oferă un echilibru bun între acuratețea statisticilor și efectul benefic de regularizare.

Alegerea unei dimensiuni corecte a batch-ului este, așadar, un aspect important de luat în considerare atunci când se utilizează Normalizarea pe Batch, influențând atât stabilitatea, cât și generalizarea modelului.

Implementarea Normalizării pe Batch în PyTorch

PyTorch oferă o implementare convenabilă a Normalizării pe Batch prin modulul nn.BatchNormXd, unde X indică dimensiunea datelor:

nn.BatchNorm1d: Pentru date 1D, cum ar fi ieșirile straturilor complet conectate (dense layers).nn.BatchNorm2d: Pentru date 2D, cel mai frecvent utilizat după straturile convoluționale în rețelele pentru imagini.nn.BatchNorm3d: Pentru date 3D, utilizat în aplicații precum procesarea video sau imagistica medicală.

Iată cum am putea integra Normalizarea pe Batch într-o arhitectură simplă de rețea neuronală multi-strat (MLP) în PyTorch, similar cu exemplul de antrenare a setului de date MNIST:

import torch from torch import nn class MLP_cu_BN(nn.Module): def __init__(self): super().__init__() self.layers = nn.Sequential( nn.Flatten(), # Aplanează tensorul de intrare (imaginea) nn.Linear(28 * 28, 64), # Strat complet conectat de la 28*28 la 64 de neuroni nn.BatchNorm1d(64), # Normalizare pe Batch pentru stabilitate și convergență mai rapidă nn.ReLU(), # Funcția de activare ReLU nn.Linear(64, 32), # Strat complet conectat de la 64 la 32 de neuroni nn.BatchNorm1d(32), # Normalizare pe Batch pentru stabilitate și convergență mai rapidă nn.ReLU(), # Funcția de activare ReLU nn.Linear(32, 10) # Strat complet conectat de la 32 la 10 neuroni (pentru clasele MNIST) ) def forward(self, x): return self.layers(x) În acest exemplu, nn.BatchNorm1d(64) este aplicat după primul strat complet conectat (cu 64 de neuroni), iar nn.BatchNorm1d(32) după al doilea strat (cu 32 de neuroni). Argumentul numeric (64 și 32) reprezintă numărul de caracteristici (neuroni) din stratul la care se aplică Normalizarea pe Batch. De obicei, stratul de Normalizare pe Batch este plasat după stratul liniar (sau convoluțional) și înainte de funcția de activare (ReLU în acest caz), pentru a normaliza ieșirile pre-activare.

Antrenarea modelului cu Normalizare pe Batch urmează pașii standard: încărcarea datelor (precum setul de date MNIST), definirea funcției de pierdere (ex: nn.CrossEntropyLoss) și a optimizatorului (ex: torch.optim.Adam). Bucla de antrenare va itera peste mini-batch-uri, va calcula pierderea, va efectua retropropagarea și va actualiza parametrii modelului, inclusiv parametrii γ și β ai straturilor de Normalizare pe Batch.

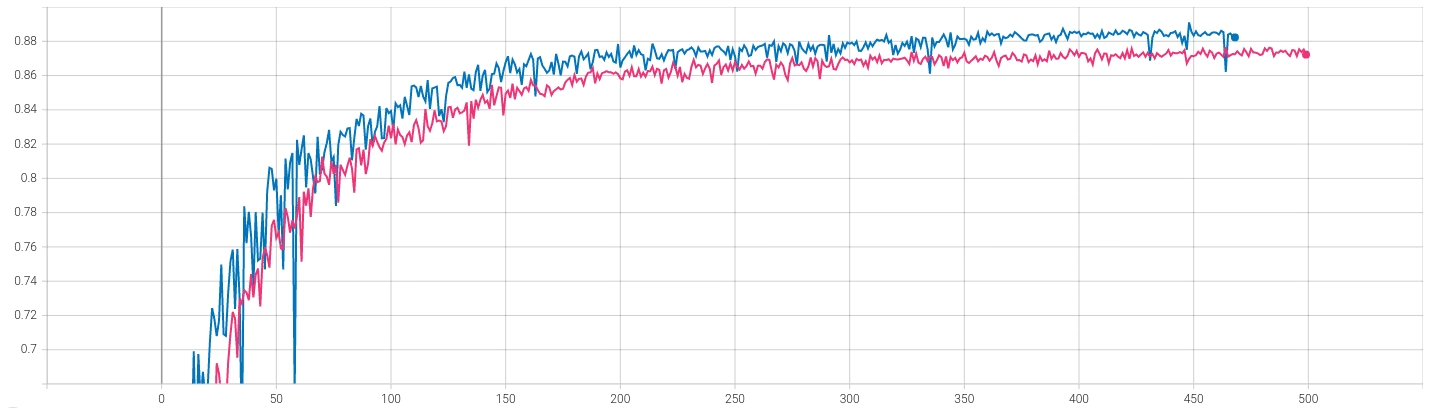

Observațiile din jurnalul de antrenare al unui astfel de model demonstrează, în mod consistent, o scădere rapidă și stabilă a pierderii pe parcursul epocilor, indicând o convergență eficientă și o performanță îmbunătățită a modelului grație Normalizării pe Batch. Aceasta este o dovadă clară a impactului său pozitiv.

Normalizarea pe Batch în Modul de Antrenament vs. Predicție

Este crucial să înțelegem că un strat de Normalizare pe Batch funcționează diferit în timpul antrenării față de modul de predicție (sau evaluare):

- Modul de Antrenament: În timpul antrenării, Normalizarea pe Batch utilizează media și varianța calculate pe mini-batch-ul curent. Aceasta introduce un zgomot subtil, dar benefic, care contribuie la efectul de regularizare și ajută modelul să generalizeze mai bine.

- Modul de Predicție (Inference/Evaluare): Odată ce modelul este antrenat, nu mai dorim ca predicțiile să depindă de mini-batch-ul specific în care se află o instanță. Prin urmare, în modul de predicție, Normalizarea pe Batch utilizează mediile și varianțele agregate (running mean și running variance) care au fost estimate și actualizate pe parcursul întregului proces de antrenare. Aceste statistici cumulate oferă o normalizare consistentă și deterministă, asigurând că o anumită intrare va produce întotdeauna aceeași ieșire.

PyTorch gestionează automat această distincție prin apelarea model.train() înainte de antrenare și model.eval() înainte de evaluare sau predicție. Acest mecanism este esențial pentru a obține performanțe optime și predicții fiabile.

Tabel Comparativ: Model Fără BN vs. Model Cu BN

Pentru a evidenția mai bine avantajele Normalizării pe Batch, iată o comparație directă:

| Caracteristică | Model Fără Normalizare pe Batch | Model Cu Normalizare pe Batch |

|---|---|---|

| Stabilitatea Gradienților | Instabilă, risc de dispariție/explozie | Mult mai stabilă |

| Viteza de Convergență | Lentă, necesită rate mici de învățare | Rapidă, permite rate mari de învățare |

| Sensibilitate la Inițializare | Ridicată, poate necesita inițializări specifice | Scăzută, mai robustă |

| Risc de Overfitting | Mai ridicat | Redus (efect de regularizare) |

| Internal Covariate Shift | Prezent, impact negativ | Ameliorat semnificativ |

| Complexitatea Rețelei | Dificil de antrenat pentru rețele adânci | Facilitează antrenarea rețelelor adânci |

Întrebări Frecvente (FAQ)

Pot folosi Normalizarea pe Batch cu orice dimensiune de batch?

Nu chiar. Deși BN este flexibilă, performanța sa depinde de dimensiunea batch-ului. Batch-urile foarte mici (sub 4-8 exemple) pot duce la estimări zgomotoase ale mediei și varianței, ceea ce poate destabiliza antrenarea. Dimensiunea 1 nu este viabilă, deoarece deviația standard ar fi zero. Pe de altă parte, batch-urile extrem de mari (sute sau mii de exemple) vor avea statistici foarte stabile, dar vor reduce efectul benefic de regularizare. Un echilibru optim se găsește adesea în intervalul 32-256, cu 50-100 fiind un punct de plecare excelent pentru majoritatea aplicațiilor.

Unde ar trebui să plasez stratul de Normalizare pe Batch într-o rețea?

Cea mai comună și eficientă practică este plasarea stratului de Normalizare pe Batch după un strat liniar (sau convoluțional) și înainte de funcția de activare non-liniară (cum ar fi ReLU, Sigmoid, Tanh). Această poziționare normalizează ieșirile scalare (pre-activare) ale stratului, asigurând că valorile care intră în funcția de activare sunt într-un interval consistent și optim pentru învățare. Există și alte variante, dar aceasta este cea mai răspândită.

Normalizarea pe Batch este un tip de regularizare?

Da, deși nu a fost concepută inițial cu acest scop. Efectul de regularizare al Normalizării pe Batch este un beneficiu secundar, dar semnificativ. Zgomotul introdus de statisticile mini-batch-ului, care sunt diferite pentru fiecare batch, acționează ca o formă de perturbație aleatorie aplicată activărilor. Această perturbare este similară cu cea introdusă de Dropout și ajută la prevenirea supra-antrenării, forțând rețeaua să devină mai robustă și mai puțin dependentă de caracteristici specifice din setul de antrenament. Prin urmare, Normalizarea pe Batch contribuie la o mai bună generalizare a modelului pe date nevăzute.

Normalizarea pe Batch funcționează și pentru Rețele Recurente (RNNs)?

Normalizarea pe Batch nu este la fel de eficientă pentru Rețelele Neuronale Recurente (RNNs) precum este pentru MLP-uri sau CNN-uri. Acest lucru se datorează naturii secvențiale a RNN-urilor, unde statisticile batch-ului pot varia semnificativ pe parcursul secvenței. Pentru RNN-uri, o alternativă mai potrivită este adesea Normalizarea pe Strat (Layer Normalization), care normalizează caracteristicile în cadrul aceluiași strat (sau pas de timp), nu pe întregul batch, fiind mai robustă la variațiile lungimii secvenței și la dimensiunile mici ale batch-ului.

Este Normalizarea pe Batch întotdeauna benefică?

În majoritatea absolută a cazurilor, da, Normalizarea pe Batch aduce beneficii substanțiale, în special pentru antrenarea rețelelor neuronale profunde. Este o tehnică standard în aproape toate arhitecturile moderne. Cu toate acestea, există scenarii nișate sau arhitecturi specifice (cum ar fi cele cu batch-uri foarte mici sau anumite tipuri de rețele generative) unde alte forme de normalizare (precum Group Normalization sau Instance Normalization) pot fi mai potrivite. Însă, pentru majoritatea aplicațiilor de clasificare și regresie, BN rămâne o primă alegere excelentă și o componentă esențială pentru performanță.

Concluzie

Normalizarea pe Batch a revoluționat modul în care antrenăm rețelele neuronale profunde, transformând un proces adesea frustrant și lent într-unul mult mai stabil și mai rapid. De la abordarea problemelor critice ale gradienților instabili și ale Internal Covariate Shift, până la oferirea unui efect serendipitous de regularizare, BN s-a impus ca o componentă indispensabilă în arsenalul oricărui specialist în învățare profundă. Prin stabilizarea procesului de antrenare, accelerarea convergenței și îmbunătățirea capacității de generalizare, Normalizarea pe Batch nu doar că face antrenarea rețelelor adânci posibilă, ci o face și eficientă. Înțelegerea și aplicarea corectă a acestei tehnici în PyTorch vă va oferi un avantaj considerabil în construirea de modele de inteligență artificială performante și robuste.

Dacă vrei să descoperi și alte articole similare cu Normalizare Batch în PyTorch: Ghid Complet, poți vizita categoria Fitness.