11/08/2022

În lumea rapidă și în continuă evoluție a inteligenței artificiale, framework-uri precum Keras au simplificat dramatic procesul de construire și antrenare a rețelelor neuronale. Unul dintre instrumentele puternice, adesea subestimate, dar esențiale pentru controlul fin asupra procesului de antrenament, este metoda train_on_batch. Această funcție oferă o flexibilitate și o granularitate remarcabilă, deschizând noi orizonturi pentru dezvoltatorii care doresc să depășească limitările metodelor tradiționale de antrenament. Fie că lucrați cu seturi de date imense, date generate dinamic sau scenarii de învățare online, înțelegerea și stăpânirea train_on_batch vă poate propulsa modelele la un nivel superior de eficiență și performanță.

- Ce este Metoda train_on_batch în Keras?

- De ce să Folosiți train_on_batch? Avantajele Controlului Granular

- Cum Funcționează train_on_batch? O Perspectivă Tehnică

- train_on_batch vs. fit: O Comparație Detaliată

- Exemple Practice și Scenarii de Utilizare

- Considerații și Cele Mai Bune Practici

- Întrebări Frecvente despre train_on_batch

- Concluzie

Ce este Metoda train_on_batch în Keras?

train_on_batch este o funcție oferită de API-ul Keras care permite antrenarea unui model pe un singur lot de date. Spre deosebire de metoda fit, care iterează automat prin întregul set de date pe parcursul mai multor epoci, train_on_batch preia un set specific de intrări și etichete, efectuează o trecere înainte (forward pass), calculează eroarea (loss), efectuează o trecere înapoi (backward pass) pentru a calcula gradienții și apoi actualizează ponderile modelului folosind un optimizator, totul pentru un singur lot de date. Rezultatul returnat de train_on_batch este valoarea erorii (loss) și, opțional, valorile metricilor specificate (de exemplu, acuratețea) pentru lotul respectiv. Această abordare granulară este fundamentală pentru scenariile în care aveți nevoie de un control precis asupra fiecărui pas de antrenament sau când datele nu sunt disponibile integral de la început.

De ce să Folosiți train_on_batch? Avantajele Controlului Granular

Există multiple scenarii în care train_on_batch devine o alegere superioară față de fit. Principalele avantaje derivă din controlul său granular:

- Învățare Incrementală și Online: Pentru aplicațiile în care datele sosesc continuu (de exemplu, fluxuri de date de la senzori, tranzacții financiare),

train_on_batchpermite modelului să învețe și să se adapteze în timp real, fără a necesita reantrenarea completă a modelului de fiecare dată când apar date noi. Aceasta este esența învățării incrementale. - Seturi de Date Mari și Memoria Limitată: Când setul de date este prea mare pentru a încăpea integral în memoria RAM,

train_on_batchpermite încărcarea și procesarea datelor în loturi mici, gestionabile. Puteți construi un generator de date personalizat care să livreze loturi de date pe măsură ce sunt necesare, evitând astfel erorile de memorie. - Bucle de Antrenament Personalizate: Dacă aveți nevoie de o logică de antrenament non-standard – cum ar fi manipularea dinamică a ratei de învățare, aplicarea de regularizări specifice la anumite etape, implementarea de algoritmi de optimizare customizați, sau integrarea cu logici complexe de preprocesare a datelor între loturi –

train_on_batchvă oferă libertatea de a construi o buclă de antrenament complet personalizată. - Antrenament Pe Bază de Eșantion Specific: În anumite situații, s-ar putea să doriți să antrenați modelul doar pe anumite eșantioane care sunt considerate mai importante sau mai relevante la un moment dat (de exemplu, în învățarea activă, unde modelul cere etichetarea anumitor eșantioane).

train_on_batchpermite selectarea și procesarea exactă a acestor loturi. - Depanare și Monitorizare Detaliată: Prin controlul fiecărui lot, puteți inspecta mai îndeaproape comportamentul modelului, erorile și actualizările ponderilor la un nivel mult mai detaliat, ceea ce facilitează depanarea și înțelegerea procesului de antrenament.

Cum Funcționează train_on_batch? O Perspectivă Tehnică

Mecanismul intern al train_on_batch implică următorii pași, executați secvențial pentru fiecare lot de date:

- Intrare (Input): Metoda primește un tensor (sau o listă de tensori) pentru datele de intrare (

x) și un tensor (sau o listă de tensori) pentru etichetele corespunzătoare (y). Acestea reprezintă un singur lot de date. - Calculul Trecerii Înainte (Forward Pass): Datele de intrare

xsunt propagate prin straturile modelului pentru a genera predicții (output). - Calculul Erorii (Loss Calculation): Predicțiile modelului sunt comparate cu etichetele reale

yfolosind funcția de eroare (loss function) specificată la compilarea modelului. Aceasta cuantifică diferența dintre ceea ce a prezis modelul și realitate. - Calculul Gradienților (Gradient Calculation): Pe baza valorii erorii, se calculează gradienții funcției de eroare în raport cu ponderile fiecărui strat al rețelei. Acest pas folosește algoritmul de retropropagare (backpropagation).

- Actualizarea Ponderilor (Weight Update): Optimizatorul (de exemplu, Adam, SGD, RMSprop) utilizează gradienții calculați pentru a ajusta ponderile modelului, cu scopul de a minimiza eroarea. Rata de învățare a optimizatorului joacă un rol crucial aici.

- Calculul Metricilor (Metrics Calculation): Pe lângă eroare, sunt calculate și metricile de performanță (de exemplu, acuratețea, precizia, recall-ul) specificate la compilarea modelului.

- Ieșire (Output): Metoda returnează o listă de valori, unde primul element este valoarea erorii pentru lotul curent, urmată de valorile metricilor.

Acest ciclu complet este executat pentru fiecare apel al funcției train_on_batch, oferind o personalizare extinsă asupra procesului de antrenament.

train_on_batch vs. fit: O Comparație Detaliată

Deși ambele metode servesc la antrenarea modelelor Keras, ele sunt concepute pentru cazuri de utilizare diferite și oferă niveluri distincte de control. Iată o comparație:

| Caracteristică | model.fit() | model.train_on_batch() |

|---|---|---|

| Nivel de Control | Înalt nivel, abstractizare mare. | Nivel scăzut, control granular. |

| Input de Date | Set de date complet (numpy arrays, TensorFlow Datasets, Keras Sequences). | Un singur lot de date (numpy arrays). |

| Iterație Date | Iterează automat prin întregul set de date pe parcursul mai multor epoci. | Procesează un singur lot la un moment dat; iterația prin setul de date trebuie gestionată manual. |

| Bucle de Antrenament | Predefinită, cu opțiuni de configurare prin callback-uri. | Necesită o buclă de antrenament personalizată. |

| Utilitate Principală | Antrenament rapid și standard al modelului, prototipare. | Învățare incrementală, date mari care nu încap în memorie, bucle de antrenament avansate. |

| Funcționalități Adăugate | Validare automată, callback-uri (EarlyStopping, ModelCheckpoint), shuffle, batching. | Necesită implementarea manuală a acestor funcționalități în bucla personalizată. |

| Consum Memorie | Poate fi mare dacă setul de date complet este încărcat. | Eficient pentru memorie, deoarece procesează doar un lot. |

Alegerea între fit și train_on_batch depinde în mare măsură de cerințele specifice ale proiectului dumneavoastră. Pentru majoritatea cazurilor standard, fit este suficient și mult mai ușor de utilizat. Cu toate acestea, pentru scenarii care necesită flexibilitate maximă, train_on_batch este instrumentul indispensabil. Acesta oferă puterea de a implementa logici de antrenament complexe și de a gestiona eficient resursele, contribuind la o optimizare superioară a procesului de antrenament.

Exemple Practice și Scenarii de Utilizare

Deși nu pot oferi cod executabil, pot descrie cum ar arăta utilizarea train_on_batch în diferite scenarii:

1. Antrenament cu Generator de Date Personalizat

Imaginați-vă că aveți un set de imagini medicale foarte mare, stocate pe disc. În loc să le încărcați pe toate în memorie, puteți crea un generator Python care citește imagini și etichete în loturi. Buclele de antrenament ar arăta astfel:

model = Model(...) # Definește-ți modelul Keras model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy']) # Presupunem un generator care produce (x_batch, y_batch) for epoch in range(num_epochs): print(f"Epoch {epoch+1}/{num_epochs}") for batch_idx, (x_batch, y_batch) in enumerate(data_generator): loss, accuracy = model.train_on_batch(x_batch, y_batch) print(f" Batch {batch_idx+1}: Loss = {loss:.4f}, Accuracy = {accuracy:.4f}") # Aici poți adăuga logica de validare sau salvare model la sfârșitul epocii Acest exemplu ilustrează cum train_on_batch este apelat într-o buclă manuală, procesând fiecare lot generat.

2. Învățare Online/Învățare Continua

Considerați un sistem de detectare a fraudelor care primește tranzacții noi în timp real. Modelul trebuie să se adapteze continuu. Când o nouă tranzacție (sau un lot mic de tranzacții) este etichetată, puteți folosi train_on_batch pentru a o încorpora în cunoștințele modelului:

# Presupunem că modelul a fost pre-antrenat sau inițializat while True: new_transaction_data, new_transaction_label = receive_new_data() if new_transaction_data is not None: loss, metrics = model.train_on_batch(new_transaction_data, new_transaction_label) print(f"Model updated with new data. Loss: {loss}, Metrics: {metrics}") time.sleep(polling_interval) Această abordare permite modelului să rămână relevant și să se adapteze la noi tipare fără a fi nevoie de reantrenări costisitoare.

3. Implementarea unei Logic Avansate de Antrenament

Să zicem că doriți să implementați o schedulă de rată de învățare foarte specifică sau să aplicați o anumită pierdere (loss) doar pentru anumite tipuri de loturi. Cu train_on_batch, aveți control total:

optimizer = tf.keras.optimizers.Adam(learning_rate=0.001) model.compile(optimizer=optimizer, loss='mse') for epoch in range(num_epochs): for x_batch, y_batch in custom_data_pipeline: # Logica condițională pentru rata de învățare sau alte modificări if some_condition: K.set_value(model.optimizer.lr, new_learning_rate) loss = model.train_on_batch(x_batch, y_batch) print(f"Loss for batch: {loss}") Flexibilitatea este cheia aici, permițându-vă să experimentați cu abordări de antrenament care depășesc funcționalitățile standard ale lui fit.

Considerații și Cele Mai Bune Practici

Deși train_on_batch este un instrument puternic, utilizarea sa optimă necesită o înțelegere a anumitor considerații:

- Gestionarea Datelor: Trebuie să vă asigurați că datele sunt preprocesate și împărțite în loturi corect înainte de a le transmite către

train_on_batch. Acest lucru include normalizarea, augmentarea datelor și asigurarea că dimensiunile loturilor (batch sizes) sunt consistente. - Bucla de Antrenament: Construirea unei bucle de antrenament manuale necesită mai mult cod și mai multă atenție la detalii. Trebuie să gestionați epocile, amestecarea datelor (shuffling), salvarea modelului, validarea și logarea performanței.

- Callback-uri: Funcționalitățile automate oferite de callback-urile

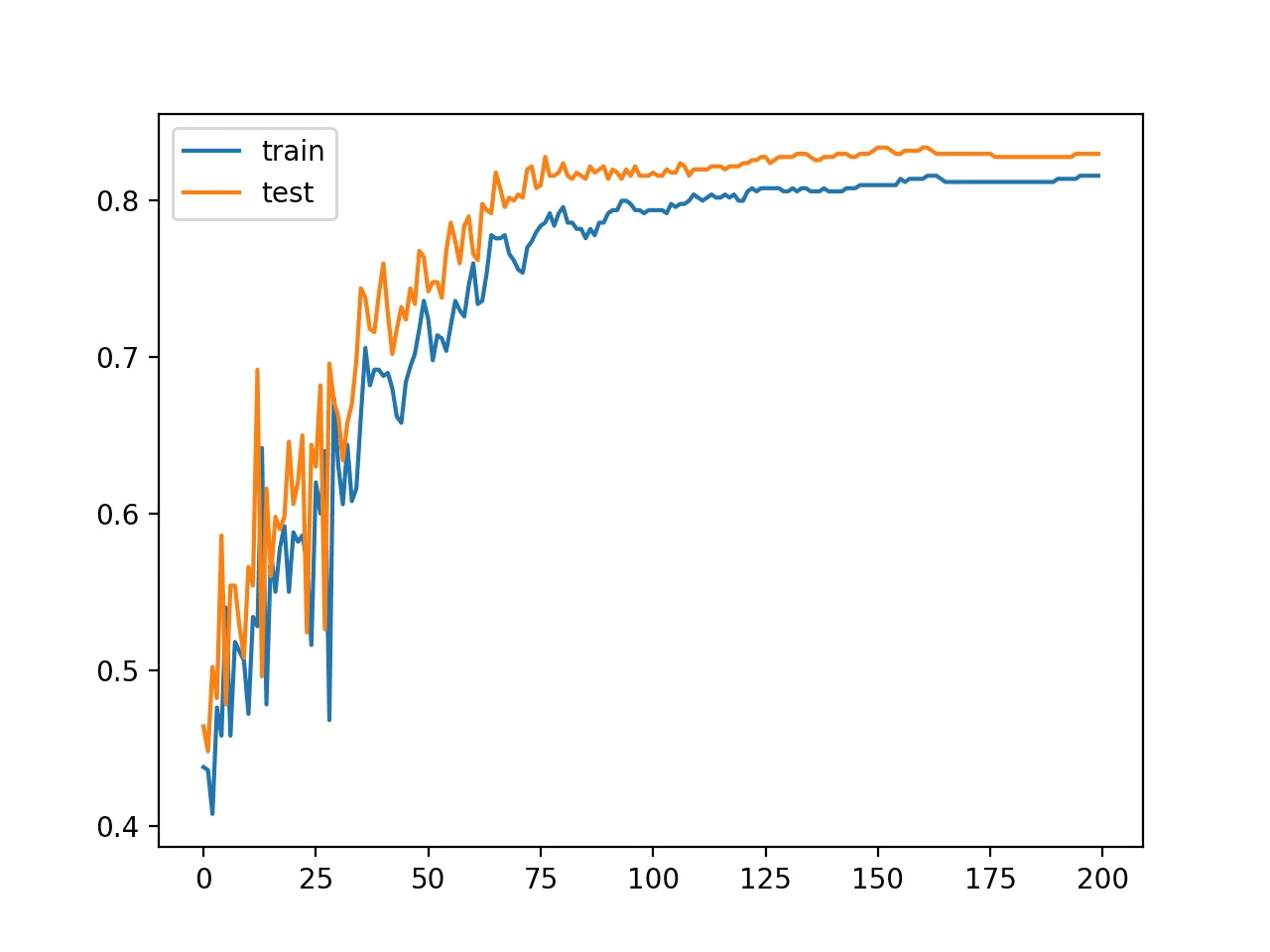

fit(precumEarlyStopping,ModelCheckpoint,ReduceLROnPlateau) nu sunt disponibile implicit cutrain_on_batch. Va trebui să le implementați manual în bucla dumneavoastră de antrenament. - Monitorizare: Este esențial să monitorizați eroarea și metricile pe parcursul antrenamentului pentru a detecta suprafitting-ul (overfitting) sau subfitting-ul (underfitting). Puteți colecta valorile returnate de

train_on_batchși să le vizualizați. - Performanță: Deși

train_on_batcheste flexibil, nu este neapărat mai rapid decâtfitpentru toate scenariile. Overhead-ul gestionării manuale a buclei poate afecta performanța dacă nu este optimizată corect, mai ales în cazul preprocesării datelor. Asigurați-vă că generatorul de date este eficient.

Întrebări Frecvente despre train_on_batch

1. Pot folosi train_on_batch pentru antrenamentul distribuit?

Da, train_on_batch poate fi un bloc fundamental în sistemele de antrenament distribuit. Puteți distribui loturi de date către mai multe dispozitive sau mașini, fiecare executând train_on_batch, iar apoi agregatele gradienților pot fi folosite pentru a actualiza modelul centralizat. Implementarea necesită însă o logică suplimentară pentru sincronizarea și agregarea gradienților.

2. Este train_on_batch mai bun decât fit?

Nu neapărat "mai bun", ci "diferit" și "mai flexibil". fit este ideal pentru majoritatea cazurilor standard, oferind o interfață simplă și funcționalități automate. train_on_batch este superior atunci când aveți nevoie de un control extrem de granular, cum ar fi în scenarii de învățare incrementală, cu seturi de date foarte mari sau când implementați algoritmi de antrenament personalizați. Alegerea depinde de nevoile specifice ale proiectului.

3. Cum gestionez validarea cu train_on_batch?

Validarea trebuie gestionată manual. După un anumit număr de iterații (de exemplu, la sfârșitul fiecărei epoci), puteți apela model.test_on_batch() sau model.evaluate() pe un lot (sau pe întregul set) de date de validare. Apoi, puteți folosi aceste rezultate pentru a decide dacă să salvați modelul, să ajustați rata de învățare, etc.

4. Cum pot amesteca (shuffle) datele atunci când folosesc train_on_batch?

Amestecarea datelor trebuie gestionată de generatorul dumneavoastră de date. Acesta ar trebui să încarce loturi de date într-o ordine aleatorie la fiecare epocă pentru a preveni modelul să învețe ordinea datelor și pentru a asigura o convergență mai bună.

5. Pot folosi train_on_batch cu un tf.data.Dataset?

Da, absolut! tf.data.Dataset este o modalitate excelentă de a gestiona datele mari și complexe. Puteți itera peste un obiect tf.data.Dataset care a fost configurat pentru batching și shuffling, iar pentru fiecare lot obținut, puteți apela model.train_on_batch(). Aceasta combină eficiența pipeline-ului de date TensorFlow cu flexibilitatea train_on_batch.

Concluzie

Metoda train_on_batch din Keras este un instrument fundamental pentru oricine dorește să depășească limitările antrenamentului standard al modelelor de deep learning. Oferind un nivel de control granular fără precedent asupra fiecărui pas de antrenament, aceasta deschide uși către soluții inovatoare pentru învățarea pe seturi de date mari, învățarea incrementală și implementarea de bucle de antrenament personalizate. Deși necesită o gestionare manuală mai mare a buclei de antrenament și a funcționalităților auxiliare, flexibilitatea pe care o oferă compensează efortul suplimentar, permițând dezvoltatorilor să optimizeze performanța și să adapteze modelele la cerințe specifice. Înțelegerea și aplicarea corectă a train_on_batch vă va extinde semnificativ arsenalul de unelte în lumea fascinantă a inteligenței artificiale.

Dacă vrei să descoperi și alte articole similare cu Antrenează Modele Keras cu train_on_batch, poți vizita categoria Fitness.