19/10/2023

Într-o lume din ce în ce mai modelată de inteligența artificială, rețelele neuronale reprezintă o piatră de temelie a progresului tehnologic. Dar cum ajung aceste structuri complexe să învețe și să ia decizii inteligente? Procesul de "antrenare" sau "potrivire" a unei rețele neuronale la un set de date de antrenament este esențial. Acesta implică ajustarea iterativă a milioanelor de parametri interni, cunoscuți sub numele de ponderi și biasuri, astfel încât rețeaua să poată face predicții precise sau să recunoască modele cu o acuratețe cât mai mare. Gândiți-vă la acest proces ca la un elev care învață dintr-o serie de exemple, corectându-și greșelile până când stăpânește subiectul. Scopul final este minimizarea erorii dintre ieșirile prezise de rețea și ieșirile reale din setul de date de antrenament.

Mecanismul de Bază al Antrenării Rețelelor Neuronale

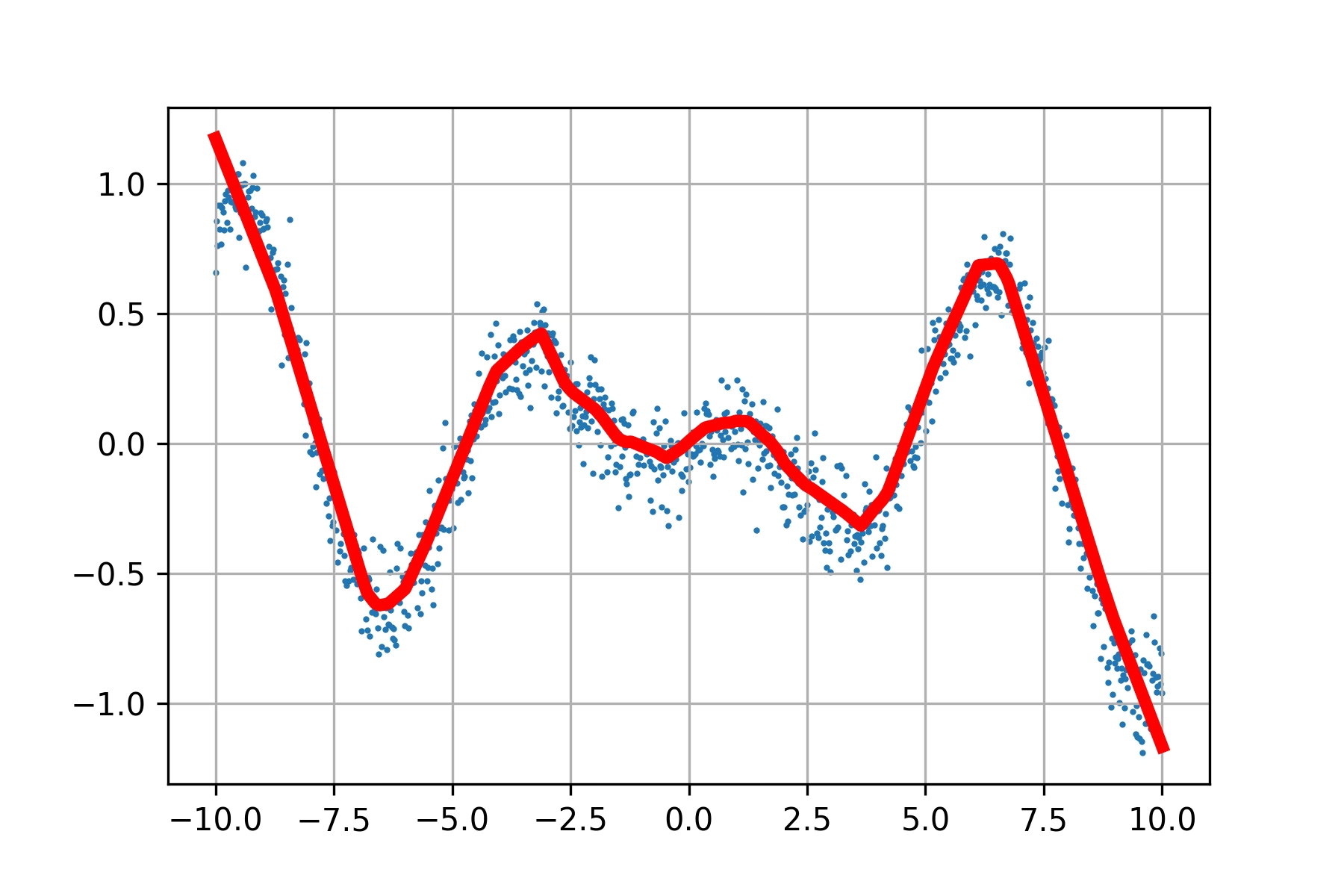

Antrenarea unei rețele neuronale este, în esență, o problemă de optimizare. Începem cu ponderi și biasuri inițiale, adesea alese aleatoriu. Apoi, rețeaua procesează datele de intrare și produce o ieșire. Această ieșire este comparată cu ieșirea dorită (ținta), iar diferența reprezintă eroarea. Pe baza acestei erori, un algoritm de optimizare ajustează ponderile și biasurile rețelei într-un mod care se așteaptă să reducă eroarea la următoarea iterație. Acest ciclu se repetă de mii sau chiar milioane de ori, până când eroarea atinge un nivel acceptabil sau până când rețeaua nu mai înregistrează îmbunătățiri semnificative.

Există numeroși algoritmi de optimizare disponibili, fiecare cu propriile sale avantaje și dezavantaje în ceea ce privește viteza, cerințele de memorie și capacitatea de a găsi soluții optime. Alegerea algoritmului potrivit poate influența dramatic timpul necesar pentru antrenarea unei rețele și calitatea modelului final. Deși metodele bazate pe gradient descent (cum ar fi Stochastic Gradient Descent - SGD, Adam, RMSprop) sunt larg utilizate datorită simplității și scalabilității lor, există situații în care viteza de convergență este primordială.

Levenberg-Marquardt: Un Gigant al Vitezei

Când vine vorba de viteză în antrenarea rețelelor neuronale, algoritmul Levenberg-Marquardt (LM) este adesea considerat unul dintre cei mai eficienți. Acest algoritm hibrid combină avantajele metodei Gauss-Newton cu cele ale metodei gradientului descendent. În esență, LM funcționează ca Gauss-Newton atunci când eroarea este mică și se comportă mai mult ca gradientul descendent atunci când eroarea este mare. Această adaptabilitate îi permite să navigheze eficient pe suprafața de eroare, ajungând la un minim local mult mai rapid decât mulți alți algoritmi.

Unul dintre motivele cheie pentru viteza superioară a algoritmului Levenberg-Marquardt este modul în care utilizează informațiile despre a doua derivată a funcției de eroare (sau o aproximare a acesteia, matricea Hessiană). În timp ce algoritmii de prim ordin (cum ar fi gradient descent) folosesc doar panta (prima derivată) pentru a determina direcția de actualizare, LM utilizează informații despre curbura suprafeței de eroare. Acest lucru îi permite să facă pași mai mari și mai bine direcționați către minim, în special în apropierea acestuia.

Compromisul Levenberg-Marquardt: Viteza vs. Memoria

Deși Levenberg-Marquardt este renumit pentru viteza sa, vine cu un cost: cerințe mai mari de memorie. Pentru a calcula actualizările ponderilor, LM necesită stocarea și manipularea unei matrici de dimensiuni considerabile (aproximarea matricei Hessiană sau Jacobiană). Pe măsură ce numărul de ponderi din rețea crește, dimensiunea acestei matrici crește exponențial, ceea ce poate deveni o problemă semnificativă pentru rețelele neuronale mari sau pentru seturile de date extinse.

În practică, acest lucru înseamnă că Levenberg-Marquardt este cel mai potrivit pentru rețele neuronale de dimensiuni medii sau mici, unde numărul de parametri nu este exorbitant. Pentru rețele foarte mari, cum ar fi cele utilizate în procesarea limbajului natural sau viziunea computerizată, cerințele de memorie ar putea face acest algoritm impracticabil, chiar dacă ar oferi o viteză de antrenare teoretică superioară. În aceste scenarii, algoritmi precum Adam sau RMSprop, care necesită mult mai puțină memorie, sunt de obicei preferați, chiar dacă pot necesita mai multe epoci de antrenament.

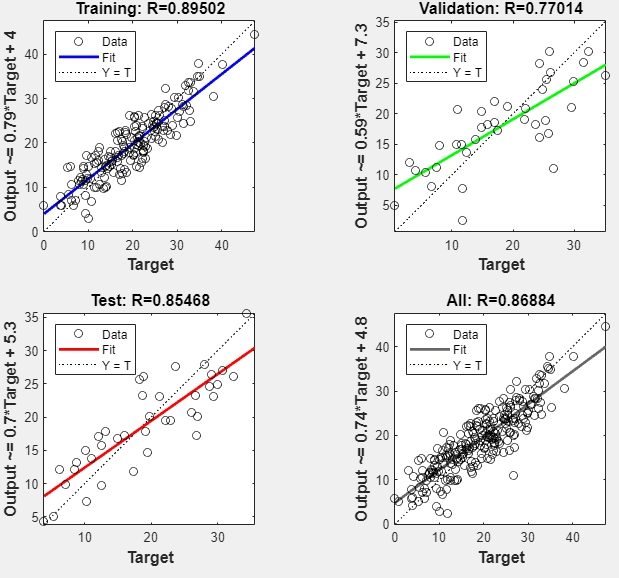

Implementarea Levenberg-Marquardt: Funcția trainlm

Multe medii de dezvoltare și biblioteci de machine learning oferă implementări ale algoritmului Levenberg-Marquardt. De exemplu, în ecosistemul MATLAB, funcția trainlm este utilizată specific pentru a implementa acest algoritm pentru antrenarea rețelelor neuronale. Această funcție abstractizează complexitatea matematică subiacentă, permițând dezvoltatorilor să aplice algoritmul cu ușurință, concentrându-se mai degrabă pe arhitectura rețelei și pe pregătirea datelor.

Utilizarea unei funcții dedicate precum trainlm simplifică procesul de antrenare, dar este crucial să înțelegem principiile de bază ale algoritmului. Aceasta include conștientizarea compromisului viteză-memorie și a modului în care alegerea algoritmului de antrenament poate afecta performanța generală a modelului.

Comparație Generală a Algoritmilor de Antrenare

Pentru a pune în perspectivă Levenberg-Marquardt, iată o scurtă comparație cu alte categorii de algoritmi:

| Caracteristică | Levenberg-Marquardt (LM) | Algoritmi bazati pe Gradient Descendent (e.g., Adam, SGD) |

|---|---|---|

| Viteză de Convergență | Foarte rapidă, în special pentru rețele mici-medii. | Moderată spre lentă, poate necesita multe epoci. |

| Cerințe de Memorie | Mari (necesită stocarea matricilor Jacobian/Hessian). | Mici (stochează doar gradientul și eventual momente). |

| Complexitate de Implementare | Mai complexă matematic, dar adesea abstractizată în biblioteci. | Relativ simplă. |

| Scalabilitate | Limitată pentru rețele foarte mari din cauza memoriei. | Excelentă, ideală pentru rețele mari și seturi de date masive. |

| Sensibilitate la Parametri | Mai puțin sensibil la rata de învățare inițială. | Foarte sensibilă la rata de învățare și alți hiperparametri. |

Întrebări Frecvente (FAQ)

1. Ce înseamnă "a antrena" o rețea neuronală?

Antrenarea unei rețele neuronale înseamnă ajustarea ponderilor și biasurilor acesteia (parametrii interni) pe baza unui set de date de antrenament. Scopul este ca rețeaua să învețe modele și relații din date, astfel încât să poată face predicții precise sau să clasifice corect date noi, nevăzute. Procesul este iterativ și implică minimizarea unei funcții de eroare.

2. De ce este Levenberg-Marquardt considerat un algoritm rapid?

Levenberg-Marquardt este rapid deoarece combină avantajele metodei Gauss-Newton (care utilizează informații despre curbura suprafeței de eroare pentru a face pași mari și eficienți) cu cele ale gradientului descendent (care oferă stabilitate când soluția este departe). Această abordare hibridă îi permite să converge rapid către un minim, în special pentru problemele de regresie non-lineară și rețele neuronale de dimensiuni adecvate.

3. Când ar trebui să folosesc algoritmul Levenberg-Marquardt?

Ar trebui să luați în considerare utilizarea Levenberg-Marquardt atunci când lucrați cu rețele neuronale de dimensiuni mici spre medii și când viteza de antrenare este o prioritate. Este deosebit de eficient pentru problemele de tip regresie. Este mai puțin potrivit pentru rețele foarte mari sau pentru seturi de date masive, unde cerințele de memorie pot deveni prohibitive.

4. Există alternative la Levenberg-Marquardt?

Da, există numeroase alternative. Cele mai comune sunt algoritmii bazați pe gradient descendent, cum ar fi Stochastic Gradient Descent (SGD), Adam, RMSprop, Adagrad, Adadelta. Acești algoritmi sunt mai puțin intenși din punct de vedere al memoriei și sunt preferați pentru rețele neuronale mari și deep learning, deși pot necesita mai mult timp pentru a converge.

5. Ce impact are memoria asupra alegerii algoritmului de antrenare?

Impactul memoriei este crucial. Algoritmi precum Levenberg-Marquardt necesită stocarea unor matrici mari (cum ar fi Jacobianul sau aproximarea Hessianului), a căror dimensiune crește exponențial cu numărul de parametri ai rețelei. Pentru rețele cu milioane sau miliarde de parametri, cerințele de memorie ale LM pot depăși capacitatea RAM disponibilă, făcându-l impracticabil. În astfel de cazuri, algoritmii cu cerințe reduse de memorie devin singura opțiune viabilă.

Concluzie

Alegerea algoritmului potrivit pentru antrenarea unei rețele neuronale este o decizie critică, influențată de o multitudine de factori, inclusiv dimensiunea rețelei, volumul datelor și resursele computaționale disponibile. Levenberg-Marquardt se distinge prin viteza sa remarcabilă, fiind o opțiune excelentă pentru anumite scenarii. Cu toate acestea, conștientizarea cerințelor sale de memorie este esențială pentru a evita blocajele de performanță. Înțelegerea profundă a modului în care acești algoritmi funcționează ne permite să construim modele de inteligență artificială mai robuste, mai rapide și mai eficiente, deschizând calea către inovații continue în diverse domenii. Fie că ești un cercetător experimentat sau un entuziast al AI-ului, explorarea și experimentarea cu diferiți algoritmi de antrenare îți va oferi o perspectivă valoroasă asupra artei și științei învățării automate.

Dacă vrei să descoperi și alte articole similare cu Antrenarea Rețelelor Neuronale: Viteza Levenberg-Marquardt, poți vizita categoria Fitness.