29/02/2024

Rețelele neurale au reprezentat dintotdeauna un subiect fascinant în lumea învățării automate, nu doar datorită algoritmului elegant de backpropagation, ci și prin complexitatea și structura lor inspirată de creierul uman. Deși nu au fost mereu în centrul atenției, fiind considerate uneori costisitoare din punct de vedere computațional sau depășite de metode mai simple precum mașinile cu vectori de suport (SVM), rețelele neurale au revenit în forță, devenind instrumente indispensabile în multe domenii. Ele sunt acum la baza multor inovații, de la recunoașterea facială la vehiculele autonome. În acest articol, vom explora cum să antrenăm o rețea neurală superficială pentru a se potrivi cu datele, comparând performanța acesteia cu un model liniar și oferind un ghid practic pentru optimizare – metaforic vorbind, cum să-ți pui modelul în „formă maximă” pentru a performa impecabil.

- Ce Este o Rețea Neurală Superficială și De Ce Contează?

- Pregătirea Datelor: Fundamentul Succesului

- Configurarea și Antrenarea Rețelei Neurale

- Evaluarea Performanței și Validarea Modelului

- Validare Încrucișată: Consolidarea Încrederii

- Considerații Finale și Interpretarea "Cutiei Negre"

- Întrebări Frecvente (FAQ)

Ce Este o Rețea Neurală Superficială și De Ce Contează?

O rețea neurală superficială (sau "shallow neural network") este un tip de rețea neurală artificială care conține un singur strat ascuns între stratul de intrare (unde sunt introduse datele) și cel de ieșire (unde se obțin predicțiile). Această structură, deși mai simplă decât rețelele neurale profunde (care au multiple straturi ascunse), este surprinzător de puternică și capabilă să învețe pattern-uri complexe în date. Importanța lor derivă din capacitatea de a modela relații neliniare, adesea dificil de capturat cu modele statistice tradiționale.

Imaginați-vă că aveți un set de date despre valori imobiliare, cum ar fi prețul unei case în funcție de numărul de camere, suprafață, locație și alți factori. Un model liniar ar încerca să găsească o relație directă, proporțională. O rețea neurală, chiar și una superficială, poate descoperi interacțiuni subtile și neliniare între acești factori, oferind predicții mult mai precise. Teorema de aproximare universală sugerează că o rețea neurală cu un singur strat ascuns și un număr suficient de neuroni poate aproxima orice funcție continuă, ceea ce le conferă o putere remarcabilă în modelarea datelor.

Pregătirea Datelor: Fundamentul Succesului

Înainte de a ne arunca în antrenarea rețelei, pregătirea datelor este un pas absolut critic. Neglijarea acestuia poate duce la rezultate inutile sau la un proces de antrenament extrem de dificil, în care algoritmul pur și simplu nu converge, irosind timp și resurse computaționale.

Verificarea și Curățarea Datelor

Primul pas este să ne asigurăm că nu există valori lipsă în setul de date. Acestea pot perturba serios procesul de antrenament. Dacă există, ele trebuie gestionate corespunzător – fie prin eliminarea rândurilor/coloanelor afectate (dacă numărul lor este mic), fie prin imputare (înlocuirea valorilor lipsă cu estimări, cum ar fi media, mediana sau o valoare prezisă de un alt model). Un set de date curat și complet este esențial pentru stabilitatea și acuratețea procesului de antrenament.

Împărțirea Datelor: Antrenament și Testare

Pentru a evalua corect performanța modelului nostru pe date noi, trebuie să împărțim setul de date într-un set de antrenament (folosit pentru a învăța modelul) și un set de testare (folosit pentru a evalua cât de bine generalizează modelul pe date nevăzute). O împărțire tipică este 75% pentru antrenament și 25% pentru testare, dar aceasta poate varia în funcție de mărimea totală a setului de date și de complexitatea problemei. Este crucial ca această împărțire să se facă aleatoriu, pentru a asigura că ambele seturi sunt reprezentative pentru populația generală de date.

Normalizarea Datelor: Un Pas Indispensabil

Acesta este, probabil, cel mai important pas premergător antrenării. Rețelele neurale sunt extrem de sensibile la scara datelor. Dacă variabilele de intrare au scale foarte diferite (de exemplu, vârsta între 0-100 și venitul între 10.000-1.000.000), neuronii cu intrări mai mari vor domina procesul de învățare, iar algoritmul de optimizare (cum ar fi gradient descent) va avea dificultăți în a găsi minimul global al funcției de cost. Fără normalizarea datelor, procesul de antrenament poate fi lent, instabil sau chiar imposibil de realizat.

Normalizarea datelor aduce toate valorile într-un interval standardizat, de obicei [0,1] (folosind scalarea min-max) sau [-1,1]. Metoda min-max este des utilizată pentru scalarea datelor în intervalul [0,1], transformând fiecare valoare după formula: (x - min(x)) / (max(x) - min(x)). Această transformare asigură că toate caracteristicile, indiferent de unitatea lor de măsură inițială, contribuie echitabil la procesul de învățare al rețelei.

De exemplu, dacă antrenați o rețea neurală pentru a prezice prețul unei case folosind două caracteristici: numărul de băi (între 1 și 5) și suprafața (între 50 și 500 mp). Fără normalizare, schimbările în suprafață ar avea un impact mult mai mare asupra ponderilor rețelei decât schimbările în numărul de băi, chiar dacă ambele sunt la fel de importante pentru preț. Normalizarea asigură că toate caracteristicile contribuie echitabil la procesul de învățare, permițând algoritmului să găsească ponderi optime mai eficient.

Configurarea și Antrenarea Rețelei Neurale

După ce datele sunt pregătite, putem trece la configurarea rețelei. Nu există o regulă fixă privind numărul de straturi ascunse sau de neuroni, dar există câteva "reguli de bază" și, mai ales, necesitatea experimentării.

Arhitectura Rețelei: Straturi și Neuroni

Pentru majoritatea aplicațiilor, un singur strat ascuns este adesea suficient pentru o rețea neurală superficială. Numărul de neuroni din acest strat ar trebui să fie de obicei între dimensiunea stratului de intrare și cea a stratului de ieșire. O regulă des întâlnită sugerează 2/3 din dimensiunea intrării plus dimensiunea ieșirii. Totuși, testarea repetată și ajustarea fină sunt cele mai bune soluții pentru a găsi configurația optimă pentru modelul dvs. Un număr prea mic de neuroni poate duce la underfitting (modelul este prea simplu pentru a captura complexitatea datelor), în timp ce un număr prea mare poate duce la overfitting (modelul memorează datele de antrenament și generalizează slab pe date noi).

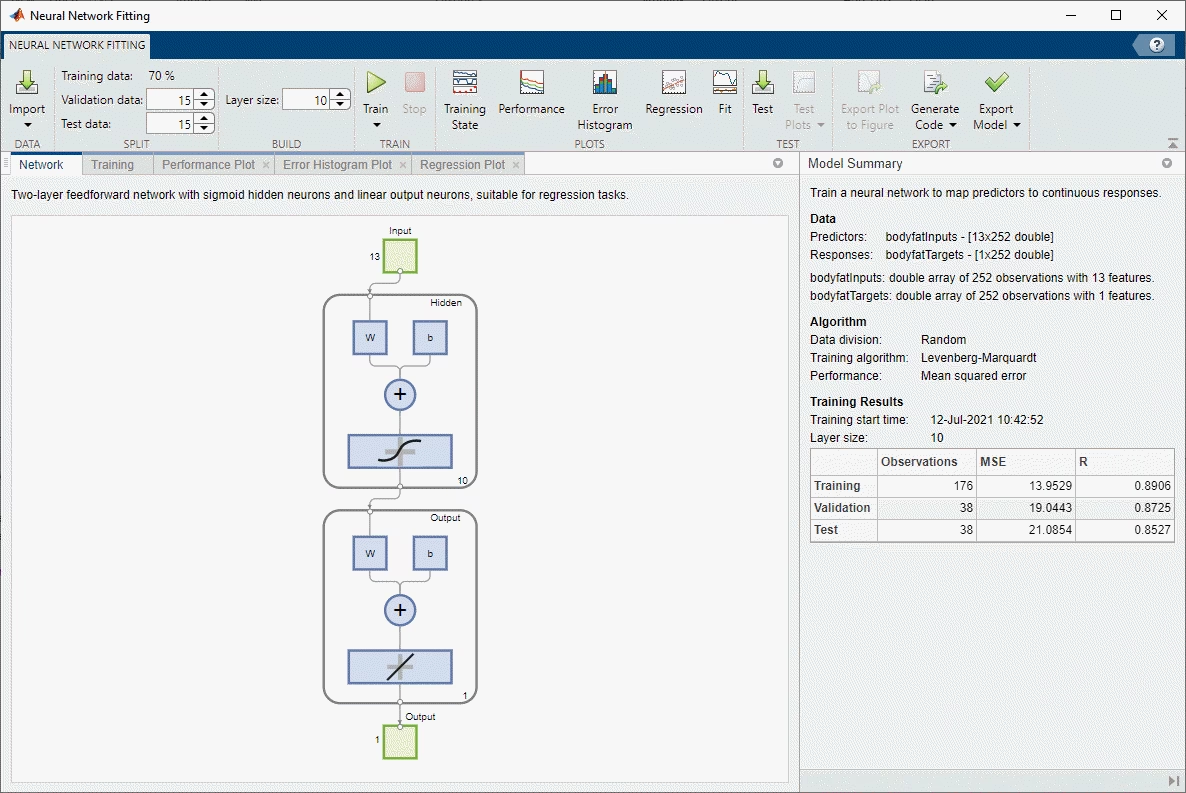

Pentru exemplul nostru, care implică un set de date cu 13 caracteristici de intrare și o singură ieșire (valoarea mediană a locuinței), o configurație tipică ar putea fi: 13 neuroni în stratul de intrare, două straturi ascunse (cu 5 și 3 neuroni, respectiv, pentru a testa o configurație mai complexă) și un singur neuron în stratul de ieșire (pentru regresie).

Antrenarea Efectivă

În R, pachetul neuralnet este o opțiune excelentă pentru antrenarea rețelelor neurale superficiale. Iată cum ar putea arăta procesul:

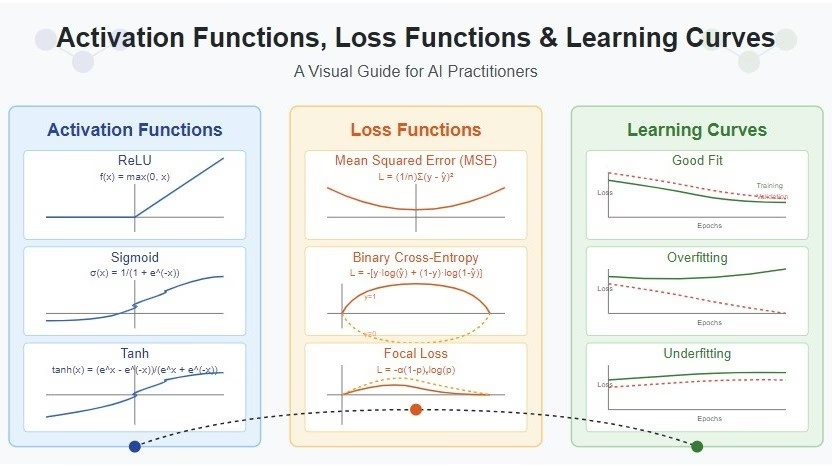

library(neuralnet) # Presupunem ca 'scaled_data' este setul de date normalizat # si 'train_' si 'test_' sunt seturile de antrenament/test # Construim formula pentru model n <- names(train_) f <- as.formula(paste("medv ~", paste(n[!n %in% "medv"], collapse = " + "))) # Antrenam reteaua neurala nn <- neuralnet(f, data = train_, hidden = c(5,3), linear.output = TRUE) # 'linear.output = TRUE' este crucial pentru probleme de regresie, # indicand ca stratul de iesire ar trebui sa produca o valoare continua. Algoritmul de antrenament, adesea o variantă a gradientului descendent (cum ar fi Levenberg-Marquardt), ajustează ponderile și bias-urile conexiunilor dintre neuroni pentru a minimiza o funcție de cost (eroarea dintre predicțiile rețelei și valorile reale). Procesul este iterativ și se oprește când eroarea nu mai scade semnificativ sau când se atinge un număr maxim de iterații.

Pachetul neuralnet oferă, de asemenea, o funcție utilă pentru vizualizarea rețelei antrenate (plot(nn)), arătând conexiunile, ponderile și termenii de bias. Această vizualizare este utilă pentru a înțelege structura, chiar dacă rețelele neurale rămân adesea o cutie neagră în ceea ce privește interpretarea exactă a deciziilor lor.

Evaluarea Performanței și Validarea Modelului

Antrenarea unei rețele este doar jumătate din ecuație. Trebuie să știm cât de bine funcționează modelul nostru pe date noi, nevăzute.

Realizarea Predicțiilor și Denormalizarea

După antrenare, rețeaua va produce predicții normalizate (în intervalul [0,1], de exemplu). Este esențial să le denormalizăm înapoi la scara originală a datelor pentru a face comparații semnificative și a înțelege rezultatele în contextul problemei reale.

pr.nn <- compute(nn, test_[, 1:13]) # Presupunem 13 caracteristici de intrare # Denormalizarea predictiilor si a valorilor reale din setul de testare pr.nn_denormalized <- pr.nn$net.result * (max(data$medv) - min(data$medv)) + min(data$medv) test.r_denormalized <- (test_$medv) * (max(data$medv) - min(data$medv)) + min(data$medv) Măsurarea Erorii: Eroarea Pătratică Medie (MSE)

Pentru problemele de regresie, eroarea pătratică medie (MSE) este o metrică comună pentru a măsura diferența dintre valorile prezise și cele reale. Un MSE mai mic indică o performanță mai bună a modelului.

MSE.nn <- sum((test.r_denormalized - pr.nn_denormalized)^2) / nrow(test_) În exemplul nostru, o rețea neurală a obținut un MSE de aproximativ 10.15, comparativ cu un model liniar care a avut un MSE de 21.63. Aceasta sugerează o performanță superioară a rețelei neurale, dar acest rezultat depinde foarte mult de împărțirea specifică a datelor antrenament-test.

Vizualizarea Performanței

Graficele pot oferi o perspectivă rapidă și intuitivă asupra performanței modelului. Plotarea valorilor reale (pe axa X) față de cele prezise (pe axa Y), cu o linie ideală de 45 de grade (unde Y=X), ne arată cât de bine se potrivesc predicțiile modelului cu realitatea. Cu cât punctele sunt mai aproape de această linie, cu atât modelul este mai precis. De asemenea, se pot suprapune predicțiile de la diferite modele pentru o comparație vizuală directă.

# Exemplu de plot simplu pentru comparatie: plot(test$medv, pr.nn_denormalized, col='red', main='Real vs. Prezise (NN vs LM)', pch=18, cex=0.7) points(test$medv, pr.lm, col='blue', pch=18, cex=0.7) # pr.lm = predictii model liniar abline(0,1,lwd=2) # Linie ideala Y=X legend('bottomright', legend=c('NN','LM'), pch=18, col=c('red','blue')) Validare Încrucișată: Consolidarea Încrederii

Pentru a obține o estimare mai robustă și mai fiabilă a performanței modelului și pentru a reduce dependența de o singură împărțire antrenament-test, folosim validarea încrucișată. Aceasta implică repetarea procesului de împărțire, antrenare și testare de mai multe ori (de exemplu, de 10 ori pentru validare încrucișată k-fold), calculând eroarea de predicție de fiecare dată și apoi făcând media acestor erori. Această metodă oferă o imagine mai clară a modului în care modelul va performa pe date noi, variate.

Un exemplu de validare încrucișată cu 10 folduri pentru rețeaua neurală (deoarece majoritatea pachetelor nu au o funcție încorporată pentru aceasta, se implementează manual printr-o buclă) ar putea arăta o medie a MSE-ului de aproximativ 9.41, mult mai bună decât 23.83 pentru modelul liniar. Variația observată în rezultatele validării încrucișate pentru rețelele neurale poate fi atribuită inițializării aleatorii a ponderilor și specificului împărțirii datelor la fiecare iterație, subliniind importanța rulării multiple a procesului.

Comparație Sumară: Rețea Neurală vs. Model Liniar

Pentru a rezuma avantajele și dezavantajele, iată o scurtă comparație:

| Caracteristică | Model Liniar (LM) | Rețea Neurală Superficială (NN) |

|---|---|---|

| Complexitate Model | Simplu, capabil să modeleze doar relații liniare | Complex, capabil să modeleze relații neliniare |

| Preprocesare Date | Relativ mai puțin strictă (dar utilă) | Foarte strictă (normalizarea datelor esențială) |

| Interpretabilitate | Ridicată, ușor de înțeles cum influențează fiecare caracteristică rezultatul | Scăzută (adesea considerată o "cutie neagră") |

| Performanță (MSE Exemplu CV) | ~23.83 | ~9.41 |

| Cerințe Computaționale | Reduse, antrenare rapidă | Medii spre ridicate (depinde de mărimea rețelei și a datelor) |

| Nevoie de Date | Mai puțin intensivă, poate funcționa bine cu seturi de date mai mici | Mai intensivă (necesită mai multe date pentru antrenare robustă și generalizare) |

Considerații Finale și Interpretarea "Cutiei Negre"

Deși rețelele neurale sunt instrumente puternice, ele seamănă adesea cu o cutie neagră: este mult mai dificil să explici de ce au luat o anumită decizie decât în cazul modelelor mai simple, cum ar fi regresia liniară. Această lipsă de interpretabilitate poate fi un dezavantaj în anumite aplicații unde transparența modelului este crucială (de exemplu, în medicină, finanțe sau sisteme juridice). Totuși, progresele recente în domeniul "AI explicabile" (XAI) încep să ofere metode pentru a arunca o lumină în interiorul acestei cutii negre.

De asemenea, așa cum am văzut, antrenarea unei rețele neurale necesită o atenție deosebită la preprocesarea datelor și la ajustarea parametrilor (numărul de straturi, neuroni, funcții de activare, rata de învățare etc.). Mici modificări pot duce la rezultate semnificativ diferite. Prin urmare, o abordare iterativă, experimentală și bazată pe validare încrucișată este cheia succesului în construirea unor modele robuste și performante.

Întrebări Frecvente (FAQ)

- Ce este o rețea neurală superficială?

- Este o rețea neurală artificială cu un singur strat ascuns între stratul de intrare și cel de ieșire. Este capabilă să învețe relații complexe și neliniare în date.

- De ce este crucială normalizarea datelor?

- Normalizarea datelor scalează valorile datelor într-un interval standardizat (ex. [0,1]), asigurând că toate caracteristicile contribuie echitabil la procesul de învățare și ajutând algoritmul de antrenament să converge eficient și rapid.

- Câți neuroni ar trebui să folosesc într-un strat ascuns?

- Nu există o regulă strictă. O regulă generală sugerează un număr de neuroni între dimensiunea intrării și a ieșirii, adesea 2/3 din dimensiunea intrării. Cea mai bună abordare este experimentarea și validarea încrucișată pentru a găsi echilibrul între sub- și supra-învățare.

- Este o rețea neurală întotdeauna mai bună decât un model liniar?

- Nu neapărat. Rețelele neurale excelează în capturarea relațiilor neliniare, dar sunt mai complexe și necesită mai multe date și putere de calcul. Pentru relații liniare simple sau seturi de date mici, un model liniar poate fi suficient, mai eficient computațional și mai ușor de interpretat.

- Ce înseamnă că o rețea neurală este o "cutie neagră"?

- Înseamnă că, deși rețeaua poate produce predicții precise, este dificil de înțeles exact cum a ajuns la acele predicții sau de a interpreta logic ponderile și bias-urile interne. Procesul său decizional este opac pentru observatorul uman, spre deosebire de modelele liniare unde contribuția fiecărei variabile este explicită.

Sperăm că acest ghid v-a oferit o perspectivă clară asupra modului de a antrena o rețea neurală superficială pentru a se potrivi cu datele dumneavoastră. Cu o pregătire adecvată a datelor și o configurare atentă, veți putea debloca potențialul acestor modele fascinante și veți obține predicții de o precizie remarcabilă, aducând performanța modelelor dumneavoastră la un nivel superior!

Dacă vrei să descoperi și alte articole similare cu Antrenează-ți Rețeaua Neurală: Ghid Complet, poți vizita categoria Fitness.