02/10/2024

Ați observat vreodată că un model de Machine Learning pe care l-ați antrenat se comportă impecabil pe datele de antrenament, dar eșuează lamentabil atunci când este confruntat cu date noi, nevăzute? Sau, poate, v-ați întrebat de ce un model simplu poate uneori să depășească performanța unui model mult mai complex? Răspunsurile la aceste întrebări fundamentale din lumea inteligenței artificiale se regăsesc în înțelegerea a două concepte cruciale: bias-ul și varianța. Acestea formează piatra de temelie a performanței oricărui model de învățare automată, dictând capacitatea acestuia de a generaliza, adică de a face predicții corecte pe date noi, nu doar pe cele pe care a fost antrenat.

Fiecare decizie de modelare, de la alegerea algoritmului până la ajustarea hiperparametrilor, influențează direct nivelurile de bias și varianță ale modelului. Înțelegerea profundă a acestor concepte nu este doar o chestiune teoretică, ci o abilitate practică esențială pentru oricine dorește să construiască sisteme de inteligență artificială robuste și eficiente, capabile să aducă valoare reală în scenarii din lumea reală. Acest ghid detaliat vă va purta prin definițiile, implicațiile și strategiile de gestionare ale bias-ului și varianței, oferindu-vă instrumentele necesare pentru a optimiza performanța modelelor dumneavoastră.

- Ce Este Bias-ul (Eroarea de Sistem)?

- Ce Este Varianța (Eroarea de Aleatoriu)?

- Compromisul Bias-Varianță (Bias-Variance Tradeoff)

- Complexitatea Modelului și Relația cu Bias-ul și Varianța

- Diagnosticarea Bias-ului și a Varianței

- Strategii de Remediere

- Întrebări Frecvente (FAQ)

- 1. Ce este mai rău, biasul ridicat sau varianța ridicată?

- 2. Cum aleg între bias și varianță atunci când optimizez un model?

- 3. Regularizarea ajută la reducerea biasului sau a varianței?

- 4. De ce adăugarea mai multor date ajută la varianța ridicată, dar nu și la biasul ridicat?

- 5. Este posibil să ai atât bias, cât și varianță ridicată?

- Concluzie

Ce Este Bias-ul (Eroarea de Sistem)?

Bias-ul, sau eroarea de sistem, reprezintă cât de departe sunt predicțiile modelului nostru de valorile reale, în medie. Gândiți-vă la bias ca la tendința modelului de a rata în mod constant ținta într-un mod specific. Un bias ridicat indică faptul că modelul a făcut presupuneri prea puternice sau prea simpliste despre relația dintre caracteristici și rezultate. Practic, modelul nu a reușit să capteze complexitatea inerentă a datelor.

Caracteristici ale Bias-ului Ridicat:

- Model supra-simplificat: Algoritmul este prea rudimentar pentru a învăța tiparele complexe din date. De exemplu, încercarea de a modela o relație neliniară cu o regresie liniară.

- Presupuneri puternice despre date: Modelul își bazează deciziile pe ipoteze prea restrictive, ignorând detalii importante.

- Eroare similară pe seturile de antrenament și testare: Atât pe datele pe care le-a văzut, cât și pe cele noi, modelul performează la fel de slab, indicând o problemă fundamentală în capacitatea sa de a învăța.

- Performanță generală slabă: Indiferent de setul de date, predicțiile sunt imprecise.

- Fenomenul de sub-adaptare (Underfitting): Un model cu bias ridicat este adesea un model sub-adaptare. Acest lucru înseamnă că modelul nu a învățat suficient de bine din datele de antrenament și nu poate generaliza nici măcar pe acestea, cu atât mai puțin pe date noi. El este "prea simplu" pentru a înțelege complexitatea informației.

Imaginați-vă un arcaș care trage întotdeauna săgețile într-un anumit punct, departe de centrul țintei. Chiar dacă își repetă acțiunea, săgețile vor ateriza mereu în jurul acelui punct greșit. Acesta este bias-ul: o eroare sistematică, repetitivă, care indică o înțelegere fundamental greșită sau incompletă a problemei.

Ce Este Varianța (Eroarea de Aleatoriu)?

Varianța măsoară cât de mult variază predicțiile modelului nostru pentru seturi de antrenament diferite. O varianță ridicată înseamnă că modelul este prea sensibil la mici fluctuații sau zgomot în datele de antrenament. În loc să învețe tiparele generale, modelul "memorează" detaliile specifice ale setului de antrenament, inclusiv zgomotul aleatoriu.

Caracteristici ale Varianței Ridicate:

- Model prea complex: Modelul este capabil să se adapteze perfect la orice detaliu, oricât de nesemnificativ, din datele de antrenament.

- Captează zgomotul din datele de antrenament: În loc să identifice tendințele esențiale, modelul încorporează erorile aleatorii și excepțiile specifice setului de antrenament.

- Eroare scăzută pe setul de antrenament, dar eroare ridicată pe setul de validare/testare: Aceasta este o caracteristică definitorie. Modelul performează aproape perfect pe datele pe care le-a văzut, dar se prăbușește pe datele noi.

- Performanță slabă la generalizare: Modelul nu poate aplica cunoștințele învățate la date nevăzute, deoarece a învățat prea mult din specificul datelor de antrenament.

- Fenomenul de supra-adaptare (Overfitting): Un model cu varianță ridicată este un model supra-adaptare. Acest lucru înseamnă că modelul a învățat "prea mult" din datele de antrenament, memorând zgomotul și specificitățile acestora, în detrimentul capacității de a identifica tipare generale. Este ca și cum ar fi "fotografiat" datele de antrenament, în loc să le "înțeleagă".

Revenind la exemplul arcașului, un arcaș cu varianță ridicată ar trage săgețile împrăștiate pe toată ținta. De fiecare dată când trage, săgeata aterizează într-un loc complet diferit, chiar dacă încearcă să lovească centrul. Aceasta este varianța: o lipsă de consistență, o sensibilitate extremă la mici schimbări în condiții, care duce la rezultate imprevizibile.

Compromisul Bias-Varianță (Bias-Variance Tradeoff)

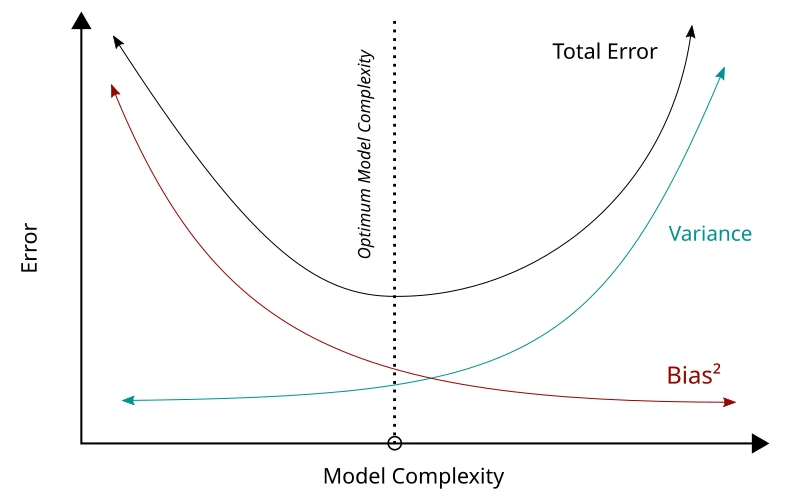

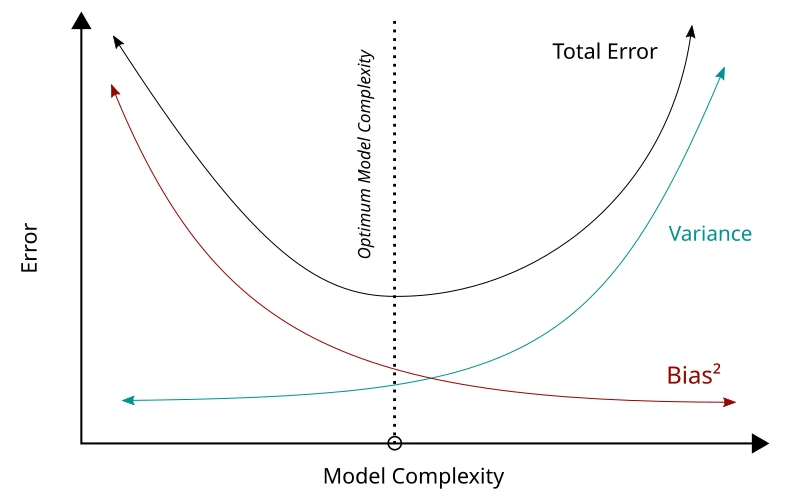

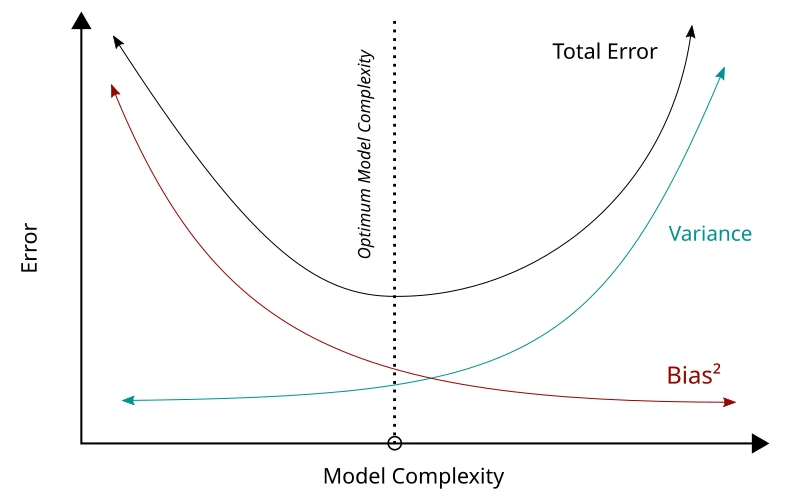

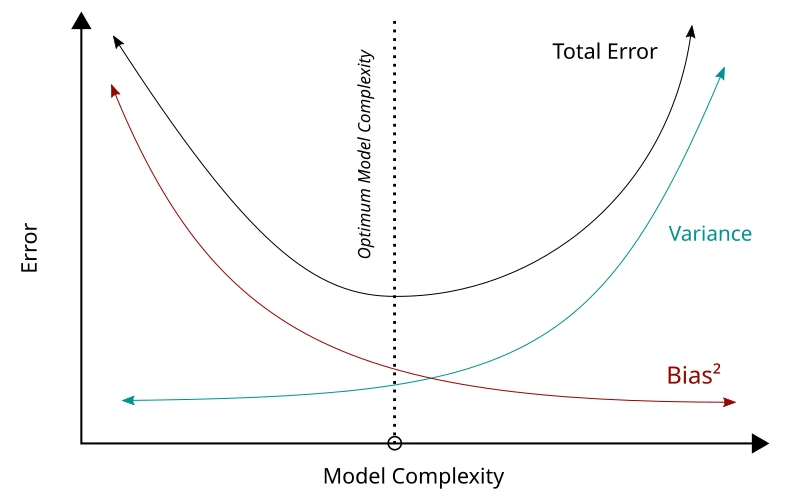

Compromisul bias-varianță este un act de echilibru constant între a face modelul nostru suficient de simplu pentru a învăța tipare generale (reducând varianța) și suficient de complex pentru a capta tipare importante (reducând bias-ul). Este imposibil să le minimizăm pe amândouă simultan. Reducerea bias-ului tinde să crească varianța, și invers.

Eroarea totală de predicție a unui model poate fi descompusă în trei componente principale:

- Bias2: Eroarea cauzată de presupunerile simplificatoare ale modelului.

- Varianță: Eroarea cauzată de sensibilitatea modelului la fluctuațiile din datele de antrenament.

- Eroarea ireductibilă (Zgomot): Aceasta este eroarea intrinsecă a datelor în sine, care nu poate fi redusă de niciun model.

Eroare Totală = Bias2 + Varianță + Zgomot Irreductibil

Obiectivul nostru este să găsim un model care să minimizeze suma biasului și a varianței, apropiindu-ne cât mai mult de eroarea ireductibilă. Acest punct "dulce" reprezintă echilibrul optim pentru performanța generalizată a modelului.

Complexitatea Modelului și Relația cu Bias-ul și Varianța

Complexitatea modelului joacă un rol central în acest compromis. Un model complex are mai mulți parametri sau o structură mai flexibilă, permițându-i să învețe relații mai nuanțate din date. Un model simplu are mai puțini parametri și face presupuneri mai stricte.

- Modele simple (Complexitate scăzută): Acestea tind să aibă un bias ridicat și o varianță scăzută. Nu sunt suficient de flexibile pentru a capta toate tiparele relevante, ducând la sub-adaptare. Pe de altă parte, deoarece fac presupuneri puternice, ele nu sunt influențate semnificativ de mici schimbări în datele de antrenament, având o varianță redusă.

- Modele complexe (Complexitate ridicată): Acestea tind să aibă un bias scăzut și o varianță ridicată. Sunt foarte flexibile și pot învăța chiar și cele mai mici detalii și zgomote din datele de antrenament, ducând la supra-adaptare. Însă, tocmai această flexibilitate le face extrem de sensibile la variațiile din seturile de antrenament, rezultând o varianță mare.

Tabel comparativ: Complexitatea Modelului vs. Bias și Varianță

| Caracteristică | Model Simplu (Complexitate Scăzută) | Model Complex (Complexitate Ridicată) |

|---|---|---|

| Bias | Ridicat (Sub-adaptare) | Scăzut |

| Varianță | Scăzută | Ridicată (Supra-adaptare) |

| Performanță pe antrenament | Slabă | Excelentă |

| Performanță pe testare | Slabă | Slabă |

| Capacitate de generalizare | Slabă | Slabă |

| Exemple | Regresie liniară simplă pentru date neliniare, arbori de decizie cu adâncime mică | Rețele neuronale adânci, arbori de decizie cu adâncime mare, modele polinomiale de grad înalt |

Diagnosticarea Bias-ului și a Varianței

Înțelegerea teoretică este un prim pas, dar cum identificăm aceste probleme în modelele noastre reale? Există instrumente și tehnici vizuale esențiale.

Curbele de Învățare (Learning Curves)

Curbele de învățare trasează performanța modelului (eroarea sau scorul) pe seturile de antrenament și de validare (sau testare) în funcție de numărul de exemple de antrenament. Acestea oferă indicii prețioase despre prezența biasului sau a varianței ridicate.

- Curbe pentru Bias Ridicat (Sub-adaptare):

- Atât eroarea de antrenament, cât și eroarea de validare sunt ridicate și converg rapid la o valoare similară, chiar și cu un număr mare de exemple de antrenament.

- Un decalaj mic sau inexistent între cele două curbe.

- Adăugarea mai multor date de antrenament nu va îmbunătăți semnificativ performanța modelului, deoarece problema este fundamentală (modelul este prea simplu).

- Curbe pentru Varianță Ridicată (Supra-adaptare):

- Eroarea de antrenament este foarte scăzută, în timp ce eroarea de validare este semnificativ mai mare.

- Există un decalaj mare între cele două curbe.

- Pe măsură ce numărul de exemple de antrenament crește, eroarea de validare tinde să scadă, iar decalajul dintre curbe se micșorează. Adăugarea de mai multe date este o soluție viabilă în acest caz.

Curbele de Validare (Validation Curves)

Curbele de validare sunt similare cu curbele de învățare, dar ele trasează scorul sau eroarea modelului în funcție de un singur hiperparametru al modelului (e.g., gradul unui polinom, parametrul de regularizare, numărul de estimatori într-un ansamblu). Ele ne ajută să găsim valoarea optimă a acelui hiperparametru.

- Pentru bias ridicat: La valori scăzute ale complexității (e.g., grad mic al polinomului), atât scorul de antrenament, cât și cel de validare sunt scăzute (eroare mare).

- Pentru varianță ridicată: La valori ridicate ale complexității, scorul de antrenament este foarte mare (eroare mică), în timp ce scorul de validare este semnificativ mai mic (eroare mare).

- Curba de validare ne ajută să identificăm punctul de echilibru unde scorul de validare este maxim (eroarea minimă), indicând complexitatea optimă a modelului.

Strategii de Remediere

Odată ce am diagnosticat dacă modelul nostru suferă de bias ridicat sau varianță ridicată, putem aplica strategii specifice pentru a remedia situația.

Pentru Bias Ridicat (Sub-adaptare):

- Creșteți complexitatea modelului:

- Utilizați un algoritm mai sofisticat (e.g., treceți de la regresie liniară la un arbore de decizie, rețele neuronale sau metode de ansamblu).

- Adăugați mai multe caracteristici (features) relevante datelor.

- Dacă utilizați modele polinomiale, creșteți gradul polinomului.

- Adăugați mai multe straturi sau neuroni într-o rețea neuronală.

- Reduceți regularizarea: Regularizarea penalizează complexitatea. Dacă este prea agresivă, poate duce la sub-adaptare. Scăderea intensității regularizării poate permite modelului să învețe mai mult.

- Modificați arhitectura modelului: Pentru rețele neuronale, experimentați cu diferite arhitecturi.

Pentru Varianță Ridicată (Supra-adaptare):

- Colectați mai multe date de antrenament: Aceasta este adesea cea mai eficientă soluție. Mai multe date ajută modelul să învețe tipare mai generale și să reducă impactul zgomotului specific.

- Reduceți complexitatea modelului:

- Utilizați un algoritm mai simplu.

- Reduceți numărul de caracteristici (selecție de caracteristici).

- Dacă utilizați modele polinomiale, reduceți gradul polinomului.

- Reduceți numărul de straturi sau neuroni într-o rețea neuronală.

- Pruning pentru arborii de decizie.

- Creșteți regularizarea: Regularizarea (L1, L2, Dropout etc.) adaugă o penalizare la funcția de cost a modelului, descurajând coeficienții mari și simplificând modelul, forțându-l să se concentreze pe tiparele mai importante. Acest lucru ajută la prevenirea supra-adaptării.

- Utilizați metode de ansamblu (Ensemble methods):

- Bagging (e.g., RandomForest): Antrenează mai multe modele pe subseturi diferite de date și combină predicțiile. Ajută la reducerea varianței.

- Boosting (e.g., Gradient Boosting, XGBoost): Construiește modele secvențial, fiecare corectând erorile predecesorului. Poate reduce biasul și varianța.

- Reducerea dimensionalității: Tehnici precum PCA (Analiza Componentelor Principale) pot reduce numărul de caracteristici, simplificând modelul.

Întrebări Frecvente (FAQ)

1. Ce este mai rău, biasul ridicat sau varianța ridicată?

Niciunul nu este intrinsec "mai rău". Ambele duc la o performanță slabă a modelului. Obiectivul este să găsim un echilibru. Un model cu bias ridicat este fundamental greșit, în timp ce un model cu varianță ridicată este prea flexibil și fragil.

2. Cum aleg între bias și varianță atunci când optimizez un model?

Nu alegeți între ele, ci căutați compromisul optim. Utilizați curbele de învățare și de validare pentru a înțelege unde se află modelul dvs. pe spectrul bias-varianță și aplicați strategiile de remediere corespunzătoare. De obicei, începeți cu un model simplu și creșteți complexitatea până când eroarea de validare începe să crească, apoi aplicați regularizarea.

3. Regularizarea ajută la reducerea biasului sau a varianței?

Regularizarea ajută în principal la reducerea varianței prin penalizarea complexității modelului, prevenind supra-adaptarea. Dacă se aplică o regularizare prea puternică, poate crește biasul, ducând la sub-adaptare.

4. De ce adăugarea mai multor date ajută la varianța ridicată, dar nu și la biasul ridicat?

Pentru varianța ridicată (supra-adaptare), modelul a memorat zgomotul din datele de antrenament. Mai multe date ajută modelul să vadă mai multe exemple "curate" și să generalizeze mai bine, reducând impactul zgomotului specific. Pentru biasul ridicat (sub-adaptare), problema este în complexitatea inerentă a modelului. Chiar și cu mai multe date, un model prea simplu nu va putea învăța tiparele complexe necesare.

5. Este posibil să ai atât bias, cât și varianță ridicată?

Deși termenii sunt adesea prezentați ca extreme opuse, un model poate suferi de ambele într-o anumită măsură. De exemplu, un model prost proiectat ar putea avea o varianță ridicată pe anumite caracteristici și un bias ridicat pe altele. Însă, cel mai adesea, se manifestă un dezechilibru pronunțat spre una dintre ele.

Concluzie

Înțelegerea compromisului bias-varianță este fundamentală pentru construirea unor modele de Machine Learning eficiente și fiabile. Prin învățarea modului de a diagnostica și de a aborda aceste probleme, puteți lua decizii de modelare mai bune, puteți optimiza performanța modelului în mod eficient și, în cele din urmă, puteți construi sisteme de inteligență artificială care funcționează cu adevărat în lumea reală. Nu uitați, găsirea echilibrului potrivit între bias și varianță este o artă care vine cu practică și experiență. Continuă să experimentezi, să analizezi și să înveți din fiecare model construit!

Dacă vrei să descoperi și alte articole similare cu Cheia Performanței Modelului: Înțelegerea Bias-ului și Varianței, poți vizita categoria Fitness.