19/06/2022

În era digitală, înțelegerea modului în care computerele „gândesc” și iau decizii devine din ce în ce mai relevantă. De la recomandări personalizate la sistemele de diagnosticare medicală, inteligența artificială (IA) este peste tot. Unul dintre blocurile fundamentale ale învățării automate este clasificarea, iar un algoritm istoric și fundamental în acest domeniu este perceptronul. Deși pare simplu, principiile sale stau la baza unor rețele neuronale mult mai complexe de astăzi. Acest articol îți va dezvălui în detaliu ce este un perceptron binar, cum funcționează și de ce este atât de important în lumea IA.

Imaginate că ai un set de date, să zicem, rezultatele unor analize medicale, și vrei să le clasifici în două categorii: sănătos sau bolnav. Cum ar putea un computer să învețe să facă această distincție? Aici intervine perceptronul binar. Este un clasificator liniar, ceea ce înseamnă că încearcă să găsească o „linie” (sau un hiperplan în spații multidimensionale) care să separe perfect cele două clase de date. Scopul său principal este de a descoperi un set optim de greutăți care, atunci când sunt aplicate datelor de intrare, permit o clasificare corectă și consistentă.

- Ce Este un Perceptron Binar?

- Algoritmul Perceptronului: Cum Învață?

- De Ce Funcționează Actualizarea Greutăților?

- Rolul Termenului de Bias

- Un Exemplu Practic al Algoritmului Perceptron

- Extinderea la Clasificarea Multi-Clasă

- Implementarea unui Model Perceptron Simplu (Concept)

- Avantaje și Limite ale Perceptronului Binar

- Întrebări Frecvente

- Concluzie

Ce Este un Perceptron Binar?

Perceptronul binar este, în esență, un model matematic simplu inspirat de neuronii biologici. A fost dezvoltat de Frank Rosenblatt în anii 1950 și este considerat unul dintre primii algoritmi de învățare supervizată. „Binar” înseamnă că este proiectat să clasifice datele în exact două categorii distincte, adesea reprezentate ca +1 și -1. De exemplu, ar putea fi utilizat pentru a distinge între „spam” și „nu spam” într-un e-mail, sau „da” și „nu” într-o decizie.

Funcționarea sa se bazează pe o combinație liniară a caracteristicilor de intrare, înmulțite cu greutăți. Rezultatul acestei combinații este apoi trecut printr-o funcție de activare, care decide clasa finală. Dacă suma ponderată depășește un anumit prag (sau este pozitivă), intrarea este clasificată într-o clasă; altfel, în cealaltă. Acest prag este adesea gestionat de un termen numit bias, despre care vom discuta mai în detaliu mai târziu.

Algoritmul Perceptronului: Cum Învață?

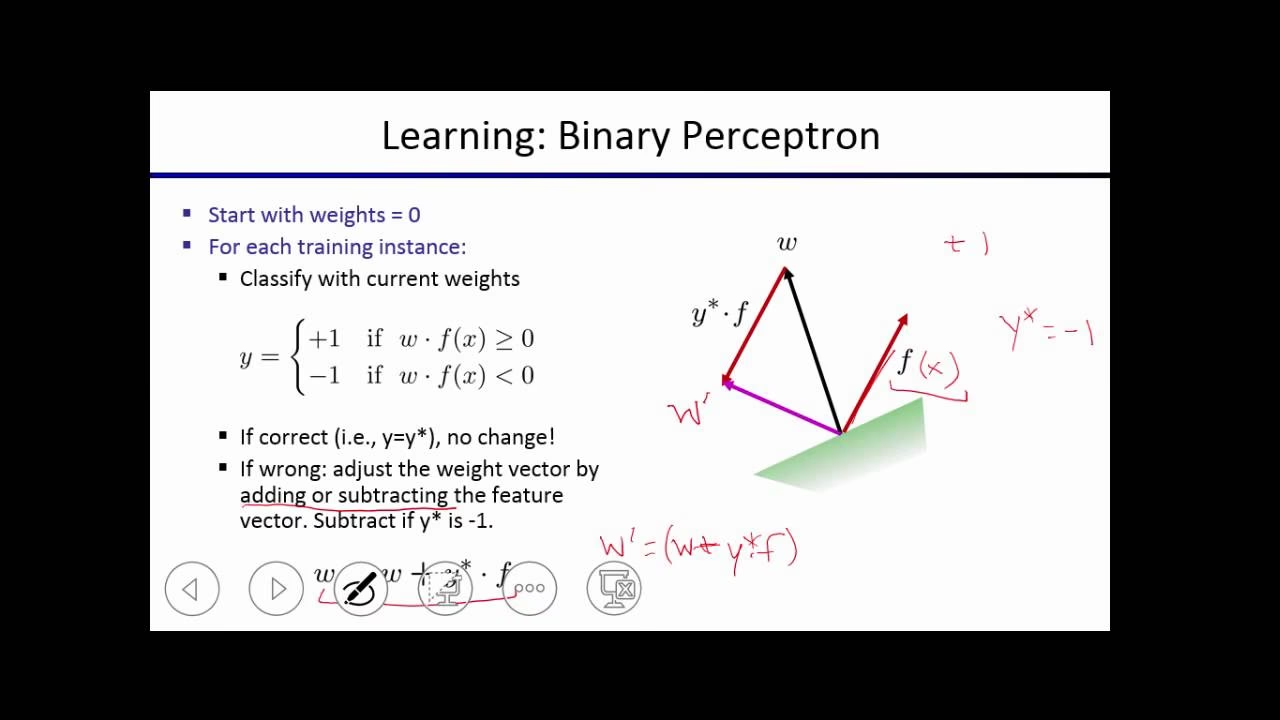

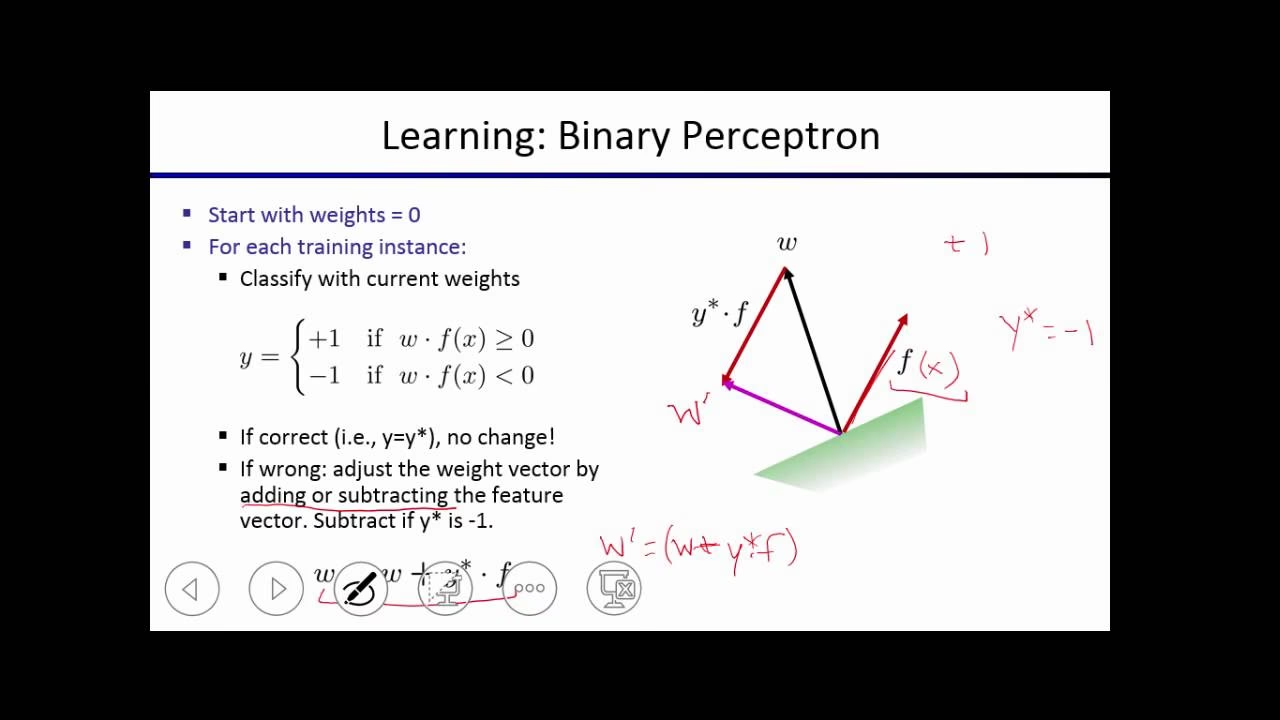

Procesul de învățare al perceptronului este iterativ și se bazează pe corectarea erorilor. Algoritmul pornește cu greutăți inițiale (adesea zero) și le ajustează treptat pe măsură ce întâlnește date de antrenament clasificate incorect. Iată pașii fundamentali:

- Inițializarea Greutăților: Toate greutățile modelului sunt setate la zero la începutul procesului de antrenament. Acest lucru oferă un punct de plecare neutru.

- Parcurgerea Setului de Antrenament: Algoritmul iterează prin fiecare eșantion din setul de date de antrenament. Pentru fiecare eșantion, care are un set de caracteristici (input) și o etichetă reală (output dorit), se efectuează următorii sub-pași:

- Clasificarea Eșantionului: Folosind greutățile curente, perceptronul calculează o predicție. Aceasta se face printr-o sumă ponderată a caracteristicilor (fiecare caracteristică înmulțită cu greutatea sa corespunzătoare), iar rezultatul este apoi verificat. Dacă suma este pozitivă, se prezice clasa +1; dacă este negativă, se prezice clasa -1.

- Compararea și Actualizarea: Predicția modelului (y) este comparată cu eticheta reală a eșantionului (y*).

- Dacă predicția este corectă (y = y*), nu se face nicio modificare. Greutățile sunt deja bune pentru acest eșantion.

- Dacă predicția este incorectă (y ≠ y*), greutățile sunt actualizate. Formula de actualizare este simplă:

w ← w + y* * f(x), undeweste vectorul de greutăți,y*este eticheta reală (+1 sau -1), iarf(x)este vectorul de caracteristici al eșantionului incorect clasificat. - Criteriul de Terminare: Algoritmul continuă să parcurgă setul de antrenament. Dacă, într-o întreagă parcurgere a setului de date, nu este necesară nicio actualizare a greutăților (adică toate eșantioanele sunt clasificate corect), atunci algoritmul se oprește. În caz contrar, procesul se repetă de la pasul 2. Perceptronul este garantat să convergă și să găsească o soluție dacă datele sunt liniar separabile.

De Ce Funcționează Actualizarea Greutăților?

Mecanismul de actualizare a greutăților este inima algoritmului perceptronului și este intuitiv. Să analizăm cele două cazuri de eroare:

- Cazul 1: Clasificat incorect pozitiv ca negativ. Aceasta înseamnă că eticheta reală era +1, dar perceptronul a prezis -1. Scorul calculat de perceptron a fost prea mic (negativ când trebuia să fie pozitiv). Formula de actualizare devine

w ← w + f(x). Adăugarea vectorului de caracteristici la greutăți are efectul de a mări scorul de activare pentru eșantionul respectiv, împingându-l mai aproape de pragul pozitiv. - Cazul 2: Clasificat incorect negativ ca pozitiv. Eticheta reală era -1, dar perceptronul a prezis +1. Scorul calculat a fost prea mare (pozitiv când trebuia să fie negativ). Formula de actualizare devine

w ← w - f(x). Scăderea vectorului de caracteristici din greutăți reduce scorul de activare, împingându-l spre pragul negativ.

Intuiția este că, prin adăugarea sau scăderea vectorului de caracteristici (f(x)) la vectorul de greutăți (w), ajustăm greutățile într-un mod proporțional cu contribuția fiecărei caracteristici la scorul total. Caracteristicile cu valori mari vor influența mai mult actualizarea greutăților decât cele cu valori mici sau zero. Acest lucru permite algoritmului să „învețe” ce caracteristici sunt cele mai relevante pentru o clasificare corectă, concentrându-se pe „repararea” greutăților care au contribuit cel mai mult la clasificare greșită.

Un aspect important al perceptronului, adesea trecut cu vederea la prima vedere, este termenul de bias. Fără el, limita de decizie trasată de perceptron ar trebui să treacă întotdeauna prin origine (punctul (0,0) într-un spațiu 2D). Acest lucru ar limita drastic capacitatea perceptronului de a clasifica seturi de date unde linia de separare nu trece prin origine, chiar dacă datele sunt liniar separabile.

Pentru a rezolva această problemă, se adaugă o caracteristică suplimentară fiecărui eșantion, care are întotdeauna valoarea 1. Această caracteristică primește apoi o greutate proprie, numită greutate de bias. Astfel, funcția de activare devine w^T * f(x) + b (unde b este greutatea asociată caracteristicii constante 1). Din punct de vedere geometric, adăugarea termenului de bias permite limitei de decizie să se deplaseze liber în spațiu, fără a fi constrânsă să treacă prin origine, oferind perceptronului o flexibilitate mult mai mare în clasificarea datelor.

Un Exemplu Practic al Algoritmului Perceptron

Să urmărim un exemplu pas cu pas pentru a înțelege cum funcționează actualizările greutăților. Vom folosi un set de date simplu și vom rula o singură trecere prin date.

Setul de Antrenament:

| # | f1 | f2 | y* (eticheta reală) |

|---|---|---|---|

| 1 | 1 | 1 | -1 |

| 2 | 3 | 2 | +1 |

| 3 | 2 | 4 | +1 |

| 4 | 3 | 4 | +1 |

| 5 | 2 | 3 | -1 |

Inițializăm greutățile (inclusiv bias-ul) la w = [-1, 0, 0], unde w0 este greutatea pentru bias (caracteristica constantă 1).

Trecere Unică de Actualizare a Perceptronului:

| Pas | Greutăți (w0, w1, w2) | Scor (w0*1 + w1*f1 + w2*f2) | Corect? | Actualizare |

|---|---|---|---|---|

| 1 (Eșantion 1: f=[1,1], y*=-1) | [-1, 0, 0] | -1*1 + 0*1 + 0*1 = -1 | Da | Niciuna |

| 2 (Eșantion 2: f=[3,2], y*=1) | [-1, 0, 0] | -1*1 + 0*3 + 0*2 = -1 | Nu (trebuia +1) | w ← w + [1, 3, 2] = [0, 3, 2] |

| 3 (Eșantion 3: f=[2,4], y*=1) | [0, 3, 2] | 0*1 + 3*2 + 2*4 = 14 | Da | Niciuna |

| 4 (Eșantion 4: f=[3,4], y*=1) | [0, 3, 2] | 0*1 + 3*3 + 2*4 = 17 | Da | Niciuna |

| 5 (Eșantion 5: f=[2,3], y*=-1) | [0, 3, 2] | 0*1 + 3*2 + 2*3 = 12 | Nu (trebuia -1) | w ← w - [1, 2, 3] = [-1, 1, -1] |

După această primă trecere, greutățile finale sunt [-1, 1, -1]. Deoarece au existat actualizări, algoritmul ar continua să ruleze alte treceri până când toate eșantioanele ar fi clasificate corect într-o singură trecere completă.

Extinderea la Clasificarea Multi-Clasă

Deși perceptronul binar este excelent pentru două clase, lumea reală este adesea mai complexă. Din fericire, perceptronul poate fi extins pentru a gestiona multiple clase. Diferența principală constă în modul în care sunt structurate și actualizate greutățile.

Pentru clasificarea multi-clasă, nu avem un singur vector de greutăți, ci un vector de greutăți pentru fiecare clasă. Dacă avem K clase, vom avea K vectori de greutăți. Pentru a clasifica un eșantion, se calculează un scor pentru fiecare clasă, înmulțind vectorul de caracteristici al eșantionului cu vectorul de greutăți al fiecărei clase. Clasa care produce cel mai mare scor este aleasă ca predicție.

În practică, acești vectori de greutăți sunt adesea stivuiți într-o singură matrice de greutăți (W). Aceasta permite o clasificare mai eficientă printr-o singură operație de înmulțire matrice-vector.

Mecanismul de actualizare se adaptează și el. Dacă o predicție este incorectă (perceptronul a prezis clasa y, dar clasa reală era y*):

- Vectorului de greutăți corespunzător clasei corecte (y*) i se adaugă vectorul de caracteristici al eșantionului. Aceasta „recompensează” vectorul de greutăți corect.

- Vectorului de greutăți corespunzător clasei prezise incorect (y) i se scade vectorul de caracteristici al eșantionului. Aceasta „pedepsește” vectorul de greutăți incorect.

- Ceilalți vectori de greutăți rămân neschimbați.

Acest proces asigură că greutățile sunt ajustate pentru a favoriza clasa corectă și a defavoriza clasa prezisă greșit, ghidând modelul spre o performanță mai bună.

Implementarea unui Model Perceptron Simplu (Concept)

Construirea unui perceptron implică definirea unei clase care gestionează greutățile, bucla de antrenament și metodele de predicție. Chiar dacă nu vom prezenta codul, putem descrie logic pașii:

- Inițializare: Se definesc rata de învățare (

lr), care controlează mărimea pasului la fiecare actualizare a greutăților, și numărul de epoci (epochs), adică de câte ori se parcurge întregul set de date. Greutățile și termenul de bias sunt inițializate, de obicei cu valori aleatorii sau zero. - Bucla de Antrenament (`fit`):

- Pentru fiecare epocă, se iterează prin fiecare punct de date și eticheta sa corespunzătoare.

- Se calculează predicția modelului pentru punctul de date curent.

- Se calculează eroarea: diferența dintre eticheta reală și predicție. Dacă eroarea este zero, nu se face nimic. Dacă eroarea este +1 (predicție -1, real +1) sau -1 (predicție +1, real -1), se calculează o „deltă” pentru greutăți și bias.

- Delta greutăților este produsul dintre rata de învățare, eroare și caracteristicile eșantionului. Delta bias-ului este produsul dintre rata de învățare și eroare.

- Greutățile și bias-ul modelului sunt apoi actualizate adăugând aceste delte. Rata de învățare este crucială; o valoare prea mare poate duce la instabilitate, în timp ce una prea mică poate încetini convergența.

- Metoda de Predicție (`predict`):

- Pentru un set de intrări, se calculează combinația liniară a intrărilor cu greutățile curente și bias-ul.

- Rezultatul este apoi trecut printr-o funcție de activare, în cazul perceptronului binar, o funcție treaptă. Aceasta transformă scorul continuu într-o ieșire binară (+1 sau -1, sau 1 sau 0) conform pragului (de obicei 0).

După antrenament, modelul va fi capabil să facă predicții mult mai precise. Dacă datele sunt liniar separabile, perceptronul va găsi o limită de decizie care le separă perfect. În cazul datelor care nu sunt liniar separabile, perceptronul va încerca să găsească cea mai bună linie de separare posibilă, dar pot exista în continuare erori de clasificare. Aceasta este o limitare fundamentală a perceptronului simplu, motiv pentru care au fost dezvoltate modele mai complexe, cum ar fi rețelele neuronale cu mai multe straturi.

Avantaje și Limite ale Perceptronului Binar

Ca orice algoritm, perceptronul binar are punctele sale forte și punctele slabe:

Avantaje:

- Simplicitate: Este un algoritm ușor de înțeles și de implementat, ideal pentru a introduce conceptele de bază ale învățării automate.

- Eficiență computațională: Pentru date liniar separabile, converge rapid și necesită resurse computaționale minime.

- Fundație: Este un bloc fundamental pentru înțelegerea rețelelor neuronale artificiale mai complexe.

Limite:

- Liniar Separabil: Cea mai mare limitare este că poate clasifica corect doar seturi de date care sunt liniar separabile. Dacă datele nu pot fi separate printr-o linie dreaptă (sau un hiperplan), perceptronul nu va converge la o soluție perfectă și poate continua să oscileze.

- Sensibilitate la Zgomot: Este sensibil la datele zgomotoase sau la valorile aberante, care pot perturba procesul de învățare.

- Non-probabilistic: Nu oferă probabilități de clasificare, ci doar o decizie binară.

Întrebări Frecvente

- Ce se întâmplă dacă datele nu sunt liniar separabile?

- Dacă datele nu sunt liniar separabile, perceptronul binar nu va găsi o soluție perfectă și nu va converge. Va continua să actualizeze greutățile la infinit sau până la atingerea unui număr maxim de epoci setat. Pentru astfel de cazuri, sunt necesari algoritmi mai avansați, cum ar fi mașinile cu vectori suport (SVM) cu nuclee sau rețelele neuronale multi-strat.

- Este perceptronul folosit încă în aplicații moderne?

- Perceptronul simplu, ca atare, este rar folosit în aplicații complexe moderne din cauza limitării sale la datele liniar separabile. Cu toate acestea, el este un element constitutiv esențial al rețelelor neuronale artificiale (cum ar fi Multi-Layer Perceptrons), care sunt utilizate pe scară largă în domenii precum viziunea computerizată, procesarea limbajului natural și multe altele.

- Ce este rata de învățare și de ce este importantă?

- Rata de învățare (learning rate) este un hiperparametru care controlează cât de mult sunt ajustate greutățile modelului la fiecare actualizare. O rată de învățare mare poate duce la o convergență rapidă, dar poate face ca modelul să „sare peste” soluția optimă, ducând la instabilitate. O rată de învățare mică asigură pași mici și stabili spre soluție, dar poate face ca antrenamentul să fie foarte lent.

- Care este diferența dintre un perceptron și o rețea neuronală?

- Un perceptron este cel mai simplu tip de rețea neuronală, având un singur strat de neuroni de ieșire. O rețea neuronală, în general, este compusă din mai multe straturi de perceptroni (sau neuroni) interconectate, inclusiv unul sau mai multe straturi „ascunse” între stratul de intrare și cel de ieșire. Această structură cu mai multe straturi permite rețelelor neuronale să învețe și să modeleze relații neliniare complexe în date, depășind limitarea perceptronului simplu.

Concluzie

Perceptronul binar, cu simplitatea sa elegantă, reprezintă o piatră de temelie în istoria inteligenței artificiale și a învățării automate. Deși limitat la problemele liniar separabile, principiile sale fundamentale – calculul ponderat, funcția de activare și actualizarea greutăților bazată pe erori – sunt esențiale pentru înțelegerea algoritmilor de învățare mai avansați. Înțelegerea perceptronului nu este doar o lecție de istorie, ci și o perspectivă valoroasă asupra modului în care mașinile încep să „învețe” din date și să ia decizii, un concept care continuă să evolueze și să redefinească lumea în care trăim.

Dacă vrei să descoperi și alte articole similare cu Perceptronul Binar: Un Ghid Complet, poți vizita categoria Fitness.