26/07/2021

Așa cum un atlet își antrenează corpul pentru a atinge performanțe maxime, la fel și sistemele de inteligență artificială, în special rețelele neuronale, necesită un 'antrenament' riguros pentru a-și dezvolta capacitățile. Acest proces de antrenament este esențial pentru ca ele să poată învăța, recunoaște tipare și să ia decizii inteligente. În acest articol, vom explora nu doar fundamentele modului în care rețelele neuronale artificiale (RNA) învață, ci și vom pătrunde în detaliile practice ale antrenamentului unei rețele de ultimă generație, așa cum este exemplificat de proiectul 'Deep Blending for Free-Viewpoint Image-Based Rendering'. Pregătește-te să descoperi cum tehnologia de vârf transformă modul în care percepem și interacționăm cu datele vizuale.

Rețelele neuronale artificiale (RNA) sunt sisteme informatice concepute să imite modul în care creierul uman procesează informațiile. Așa cum creierul folosește neuroni pentru a procesa date și a lua decizii, RNA-urile folosesc neuroni artificiali pentru a analiza date, a identifica tipare și a face predicții. Aceste rețele sunt formate din straturi de neuroni interconectați care lucrează împreună pentru a rezolva probleme complexe. Ideea cheie este că RNA-urile pot 'învăța' din datele pe care le procesează, exact așa cum creierul nostru învață din experiență. Ele sunt utilizate într-o varietate de aplicații, de la recunoașterea imaginilor la recomandări personalizate. Să vedem mai multe despre RNA-uri, cum funcționează și alte concepte fundamentale.

- Ce Sunt Rețelele Neuronale Artificiale (RNA)?

- Antrenarea Practică a unei Rețele Neuronale: Cazul 'Deep Blending'

- Diferențe Cheie: Neuroni Biologici vs. Neuroni Artificiali

- Funcții de Activare Esențiale în RNA

- Tipuri de Rețele Neuronale Artificiale

- Algoritmi de Optimizare în Antrenamentul RNA

- Aplicații Vaste ale Rețelelor Neuronale Artificiale

- Provocări în Lumea RNA

- Rețele Neuronale Fizice (PNNA): O Privire Spre Viitor

- Întrebări Frecvente (FAQ)

Ce Sunt Rețelele Neuronale Artificiale (RNA)?

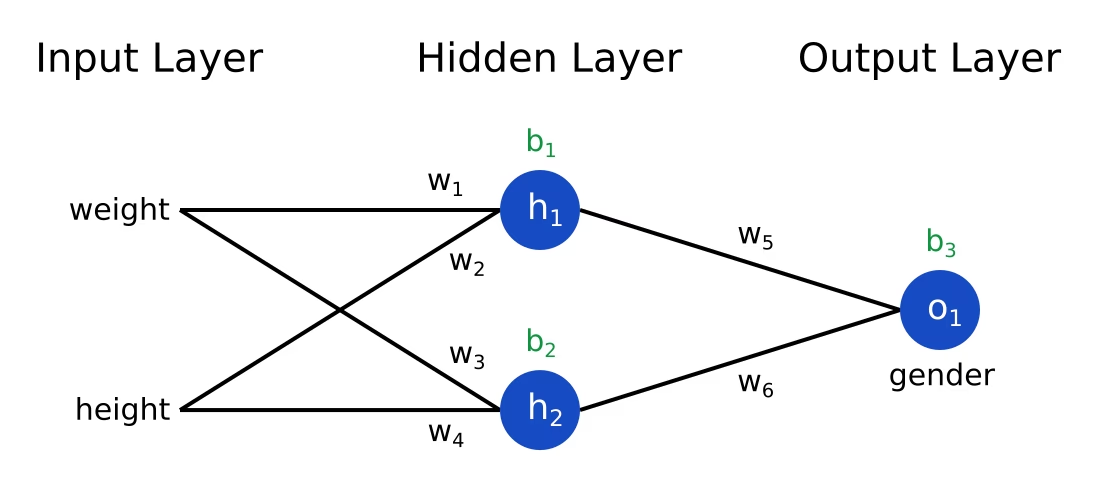

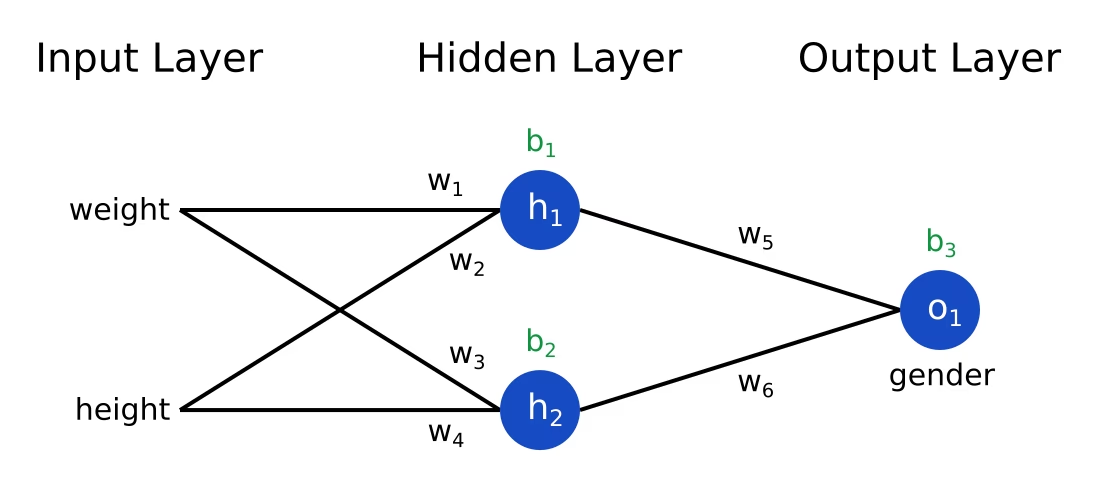

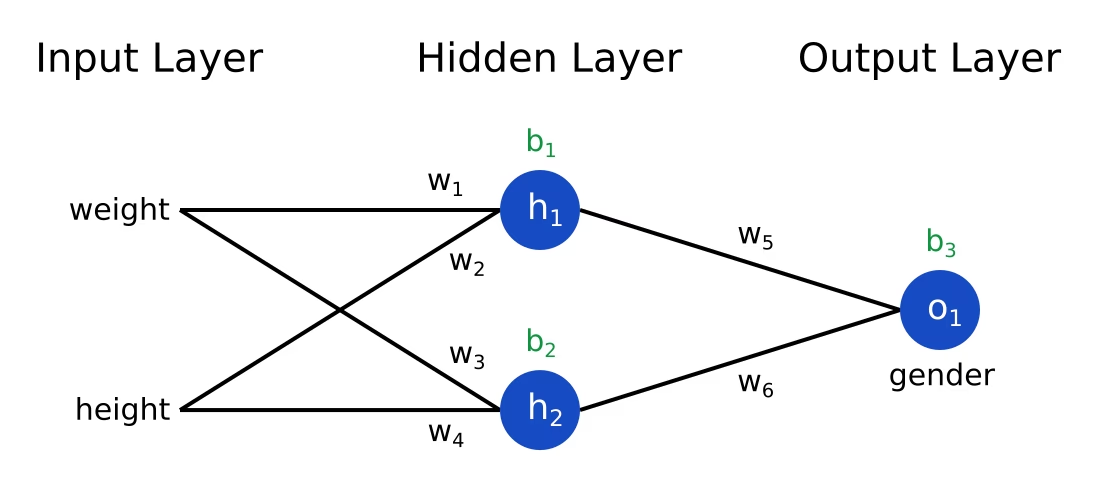

Rețelele neuronale artificiale sunt modele computaționale inspirate de structura și funcționarea creierului biologic. Ele sunt alcătuite din noduri (neuroni artificiali) aranjate în straturi, conectate între ele, fiecare conexiune având o 'greutate' asociată. Aceste greutăți sunt ajustate în timpul procesului de antrenament pentru a optimiza performanța rețelei.

Componentele Cheie ale unei RNA

- Stratul de Intrare: Acesta este locul unde rețeaua primește informații. De exemplu, într-o sarcină de recunoaștere a imaginii, intrarea ar putea fi o imagine.

- Straturi Ascunse: Aceste straturi procesează datele primite de la stratul de intrare. Cu cât există mai multe straturi ascunse, cu atât rețeaua poate învăța și înțelege tipare mai complexe. Fiecare strat ascuns transformă datele în informații mai abstracte.

- Stratul de Ieșire: Acesta este locul unde se ia decizia finală sau se face predicția. De exemplu, după procesarea unei imagini, stratul de ieșire ar putea decide dacă este o pisică sau un câine.

Cum Funcționează RNA-urile? Procesul de Învățare

RNA-urile funcționează prin învățarea tiparelor din date printr-un proces numit antrenament. În timpul antrenamentului, rețeaua se ajustează pentru a-și îmbunătăți precizia, comparând predicțiile sale cu rezultatele reale.

Iată cum funcționează procesul de învățare:

- Stratul de Intrare: Date, cum ar fi o imagine, text sau număr, sunt introduse în rețea prin stratul de intrare.

- Straturi Ascunse: Fiecare neuron din straturile ascunse efectuează o anumită calculare asupra intrării, trecând rezultatul la stratul următor. Datele sunt transformate și abstractizate la fiecare strat.

- Stratul de Ieșire: După ce trece prin toate straturile, rețeaua oferă predicția finală, cum ar fi clasificarea unei imagini ca pisică sau câine.

Procesul de backpropagation este utilizat pentru a ajusta greutățile dintre neuroni. Atunci când rețeaua face o greșeală, greutățile sunt actualizate pentru a reduce eroarea și a îmbunătăți următoarea predicție. Această metodă este fundamentală pentru învățarea eficientă a rețelelor neuronale.

Antrenament și Testare

În timpul antrenamentului, rețelei i se arată exemple, cum ar fi imagini cu pisici, și învață să recunoască tiparele din ele. După antrenament, rețeaua este testată pe date noi pentru a-i verifica performanța. Cu cât rețeaua este mai bine antrenată, cu atât va prezice mai precis datele noi.

Antrenarea Practică a unei Rețele Neuronale: Cazul 'Deep Blending'

Proiectul 'Deep Blending for Free-Viewpoint Image-Based Rendering' de la SIGGRAPH Asia 2018 este un exemplu excelent de aplicare a rețelelor neuronale pentru sarcini complexe de redare grafică. Acest proiect utilizează învățarea profundă pentru a amesteca imagini din perspective diferite, creând o vizualizare fluidă și realistă dintr-un punct de vedere liber. Să vedem cum se antrenează o astfel de rețea.

Pregătirea Terenului: Cerințe și Date

Antrenarea unei rețele neuronale necesită un mediu de lucru specific și date pregătite corespunzător. Pentru 'Deep Blending', cerințele sunt următoarele:

- Sistem de Operare: Testat pe Ubuntu 16.04.

- GPU: Plăci grafice NVIDIA sunt esențiale pentru accelerarea antrenamentului.

- Software: Python 3, Pip și TensorFlow-GPU trebuie instalate.

- Pachete Python: Numpy, Scipy și PIL (Pillow) sunt necesare.

- Date: Seturi de date pentru antrenament și testare trebuie descărcate și dezarhivare. Acestea conțin imagini și informații geometrice din diverse scene.

Pașii de Antrenament pentru 'Deep Blending'

Procesul de antrenament implică mai multe etape, de la pregătirea datelor la rularea scriptului de antrenament.

Descărcarea Greutăților Pre-antrenate VGG

Pentru a beneficia de cunoștințele acumulate de alte rețele, 'Deep Blending' utilizează greutăți pre-antrenate de la modelul VGG-16. Acesta este un exemplu de transfer de învățare, o tehnică ce accelerează antrenamentul și îmbunătățește performanța.

cd [DEEP_BLENDING_CODE_FOLDER] wget http://download.tensorflow.org/models/vgg_16_2016_08_28.tar.gz tar -xvf vgg_16_2016_08_28.tar.gz rm vgg_16_2016_08_28.tar.gzCrearea Fișierelor de Intrare pentru Antrenament și Validare

Seturile de date trebuie organizate în fișiere text care listează toate imaginile de antrenament și de validare. Aceste fișiere sunt esențiale pentru ca rețeaua să știe ce date să folosească.

Pentru antrenament:

cd [DEEP_BLENDING_CODE_FOLDER] DATASET_DIR=[PATH_TO_UNZIPPED_TRAINING_DATA] for scene in `ls $DATASET_DIR | grep -v txt` ; do python3 make_data_txt.py $DATASET_DIR/$scene > ${scene}_training.txt ; cat ${scene}_training.txt >> training_all_ordered.txt ; rm ${scene}_training.txt ; done ; shuf training_all_ordered.txt > $DATASET_DIR/training.txt ; rm training_all_ordered.txt ;Pentru validare (un subset al datelor de antrenament utilizat pentru a monitoriza progresul și a preveni supra-antrenarea):

cd [DEEP_BLENDING_CODE_FOLDER] DATASET_DIR=[PATH_TO_UNZIPPED_TRAINING_DATA] for scene in `ls $DATASET_DIR | grep -v txt` ; do python3 make_data_txt.py $DATASET_DIR/$scene validation > ${scene}_validation.txt ; cat ${scene}_validation.txt >> validation_all_ordered.txt ; rm ${scene}_validation.txt ; done ; shuf validation_all_ordered.txt > $DATASET_DIR/validation.txt ; rm validation_all_ordered.txt ;Lansarea Procesului de Antrenament

Odată ce toate pregătirile sunt făcute, antrenamentul rețelei poate începe. Comanda de bază, care utilizează parametrii din lucrare, arată astfel:

cd [DEEP_BLENDING_CODE_FOLDER] python3 train.py [PATH_TO_UNZIPPED_TRAINING_DATA] NETWORK_OUTPUT_FOLDER --training_file=[PATH_TO_UNZIPPED_TRAINING_DATA]/training.txt --validation_file=[PATH_TO_UNZIPPED_TRAINING_DATA]/validation.txtParametrii Avansați de Antrenament

Flexibilitatea este cheia în antrenamentul rețelelor neuronale. Proiectul 'Deep Blending' permite ajustarea fină a parametrilor pentru a experimenta cu diferite configurații:

--loss_function: Definește funcția de pierdere (L1, VGG, sau VGG_AND_L1). Implicit este VGG_AND_L1. Aceasta determină cum este calculată eroarea dintre predicție și realitate.--direct_regression: Dacă este activat, rețeaua prezice direct imaginea de ieșire în loc să prezică ponderile de amestecare. Implicit este oprit.--no_temporal_loss: Antrenează rețeaua fără o pierdere temporală, utilă în scenarii unde coerența în timp nu este o prioritate. Implicit este oprit.--no_textured_mesh: Dezactivează stratul de intrare de la mesh-ul texturat. Implicit este oprit.--num_input_mosaics: Numărul de straturi mozaic de intrare de utilizat. Implicit este 4.--temporal_alpha: Forța relativă a pierderii temporale. Implicit este 0.33.--debug: Mod de depanare pentru antrenament, arată mai multe ieșiri intermediare în TensorBoard. Implicit este oprit.--num_batches: Durata antrenamentului (în termeni de număr de mini-batch-uri). Implicit este 256000.--batch_size: Dimensiunea batch-ului de utilizat pentru antrenament. Implicit este 8.--crop: Dimensiunea de decupare pentru augmentarea datelor. Implicit este 256.

Testarea Rețelei Antrenate

După antrenament, rețeaua trebuie testată pentru a-i evalua performanța pe date nevăzute. Comanda de testare este:

cd [DEEP_BLENDING_CODE_FOLDER] python3 test.py [PATH_TO_TEST_SCENE] [OUTPUT_DIRECTORY] --model_path=[NETWORK_OUTPUT_FOLDER]Este IMPORTANT ca parametrii utilizați în timpul testării să se potrivească cu cei folosiți la antrenament, altfel rezultatele pot fi incorecte.

Diferențe Cheie: Neuroni Biologici vs. Neuroni Artificiali

Pentru a înțelege mai bine RNA-urile, este util să comparăm neuronii artificiali cu omologii lor biologici, care au servit drept inspirație.

| Aspect | Neuroni Biologici | Neuroni Artificiali |

|---|---|---|

| Structură | Dendrite: Primesc semnale. Corp celular (Soma): Procesează semnale. Axon: Transmite semnale. | Noduri de Intrare: Primesc date. Noduri din Straturi Ascunse: Procesează și transformă date. Noduri de Ieșire: Produc rezultatul final. |

| Conexiuni | Sinapse: Legături între neuroni care transmit semnale. | Greutăți: Conexiuni între neuroni care controlează influența unui neuron asupra altuia. |

| Mecanism de Învățare | Plasticitate Sinaptică: Modificări ale forței sinaptice bazate pe activitate. | Backpropagation: Ajustează greutățile pe baza erorilor pentru a îmbunătăți predicțiile viitoare. |

| Activare | Activare: Neuronii se declanșează când semnalele ating un prag. | Funcție de Activare: Mapează intrarea la ieșire, decide dacă neuronul ar trebui să se 'activeze' pe baza datelor procesate. |

Funcții de Activare Esențiale în RNA

Funcțiile de activare sunt importante în rețelele neuronale deoarece introduc non-liniaritate și ajută rețeaua să învețe tipare complexe. Iată câteva funcții de activare comune utilizate în RNA-uri:

- Funcția Sigmoid: Produce valori între 0 și 1. Este utilizată în sarcini de clasificare binară, cum ar fi decizia dacă o imagine este o pisică sau nu.

- ReLU (Rectified Linear Unit): O alegere populară pentru straturile ascunse, returnează intrarea dacă este pozitivă și zero în caz contrar. Ajută la rezolvarea problemei gradientului care dispare.

- Tanh (Hyperbolic Tangent): Similară cu sigmoid, dar produce valori între -1 și 1. Este utilizată în straturile ascunse atunci când este necesară o gamă mai largă de ieșiri.

- Softmax: Convertește ieșirile brute în probabilități, utilizate în stratul final al unei rețele pentru sarcini de clasificare multi-clasă.

- Leaky ReLU: O variantă a ReLU care permite valori negative mici pentru intrări, ajutând la prevenirea 'neuronilor morți' în timpul antrenamentului.

Aceste funcții ajută rețeaua să decidă dacă să activeze un neuron, contribuind la recunoașterea tiparelor și la realizarea predicțiilor.

Tipuri de Rețele Neuronale Artificiale

Lumea RNA este vastă și diversă, cu arhitecturi specializate pentru diferite tipuri de probleme:

- Rețea Neuronală Feedforward (FNN): Unul dintre cele mai simple tipuri de RNA. Datele circulă într-o singură direcție, de la intrare la ieșire, prin unul sau mai multe straturi ascunse. Nu există bucle sau cicluri. Folosită pentru clasificări și regresii de bază.

- Rețea Neuronală Convoluțională (CNN): Proiectată pentru a procesa date cu o structură de tip grilă, cum ar fi imaginile. Include straturi convoluționale care aplică filtre pentru a extrage caracteristici importante (margini, texturi). Eficientă în recunoașterea imaginilor și a vorbirii.

- Rețea Neuronală cu Funcție de Bază Radială (RBFN): Concepută pentru a lucra cu date care pot fi modelate într-un mod radial sau circular. Utilizată pentru sarcini de clasificare și regresie, mai ales când datele reprezintă un tipar sau o tendință subiacentă.

- Rețea Neuronală Recurentă (RNN): Proiectată pentru a gestiona date secvențiale, cum ar fi serii de timp sau text. Spre deosebire de alte rețele, RNN-urile au bucle de feedback care permit informațiilor să fie transmise înapoi în straturile anterioare, oferind rețelei 'memorie'. Ideală pentru recunoașterea vorbirii, modelarea limbajului și prognoză.

Algoritmi de Optimizare în Antrenamentul RNA

Algoritmii de optimizare ajustează greutățile unei rețele neuronale în timpul antrenamentului pentru a minimiza erorile. Scopul este de a face predicțiile rețelei mai precise. Iată câțiva algoritmi cheie:

- Gradient Descent (Coborârea Gradientului): Cel mai de bază algoritm de optimizare, actualizează greutățile prin calcularea gradientului funcției de pierdere.

- Adam (Adaptive Moment Estimation): O versiune eficientă a coborârii gradientului care adaptează ratele de învățare pentru fiecare greutate, utilizată pe scară largă în învățarea profundă.

- RMSprop: O variație a coborârii gradientului care ajustează rata de învățare pe baza mediei gradientilor recenți, utilă în antrenarea rețelelor neuronale recurente (RNN).

- Stochastic Gradient Descent (SGD): Actualizează greutățile folosind o singură mostră la un moment dat, fiind mai rapid, dar și mai 'zgomotos'.

Aplicații Vaste ale Rețelelor Neuronale Artificiale

RNA-urile au revoluționat numeroase domenii, transformând modul în care interacționăm cu tehnologia și lumea din jurul nostru:

- Social Media: Ajută platformele să sugereze prieteni și conținut relevant, analizând profilurile utilizatorilor, interesele și interacțiunile. De asemenea, asistă în publicitatea direcționată, asigurându-se că utilizatorii văd reclame adaptate preferințelor lor.

- Marketing și Vânzări: Site-urile de comerț electronic, cum ar fi Amazon, folosesc RNA-uri pentru a recomanda produse pe baza istoricului de navigare. Ele personalizează, de asemenea, oferte, prezic comportamentul clienților și segmentează clienții pentru campanii de marketing mai eficiente.

- Sănătate: Sunt utilizate în imagistica medicală pentru detectarea bolilor precum cancerul și asistă la diagnosticarea afecțiunilor cu o precizie similară cu a medicilor. În plus, prezic riscurile de sănătate și recomandă planuri de tratament personalizate.

- Asistenți Personali: Asistenți virtuali precum Siri și Alexa folosesc RNA-uri pentru a procesa limbajul natural, a înțelege comenzile vocale și a răspunde în consecință. Ei ajută la gestionarea sarcinilor, cum ar fi setarea mementourilor, efectuarea apelurilor și răspunsul la întrebări.

- Suport Clienți: RNA-urile alimentează chatbot-urile și sistemele automate de servicii pentru clienți care analizează întrebările clienților și oferă răspunsuri precise, îmbunătățind eficiența în gestionarea solicitărilor clienților.

- Finanțe: În industria financiară, sunt utilizate pentru detectarea fraudelor, scoruri de credit și predicția tendințelor pieței, prin analizarea unor seturi mari de date de tranzacții și identificarea anomaliilor.

Provocări în Lumea RNA

Deși puternice, RNA-urile vin cu propriile provocări:

- Dependența de Date: RNA-urile necesită cantități mari de date de înaltă calitate pentru a se antrena eficient. Colectarea și curățarea datelor suficiente pot fi consumatoare de timp, costisitoare și adesea nepractice, mai ales în industriile cu acces limitat la date de calitate.

- Putere de Calcul: Antrenarea rețelelor neuronale profunde cu multe straturi necesită resurse computaționale semnificative. Hardware-ul de înaltă performanță (de exemplu, GPU-uri) este adesea necesar, ceea ce face procesul costisitor și intensiv în resurse.

- Supra-antrenarea (Overfitting): Rețelele pot supra-antrena cu ușurință pe datele de antrenament, ceea ce înseamnă că performează bine pe setul de antrenament, dar slab pe date noi, nevăzute. Această provocare apare atunci când modelul învață să memoreze, mai degrabă decât să generalizeze, reducând aplicabilitatea sa în lumea reală.

- Interpretarea: Sunt adesea denumite 'cutii negre'. Este dificil de înțeles cum iau decizii, ceea ce reprezintă o problemă în domenii precum sănătatea și finanțele, unde explicabilitatea și transparența sunt importante.

- Timpul de Antrenament: Antrenarea RNA-urilor poate dura mult timp, în special pentru modelele de învățare profundă cu multe straturi și seturi de date vaste. Acest proces lung de antrenament poate întârzia implementarea modelelor și poate împiedica utilizarea lor în aplicații sensibile la timp.

Rețele Neuronale Fizice (PNNA): O Privire Spre Viitor

Pe lângă rețelele neuronale artificiale software, există și conceptul de rețele neuronale fizice (PNNA). Acestea oferă o procesare eficientă a informațiilor neuromorfice prin valorificarea puterii de calcul intrinseci a proceselor fizice. Cu toate acestea, antrenarea parametrilor lor de greutate este costisitoare din punct de vedere computațional. Cercetătorii propun abordări de antrenament pentru a reduce substanțial acest cost, deschizând calea către sisteme AI și mai eficiente și mai rapide.

Întrebări Frecvente (FAQ)

Ce este backpropagation?

Backpropagation este un algoritm fundamental utilizat în antrenamentul rețelelor neuronale artificiale. Permite rețelei să ajusteze greutățile conexiunilor dintre neuroni prin calcularea gradientului funcției de pierdere în raport cu fiecare greutate. Practic, este metoda prin care rețeaua 'învață din greșeli' și își ajustează parametrii pentru a îmbunătăți predicțiile viitoare.

De ce sunt necesare GPU-urile pentru antrenarea rețelelor neuronale?

GPU-urile (Graphics Processing Units) sunt esențiale pentru antrenarea rețelelor neuronale datorită arhitecturii lor paralele, care le permite să efectueze un număr mare de operații matematice simultan. Antrenamentul RNA implică înmulțiri și adunări matriciale masive, sarcini în care GPU-urile excelează, accelerând semnificativ procesul comparativ cu un CPU tradițional.

Ce înseamnă "supra-antrenare" (overfitting) și cum poate fi evitată?

Supra-antrenarea apare atunci când o rețea neuronală învață prea bine detaliile și 'zgomotul' din datele de antrenament, în loc să învețe tiparele generale. Drept urmare, performează excelent pe datele de antrenament, dar slab pe date noi, nevăzute. Poate fi evitată prin tehnici precum utilizarea unui set de validare, regularizare (ex: L1, L2, dropout), augmentarea datelor și oprirea timpurie a antrenamentului.

Care este diferența dintre datele de antrenament și datele de validare?

Datele de antrenament sunt folosite pentru a ajusta greutățile rețelei în timpul procesului de învățare. Datele de validare sunt un set separat de date, nevăzute de rețea în timpul antrenamentului principal, utilizate pentru a monitoriza performanța rețelei și a detecta supra-antrenarea, ajutând la reglarea hiperparametrilor.

Poate o rețea neuronală să 'uite' ceea ce a învățat?

Da, un fenomen numit 'uitare catastrofală' poate apărea atunci când o rețea este antrenată succesiv pe sarcini diferite. Învățarea unei noi sarcini poate duce la pierderea informațiilor învățate anterior. Cercetările actuale se concentrează pe dezvoltarea de metode pentru a atenua acest fenomen, permițând rețelelor să învețe continuu.

Pe măsură ce tehnologia continuă să se îmbunătățească, rețelele neuronale artificiale vor continua să schimbe modul în care rezolvăm problemele și ne vor face viața mai ușoară. De la înțelegerea limbajului natural la crearea de lumi virtuale realiste, potențialul lor este imens și abia începem să-l explorăm.

Dacă vrei să descoperi și alte articole similare cu Antrenamentul Rețelelor Neuronale: Forța Din Spate, poți vizita categoria Fitness.