15/01/2023

În lumea complexă a învățării automate, înțelegerea și evaluarea performanței modelelor noastre este la fel de importantă ca și construirea lor. Când ne confruntăm cu probleme de regresie, unde scopul este de a prezice o valoare continuă, avem la dispoziție diverse metrici de eroare. Una dintre cele mai intuitive și utilizate este Eroarea Medie Absolută, cunoscută sub acronimul MAE (Mean Absolute Error). Această metrică ne oferă o imagine clară a diferenței medii absolute dintre valorile prezise de model și valorile reale, istorice. În acest articol, vom explora în detaliu ce este MAE, cum se calculează, cum o putem interpreta și, mai important, cum ne ajută să alegem cel mai bun model pentru sarcinile noastre predictive.

Eroarea Medie Absolută este o măsură a erorii care cuantifică diferența medie absolută dintre predicțiile unui model și rezultatele reale. Spre deosebire de alte metrici care pot amplifica erorile mari prin ridicarea lor la pătrat, MAE tratează toate erorile cu aceeași pondere, indiferent de mărimea lor, ceea ce o face deosebit de utilă și ușor de înțeles. Este exprimată în aceleași unități ca și variabila țintă, permițând o interpretare directă și intuitivă a magnitudinii erorilor.

- Ce este Eroarea Medie Absolută (MAE)?

- MAE vs. MSE: O Comparație Detaliată

- Cum se Interpretează MAE?

- MAE în Practică: Evaluarea Modelelor de Regresie

- Importanța Caracteristicilor (Feature Importance)

- MAE și Alte Metricile de Erori pentru Modelul Ales (Random Forest)

- Întrebări Frecvente (FAQ)

- Concluzie

Ce este Eroarea Medie Absolută (MAE)?

MAE reprezintă media distanțelor absolute dintre fiecare pereche de puncte de date reale și cele prezise de model. Cu alte cuvinte, măsoară exact cât de mult, în medie, predicțiile modelului deviază de la valorile reale, ignorând direcția erorii (adică, dacă predicția este mai mare sau mai mică decât realitatea). Această caracteristică face MAE o metrică robustă, mai puțin sensibilă la valorile aberante (outliers) în comparație cu Eroarea Medie Pătratică (MSE) sau Rădăcina Eroare Medie Pătratică (RMSE).

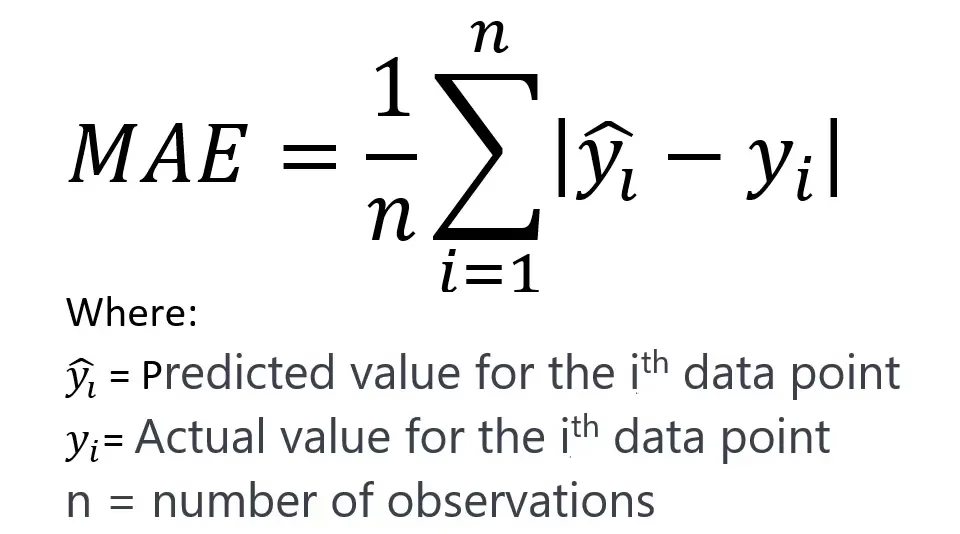

Formula pentru calcularea MAE este următoarea:

MAE = (1/n) * Σ |y_real - y_prezis|

Unde:

neste numărul total de puncte de date.Σreprezintă suma.y_realeste valoarea reală, observată.y_preziseste valoarea prezisă de model.|...|denotă valoarea absolută.

Pentru a calcula MAE, se urmează pașii:

- Se calculează diferența absolută dintre fiecare valoare prezisă și valoarea reală corespunzătoare.

- Se însumează toate aceste diferențe absolute.

- Se împarte suma totală la numărul de observații pentru a obține media.

Rezultatul este o valoare unică ce reprezintă eroarea medie a modelului.

MAE vs. MSE: O Comparație Detaliată

MAE și MSE sunt ambele metrici comune de eroare utilizate pentru a evalua performanța modelelor de regresie, dar au diferențe fundamentale care le fac potrivite pentru scenarii diferite. Înțelegerea acestor diferențe este crucială pentru a alege metrica potrivită pentru problema dumneavoastră.

| Caracteristică | MAE (Eroarea Medie Absolută) | MSE (Eroarea Medie Pătratică) |

|---|---|---|

| Calcul | Media sumei valorilor absolute ale erorilor. | Media sumei pătratelor erorilor. |

| Sensibilitate la Outlieri | Mai puțin sensibilă. Tratează erorile mari la fel ca pe cele mici. | Mai sensibilă. Amplifică erorile mari prin ridicarea la pătrat. |

| Unități de Măsură | Aceleași unități ca și variabila țintă. | Unități pătratice față de variabila țintă (mai puțin intuitiv). |

| Interpretare | Directă și intuitivă (eroarea medie în unități reale). | Mai puțin intuitivă, dar utilă pentru penalizarea erorilor mari. |

| Diferențiabilitate | Funcția valoare absolută nu este diferențiabilă în zero, ceea ce poate fi o problemă pentru optimizare. | Diferențiabilă, ceea ce o face preferată în multe algoritmi de optimizare. |

| Obiectiv | Minimizează suma erorilor absolute. | Minimizează suma erorilor pătratice. |

MSE (Mean Squared Error) ridică la pătrat diferențele dintre predicții și valori reale. Acest lucru are două implicații majore: în primul rând, previne anularea reciprocă a erorilor pozitive și negative; în al doilea rând, penalizează semnificativ mai mult erorile mari. RMSE (Root Mean Squared Error) este pur și simplu rădăcina pătrată a MSE, aducând eroarea înapoi la aceeași scară cu variabila țintă, la fel ca MAE, dar păstrând sensibilitatea la erorile mari.

Alegerea între MAE și MSE/RMSE depinde de costul erorilor în contextul specific al problemei. Dacă erorile mari sunt deosebit de problematice și doriți ca modelul să le evite cu orice preț, MSE/RMSE ar putea fi mai potrivite. Dacă doriți o măsură a erorii care este mai robustă la outlieri și mai ușor de interpretat direct, MAE este adesea alegerea superioară.

Cum se Interpretează MAE?

Interpretarea MAE este relativ simplă și directă. O valoare MAE de 0 indică un model perfect, fără erori de predicție. Pe măsură ce valoarea MAE crește, scade și precizia modelului. De exemplu, dacă un model prezice prețuri de case și obține un MAE de 10.000 de dolari, înseamnă că, în medie, predicțiile modelului sunt la o distanță de 10.000 de dolari față de prețul real al casei. Această interpretare este mult mai ușor de comunicat și înțeles decât, să zicem, o valoare MSE de 100.000.000 de dolari pătrați.

Cu toate acestea, interpretarea „bună” sau „rea” a unei valori MAE depinde în mare măsură de contextul datelor și de domeniul de aplicare. O MAE de 10 poate fi excelentă dacă valorile țintă variază între 1.000 și 100.000, dar ar fi teribilă dacă valorile țintă sunt cuprinse între 0 și 20. Prin urmare, este esențial să se ia în considerare:

- Intervalul valorilor țintă: O MAE mică în raport cu intervalul de variație al datelor este un semn bun.

- Acceptabilitatea erorii: Care este nivelul de eroare considerat acceptabil pentru scopul specific al aplicației?

Pentru o interpretare și mai nuanțată, MAE este adesea utilizată în combinație cu Eroarea Medie Absolută Procentuală (MAPE - Mean Absolute Percentage Error), care exprimă eroarea ca procent, oferind o perspectivă relativă asupra preciziei modelului.

MAE în Practică: Evaluarea Modelelor de Regresie

Pentru a ilustra aplicarea MAE, să luăm un exemplu practic în care scopul este de a prezice o variabilă continuă, denumită „Tag.Mpa”, dintr-un set de date de beton. Acest scenariu implică aplicarea și evaluarea mai multor algoritmi de regresie, utilizând MAE ca metrică principală de performanță. Setul de date conține 798 de puncte de date, fiecare cu 12 caracteristici, din care am selectat 7 caracteristici relevante pentru predicție.

k-Nearest Neighbors (k-NN)

Algoritmul k-NN este unul dintre cei mai simpli algoritmi de învățare automată. Performanța sa depinde de numărul de vecini (n_neighbors) considerați. Am observat că, pentru acest set de date, un număr de 6 vecini a oferit cea mai bună performanță pe setul de test. MAE a fost de 5.821 pe setul de antrenament și 7.955 pe setul de test. Inițial, cu un singur vecin, modelul era prea complex și supraînvăța, având o MAE perfectă pe setul de antrenament, dar mult mai mare pe setul de test.

Regresia Liniară

Regresia Liniară este un algoritm fundamental. A demonstrat o performanță relativ stabilă, cu o MAE de 6.065 pe setul de antrenament și 6.576 pe setul de test. Acest model oferă o bază solidă pentru comparație, fiind adesea un punct de plecare datorită simplității și interpretabilității sale.

Arbori de Decizie

Un arbore de decizie este un model intuitiv, dar care poate supraînvăța ușor. Inițial, modelul a obținut o MAE de 0.000 pe setul de antrenament, indicând o supraînvățare severă, și o MAE de 4.208 pe setul de test. Prin limitarea adâncimii maxime a arborelui (max_depth=11), am reușit să reducem supraînvățarea, obținând o MAE de 0.593 pe setul de antrenament și o ușoară îmbunătățire la 4.190 pe setul de test. Această ajustare a demonstrat importanța reglării parametrilor pentru a asigura generalizarea modelului.

Păduri Aleatoare (Random Forest)

Pădurile Aleatoare combină un număr mare de arbori de decizie pentru a îmbunătăți precizia și a reduce supraînvățarea. Aplicând o pădure aleatoare cu 100 de estimatori (arbori), am obținut o MAE de 1.428 pe setul de antrenament și o MAE de 3.351 pe setul de test. Aceasta a fost cea mai bună performanță dintre toate modelele testate, fără nicio ajustare specifică a parametrilor în afara numărului de estimatori. Chiar și cu o adâncime maximă a arborelui (max_depth=11), performanța a rămas similară, indicând că parametrii impliciti funcționează excelent pentru acest model.

Gradient Boosting

Gradient Boosting combină, de asemenea, arbori de decizie, dar într-o manieră secvențială, unde fiecare arbore corectează erorile arborelui precedent. Modelul inițial a avut o MAE de 2.355 pe setul de antrenament și 3.634 pe setul de test. Încercările de a reduce supraînvățarea prin limitarea adâncimii maxime (max_depth=1) sau reducerea ratei de învățare (learning_rate=0.01) au crescut MAE pe setul de antrenament, dar, în acest caz specific, nu au îmbunătățit MAE pe setul de test, sugerând că setările implicite au fost deja aproape optime sau că modelul era deja bine echilibrat.

Mașini cu Vector Suport (SVM)

Mașinile cu Vector Suport (SVM) sunt algoritmi puternici de regresie, dar necesită ca toate caracteristicile să fie la o scară similară. Fără scalare, MAE a fost de 7.704 pe setul de antrenament și 8.707 pe setul de test. După aplicarea scalării Min-Max, MAE s-a îmbunătățit drastic la 5.355 pe setul de antrenament și 6.390 pe setul de test. Ajustarea parametrului gamma la 10 a condus la o îmbunătățire ulterioară, cu o MAE de 5.021 pe setul de antrenament și 5.872 pe setul de test, demonstrând importanța preprocesării datelor pentru SVM.

Învățare Profundă (Deep Learning - MLP)

Rețelele neuronale (MLP - Multilayer Perceptron) sunt algoritmi flexibili, dar la fel ca SVM, sunt sensibile la scalarea datelor. Inițial, fără scalare, MAE a fost de 8.439 pe setul de antrenament și 9.663 pe setul de test. După scalarea datelor cu StandardScaler, MAE a scăzut la 6.635 pe setul de antrenament și 7.018 pe setul de test. Creșterea numărului de iterații (max_iter=1000) a adus o îmbunătățire semnificativă, cu o MAE de 4.069 pe setul de antrenament și 4.510 pe setul de test. Chiar și cu ajustări suplimentare (alpha=1), nu am reușit să reducem MAE pe setul de test mai mult, dar rezultatul a fost competitiv.

Comparația MAE pe Setul de Test

Rezultatele MAE pentru fiecare model pe setul de test, sortate de la cel mai bun la cel mai puțin bun, sunt prezentate mai jos. Această comparație subliniază clar performanța superioară a Pădurilor Aleatoare în acest caz specific.

| Algoritm | MAE pe Setul de Test |

|---|---|

| Random Forest Regressor | 3.351 |

| Decision Tree Regressor (max_depth=11) | 4.190 |

| MLP Regressor (scaled, max_iter=1000) | 4.510 |

| Gradient Boosting Regressor | 3.634 |

| Linear Regression | 6.576 |

| Support Vector Regressor (scaled, gamma=10) | 5.872 |

| KNN Regressor (n_neighbors=6) | 7.955 |

Așa cum se poate observa, modelul Random Forest Regressor a obținut cea mai mică eroare medie absolută pe setul de test, confirmându-se ca fiind cel mai performant pentru această problemă specifică. Această analiză detaliată a MAE ne-a permis să identificăm cel mai bun model și să înțelegem impactul diferitelor ajustări asupra performanței acestuia.

Importanța Caracteristicilor (Feature Importance)

Pe lângă evaluarea erorii, înțelegerea importanței caracteristicilor este un aspect crucial al modelării. Atât Arborii de Decizie, cât și Pădurile Aleatoare oferă o perspectivă asupra cât de mult contribuie fiecare caracteristică la deciziile modelului. În exemplul nostru, caracteristica „FT.9” s-a dovedit a fi de departe cea mai importantă, urmată de „Peak.us”. Această informație este valoroasă pentru a înțelege ce factori influențează cel mai mult variabila țintă și poate ghida eforturile viitoare de colectare a datelor sau de inginerie a caracteristicilor.

MAE și Alte Metricile de Erori pentru Modelul Ales (Random Forest)

Odată ce am identificat cel mai bun model, este util să examinăm și alte metrici pentru a obține o imagine completă a performanței sale. Pentru modelul nostru Random Forest, am calculat următoarele:

- R-squared (R²): Această metrică indică proporția varianței din variabila dependentă care poate fi explicată de variabilele independente. Un R² de 0.8639 pentru modelul nostru Random Forest este un rezultat excelent, sugerând că 86.39% din variabilitatea în „Tag.Mpa” poate fi explicată de caracteristicile utilizate.

- Mean Squared Error (MSE): MSE pentru modelul nostru este de 20.0613. Deși valoarea în sine nu are o interpretare fizică directă (fiind în unități pătratice), este utilă pentru comparații interne și pentru algoritmii care minimizează erorile pătratice.

- Root Mean Squared Error (RMSE): RMSE este rădăcina pătrată a MSE, aducând eroarea înapoi la aceeași scară cu variabila țintă. Un RMSE de 4.4790 înseamnă că modelul nostru a putut prezice „Tag.Mpa” în limita a ±4.4790 unități de la valoarea reală, utilizând distanțe euclidiene.

- Mean Absolute Error (MAE): Reconfirmând rezultatul, MAE pentru modelul nostru este de 3.3511. Aceasta înseamnă că, în medie, predicțiile modelului nostru sunt la o distanță de ±3.3511 unități de valoarea reală a „Tag.Mpa”, utilizând distanțe Manhattan (taxicab). Această interpretare directă este motivul pentru care MAE este atât de apreciată.

- Mean Squared Logarithmic Error (MSLE): MSLE este o metrică care penalizează subestimările mai mult decât supraestimările și este utilă atunci când dorim să măsurăm eroarea în termeni procentuali. Un MSLE de 2.3770% indică faptul că modelul a putut prezice „Tag.Mpa” în limita a ±2.3770% față de valoarea reală.

Analizând diferențele dintre valorile prezise și cele reale, am observat o ușoară tendință de subestimare a valorilor „Tag.Mpa”, ceea ce, în multe proiecte de știința datelor, nu reprezintă o problemă majoră, atâta timp cât eroarea medie este controlată.

Întrebări Frecvente (FAQ)

De ce este MAE preferată uneori în locul MSE?

MAE este preferată în locul MSE (sau RMSE) atunci când valorile aberante (outliers) sunt prezente în date și nu doriți ca acestea să distorsioneze semnificativ metrica de eroare. Deoarece MAE folosește valorile absolute ale erorilor, nu le ridică la pătrat, ceea ce înseamnă că erorile mari nu sunt penalizate disproporționat. Acest lucru face MAE mai robustă și mai ușor de interpretat în aceleași unități cu variabila țintă.

Poate MAE fi negativă?

Nu, MAE nu poate fi niciodată negativă. Prin definiție, MAE calculează media valorilor absolute ale diferențelor. O valoare absolută este întotdeauna zero sau pozitivă, prin urmare, media lor va fi întotdeauna zero sau pozitivă. Cea mai mică valoare pe care o poate lua MAE este zero, indicând o potrivire perfectă a modelului.

Ce înseamnă o MAE de 0?

O MAE de 0 înseamnă că modelul prezice fiecare valoare exact, fără nicio eroare. Este o potrivire perfectă între predicțiile modelului și valorile reale din setul de date. Acest lucru este rar în practică, mai ales pe seturi de date de test nevăzute, și poate indica uneori o supraînvățare severă dacă se întâmplă pe setul de antrenament.

Este o MAE mai mică întotdeauna mai bună?

Da, în general, o valoare MAE mai mică indică o performanță mai bună a modelului, deoarece înseamnă că, în medie, predicțiile modelului sunt mai aproape de valorile reale. Cu cât MAE este mai aproape de zero, cu atât modelul este mai precis. Cu toate acestea, interpretarea „cât de bună” este o MAE depinde de contextul specific al datelor și de toleranța la eroare a aplicației.

Cum afectează scalarea datelor MAE?

Scalarea datelor nu afectează direct valoarea MAE în sine, ci afectează capacitatea anumitor algoritmi de învățare automată (cum ar fi Mașinile cu Vector Suport - SVM sau Rețelele Neuronale - MLP) de a învăța eficient și, prin urmare, de a obține o MAE optimă. Acești algoritmi sunt sensibili la scara caracteristicilor, iar scalarea datelor asigură că toate caracteristicile contribuie în mod echitabil la procesul de învățare, ducând la o performanță îmbunătățită și, implicit, la o MAE mai mică.

Concluzie

Eroarea Medie Absolută (MAE) este o metrică fundamentală și extrem de utilă în evaluarea modelelor de regresie. Simplitatea sa, robustetea la outlieri și interpretabilitatea directă în unitățile originale ale datelor o fac o alegere excelentă pentru multe scenarii. Prin aplicarea și compararea MAE pe diverse modele de învățare automată, așa cum am exemplificat cu setul de date de beton, putem identifica cel mai performant model și înțelege mai bine comportamentul datelor noastre. Această abordare sistematică este esențială pentru a construi modele predictive fiabile și eficiente, capabile să transforme datele brute în informații acționabile. Continuarea explorării și experimentării cu diferite algoritmi și metrici este cheia pentru a deveni un expert în lumea învățării automate.

Dacă vrei să descoperi și alte articole similare cu MAE: Măsurarea Preciziei Modelelor de Regresie, poți vizita categoria Fitness.