09/03/2022

Într-o eră dominată de progrese uimitoare în inteligența artificială, înțelegerea fundamentelor care au pavat calea pentru algoritmii moderni este esențială. Printre aceste pietre de temelie se numără Rețelele de Credință Profundă (DBN), introduse de Geoffrey Hinton și echipa sa în 2006. Aceste algoritmi de învățare profundă, inovatori la vremea lor, utilizează conceptul de variabile latente pentru a descoperi tipare subiacente complexe în seturile de date. Prin structura lor unică, care implică noduri conectate într-un graf aciclic dirijat (DAG), DBN-urile au demonstrat capacități atât generative, cât și discriminative, marcând un pas important în evoluția învățării automate.

Deși similare cu perceptronii multi-strat (MLP) tradiționali, DBN-urile au adus beneficii notabile, cum ar fi un antrenament mai rapid și o inițializare mai eficientă a ponderilor. Acest articol va explora în detaliu principiul de funcționare al Rețelelor de Credință Profundă, arhitectura lor bazată pe Mașini Boltzmann Restricționate (RBM), procesul lor de antrenament, beneficiile cheie și aplicațiile lor, precum și starea lor actuală în peisajul inteligenței artificiale.

- Ce Sunt Rețelele de Credință Profundă (DBN)?

- Arhitectura DBN-urilor: Fundamentul Mașinilor Boltzmann Restricționate (RBM)

- Antrenarea unei Rețele de Credință Profundă

- Beneficiile Cheie ale DBN-urilor

- Aplicații ale DBN-urilor

- Starea Actuală a Rețelelor de Credință Profundă

- Tabel Comparativ: Faze de Antrenament DBN

- Întrebări Frecvente (FAQ) despre DBN-uri

Ce Sunt Rețelele de Credință Profundă (DBN)?

La baza Rețelelor de Credință Profundă stau mai multe straturi de neuroni, fiecare strat fiind conectat doar cu neuronii stratului următor, fără conexiuni intra-strat. Această arhitectură generală, deși amintește de un MLP, permite o abordare distinctă a învățării. Fiecare strat al unei DBN poate fi considerat un model separat, antrenat independent pe ieșirea stratului anterior. Astfel, o DBN este, în esență, o stivă de rețele, fiecare dintre ele învățând caracteristici și trăsături diferite din datele brute.

Această arhitectură neurală stratificată și complexă permite DBN-urilor să abordeze atât probleme de învățare supervizată, cât și nesupervizată. Mai mult, capacitatea lor de a înțelege tipare complexe subiacente ale datelor le face excelente pentru aplicații generative, cum ar fi generarea de imagini sau text. Pentru a înțelege pe deplin cum funcționează o DBN, este crucial să explorăm componenta sa fundamentală: Mașinile Boltzmann Restricționate.

Arhitectura DBN-urilor: Fundamentul Mașinilor Boltzmann Restricționate (RBM)

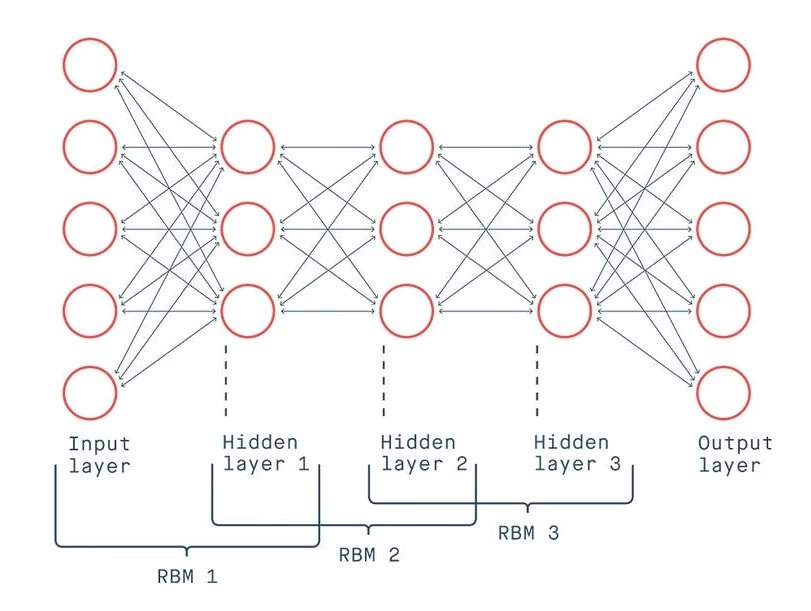

O Rețea de Credință Profundă este o stivă de multiple structuri de Mașini Boltzmann Restricționate (RBM), care formează baza arhitecturilor profunde. Fiecare dintre aceste RBM-uri constă dintr-un strat vizibil și un strat ascuns. Stratul vizibil primește intrarea de la stratul anterior (sau datele brute în cazul primului RBM), în timp ce stratul ascuns stochează ieșirea procesată. Pentru o înțelegere mai bună, trebuie să înțelegem mai întâi ce este o RBM.

Mașinile Boltzmann Restricționate (RBM)

O Mașină Boltzmann Restricționată este o rețea neurală probabilistică cu două straturi. Conceptul său a fost introdus pentru prima dată în 1986 sub denumirea de model Harmonium, dar termenul RBM nu a fost folosit pe scară largă până la mijlocul anilor 2000. Primul său strat (stratul vizibil) interacționează cu datele brute, iar al doilea (stratul ascuns) învață caracteristici de nivel înalt din primul. Sunt numite "Restricționate" deoarece conexiunile există doar între neuronii din straturi succesive (vizibil și ascuns), și nu există conexiuni intra-strat.

RBM-urile au avut performanțe excelente în formarea reprezentărilor de date și au câștigat popularitate în sarcini precum filtrarea colaborativă. Fiecare RBM din cadrul unei DBN este un model bazat pe energie. Aceasta înseamnă că utilizează o valoare energetică pentru a defini relația dintre unitățile sale ascunse și vizibile. Valoarea energetică este calculată folosind o combinație liniară a activărilor unităților, combinații pereche ale activărilor și orice bias-uri asociate cu unitățile. O energie mai mică înseamnă o probabilitate mai mare de asociere între unități. Prin minimizarea valorii energetice pentru întreaga rețea, RBM-ul construiește o reprezentare plauzibilă a datelor originale.

Structura DBN-urilor

O Rețea de Credință Profundă extinde funcționalitatea RBM-urilor prin crearea unor stive suprapuse de modele. Stivele se suprapun deoarece stratul ascuns al unui model devine stratul vizibil al următorului. Aceste RBM-uri sunt antrenate independent, iar arhitectura generală formează rețeaua de credință profundă. Această abordare stratificată permite extragerea ierarhică a caracteristicilor, unde fiecare strat succesiv învață reprezentări din ce în ce mai abstracte și mai complexe ale datelor de intrare.

Antrenarea unei Rețele de Credință Profundă

Antrenarea unei rețele de credință profundă constă dintr-o fază de pre-antrenare și apoi o reglare fină specifică sarcinii. Aceste două metodologii reprezintă un hibrid de abordări de învățare nesupervizată și supervizată, valorificând punctele forte ale ambelor.

Faza de Pre-antrenare

Faza de pre-antrenare are ca scop inițializarea DBN-ului astfel încât ponderile antrenate să reprezinte direct datele de intrare. Această fază este realizată prin învățare nesupervizată, antrenând fiecare modul RBM independent ca un detector de caracteristici. Primul strat al ansamblului (adesea numit stratul de intrare sau stratul de bază) interacționează direct cu datele brute, învățând caracteristicile acestora și creând o reprezentare latentă în timpul procesului. Fiecare strat ulterior este apoi antrenat astfel încât ieșirea primului să devină intrarea următorului. Această învățare stratificată, "lacomă" (greedy layer-wise learning), permite o învățare eficientă a caracteristicilor.

Antrenarea RBM-ului este realizată folosind algoritmul Contrastive Divergence. Antrenamentul cuprinde o fază pozitivă și o fază negativă. Faza pozitivă eșantionează activarea stratului vizibil pentru a calcula probabilitățile de activare a unităților ascunse, și invers pentru faza negativă. Acest proces este iterat de mai multe ori, acoperind diverse eșantioane de date și actualizând ponderile după fiecare trecere. În cele din urmă, ultimul strat (strat de ieșire) produce predicția rețelei.

Faza de Reglare Fină (Fine-tuning)

Odată ce am finalizat pre-antrenarea și am inițializat ponderile modelului, acesta este ajustat în continuare pentru sarcini specifice ulterioare. Realizăm reglarea fină utilizând date etichetate și un algoritm de învățare supervizată, cum ar fi backpropagation. În acest fel, modelul poate fi antrenat pentru diverse sarcini, inclusiv clasificare sau regresie, iar ponderile inițializate corect duc la un antrenament mai rapid și rezultate mai bune. Această combinație de pre-antrenare nesupervizată și reglare fină supervizată permite DBN-urilor să învețe reprezentări robuste ale datelor, care sunt apoi adaptate eficient pentru sarcini specifice.

Beneficiile Cheie ale DBN-urilor

Rețelele de Credință Profundă, prin modelarea probabilistică și abordarea lor de învățare hibridă, oferă anumite avantaje față de rețelele neurale convenționale. Acestea includ:

- Capacitatea de a gestiona volume mari de date: Utilizarea unităților ascunse pentru a extrage corelații subiacente complexe.

- Antrenament mai rapid și rezultate îmbunătățite: Datorită inițializării ponderilor prin pre-antrenare.

- Atingerea minimelor globale: O inițializare mai bună a ponderilor ajută la evitarea minimelor locale în spațiul de optimizare.

- Învățare ierarhică a caracteristicilor: Fiecare strat învață reprezentări din ce în ce mai abstracte, utile pentru înțelegerea datelor complexe.

Aplicații ale DBN-urilor

Rețelele de Credință Profundă funcționează similar cu rețelele neurale profunde și pot gestiona seturi de date mari și diverse tipuri de date. Prin urmare, sunt excelente pentru sarcini precum:

- Clasificarea imaginilor: Recunoașterea și categorisirea obiectelor sau scenelor în imagini.

- Clasificarea textului: Categorisirea documentelor sau a fragmentelor de text.

- Generarea de imagini: Crearea de noi imagini care imită stilul și caracteristicile datelor de antrenament.

- Recunoașterea vorbirii: Transcrierea vorbirii umane în text.

- Captura mișcării: Înțelegerea și replicarea mișcărilor umane sau ale altor entități.

- Sisteme de recomandare: Identificarea preferințelor utilizatorilor și sugerarea de produse sau conținut relevant.

Starea Actuală a Rețelelor de Credință Profundă

Deși au demonstrat capacități hibride remarcabile, Rețelele de Credință Profundă nu au câștigat o popularitate pe scară largă în comparație cu alți algoritmi moderni de învățare profundă. Unul dintre motivele principale a fost faptul că modelul probabilistic necesita o cantitate mare de date pentru a înțelege corect tiparele subiacente, similar cu descenta de gradient. Pe de altă parte, progresele în rețelele profunde convenționale, cum ar fi Rețelele Neurale Convoluționale (CNN-uri) pentru viziune computerizată, Rețelele Neurale Recurente (RNN-uri) pentru date secvențiale și Rețelele Neurale Artificiale (ANN-uri) în general, au oferit rezultate revoluționare.

Acești algoritmi au devenit mai eficienți în timp și constituie astăzi bazele majorității aplicațiilor moderne de viziune computerizată (CV) și procesare a limbajului natural (NLP). Deși Rețelele de Credință Profundă au jucat un rol vital în creșterea și evoluția învățării profunde, ele nu sunt la fel de comune astăzi, fiind în mare parte înlocuite de arhitecturi mai performante și mai ușor de antrenat pentru majoritatea sarcinilor.

Tabel Comparativ: Faze de Antrenament DBN

Pentru a înțelege mai bine procesul de antrenament al unei DBN, iată o comparație între cele două faze principale:

| Aspect | Pre-antrenare (Nesupervizată) | Reglare Fină (Supervizată) |

|---|---|---|

| Scop principal | Inițializarea ponderilor, învățarea reprezentărilor generice ale datelor | Optimizarea ponderilor pentru o sarcină specifică (clasificare, regresie) |

| Tip de învățare | Nesupervizată (fără etichete) | Supervizată (cu etichete) |

| Algoritmi utilizați | Contrastive Divergence (pentru RBM-uri individuale) | Backpropagation |

| Date necesare | Date brute, neetichetate | Date etichetate (set de antrenament, validare) |

| Beneficiu cheie | Inițializare bună a ponderilor, evitarea minimelor locale, învățarea caracteristicilor | Performanță optimizată pentru sarcina finală, convergență rapidă |

Întrebări Frecvente (FAQ) despre DBN-uri

- Ce este o Mașină Boltzmann Restricționată (RBM) și de ce este importantă pentru DBN-uri?

- O Mașină Boltzmann Restricționată (RBM) este o rețea neurală probabilistică cu două straturi (vizibil și ascuns) care învață reprezentări de nivel înalt din datele de intrare. Este fundamentală pentru DBN-uri deoarece o DBN este construită prin stivuirea mai multor RBM-uri, unde stratul ascuns al unui RBM devine stratul vizibil al următorului. Această structură permite DBN-urilor să învețe ierarhic caracteristici complexe.

- De ce Rețelele de Credință Profundă nu sunt la fel de populare astăzi ca alte arhitecturi de învățare profundă?

- Deși au fost inovatoare, DBN-urile au fost în mare parte înlocuite de algoritmi precum Rețelele Neurale Convoluționale (CNN-uri) și Rețelele Neurale Recurente (RNN-uri). Acestea din urmă au demonstrat performanțe superioare și sunt mai eficiente pentru majoritatea sarcinilor moderne de viziune computerizată și procesare a limbajului natural, în parte datorită avansurilor în puterile de calcul și tehnicilor de antrenament. DBN-urile au avut nevoie de o cantitate mare de date și au fost mai dificil de antrenat în comparație cu arhitecturile mai noi.

- Ce înseamnă "greedy layer-wise learning" în contextul antrenării DBN-urilor?

- „Greedy layer-wise learning” se referă la procesul de antrenare a fiecărui strat al DBN-ului (care este un RBM) independent, unul după altul. Primul RBM este antrenat pe datele de intrare brute, apoi ieșirea (reprezentarea învățată) a primului RBM devine intrarea pentru al doilea RBM, și așa mai departe. Acest proces este "lacom" deoarece fiecare strat încearcă să optimizeze reprezentarea datelor pentru el însuși, fără a lua în considerare optimizarea globală a întregii rețele până la faza de reglare fină. Această metodă a permis antrenarea eficientă a rețelelor profunde într-o perioadă în care backpropagation-ul era dificil de aplicat pe rețele cu multe straturi.

Rețelele de Credință Profundă au reprezentat o parte crucială a ecosistemului de învățare profundă și au jucat un rol esențial în dezvoltarea domeniului. Deși arhitectura DBN nu este foarte populară astăzi și a fost înlocuită de algoritmi de învățare profundă mai performanți, cum ar fi CNN-urile și RNN-urile, contribuția lor la înțelegerea și avansarea învățării profunde rămâne semnificativă. Ele ne amintesc de evoluția constantă a inteligenței artificiale și de importanța cercetării fundamentale în deschiderea de noi drumuri.

Dacă vrei să descoperi și alte articole similare cu Rețelele de Credință Profundă (DBN): O Analiză Completă, poți vizita categoria Fitness.