05/02/2025

De multe ori, atunci când analizăm date, avem tendința de a ne imagina o relație liniară între două variabile. Presupunem că, dacă mărim predictorul cu o unitate, răspunsul va crește întotdeauna cu un anumit număr de unități. Însă, realitatea datelor este adesea mult mai complexă. Nu toate relațiile sunt liniare, iar pentru a obține un model precis și predicții fiabile, este esențial ca modelul nostru să poată capta curbele prezente în date. Ignorarea acestor curbe poate duce la erori semnificative și la concluzii greșite. Din fericire, Minitab Statistical Software oferă o gamă largă de metode pentru ajustarea curbelor, atât prin regresia liniară, cât și prin regresia neliniară, permițându-ne să depășim limitările modelelor liniare simple.

- De Ce Relațiile Liniare Nu Sunt Suficiente?

- Ajustarea Curvelor cu Termeni Polinomiali în Regresia Liniară

- Ajustarea Curvelor cu Termeni Reciproci în Regresia Liniară

- Transformarea Variabilelor cu Funcții Logaritmice în Regresia Liniară

- Ajustarea Curvelor cu Regresia Neliniară

- Compararea Eficacității Metodelor de Ajustare a Curvelor

- Cum se Calculează o Linie de Regresie prin Metoda Celor Mai Mici Pătrate în Minitab?

- Întrebări Frecvente (FAQ)

- Gânduri de Încheiere

De Ce Relațiile Liniare Nu Sunt Suficiente?

Imaginați-vă un set de date care, atunci când este reprezentat grafic, formează o curbă clară. Dacă încercăm să ajustăm o linie dreaptă la aceste date, rezultatul va fi adesea o potrivire deficitară. Linia de regresie va supraestima și subestima sistematic datele în diferite puncte ale curbei, indicând o eroare predictivă consistentă. Acest fenomen subliniază un adevăr important: un coeficient de determinare (R-squared) ridicat nu este întotdeauna singurul indicator al unei potriviri bune. Chiar și cu un R-squared impresionant, un model liniar aplicat unor date curbe poate eșua lamentabil în a oferi predicții exacte și în a capta adevărata relație dintre variabile. Este crucial să evaluăm nu doar valoarea R-squared, ci și reziduurile și graficul liniei ajustate pentru a detecta orice tipar sistematic de eroare, care ar indica o potrivire inadecuată.

Ajustarea Curvelor cu Termeni Polinomiali în Regresia Liniară

Una dintre cele mai comune și accesibile metode de a ajusta curbele la date folosind regresia liniară este includerea termenilor polinomiali. Aceasta implică adăugarea unor predictori elevați la putere (cum ar fi predictori la pătrat sau la cub) în ecuația de regresie. De exemplu, un termen pătrat (X^2) permite modelului să formeze o singură îndoire în linie, în timp ce un termen cub (X^3) permite două îndoiri. În general, fiecare creștere a exponentului produce o îndoire suplimentară în linia curbată ajustată. Este foarte rar să se utilizeze termeni cu puteri mai mari de trei, deoarece modelele devin rapid prea complexe și pot duce la supra-ajustare (overfitting), adică la o potrivire excelentă pe datele de antrenament, dar o performanță slabă pe date noi.

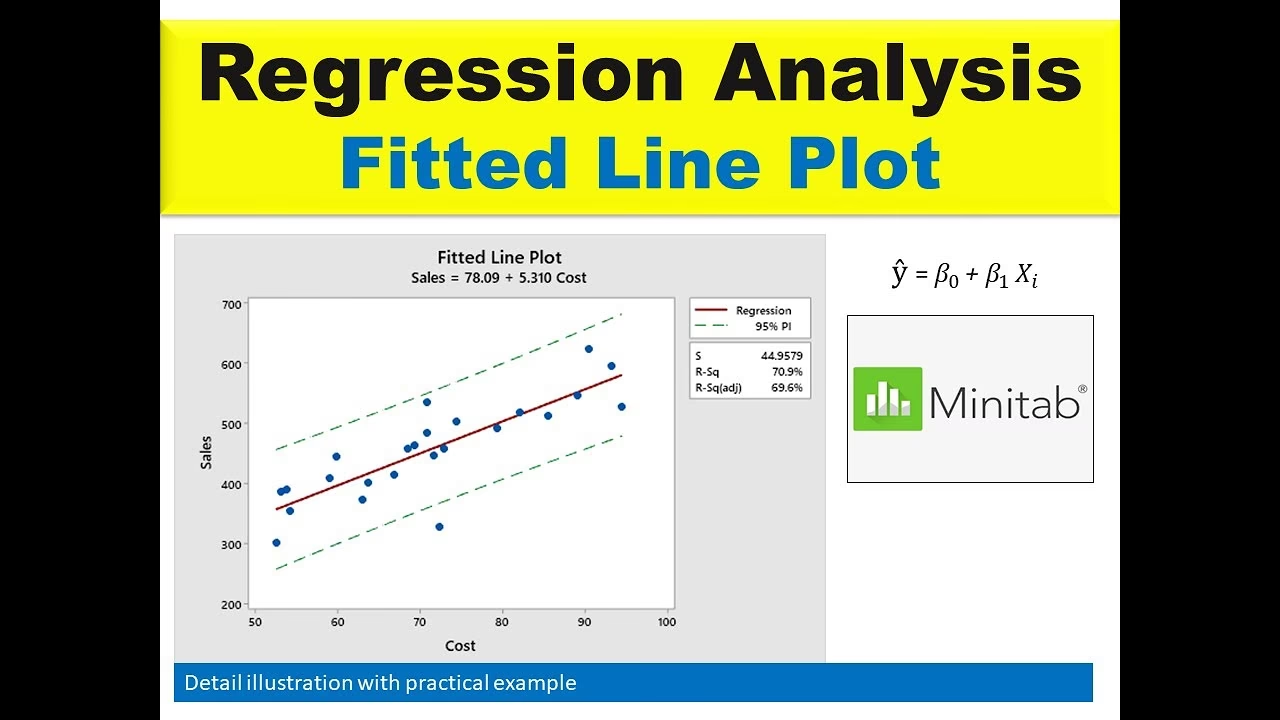

În Minitab, puteți implementa regresia polinomială utilizând opțiunea Stat > Regression > Fitted Line Plot.... În fereastra de dialog, selectați variabila de răspuns (Y) și variabila predictor (X). Apoi, sub "Type of Regression Model", selectați "Polynomial" și specificați ordinul polinomului (de exemplu, 2 pentru un model cuadratic, 3 pentru un model cubic). Minitab va crea automat termenii polinomiali necesari și va ajusta modelul. Deși această metodă poate îmbunătăți semnificativ potrivirea pentru datele curbe, este important să examinați graficul liniei ajustate. În exemplul nostru, chiar și un model cuadratic cu un R-squared ridicat a arătat o supraestimare și subestimare sistematică a datelor, demonstrând că un R-squared mare nu este întotdeauna suficient pentru a valida un model.

Ajustarea Curvelor cu Termeni Reciproci în Regresia Liniară

Pentru anumite tipuri de curbe, în special cele în care răspunsul se apropie de o valoare minimă (un "podea") sau maximă (un "tavan" sau o asimptotă) pe măsură ce predictorul crește, includerea termenilor reciproci în regresia liniară poate fi extrem de eficientă. Un termen reciproc este de forma 1/X, unde X este variabila predictor. Mai general, această formă este utilă atunci când dimensiunea efectului unei variabile predictive scade pe măsură ce valoarea sa crește.

Matematic, deoarece panta este o funcție de 1/X, panta devine mai plată pe măsură ce X crește, ceea ce simulează comportamentul asimptotic. Este important de reținut că, în acest tip de model, variabila X nu poate fi niciodată egală cu 0, deoarece împărțirea la zero nu este permisă. Pentru a crea o coloană cu valorile reciproce (de exemplu, "InvInput" pentru 1/Input), puteți utiliza Calc > Calculator... în Minitab. Acolo, puteți introduce o formulă precum 'InvInput' = 1 / 'Input'. Odată ce aveți această nouă variabilă, o puteți include în modelul de regresie liniară, fie ca termen liniar (1/X), fie chiar ca termen pătrat (1/X)^2, dacă observați o îndoire suplimentară în relația reciprocă.

În exemplul dat, modelul reciproc cuadratic (adică, incluzând atât 1/X cât și (1/X)^2) a oferit o potrivire mult mai bună decât modelul polinomial simplu. Acest model a avut o valoare S mai mică (ceea ce este de dorit, indicând o dispersie mai mică a punctelor în jurul liniei ajustate) și un R-squared mai mare, fără a prezenta predicții părtinitoare. Aceasta a demonstrat o capacitate superioară de a capta asimptota vizibilă în date, reprezentând cel mai bun model de până acum.

Transformarea Variabilelor cu Funcții Logaritmice în Regresia Liniară

Transformările logaritmice sunt o altă metodă puternică ce permite regresiei liniare să realizeze o ajustare a curbelor care altfel ar fi posibilă doar prin regresia neliniară. Aceste transformări pot liniariza relații care sunt intrinsec neliniare. De exemplu, o funcție neliniară de forma Y = e^(B0 + B1*X1 + B2*X2) poate fi exprimată într-o formă liniară aplicând logaritmul natural (Ln) ambelor părți: Ln(Y) = B0 + B1*Ln(X1) + B2*Ln(X2). Aceasta este cunoscută sub denumirea de formă dublu-logaritmică.

Alternativ, puteți aplica logaritmul doar uneia dintre părți, creând o formă semi-logaritmică. Dacă aplicați logaritmul variabilelor predictive, puteți face acest lucru pentru toate sau doar pentru o parte dintre ele. Alegerea între o formă dublu-logaritmică și una semi-logaritmică (fie pentru răspuns, fie pentru predictori) depinde de specificul datelor dumneavoastră și de cunoștințele din domeniul de studiu. Aceste forme funcționale logaritmice pot fi extrem de eficiente în modelarea anumitor tipuri de curbe, în special cele care prezintă o creștere sau descreștere exponențială sau o rată de schimbare care se modifică proporțional cu valoarea variabilelor.

În Minitab, opțiunea Fitted Line Plot... oferă în mod convenabil posibilitatea de a transforma logaritmic una sau ambele părți ale modelului. Puteți selecta opțiunile de transformare (de exemplu, "Log" pentru predictor) direct în fereastra de dialog. În exemplul nostru, un model semi-logaritmic (transformând doar variabila predictor) a arătat o potrivire vizuală similară cu modelul cuadratic, cu valori S și R-squared aproape identice. Aceasta a confirmat că, pentru setul nostru de date specific, modelul liniar cu termeni reciproci a rămas cel mai bun ajustaj.

Ajustarea Curvelor cu Regresia Neliniară

Regresia neliniară este o alternativă puternică la regresia liniară, oferind cea mai flexibilă funcționalitate de ajustare a curbelor. Spre deosebire de regresia liniară, care modelează relații liniare sau cele care pot fi liniarizate prin transformări, regresia neliniară ajustează direct funcții neliniare la date. Trucul este să găsești funcția neliniară care se potrivește cel mai bine curbei specifice din datele tale. Din fericire, Minitab oferă instrumente pentru a facilita acest proces.

În Minitab, navigați la Stat > Regression > Nonlinear Regression.... Aici, veți introduce variabila de răspuns. Apoi, puteți face clic pe butonul "Use Catalog" pentru a alege dintr-o selecție de funcții neliniare predefinite pe care Minitab le pune la dispoziție. Acestea includ funcții asimptotice, logistice, exponențiale și multe altele. Pentru datele care se apropie de o asimptotă, cum ar fi în exemplul nostru, puteți selecta una dintre funcțiile de regresie asimptotică (de exemplu, versiunea concavă, dacă se potrivește vizual cu datele dumneavoastră).

Odată selectată funcția, Minitab va solicita să introduceți variabila predictor. Un aspect cheie al regresiei neliniare, care o diferențiază de regresia liniară, este necesitatea de a furniza valori de pornire pentru fiecare parametru din funcție. Algoritmul de regresie neliniară este iterativ, ceea ce înseamnă că începe cu aceste valori inițiale și ajustează parametrii pas cu pas pentru a găsi cea mai bună potrivire. Dacă nu aveți o idee clară despre aceste valori, Minitab facilitează estimarea lor. De exemplu, pentru o funcție asimptotică, unul dintre parametri (Theta1) reprezintă adesea asimptota la care se apropie datele. Vizualizând graficul de dispersie inițial, puteți estima o valoare rezonabilă pentru această asimptotă (de exemplu, în jurul valorii de 20 pentru exemplul nostru). Ceilalți parametri (Theta2, Theta3) pot fi adesea inițializați cu valori simple, cum ar fi 1, dacă nu există alte indicii.

După introducerea valorilor de pornire, Minitab va rula algoritmul și va afișa rezultatele. Deși regresia neliniară nu calculează R-squared (deoarece interpretarea sa este ambiguă în context neliniar), ea oferă valoarea S, care este o măsură a dispersiei punctelor de date în jurul curbei ajustate. O valoare S mică indică o potrivire bună. În exemplul nostru, valoarea S pentru modelul neliniar (0.179746) a fost foarte aproape de cea a modelului reciproc (0.134828), confirmând o potrivire excelentă și absența unei părtiniri sistematice.

Compararea Eficacității Metodelor de Ajustare a Curvelor

Pentru a determina cel mai bun model, este esențial să comparăm performanțele diferitelor metode. Iată o comparație a modelelor discutate, bazată pe un exemplu specific:

| Model | R-squared | S | Predicții părtinitoare |

|---|---|---|---|

| Reciproc - Cuadratic | 99.9% | 0.134828 | Nu |

| Neliniar (Asimptotic) | N/A | 0.179746 | Nu |

| Cuadratic (Polinomial) | 99.0% | 0.518387 | Da |

| Semi-Logaritmic | 98.6% | 0.565293 | Da |

| Reciproc - Liniar | 90.4% | 1.49655 | Da |

| Liniar | 84.0% | 1.93253 | Da |

Din această comparație, reiese clar că modelul liniar cu termenul reciproc cuadratic și modelul neliniar asimptotic au oferit cele mai bune potriviri pentru datele noastre curbe. Ambele modele au produs predicții la fel de bune pentru relația curbată. Cu toate acestea, modelul de regresie liniară cu termeni reciproci oferă avantaje suplimentare, cum ar fi valorile p pentru predictori (toți semnificativi în exemplul dat) și un R-squared interpretabil (99.9%), statistici care nu sunt disponibile pentru un model de regresie neliniară.

În acest caz particular, statisticile suplimentare ale regresiei liniare pot fi utile pentru raportare, chiar dacă rezultatele neliniare sunt la fel de valide din punct de vedere al potrivirii. Totuși, în situațiile în care modelul neliniar oferă o potrivire semnificativ superioară, ar trebui să optați întotdeauna pentru modelul care se potrivește cel mai bine, indiferent de disponibilitatea R-squared sau a valorilor p.

Cum se Calculează o Linie de Regresie prin Metoda Celor Mai Mici Pătrate în Minitab?

Chiar dacă focusul principal este pe curbe, înțelegerea modului de calcul al unei linii de regresie simple este fundamentală în Minitab. Există cel puțin două metode principale pentru a cere Minitab să calculeze o linie de regresie prin metoda celor mai mici pătrate.

Metoda 1: Folosind Graficul Liniei Ajustate (Fitted Line Plot)

Această metodă este rapidă și oferă o vizualizare imediată a liniei de regresie. Introduceți datele în două coloane (de exemplu, Greutate și Înălțime). Apoi, navigați la Stat > Regression > Fitted Line Plot.... În fereastra pop-up, specificați variabila de răspuns (Y, de exemplu, Greutate) și variabila predictor (X, de exemplu, Înălțime). Faceți clic pe OK, iar Minitab va afișa o nouă fereastră grafică ce conține ecuația de regresie estimată și graficul liniei de regresie.

Metoda 2: Folosind Analiza de Regresie (Regression Analysis)

Această metodă oferă o analiză mai detaliată a regresiei. După ce ați introdus datele, selectați Stat > Regression > Regression > Regression.... Similar cu metoda anterioară, introduceți variabila de răspuns și variabila predictor. Când faceți clic pe OK, Minitab va afișa o analiză completă în fereastra Session, incluzând ecuația de regresie, coeficienții, erorile standard, valorile T și p, precum și S, R-squared și R-squared (adj).

Calcularea Regresiei cu Variabile Centrate

Minitab estimează, în mod implicit, ecuația de regresie de forma &haty_i = a_1 + b*x_i. Pentru a estima o ecuație de forma &haty_i = a + b(x_i - &barx), unde &barx este media predictorului, trebuie mai întâi să calculați media predictorului. Acest lucru se poate face folosind Calc > Column Statistics..., selectând "Mean" și variabila predictor. Odată ce aveți media (de exemplu, 69.3 pentru înălțime), puteți crea o nouă variabilă (de exemplu, Înălțime*) folosind Calc > Calculator..., unde 'Înălțime*' = 'Înălțime' - 69.3. Apoi, rulați o nouă analiză de regresie cu această variabilă centrată ca predictor. Această abordare poate fi utilă pentru interpretarea coeficientului de interceptare în contextul mediei predictorului.

Întrebări Frecvente (FAQ)

- Ce este diferența dintre ecuațiile de regresie liniară și neliniară?

- Regresia liniară modelează o relație liniară între variabile sau o relație care poate fi transformată într-una liniară. Ecuația este lineară în parametri (de exemplu, Y = B0 + B1*X). Regresia neliniară modelează relații intrinsec neliniare, unde ecuația este neliniară în parametri (de exemplu, Y = B0*e^(B1*X)). Regresia neliniară este mai flexibilă, dar necesită valori de pornire pentru parametri și nu oferă R-squared în mod tradițional.

- Când ar trebui să folosesc termeni polinomiali?

- Termenii polinomiali sunt utili atunci când observați una sau două îndoiri în relația dintre predictor și răspuns pe un grafic de dispersie. Un termen pătrat (X^2) este potrivit pentru o singură îndoire, iar un termen cub (X^3) pentru două. Este o metodă simplă de a ajusta curbele în cadrul regresiei liniare.

- Cum aleg valorile de pornire pentru regresia neliniară?

- Valorile de pornire sunt cruciale pentru ca algoritmul de regresie neliniară să converge. Cel mai bun mod este să examinați graficul de dispersie al datelor și să estimați vizual parametrii. De exemplu, pentru o funcție asimptotică, valoarea asimptotei poate fi estimată direct din grafic. Minitab oferă, de asemenea, un "Catalog" de funcții care pot include indicii despre interpretarea parametrilor.

- Un R-squared mare înseamnă întotdeauna o potrivire bună?

- Nu neapărat. Un R-squared mare indică faptul că modelul explică o proporție mare din varianța răspunsului, dar nu garantează că modelul este potrivit pentru date. Dacă există tipare sistematice în reziduuri (adică, modelul supraestimează sau subestimează consecvent în anumite zone), sau dacă graficul liniei ajustate arată o potrivire părtinitoare, atunci modelul nu este adecvat, indiferent de R-squared. Întotdeauna examinați graficele de diagnosticare și reziduurile.

Gânduri de Încheiere

Ajustarea unei curbe dificile la date poate părea o sarcină descurajantă, dar, după tot efortul depus pentru colectarea datelor, merită să depuneți efortul pentru a găsi cea mai bună potrivire posibilă. Precizia modelului dumneavoastră depinde în mare măsură de capacitatea sa de a capta adevărata formă a relației dintre variabile.

Atunci când specificați orice model, ar trebui să vă lăsați ghidați de teorie și de cunoștințele specifice domeniului de studiu. Multe domenii au practici standard și funcții specifice pentru modelarea datelor lor, iar consultarea literaturii de specialitate poate oferi direcții valoroase. De exemplu, în fizică sau biologie, anumite procese sunt cunoscute a urma legi exponențiale sau logistice, ceea ce ar sugera utilizarea transformărilor corespunzătoare sau a regresiei neliniare specifice.

Deși doriți o potrivire bună, este important să nu umflați artificial R-squared-ul cu un model excesiv de complicat. Un model prea complex, cu prea mulți termeni sau de un ordin prea înalt, poate duce la supra-ajustare (overfitting). Acest lucru înseamnă că modelul se potrivește perfect zgomotului din datele de antrenament, dar își pierde capacitatea de a generaliza bine pe date noi sau neobservate. Principiul parcimoniei, care sugerează că cel mai simplu model care explică adecvat datele este de preferat, este un ghid valoros aici. Întotdeauna căutați echilibrul între complexitatea modelului și capacitatea sa de a oferi predicții precise și robuste.

Dacă vrei să descoperi și alte articole similare cu Curbe în Minitab: Ghid Complet pentru Analiza Datelor, poți vizita categoria Fitness.