16/01/2026

Rețelele Generative Antagoniste (GAN) au revoluționat domeniul inteligenței artificiale, în special în generarea de imagini și date sintetice care sunt aproape imposibil de distins de cele reale. Cu toate acestea, în spatele rezultatelor lor impresionante se află un proces de antrenament complex și adesea dificil. Spre deosebire de alte modele de învățare automată, antrenamentul unui GAN implică o interacțiune dinamică între două rețele neuronale distincte, fiecare cu propriile sale obiective, ceea ce duce la provocări unice. Acest articol își propune să demistifice procesul de antrenament al GAN-urilor, explorând mecanismele sale interne, dificultățile inerente și, cel mai important, strategiile și bunele practici care pot duce la succes.

La baza oricărui GAN stau două componente principale care lucrează într-o manieră antagonică: Generatorul și Discriminatorul. Aceste două rețele sunt antrenate într-un „joc” competitiv, unde fiecare încearcă să o depășească pe cealaltă. Generatorul are sarcina de a crea date false (de exemplu, imagini false) care să semene cât mai mult cu datele reale. Pe de altă parte, Discriminatorul acționează ca un critic, având rolul de a distinge între datele reale și cele generate de Generator. Scopul final al antrenamentului este ca Generatorul să devină atât de bun încât Discriminatorul să nu mai poată face diferența, având o acuratețe de 50%, adică la fel de bine cum ar ghici pur și simplu.

- Provocările Antrenamentului GAN: De ce este atât de Dificil?

- Antrenamentul Alternativ: O Dansă Delicată

- Problema Convergenței în GAN-uri: Un Obiectiv În Mișcare

- Strategii și Bune Practici pentru un Antrenament Eficient al GAN-urilor

- 1. Cunoașteți-vă Problema și Datele

- 2. Cercetați și Înțelegeți Lucrările Existente

- 3. Utilizați Implementări Existente și Hiperparametrii acestora

- 4. Începeți cu Modele Simple

- 5. Începeți cu Date Simple

- 6. Nu Uitați să Înghețați Greutățile

- 7. Ajustați Rata de Învățare a Discriminatorului

- 8. Asigurați-vă că Toate Componentele Funcționează Individual

- 9. Înregistrați Totul (Logging)

- 10. Priviți Metricile, Nu Doar Imaginile

- Întrebări Frecvente (FAQ) despre Antrenamentul GAN-urilor

Provocările Antrenamentului GAN: De ce este atât de Dificil?

Antrenarea unui GAN este recunoscută ca fiind una dintre cele mai dificile sarcini în învățarea profundă, iar acest lucru se datorează în principal două complicații majore:

- Echilibrarea a Două Tipuri Diferite de Antrenament: Spre deosebire de majoritatea rețelelor neuronale care sunt antrenate pentru o singură sarcină (fie clasificare, fie generare), un GAN implică antrenarea simultană a două rețele cu obiective opuse. Acest lucru necesită o gestionare atentă a procesului de antrenament pentru a asigura că niciuna dintre rețele nu o domină pe cealaltă prea devreme sau prea puternic.

- Dificultatea de a Identifica Convergența: Într-o rețea neuronală tipică, convergența este atinsă atunci când eroarea de antrenament scade și modelul își îmbunătățește performanța pe setul de date de validare. În cazul GAN-urilor, pe măsură ce Generatorul se îmbunătățește, performanța Discriminatorului se înrăutățește (deoarece îi este mai greu să identingă falsurile). Acest lucru face ca feedback-ul de la Discriminator să devină din ce în ce mai puțin semnificativ, iar punctul de convergență să fie adesea un stadiu trecător, nu stabil. Dacă antrenamentul continuă după ce Discriminatorul oferă feedback complet aleatoriu, Generatorul poate începe să se antreneze pe baza unor informații irelevante, iar calitatea sa se poate prăbuși.

Antrenamentul Alternativ: O Dansă Delicată

Dat fiind că Generatorul și Discriminatorul au procese de antrenament diferite, antrenarea întregului GAN se realizează în perioade alternative, într-un mod similar unei „dame de șah” complexe:

- Antrenarea Discriminatorului: Discriminatorul este antrenat pentru una sau mai multe epoci, în timp ce greutățile Generatorului sunt menținute constante (înghețate). În această fază, Discriminatorul învață să distingă datele reale de cele false produse de Generator. Este crucial ca Generatorul să rămână neschimbat, deoarece Discriminatorul trebuie să învețe să recunoască „eșecurile” unui Generator specific, nu ale unui Generator în continuă schimbare.

- Antrenarea Generatorului: Ulterior, Generatorul este antrenat pentru una sau mai multe epoci, în timp ce greutățile Discriminatorului sunt menținute constante. Generatorul încearcă să producă date cât mai convingătoare, care să păcălească Discriminatorul. Dacă Discriminatorul s-ar schimba în timpul antrenamentului Generatorului, Generatorul ar încerca să atingă o „țintă în mișcare” și ar putea să nu conveargă niciodată.

- Repetare: Pașii 1 și 2 se repetă, permițând ambelor rețele să se îmbunătățească iterativ.

Acest proces de „du-te-vino” este esențial și permite GAN-urilor să abordeze probleme generative altfel inabordabile. Pentru a rezolva problema generativă dificilă, trebuie să se înceapă cu o problemă de clasificare mult mai simplă. Dacă nu se poate antrena un clasificator pentru a distinge între datele reale și cele generate (chiar și pentru rezultatul inițial al Generatorului aleatoriu), atunci antrenamentul GAN nu poate începe.

Comparație: Obiectivele Antrenamentului Generatorului și Discriminatorului

| Componenta Rețelei | Obiectivul Principal | Tipul de Feedback | Starea celeilalte componente în timpul antrenamentului |

|---|---|---|---|

| Discriminator | Distinge corect datele reale de cele false. | Acuratețe în clasificare. | Generatorul este înghețat (constant). |

| Generator | Produce date false care să păcălească Discriminatorul. | Capacitatea de a reduce acuratețea Discriminatorului. | Discriminatorul este înghețat (constant). |

Problema Convergenței în GAN-uri: Un Obiectiv În Mișcare

Pe măsură ce Generatorul se îmbunătățește prin antrenament, performanța Discriminatorului se înrăutățește, deoarece nu mai poate distinge cu ușurință între real și fals. Un scenariu ideal, de convergență perfectă, ar fi atunci când Generatorul funcționează impecabil, iar Discriminatorul are o acuratețe de 50%. În acest punct, Discriminatorul practic aruncă o monedă pentru a face predicția sa. Această progresie ridică o problemă pentru convergența întregului GAN: feedback-ul de la Discriminator devine din ce în ce mai puțin semnificativ în timp. Dacă GAN-ul continuă antrenamentul dincolo de punctul în care Discriminatorul oferă feedback complet aleatoriu, Generatorul începe să se antreneze cu feedback nedorit, iar propria sa calitate se poate prăbuși. În cazul unui GAN, convergența este adesea o stare efemeră, mai degrabă decât stabilă, ceea ce face monitorizarea și oprirea antrenamentului la momentul potrivit extrem de importante.

Strategii și Bune Practici pentru un Antrenament Eficient al GAN-urilor

Dată fiind complexitatea antrenamentului GAN-urilor, aplicarea unor bune practici este crucială pentru a obține rezultate satisfăcătoare. Iată câteva sfaturi și trucuri esențiale:

1. Cunoașteți-vă Problema și Datele

Înainte de a scrie o singură linie de cod, vizualizați-vă datele și gândiți-vă cu atenție la ce doriți să faceți cu ele. Pentru imagini, de exemplu, puneți-vă întrebări precum: Câte eșantioane aveți? Care este rezoluția imaginilor? Există ceva special la imaginile dvs. (culori, obiecte, etc.)? Există valori aberante sau alte probleme potențiale? Ce doriți să generați? Cât de dificilă este sarcina? O înțelegere profundă a datelor și a problemei este fundamentul oricărui proiect de succes.

2. Cercetați și Înțelegeți Lucrările Existente

Construirea GAN-urilor de la zero este extrem de dificilă și poate necesita ore întregi de depanare și ajustare fină a hiperparametrilor. Căutați întotdeauna lucrări existente. Dacă există deja articole care folosesc GAN-uri pentru ceea ce doriți să faceți, folosiți-le sau construiți pe baza lor. Înțelegeți dacă un anumit model este potrivit pentru aplicația dvs. (de exemplu, nu folosiți CycleGAN dacă aveți date pereche, nu folosiți StyleGAN dacă aveți imagini de rezoluție scăzută). Citiți documentele de cercetare și înțelegeți contribuțiile lor cheie.

3. Utilizați Implementări Existente și Hiperparametrii acestora

Dacă ați găsit o metodă existentă potrivită și implementarea sa este open-source, folosiți-o! Deși poate fi tentant să reimplementați metodele pe cont propriu, antrenarea GAN-urilor este foarte dificilă, iar o mică eroare în implementare poate duce la rezultate total greșite. Începeți întotdeauna cu hiperparametrii din lucrarea/implementarea originală, deoarece GAN-urile sunt notoriu instabile în ceea ce privește alegerea hiperparametrilor.

4. Începeți cu Modele Simple

Când construiți modele, începeți întotdeauna simplu. Alegeți o arhitectură mică, de preferință cu mai puțin de un milion de parametri. Pentru GAN-uri, începeți cu funcția de pierdere (loss function) standard. Nu vă lăsați tentat de funcții de pierdere mai complexe (cum ar fi Wasserstein loss) la început, deoarece acestea sunt mai greu de depanat dacă modelul produce doar rezultate nedorite. Evitați, de asemenea, trucurile de stabilizare (cum ar fi normalizarea spectrală) la început; adăugați-le doar după ce modelul de bază funcționat.

5. Începeți cu Date Simple

Pe lângă modelul simplu, păstrați și datele cât mai simple la început. Începeți prin a supraînvăța un singur eșantion. Dacă acest lucru nu funcționează, aveți cu siguranță o eroare majoră în model, cel mai probabil în definirea funcției de pierdere. Odată ce puteți supraînvăța un singur eșantion, încercați un mini-batch. Dacă nici acest lucru nu funcționează, verificați încărcarea datelor și vizualizați intrările.

6. Nu Uitați să Înghețați Greutățile

Una dintre cele mai enervante erori în GAN-uri este uitarea de a îngheța greutățile. Generatorul și Discriminatorul trebuie antrenați alternativ, ceea ce înseamnă că trebuie să înghețați un model în timp ce îl antrenați pe celălalt (de exemplu, folosind detach() sau setând requires_grad=False pentru parametri). Această eroare poate fi ușor trecută cu vederea și este extrem de dificil de găsit, putând încetini semnificativ antrenamentul sau duce la rezultate suboptime.

7. Ajustați Rata de Învățare a Discriminatorului

GAN-urile sunt foarte sensibile la hiperparametri, iar rata de învățare a Discriminatorului este cea mai importantă. Dacă rata de învățare a Discriminatorului este prea mare, modelele vor experimenta imediat un „colaps de mod” (mode collapse), iar nimic nu va fi învățat. Recomandarea este să începeți cu o rată de învățare în jurul valorii de 1e-5 și să o creșteți treptat dacă antrenamentul este prea lent.

8. Asigurați-vă că Toate Componentele Funcționează Individual

Deoarece un GAN este un sistem complex de componente, problemele pot proveni din diverse locuri. Cea mai bună modalitate de a depana este de a împărți lucrurile în componente mai mici și de a le testa separat. De exemplu: Poate Generatorul fi folosit ca un autoencoder cu o funcție de pierdere de reconstrucție L1? Poate Discriminatorul fi antrenat într-o sarcină de clasificare și să atingă o acuratețe satisfăcătoare? Prin descompunerea componentelor și testarea lor individuală, puteți restrânge problemele și identifica exact unde trebuie să căutați.

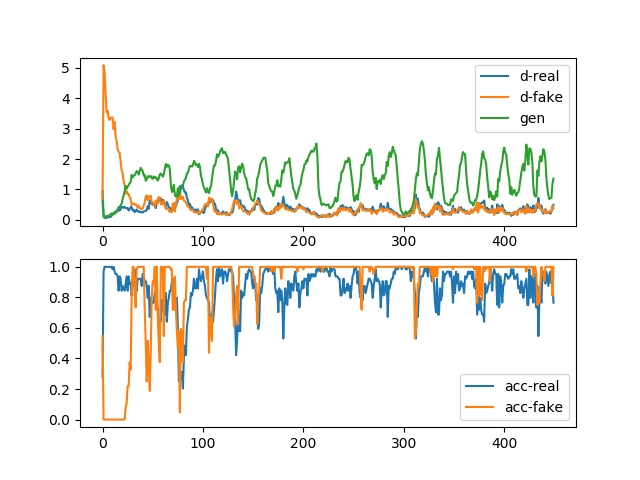

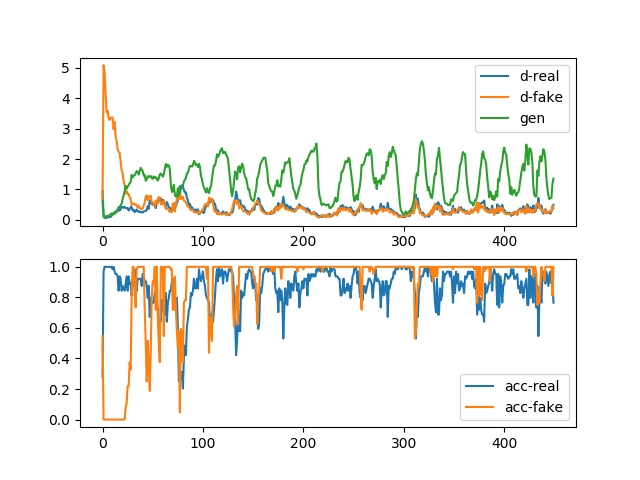

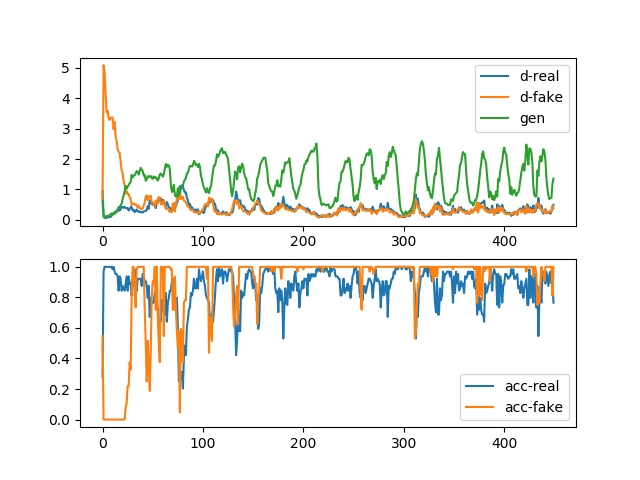

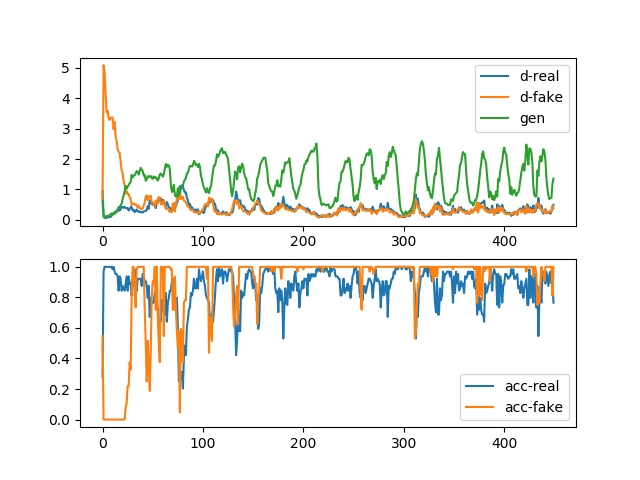

9. Înregistrați Totul (Logging)

Deoarece GAN-urile sunt atât de instabile, reproductibilitatea este esențială. Chiar dacă un singur detaliu este ușor diferit, rezultatele pot fi vast diferite, așa că trebuie să înregistrați meticulos totul: hiperparametrii, versiunea git (pentru a putea reveni la codul exact folosit), curbele de pierdere (cât mai detaliate posibil, înregistrând separat pierderile compozite), ieșirile modelului (imagini/videoclipuri) și metricile de evaluare.

10. Priviți Metricile, Nu Doar Imaginile

Este tentant să vă concentrați excesiv pe rezultatele calitative, deoarece suntem buni la percepția vizuală și putem intui dacă ceva pare real. Cu toate acestea, puteți analiza doar un eșantion mic de ieșiri, iar evaluarea dvs. va fi probabil părtinitoare. Definiți-vă metricile de evaluare cantitative (cum ar fi FID, Inception Score) de la început și folosiți-le pentru selecția modelului, la fel ca în orice alt model de învățare automată care nu este un GAN. Acestea oferă o măsură obiectivă a performanței.

Întrebări Frecvente (FAQ) despre Antrenamentul GAN-urilor

- Ce este un colaps de mod (mode collapse) în GAN-uri?

- Colapsul de mod apare atunci când Generatorul produce o varietate limitată de ieșiri, adesea doar câteva eșantioane foarte bune, dar ignoră diversitatea datelor reale. Acest lucru se întâmplă când Generatorul găsește o modalitate de a păcăli Discriminatorul cu doar câteva tipuri de ieșiri, în loc să învețe întreaga distribuție a datelor.

- De ce este important să înghețăm o rețea în timpul antrenamentului celeilalte?

- Este crucial pentru a oferi un obiectiv stabil de învățare. Dacă ambele rețele s-ar antrena simultan fără a fi înghețate, ele ar încerca să atingă o „țintă în mișcare”, ceea ce ar face ca procesul de antrenament să fie instabil și să nu conveargă niciodată eficient. Fiecare rețea are nevoie de un punct de referință fix pentru a-și ajusta propriile greutăți.

- Cât timp ar trebui să antrenez un GAN?

- Timpul de antrenament variază enorm în funcție de complexitatea datelor, arhitectura modelului și resursele de calcul. Deoarece convergența este adesea o stare efemeră, este important să monitorizați metricile și ieșirile generate. Oprirea antrenamentului la momentul optim, adesea înainte ca Discriminatorul să devină complet aleatoriu, este o artă în sine.

- Pot folosi orice tip de date pentru a antrena un GAN?

- GAN-urile sunt versatile și pot fi folosite pentru a genera diverse tipuri de date, nu doar imagini. Au fost aplicate cu succes în generarea de text, audio, date tabelare și chiar modele 3D. Cu toate acestea, complexitatea datelor influențează direct dificultatea antrenamentului și calitatea rezultatelor.

Antrenamentul GAN-urilor rămâne un domeniu de cercetare activ și provocator, dar cu o înțelegere solidă a principiilor de bază și aplicarea bunelor practici, se pot obține rezultate remarcabile. Cheia succesului constă în răbdare, experimentare și o monitorizare atentă a procesului de învățare a ambelor rețele implicate în acest joc fascinant.

Dacă vrei să descoperi și alte articole similare cu Antrenamentul GAN: Ghid Complet pentru Succes, poți vizita categoria Fitness.