18/11/2024

În peisajul dinamic al inteligenței artificiale, rețelele neurale artificiale (RNA) reprezintă una dintre cele mai puternice și versatile unelte, capabile să rezolve o gamă largă de probleme, de la recunoașterea imaginilor la prelucrarea limbajului natural și predicții complexe. Cu toate acestea, puterea lor nu rezidă doar în arhitectura lor, ci și în capacitatea de a fi antrenate eficient. Antrenarea unei rețele neurale este procesul prin care aceasta învață să îndeplinească o anumită sarcină, ajustându-și parametrii interni (greutățile și bias-urile) pe baza unui set de date de antrenament. Două dintre cele mai proeminente și fundamental diferite abordări pentru acest proces sunt Backpropagation și Algoritmii Genetici. În timp ce Backpropagation domină de decenii, fiind metoda standard pentru majoritatea aplicațiilor, Algoritmii Genetici oferă o alternativă robustă, inspirată de evoluția biologică, mai ales în scenarii unde metodele bazate pe gradient întâmpină dificultăți.

Acest articol va explora în detaliu ambele metode, comparându-le avantajele, dezavantajele și scenariile de aplicare optime, pentru a oferi o înțelegere cuprinzătoare a modului în care aceste tehnici contribuie la modelarea și rafinarea inteligenței artificiale.

- Ce Sunt Rețelele Neurale și De Ce Au Nevoie de Antrenament?

- Backpropagation: Pilonul Antrenării Rețelelor Neurale

- Algoritmii Genetici: O Abordare Inspirată de Natură

- Evaluare Comparativă: Backpropagation vs. Algoritmi Genetici

- Abordări Hibride și Viitorul Antrenării Rețelelor Neurale

- Întrebări Frecvente (FAQ)

- Sunt Algoritmii Genetici mai buni decât Backpropagation pentru antrenarea rețelelor neurale?

- Pot folosi ambele metode împreună?

- Care este principala provocare a Algoritmilor Genetici în antrenarea rețelelor neurale?

- Ce se întâmplă dacă rețeaua mea are o funcție de activare non-differentiabilă?

- De ce Backpropagation este considerată metoda standard?

Ce Sunt Rețelele Neurale și De Ce Au Nevoie de Antrenament?

O rețea neurală artificială este o arhitectură computațională inspirată de structura și funcționarea creierului uman. Este compusă dintr-un număr mare de unități interconectate, numite neuroni (sau noduri), aranjate în straturi: un strat de intrare, unul sau mai multe straturi ascunse și un strat de ieșire. Fiecare conexiune între neuroni are o greutate asociată, iar fiecare neuron are un bias. Aceste greutăți și bias-uri sunt parametrii ajustabili ai rețelei. Când rețeaua primește o intrare, semnalul se propagă prin straturi, fiecare neuron efectuând o sumă ponderată a intrărilor sale, la care adaugă bias-ul, și apoi aplică o funcție de activare pentru a produce o ieșire. Scopul final al unei rețele neurale este de a învăța o mapare complexă între intrări și ieșiri.

Antrenarea este crucială deoarece, inițial, greutățile și bias-urile sunt adesea inițializate aleatoriu, iar rețeaua produce rezultate incorecte. Procesul de antrenament implică prezentarea repetată a datelor de intrare și a ieșirilor dorite (etichetele) rețelei. Pe baza diferenței dintre ieșirea reală a rețelei și ieșirea dorită (eroarea), parametrii rețelei sunt ajustați iterativ pentru a minimiza această eroare. Această optimizare permite rețelei să generalizeze și să facă predicții precise pe date noi, nevăzute.

Backpropagation: Pilonul Antrenării Rețelelor Neurale

Backpropagation, sau retropropagarea erorii, este algoritmul fundamental pentru antrenarea rețelelor neurale feed-forward și este o formă de gradient descent. A fost popularizat în anii 1980 și a stat la baza succesului rețelelor neurale din ultimele decenii.

Mecanismul Backpropagation:

- Propagarea Înainte (Forward Pass): Intrările sunt alimentate în rețea, iar semnalul se propagă prin straturi, de la intrare la ieșire. Fiecare neuron calculează o valoare de ieșire.

- Calculul Erorii: Ieșirea rețelei este comparată cu ieșirea dorită (eticheta reală) pentru a calcula o funcție de cost sau eroare (ex: eroarea pătratică medie).

- Propagarea Înapoi (Backward Pass): Acesta este pasul cheie. Eroarea este propagată înapoi prin rețea, de la stratul de ieșire la straturile ascunse și, în cele din urmă, la stratul de intrare. Pe măsură ce eroarea se propagă înapoi, se calculează gradientul funcției de cost în raport cu fiecare greutate și bias din rețea, folosind regula lanțului (chain rule) din calculul diferențial. Acesta indică direcția în care parametrii trebuie ajustați pentru a reduce eroarea.

- Actualizarea Greutăților: Greutățile și bias-urile sunt actualizate în direcția opusă gradientului, cu o rată de învățare specificată. Acest proces se repetă pentru un număr mare de epoci (treceri complete prin setul de date de antrenament) până când eroarea este minimizată sau se atinge un criteriu de convergență.

Avantaje și Dezavantaje ale Backpropagation:

- Avantaje:

- Eficiență: Este extrem de eficientă computațional pentru antrenarea rețelelor mari pe seturi de date extinse.

- Simplitate Matematică: Se bazează pe calculul gradientului, o metodă bine înțeleasă.

- Ubiquitate: Este algoritmul standard, susținut de numeroase biblioteci și framework-uri de învățare automată.

- Dezavantaje:

- Minime Locale: Poate rămâne blocată în minime locale ale funcției de cost, mai degrabă decât să găsească optimul global, mai ales pe suprafețe de eroare complexe.

- Gradientul Vanishing/Exploding: În rețelele profunde, gradienții pot deveni extrem de mici (vanishing) sau extrem de mari (exploding), împiedicând o antrenare eficientă.

- Necesită Funcții Differentiabile: Necesită ca funcțiile de activare să fie diferențiabile, limitând alegerea unora dintre ele.

- Sensibilitate la Inițializare: Performanța poate fi puternic influențată de inițializarea greutăților.

Algoritmii Genetici: O Abordare Inspirată de Natură

Algoritmii Genetici (AG) fac parte din familia algoritmilor evolutivi și sunt inspirați de procesul de selecție naturală și genetică. Spre deosebire de Backpropagation, care este o metodă bazată pe gradient, AG sunt algoritmi de căutare globală, meta-euristici, care nu necesită calculul derivatelor.

Mecanismul Algoritmilor Genetici în Antrenarea Rețelelor Neurale:

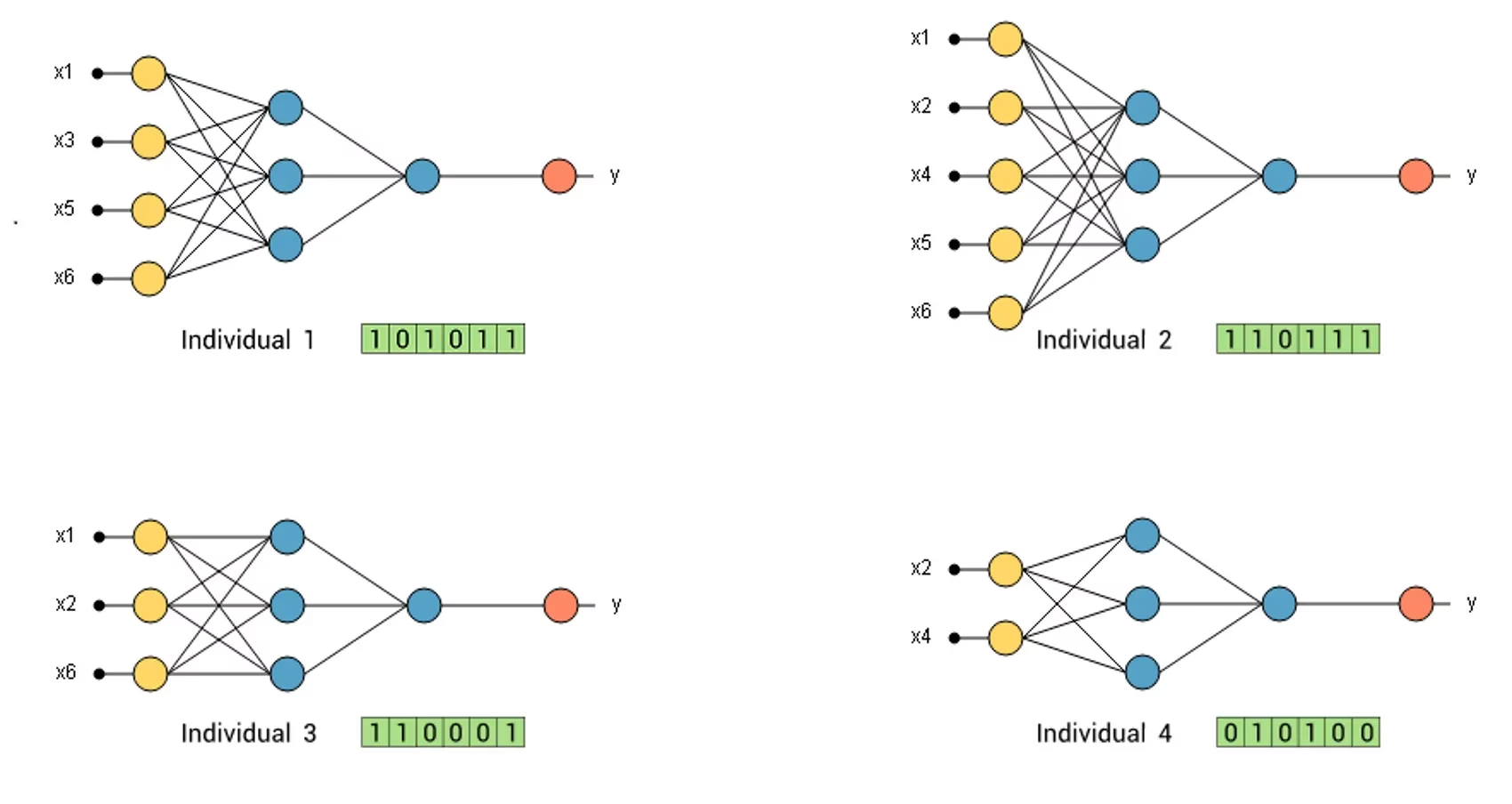

Când sunt aplicați la antrenarea rețelelor neurale, fiecare individ din populația genetică reprezintă un set complet de greutăți și bias-uri pentru rețea. Procesul este următorul:

- Inițializarea Populației: Se generează o populație inițială de indivizi (seturi de greutăți și bias-uri) în mod aleatoriu.

- Evaluarea Fitness-ului: Fiecare individ (set de greutăți) este utilizat pentru a antrena rețeaua neurală, iar performanța rețelei pe un set de date de validare (ex: acuratețea sau inversul erorii) este evaluată ca scor de fitness. Cu cât fitness-ul este mai mare, cu atât setul de greutăți este mai bun.

- Selecția: Indivizii cu fitness mai mare au o probabilitate mai mare de a fi selectați pentru a deveni părinți. Metode comune includ selecția roții de ruletă sau selecția turneului.

- Crossover (Încrucișare): Doi părinți selectați schimbă fragmente din materialul lor genetic (greutățile și bias-urile) pentru a crea doi noi descendenți. Acest lucru permite explorarea de noi combinații de greutăți.

- Mutație: Cu o probabilitate mică, unele greutăți din descendenți sunt modificate aleatoriu. Mutația introduce diversitate în populație și ajută la evitarea minimelor locale.

- Crearea Noii Generații: Descendenții înlocuiesc o parte sau întreaga populație veche. Procesul se repetă pentru un număr predefinit de generații sau până când se atinge un criteriu de convergență (ex: un anumit nivel de fitness).

Avantaje și Dezavantaje ale Algoritmilor Genetici:

- Avantaje:

- Căutare Globală: Sunt excelenți în găsirea optimelor globale și sunt mai puțin susceptibili de a rămâne blocați în minime locale, deoarece explorează un spațiu de soluții mai larg.

- Nu Necesită Differentiabilitate: Nu necesită calculul derivatelor, ceea ce înseamnă că pot fi utilizați cu funcții de activare non-differentiabile sau chiar cu probleme unde funcția de cost nu este netedă.

- Robustă la Zgomot: Pot fi mai robusti în prezența datelor zgomotoase.

- Paralelizare Naturală: Procesul de evaluare a fitness-ului pentru fiecare individ poate fi paralelizat, ceea ce poate accelera semnificativ antrenarea.

- Dezavantaje:

- Cost Computațional Ridicat: Sunt semnificativ mai costisitori computațional decât Backpropagation, deoarece necesită evaluarea performanței pentru o populație întreagă în fiecare generație.

- Viteză de Convergență: Convergența poate fi mult mai lentă decât cea a Backpropagation pentru probleme bine definite și netede.

- Tuningul Parametrilor: Performanța depinde puternic de alegerea corectă a parametrilor AG (dimensiunea populației, ratele de crossover și mutație).

- Lipsa de Exploatare Locală: Deși excelenți în explorarea globală, pot fi mai puțin eficienți în exploatarea fină a optimelor locale.

Evaluare Comparativă: Backpropagation vs. Algoritmi Genetici

Ambele metode au demonstrat capacitatea de a antrena rețele neurale, dar abordările lor fundamentale duc la rezultate și aplicații diferite. Studiile, cum ar fi cel realizat de Kattan, Abdullah și Salam (2000), au explorat în detaliu această comparație, evidențiind că, deși Backpropagation este adesea mai rapidă pentru problemele standard, Algoritmii Genetici pot oferi soluții superioare în scenarii complexe sau atunci când se urmărește evitarea minimelor locale. Utilizarea algoritmilor genetici paraleli, cu strategii precum „best must survive”, poate îmbunătăți semnificativ eficiența acestora.

| Criteriu | Backpropagation | Algoritmi Genetici |

|---|---|---|

| Mecanism | Bazat pe gradient, descendent | Evolutiv, meta-euristic |

| Tip de Căutare | Locală (exploatare) | Globală (explorare) |

| Necesită Derivate | Da, funcții de activare diferențiabile | Nu |

| Convergență | Rapidă (dar poate fi blocată în minime locale) | Mai lentă (dar tinde spre optimul global) |

| Cost Computațional (per iterație) | Mai mic | Mai mare (populație întreagă) |

| Sensibilitate la Inițializare | Mare | Mai mică |

| Gestionare Minime Locale | Predispus la blocare | Mai puțin predispus, poate ieși din ele |

| Complexitate Funcție Cost | Preferă funcții netede, convexe | Poate gestiona funcții complexe, neregulate |

| Paralelizare | Mai dificilă la nivel de algoritm | Naturală și eficientă |

Când Să Alegi Fiecare Metodă?

- Alege Backpropagation atunci când:

- Ai un set de date mare și bine etichetat.

- Rețeaua neurală este de tip feed-forward sau convoluțională standard.

- Viteza de antrenament este critică.

- Funcția de cost este netedă și diferențiabilă.

- Nu ești preocupat excesiv de minimele locale sau poți folosi strategii pentru a le mitiga (ex: diferite inițializări, optimizatori avansați).

- Alege Algoritmii Genetici atunci când:

- Funcția de cost este non-differentiabilă, zgomotoasă sau are multiple minime locale.

- Căutarea unui optim global este esențială.

- Spațiul de căutare este extrem de complex și neregulat.

- Poți tolera un timp de antrenament mai lung.

- Ai resurse computaționale (ex: GPU-uri, clustere) pentru a beneficia de paralelizare.

- Dorești să explorezi o gamă mai largă de soluții posibile.

Abordări Hibride și Viitorul Antrenării Rețelelor Neurale

În multe cazuri, cea mai bună soluție nu este alegerea exclusivă a unei metode, ci combinarea lor într-o abordare hibridă. De exemplu, un algoritm genetic ar putea fi folosit pentru a găsi o bună inițializare a greutăților, care apoi ar fi rafinată de Backpropagation. Această strategie combină capacitatea de explorare globală a AG cu eficiența de exploatare locală a Backpropagation, potențial depășind limitările ambelor metode individuale.

Pe măsură ce rețelele neurale devin tot mai complexe și seturile de date mai masive, căutarea unor metode de antrenament mai eficiente și mai robuste continuă. Cercetările viitoare ar putea explora noi algoritmi evolutivi sau hibrizi, precum și optimizarea arhitecturilor rețelelor neurale prin metode inspirate biologic, deschizând noi orizonturi în inteligența artificială.

Întrebări Frecvente (FAQ)

Sunt Algoritmii Genetici mai buni decât Backpropagation pentru antrenarea rețelelor neurale?

Nu neapărat. Depinde de problema specifică. Backpropagation este de obicei mai rapidă și mai eficientă pentru problemele standard cu funcții de cost netede. Algoritmii Genetici excelează în scenarii unde funcția de cost este complexă, non-differentiabilă sau are multe minime locale, unde Backpropagation ar putea eșua.

Pot folosi ambele metode împreună?

Da, abordările hibride sunt o direcție promițătoare. De exemplu, un algoritm genetic poate fi folosit pentru a găsi o bună inițializare a greutăților, iar apoi Backpropagation poate fi aplicată pentru a rafina și optimiza aceste greutăți.

Care este principala provocare a Algoritmilor Genetici în antrenarea rețelelor neurale?

Principalul dezavantaj este costul computațional ridicat și viteza de convergență mai lentă comparativ cu Backpropagation, mai ales pentru rețele mari și seturi de date extinse. De asemenea, reglarea fină a parametrilor algoritmului genetic (ratele de mutație, crossover, dimensiunea populației) poate fi o provocare.

Ce se întâmplă dacă rețeaua mea are o funcție de activare non-differentiabilă?

Backpropagation nu ar putea fi aplicată direct, deoarece se bazează pe calculul gradientului. În acest caz, Algoritmii Genetici ar fi o alternativă viabilă, deoarece nu necesită ca funcțiile de activare să fie diferențiabile.

De ce Backpropagation este considerată metoda standard?

Datorită eficienței sale computaționale și capacității de a converge rapid pentru majoritatea problemelor bine definite. De-a lungul anilor, au fost dezvoltate numeroase optimizări și variații ale Backpropagation care i-au consolidat poziția dominantă.

Dacă vrei să descoperi și alte articole similare cu Antrenarea Rețelelor Neurale: GA vs. Backpropagation, poți vizita categoria Fitness.