25/08/2025

Arborii de decizie sunt instrumente analitice remarcabile, utilizate pe scară largă în diverse domenii, de la inteligența artificială la strategiile de afaceri. Capacitatea lor de a vizualiza și de a simplifica procese complexe de luare a deciziilor îi face incredibil de valoroși. Indiferent dacă ești un specialist în știința datelor sau pur și simplu curios să înțelegi cum funcționează aceste structuri logice, antrenarea unui arbore de decizie implică o serie de pași fundamentali, de la înțelegerea conceptelor teoretice până la implementarea practică și optimizarea rezultatelor. Acest ghid detaliat te va purta prin toate etapele necesare pentru a antrena și a înțelege pe deplin puterea arborilor de decizie.

O Scurtă Istorie a Arborilor de Decizie

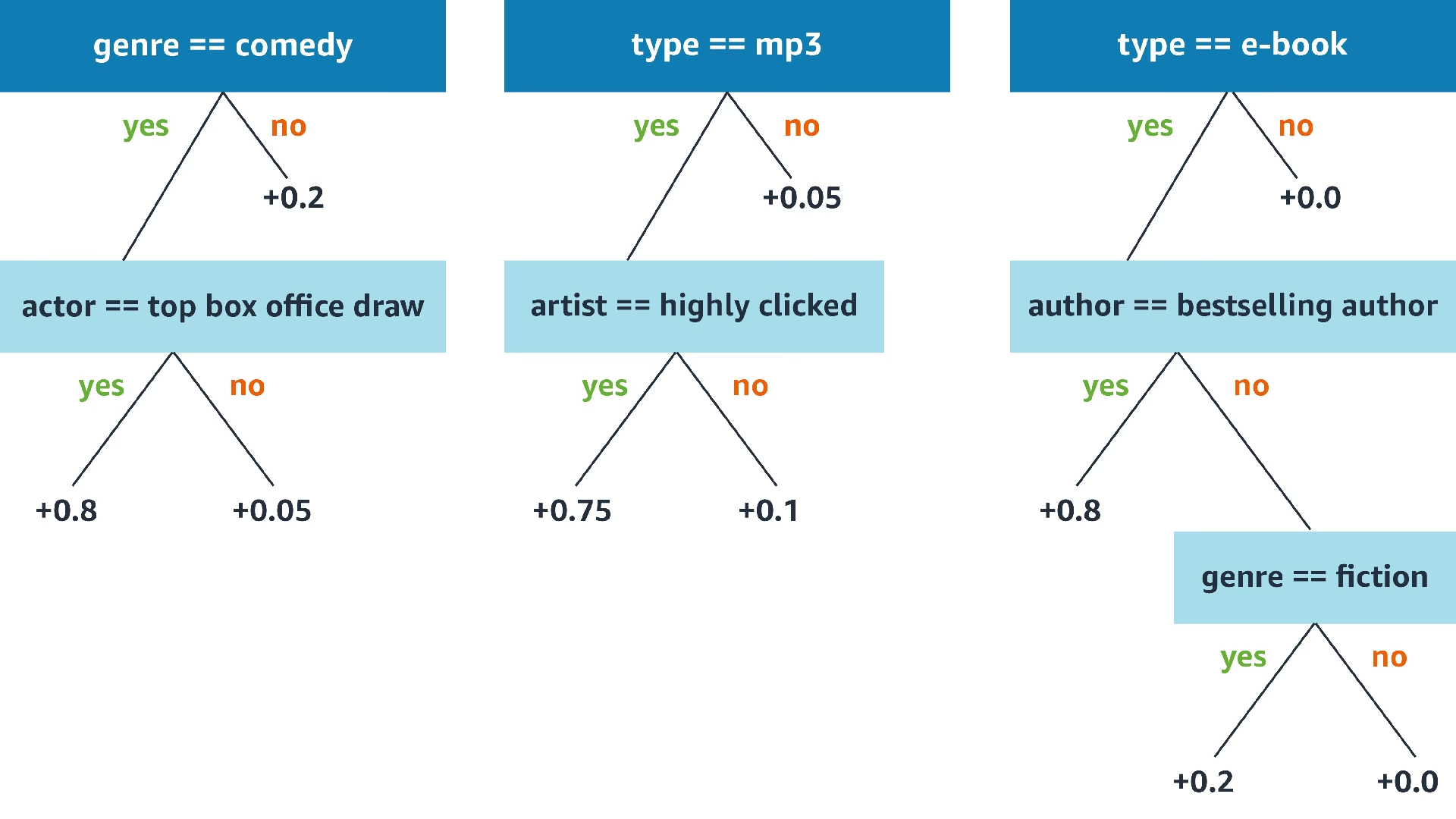

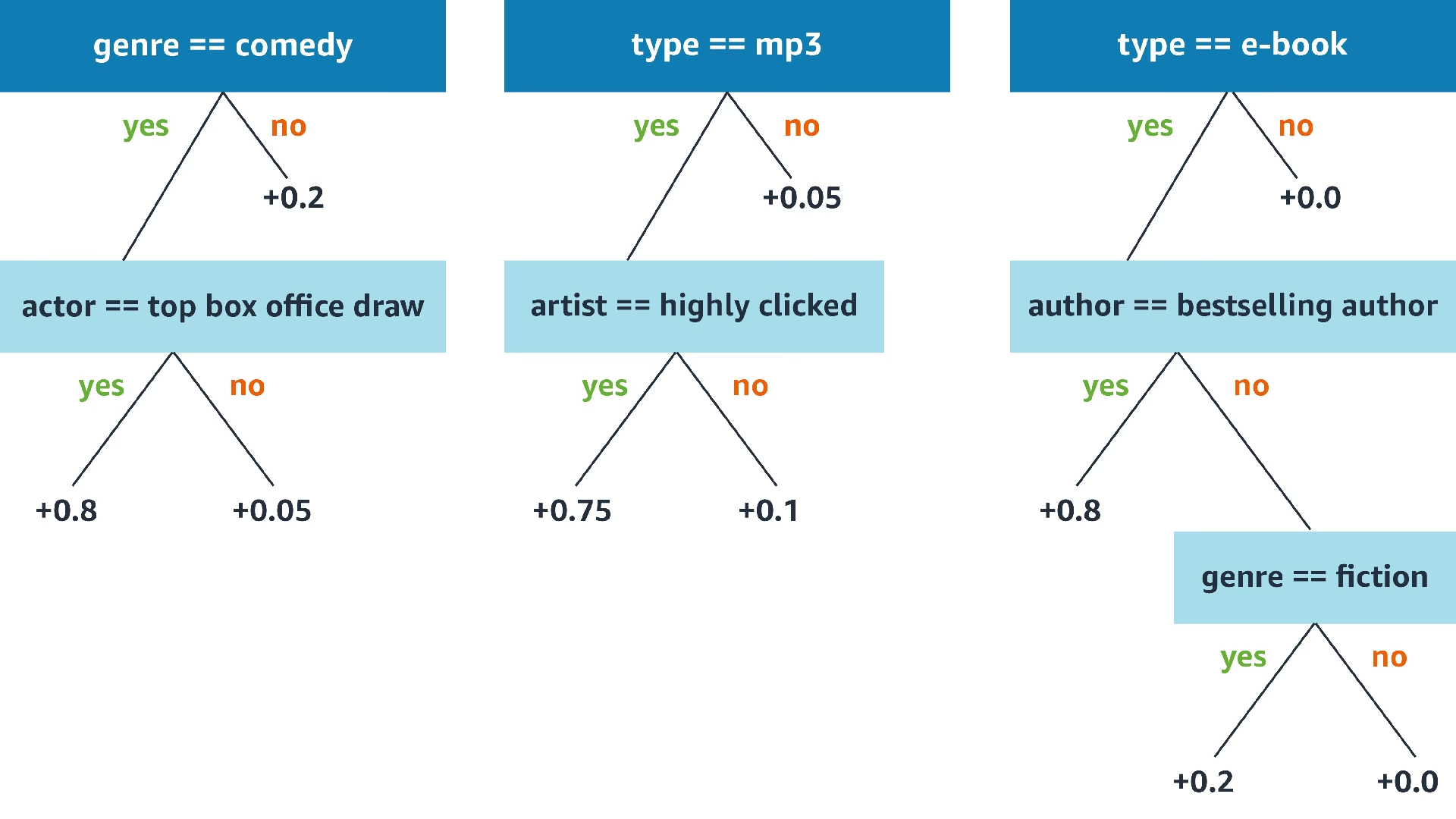

Conceptul de structură arborescentă pentru clasificare a apărut pentru prima dată în anii '50, când William Welson a introdus o formă rudimentară în lucrarea sa din 1959. Cu toate acestea, algoritmii structurați, recunoscuți pe scară largă astăzi, au fost propuși în anii '80. Ross Quinlan a dezvoltat algoritmi precum ID3 și C4.5, în timp ce Leo Breiman și colegii săi au introdus algoritmul CART (Classification and Regression Trees). De la anii '90 încoace, au apărut algoritmi mai avansați, construiți pe baza acestor arbori de decizie simpli, consolidând rolul lor central în domeniul învățării automate. În discuția noastră, ne vom concentra în special pe principiile algoritmului CART, care stau la baza multor implementări moderne.

Construirea unui Arbore de Decizie de la Zero: Fundamente

La baza oricărui arbore de decizie stă ideea de a împărți datele într-un mod structurat, similar ramurilor unui copac. În contextul unui clasificator de arbore de decizie, scopul final este de a obține o variabilă de ieșire categorică. Procesul de antrenare implică dezvoltarea unei funcții de "antrenare" care construiește arborele și, ulterior, o funcție de "predicție" care folosește arborele antrenat pentru a face estimări. Elementul cheie în construirea unui arbore eficient este identificarea celei mai bune metode de împărțire a datelor, un aspect crucial pe care îl vom explora în detaliu.

Decizia Asupra Celei Mai Bune Împărțiri a Datelor

Ideea principală în antrenarea unui arbore de decizie se învârte în jurul modului în care vei împărți setul de date. O împărțire "bună" este acea împărțire în urma căreia fiecare subgrup rezultat conține puncte de date care aparțin, pe cât posibil, aceleiași clase. Pentru a cuantifica această proprietate, trebuie să definim o metrică numerică. Deși "Gini Impurity" este metrica implicită utilizată pentru împărțire în algoritmul CART, în multe implementări, inclusiv în cele didactice, se preferă metrica Entropy. Entropia măsoară gradul de dezordine sau incertitudine dintr-un set de date. Cu cât entropia este mai mică, cu atât grupul de date împărțit este mai omogen, adică o clasă este mai dominantă. Invers, o entropie ridicată indică o distribuție mai echilibrată a claselor și, implicit, o incertitudine mai mare.

Calculul entropiei se bazează pe probabilitățile de apariție ale fiecărei clase într-un anumit subgrup. Formula generală a entropiei este: Suma de [-p * log2(p)] pentru fiecare probabilitate p a unei clase. Astfel, obiectivul nostru este să căutăm împărțiri care duc la cea mai mică entropie posibilă în subgrupurile rezultate. Funcția care determină cea mai bună împărțire ("find_best_split") este construită pe baza acestei metrici, evaluând diferite puncte de împărțire pentru fiecare caracteristică și alegând-o pe cea care minimizează entropia combinată a grupurilor rezultate.

Generarea Candidaților de Împărțire și Abordarea Greedy

Odată ce înțelegem cum să evaluăm calitatea unei împărțiri prin intermediul entropiei (unde o valoare mai mică este întotdeauna mai bună), următorul pas este să generăm candidați pentru împărțire. Imaginați-vă că aveți două caracteristici cu valori numerice. Puteți compara împărțirea datelor folosind valoarea mediană a caracteristicii 1 cu împărțirea folosind valoarea mediană a caracteristicii 2. Dacă împărțirea cu caracteristica 1 produce o entropie mai mică, atunci acea împărțire este preferată. Acest algoritm este aplicat recursiv la fiecare nivel al arborelui pentru a decide cu ce caracteristică să se facă următoarea împărțire. Această abordare este cunoscută sub numele de abordare "greedy" (lacomă), deoarece la fiecare pas, se alege cea mai bună împărțire locală, fără a lua în considerare impactul pe termen lung asupra structurii generale a arborelui. Deși abordarea greedy poate avea unele dezavantaje, în majoritatea implementărilor simple, este preferată pentru simplitatea și eficiența sa.

Crearea Arborelui prin Împărțire Recursivă

Pentru a construi un arbore, avem nevoie de o structură de bază pentru noduri, unde fiecare nod poate avea un nod stânga și un nod dreapta. Această structură, adesea numită "TreeNode", va stoca informațiile despre împărțire (cum ar fi indicele caracteristicii și valoarea de împărțire), probabilitățile de predicție pentru nodul respectiv și câștigul de informație obținut prin acea împărțire. De asemenea, un nod va avea referințe către nodurile sale copil (stânga și dreapta), care vor fi create prin împărțiri ulterioare.

Procesul de creare a arborelui este, prin excelență, recursiv. O funcție de tip "create_tree" primește datele și adâncimea curentă a nodului. În cadrul acestei funcții, se caută cea mai bună împărțire pentru datele curente, se calculează probabilitățile etichetelor pentru nod și, crucial, se determină "Câștigul de Informație" (Information Gain). Câștigul de informație este diferența dintre entropia nodului înainte de împărțire și entropia ponderată a nodurilor copil după împărțire. Un câștig de informație pozitiv indică o reducere a incertitudinii și, prin urmare, o împărțire utilă.

Odată ce aceste valori sunt calculate, se creează un nou nod al arborelui. Apoi, funcția se apelează recursiv pentru datele din subgrupurile rezultate în urma împărțirii, construind astfel ramurile stânga și dreapta ale nodului curent. Acest proces continuă până când sunt îndeplinite anumite criterii de oprire, pe care le vom discuta în secțiunea următoare.

Criteriile de Oprire: Când să Oprim Împărțirea

Deoarece procesul de împărțire este recursiv, este esențial să stabilim condiții clare pentru a opri crearea de noi noduri, evitând astfel crearea unui arbore excesiv de complex care ar putea duce la supra-antrenare (overfitting). Supra-antrenarea apare atunci când un model învață prea mult din datele de antrenament, inclusiv zgomotul, și nu generalizează bine pe date noi, nevăzute. În implementările tipice, se folosesc trei criterii principale de oprire:

- Adâncimea maximă a arborelui (

max_depth): Aceasta limitează numărul de niveluri ale arborelui. O adâncime prea mare poate duce la supra-antrenare, în timp ce o adâncime prea mică poate duce la un arbore sub-antrenat (underfitting), care nu captează suficient de bine complexitatea datelor. - Numărul minim de eșantioane într-o frunză (

min_samples_leaf): Acest criteriu specifică numărul minim de puncte de date care trebuie să existe într-un nod frunză (un nod care nu se mai împarte). Dacă o împărțire ar duce la un nod copil cu mai puține eșantioane decât această valoare minimă, împărțirea este oprită, iar nodul curent devine o frunză. Acest lucru ajută la prevenirea creării de ramuri prea specifice. - Câștigul minim de informație (

min_information_gain): Dacă o împărțire propusă nu generează un câștig de informație suficient de mare (adică nu reduce semnificativ incertitudinea), atunci acea împărțire este considerată inutilă și procesul de divizare se oprește. Acest criteriu asigură că numai împărțirile semnificative sunt efectuate.

Aceste criterii sunt definite de obicei la inițializarea obiectului arborelui de decizie și sunt evaluate la fiecare pas al procesului recursiv de creare a arborelui.

Procesul de Antrenare

Odată ce toate funcțiile necesare pentru împărțire, crearea nodurilor și oprire sunt definite, procesul de antrenare devine relativ simplu. Funcția de antrenare primește seturile de date de intrare (caracteristici) și etichetele corespunzătoare. În primul rând, datele de intrare și etichetele sunt concatenate într-un singur set de date pentru a facilita procesarea. Apoi, funcția de antrenare inițiază procesul recursiv de creare a arborelui, începând de la adâncimea zero (rădăcina arborelui). Rezultatul final al funcției de antrenare este nodul rădăcină al arborelui, care conține întreaga structură a arborelui antrenat.

Procesul de Predicție

După ce arborele a fost antrenat, el este gata să facă predicții pe date noi, nevăzute. Atunci când se face o predicție, arborele calculează probabilitatea ca un anumit eșantion să aparțină oricărei clase. Fiecare nod frunză al arborelui (adică un nod care nu se mai împarte) are asociate probabilități constante pentru fiecare etichetă, învățate în faza de antrenare.

Pentru a face o predicție nouă, se iau datele fără etichetă și se începe de la primul nod al arborelui (rădăcina). Datele urmează apoi calea prin arbore care corespunde criteriilor de împărțire ale fiecărui nod. Acest proces continuă printr-o buclă iterativă (sau recursivă) până când nu mai există niciun alt nod de parcurs, adică se ajunge la un nod frunză. Odată ajuns la nodul frunză, se returnează probabilitățile de clasă asociate acelui nod. În final, funcția de predicție returnează clasa cu cea mai mare probabilitate ca predicție finală pentru eșantionul dat.

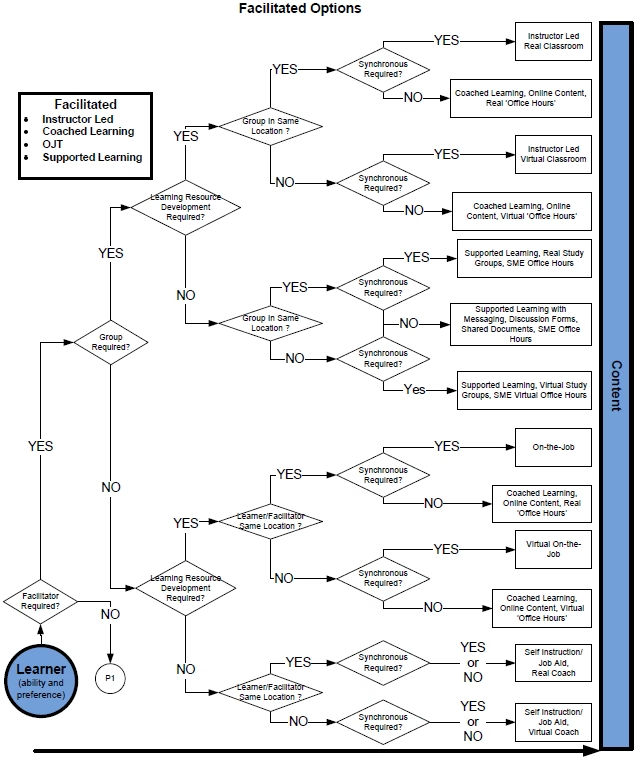

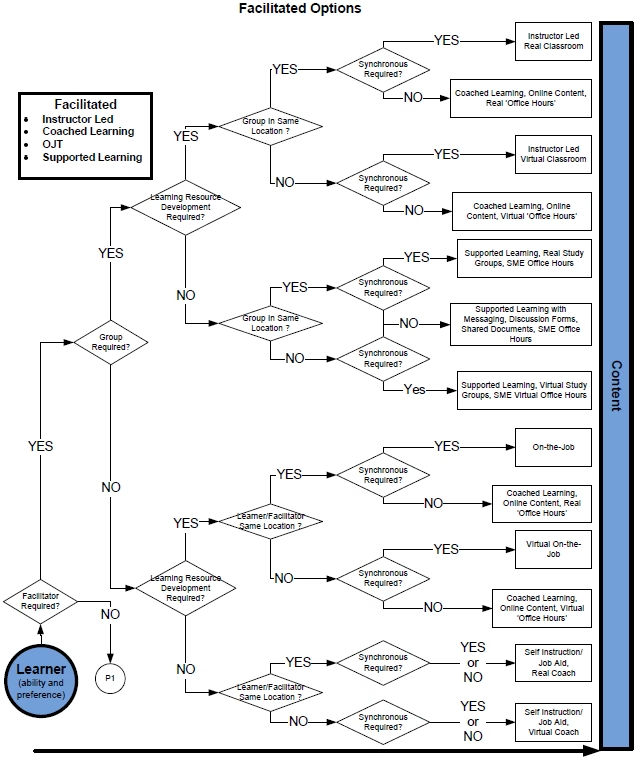

Arbori de Decizie Interactivi pentru Antrenamentul Angajaților

Dincolo de aplicațiile lor în învățarea automată, arborii de decizie sunt instrumente vizuale și analitice excelente pentru luarea deciziilor strategice, în special în contextul antrenamentului angajaților. Ei ajută organizațiile să vizualizeze scenarii multiple și consecințele lor, facilitând un proces decizional mai rațional și mai puțin emoțional, bazat pe date.

Elementele Cheie ale unui Arbore de Decizie

Un arbore de decizie, în acest context, include următoarele elemente cheie:

- Nodurile Rădăcină: Acesta este punctul de plecare al arborelui și reprezintă decizia principală care trebuie luată (ex: "Alegerea unei strategii de marketing").

- Ramurile: Liniile care emană din nodul rădăcină și se conectează la diverse puncte de decizie sau noduri. Fiecare ramură reprezintă o alegere sau o decizie posibilă. Urmărind ramurile, se poate înțelege rezultatul potențial al fiecărei decizii.

- Nodurile Frunză: Acestea sunt punctele finale ale ramurilor și reprezintă rezultatele sau consecințele finale ale unei anumite căi decizionale. În contextul afacerilor, aceste rezultate pot fi acțiuni specifice, recomandări sau concluzii.

Avantaje și Dezavantaje ale Utilizării Arborilor de Decizie

Utilizarea arborilor de decizie în antrenament și luarea deciziilor aduce multiple beneficii, dar și câteva limitări:

| Avantaje | Dezavantaje |

|---|---|

| Ușor de înțeles: Oferă o reprezentare vizuală clară a proceselor decizionale, accesibilă atât experților, cât și non-experților. Transparența logică este un atu major. | Predispoziție la Supra-antrenare: Nu sunt ideali pentru seturi de date masive, deoarece un singur arbore poate deveni extrem de complex, ducând la supra-antrenare și performanțe slabe pe date noi. |

| Versatilitate: Pot fi utilizați pentru diverse tipuri de decizii (prețuri, marketing, evaluarea riscurilor) și pot gestiona atât date numerice, cât și categorice. | Instabilitate la Modificări Mici: Schimbări minore în date pot duce la structuri de arbore complet diferite, făcându-i mai puțin stabili comparativ cu alte modele de învățare automată. |

| Prioritizarea Factorilor Cheie: Ajută la simplificarea deciziilor prin evaluarea sistematică a opțiunilor și identificarea celor mai influente variabile sau factori. | Complexitate Vizuală (pentru arbori mari): Deși sunt vizuali, un arbore foarte mare poate deveni dificil de citit și interpretat manual. |

| Cost-Eficiență: Construirea și utilizarea lor necesită adesea mai puține resurse comparativ cu modelele complexe de învățare automată. | Bias de Selecție: Pot fi influențați de caracteristicile cu mai multe niveluri sau cu o cardinalitate mai mare, favorizând împărțiri pe aceste caracteristici. |

| Evaluarea Riscului: Valoroși pentru analiza riscurilor, ajutând la identificarea riscurilor potențiale și a probabilității lor, sprijinind strategiile de atenuare. |

Cum să Creezi un Arbore de Decizie Interactiv (Fără Cod)

Crearea unui arbore de decizie interactiv pentru antrenamentul angajaților nu necesită neapărat cunoștințe de programare. Există platforme și instrumente vizuale care permit construirea acestora prin interfețe intuitive drag-and-drop. Procesul general implică următorii pași:

- Definește Decizia: Fii specific în legătură cu ceea ce încerci să realizezi sau să decizi. Cunoașterea scopului arborelui te va ajuta să alegi structura potrivită.

- Identifică Alternativele: Listează toate opțiunile posibile pentru a aborda decizia. Acestea vor fi reprezentate ca ramuri în arbore.

- Determină Criteriile și Factorii: Identifică factorii relevanți pentru decizie (cost, timp, venit, risc etc.) și, opțional, atribuie-le ponderi.

- Creează Structura Arborelui: Începe cu un nod pătrat sau cerc pentru decizia inițială. Desenează linii (ramuri) pentru fiecare alternativă și creează noduri de decizie pentru fiecare criteriu, ramificându-le de la alternative. Continuă ramificarea până la rezultatele finale.

- Adaugă Probabilități (Opțional): Dacă decizia implică incertitudine, poți adăuga valori de probabilitate fiecărei ramuri pentru a indica probabilitatea anumitor rezultate.

- Personalizează Designul: Modifică forme, linii, simboluri și fonturi. Integrează elemente vizuale de înaltă calitate și asigură-te că designul este aliniat cu identitatea vizuală a brandului tău.

- Adaugă Interactivitate: Aceasta este cheia unui arbore de decizie interactiv. Poți adăuga elemente precum meniuri clicabile, link-uri, efecte de hover (la trecerea mouse-ului), pop-up-uri, tranziții animate și alte elemente dinamice pentru a face arborele mai captivant și mai ușor de explorat.

- Colaborează și Partajează: Permite membrilor echipei să colaboreze în timp real. După finalizare, arborele poate fi găzduit pe un sistem de management al învățării (LMS) sau partajat prin link-uri live, fișiere PDF, imagini, sau chiar încorporat pe un site web.

Construirea unui Arbore de Decizie Fără a Scrie Cod

O întrebare frecventă este dacă este necesară programarea pentru a construi un arbore de decizie. Vestea bună este că, în ciuda complexității teoretice a algoritmilor, nu este obligatoriu să știi să scrii cod pentru a implementa un arbore de decizie. Instrumente moderne, cunoscute sub numele de platforme "no-code" sau "low-code", au democratizat accesul la învățarea automată, permițând utilizatorilor să construiască și să exploreze modele precum arborii de decizie printr-o interfață simplă de tip drag-and-drop.

Iată cum funcționează procesul într-un astfel de mediu vizual:

- Importă Setul de Date: Primul pas este să aduci datele în platformă. Acest lucru se face de obicei printr-un nod special care citește date dintr-un fișier (CSV, Excel etc.).

- Pregătește Datele: Datele brute rareori sunt perfecte. Trebuie să te asiguri că sunt curate și organizate. Acest lucru implică adăugarea de noduri pentru a gestiona valorile lipsă (fie prin umplerea lor, fie prin eliminarea rândurilor afectate) și pentru a filtra coloanele relevante pentru analiza ta. De exemplu, dacă prezici dezabonarea clienților, te-ai concentra pe coloane precum vârsta, istoricul achizițiilor și satisfacția clientului.

- Împarte Datele pentru Antrenament și Testare: Este crucial să împarți setul de date în două părți: una pentru antrenarea arborelui (unde modelul învață din exemple) și alta pentru testarea performanței arborelui pe date nevăzute. Un nod de "partiționare" permite specificarea procentajului de împărțire (ex: 80% antrenament, 20% testare).

- Construiește Arborele de Decizie: Aici intervine "magia". Un nod de tip "Decision Tree Learner" (Învățător de Arbore de Decizie) este conectat la datele de antrenament. Configurezi acest nod specificând coloana pe care dorești să o prezici (coloana țintă). Nu trebuie să te intimideze multitudinea de "hyper-parametri" disponibili; pentru început, setările implicite sunt adesea suficiente.

- Testează Modelul: După antrenare, un nod de tip "Decision Tree Predictor" (Predictor de Arbore de Decizie) este utilizat pentru a aplica arborele antrenat pe setul de date de testare. Acest lucru generează predicții pentru datele pe care arborele nu le-a "văzut" niciodată în timpul antrenamentului.

- Evaluează Rezultatele: Pentru a înțelege cât de bine a funcționat arborele tău, un nod de "Scorer" (Evaluator) compară predicțiile cu rezultatele reale. Acesta va oferi metrici precum scorul de acuratețe și o matrice de confuzie, indicând de câte ori modelul a ghicit corect și în ce cazuri a greșit. Un scor de acuratețe mai mare indică, în general, o performanță mai bună, dar este important să fii precaut la scoruri neașteptat de mari, care ar putea semnala supra-antrenare.

- Vizualizează Arborele: Unul dintre cele mai mari avantaje ale arborilor de decizie este vizualizarea lor ușoară. Un nod de "Decision Tree View" (Vizualizare Arbore de Decizie) generează o diagramă clară și ușor de citit a arborelui tău, permițându-ți să vezi exact cum au fost luate deciziile și ce reguli au format diferitele ramuri.

- Salvează și Partajează: Odată ce ești mulțumit de rezultate, poți salva fluxul de lucru și chiar să-l exporți ca imagine sau să-l partajezi cu alți colegi sau entuziaști ai științei datelor.

Acest proces demonstrează că nu este necesară o expertiză profundă în programare pentru a începe să construiești și să utilizezi modele de învățare automată, deschizând porți către analiza datelor pentru un public mult mai larg.

Întrebări Frecvente (FAQ)

- Ce este un Arbore de Decizie?

- Un arbore de decizie este o structură arborescentă care utilizează ramuri pentru a reprezenta alegeri posibile și rezultatele lor. Este un instrument vizual și analitic pentru a facilita luarea deciziilor bazate pe date, împărțind continuu un set de date în subseturi mai mici, pe baza unor criterii specifice, până când fiecare subset devine suficient de omogen în ceea ce privește clasa țintă.

- Cum diferă un Arbore de Decizie de o Diagramă Flux?

- Deși ambele sunt reprezentări vizuale ale proceselor, un arbore de decizie este un tip specific de diagramă flux, concentrat exclusiv pe procesul de luare a deciziilor. El vizualizează toate căile posibile care pot fi urmate pe baza diferitelor alegeri sau decizii. O diagramă flux este un tip mai general de diagramă care poate reprezenta o varietate de procese, secvențe de pași sau relații între elemente, nu doar decizii.

- Este necesară programarea pentru a construi un Arbore de Decizie?

- Nu, nu este obligatoriu. Deși programarea (ex. în Python cu scikit-learn) oferă un control mai fin, există numeroase platforme "no-code" sau "low-code" (cum ar fi cele menționate în articol, fără a le numi direct) care permit construirea și vizualizarea arborilor de decizie printr-o interfață grafică intuitivă, prin drag-and-drop. Aceste instrumente fac învățarea automată accesibilă și persoanelor fără experiență în programare.

În concluzie, antrenarea unui arbore de decizie este un proces structurat, de la înțelegerea metricilor de împărțire precum entropia, la construirea recursivă a arborelui și aplicarea criteriilor de oprire. Fie că îl construiești manual, cu cod, sau folosești instrumente vizuale fără cod, puterea sa de a transforma datele în decizii clare și acționabile rămâne incontestabilă. Arborii de decizie sunt o dovadă a modului în care complexitatea poate fi descompusă în pași simpli, oferind soluții eficiente pentru o multitudine de probleme.

Dacă vrei să descoperi și alte articole similare cu Antrenarea Arborilor de Decizie: Ghid Complet, poți vizita categoria Fitness.