11/10/2024

În lumea dinamică și în continuă expansiune a inteligenței artificiale, înțelegerea modului în care performează un model este crucială pentru succesul oricărui proiect. Două concepte fundamentale care ne ajută să evaluăm și să optimizăm aceste performanțe sunt pierderea la antrenament și pierderea la validare. Acest ghid detaliat vă va purta prin definițiile, utilizările și implicațiile acestor metrici esențiale în învățarea profundă, oferind o perspectivă cuprinzătoare asupra modului de a construi modele AI eficiente și generalizabile.

Vom începe prin a defini aceste concepte cheie și a explica contextul lor în învățarea automată și învățarea profundă. Ulterior, vom explora modul în care sunt calculate și interpretate, culminând cu analiza scenariilor comune de performanță a modelului, cum ar fi sub-antrenarea, supra-antrenarea și potrivirea optimă. Prin înțelegerea profundă a acestor indicatori, veți dobândi instrumentele necesare pentru a diagnostica și a rafina modelele dumneavoastră, asigurându-vă că acestea nu doar învață din date, ci și generalizează eficient la informații noi, nevăzute.

- Fundamentele Învățării Profunde și Conceptul de Pierdere

- Pierderea la Antrenament: Înțelegerea Performanței Interne

- Pierderea la Validare: Măsura Generalizării

- Comparație Între Pierderea la Antrenament și Pierderea la Validare

- Implicațiile Pierderii la Antrenament și Validare

- Calculul Practic al Pierderii: Funcții de Cost Comune

- Sfaturi Practice pentru Monitorizarea Pierderii

- Întrebări Frecvente (FAQ)

- Concluzii

Fundamentele Învățării Profunde și Conceptul de Pierdere

Pentru a înțelege pe deplin pierderea la antrenament și la validare, este esențial să avem o bază solidă în conceptele de învățare profundă. Învățarea profundă (Deep Learning) reprezintă o ramură a învățării automate care se bazează pe utilizarea rețelelor neuronale artificiale. Aceste algoritmi sunt concepuți pentru a permite programelor de calculator să învețe și să descopere modele complexe în volume masive de date, imitând într-o anumită măsură funcționarea creierului uman.

Rețelele neuronale artificiale (Artificial Neural Networks - ANN) sunt structuri algoritmice inspirate de rețelele neuronale biologice. O ANN este compusă dintr-un sistem de noduri interconectate, numite neuroni, și ponderi (greutăți). Semnalele de intrare sunt inițial transmise prin acești neuroni, care apoi sunt activați de o funcție de activare și înmulțiți cu ponderi pentru a produce un semnal de ieșire. Prin ajustarea iterativă a acestor ponderi în timpul procesului de antrenament, rețeaua învață să mapeze intrările la ieșirile dorite.

Atunci când aplicăm algoritmi de învățare profundă pe un anumit set de date, rezultatul este un model capabil să preia o anumită intrare și să producă o ieșire. Pentru a evalua performanța acestui model, utilizăm o măsură cunoscută sub numele de pierdere (loss). Pierderea cuantifică eroarea produsă de model. O valoare mare a pierderii indică, de obicei, că modelul produce o ieșire eronată, în timp ce o valoare scăzută a pierderii sugerează că există mai puține erori în model și că predicțiile sale sunt mai precise.

Pierderea este calculată utilizând o funcție de cost (cost function) sau funcție de pierdere (loss function), care măsoară eroarea în diferite moduri. Alegerea funcției de cost depinde de problema specifică ce trebuie rezolvată și de tipul de date utilizate. De exemplu, pentru problemele de clasificare binară, se utilizează adesea entropia încrucișată (cross-entropy), în timp ce pentru problemele de regresie, eroarea pătratică medie (Mean Squared Error - MSE) este o alegere comună.

Pierderea la Antrenament: Înțelegerea Performanței Interne

Pierderea la antrenament (Training Loss) este o metrică utilizată pentru a evalua cât de bine se potrivește un model de învățare profundă datelor de antrenament. Cu alte cuvinte, măsoară eroarea modelului pe setul de antrenament. Setul de antrenament este o porțiune a setului de date utilizată pentru a antrena inițial modelul.

Din punct de vedere computațional, pierderea la antrenament este calculată prin însumarea erorilor pentru fiecare exemplu din setul de antrenament. Acest proces se desfășoară iterativ. Datele de antrenament sunt de obicei împărțite în subgrupuri mai mici, numite batch-uri (batches). După fiecare batch, modelul face predicții, erorile sunt calculate, iar ponderile rețelei sunt ajustate prin intermediul unui algoritm de optimizare (precum gradient descent) pentru a minimiza pierderea. Această ajustare a ponderilor se bazează pe gradientul funcției de pierdere în raport cu ponderile, indicând direcția în care ponderile trebuie modificate pentru a reduce eroarea.

Este important de reținut că pierderea la antrenament este măsurată, și de obicei raportată, după fiecare batch. Evoluția acestei pierderi este adesea vizualizată prin trasarea unei curbe a pierderii la antrenament pe parcursul epocilor de antrenament. O scădere constantă a pierderii la antrenament indică faptul că modelul învață eficient din datele pe care le-a văzut.

Pierderea la Validare: Măsura Generalizării

Spre deosebire de pierderea la antrenament, pierderea la validare (Validation Loss) este o metrică utilizată pentru a evalua performanța unui model de învățare profundă pe setul de validare. Setul de validare este o porțiune a setului de date, separată și păstrată special pentru a valida performanța modelului. Această porțiune de date nu este niciodată utilizată în timpul procesului de antrenament al modelului, ceea ce o face o măsură imparțială a capacității modelului de a generaliza la date noi, nevăzute.

Pierderea la validare este similară cu pierderea la antrenament în sensul că este calculată ca o sumă a erorilor pentru fiecare exemplu din setul de validare. Cu toate acestea, frecvența de măsurare diferă. Pierderea la validare este măsurată de obicei după fiecare epocă (epoch). O epocă reprezintă o trecere completă a întregului set de antrenament prin rețeaua neuronală.

Măsurarea pierderii la validare la sfârșitul fiecărei epoci ne oferă informații cruciale despre dacă modelul necesită ajustări suplimentare sau nu. Pentru a face acest lucru, trasăm de obicei o curbă de învățare pentru pierderea la validare, alături de curba pierderii la antrenament. Compararea acestor două curbe este esențială pentru a diagnostica problemele de performanță ale modelului.

Comparație Între Pierderea la Antrenament și Pierderea la Validare

Pentru a sublinia diferențele și rolurile complementare ale acestor două metrici, iată o tabelă comparativă:

| Caracteristică | Pierderea la Antrenament (Training Loss) | Pierderea la Validare (Validation Loss) |

|---|---|---|

| Scop | Măsoară cât de bine învață modelul datele pe care le-a văzut. | Măsoară capacitatea modelului de a generaliza la date noi. |

| Set de Date Utilizat | Setul de antrenament | Setul de validare (date nevăzute) |

| Frecvența Măsurării | După fiecare batch | După fiecare epocă |

| Indică | Performanța internă, capacitatea de memorare. | Capacitatea de generalizare, riscul de supra-antrenare. |

Implicațiile Pierderii la Antrenament și Validare

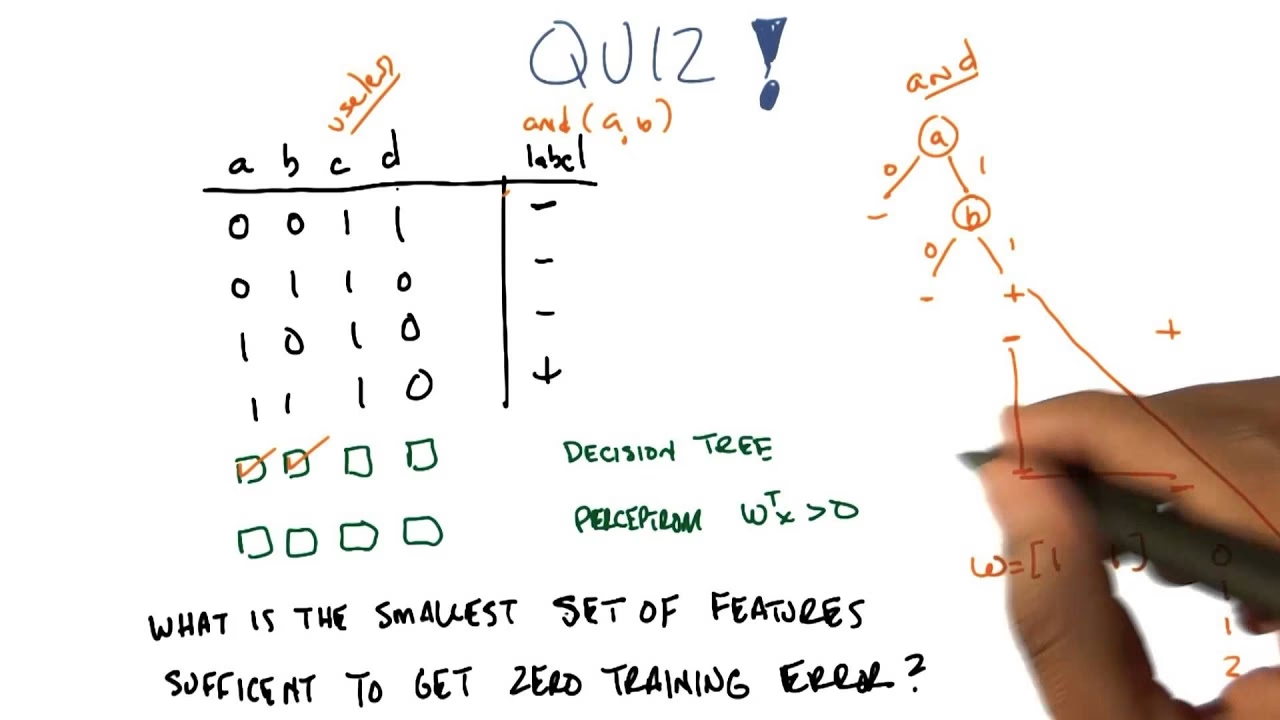

În majoritatea proiectelor de învățare profundă, pierderea la antrenament și pierderea la validare sunt vizualizate împreună pe un grafic. Scopul principal al acestei vizualizări este de a diagnostica performanța modelului și de a identifica aspectele care necesită ajustări. Vom folosi trei scenarii distincte pentru a explica aceste implicații.

Scenariul 1: Sub-antrenare (Underfitting)

Să considerăm un scenariu în care atât pierderea la antrenament, cât și pierderea la validare rămân ambele la valori ridicate. Acest lucru indică faptul că modelul suferă de sub-antrenare (underfitting). Sub-antrenarea apare atunci când modelul nu este capabil să modeleze cu precizie datele de antrenament, și prin urmare, generează erori mari atât pe setul de antrenament, cât și pe cel de validare. Practic, modelul este prea simplu sau nu a fost antrenat suficient pentru a capta complexitatea relațiilor din date.

Rezultatele din acest scenariu sugerează că este nevoie de antrenament suplimentar pentru a reduce pierderea. Alternativele includ creșterea complexității modelului (de exemplu, adăugarea mai multor straturi sau neuroni în rețeaua neuronală), ajustarea hiperparametrilor (cum ar fi rata de învățare) sau, în unele cazuri, creșterea cantității de date de antrenament, fie prin obținerea mai multor mostre, fie prin augmentarea datelor existente.

Scenariul 2: Supra-antrenare (Overfitting)

În cel de-al doilea scenariu, observăm că pierderea la validare este semnificativ mai mare decât pierderea la antrenament, mai ales după un anumit punct. Acest lucru indică, de obicei, că modelul suferă de supra-antrenare (overfitting) și nu poate generaliza bine pe date noi. Modelul performează excelent pe datele de antrenament – practic le-a memorat – dar performează slab pe datele noi din setul de validare. La un moment dat, pierderea la validare scade, dar apoi începe să crească din nou, în timp ce pierderea la antrenament continuă să scadă sau se stabilizează la o valoare foarte mică.

O cauză notabilă pentru această apariție este că modelul poate fi prea complex pentru datele disponibile, sau că modelul a fost antrenat pentru o perioadă prea lungă de timp, începând să memoreze zgomotul din datele de antrenament în loc să învețe modelele subiacente. În acest caz, antrenamentul poate fi oprit atunci când pierderea la validare atinge un minim și începe să crească din nou; această tehnică este cunoscută sub numele de oprire timpurie (early stopping). Oprirea timpurie este una dintre numeroasele abordări utilizate pentru a preveni supra-antrenarea. Alte soluții includ: utilizarea de regularizare (L1, L2), dropout, obținerea mai multor date de antrenament, reducerea complexității modelului sau utilizarea tehnicilor de augmentare a datelor.

Scenariul 3: Potrivire Optimă (Good Fit)

În scenariul ideal, observăm că atât pierderea la antrenament, cât și pierderea la validare scad ambele și se stabilizează la un anumit punct, fiind apropiate una de cealaltă. Acest lucru indică o potrivire optimă (good fit), adică un model care nu suferă nici de supra-antrenare, nici de sub-antrenare. Un astfel de model a învățat eficient modelele din datele de antrenament și este capabil să generalizeze bine la date noi, nevăzute. Obținerea acestui echilibru este scopul final al oricărui proces de antrenament al unui model de învățare profundă, deoarece asigură că modelul va fi performant în aplicații reale.

Calculul Practic al Pierderii: Funcții de Cost Comune

Așa cum am menționat, pierderea este calculată printr-o funcție de cost, care variază în funcție de tipul problemei. Să detaliem puțin acest aspect pentru a înțelege mai bine cum se transformă eroarea într-o valoare numerică.

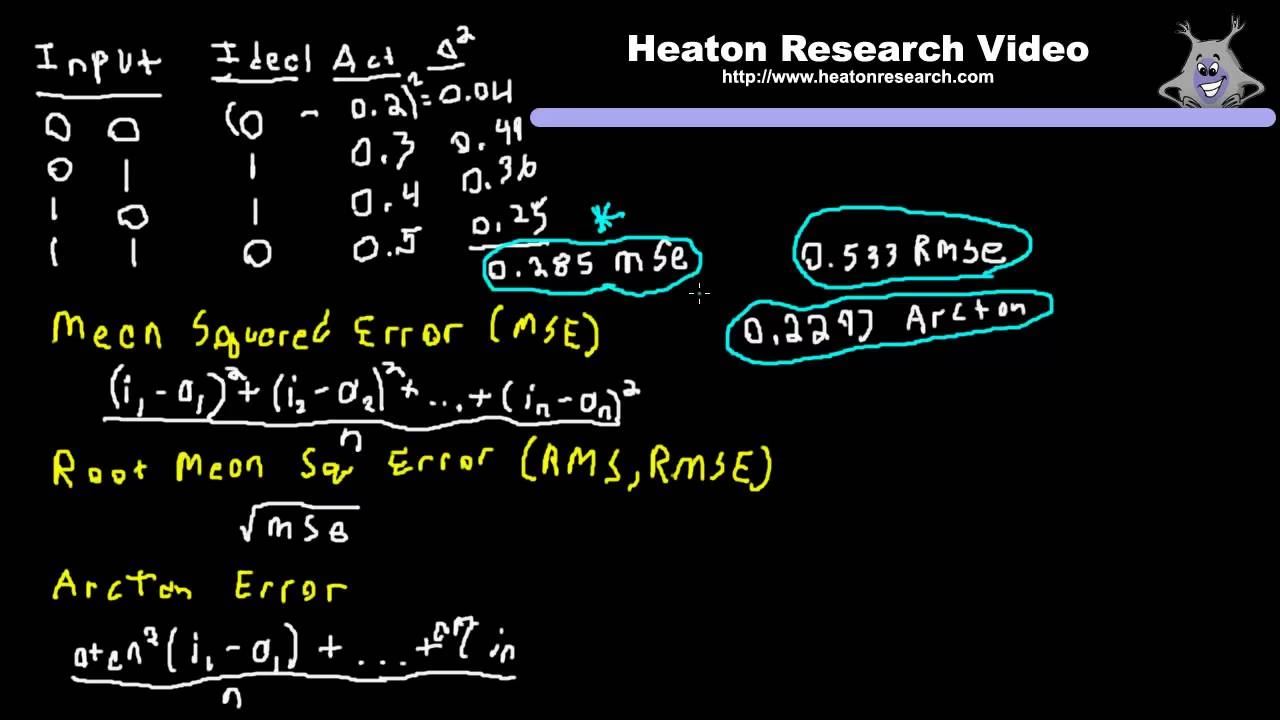

Eroarea Pătratică Medie (Mean Squared Error - MSE)

Pentru problemele de regresie, unde modelul încearcă să prezică o valoare numerică continuă (de exemplu, prețul unei case, temperatura), MSE este o funcție de cost foarte populară. Se calculează ca media pătratelor diferențelor dintre valorile prezise de model (ŷ) și valorile reale (y). Formula este:

MSE = (1/N) * Σ(yi - ŷi)^2

Unde N este numărul de exemple, yi este valoarea reală și ŷi este valoarea prezisă. Prin pătrarea diferenței, se asigură că erorile negative și pozitive contribuie la pierdere în mod egal și că erorile mai mari sunt penalizate mai puternic.

Entropia Încrustată (Cross-Entropy Loss)

Pentru problemele de clasificare, unde modelul prezice probabilitatea ca un exemplu să aparțină unei anumite clase (de exemplu, pisică sau câine, spam sau non-spam), se utilizează frecvent entropia încrucișată. Există două variante principale:

- Binary Cross-Entropy (BCE): Pentru clasificare binară (două clase). Calculează pierderea pe baza probabilităților prezise și a etichetelor reale (0 sau 1).

- Categorical Cross-Entropy: Pentru clasificare multi-clasă (mai mult de două clase).

Ideea de bază este de a penaliza modelul mai mult atunci când prezice o probabilitate mică pentru clasa corectă și o probabilitate mare pentru o clasă incorectă. Cu cât probabilitatea prezisă pentru clasa reală este mai aproape de 1, cu atât pierderea este mai mică.

Sfaturi Practice pentru Monitorizarea Pierderii

Pe lângă înțelegerea teoretică, implementarea practică a monitorizării pierderii este crucială:

- Vizualizarea Curbeor de Învățare: Întotdeauna vizualizați pierderea la antrenament și la validare pe același grafic. Acest lucru vă permite să identificați rapid tendințele de sub-antrenare sau supra-antrenare.

- Verificarea Stabilității: Odată ce pierderea atinge un platou, fie că este vorba de un minim sau de o stagnare, este un semnal că modelul a învățat tot ce poate de la datele curente sau că a intrat într-o fază de supra-antrenare.

- Ajustarea Hiperparametrilor: Rata de învățare, dimensiunea batch-ului, numărul de epoci și arhitectura modelului sunt doar câțiva dintre hiperparametrii care influențează direct curbele de pierdere. Experimentarea sistematică cu aceștia este esențială.

- Iterare și Rafinare: Construirea unui model performant este un proces iterativ. Analiza pierderii vă ghidează în fiecare pas de rafinare, ajutându-vă să luați decizii informate despre cum să îmbunătățiți modelul.

Întrebări Frecvente (FAQ)

De ce este importantă monitorizarea pierderii?

Monitorizarea pierderii este crucială deoarece oferă o imagine clară a performanței modelului pe parcursul antrenamentului. Vă permite să diagnosticați probleme precum sub-antrenarea (modelul nu învață suficient) și supra-antrenarea (modelul memorează datele de antrenament și nu generalizează bine), ghidându-vă în procesul de optimizare și asigurându-vă că modelul va funcționa eficient pe date noi.

Care este diferența cheie între pierderea la antrenament și pierderea la validare?

Diferența cheie constă în setul de date utilizat. Pierderea la antrenament măsoară eroarea modelului pe datele pe care le-a văzut și din care a învățat. Pierderea la validare, în schimb, măsoară eroarea pe un set de date complet nou, nevăzut, oferind o estimare a capacității modelului de a generaliza la informații din lumea reală.

Ce înseamnă o valoare mică a pierderii?

O valoare mică a pierderii indică faptul că modelul face predicții precise, cu erori minime. Cu cât valoarea pierderii este mai aproape de zero, cu atât modelul este mai performant în sarcina sa.

Cum pot reduce pierderea la antrenament?

Pentru a reduce pierderea la antrenament, puteți: crește numărul de epoci de antrenament, crește complexitatea modelului (mai multe straturi/neuroni), ajusta rata de învățare (de obicei, o rată mai mare la început), asigurați-vă că datele de antrenament sunt de bună calitate și relevante.

Este posibil ca pierderea la validare să fie mai mică decât pierderea la antrenament?

Deși este rar, se poate întâmpla, mai ales în primele epoci de antrenament sau dacă setul de validare este neobișnuit de ușor sau mic. De obicei, acest lucru indică o problemă în setarea datelor (de exemplu, setul de validare este prea similar cu cel de antrenament sau nu este reprezentativ) sau o coincidență statistică. Pe termen lung, pierderea la validare tinde să fie mai mare sau egală cu pierderea la antrenament, mai ales dacă modelul începe să se supra-antreneze.

Concluzii

În acest ghid, am explorat conceptele fundamentale de pierdere la antrenament și pierdere la validare, două metrici indispensabile în evaluarea și optimizarea modelelor de învățare profundă. Am discutat despre definițiile lor, modul în care sunt calculate și, cel mai important, implicațiile lor asupra performanței modelului. Înțelegerea profundă a acestor indicatori vă permite să diagnosticați eficient problemele precum sub-antrenarea și supra-antrenarea, și să aplicați strategii corective pentru a construi modele robuste, capabile să generalizeze și să performeze excelent pe date noi.

Capacitatea de a interpreta curbele de pierdere este o abilitate esențială pentru orice practicant de învățare automată. Prin stăpânirea acestei arte, veți fi mai bine echipat pentru a crea sisteme AI care nu doar învață, ci și performează în mod fiabil în scenarii din lumea reală, deschizând calea către inovații semnificative în diverse domenii ale inteligenței artificiale.

Dacă vrei să descoperi și alte articole similare cu Pierderea la Antrenament și Validare în AI, poți vizita categoria Fitness.