29/10/2021

În era digitală, cantitatea de text generată zilnic este colosală. De la e-mailuri și mesaje la articole de știri și postări pe rețelele sociale, limbajul uman este peste tot. Dar cum pot mașinile, care prin natura lor înțeleg doar numere, să proceseze și să înțeleagă nuanțele complexe ale limbajului? Răspunsul stă în conceptul de embeddings textuale – o metodă revoluționară de a transforma cuvintele și frazele în reprezentări numerice, inteligibile pentru algoritmii de învățare automată.

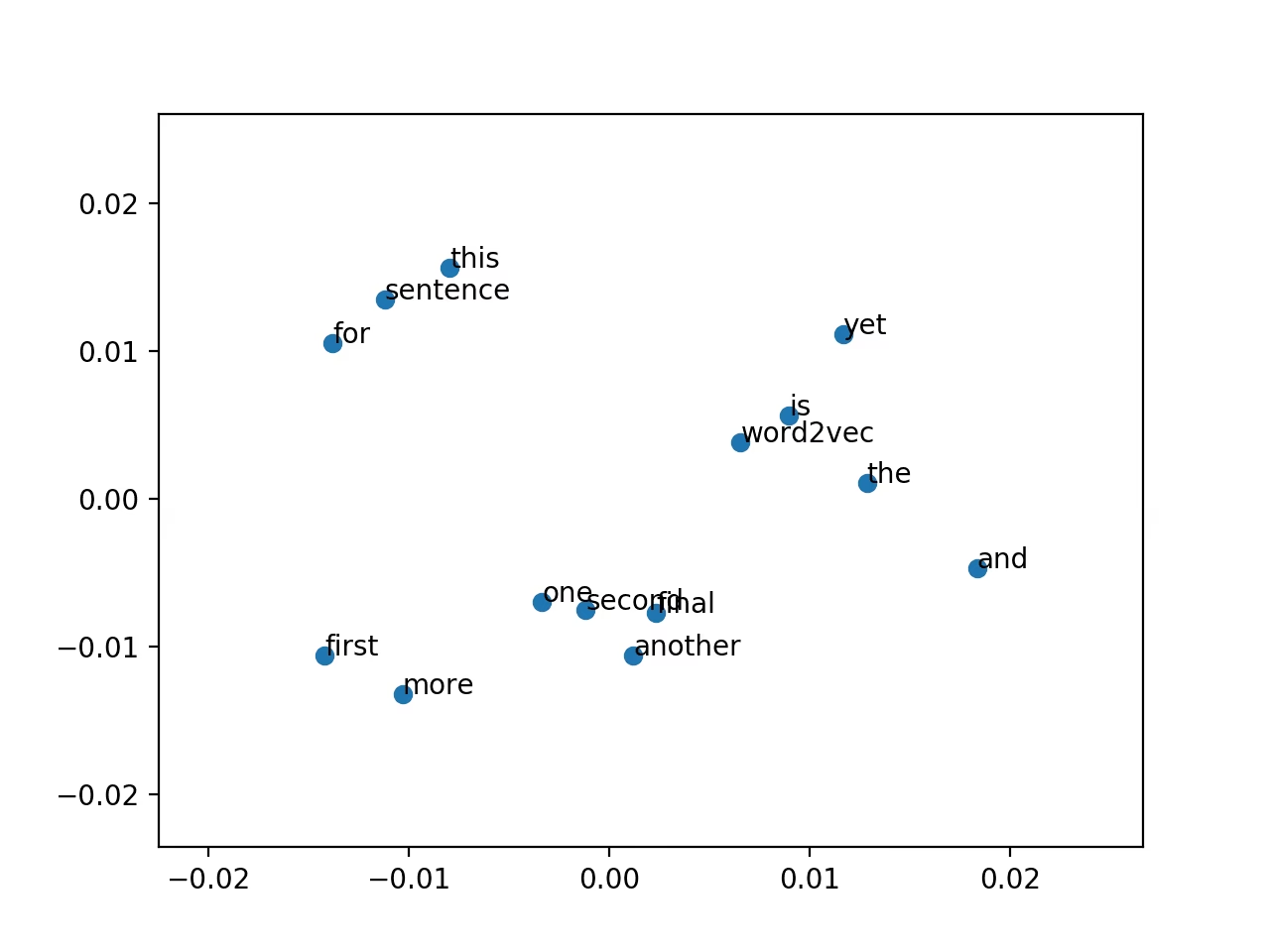

Imaginați-vă că fiecare cuvânt ar avea o "adresă" într-un spațiu multidimensional, unde cuvintele cu sensuri similare ar fi plasate aproape una de alta. Aceasta este esența embeddings-urilor. Ele ne permit să captăm nu doar prezența unui cuvânt, ci și sensul său semantic și contextul în care este folosit. Această transformare este fundamentală pentru o multitudine de aplicații de procesare a limbajului natural (NLP), de la clasificarea textului și analiza sentimentelor, la traducerea automată și motoarele de căutare.

Cum sunt "învățate" embeddings-urile din text?

Procesul de creare a acestor reprezentări numerice nu este deloc trivial. În esență, algoritmii de învățare a embeddings-urilor analizează relațiile dintre cuvinte într-un corpus mare de text. Două dintre cele mai cunoscute abordări timpurii sunt Continuous Bag of Words (CBOW) și Skip-Gram. Fără a intra în detalii tehnice complicate, ideea centrală este că aceste algoritmi examinează o "fereastră" de cuvinte din jurul unui cuvânt țintă pentru a înțelege contextul său. Prin analizarea repetată a acestor ferestre, modelul învață să asocieze cuvintele cu reprezentările lor numerice, astfel încât cuvintele care apar în contexte similare să aibă embeddings similare.

De exemplu, dacă algoritmul vede frecvent cuvintele "rege" și "regină" în contexte asemănătoare cu "bărbat" și "femeie", va învăța că relația dintre "rege" și "regină" este similară cu cea dintre "bărbat" și "femeie". Această capacitate de a capta relații semantice și chiar analogii este ceea ce face embeddings-urile atât de puternice.

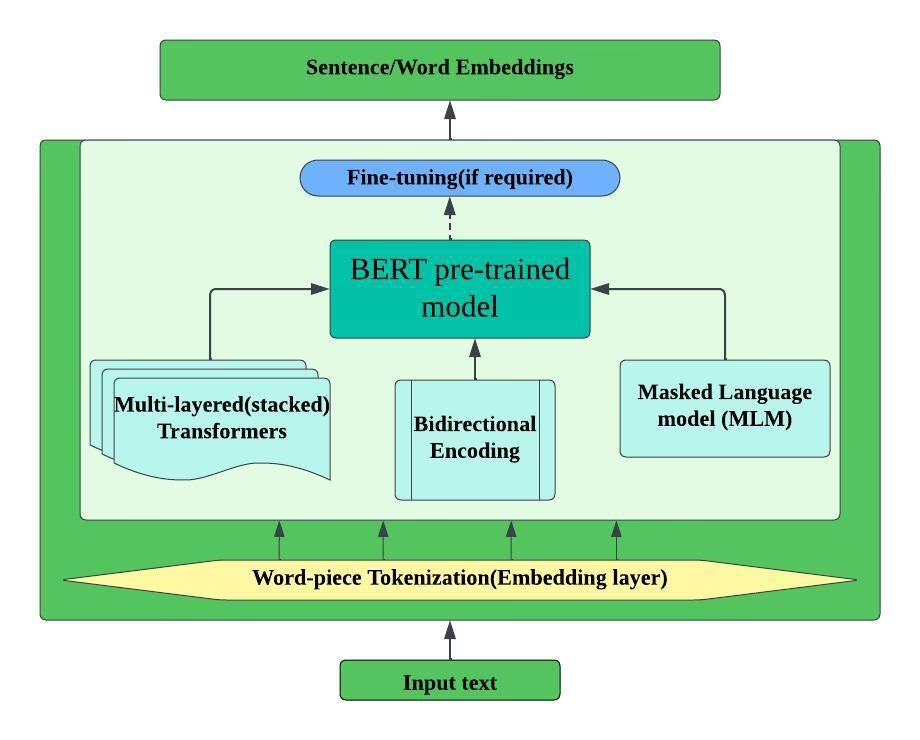

Mai recent, modele precum BERT (Bidirectional Encoder Representations from Transformers) au revoluționat modul în care înțelegem și generăm embeddings. Spre deosebire de abordările anterioare care priveau contextul într-o singură direcție (stânga sau dreapta), BERT analizează contextul bidirecțional, adică privește simultan cuvintele dinaintea și de după un cuvânt țintă. Această capacitate de a înțelege contextul în profunzime permite crearea unor embeddings mult mai bogate și mai nuanțate, esențiale pentru sarcinile complexe de NLP de astăzi.

De ce este crucial să-ți salvezi embeddings-urile?

Ați investit timp și resurse pentru a genera embeddings-uri valoroase, mai ales dacă folosiți modele complexe și mari precum BERT. Procesul de generare a acestor reprezentări numerice poate fi extrem de consumator de timp și resurse computaționale, mai ales când lucrați cu volume mari de text sau cu modele pre-antrenate de dimensiuni considerabile. Imaginați-vă că lucrați la un proiect de clasificare a textului în Google Colab, unde fiecare restart al kernelului înseamnă regenerarea tuturor embeddings-urilor – un proces care poate dura zeci de minute sau chiar ore, în funcție de dimensiunea setului de date și complexitatea modelului.

Soluția este simplă și eficientă: salvarea embeddings-urilor generate. Odată ce ați transformat textul în vectori numerici, aceștia pot fi stocați permanent și reîncărcați ori de câte ori aveți nevoie, fără a mai fi necesară regenerarea lor. Acest lucru nu doar că economisește timp prețios, dar reduce și consumul de resurse, permițându-vă să vă concentrați pe dezvoltarea și testarea modelelor de învățare automată.

Cum salvezi embeddings-urile într-un fișier NumPy?

Una dintre cele mai comune și eficiente metode de a salva și încărca date numerice în Python, în special atunci când lucrați cu array-uri, este utilizarea bibliotecii NumPy. Aceasta oferă funcții dedicate pentru serializarea și deserializarea array-urilor sale, ceea ce le face ideale pentru stocarea embeddings-urilor.

Să presupunem că aveți o listă de texte (text_list) și o funcție get_features(text) care, pentru fiecare text, returnează embedding-ul său sub forma unui array NumPy sau a unei liste de numere ce pot fi convertite într-un array NumPy. Procesul de salvare este următorul:

- Generarea Embeddings-urilor: Mai întâi, trebuie să generați toate embeddings-urile pentru setul dumneavoastră de date.

- Colectarea Embeddings-urilor într-o Structură Unică: De obicei, funcția

get_featuresva returna un vector pentru fiecare intrare. Trebuie să colectați acești vectori într-un singur array NumPy mare. - Salvarea cu

np.save(): Odată ce ați obținut array-ul NumPy final care conține toate embeddings-urile, îl puteți salva pe disc.

Iată un exemplu conceptual al codului pe care l-ați putea folosi, bazat pe scenariul dumneavoastră:

import numpy as np # Presupunem că 'get_features' este funcția dvs. care generează embedding-ul pentru un text # și 'text_list' este lista dvs. de texte. # Pasul 1: Generați embeddings-urile # Această operație poate dura mult timp embeddings_list = [] for text in text_list: embedding = get_features(text) # Aceasta va returna un array NumPy sau o listă embeddings_list.append(embedding) # Pasul 2: Convertiți lista de embeddings într-un singur array NumPy # Asigurați-vă că toate embeddings-urile individuale au aceeași dimensiune embeddings_array = np.array(embeddings_list) # Pasul 3: Salvați array-ul NumPy într-un fișier .npy # Numele fișierului poate fi orice doriți, de exemplu 'bert_embeddings.npy' np.save('bert_embeddings.npy', embeddings_array) print("Embeddings-urile au fost salvate cu succes în 'bert_embeddings.npy'") După ce ați salvat fișierul, îl puteți reîncărca oricând aveți nevoie, folosind np.load():

import numpy as np # Încărcați embeddings-urile salvate loaded_embeddings = np.load('bert_embeddings.npy') print(f"Embeddings-urile au fost încărcate. Forma array-ului: {loaded_embeddings.shape}") # Acum puteți folosi 'loaded_embeddings' direct în modelul dvs. de învățare automată Acest proces simplifică semnificativ fluxul de lucru, eliminând necesitatea de a regenera embeddings-urile la fiecare sesiune sau rulare a codului. Este o practică standard și foarte recomandată în proiectele de învățare automată care implică preprocesarea intensivă a datelor.

Procesul de Lucru cu Embeddings

Pentru a vizualiza mai bine pașii, iată o scurtă comparație a fluxurilor de lucru:

| Fără Salvare | Cu Salvare NumPy |

|---|---|

| Start sesiune / Repornire kernel | Start sesiune / Repornire kernel |

| Generează Embeddings (timp lung) | Verifică dacă fișierul .npy există |

| Folosește Embeddings în model | Dacă nu există: Generează Embeddings (timp lung) |

| Dacă nu există: Salvează Embeddings (.npy) | |

| Dacă există: Încarcă Embeddings (.npy) (timp scurt) | |

| Folosește Embeddings în model |

După cum se poate observa, salvarea embeddings-urilor reduce drastic timpul necesar pentru a începe lucrul cu datele preprocesate în sesiunile ulterioare.

Întrebări Frecvente (FAQ)

Ce sunt exact embeddings-urile textuale?

Embeddings-urile textuale sunt reprezentări numerice (vectori) ale cuvințelor, frazelor sau chiar ale documentelor întregi. Ele sunt create în așa fel încât cuvintele cu sensuri similare sau care apar în contexte similare să aibă vectori "aproape" unul de celălalt într-un spațiu multidimensional. Acest lucru permite algoritmilor de învățare automată să înțeleagă relațiile semantice dintre cuvinte.

De ce durează atât de mult generarea embeddings-urilor, în special cu BERT?

Generarea embeddings-urilor cu modele avansate precum BERT este un proces intensiv computațional din mai multe motive. Aceste modele sunt extrem de mari (milioane sau chiar miliarde de parametri) și necesită resurse semnificative (GPU-uri) pentru a procesa textul. De asemenea, ele efectuează operații complexe, cum ar fi atenția bidirecțională, care implică calcule matriciale extinse pentru fiecare token din text, contribuind la timpul lung de execuție, mai ales pentru seturi mari de date.

Pot folosi alte formate pentru salvarea embeddings-urilor în afară de NumPy?

Da, deși NumPy este o alegere excelentă pentru array-uri numerice, există și alte formate. Puteți folosi pickle pentru a serializa obiecte Python (inclusiv liste de array-uri NumPy), dar fișierele .npy sunt adesea mai eficiente pentru array-uri mari. Pentru volume extrem de mari de date sau dacă aveți nevoie de o bază de date structurată, ați putea considera formate precum HDF5 sau chiar baze de date specializate (e.g., FAISS pentru căutare de similaritate).

Când ar trebui să îmi salvez embeddings-urile?

Ar trebui să vă salvați embeddings-urile ori de câte ori procesul de generare este costisitor din punct de vedere computațional și intenționați să reutilizați aceleași embeddings de mai multe ori. Acest lucru este valabil pentru aproape toate proiectele de învățare automată care implică embeddings pre-antrenate sau fine-tuned pe un set de date specific, unde regenerarea lor ar însemna pierderea unui timp considerabil.

Sunt embeddings-urile statice sau dinamice?

Depinde de model. Embeddings-urile tradiționale (precum Word2Vec sau GloVe) sunt adesea "statice" – un cuvânt are același vector indiferent de context. În schimb, embeddings-urile generate de modele contextuale precum BERT sunt "dinamice" sau "contextuale". Asta înseamnă că vectorul pentru un cuvânt poate fi diferit în funcție de cuvintele care îl înconjoară în propoziție, permițând o înțelegere mult mai nuanțată a sensului.

Concluzie

Embeddings-urile textuale sunt coloana vertebrală a multor aplicații moderne de procesare a limbajului natural, transformând complexitatea limbajului uman în date numerice manipulabile de mașini. Înțelegerea modului în care sunt create și, mai important, cum să le gestionăm eficient prin salvarea și reutilizarea lor, este esențială pentru oricine lucrează în domeniul învățării automate și al NLP. Prin adoptarea unor practici precum salvarea embeddings-urilor în fișiere NumPy, nu doar că veți economisi timp și resurse computaționale, dar veți optimiza și fluxul de lucru al proiectelor dumneavoastră, permițându-vă să inovați mai rapid și mai eficient.

Investiția inițială în generarea și salvarea embeddings-urilor se va amortiza rapid prin eficiența câștigată în sesiunile de lucru ulterioare. Așadar, nu mai sta pe gânduri: transformă-ți datele text în active valoroase și pregătește-te să construiești modele NLP mai performante ca niciodată!

Dacă vrei să descoperi și alte articole similare cu Embeddings Textuale: De la Înțelegere la Salvare, poți vizita categoria Fitness.