14/04/2023

În lumea rapidă a învățării automate și a învățării profunde, instrumente precum TensorFlow și Keras au revoluționat modul în care construim și antrenăm rețele neuronale. Keras, acum pe deplin integrat în TensorFlow sub numele tf.keras, oferă o interfață API de nivel înalt, ușor de utilizat, dar incredibil de flexibilă. Acest ghid detaliat vă va purta prin diversele metode de antrenament și evaluare pe care Keras le pune la dispoziție, de la cele mai simple abordări până la controlul de nivel foarte scăzut, permițându-vă să înțelegeți și să implementați strategii complexe.

Vom explora cum funcțiile integrate vă pot simplifica munca, dar și cum puteți prelua controlul total asupra algoritmului de învățare, creând bucle de antrenament personalizate. Indiferent dacă sunteți la început de drum sau căutați să optimizați performanța și flexibilitatea modelelor dumneavoastră, veți găsi informații esențiale aici.

- Metode Integrate de Antrenare și Evaluare Keras

- Personalizarea Buclului de Antrenare: train_step() și Subclasarea Modelului

- Control Detaliat cu Bucle de Antrenare Personalizate

- Exemplu End-to-End: Antrenarea unui GAN cu un Buclă Personalizată

- Pregătirea Datelor și tf.data.Dataset

- Validarea Modelului și Selecția Hiperparametrilor

- Întrebări Frecvente

- Concluzie

Metode Integrate de Antrenare și Evaluare Keras

Keras este renumit pentru simplitatea sa, iar acest lucru este cel mai evident în metodele sale integrate de antrenament și evaluare: fit() și evaluate(). Acestea reprezintă punctul de plecare pentru majoritatea utilizatorilor și sunt suficiente pentru o gamă largă de aplicații.

Funcția model.fit()

Metoda model.fit() este inima antrenamentului în Keras. Ea se ocupă automat de multe detalii complexe, cum ar fi iterarea prin epoci și loturi de date, calculul pierderii, propagarea înapoi a erorii și actualizarea ponderilor modelului. Iată cum funcționează:

- Date de intrare: Primește seturile de date de antrenament (X_train, Y_train).

- Epoci: Specifică numărul de iterații complete peste întregul set de date (

epochs). - Dimensiunea lotului: Definește câte exemple sunt procesate la un moment dat înainte de actualizarea ponderilor (

batch_size). - Validare automată: O caracteristică extrem de utilă este

validation_split. Aceasta permite alocarea unui procent din datele de antrenament pentru validare. Keras va folosi această submulțime pentru a monitoriza performanța modelului la sfârșitul fiecărei epoci, fără a atinge setul de testare. Aceasta este crucială pentru selecția modelului și evitarea supra-antrenării. De exemplu,validation_split=0.2va rezerva 20% din datele de antrenament pentru validare.

Folosirea fit() este incredibil de eficientă pentru prototipare rapidă și pentru majoritatea scenariilor standard de învățare profundă. Vă scutește de a scrie manual buclele de antrenament și gestionarea detaliilor de nivel scăzut.

Funcția model.evaluate()

După ce modelul a fost antrenat, este esențial să se evalueze performanța sa pe date nevăzute. Metoda model.evaluate() este concepută exact pentru acest scop. Ea calculează pierderea și metricele specificate (cum ar fi acuratețea) pe un set de date separat, de obicei setul de testare (X_test, Y_test). Această evaluare oferă o estimare imparțială a modului în care modelul dumneavoastră se va comporta în lumea reală. Este crucial să nu utilizați niciodată setul de testare pentru selecția modelului sau ajustarea hiperparametrilor, deoarece acest lucru ar duce la o estimare părtinitoare a performanței.

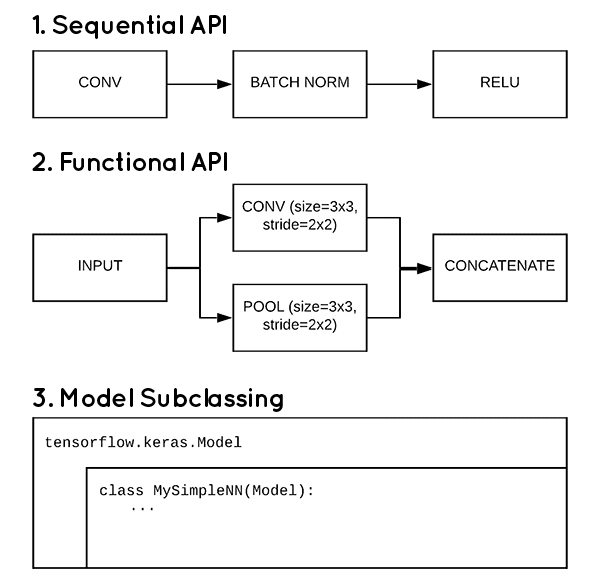

Personalizarea Buclului de Antrenare: train_step() și Subclasarea Modelului

Deși model.fit() este puternic, există scenarii în care aveți nevoie de un control mai fin asupra procesului de antrenament. De exemplu, antrenarea Rețelelor Generative Antagoniste (GAN-uri) sau implementarea unor algoritmi de învățare personalizați necesită adesea o logică de antrenament diferită. Aici intervine posibilitatea de a subclasa clasa keras.Model și de a implementa propria metodă train_step().

Atunci când subclasați keras.Model, puteți suprascrie metoda train_step(data). Această metodă este apelată repetat de fit() pentru fiecare lot de date. În interiorul ei, aveți libertatea de a defini întregul pas de antrenament: cum se calculează pierderea, cum se obțin gradienții și cum se aplică actualizările ponderilor. Această abordare vă permite să beneficiați în continuare de conveniența funcționalităților auxiliare ale fit() (cum ar fi barele de progres și apelurile inverse), dar cu flexibilitatea unui algoritm de învățare personalizat.

Control Detaliat cu Bucle de Antrenare Personalizate

Pentru controlul de cel mai jos nivel, puteți alege să scrieți propriile bucle de antrenament și evaluare de la zero. Această abordare este cea mai flexibilă, dar necesită o înțelegere mai profundă a operațiunilor TensorFlow.

Utilizarea GradientTape

Elementul central al buclelor de antrenament personalizate este tf.GradientTape. Aceasta este o API care înregistrează operațiile efectuate într-un bloc de cod, permițându-vă ulterior să calculați gradienții acestor operații în raport cu variabilele antrenabile (ponderile modelului).

Procesul implică următorii pași:

- Deschiderea unei Benzi de Gradient: Un context

with tf.GradientTape() as tape:este deschis pentru a înregistra operațiile din timpul pasului înainte (forward pass). - Pasul Înainte și Calculul Pierderii: În acest context, modelul este apelat cu datele de intrare (

logits = model(x_batch_train, training=True)), iar valoarea pierderii este calculată pe baza predicțiilor modelului și a etichetelor reale (loss_value = loss_fn(y_batch_train, logits)). - Recuperarea Gradienților: Odată ce pierderea este calculată,

grads = tape.gradient(loss_value, model.trainable_weights)este utilizat pentru a obține automat gradienții pierderii în raport cu toate variabilele antrenabile ale modelului. - Aplicarea Gradienților: În cele din urmă, un optimizator (ex.

keras.optimizers.SGD) este folosit pentru a actualiza ponderile modelului pe baza acestor gradienți (optimizer.apply_gradients(zip(grads, model.trainable_weights))).

Acest ciclu este repetat pentru fiecare lot de date și pentru fiecare epocă, formând un algoritm de optimizare prin descendența gradientului.

Gestionarea Metricilor la Nivel Scăzut

Chiar și în buclele de antrenament personalizate, puteți integra cu ușurință metricele Keras (atât cele încorporate, cât și cele personalizate). Procesul este simplu:

- Instanțiere: Creați o instanță a metricii la începutul buclei (ex.

train_acc_metric = keras.metrics.SparseCategoricalAccuracy()). - Actualizare: Apelați

metric.update_state(y_true, y_pred)după fiecare lot pentru a acumula starea metricii. - Vizualizare: Apelați

metric.result()pentru a obține valoarea curentă a metricii, de obicei la sfârșitul unei epoci. - Resetare: Apelați

metric.reset_states()pentru a șterge starea metricii la sfârșitul fiecărei epoci, pregătind-o pentru următoarea.

Această abordare vă permite să monitorizați performanța modelului în timp real, chiar și atunci când construiți buclele de la zero.

Accelerarea cu tf.function

TensorFlow 2.x rulează implicit în modul eager execution, ceea ce este excelent pentru depanare, dar poate fi mai lent decât execuția bazată pe grafice. Pentru a beneficia de optimizările de performanță ale compilării graficelor statice, puteți decora funcțiile pasului de antrenament și evaluare cu @tf.function.

Adăugarea acestui decorator transformă funcția Python într-un grafic TensorFlow compilabil. Acest lucru permite framework-ului să aplice optimizări globale care nu sunt posibile în modul eager execution, rezultând o viteză de antrenament semnificativ mai mare. Este o tehnică esențială pentru modelele mari și seturile de date extinse.

Gestionarea Pierderilor Urmărite de Model

Pe lângă pierderea principală calculată de funcția de pierdere, modelele Keras pot avea și pierderi suplimentare, cum ar fi pierderile de regularizare. Acestea sunt adesea adăugate prin apeluri la self.add_loss(value) în cadrul straturilor personalizate sau al modelului însuși. Aceste pierderi sunt colectate în proprietatea model.losses. Atunci când scrieți o buclă de antrenament personalizată, este important să le includeți în calculul total al pierderii:

loss_value += sum(model.losses)Aceasta asigură că toate componentele pierderii sunt luate în considerare la calcularea gradienților și la actualizarea ponderilor.

Exemplu End-to-End: Antrenarea unui GAN cu un Buclă Personalizată

Pentru a ilustra puterea și flexibilitatea buclelor de antrenament personalizate, să luăm exemplul unei Rețele Generative Antagoniste (GAN). O GAN este compusă din două modele: un generator, care creează date false (de exemplu, imagini), și un discriminator, care încearcă să distingă între datele reale și cele false.

Ciclul de antrenament al unei GAN este un proces în doi pași:

- Antrenarea Discriminatorului: Discriminatorul învață să clasifice imaginile reale ca reale și imaginile generate ca false. Acesta primește un lot de imagini reale și un lot de imagini generate de generator, apoi este antrenat să le eticheteze corect.

- Antrenarea Generatorului: Generatorul învață să creeze imagini suficient de realiste pentru a „înșela” discriminatorul. În acest pas, discriminatorul este utilizat pentru a evalua imaginile generate, dar gradienții sunt aplicați doar la generator, cu scopul de a-l face să producă imagini pe care discriminatorul le clasifică drept reale.

Implementarea acestui ciclu într-o buclă personalizată implică gestionarea separată a optimizatorilor și a calculelor de pierdere pentru cele două rețele. Se folosesc două instanțe de tf.GradientTape, una pentru discriminator și una pentru generator, și două optimizatori separați (d_optimizer și g_optimizer).

Acest exemplu subliniază de ce buclele personalizate sunt esențiale: model.fit() nu ar putea gestiona direct logica de antrenament competitivă și alternantă a unei GAN, unde două modele sunt antrenate secvențial, dar cu obiective opuse.

Pregătirea Datelor și tf.data.Dataset

Indiferent de metoda de antrenament aleasă, pregătirea datelor este un pas fundamental. Keras și TensorFlow oferă instrumente puternice pentru aceasta.

- Încărcarea și Preprocesarea: Datele, cum ar fi setul MNIST, trebuie încărcate și preprocesate. Aceasta implică adesea redimensionarea (ex.

np.reshape), normalizarea valorilor pixelilor (ex. la intervalul [0, 1]) și, pentru etichete, codificarea one-hot (tf.keras.utils.to_categorical) dacă se utilizează o funcție de pierdere precumcategorical_crossentropy. tf.data.Dataset: Această API este recomandată pentru construirea unor conducte de date eficiente și scalabile. Ea permite:- Crearea Dataset-ului: Din tensori (

tf.data.Dataset.from_tensor_slices()) sau din fișiere (tf.data.TFRecordDatasetpentru seturi de date mari). - Amestecare (Shuffle):

dataset.shuffle(buffer_size)pentru a asigura că loturile sunt aleatorii și pentru a preveni ca modelul să învețe ordinea datelor. - Împărțire în Loturi (Batching):

dataset.batch(batch_size)pentru a grupa exemplele în loturi, optimizând utilizarea resurselor hardware și viteza de antrenament.

Utilizarea

Dataseteste o practică excelentă pentru a gestiona eficient datele, mai ales în cazul seturilor de date mari care nu încap în memorie.Validarea Modelului și Selecția Hiperparametrilor

Un aspect crucial al antrenamentului eficient al modelelor este validarea. Validarea este procesul de evaluare a performanței modelului pe un subset de date pe care nu le-a văzut în timpul antrenamentului, dar pe care le folosim pentru a ajusta hiperparametrii și pentru a evita supra-antrenarea.

Reamintim că

model.fit()simplifică acest proces prin parametrulvalidation_split. Aceasta permite Keras să separe automat o parte din datele de antrenament pentru a fi utilizate ca set de validare. De exemplu, dacă aveți 100.000 de imagini pentru antrenament și setațivalidation_split=0.2, 80.000 de imagini vor fi folosite pentru antrenament și 20.000 pentru validare.Diferența cheie:

Set de Date Scop Utilizare Keras Antrenament Antrenarea modelului Intrare principală pentru model.fit()Validare Ajustarea hiperparametrilor, selecția modelului, monitorizarea supra-antrenării Parametrul validation_splitînmodel.fit()sau unvalidation_dataseparatTestare Estimare imparțială a performanței finale a modelului model.evaluate()o singură dată la finalEste vital să nu folosiți niciodată setul de testare pentru selecția modelului. Setul de testare ar trebui să rămână neatins până la final, pentru a oferi o estimare cât mai realistă a performanței modelului în condiții reale.

metrics: List of metrics to be evaluated by the model during training and testing. Each of this can be a string (name of a built-in function), function or a keras.metrics.Metric instance. See keras.metrics. Typically you will use metrics=['accuracy']. A function is any callable with the signature result = fn(y_true, _pred). Întrebări Frecvente

Q1: Când ar trebui să folosesc model.fit() și când o buclă personalizată?

R: Utilizați

model.fit()pentru majoritatea scenariilor standard de antrenament al rețelelor neuronale, deoarece este simplu, rapid și gestionează multe detalii interne. Optați pentru o buclă personalizată (prin suprascriereatrain_step()sau scriind o buclă de la zero) atunci când aveți nevoie de un control foarte fin asupra algoritmului de învățare (ex. antrenarea GAN-urilor, algoritmi de învățare prin consolidare, sau logici complexe de pierdere).Q2: Ce este tf.GradientTape?

R:

tf.GradientTapeeste o API TensorFlow care înregistrează operațiile efectuate într-un bloc de cod. Odată ce operațiile sunt înregistrate, puteți utiliza banda pentru a calcula automat gradienții oricărei ieșiri în raport cu orice variabile antrenabile implicate în acele operații. Este fundamentală pentru implementarea algoritmilor de optimizare bazati pe gradient.Q3: De ce este tf.function important?

R:

tf.functioncompilează o funcție Python care primește tensori ca intrare într-un grafic TensorFlow static. Acest lucru permite framework-ului să aplice optimizări de performanță la nivel global, ducând la o execuție mult mai rapidă, mai ales pentru modele mari și seturi de date extinse. Transformă modul de execuție eager în execuție bazată pe grafic, oferind un impuls semnificativ de viteză.Q4: Cum gestionez validarea în Keras?

R: Cea mai simplă metodă este să folosiți parametrul

validation_splitînmodel.fit(). Alternativ, puteți furniza un set de date de validare separat prin parametrulvalidation_data. Pentru bucle personalizate, puteți rula o buclă de evaluare separată la sfârșitul fiecărei epoci, folosindval_acc_metric.update_state()șival_acc_metric.result().Q5: Pot folosi metrice personalizate în buclele mele de antrenare?

R: Absolut! Keras vă permite să definiți propriile metrice personalizate. Acestea pot fi apoi instanțiate și utilizate în buclele personalizate prin apelarea

update_state()pentru a-și acumula starea,result()pentru a obține valoarea curentă șireset_states()pentru a le reseta la sfârșitul fiecărei epoci. Această flexibilitate vă permite să măsurați exact ceea ce este relevant pentru aplicația dumneavoastră.Concluzie

Ați parcurs acum o explorare amănunțită a metodelor de antrenament și evaluare în Keras, de la simplitatea funcției

fit()până la controlul granular oferit de buclele de antrenament personalizate cuGradientTapeși optimizările de viteză aduse detf.function. Înțelegerea acestor concepte vă oferă flexibilitatea de a alege abordarea potrivită pentru fiecare proiect, fie că este vorba de prototipare rapidă sau de implementarea unor algoritmi de învățare complecși.Keras, prin integrarea sa perfectă cu TensorFlow și prin API-ul său intuitiv, democratizează învățarea profundă, făcând-o accesibilă și puternică. Capacitatea de a gestiona eficient datele cu

DatasetAPI, de a monitoriza performanța cu metrice și de a valida corect modelele sunt piloni esențiali pentru construirea de sisteme de inteligență artificială robuste și performante. Continuați să experimentați și să explorați, deoarece lumea învățării automate este în continuă evoluție!- Crearea Dataset-ului: Din tensori (

Dacă vrei să descoperi și alte articole similare cu Antrenament și Evaluare Keras: De La Simplu La Avansat, poți vizita categoria Fitness.