21/12/2023

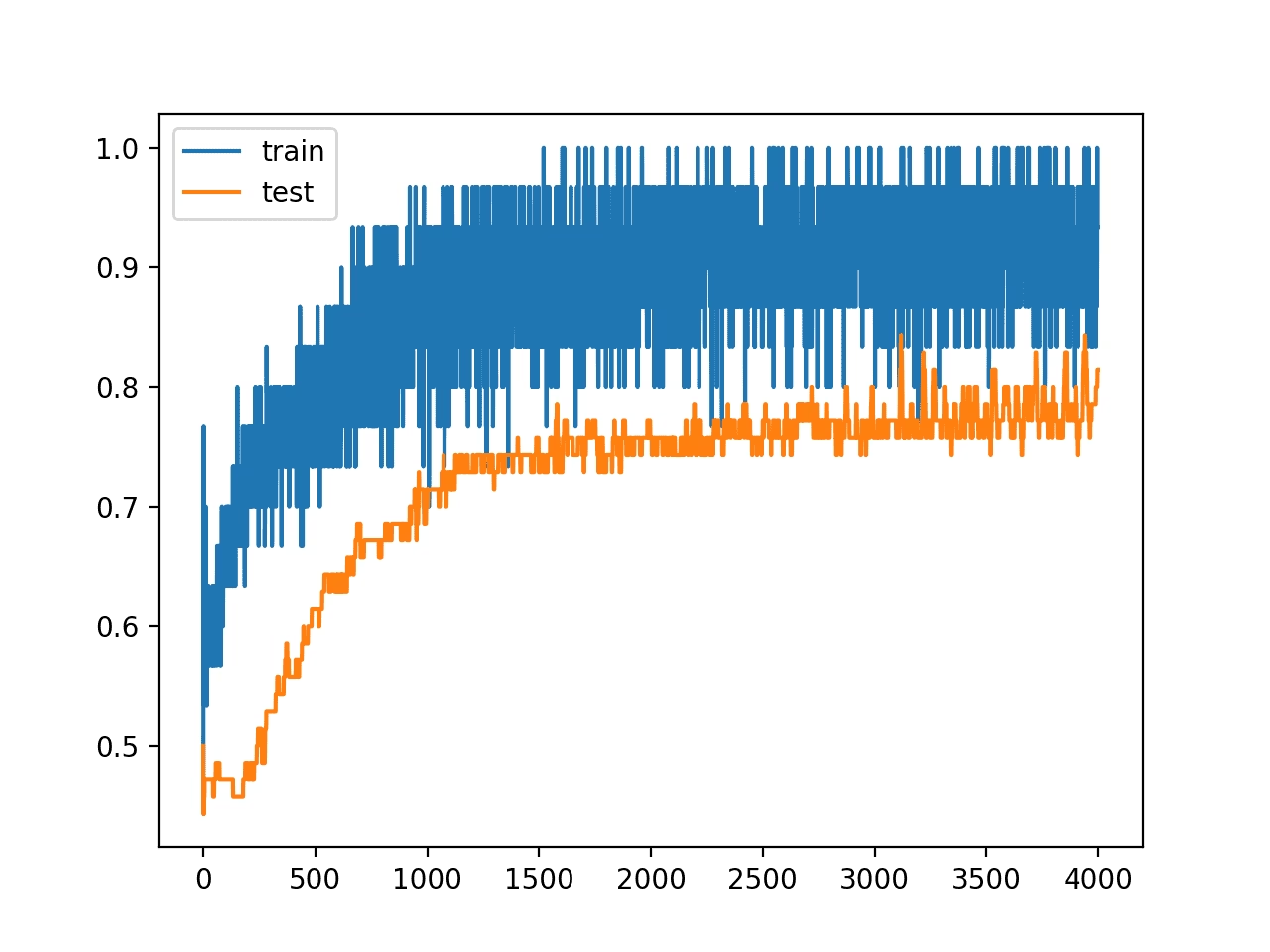

În lumea complexă a inteligenței artificiale și a învățării automate, construirea unor modele performante este un obiectiv constant. Cu toate acestea, un obstacol major cu care se confruntă adesea dezvoltatorii este fenomenul de overfitting. Acesta apare atunci când un model învață datele de antrenament prea bine, inclusiv zgomotul și particularitățile irelevante, pierzându-și astfel capacitatea de a generaliza eficient la date noi, nevăzute. Rezultatul este un model care performează excelent pe setul de antrenament, dar dezamăgitor pe datele reale. Din fericire, există tehnici puternice de regularizare menite să combată această problemă, iar una dintre cele mai eficiente și utilizate pe scară largă este Dropout, în special în cadrul framework-ului Keras.

Ce Este Dropout și De Ce Este Crucial?

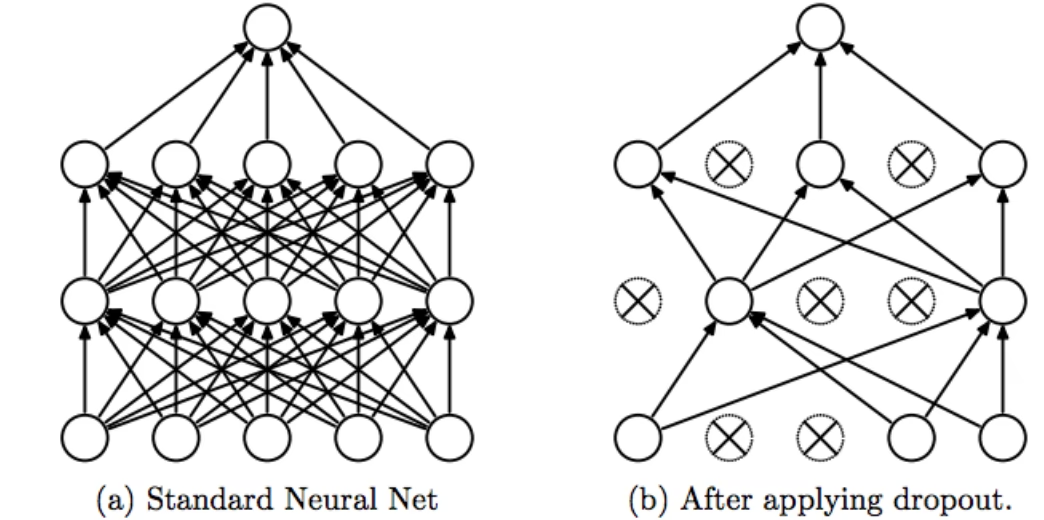

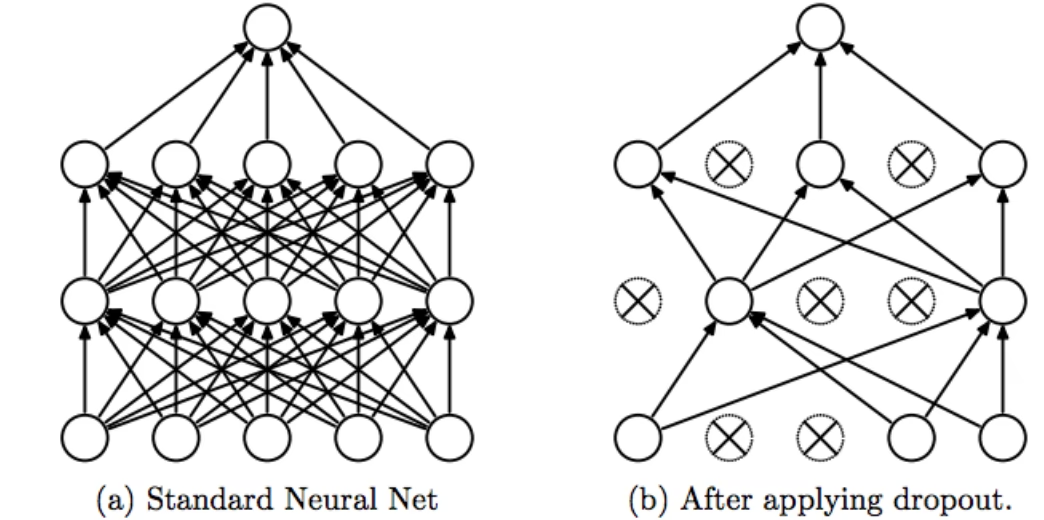

Dropout este o tehnică de regularizare dezvoltată pentru a reduce overfitting-ul în rețelele neurale profunde. Numele „Dropout” provine de la acțiunea de a „elimina” temporar neuroni (unități) din rețea în timpul fazei de antrenament. Esențial, scopul său este de a preveni co-adaptările complexe și excesive între neuroni, care duc la o specializare prea mare a rețelei pe setul de antrenament.

Imaginează-ți o rețea neurală ca o echipă de specialiști. Fără Dropout, acești specialiști ar putea începe să se bazeze prea mult unii pe alții pentru anumite sarcini, formând dependențe nesănătoase. Dacă unul dintre ei lipsește, întreaga echipă ar putea eșua. Dropout forțează fiecare „specialist” (neuron) să devină mai robust și mai independent, deoarece nu știe niciodată dacă colegii săi vor fi prezenți la următoarea iterație de antrenament. Astfel, rețeaua devine mai puțin sensibilă la ponderile specifice ale unor neuroni individuali, forțând-o să învețe caracteristici mai generalizabile.

Cum Funcționează Mecanismul Dropout?

Mecanismul din spatele Dropout este surprinzător de simplu, dar ingenios. În timpul fiecărui pas de antrenament (sau pentru fiecare mini-batch), un anumit procent (specificat de rata de dropout) dintre neuronii dintr-un strat sunt selectați aleatoriu și „dezactivați”. A dezactiva un neuron înseamnă a-i seta temporar ieșirea la zero. Aceasta are două implicații majore:

- Propagare înainte (Forward Propagation): Neuronii din straturile ulterioare nu vor mai primi contribuția de la neuronii dezactivați în timpul propagării înainte. Acest lucru forțează ceilalți neuroni să compenseze și să învețe reprezentări mai robuste ale datelor.

- Retropropagare (Backpropagation): Nicio actualizare nu va fi făcută pentru ponderile neuronilor dezactivați în timpul fazei de retropropagare. Ei sunt pur și simplu ignorați pentru acea iterație specifică de antrenament.

Acest proces de eliminare aleatorie creează, efectiv, o multitudine de „sub-rețele” diferite la fiecare pas de antrenament. Fiecare dintre aceste sub-rețele este antrenată doar pe o parte a datelor și cu o arhitectură ușor diferită. La finalul antrenamentului, rețeaua originală (cu toți neuronii activi) este utilizată pentru inferență. Acest lucru poate fi văzut ca o formă eficientă de învățare prin ansamblu (ensemble learning), unde modelul final beneficiază de „experiența” combinată a numeroaselor sale sub-rețele. Efectul este similar cu antrenarea mai multor rețele neurale diferite și apoi combinarea predicțiilor lor, dar într-un mod mult mai eficient din punct de vedere computațional.

Dropout în Modul de Antrenament vs. Modul de Inferență

Este crucial de înțeles că Dropout funcționează exclusiv în timpul fazei de antrenament. Când modelul este utilizat pentru predicții (inferență), toți neuronii sunt activi. Cu toate acestea, pentru a menține scala ieșirilor consistente între antrenament și inferență, Keras aplică o scalare inversă. Dacă, de exemplu, rata de dropout este de 0.5 (adică 50% dintre neuroni sunt eliminați), atunci în timpul inferenței, ieșirile neuronilor rămași sunt multiplicate cu 1 / (1 - rata de dropout). În acest caz, 1 / (1 - 0.5) = 2. Această scalare asigură că suma așteptată a intrărilor către stratul următor rămâne aproximativ aceeași, indiferent dacă modelul este în antrenament sau în inferență.

Iată o comparație simplificată:

| Aspect | Mod de Antrenament | Mod de Inferență |

|---|---|---|

| Activarea Neuronilor | Aleatoriu dezactivați (conform ratei) | Toți neuronii sunt activi |

| Actualizare Ponderi | Numai pentru neuronii activi | Nicio actualizare a ponderilor |

| Scalare Ieșiri | Nu se aplică scalare | Ieșirile sunt scalate cu 1 / (1 - rata) |

| Scop Principal | Regularizare, prevenirea overfitting-ului | Realizarea predicțiilor |

Implementarea Dropout în Keras

Implementarea Dropout în Keras este incredibil de simplă, datorită stratului dedicat tf.keras.layers.Dropout. Acest strat poate fi inserat oriunde într-o rețea neurală secvențială sau funcțională, de obicei după un strat Dense (sau Conv2D în cazul rețelelor convoluționale).

Parametrul cheie al stratului Dropout este rate, care specifică fracția (procentul) de unități de intrare care vor fi setate la 0. Valoarea acestei rate ar trebui să fie între 0 și 1.

Exemplu conceptual de adăugare a Dropout într-un model Keras:

model = tf.keras.Sequential([ tf.keras.layers.Dense(128, activation='relu', input_shape=(input_dim,)), tf.keras.layers.Dropout(0.2), # Aplică Dropout cu o rată de 20% tf.keras.layers.Dense(64, activation='relu'), tf.keras.layers.Dropout(0.3), # Aplică Dropout cu o rată de 30% tf.keras.layers.Dense(num_classes, activation='softmax') ])În exemplul de mai sus, primul strat Dropout elimină aleatoriu 20% dintre ieșirile primului strat Dense înainte ca acestea să ajungă la al doilea strat Dense. Al doilea strat Dropout face același lucru cu 30% dintre ieșirile celui de-al doilea strat Dense.

Unde să Aplici Dropout și Ce Rată să Alegi?

Nu există o regulă strictă universal valabilă privind locul exact unde ar trebui aplicat Dropout sau rata optimă, deoarece depinde foarte mult de specificul problemei și al arhitecturii rețelei. Cu toate acestea, există câteva linii directoare generale:

- Straturi de Intrare: Se recomandă aplicarea Dropout-ului și la stratul de intrare (adică, direct după stratul de intrare, afectând caracteristicile brute). O rată de aproximativ 0.2 (20%) este adesea sugerată pentru stratul de intrare. Aceasta ajută la tratarea zgomotului din datele de intrare.

- Straturi Ascunse: Dropout este cel mai frecvent aplicat între straturile ascunse. Ratele tipice variază între 0.2 și 0.5. O rată prea mică ar putea să nu ofere suficientă regularizare, în timp ce o rată prea mare ar putea duce la sub-învățare (underfitting) sau ar putea încetini semnificativ convergența modelului. O rată de 0.5 este adesea un bun punct de plecare, deoarece maximizează incertitudinea și forțează rețeaua să învețe caracteristici redundante și robuste.

- Stratul de Ieșire: De obicei, nu se aplică Dropout stratului de ieșire, deoarece ar putea afecta direct predicțiile finale într-un mod nedorit.

Experimentarea este cheia. Este recomandat să începi cu o rată moderată (ex. 0.3-0.5) și să o ajustezi în funcție de performanța modelului pe setul de validare.

Avantajele și Limitările Dropout

Avantaje:

- Reducerea Overfitting-ului: Acesta este principalul beneficiu. Prin forțarea rețelei să învețe caracteristici mai robuste și mai puțin dependente de neuroni individuali, Dropout îmbunătățește capacitatea de generalizare a modelului.

- Cost Computațional Redus: Comparativ cu alte tehnici de regularizare (cum ar fi ansamblurile multiple de modele), Dropout este extrem de eficient din punct de vedere computațional, deoarece este aplicat în timpul antrenamentului unei singure rețele.

- Simplitate: Este ușor de implementat în majoritatea framework-urilor de învățare profundă, inclusiv Keras, prin adăugarea unui singur strat.

- Îmbunătățește Robustețea: Modelele antrenate cu Dropout sunt adesea mai robuste la zgomotul din datele de intrare.

Limitări:

- Timp de Antrenament Potențial Crescut: Deși este eficient computațional, antrenamentul cu Dropout poate necesita mai multe epoci pentru a converge, deoarece rețeaua vede la fiecare pas o sub-rețea diferită.

- Rată Optimă Necunoscută: Găsirea ratei optime de dropout necesită experimentare și poate varia semnificativ de la un caz la altul. O rată prea mare poate duce la underfitting.

- Nu Este Universal: Deși este eficient pentru rețelele neurale dense și convoluționale, aplicarea sa poate fi mai puțin directă sau chiar contraproductivă în anumite arhitecturi (ex. Rețele Recurente - RNN-uri, unde există varietăți specifice de Dropout).

Întrebări Frecvente (FAQ) despre Dropout în Keras

Pe măsură ce explorezi Dropout, s-ar putea să apară câteva întrebări comune. Iată răspunsurile la cele mai frecvente dintre ele:

Q1: Când ar trebui să folosesc Dropout?

R: Ar trebui să iei în considerare utilizarea Dropout ori de câte ori rețeaua ta neurală prezintă semne de overfitting, adică performează mult mai bine pe setul de antrenament decât pe cel de validare sau de test. Este o primă linie de apărare excelentă împotriva acestui fenomen, în special în rețelele adânci cu mulți parametri și seturi de date de antrenament relativ mici.

Q2: Ce rată de dropout ar trebui să aleg?

R: Nu există o rată universală perfectă. Un punct de plecare bun este între 0.2 și 0.5. Pentru stratul de intrare, 0.2 este adesea recomandat. Pentru straturile ascunse, 0.5 este o alegere populară, deoarece maximizează incertitudinea. Cel mai bine este să experimentezi cu diferite valori și să monitorizezi performanța pe setul de validare.

Q3: Afectează Dropout timpul de inferență (predicție)?

R: Nu, Dropout nu afectează negativ timpul de inferență. În timpul inferenței, stratul Dropout nu elimină neuroni; în schimb, el acționează ca un factor de scalare (multiplicând intrările cu 1 / (1 - rata de dropout)) pentru a compensa absența eliminărilor din timpul antrenamentului. Această operațiune de scalare este minimă și nu încetinește semnificativ predicțiile.

Q4: Pot folosi Dropout cu orice tip de rețea neurală?

R: Dropout este cel mai eficient și mai frecvent utilizat cu rețelele neurale feed-forward dense și cu rețelele convoluționale (CNN-uri). Pentru rețelele recurente (RNN-uri) și arhitecturile avansate (cum ar fi Transformers), există variante specifice de Dropout (ex. Recurrent Dropout, Variational Dropout) care sunt concepute pentru a respecta structura temporală sau alte constrângeri ale acestor modele.

Q5: Este Dropout singura tehnică de regularizare?

R: Nu, Dropout este doar una dintre numeroasele tehnici de regularizare. Alte metode populare includ regularizarea L1 și L2 (Weight Decay), Batch Normalization, data augmentation (creșterea setului de date prin transformări), early stopping și constrângeri de normă maximă. Adesea, o combinație de mai multe tehnici poate oferi cele mai bune rezultate.

Concluzie

Dropout este o tehnică fundamentală și extrem de valoroasă în arsenalul oricărui specialist în învățare profundă. Simplitatea sa în implementare, combinată cu eficacitatea sa remarcabilă în combaterea overfitting-ului, o face o alegere implicită pentru multe arhitecturi de rețele neurale. Prin înțelegerea mecanismului său și prin aplicarea corectă a stratului tf.keras.layers.Dropout, poți construi modele mult mai robuste, capabile să generalizeze mai bine la date noi și să ofere predicții de o acuratețe superioară în aplicațiile din lumea reală. Nu uita să experimentezi cu rate diferite și să monitorizezi performanța modelului tău pe setul de validare pentru a găsi configurația optimă.

Dacă vrei să descoperi și alte articole similare cu Dropout în Keras: Lupta Împotriva Overfitting-ului, poți vizita categoria Fitness.