04/08/2024

În era digitală actuală, Inteligența Artificială (IA) și Machine Learning (ML) transformă rapid fiecare domeniu, de la medicină la finanțe și, desigur, chiar și fitness. Cu toate acestea, pe măsură ce modelele de IA devin din ce în ce mai complexe – cum ar fi Modelele Lingvistice Mari (LLM-uri) cu miliarde de parametri – antrenarea acestora devine o provocare imensă. Antrenamentul necesită resurse computaționale colosale și o infrastructură capabilă să gestioneze volume masive de date și calcule. Aici intervine Kubeflow Trainer, o soluție inovatoare concepută pentru a aborda aceste provocări, permițând antrenarea scalabilă și distribuită a modelelor ML.

- Ce Este Kubeflow Trainer?

- De Ce Avem Nevoie de Kubeflow Trainer în Peisajul ML Modern?

- Funcționalități Cheie și Beneficii ale Kubeflow Trainer

- Cum Funcționează Kubeflow Trainer (O Perspectivă Simplificată)

- Scenarii de Utilizare pentru Kubeflow Trainer

- Kubeflow Trainer vs. Kubeflow Training Operator V1: O Perspectivă Asupra Evoluției

- Întrebări Frecvente (FAQ) Despre Kubeflow Trainer

- Concluzie

Ce Este Kubeflow Trainer?

Kubeflow Trainer este un proiect nativ Kubernetes, special conceput pentru a facilita antrenarea la scară largă a modelelor de Machine Learning. În esență, este un instrument puternic care permite dezvoltatorilor și cercetătorilor să antreneze eficient modele complexe, inclusiv LLM-uri, prin distribuirea sarcinii de antrenament pe un cluster de calcul. Indiferent dacă lucrați cu PyTorch, JAX, TensorFlow sau alte framework-uri populare de ML, Kubeflow Trainer oferă o platformă unificată și robustă pentru operațiunile dumneavoastră de antrenament.

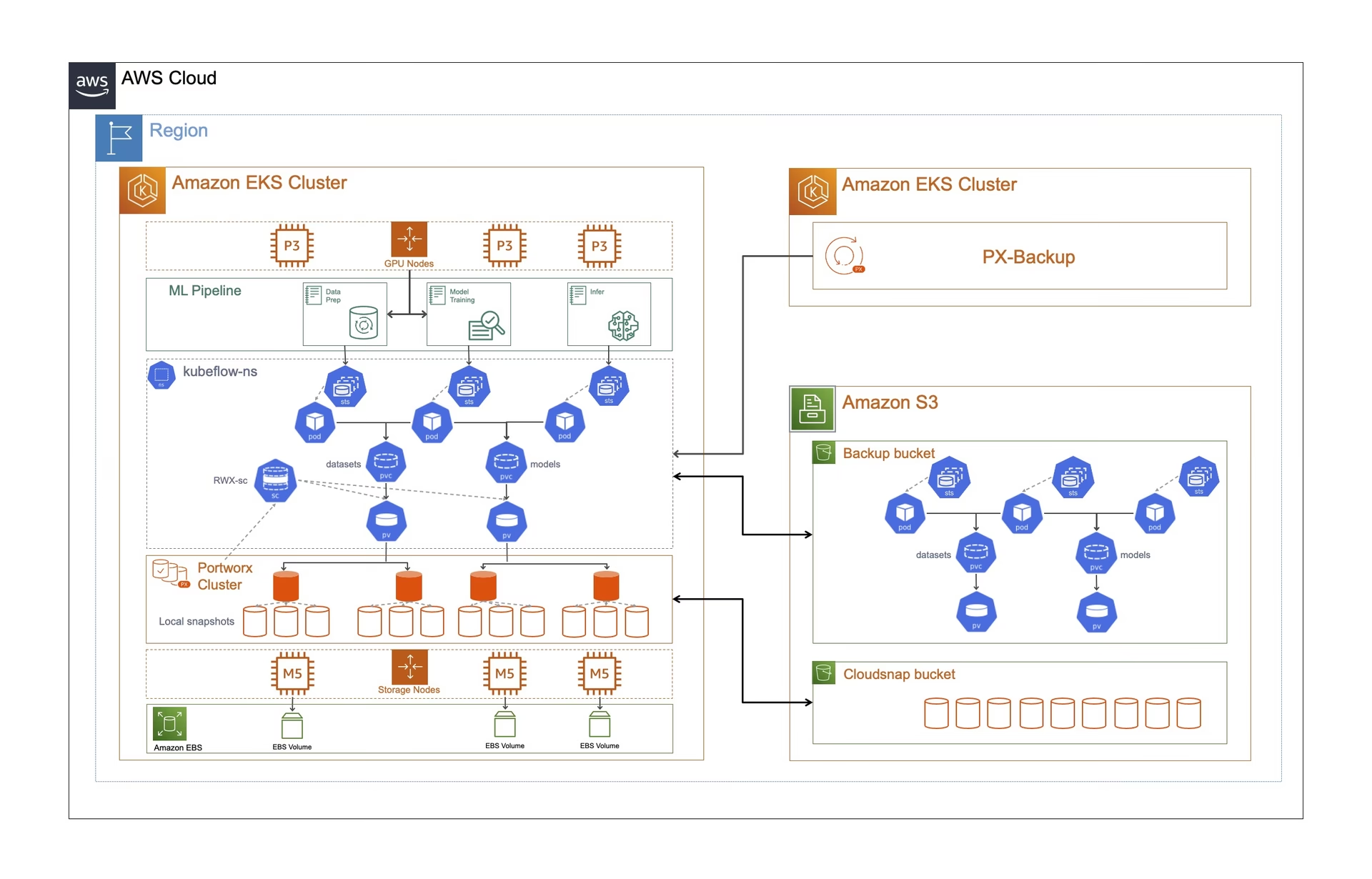

Conceptul de "nativ Kubernetes" este crucial aici. Aceasta înseamnă că Kubeflow Trainer se integrează perfect cu ecosistemul Kubernetes, utilizând capacitățile sale de orchestrare și gestionare a containerelor pentru a aloca resurse, a monitoriza și a scala antrenamentele ML. Acest lucru elimină multe dintre complexitățile asociate cu configurarea și gestionarea infrastructurii de antrenament distribuit, permițând echipelor să se concentreze mai mult pe aspectele modelării și mai puțin pe operațiunile de infrastructură.

De Ce Avem Nevoie de Kubeflow Trainer în Peisajul ML Modern?

Nevoiile de antrenament ale modelelor ML au evoluat exponențial. Modelele de ultimă generație, cum ar fi GPT-3, BERT sau chiar modele specializate în viziune computerizată, necesită putere de calcul care depășește cu mult capacitatea unei singure mașini sau a unui singur GPU. Iată de ce Kubeflow Trainer este indispensabil:

Gestionarea Complexității Modelelor Mari: Antrenarea LLM-uri și a altor modele masive implică manipularea a miliarde de parametri și seturi de date de terabytes. O astfel de sarcină este imposibil de realizat eficient fără un sistem de antrenament distribuit.

Eficiența Resurselor și Costurilor: Prin utilizarea Kubernetes, Kubeflow Trainer maximizează utilizarea hardware-ului disponibil (CPU-uri, GPU-uri), alocând dinamic resurse în funcție de necesități. Acest lucru reduce costurile operaționale pe termen lung, evitând subutilizarea sau supraprovizionarea resurselor.

Antrenament Paralel și Distribuție Avansată: Trainer permite divizarea sarcinii de antrenament în sub-sarcini mai mici, care pot fi executate simultan pe mai multe noduri ale clusterului. Această paralelism accelerează semnificativ timpul necesar pentru a ajunge la convergența modelului, un aspect critic în ciclurile rapide de dezvoltare de IA.

Reproducibilitate și Consistență: Prin definirea antrenamentelor ca resurse Kubernetes (Custom Resources), Kubeflow Trainer asigură că fiecare antrenament rulează într-un mediu consistent și reproductibil. Acest lucru este vital pentru depanare, audit și pentru asigurarea calității modelelor.

Funcționalități Cheie și Beneficii ale Kubeflow Trainer

Kubeflow Trainer nu este doar un instrument de antrenament distribuit; este o platformă bogată în funcționalități care simplifică întregul proces de dezvoltare ML:

Suport Multi-Framework Robuste: Flexibilitatea este esențială în ML. Kubeflow Trainer suportă nativ framework-uri precum PyTorch, JAX și TensorFlow, permițând dezvoltatorilor să utilizeze instrumentele cu care sunt deja familiarizați sau cele mai potrivite pentru sarcina specifică. Această agnosticism față de framework-uri încurajează inovația și adoptarea celor mai noi tehnologii.

Integrare Cu Biblioteci ML Avansate: Unul dintre punctele forte ale Kubeflow Trainer este capacitatea sa de a se integra cu biblioteci specializate de optimizare și scalare, cum ar fi HuggingFace, DeepSpeed sau Megatron-LM. Această integrare este vitală pentru a aborda provocările specifice ale antrenamentului la scară foarte mare:

HuggingFace: Cunoscut pentru bibliotecile sale de transformere și NLP, integrarea cu HuggingFace permite antrenarea și fine-tuning-ul rapid al modelelor lingvistice avansate.

DeepSpeed: O bibliotecă de optimizare a antrenamentului care reduce semnificativ cerințele de memorie și accelerează antrenamentul, în special pentru modele cu număr mare de parametri.

Megatron-LM: Dezvoltat de NVIDIA, este specializat în antrenarea LLM-urilor gigantice, oferind metode avansate de paralelism model și date.

Prin combinarea acestor biblioteci cu puterea de orchestrare a Kubeflow Trainer, dezvoltatorii pot construi și antrena modele cu o eficiență și o scală de neegalat.

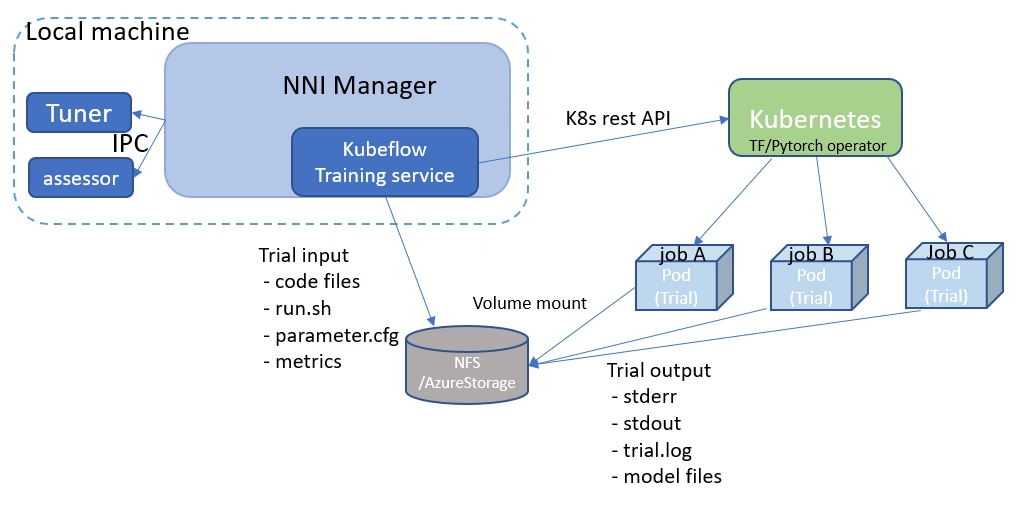

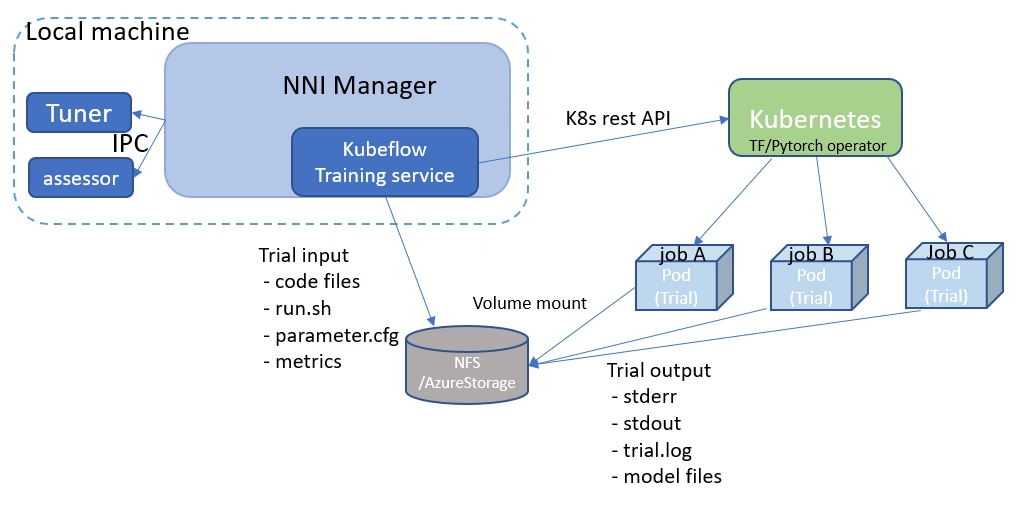

Dezvoltare Simplificată cu Kubeflow Python SDK: Pentru a face interacțiunea cu Kubeflow Trainer cât mai accesibilă, proiectul oferă un SDK Python. Acest SDK permite dezvoltatorilor să definească, să lanseze și să gestioneze antrenamentele ML direct din codul Python, abstractizând complexitatea API-urilor Kubernetes. Această abordare programatică accelerează ciclul de dezvoltare și reduce curba de învățare pentru inginerii ML.

By the end of this course, you will understand Kubeflow’s architecture and key components and know how to prepare data, model training, serving, and management within Kubeflow. You will be ready to deploy real-world ML projects using Kubeflow as well as have the skills and knowledge needed to contribute to the Kubeflow community. Welcome! Runtimes Nativ Kubernetes Utilizând API-uri Custom Resource: La baza Kubeflow Trainer stau API-urile Custom Resource (CRD-uri) din Kubernetes. Acestea permit definirea unor noi tipuri de resurse în Kubernetes, cum ar fi "TrainingJob". Dezvoltatorii specifică cerințele antrenamentului (de exemplu, tipul modelului, cantitatea de GPU-uri, setul de date) într-un fișier YAML sau prin SDK, iar Kubeflow Trainer se ocupă de transformarea acestei specificații într-un set de pod-uri și servicii Kubernetes care rulează antrenamentul. Această abordare declarativă asigură o gestionare robustă și automată a fluxurilor de lucru ML.

Cum Funcționează Kubeflow Trainer (O Perspectivă Simplificată)

Imaginați-vă că aveți un model de IA uriaș și un set de date la fel de mare. Fără Kubeflow Trainer, ar trebui să gestionați manual distribuția datelor, sincronizarea modelului între mai multe mașini și coordonarea proceselor de antrenament. Este o sarcină herculeană. Kubeflow Trainer simplifică acest proces astfel:

Definirea Sarcinii de Antrenament: Utilizați Kubeflow Python SDK sau un fișier YAML pentru a descrie sarcina de antrenament. Specificați framework-ul (ex: PyTorch), locația codului modelului, datele de intrare, numărul de noduri necesare și resursele (ex: GPU-uri per nod).

Orchestrarea Kubernetes: Odată ce sarcina este trimisă către clusterul Kubernetes, operatorul Kubeflow Trainer preia controlul. Acesta interpretează specificațiile și creează pod-uri Kubernetes corespunzătoare, alocând resursele necesare (GPU-uri, memorie, CPU) și configurând rețeaua pentru comunicarea între procesele de antrenament distribuite.

Execuția Distribuită: Procesele de antrenament rulează în paralel pe pod-urile alocate. Kubeflow Trainer se asigură că datele sunt accesibile, că gradientii sunt sincronizați corect între noduri (în cazul antrenamentului distribuit pe bază de gradient), și că progresul antrenamentului este monitorizat constant.

Monitorizare și Gestionare: Pe parcursul antrenamentului, Kubeflow Trainer oferă vizibilitate asupra progresului și a stării. În cazul unor erori sau finalizării, gestionează curățarea resurselor sau repornirea sarcinilor, dacă este configurat.

Scenarii de Utilizare pentru Kubeflow Trainer

Datorită capacităților sale de antrenament distribuit și scalabil, Kubeflow Trainer este ideal pentru o multitudine de aplicații de Inteligență Artificială, în special cele care implică:

Antrenarea Modelelor Lingvistice Mari (LLM-uri): Acesta este un caz de utilizare principal. Fie că este vorba de fine-tuning-ul unui model pre-antrenat sau de antrenarea de la zero a unui LLM, Kubeflow Trainer oferă infrastructura necesară pentru a gestiona cerințele computaționale masive.

Viziune Computerizată la Scară Largă: Procesarea și antrenarea modelelor pe seturi de date de imagini și video de terabytes (cum ar fi cele din supraveghere, mașini autonome sau imagistică medicală) beneficiază enorm de pe urma antrenamentului distribuit.

Sisteme de Recomandare Personalizate: Antrenarea modelelor complexe de recomandare pe volume uriașe de date de interacțiune a utilizatorilor, pentru platforme de streaming, comerț electronic sau social media.

Cercetare Științifică și Descoperiri: În domenii precum bioinformatica, fizica sau chimia, antrenarea modelelor ML pentru simulări complexe sau analiza datelor experimentale la scară mare devine mult mai eficientă.

Kubeflow Trainer vs. Kubeflow Training Operator V1: O Perspectivă Asupra Evoluției

Este important de menționat că proiectul Kubeflow Trainer este, în prezent, în stadiu Alpha. Aceasta înseamnă că API-urile sale se pot schimba pe măsură ce proiectul evoluează. Pentru utilizatorii familiarizați cu versiunile anterioare, cum ar fi Kubeflow Training Operator V1, există un drum de migrare. Trainer-ul reprezintă o evoluție, un efort de a unifica și simplifica experiența utilizatorilor și a dezvoltatorilor, pornind de la operatorii distribuiți inițiali (cum ar fi operatorul TensorFlow distribuit).

Comunitatea Kubeflow continuă să mențină codul sursă al Training Operator V1 pe ramura release-1.9, asigurând suport pentru implementările existente. Această abordare dublă permite inovația rapidă cu Kubeflow Trainer, oferind în același timp stabilitate pentru versiunile anterioare.

Comparație Conceptuală: Antrenament Local vs. Antrenament Distribuit cu Kubeflow Trainer

| Caracteristică | Antrenament Local (Ex: pe un singur GPU) | Antrenament Distribuit cu Kubeflow Trainer |

|---|---|---|

| Scalabilitate | Limitată de resursele unei singure mașini sau ale unui singur GPU. Modelele mari pot depăși memoria disponibilă. | Aproape nelimitată, permițând utilizarea unui întreg cluster de mașini și GPU-uri. Poate antrena modele de miliarde de parametri. |

| Timp de Antrenament | Potențial foarte lung pentru modele complexe și seturi de date mari, putând dura zile sau chiar săptămâni. | Redus semnificativ prin paralelism. Sarcinile sunt împărțite și executate simultan, accelerând convergența modelului. |

| Complexitate de Setare | Relativ simplu de configurat pe o mașină individuală, necesită doar instalarea framework-ului ML. | Necesită cunoștințe de bază despre Kubernetes, dar Kubeflow Trainer simplifică mult orchestrările complexe. |

| Costuri Inițiale | Investiție inițială mai mică în hardware, dar poate fi ineficient pe termen lung dacă timpul este critic. | Necesită o infrastructură Kubernetes existentă sau investiții în cloud, dar oferă o eficiență superioară a resurselor la scară. |

| Reproducibilitate | Dependentă de configurația exactă a mediului local, ceea ce poate duce la inconsecvențe între mașini. | Înaltă, datorită containerizării și orchestrării Kubernetes, asigurând medii de rulare consistente și izolate. |

| Managementul Erorilor | Gestionare manuală a erorilor și a reluărilor. | Recuperare automată și gestionare a erorilor prin mecanismele de orchestrare ale Kubernetes. |

Întrebări Frecvente (FAQ) Despre Kubeflow Trainer

- Q: Ce tipuri de modele de Machine Learning pot antrena cu Kubeflow Trainer?

- R: Kubeflow Trainer este extrem de versatil și poate fi folosit pentru a antrena o gamă largă de modele ML, inclusiv rețele neuronale profunde, modele de viziune computerizată, modele de procesare a limbajului natural (NLP), și în special Modele Lingvistice Mari (LLM-uri). Suportul pentru framework-uri precum PyTorch, JAX și TensorFlow asigură compatibilitatea cu majoritatea arhitecturilor moderne.

- Q: Este Kubeflow Trainer gata pentru producție?

- R: Proiectul Kubeflow Trainer se află în stadiu Alpha, ceea ce înseamnă că API-urile sale sunt încă în dezvoltare activă și pot suferi modificări. Este ideal pentru experimentare, dezvoltare și prototipare. Pentru implementări critice în producție, mulți utilizatori ar putea prefera încă Kubeflow Training Operator V1, care este mai stabil și are o istorie mai lungă de utilizare în producție, deși Trainer-ul este direcția viitoare și oferă avantaje semnificative.

- Q: Am nevoie de cunoștințe aprofundate de Kubernetes pentru a utiliza Kubeflow Trainer?

- R: O înțelegere de bază a conceptelor Kubernetes (pod-uri, deploymente, servicii) este benefică. Cu toate acestea, Kubeflow Trainer este conceput pentru a simplifica interacțiunea prin Kubeflow Python SDK și API-urile Custom Resource. Acestea abstractizează o mare parte din complexitatea subiacentă, permițând inginerilor ML să se concentreze mai mult pe logica modelului și mai puțin pe gestionarea infrastructurii Kubernetes.

- Q: Cum se compară Kubeflow Trainer cu alte soluții de antrenament distribuit?

- R: Kubeflow Trainer se distinge prin integrarea sa profundă cu Kubernetes, oferind o abordare nativă pentru orchestrarea antrenamentelor ML. Spre deosebire de soluțiile ad-hoc sau de unele platforme cloud care pot fi mai puțin flexibile, Kubeflow Trainer oferă o soluție open-source, extensibilă și agnostică față de cloud, care poate fi implementată pe orice cluster Kubernetes. Capacitatea sa de a integra biblioteci ML avansate (HuggingFace, DeepSpeed) este, de asemenea, un avantaj competitiv.

- Q: Care este beneficiul major al utilizării Kubeflow Trainer?

- R: Beneficiul major este capacitatea de a antrena modele de Machine Learning la scară largă, în special LLM-uri și alte modele complexe, cu o eficiență, flexibilitate și reproducibilitate sporite. Permite echipelor să reducă semnificativ timpul de antrenament, să utilizeze resursele computaționale mai eficient și să accelereze inovația în domeniul IA.

Concluzie

Kubeflow Trainer reprezintă un pas semnificativ înainte în democratizarea și scalarea antrenamentului de Machine Learning. Prin îmbinarea puterii Kubernetes cu cerințele riguroase ale IA moderne, Kubeflow Trainer oferă o platformă robustă și flexibilă pentru dezvoltarea și implementarea de modele de IA de ultimă generație. Pe măsură ce cererea pentru modele din ce în ce mai mari și mai sofisticate crește, Kubeflow Trainer va juca un rol crucial în a permite cercetătorilor și inginerilor să depășească limitele a ceea ce este posibil în Inteligența Artificială. Este o dovadă a modului în care comunitatea open-source colaborează pentru a construi instrumentele viitorului, deschizând noi orizonturi pentru inovație în ML.

Dacă vrei să descoperi și alte articole similare cu Kubeflow Trainer: Reorganizarea Antrenării ML la Scară, poți vizita categoria Fitness.