17/06/2024

În lumea vastă a datelor, capacitatea de a identifica modele, de a face predicții și de a înțelege relațiile dintre variabile este fundamentală. Fie că este vorba de anticiparea vânzărilor, de prognozarea vremii sau de optimizarea proceselor, avem nevoie de instrumente precise care să ne ajute să transformăm informația brută în cunoștințe acționabile. Unul dintre cele mai puternice și utilizate instrumente în acest sens este Metoda Celor Mai Mici Pătrate (Least Squares Method), o tehnică matematică de optimizare care stă la baza multor modele predictive, inclusiv a regresiei liniare.

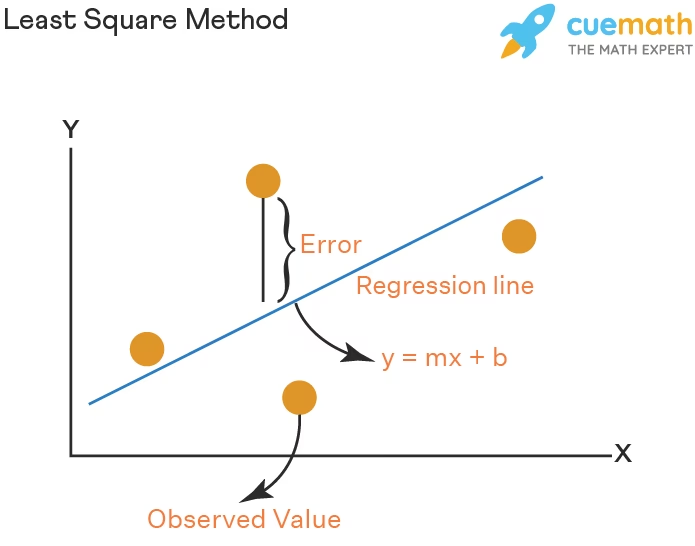

Metoda Celor Mai Mici Pătrate este o tehnică de optimizare matematică ce își propune să determine funcția de potrivire optimă prin minimizarea sumei pătratelor diferențelor dintre valorile observate și valorile prezise de model. Această metodă este utilizată pe scară largă în domenii precum analiza de regresie, ajustarea curbelor și modelarea datelor. Poate fi clasificată în forme liniare și neliniare, în funcție de relația dintre parametrii modelului și datele observate.

- Scurt Istoric: O Călătorie Prin Timp și Descoperiri

- Enunțul Problemei: Minimizarea Erorii

- Regresia Liniară: Metoda Celor Mai Mici Pătrate Ordinare (OLS)

- Regresia Neliniară: Când Linia Dreaptă Nu Este Suficientă

- Diferențe Cheie: Liniar vs. Neliniar

- Un Exemplu Simplu: Legea lui Hooke

- Quantificarea Incertitudinii și Testarea Statistică

- Când Varianțele Nu Sunt Egale: Metoda Celor Mai Mici Pătrate Ponderate

- Regula de Aur a Modernității: Regularizarea

- OLS vs. Ridge: Când și Cum Alegem?

- Întrebări Frecvente (FAQ)

Scurt Istoric: O Călătorie Prin Timp și Descoperiri

Rădăcinile Metodei Celor Mai Mici Pătrate se găsesc în domenii precum astronomia și geodezia, unde oamenii de știință și matematicienii căutau soluții pentru provocările navigării pe oceanele Pământului în timpul Epocii Descoperirilor. O descriere precisă a comportamentului corpurilor cerești era esențială pentru a permite navelor să navigheze în larg, acolo unde marinarii nu se mai puteau baza pe repere terestre pentru orientare.

Prima expunere clară și concisă a metodei a fost publicată de Adrien-Marie Legendre în 1805. El a descris tehnica ca o procedură algebrică pentru ajustarea ecuațiilor liniare la date, demonstrând noua metodă prin analiza acelorași date ca și Laplace pentru forma Pământului. Într-un deceniu de la publicarea lui Legendre, Metoda Celor Mai Mici Pătrate fusese adoptată ca un instrument standard în astronomie și geodezie în Franța, Italia și Prusia, ceea ce constituie o acceptare extraordinar de rapidă a unei tehnici științifice.

În 1809, Carl Friedrich Gauss a publicat metoda sa de calculare a orbitelor corpurilor cerești. În acea lucrare, el a susținut că deținea Metoda Celor Mai Mici Pătrate încă din 1795. Acest lucru a dus, în mod natural, la o dispută de prioritate cu Legendre. Cu toate acestea, meritul lui Gauss este că a mers dincolo de Legendre și a reușit să conecteze metoda cu principiile probabilității și cu distribuția normală. El a reușit să finalizeze programul lui Laplace de a specifica o formă matematică a densității de probabilitate pentru observații, dependentă de un număr finit de parametri necunoscuți, și să definească o metodă de estimare care minimizează eroarea de estimare. Gauss a demonstrat că media aritmetică este, într-adevăr, cea mai bună estimare a parametrului de locație, modificând atât densitatea de probabilitate, cât și metoda de estimare. Apoi, a inversat problema, întrebând ce formă ar trebui să aibă densitatea și ce metodă de estimare ar trebui utilizată pentru a obține media aritmetică ca estimare a parametrului de locație. În această încercare, a inventat distribuția normală.

O demonstrație timpurie a puterii metodei lui Gauss a venit atunci când a fost folosită pentru a prezice locația viitoare a asteroidului Ceres, recent descoperit. Pe 1 ianuarie 1801, astronomul italian Giuseppe Piazzi a descoperit Ceres și a reușit să-i urmărească traiectoria timp de 40 de zile înainte de a fi pierdut în strălucirea Soarelui. Bazându-se pe aceste date, astronomii doreau să determine locația lui Ceres după ce a ieșit din spatele Soarelui, fără a rezolva ecuațiile neliniare complicate ale lui Kepler pentru mișcarea planetară. Singurele predicții care i-au permis astronomului maghiar Franz Xaver von Zach să localizeze Ceres au fost cele realizate de Gauss, în vârstă de 24 de ani, folosind analiza celor mai mici pătrate.

În 1810, după ce a citit lucrarea lui Gauss, Laplace, după ce a demonstrat teorema limitei centrale, a folosit-o pentru a justifica metoda celor mai mici pătrate și distribuția normală pe baza unui eșantion mare. În 1822, Gauss a putut afirma că abordarea celor mai mici pătrate pentru analiza de regresie este optimă în sensul că, într-un model liniar în care erorile au o medie zero, sunt necorelate, distribuite normal și au varianțe egale, cel mai bun estimator liniar fără părtinire al coeficienților este estimatorul celor mai mici pătrate. O versiune extinsă a acestui rezultat este cunoscută sub numele de teorema Gauss-Markov. Ideea analizei celor mai mici pătrate a fost formulată independent și de americanul Robert Adrain în 1808.

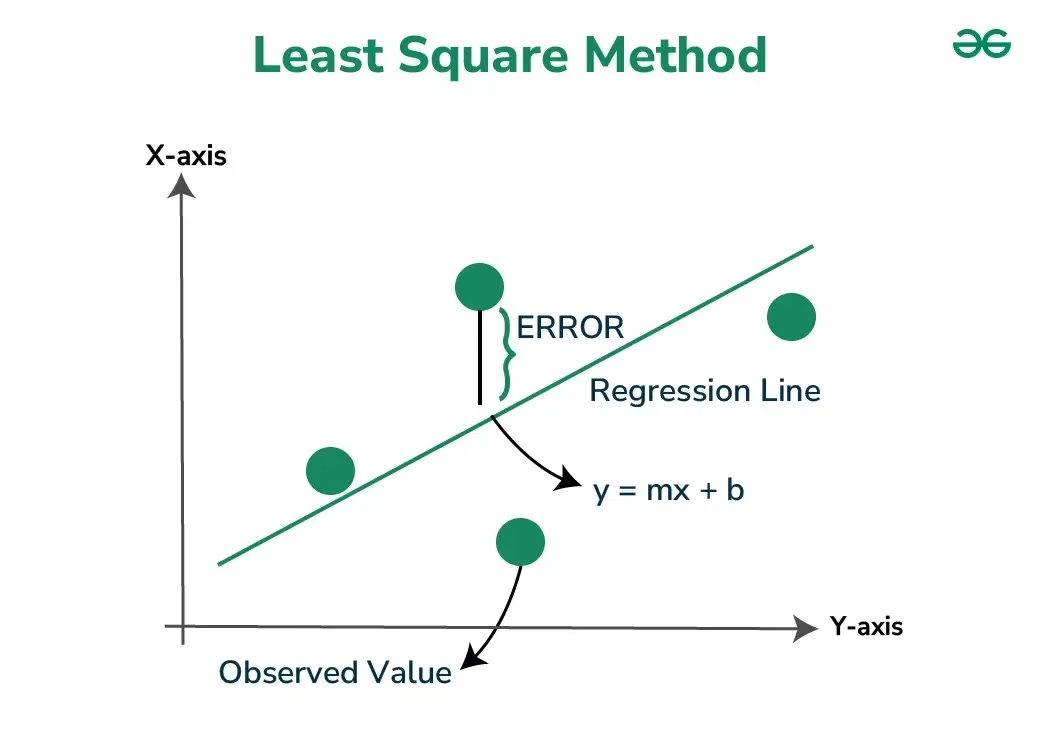

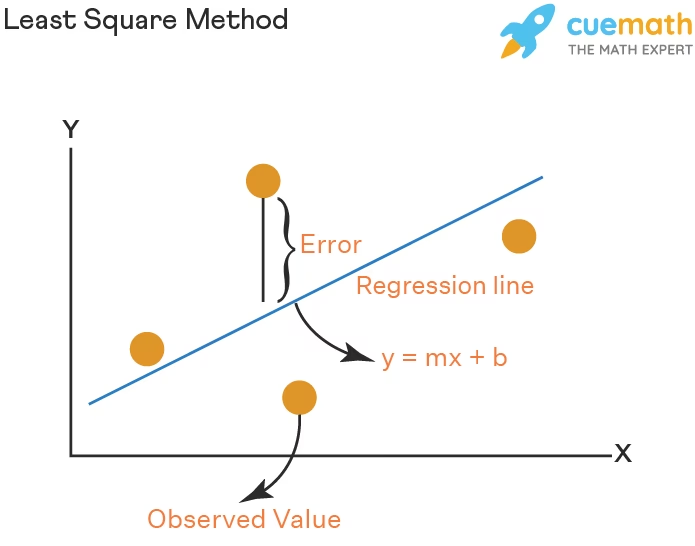

Enunțul Problemei: Minimizarea Erorii

Obiectivul constă în ajustarea parametrilor unei funcții model pentru a se potrivi cel mai bine unui set de date. Un set simplu de date constă din n puncte (perechi de date) (xᵢ, yᵢ), i = 1, ..., n, unde xᵢ este o variabilă independentă și yᵢ este o variabilă dependentă a cărei valoare este găsită prin observare. Funcția model are forma f(x, β), unde m parametri ajustabili sunt conținuți în vectorul β. Scopul este de a găsi valorile parametrilor pentru model care se potrivesc „cel mai bine” datelor.

Potrivirea unui model la un punct de date este măsurată de rezidualul său, definit ca diferența dintre valoarea observată a variabilei dependente și valoarea prezisă de model: rᵢ = yᵢ - f(xᵢ, β). Metoda celor mai mici pătrate găsește valorile optime ale parametrilor prin minimizarea sumei rezidualelor pătratice, S:

S = Σ rᵢ²

În cazul cel mai simplu, f(xᵢ, β) = β, iar rezultatul metodei celor mai mici pătrate este media aritmetică a datelor de intrare. Pentru a găsi minimul sumei pătratelor, se stabilește gradientul la zero. Deoarece modelul conține m parametri, există m ecuații de gradient:

∂S/∂βⱼ = 2 Σᵢ rᵢ (∂rᵢ/∂βⱼ) = 0, j = 1, ..., m

Deoarece rᵢ = yᵢ - f(xᵢ, β), ecuațiile de gradient devin:

-2 Σᵢ rᵢ (∂f(xᵢ, β)/∂βⱼ) = 0, j = 1, ..., m

Aceste ecuații de gradient se aplică tuturor problemelor celor mai mici pătrate. Fiecare problemă particulară necesită expresii specifice pentru model și derivatele sale parțiale.

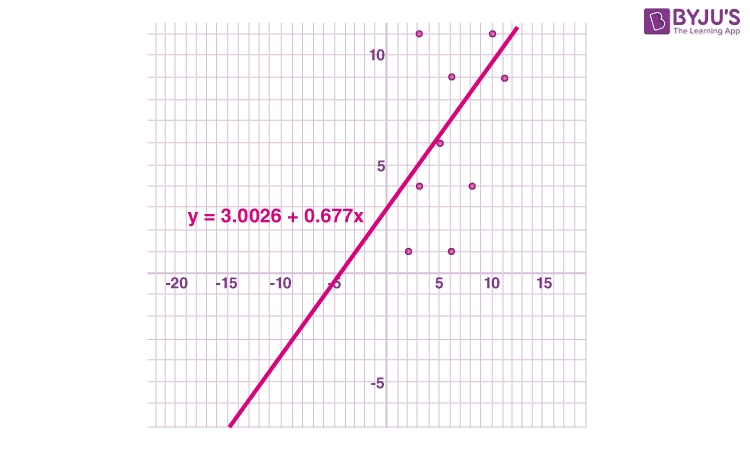

Regresia Liniară: Metoda Celor Mai Mici Pătrate Ordinare (OLS)

Un model de regresie este liniar atunci când modelul cuprinde o combinație liniară a parametrilor, adică f(x, β) = Σⱼ βⱼφⱼ(x), unde funcția φⱼ este o funcție a lui x. OLS este cea mai fundamentală abordare a regresiei liniare. Scopul său este de a găsi linia de potrivire optimă prin punctele noastre de date. Facem acest lucru măsurând cât de „greșite” sunt predicțiile noastre în comparație cu valorile reale și apoi găsind linia care face ca aceste erori să fie cât mai mici posibil. Prin „eroare” ne referim la distanța verticală dintre fiecare punct și linia noastră – cu alte cuvinte, cât de mult se abat predicțiile noastre de la realitate.

Soluția Matematică a OLS

Pentru a găsi coeficienții modelului (β) care minimizează suma pătratelor rezidualelor, OLS folosește o soluție în formă închisă, cunoscută sub numele de ecuația normală. Aceasta evită necesitatea iterațiilor numerice și oferă un rezultat direct și unic (în majoritatea cazurilor).

Fie X matricea de design, care conține variabilele independente (și o coloană de 1-uri pentru termenul de intercept), și Y vectorul variabilelor dependente. Atunci, vectorul coeficienților estimați (β̂) este dat de:

β̂ = (XTX)-1XTY

Unde:

- β̂ este vectorul coeficienților estimați.

- X este matricea de date (inclusiv o coloană pentru intercept).

- Y este vectorul variabilei dependente.

- XT reprezintă transpusa matricei X.

- -1 reprezintă inversa matricei.

Această formulă compactă permite calcularea directă a coeficienților modelului, făcând OLS o metodă eficientă și ușor de implementat atunci când condițiile sunt îndeplinite.

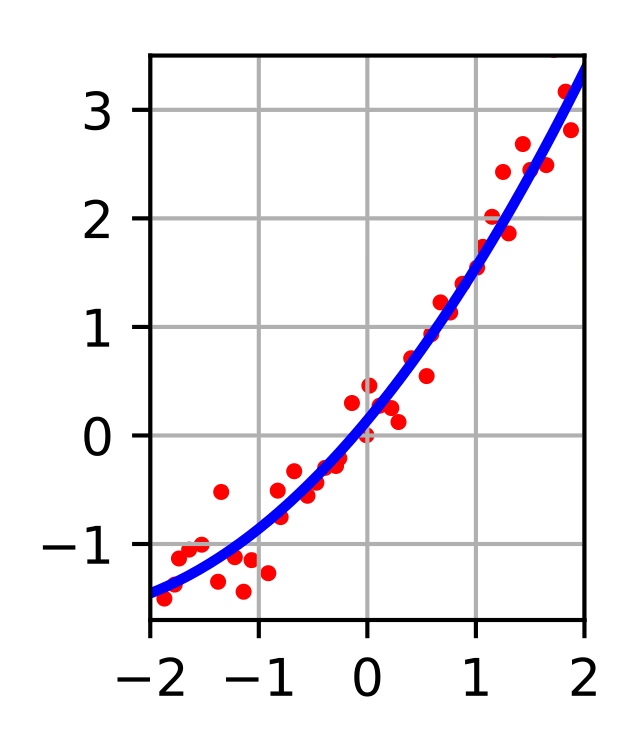

Regresia Neliniară: Când Linia Dreaptă Nu Este Suficientă

Spre deosebire de regresia liniară, pentru problemele de regresie neliniară nu există, în general, o soluție în formă închisă. În astfel de cazuri, se utilizează algoritmi numerici pentru a găsi valorile parametrilor β care minimizează obiectivul. Majoritatea algoritmilor implică alegerea unor valori inițiale pentru parametri. Apoi, parametrii sunt rafinați iterativ, adică valorile sunt obținute prin aproximări succesive. Un algoritm comun este algoritmul Gauss-Newton, care liniarizează modelul prin aproximare la o expansiune în serie Taylor de prim ordin în fiecare iterație.

Diferențe Cheie: Liniar vs. Neliniar

Înțelegerea distincțiilor dintre regresia liniară și cea neliniară este crucială pentru alegerea metodei potrivite:

| Caracteristică | Regresia Liniară (OLS) | Regresia Neliniară |

|---|---|---|

| Soluție | Formă închisă (directă) | Iterativă (de obicei) |

| Valori inițiale | Nu necesită | Necesită valori inițiale pentru parametri |

| Convergență | Întotdeauna converge (global concavă) | Probleme de non-convergență, multiple minime |

| Unicitatea soluției | Unică (în general) | Pot exista multiple minime |

| Estimatori | Fără părtinire (în condiții ideale) | În general, cu părtinire |

| Calculul Jacobianului | Nu este necesar direct | Necesită calcularea sau aproximarea Jacobianului |

Un Exemplu Simplu: Legea lui Hooke

Să luăm în considerare un exemplu simplu din fizică. Un arc ar trebui să respecte legea lui Hooke, care afirmă că extinderea unui arc y este proporțională cu forța F aplicată acestuia: y = f(F, k) = kF. Aici, F este variabila independentă, iar k este constanta elastică. Pentru a estima constanta de forță k, efectuăm o serie de n măsurători cu forțe diferite pentru a produce un set de date (Fᵢ, yᵢ), i = 1, ..., n, unde yᵢ este o extindere măsurată a arcului.

Fiecare observație experimentală va conține o anumită eroare, ε, astfel încât putem specifica un model empiric pentru observațiile noastre: yᵢ = kFᵢ + εᵢ. Există multe metode pe care le-am putea folosi pentru a estima parametrul necunoscut k. Deoarece cele n ecuații din m variabile din datele noastre cuprind un sistem supradeterminat cu o singură necunoscută și n ecuații, estimăm k folosind cele mai mici pătrate. Suma pătratelor care trebuie minimizată este:

S = Σᵢ (yᵢ - kFᵢ)²

Estimarea prin metoda celor mai mici pătrate a constantei de forță, k, este dată de:

k̂ = (Σᵢ Fᵢyᵢ) / (Σᵢ Fᵢ²)

Quantificarea Incertitudinii și Testarea Statistică

Într-un calcul al celor mai mici pătrate cu ponderi unitare sau în regresia liniară, varianța parametrului j, notată var(β̂ⱼ), este de obicei estimată cu:

var(β̂ⱼ) = σ² ([XTX]-1)jj ≈ σ̂² Cjj

Unde σ² este varianța reală a erorii, înlocuită de o estimare, statistica chi-pătrat redusă, bazată pe valoarea minimizată a sumei pătratelor reziduale (funcția obiectiv), S. Numitorul, n - m, reprezintă gradele de libertate statistice. C = (XTX)-1 este matricea de covarianță.

Pentru a testa statistic rezultatele, este necesar să facem ipoteze despre natura erorilor experimentale. O ipoteză comună este că erorile aparțin unei distribuții normale. Teorema limitei centrale susține ideea că aceasta este o bună aproximare în multe cazuri. Teorema Gauss-Markov afirmă că, într-un model liniar în care erorile au o speranță zero condiționată de variabilele independente, sunt necorelate și au varianțe egale, estimatorul liniar fără părtinire cel mai bun al oricărei combinații liniare a observațiilor este estimatorul său prin metoda celor mai mici pătrate. „Cel mai bun” înseamnă că estimatorii celor mai mici pătrate ai parametrilor au varianță minimă. Ipoteza varianței egale este valabilă atunci când erorile aparțin toate aceleiași distribuții (homoscedasticitate).

Când Varianțele Nu Sunt Egale: Metoda Celor Mai Mici Pătrate Ponderate

Un caz special al celor mai mici pătrate generalizate este Metoda Celor Mai Mici Pătrate Ponderate (Weighted Least Squares - WLS), care apare atunci când toate intrările non-diagonale ale matricei de corelație a rezidualelor sunt nule; varianțele observațiilor (de-a lungul diagonalei matricei de covarianță) pot fi în continuare inegale (heteroscedasticitate). În termeni mai simpli, heteroscedasticitatea apare atunci când varianța lui Yᵢ depinde de valoarea lui Xᵢ, ceea ce face ca graficul rezidual să creeze un efect de „evantai” către valori mai mari ale lui Yᵢ.

Regula de Aur a Modernității: Regularizarea

În anumite contexte, o versiune regularizată a soluției celor mai mici pătrate poate fi preferabilă. Regularizarea este o tehnică esențială în modelarea statistică și în învățarea automată, concepută pentru a preveni supra-antrenarea (overfitting) și pentru a îmbunătăți generalizabilitatea modelelor. Supra-antrenarea apare atunci când un model învață zgomotul și detaliile irelevante din datele de antrenament, performând slab pe date noi, nevăzute. Regularizarea adaugă un termen de penalizare funcției obiectiv a celor mai mici pătrate, care descurajează coeficienții mari și promovează modele mai simple.

Regresia Ridge (Regularizarea Tikhonov)

Regresia Ridge (sau regularizarea Tikhonov) adaugă o constrângere conform căreia ‖β‖₂², norma L₂ pătrată a vectorului de parametri, să nu fie mai mare decât o valoare dată, ceea ce duce la o problemă de minimizare constrânsă. Aceasta este echivalentă cu problema de minimizare neconstrânsă în care funcția obiectiv este suma pătratelor rezidualelor plus un termen de penalizare α‖β‖₂², unde α este un parametru de reglaj (acesta este forma Lagrangiană a problemei de minimizare constrânsă).

Soluția pentru Regresia Ridge este o modificare a soluției OLS:

β̂ = (XTX + λI)-1XTY

Unde I este matricea identitate, iar λ (lambda) este parametrul de regularizare. Prin adăugarea lui λI la XTX, se asigură că matricea devine inversabilă chiar dacă XTX nu este, rezolvând o problemă numerică cheie a OLS. Pe măsură ce λ crește, coeficienții se micșorează spre zero, dar nu ajung niciodată exact la zero. Regresia Ridge este deosebit de utilă în prezența multicoliniarității (când variabilele independente sunt puternic corelate între ele), deoarece stabilizează estimările coeficienților.

Metoda Lasso (Least Absolute Shrinkage and Selection Operator)

O altă versiune regularizată a celor mai mici pătrate este Lasso (Least Absolute Shrinkage and Selection Operator), care utilizează constrângerea conform căreia ‖β‖₁, norma L₁ a vectorului de parametri, să nu fie mai mare decât o valoare dată. Aceasta este echivalentă cu o minimizare neconstrânsă a penalizării celor mai mici pătrate cu α‖β‖₁ adăugat.

Una dintre diferențele principale dintre Lasso și regresia Ridge este că, în regresia Ridge, pe măsură ce penalizarea crește, toți parametrii sunt reduși, rămânând totuși non-zero, în timp ce în Lasso, creșterea penalizării va face ca tot mai mulți parametri să fie aduși la zero. Acesta este un avantaj al Lasso față de regresia Ridge, deoarece aducerea parametrilor la zero realizează selecția de caracteristici, eliminând variabilele mai puțin relevante din model. Astfel, Lasso selectează automat caracteristicile mai relevante și le elimină pe celelalte.

OLS vs. Ridge: Când și Cum Alegem?

Alegerea între OLS și Regresia Ridge depinde adesea de caracteristicile datelor dumneavoastră:

- Utilizați OLS atunci când aveți date bine comportate, cu puțină multicoliniaritate și un număr suficient de eșantioane (în raport cu numărul de caracteristici).

- Utilizați Regresia Ridge atunci când aveți:

- Multe caracteristici (în raport cu numărul de eșantioane).

- Multicoliniaritate în caracteristicile dumneavoastră.

- Semne de supra-antrenare cu OLS.

Cu Regresia Ridge, va trebui să alegeți valoarea optimă a parametrului λ. Acest lucru se face de obicei prin validare încrucișată, testând o gamă de valori (adesea spațiate logaritmic) și alegând-o pe cea care oferă cea mai bună performanță de validare.

Întrebări Frecvente (FAQ)

- Ce este multicoliniaritatea și cum o abordează OLS și Ridge?

- Multicoliniaritatea apare atunci când două sau mai multe variabile independente dintr-un model de regresie sunt puternic corelate între ele. În OLS, aceasta poate duce la estimări instabile și greu de interpretat ale coeficienților, cu erori standard mari. Regresia Ridge abordează multicoliniaritatea prin adăugarea unui termen de penalizare care micșorează coeficienții, stabilizând modelul și reducând sensibilitatea la corelațiile dintre variabile.

- De ce se folosesc pătrate și nu valori absolute în Metoda Celor Mai Mici Pătrate?

- Folosirea pătratelor (suma pătratelor rezidualelor) are două avantaje majore: 1) Transformă toate erorile (pozitive sau negative) în valori pozitive, prevenind anularea lor reciprocă. 2) Funcția de eroare rezultată (suma pătratelor) este o funcție convexă și diferențiabilă, ceea ce permite utilizarea metodelor de calcul (cum ar fi derivatele parțiale) pentru a găsi soluția optimă în formă închisă (pentru OLS) sau prin algoritmi iterativi eficienți (pentru regresia neliniară). Folosirea valorilor absolute (cum face Lasso) ar duce la o funcție non-diferențiabilă în zero, ceea ce complică optimizarea.

- Ce este parametrul lambda (λ) în regresia Ridge și cum îl alegem?

- Parametrul lambda (λ) în regresia Ridge controlează puterea termenului de penalizare. O valoare mai mare a lui λ impune o penalizare mai mare asupra coeficienților, micșorându-i mai mult spre zero. O valoare mai mică a lui λ reduce efectul de regularizare, iar λ = 0 transformă regresia Ridge în OLS. Alegerea optimă a lui λ se face de obicei prin tehnici de validare încrucișată, cum ar fi validarea încrucișată k-fold. Se testează modelul cu diferite valori ale lui λ pe subseturi ale datelor și se alege valoarea care minimizează eroarea de predicție pe setul de validare.

- Regresia Ridge poate face ca un coeficient să devină exact zero?

- Nu, regresia Ridge micșorează coeficienții spre zero, dar nu îi face niciodată exact zero (cu excepția cazului în care coeficientul original ar fi fost deja zero). Aceasta este o diferență cheie față de regresia Lasso, care, datorită naturii penalizării sale L1, are capacitatea de a aduce unii coeficienți exact la zero, realizând astfel selecția de caracteristici.

În concluzie, Metoda Celor Mai Mici Pătrate este o piatră de temelie în analiza datelor, oferind o bază solidă pentru înțelegerea și modelarea relațiilor dintre variabile. Fie că este vorba de simplitatea și eficiența OLS sau de robustețea oferită de tehnicile de regularizare precum Regresia Ridge și Lasso, aceste metode ne echipează cu instrumentele necesare pentru a desluși complexitatea datelor și a extrage informații valoroase pentru decizii informate.

Dacă vrei să descoperi și alte articole similare cu Deslușind Datele: Metoda Celor Mai Mici Pătrate, poți vizita categoria Fitness.