21/11/2024

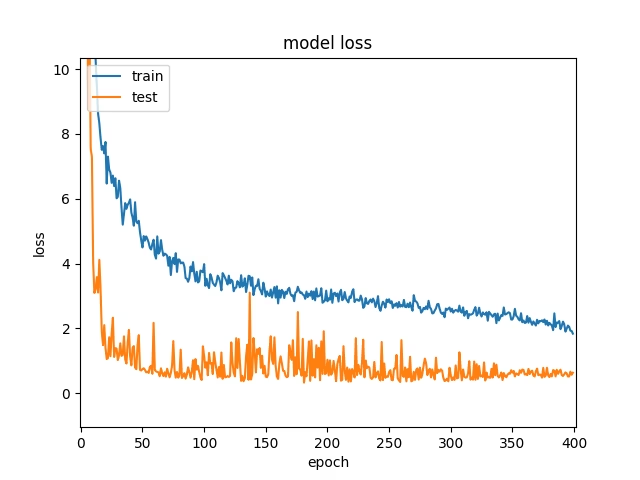

În lumea complexă a învățării automate (Machine Learning), monitorizarea performanței modelelor este crucială. Două dintre cele mai importante metrici utilizate în acest scop sunt pierderea de antrenament (training loss) și pierderea de validare (validation loss). De obicei, ne așteptăm ca pierderea de antrenament să fie mai mică decât cea de validare, indicând faptul că modelul a învățat bine datele pe care a fost antrenat și că, în mod natural, se descurcă puțin mai puțin bine pe date noi, nevăzute. Însă, există scenarii surprinzătoare în care pierderea de validare poate fi, contrar intuiției, mai mică decât pierderea de antrenament. Acest fenomen, deși la prima vedere contraintuitiv, oferă indicii valoroase despre modul în care modelul nostru generalizează și despre eficacitatea strategiilor de antrenament aplicate.

În acest articol, vom explora în detaliu ce reprezintă aceste două metrici, vom analiza cauzele fundamentale pentru care pierderea de validare poate fi ocazional mai mică și vom discuta strategii practice pentru a înțelege și a optimiza comportamentul modelului tău. Scopul este de a te echipa cu cunoștințele necesare pentru a interpreta corect performanța modelului și pentru a lua decizii informate în procesul de dezvoltare.

- Ce Este Pierderea de Antrenament și Pierderea de Validare?

- De Ce Pierderea de Validare Poate Fi Mai Mică Decât Pierderea de Antrenament?

- Eroarea Pătratică Medie (MSE) ca Funcție de Pierdere

- Întrebări Frecvente (FAQ)

- Q: Este întotdeauna rău dacă pierderea de validare este mai mică decât pierderea de antrenament?

- Q: Cum pot identifica cauza principală a acestei discrepanțe?

- Q: Ce este underfitting-ul și cum se leagă de acest fenomen?

- Q: Cât de importantă este rata de învățare în acest context?

- Q: Ar trebui să mă îngrijoreze dacă pierderea de antrenament este mult mai mare decât pierderea de validare?

- Concluzie

Ce Este Pierderea de Antrenament și Pierderea de Validare?

Pentru a înțelege anomalia, trebuie mai întâi să definim clar conceptele de bază.

Pierderea de Antrenament (Training Loss)

Pierderea de antrenament măsoară cât de bine se potrivește modelul datelor de antrenament, adică datelor pe care modelul le-a văzut și din care a învățat direct. Această metrică oferă o perspectivă asupra eficacității procesului de învățare. O pierdere de antrenament în scădere indică, în mod obișnuit, o performanță mai bună a modelului pe setul de antrenament. Este o măsură a „erorii interne” a modelului, reflectând cât de bine a reușit să memoreze sau să învețe tiparele din datele cu care a fost expus.

Pierderea de Validare (Validation Loss)

Pierderea de validare este calculată pe un set de date separat, care nu a fost văzut de model în timpul fazei de antrenament. Este o metrică crucială pentru evaluarea capacităților de generalizare ale modelului – performanța sa pe date noi, nevăzute. În mod ideal, pierderea de validare ar trebui să scadă în paralel cu pierderea de antrenament. Totuși, uneori, aceasta poate scădea mai accentuat sau chiar poate deveni mai mică decât pierderea de antrenament, semnalând necesitatea unei analize aprofundate.

Iată o comparație simplificată între cele două:

| Metrică | Scop Principal | Date Utilizate | Comportament Ideal |

|---|---|---|---|

| Pierderea de Antrenament | Evaluează învățarea pe datele expuse | Setul de antrenament | Scade pe măsură ce modelul învață |

| Pierderea de Validare | Evaluează capacitatea de generalizare | Setul de validare (nevăzut) | Scade împreună cu antrenamentul, indicând generalizare bună |

De Ce Pierderea de Validare Poate Fi Mai Mică Decât Pierderea de Antrenament?

Acest fenomen, deși contraintuitiv, nu este neapărat un semn rău. De fapt, poate indica o bună generalizare a modelului, mai ales în prezența unor tehnici specifice de optimizare. Iată principalele motive:

1. Complexitatea Modelului și Supraspecializarea (Overfitting)

Supraspecializarea (overfitting) apare atunci când un model învață nu doar tiparele subiacente ale datelor de antrenament, ci și zgomotul și nuanțele specifice irelevante pentru problema generală. Acest lucru are ca rezultat o performanță excelentă la antrenament (pierdere de antrenament mică), dar o generalizare slabă pe date noi (pierdere de validare mare). Surprinzător, în unele scenarii, mai ales sub o regularizare puternică, pierderea de validare ar putea părea totuși mai mică.

- Decizii privind Arhitectura Modelului: Alegerea arhitecturii potrivite este crucială. Pentru seturi de date mai simple, un model mai puțin complex, cu mai puține straturi, ar putea fi suficient, în timp ce pentru seturi de date mai complexe, o rețea mai profundă, cu mai multe straturi, ar putea fi necesară. Experimentarea și validarea încrucișată (cross-validation) pot ajuta la determinarea nivelului corect de complexitate.

- Ingineria Caracteristicilor (Feature Engineering): Aceasta implică revizuirea caracteristicilor de intrare – reducerea dimensionalității dacă sunt prezente prea multe caracteristici irelevante sau crearea de noi caracteristici care captează informații mai relevante în termeni mai simpli. Tehnici precum PCA (Principal Component Analysis) pentru reducerea dimensionalității sau ingineria caracteristicilor specifice domeniului pot fi esențiale.

- Modele Hibride (Ensemble Methods): Uneori, combinarea modelelor într-o arhitectură hibridă (metode de ansamblu, cum ar fi Random Forests sau Gradient Boosting) poate echilibra complexitatea prin valorificarea punctelor forte ale diferitelor modele mai simple. Această abordare ajută adesea la atenuarea riscului de overfitting, îmbunătățind în același timp capacitatea modelului de a generaliza pe diverse seturi de date.

2. Tehnici de Regularizare (Regularization)

Regularizarea ajută la atenuarea supraspecializării prin descurajarea complexității modelului. Aceste tehnici sunt aplicate doar în timpul antrenamentului, dar nu și în timpul validării, ceea ce poate explica discrepanța:

- Regularizarea L1/L2: Acestea adaugă penalități asupra mărimii coeficienților în timpul antrenamentului, penalități care nu sunt prezente în timpul validării. Aceasta poate face ca modelul să pară „mai puțin potrivit” sau sub-antrenat pe datele de antrenament, rezultând o pierdere de antrenament mai mare comparativ cu validarea. Practic, modelul este forțat să fie mai simplu în timpul antrenamentului, ceea ce îi crește eroarea pe datele de antrenament, dar îi îmbunătățește performanța pe datele nevăzute.

- Dropout: Prin eliminarea aleatorie a unităților (neuronilor) din rețea în timpul antrenamentului, dropout-ul împiedică rețeaua să se bazeze prea mult pe o singură caracteristică, sporind capacitățile de generalizare. Deoarece dropout-ul nu este utilizat în timpul validării (toți neuronii sunt activi), performanța de validare poate fi, prin urmare, mai bună. Modelul devine mai robust în timpul antrenamentului, dar „dezactivarea” dropout-ului pentru validare permite o utilizare completă a capacității sale învățate.

- Ajustarea Forței de Regularizare: Parametrul de regularizare (lambda) controlează impactul termenului de regularizare asupra funcției de pierdere. Acordarea fină a acestui parametru este crucială; o valoare prea mare poate sub-antrena modelul (făcându-l prea simplist), iar o valoare prea mică ar putea să nu prevină eficient supraspecializarea.

- Validare Încrucișată pentru Ajustarea Regularizării: Implementarea validării încrucișate pentru a determina forța de regularizare poate ajuta la găsirea echilibrului optim, unde pierderile de validare și de antrenament converg către cele mai mici valori posibile.

3. Augmentarea Datelor și Normalizarea Loturilor (Batch Normalization)

Aceste tehnici îmbunătățesc stabilitatea și generalizarea modelului, dar pot influența diferența dintre pierderi:

- Augmentarea Datelor: Prin creșterea artificială a diversității setului de date de antrenament prin modificări și transformări (ex: rotiri, oglindiri, decupări ale imaginilor), augmentarea datelor forțează modelul să învețe caracteristici mai robuste. Cu toate acestea, deoarece aceste caracteristici sunt generalizate, s-ar putea să nu performeze la fel de bine pe exemplele mai complexe sau variate găsite în antrenament, reflectate printr-o pierdere de antrenament mai mare. Modelul vede o versiune mai „zgomotoasă” a datelor în timpul antrenamentului, dar o versiune mai „curată” în validare.

- Normalizarea Loturilor (Batch Normalization): Această tehnică normalizează intrările fiecărui strat, astfel încât media și varianța mini-lotului (batch) să fie consistente. În timpul antrenamentului, normalizarea se face pe baza statisticilor fiecărui mini-lot. În contrast, validarea utilizează statisticile întregii populații (sau o medie mobilă a statisticilor loturilor acumulate în timpul antrenamentului), ceea ce adesea duce la o performanță mai bună pe setul de validare, deoarece statisticile sunt mai stabile și mai reprezentative.

4. Dinamica Epocilor și Ratele de Învățare

Modul și frecvența raportării pierderilor în timpul epocilor de antrenament pot denatura percepțiile:

- Raportarea Pierderii: Pierderea de antrenament este de obicei raportată ca o medie a pierderilor pe fiecare lot (batch) în cadrul unei epoci. Prin contrast, pierderea de validare este calculată după ce modelul a fost actualizat pe parcursul întregii epoci, beneficiind potențial de întreaga extindere a învățării din acea epocă. Această diferență de sincronizare poate face ca pierderea de validare să pară înșelător de favorabilă. De asemenea, dacă rata de învățare este foarte mare și modelul oscilează, pierderea de antrenament poate fi mai volatilă.

5. Gestionarea Corectă a Datelor

Asigurarea faptului că procesul de gestionare a datelor nu introduce erori sau scurgeri de informații implică:

- Divizarea Robustă a Datelor: Utilizați eșantionarea stratificată pentru a împărți datele în seturi de antrenament și validare. Această tehnică asigură că fiecare set este reprezentativ pentru întregul set de date, menținând distribuții consistente ale variabilelor și claselor cheie în ambele seturi. O divizare neuniformă poate duce la situații în care setul de validare este, prin pură întâmplare, mai ușor de prezis.

- Evitarea Scurgerii de Date (Data Leakage): Este crucial să preveniți orice scurgere de informații din setul de validare în procesul de antrenament. Acest lucru se poate întâmpla subtil prin utilizarea necorespunzătoare a normalizării datelor sau a selecției caracteristicilor care include setul de validare în mod inadvertent. De exemplu, scalarea datelor pe întregul set înainte de divizare poate introduce scurgeri.

- Monitorizarea Continuă a Datelor: Revizuiți regulat distribuțiile și caracteristicile ambelor seturi de date, de antrenament și de validare, mai ales în medii dinamice unde datele pot evolua în timp. Această monitorizare continuă ajută la asigurarea faptului că modelele sunt antrenate și validate pe distribuții de date actualizate și relevante.

Eroarea Pătratică Medie (MSE) ca Funcție de Pierdere

În contextul modelelor de învățare automată, inclusiv a rețelelor neurale recurente precum LSTM (Long Short-Term Memory), alegerea funcției de pierdere este fundamentală și depinde direct de tipul problemei pe care modelul încearcă să o rezolve. Pentru problemele de regresie, unde modelul încearcă să prezică o valoare continuă (spre deosebire de clasificare, unde prezice o clasă), una dintre cele mai comune și implicite funcții de pierdere este Eroarea Pătratică Medie, sau MSE (Mean Squared Error).

MSE este calculată ca media diferențelor la pătrat dintre valorile prezise de model și valorile reale (adevărate). Formula sa este următoarea:

MSE = (1/N) * Σ(y_pred_i - y_actual_i)^2

Unde:

- `N` este numărul de observații (sau puncte de date).

- `y_pred_i` este valoarea prezisă de model pentru observația `i`.

- `y_actual_i` este valoarea reală pentru observația `i`.

- `Σ` (sigma) indică suma tuturor diferențelor.

Caracteristicile și Implicațiile MSE:

- Valoare Pozitivă: Rezultatul MSE este întotdeauna pozitiv, indiferent de semnul diferențelor dintre valorile prezise și cele reale, deoarece diferențele sunt ridicate la pătrat.

- Valoare Ideală de 0.0: O valoare de 0.0 pentru MSE indică o potrivire perfectă a modelului, adică predicțiile sunt identice cu valorile reale. Cu cât valoarea MSE este mai mică, cu atât performanța modelului este mai bună în ceea ce privește acuratețea predicțiilor sale.

- Penalizarea Erorilor Mari: Aspectul crucial al MSE este că diferențele sunt ridicate la pătrat. Acest lucru înseamnă că erorile mai mari (adică diferențe mari între predicție și valoarea reală) au un impact disproporționat mai mare asupra valorii totale a pierderii decât erorile mici. Prin urmare, modelul este „pedepsit” mai sever pentru greșelile mari. Această proprietate face ca MSE să fie sensibilă la valorile aberante (outliers) și încurajează modelul să facă predicții care sunt aproape de valoarea reală pentru majoritatea datelor, evitând abaterile semnificative.

În contextul unui model LSTM, care este adesea utilizat pentru sarcini de predicție a seriilor temporale (unde se prezic valori continue, cum ar fi prețurile acțiunilor, temperatura sau fluxul de trafic), MSE este o alegere logică și eficientă ca funcție de pierdere. Modelul LSTM va fi antrenat să minimizeze această funcție de pierdere, ajustându-și ponderile interne pentru a reduce la minimum eroarea pătratică medie dintre predicțiile sale și datele reale. Pe lângă MSE, Keras oferă o gamă largă de funcții de pierdere, iar alegerea depinde de specificul problemei și de distribuția datelor.

Întrebări Frecvente (FAQ)

Am adunat câteva dintre cele mai comune întrebări legate de acest subiect pentru a-ți clarifica și mai mult înțelegerea.

Q: Este întotdeauna rău dacă pierderea de validare este mai mică decât pierderea de antrenament?

R: Nu neapărat. Deși este contraintuitiv, poate fi un semn al unei bune generalizări a modelului, în special dacă sunt utilizate tehnici puternice de regularizare (cum ar fi L1/L2 sau Dropout) sau normalizarea loturilor, care modifică modul în care pierderea este calculată sau percepută în timpul antrenamentului, dar nu și în timpul validării. Este important să investighezi cauzele pentru a te asigura că nu este vorba de scurgeri de date sau de o divizare necorespunzătoare a seturilor de date.

Q: Cum pot identifica cauza principală a acestei discrepanțe?

R: Începe prin a verifica implementarea tehnicilor de regularizare (Dropout, L1/L2) și a normalizării loturilor. Apoi, examinează modul în care sunt raportate pierderile (media pe loturi vs. calculul la sfârșitul epocii). Asigură-te că datele sunt împărțite corect și că nu există scurgeri de date între seturile de antrenament și validare. Experimentează cu diferite intensități ale regularizării și cu arhitecturi de model.

Q: Ce este underfitting-ul și cum se leagă de acest fenomen?

R: Underfitting-ul (sub-antrenarea) apare atunci când modelul este prea simplu pentru a capta complexitatea datelor. Se manifestă prin pierderi mari atât la antrenament, cât și la validare. Fenomenul pierderii de validare mai mici decât cea de antrenament nu este un semn direct de underfitting, ci mai degrabă o indicație a modului în care tehnicile de antrenament influențează performanța percepută pe cele două seturi de date. Totuși, o regularizare prea agresivă poate duce la underfitting, chiar dacă validarea ar putea părea „mai bună” decât antrenamentul.

Q: Cât de importantă este rata de învățare în acest context?

R: Rata de învățare joacă un rol crucial. O rată de învățare prea mare poate duce la oscilații mari în pierderea de antrenament și la instabilitate, în timp ce pierderea de validare, fiind calculată la sfârșitul epocii, poate părea mai stabilă sau chiar mai mică, dacă modelul „sare” peste minimele locale. O rată de învățare bine ajustată contribuie la o convergență mai lină și la o coerență mai bună între cele două pierderi.

Q: Ar trebui să mă îngrijoreze dacă pierderea de antrenament este mult mai mare decât pierderea de validare?

R: Nu neapărat „mult mai mare”, dar o diferență notabilă ar trebui investigată. Dacă diferența este mare și constantă, este un semnal că tehnicile de regularizare sau augmentare sunt foarte eficiente și/sau că modelul este forțat să generalizeze puternic în timpul antrenamentului. Atâta timp cât pierderea de validare este scăzută și stabilă, iar modelul generalizează bine pe date nevăzute, acest comportament este acceptabil. Preocuparea ar trebui să apară dacă pierderea de validare este ridicată, indicând o generalizare slabă, indiferent de relația cu pierderea de antrenament.

Concluzie

Discrepanța dintre pierderea de antrenament și pierderea de validare, în special atunci când ultima este mai mică, poate fi un subiect confuz pentru mulți practicieni în Machine Learning. Totuși, în loc să fie un semnal de alarmă, acest fenomen este adesea o oportunitate de a înțelege mai profund dinamica modelului tău și impactul strategiilor de antrenament. Prin adoptarea strategiilor rafinate discutate – echilibrarea complexității modelului, optimizarea parametrilor de regularizare, implementarea corectă a augmentării datelor și a normalizării loturilor, și asigurarea unei gestionări impecabile a datelor – practicanții pot aborda mai eficient provocările puse de aceste discrepanțe.

Aceste strategii nu numai că atenuează riscul de supraspecializare, dar sporesc și precizia predictivă și fiabilitatea modelelor. În final, înțelegerea și gestionarea corectă a acestor metrici sunt pași critici către dezvoltarea unor modele de învățare automată robuste, generalizabile, care performează constant bine pe diverse seturi de date și în aplicații din lumea reală. O viziune holistică asupra procesului de antrenament este cheia succesului.

Dacă vrei să descoperi și alte articole similare cu Pierderea de Antrenament vs. Validare: De Ce Valida, poți vizita categoria Fitness.