04/12/2022

În lumea fascinantă a învățării profunde (Deep Learning), datele reprezintă oxigenul, combustibilul și fundația oricărui model de succes. Fără seturi de date bine structurate, curate și relevante, chiar și cele mai sofisticate arhitecturi neuronale ar fi simple carcase goale, incapabile să învețe sau să facă predicții utile. Înțelegerea modului în care se utilizează eficient aceste seturi de date este, prin urmare, un pas fundamental pentru oricine dorește să se aventureze în dezvoltarea aplicațiilor de inteligență artificială.

Rolul central al datelor în învățarea profundă derivă din natura algoritmilor. Spre deosebire de programarea tradițională, unde regulile sunt explicit definite de către programator, învățarea profundă se bazează pe capacitatea modelelor de a descoperi singure tipare și relații complexe în seturile de date masive. Cu cât datele sunt mai variate și mai reprezentative pentru problema pe care încercăm să o rezolvăm, cu atât modelul va fi mai robust și mai precis în predicțiile sale.

- De Ce Sunt Datele Cruciale pentru Învățarea Profundă?

- Tipuri Comune de Seturi de Date în Învățarea Profundă

- Pregătirea Datelor: O Etapă Critică

- Exemplu Concret: Setul de Date Digits

- Provocări Comune și Soluții

- Întrebări Frecvente (FAQ)

- 1. Cât de mari ar trebui să fie seturile de date pentru învățarea profundă?

- 2. Pot folosi date din surse diferite?

- 3. Ce este „supraînvățarea” (overfitting) și cum o pot evita cu ajutorul datelor?

- 4. Este necesar să fiu un expert în știința datelor pentru a începe cu învățarea profundă?

- 5. De unde pot găsi seturi de date pentru proiectele mele?

- Concluzie

De Ce Sunt Datele Cruciale pentru Învățarea Profundă?

Imaginați-vă că încercați să învățați un copil să recunoască diferite animale. Nu i-ați oferi o singură imagine a unui câine și i-ați cere apoi să identifice toate celelalte animale. În schimb, i-ați arăta sute, poate mii de imagini, prezentând câini de diferite rase, în diferite ipostaze, cu diferite fundaluri, alături de imagini cu pisici, păsări, elefanți și așa mai departe. Exact la fel funcționează și învățarea profundă. Fiecare imagine, fiecare linie de text, fiecare punct de date numeric servește ca o „lecție” individuală pentru model, ajutându-l să generalizeze și să facă distincții subtile.

Calitatea și cantitatea datelor influențează direct performanța modelului. Un set de date insuficient sau unul plin de zgomot și erori va duce la un model slab, care nu va performa bine în lumea reală. Pe de altă parte, un set de date bine curat, divers și echilibrat poate transforma un algoritm mediocru într-unul de înaltă performanță. Este esențial să înțelegem că „mai multe date” nu înseamnă întotdeauna „mai bine”; „date de calitate superioară” este adesea mult mai important.

Tipuri Comune de Seturi de Date în Învățarea Profundă

Învățarea profundă abordează o gamă largă de probleme, iar tipurile de date folosite variază în consecință:

- Date Imagine: Utilizate în viziunea computerizată (recunoaștere facială, detectarea obiectelor, imagistică medicală). Exemple includ ImageNet, MNIST (pentru cifre manuscrise), CIFAR-10.

- Date Text: Esențiale pentru procesarea limbajului natural (NLP), cum ar fi traducerea automată, analiza sentimentelor, generarea de text. Exemple includ Wikipedia, seturi de date pentru recunoașterea vorbirii sau corpusuri de text specifice.

- Date Audio: Folosite în recunoașterea vorbirii, identificarea sunetului, sinteza vocală. Exemple includ LibriSpeech, VoxCeleb.

- Date Tabelare/Numerice: Pentru probleme de predicție, clasificare în domenii precum finanțe, sănătate, IoT. Deși învățarea profundă excelează la date nestructurate, rețelele neuronale pot fi folosite și pentru date structurate.

- Date Video: O secvență de imagini, plus componenta temporală, utilizate pentru recunoașterea acțiunilor, urmărirea obiectelor.

Pregătirea Datelor: O Etapă Critică

Achiziționarea unui set de date este doar începutul. Următorul pas, și adesea cel mai consumator de timp, este preprocesarea datelor. Aceasta implică o serie de operațiuni menite să transforme datele brute într-un format adecvat pentru antrenarea modelelor de învățare profundă. Fără o preprocesare adecvată, performanța modelului va fi compromisă semnificativ.

Etape Cheie în Preprocesarea Datelor:

- Curățarea Datelor: Eliminarea zgomotului, a valorilor lipsă, a duplicatelor și a erorilor. De exemplu, într-un set de date de imagini, ar putea însemna eliminarea imaginilor corupte sau a celor cu rezoluție prea mică.

- Normalizarea/Scalarea: Asigurarea că toate caracteristicile au o scară similară. De exemplu, valorile pixelilor dintr-o imagine sunt adesea scalate între 0 și 1 sau -1 și 1. Aceasta ajută la o convergență mai rapidă a algoritmilor de optimizare.

- Augmentarea Datelor: Creșterea artificială a dimensiunii setului de date prin aplicarea de transformări minore datelor existente. Pentru imagini, aceasta poate include rotații, răsturnări, decupări sau modificări ale luminozității. Această tehnică este crucială pentru a îmbunătăți robustețea modelului și a preveni supraînvățarea (overfitting), mai ales când setul de date inițial este limitat.

- Codificarea Datelor Categorice: Transformarea datelor textuale sau categoriale în format numeric, deoarece rețelele neuronale operează cu numere. Tehnici comune includ One-Hot Encoding sau Word Embeddings (pentru text).

- Împărțirea Datelor: Separarea setului de date în trei subseturi distincte: antrenament, validare și testare.

Tabel Comparativ: Scopul Fiecărui Subset de Date

| Subset | Scop | Utilizare | Importanță |

|---|---|---|---|

| Antrenament | Antrenarea modelului, ajustarea ponderilor | Modelul învață din aceste date prin optimizarea funcției de pierdere. | Cel mai mare subset, esențial pentru învățare. |

| Validare | Reglarea hiperparametrilor, evaluarea performanței intermediare | Folosit pentru a evalua modelul în timpul antrenamentului și a preveni supraînvățarea. | Ajută la alegerea celor mai buni hiperparametri. |

| Testare | Evaluarea finală a performanței modelului | Folosit o singură dată, la final, pentru a măsura performanța generalizată pe date nevăzute. | Oferă o estimare imparțială a performanței reale a modelului. |

Proporțiile comune pentru această împărțire sunt 70-80% pentru antrenament, 10-15% pentru validare și 10-15% pentru testare, dar acestea pot varia în funcție de dimensiunea totală a setului de date și de specificul problemei.

Exemplu Concret: Setul de Date Digits

Pentru a începe cu aplicațiile de învățare profundă, seturi de date precum cel menționat, Digits, sunt ideale. Setul de date Digits constă din 10.000 de imagini sintetice în tonuri de gri, reprezentând cifre scrise de mână. Acest set de date este perfect pentru a învăța concepte fundamentale, cum ar fi clasificarea imaginilor, deoarece este relativ mic și ușor de manipulat, dar suficient de complex pentru a ilustra puterea rețelelor neuronale convoluționale (CNN).

Când lucrați cu setul de date Digits, procesul ar arăta, în linii mari, așa:

- Încărcarea Datelor: Importați imaginile și etichetele corespunzătoare (cifra pe care o reprezintă imaginea).

- Preprocesare: Redimensionați imaginile la o dimensiune uniformă, normalizați valorile pixelilor (de obicei între 0 și 1). De asemenea, s-ar putea aplica o augmentare minoră a datelor pentru a crește varietatea (ex: rotații mici, translații).

- Împărțirea: Împărțiți setul Digits în subseturi de antrenament, validare și testare.

- Construirea Modelului: Definiți o arhitectură de rețea neuronală (probabil o CNN simplă) capabilă să proceseze imagini.

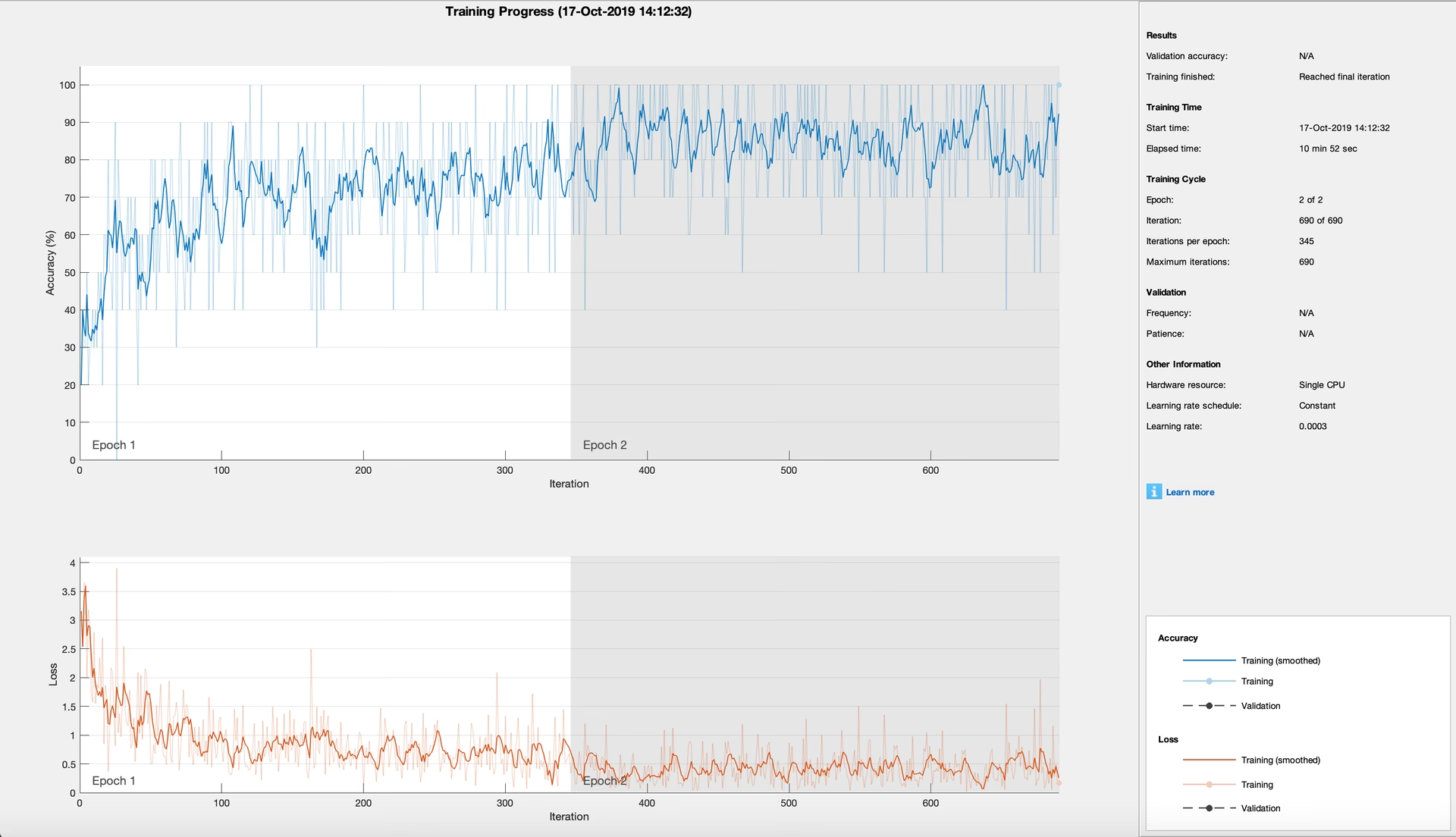

- Antrenarea Modelului: Alimentați modelul cu datele de antrenament, permițându-i să învețe să asocieze imaginile cu cifrele corecte. Pe parcurs, monitorizați performanța pe setul de validare.

- Evaluarea Modelului: Odată antrenat, evaluați performanța finală a modelului pe setul de testare, care conține imagini pe care modelul nu le-a văzut niciodată. Aceasta vă va oferi o estimare reală a capacității modelului de a generaliza.

Funcțiile de suport menționate în descrierea setului de date Digits, care sunt adesea atașate exemplelor, simplifică adesea pași precum încărcarea și preprocesarea, permițând dezvoltatorilor să se concentreze mai mult pe arhitectura modelului și pe experimentare.

Provocări Comune și Soluții

Chiar și cu cele mai bune intenții, lucrul cu seturi de date poate prezenta provocări:

- Date Insuficiente (Data Scarcity): Când nu există suficiente date pentru a antrena un model robust. Soluții: augmentarea datelor, transfer learning (utilizarea unui model pre-antrenat pe un set de date mare și ajustarea lui pentru sarcina specifică), colectarea mai multor date.

- Date Dezechilibrate (Imbalanced Data): Când anumite clase sunt subreprezentate semnificativ în setul de date. Soluții: supra-eșantionarea claselor minoritare (Oversampling), sub-eșantionarea claselor majoritare (Undersampling), utilizarea funcțiilor de pierdere ponderate.

- Zgomot și Erori în Date: Datele din lumea reală sunt rareori perfecte. Soluții: curățarea riguroasă a datelor, tehnici de robustificare a modelului care îl fac mai puțin sensibil la zgomot.

- Date Neformatate/Nestructurate: Necesită eforturi semnificative de preprocesare pentru a le aduce într-un format utilizabil.

Întrebări Frecvente (FAQ)

1. Cât de mari ar trebui să fie seturile de date pentru învățarea profundă?

Nu există o regulă fixă, dar în general, cu cât modelul este mai complex și problema mai dificilă, cu atât este nevoie de mai multe date. Pentru sarcini de clasificare a imaginilor, sute de mii sau chiar milioane de exemple sunt comune. Pentru probleme mai simple sau cu modele pre-antrenate, câteva mii pot fi suficiente. Calitatea primează întotdeauna cantității.

2. Pot folosi date din surse diferite?

Da, dar este esențial să vă asigurați că datele sunt compatibile și că au fost preprocesate într-un mod uniform. Diferențele în format, rezoluție sau distribuția datelor pot crea probleme pentru model.

3. Ce este „supraînvățarea” (overfitting) și cum o pot evita cu ajutorul datelor?

Supraînvățarea apare atunci când un model învață prea bine detaliile specifice ale setului de date de antrenament, inclusiv zgomotul, și nu reușește să generalizeze pe date noi. O împărțire corectă a datelor (antrenament, validare, testare), augmentarea datelor și utilizarea tehnicilor de regularizare (precum Dropout) sunt esențiale pentru a o evita.

4. Este necesar să fiu un expert în știința datelor pentru a începe cu învățarea profundă?

Nu este necesar să fii un expert, dar o înțelegere solidă a conceptelor de bază din statistică, algebră liniară și, desigur, a manipulării datelor este extrem de utilă. Există multe biblioteci și cadre de lucru (framework-uri) care simplifică procesul, dar o înțelegere fundamentală te va ajuta să depanezi problemele și să optimizezi modelele.

5. De unde pot găsi seturi de date pentru proiectele mele?

Există numeroase resurse online: Kaggle, UCI Machine Learning Repository, Google Dataset Search, TensorFlow Datasets, PyTorch Datasets. Multe instituții de cercetare și companii publică, de asemenea, seturi de date pentru uz public.

Concluzie

Utilizarea eficientă a seturilor de date este piatra de temelie a succesului în învățarea profundă. De la înțelegerea tipurilor de date la aplicarea riguroasă a tehnicilor de preprocesare și la împărțirea strategică a datelor, fiecare pas contribuie la construirea unor modele puternice și capabile să rezolve probleme complexe din lumea reală. Începeți cu seturi de date simple, cum ar fi Digits, experimentați cu ele și, treptat, veți deprinde arta și știința de a transforma datele brute în inteligență artificială aplicată.

Dacă vrei să descoperi și alte articole similare cu Seturi de Date: Combustibilul Învățării Profunde, poți vizita categoria Fitness.