29/11/2024

În lumea în continuă evoluție a inteligenței artificiale, termenii precum 'învățare automată' și 'rețele neuronale' sunt din ce în ce mai prezenți. La fel cum antrenăm un mușchi pentru a deveni mai puternic și mai eficient, și sistemele digitale pot fi 'antrenate' pentru a deveni mai inteligente și mai capabile să rezolve probleme complexe. Astăzi, vom explora una dintre cele mai fundamentale și puternice arhitecturi de rețele neuronale: Perceptronul Multi-Strat (Multi-Layer Perceptron - MLP). Gândiți-vă la el ca la un 'creier' digital capabil să învețe și să ia decizii, transformând datele brute în informații valoroase. Obiectivul principal al antrenării unui MLP este de a modela relații complexe între datele de intrare și cele de ieșire, permițându-ne să rezolvăm o gamă largă de probleme, de la recunoașterea imaginilor la predicția tendințelor comportamentale.

- Ce Este un Perceptron Multi-Strat (MLP)?

- Componentele Cheie ale un MLP

- Cum Funcționează un MLP: Mecanismele Fundamentale

- Tehnici Avansate pentru Îmbunătățirea Performanței MLP

- Aplicații Practice ale MLP-urilor

- Avantajele și Dezavantajele Perceptronilor Multi-Strat

- Întrebări Frecvente (FAQ)

- Concluzie

Ce Este un Perceptron Multi-Strat (MLP)?

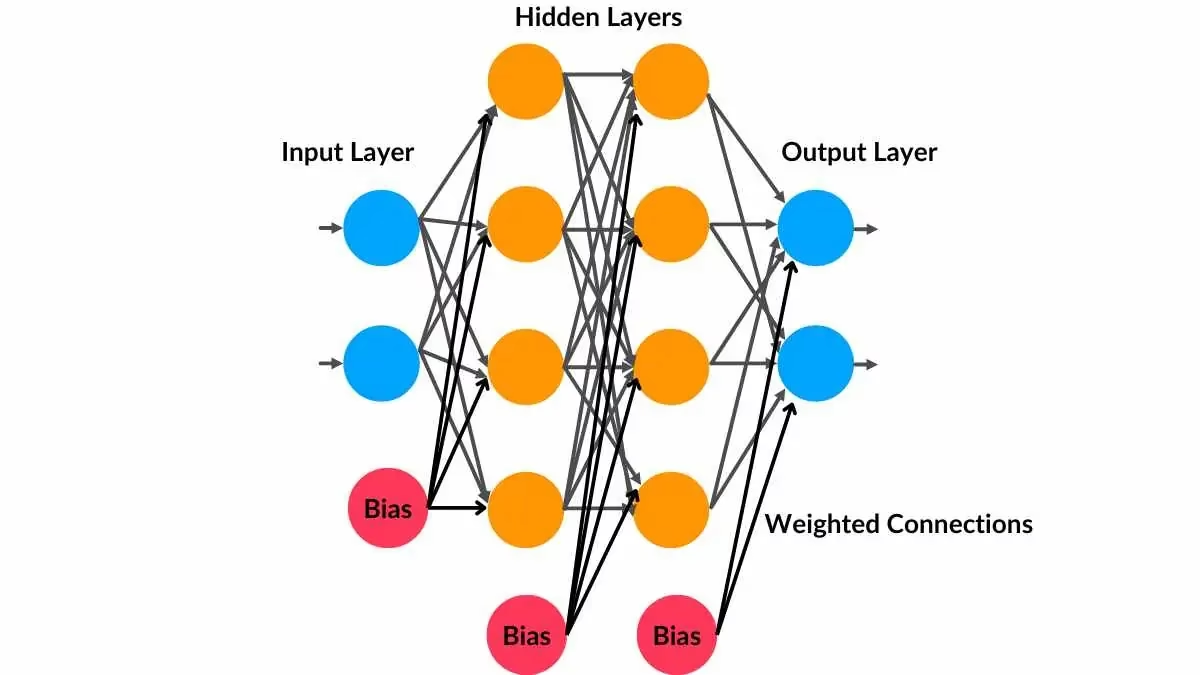

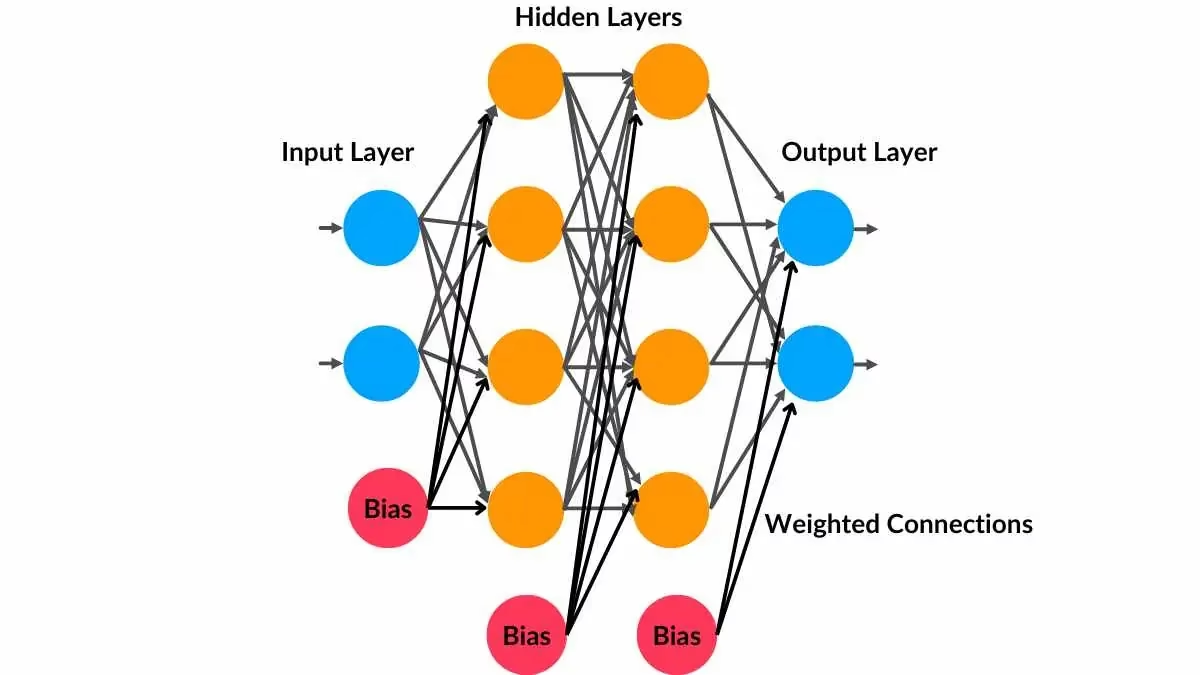

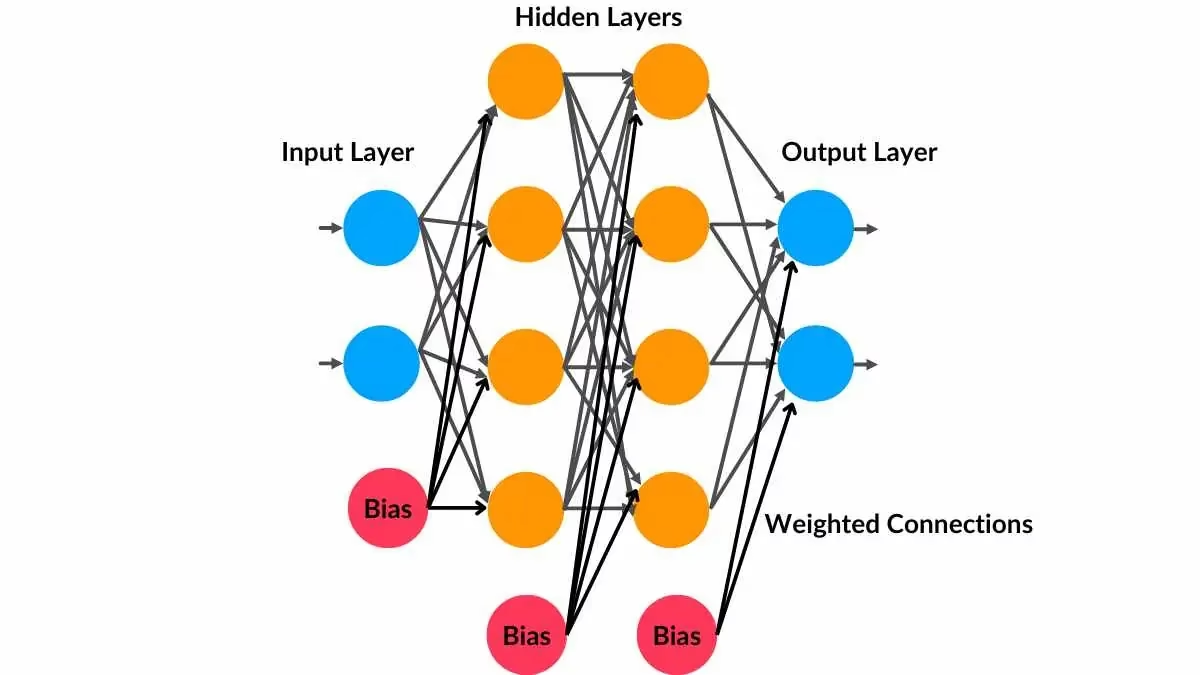

Perceptronul Multi-Strat (MLP) este cea mai simplă formă de rețea neuronală artificială și este compus din straturi dense, complet conectate, care transformă datele de intrare dintr-o dimensiune în alta. Este numit 'multi-strat' deoarece, spre deosebire de un perceptron simplu, care are doar un strat de intrare și unul de ieșire, un MLP include un strat de intrare, unul sau mai multe straturi ascunse și un strat de ieșire. Această structură cu straturi multiple îi conferă capacitatea de a învăța și de a modela relații mult mai complexe și non-liniare în date, depășind limitările unui perceptron simplu.

Fiecare conexiune din cadrul unui MLP reprezintă natura complet conectată a arhitecturii sale. Aceasta înseamnă că fiecare nod dintr-un strat este conectat la fiecare nod din stratul următor. Pe măsură ce datele se propagă prin rețea, fiecare strat le transformă treptat, până când predicția sau rezultatul final este generat în stratul de ieșire. Această interconectivitate densă permite rețelei să capteze și să proceseze o multitudine de caracteristici și interacțiuni din date, făcând MLP-urile extrem de versatile pentru diverse sarcini.

Componentele Cheie ale un MLP

Pentru a înțelege cum funcționează un MLP, este esențial să-i cunoaștem componentele principale:

- Stratul de Intrare: Acesta este punctul de plecare al datelor. Fiecare neuron sau nod din acest strat corespunde unei caracteristici de intrare. De exemplu, dacă analizăm un set de date despre clienți care include vârsta, venitul și numărul de achiziții, stratul de intrare ar avea trei neuroni, câte unul pentru fiecare caracteristică.

- Straturile Ascunse: Un MLP poate avea orice număr de straturi ascunse, iar fiecare strat poate conține orice număr de noduri sau neuroni. Aceste straturi sunt 'creierul' rețelei, unde are loc cea mai mare parte a procesării informațiilor. Ele primesc informații de la stratul anterior (fie stratul de intrare, fie un alt strat ascuns), le transformă și le transmit către stratul următor. Complexitatea relațiilor pe care un MLP le poate învăța este direct legată de numărul și dimensiunea straturilor ascunse.

- Stratul de Ieșire: Acest strat generează predicția sau rezultatul final al rețelei. Numărul de neuroni din stratul de ieșire depinde de tipul problemei pe care o rezolvăm. Pentru o clasificare binară (de exemplu, da/nu), ar putea fi un singur neuron. Pentru o clasificare multi-clasă (de exemplu, recunoașterea cifrelor de la 0 la 9), ar putea fi 10 neuroni, câte unul pentru fiecare clasă.

Cum Funcționează un MLP: Mecanismele Fundamentale

Antrenarea unui MLP este un proces iterativ, similar cu etapele unui program de antrenament bine structurat. Implică patru mecanisme cheie:

1. Propagarea Înainte (Forward Propagation)

În propagarea înainte, datele curg de la stratul de intrare către stratul de ieșire, trecând prin toate straturile ascunse. Fiecare neuron din straturile ascunse procesează intrarea în două etape:

- Suma Ponderată: Neuronul calculează o sumă ponderată a intrărilor sale, la care se adaugă un termen de bias. Formula este:

z = Σ w_i x_i + b, undex_ieste caracteristica de intrare,w_ieste greutatea corespunzătoare (importanța acelei intrări), iarbeste termenul de bias. Greutățile și bias-urile sunt parametrii pe care rețeaua îi 'învață' în timpul antrenamentului. - Funcția de Activare: Suma ponderată

zeste apoi trecută printr-o funcție de activare pentru a introduce non-liniaritate în rețea. Fără aceste funcții, un MLP ar fi doar o serie de transformări liniare, limitându-i capacitatea de a învăța relații complexe. Funcțiile de activare comune includ: - Sigmoid: Produce o ieșire între 0 și 1, fiind utilă în stratul de ieșire pentru probleme de clasificare binară.

- ReLU (Rectified Linear Unit): Returnează intrarea dacă este pozitivă, altfel 0. Este populară datorită eficienței sale computaționale și capacității de a rezolva problema gradientului care dispare.

- Tanh (Hyperbolic Tangent): Similară cu Sigmoid, dar produce o ieșire între -1 și 1.

Tabel Comparativ: Funcții de Activare Comune

| Funcție | Interval Ieșire | Avantaje | Dezavantaje |

|---|---|---|---|

| Sigmoid | (0, 1) | Utile pentru probabilități. | Gradient care dispare, ieșire nu este centrată pe zero. |

| Tanh | (-1, 1) | Ieșire centrată pe zero, mai bună decât Sigmoid. | Gradient care dispare. |

| ReLU | [0, ∞) | Fără gradient care dispare (pentru valori pozitive), eficientă computațional. | Problema neuronilor morți (dead neurons). |

| Leaky ReLU | (-∞, ∞) | Rezultă problema neuronilor morți, antrenament mai rapid. | Performanța poate varia. |

2. Funcția de Pierdere (Loss Function)

Odată ce rețeaua generează o ieșire (predicție), următorul pas este calcularea 'pierderii' folosind o funcție de pierdere. Aceasta cuantifică cât de mult se abate predicția rețelei de la eticheta reală. În învățarea supervizată, scopul este de a minimiza această pierdere.

- Pentru probleme de clasificare, se utilizează adesea Entropia Încrucișată Binară.

- Pentru probleme de regresie (unde se prezice o valoare continuă), Eroarea Pătratică Medie (MSE) este frecvent utilizată.

3. Retropropagarea (Backpropagation)

Scopul principal al antrenării unui MLP este de a minimiza funcția de pierdere prin ajustarea greutăților și bias-urilor rețelei. Acest lucru se realizează prin retropropagarea erorii. Procesul implică:

- Calculul Gradientului: Gradienții funcției de pierdere în raport cu fiecare greutate și bias sunt calculați folosind regula lanțului din calculul diferențial. Acești gradienți indică direcția și magnitudinea celei mai abrupte pante de creștere a pierderii.

- Propagarea Errorei: Eroarea este propagată înapoi prin rețea, strat cu strat, de la stratul de ieșire către stratul de intrare.

- Descendentă de Gradient: Rețeaua actualizează greutățile și bias-urile deplasându-se în direcția opusă gradientului pentru a reduce pierderea. Formula generală este:

w = w - η · (∂L/∂w), undeweste greutatea,η(eta) este rata de învățare (care controlează mărimea pasului de ajustare), iar∂L/∂weste gradientul funcției de pierdere în raport cu greutatea.

4. Optimizarea (Optimization)

MLP-urile se bazează pe algoritmi de optimizare pentru a rafina iterativ greutățile și bias-urile în timpul antrenamentului. Acești optimizatori determină cum sunt actualizați parametrii rețelei pe baza gradienților calculați de retropropagare. Alegerea optimizatorului poate influența semnificativ viteza și stabilitatea antrenamentului.

- Descendentă de Gradient Stocastic (SGD): Actualizează greutățile pe baza unui singur eșantion sau a unui lot mic de date. Este simplu, dar poate fi lent și zgomotos.

- Adam Optimizer: O extensie populară a SGD care încorporează momentum și rate de învățare adaptive pentru un antrenament mai eficient. Este adesea alegerea implicită datorită robusteții și performanței sale bune într-o gamă largă de probleme.

Tabel Comparativ: Optimizatori Comuni

| Optimizator | Principiu Cheie | Avantaje | Dezavantaje |

|---|---|---|---|

| SGD | Actualizări pe mini-loturi. | Simplitate, bun pentru seturi mari. | Convergență lentă, oscilații. |

| Adam | Momentum + Rate de învățare adaptive. | Convergență rapidă, robust. | Poate necesita ajustarea hiperparametrilor. |

| Adagrad | Rate de învățare adaptive per parametru. | Bun pentru date sparse. | Rata de învățare poate scădea prea repede. |

| RMSProp | Rate de învățare adaptive bazate pe media pătratelor. | Bun pentru probleme non-staționare. | Poate fi sensibil la rata de învățare. |

Tehnici Avansate pentru Îmbunătățirea Performanței MLP

Pentru a maximiza eficiența și acuratețea unui MLP, se aplică diverse tehnici avansate, similare cu tehnicile de antrenament specifice pentru atleți de performanță:

Inițializarea Greutăților

Greutățile dintr-o rețea neuronală indică importanța fiecărei intrări. O inițializare corectă a acestora este crucială pentru un antrenament stabil și rapid. Valorile trebuie să fie mici, non-zero și diferite între ele pentru a evita simetria. Două metode comune sunt:

- Inițializarea Xavier/Glorot: Ideală pentru funcțiile de activare Sigmoid și Tanh, urmărește menținerea unei varianțe constante a activărilor în toate straturile.

- Inițializarea He: Proiectată special pentru funcțiile de activare ReLU și Leaky ReLU, ajută la prevenirea dispariției sau exploziei gradientului.

Regularizarea Modelului

Un risc major în antrenarea rețelelor neuronale profunde este supraînvățarea (overfitting), unde modelul învață prea bine datele de antrenament și nu generalizează eficient pe date noi. Tehnici de regularizare ajută la prevenirea acestui fenomen:

- Stratul de Dropout: În timpul antrenamentului, o anumită proporție de neuroni din fiecare strat sunt 'dezactivați' aleatoriu (setați la zero). Acest lucru forțează rețeaua să nu se bazeze prea mult pe un singur neuron sau pe un set specific de neuroni, creând o rețea mai robustă și reducând interdependențele.

- Normalizarea Batch (Batch Normalization): Această tehnică normalizează ieșirile fiecărui strat ascuns înainte de a le introduce în următorul strat. Acest lucru rezolvă problema 'schimbării covariatei interne' (internal covariance shift), stabilizând antrenamentul, permițând utilizarea unor rate de învățare mai mari și accelerând convergența.

Monitorizarea Gradienților

Problema gradientului care explodează (exploding gradient) apare atunci când gradienții devin extrem de mari în timpul retropropagării, ducând la actualizări instabile ale greutăților. Decuparea Gradientului (Gradient Clipping) este o tehnică prin care valorile gradientului sunt limitate la un prag maxim, prevenind creșterea lor necontrolată și asigurând un antrenament mai stabil.

Programarea Ratei de Învățare (Learning Rate Scheduling)

Rata de învățare, un hiperparametru crucial, poate fi ajustată dinamic pe parcursul antrenamentului. Strategii precum reducerea ratei de învățare după un anumit număr de epoci sau atunci când pierderea de validare stagnează pot duce la o convergență mai fină și la o performanță mai bună.

Oprirea Timpurie (Early Stopping)

O altă metodă eficientă de prevenire a supraînvățării este oprirea timpurie. Aceasta implică monitorizarea performanței modelului pe un set de date de validare separat. Dacă performanța pe setul de validare nu se mai îmbunătățește (sau chiar începe să scadă) pentru un anumit număr de epoci (patience), antrenamentul este oprit, iar modelul cu cea mai bună performanță de validare este salvat. Aceasta economisește timp și resurse computaționale.

Tuning-ul Hiperparametrilor

Identificarea celei mai bune combinații de hiperparametri (cum ar fi numărul de straturi ascunse, numărul de neuroni pe strat, rata de învățare, funcțiile de activare și rata de dropout) este esențială pentru performanța optimă a unui MLP. Procesul de tuning implică experimentarea sistematică cu diferite valori pentru a găsi configurația care minimizează pierderea și maximizează acuratețea.

Aplicații Practice ale MLP-urilor

MLP-urile, datorită capacității lor de a modela relații complexe, sunt utilizate într-o multitudine de aplicații practice:

Recunoașterea Cifrelor Manuscrise (MNIST)

Un exemplu clasic de aplicare a MLP-urilor este recunoașterea cifrelor manuscrise din setul de date MNIST. Procesul implică încărcarea imaginilor (care sunt reprezentate ca matrici de pixeli), normalizarea valorilor pixelilor (împărțirea la 255 pentru a le aduce în intervalul 0-1), și apoi construirea unui model MLP. Modelul include un strat de aplatizare (Flatten) pentru a transforma imaginea 2D într-un vector 1D, urmat de straturi Dense (complet conectate) cu funcții de activare precum Sigmoid sau ReLU, și un strat de ieșire cu activare Softmax pentru clasificare multi-clasă. Modelul este apoi compilat cu un optimizator (ex: Adam) și o funcție de pierdere adecvată (ex: sparse categorical cross-entropy) și antrenat pe datele de antrenament. După antrenament, performanța modelului este evaluată pe un set de date de testare, arătând capacitatea sa de a clasifica cu acuratețe cifrele nevăzute.

Predicția Plecării Angajaților

Un alt caz de utilizare relevant este predicția plecării angajaților dintr-o companie. Acest tip de analiză ajută organizațiile să dezvolte planuri mai bune de reținere a angajaților și să îmbunătățească satisfacția la locul de muncă. Datele relevante despre angajați (nivel de satisfacție, ore lucrate, vechime, salarizare, departament etc.) sunt încărcate și preprocesate. Preprocesarea include adesea codificarea etichetelor (Label Encoding) pentru coloanele categorice (cum ar fi 'salariu' sau 'departament'), transformându-le în valori numerice. Setul de date este apoi împărțit în seturi de antrenament și testare. Un model MLPClassifier este construit și antrenat pe datele de antrenament, învățând tiparele care duc la plecarea angajaților. În final, modelul este utilizat pentru a face predicții pe setul de testare, iar acuratețea sa este evaluată, oferind o măsură a eficacității sale în identificarea angajaților cu risc de plecare.

Avantajele și Dezavantajele Perceptronilor Multi-Strat

Ca orice instrument puternic, MLP-urile vin cu propriul set de avantaje și dezavantaje:

Avantaje:

- Versatilitate: MLP-urile pot fi aplicate la o varietate largă de probleme, atât de clasificare (cum ar fi recunoașterea de imagini) cât și de regresie (cum ar fi predicția prețurilor). Flexibilitatea lor le face un punct de plecare excelent în multe proiecte de învățare automată.

- Non-liniaritate: Prin utilizarea funcțiilor de activare, MLP-urile pot modela relații complexe, non-liniaritate, în date. Aceasta este o capacitate crucială, deoarece majoritatea datelor din lumea reală prezintă tipare non-liniare pe care metodele liniare nu le pot capta.

- Calcul Paralel: Datorită naturii lor interconectate și a procesării paralele a neuronilor, MLP-urile pot fi antrenate rapid, mai ales cu ajutorul unităților de procesare grafică (GPU-uri), care sunt optimizate pentru operații matriciale.

Dezavantaje:

- Cost Computațional Ridicat: Antrenarea MLP-urilor poate fi lentă și necesită resurse computaționale semnificative, mai ales pe seturi de date mari sau cu multe straturi și neuroni.

- Predispoziție la Supraînvățare: Fără tehnici adecvate de regularizare (precum dropout sau normalizarea batch), MLP-urile sunt predispuse la supraînvățare, ceea ce înseamnă că învață prea bine zgomotul din datele de antrenament și nu generalizează bine pe date noi.

- Sensibilitate la Scalarea Datelor: MLP-urile necesită ca datele de intrare să fie normalizate sau scalate corespunzător pentru o performanță optimă. Lipsa acestei preprocesări poate duce la un antrenament instabil și o convergență lentă.

Întrebări Frecvente (FAQ)

- Ce este diferența dintre un Perceptron și un MLP?

- Un Perceptron este un model liniar simplu, având doar un strat de intrare și un strat de ieșire, putând rezolva doar probleme separabile liniar. Un MLP adaugă unul sau mai multe straturi ascunse, permițându-i să modeleze relații non-liniare și să rezolve probleme mult mai complexe.

- De ce sunt necesare funcțiile de activare?

- Funcțiile de activare introduc non-liniaritate în rețea. Fără ele, un MLP ar fi doar o serie de transformări liniare, indiferent de numărul de straturi, și nu ar putea învăța tipare complexe.

- Ce este supraînvățarea și cum o previne MLP?

- Supraînvățarea apare atunci când un model învață prea bine datele de antrenament, inclusiv zgomotul, și nu generalizează bine pe date noi. MLP-urile o pot preveni prin tehnici de regularizare precum Dropout și Normalizarea Batch, care reduc dependența de anumite caracteristici sau neuroni.

- Care este rolul ratei de învățare?

- Rata de învățare (learning rate) este un hiperparametru care controlează mărimea pasului cu care sunt actualizate greutățile rețelei în timpul procesului de optimizare. O rată prea mare poate duce la instabilitate, iar una prea mică la o convergență lentă.

- Când ar trebui să folosesc un MLP?

- Un MLP este o alegere bună atunci când aveți date structurate (tabele), probleme de clasificare sau regresie și relațiile dintre intrări și ieșiri sunt non-liniare și complexe. Este, de asemenea, o bază excelentă pentru înțelegerea conceptelor fundamentale ale rețelelor neuronale.

Concluzie

Perceptronii Multi-Strat reprezintă o fundație puternică în lumea rețele neuronale și a învățării automate. Capacitatea lor de a învăța tipare complexe din date îi face un instrument valoros, esențial pentru înțelegerea arhitecturilor mai avansate de învățare profundă. De la recunoașterea imaginii la predicția comportamentelor, MLP-urile continuă să fie un pilon în dezvoltarea inteligenței artificiale, demonstrând că, la fel ca în antrenamentul fizic, disciplina și structura pot duce la performanțe remarcabile.

Dacă vrei să descoperi și alte articole similare cu MLP: Creierul Artificial care Transformă Datele, poți vizita categoria Fitness.