03/01/2023

În era digitală actuală, inteligența artificială (AI) a atins niveluri de complexitate și eficiență inimaginabile acum câteva decenii. Unul dintre cele mai impresionante progrese în domeniul AI este reprezentat de învățarea profundă (deep learning), o subcategorie a învățării automate care utilizează rețele neuronale cu multiple straturi. În cadrul acestei discipline, rețelele neuronale convoluționale (CNN-uri) s-au impus ca fiind soluția de referință pentru sarcinile de procesare a imaginilor și a altor tipuri de date spațiale, revoluționând domenii precum recunoașterea vizuală, medicina și vehiculele autonome. Dar cum funcționează exact aceste arhitecturi complexe și de ce sunt atât de eficiente?

- Ce Este o Rețea Neuronală Convoluțională (CNN)?

- Componentele Cheie ale unei CNN

- Cum Funcționează o CNN în Profunzime?

- Etapele Construirii și Antrenării unei CNN

- Aplicații Practice ale CNN-urilor

- Avantaje și Dezavantaje

- Tabel Comparativ: CNN vs. Rețele Neuronale Tradiționale (MLP)

- Întrebări Frecvente (FAQ)

- Concluzie

Ce Este o Rețea Neuronală Convoluțională (CNN)?

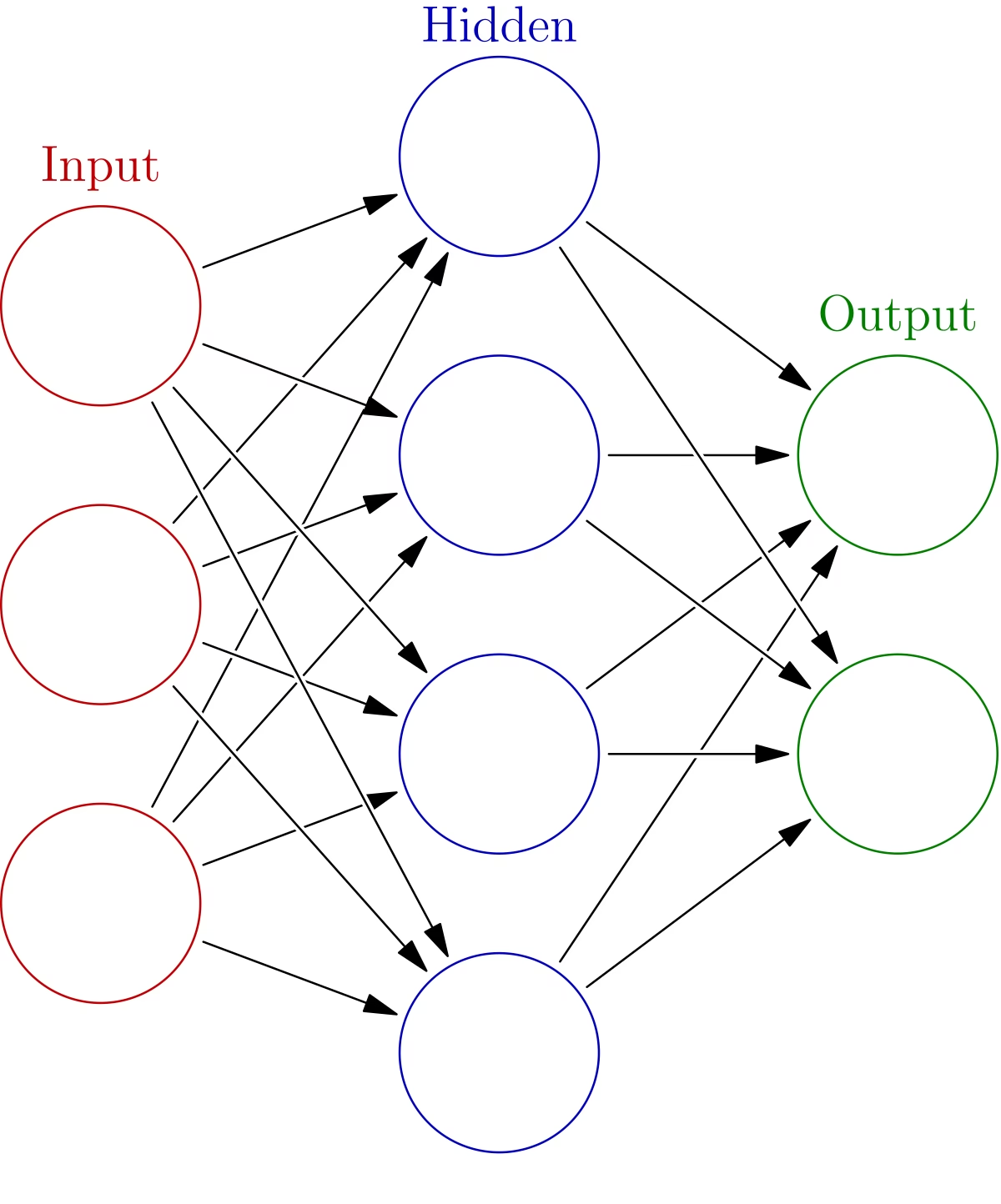

O Rețea Neuronală Convoluțională (CNN), cunoscută și sub denumirea de ConvNet, este un tip specializat de rețea neuronală profundă, concepută pentru a procesa date cu o structură de grilă, cum ar fi imaginile (care pot fi considerate grile de pixeli). Spre deosebire de rețelele neuronale tradiționale (MLP - Multilayer Perceptron) care procesează intrările ca vectori liniari, CNN-urile sunt capabile să detecteze automat și să învețe ierarhii de caracteristici spațiale direct din datele brute, fără a necesita inginerie manuală a caracteristicilor. Această capacitate de a extrage automat caracteristici relevante, de la margini simple la forme complexe, le face extrem de puternice pentru sarcinile vizuale.

De Ce CNN-uri pentru Imagini?

- Invariantă la Translație: O CNN poate recunoaște un obiect chiar dacă poziția sa se modifică ușor în imagine.

- Partajarea Parametrilor: Aceeași "filtru" sau "kernel" este aplicat pe diferite părți ale imaginii, reducând semnificativ numărul de parametri și, implicit, necesitatea unui volum imens de date de antrenament.

- Extracție Automată a Caracteristicilor: CNN-urile învață singure ce caracteristici sunt importante pentru o anumită sarcină, eliminând nevoia de a le defini manual.

Componentele Cheie ale unei CNN

O CNN tipică este compusă din mai multe straturi, fiecare având un rol specific în procesarea informației. Principalele straturi sunt:

1. Stratul de Convoluție (Convolutional Layer)

Acesta este inima unei CNN și locul unde are loc operația de convoluție. Un filtru (sau kernel) mic, de dimensiuni predefinite (ex. 3x3 sau 5x5), "glisează" peste imaginea de intrare. La fiecare pas, filtrul efectuează o operație de produs scalar între valorile pixelilor din zona pe care o acoperă și propriile sale valori. Rezultatul este o hartă de caracteristici (feature map) care indică prezența anumitor caracteristici (cum ar fi margini, texturi sau colțuri) în diferite locații ale imaginii. Prin utilizarea mai multor filtre, se pot detecta o varietate de caracteristici.

- Filtre (Kernels): Mici matrici de numere care detectează caracteristici specifice.

- Stride: Mărimea pasului cu care filtrul se deplasează peste imagine. Un stride mai mare reduce dimensiunea hărții de caracteristici.

- Padding: Adăugarea de pixeli de "umplutură" (de obicei zero) la marginea imaginii pentru a controla dimensiunea de ieșire și a evita pierderea informației de la margini.

2. Funcția de Activare (Activation Function)

După fiecare operație de convoluție, se aplică o funcție de activare non-liniară pe harta de caracteristici. Cea mai comună este Rectified Linear Unit (ReLU), care pur și simplu înlocuiește toate valorile negative cu zero. Aceasta introduce non-liniaritate în rețea, permițându-i să învețe modele mai complexe și să rezolve probleme care nu sunt liniar separabile.

3. Stratul de Pooling (Pooling Layer)

Stratul de pooling (cunoscut și sub numele de sub-eșantionare sau downsampling) este utilizat pentru a reduce dimensiunea spațială a hărților de caracteristici. Acest lucru ajută la reducerea numărului de parametri și a complexității computaționale, precum și la controlul suprapuneri (overfitting). Cele mai comune tipuri sunt:

- Max Pooling: Selectează valoarea maximă dintr-o regiune a hărții de caracteristici. Este foarte eficient în detectarea caracteristicilor dominante.

- Average Pooling: Calculează media valorilor dintr-o regiune.

Prin reducerea dimensiunilor, pooling-ul face rețeaua mai robustă la mici variații sau translații ale caracteristicilor în imagine.

4. Stratul Complet Conectat (Fully Connected Layer)

După mai multe straturi de convoluție și pooling, datele sunt "aplatizate" (transformate într-un vector unidimensional) și introduse într-un strat complet conectat, similar cu straturile unei rețele neuronale tradiționale. Acest strat preia caracteristicile abstracte învățate de straturile anterioare și le utilizează pentru a realiza clasificarea finală (de exemplu, a determina dacă imaginea conține o pisică, un câine etc.).

5. Stratul de Dropout

Dropout este o tehnică de regularizare utilizată pentru a preveni suprapunerea (overfitting-ul). În timpul antrenamentului, un anumit procent de neuroni din straturile complet conectate sunt "dezactivați" aleatoriu. Acest lucru forțează rețeaua să nu se bazeze excesiv pe anumiți neuroni și să învețe reprezentări mai robuste.

Cum Funcționează o CNN în Profunzime?

Procesul de funcționare al unei CNN poate fi împărțit în două faze principale: propagarea înainte (forward propagation) și retropropagarea (backpropagation).

1. Propagarea Înainte (Forward Propagation)

O imagine de intrare este alimentată în primul strat convoluțional. Aici, filtrele detectează caracteristici de nivel scăzut, cum ar fi margini sau colțuri. Hărțile de caracteristici rezultate trec printr-o funcție de activare și apoi prin straturi de pooling, reducând dimensiunea și extrăgând cele mai importante informații. Acest proces se repetă prin multiple straturi convoluționale și de pooling, fiecare strat învățând să detecteze caracteristici din ce în ce mai complexe și abstracte. De exemplu, un strat inițial ar putea detecta linii orizontale, în timp ce un strat mai profund ar putea combina aceste linii pentru a forma forme geometrice, iar un strat și mai profund ar putea recunoaște părți de obiecte, cum ar fi ochi sau roți. În cele din urmă, caracteristicile extrase sunt aplatizate și introduse în straturile complet conectate, care efectuează clasificarea finală, generând o predicție (de exemplu, probabilitatea ca imaginea să aparțină unei anumite categorii).

2. Retropropagarea (Backpropagation)

După ce rețeaua face o predicție, aceasta este comparată cu eticheta reală (adevărul fundamental) a imaginii, iar o funcție de pierdere (loss function) măsoară eroarea. Această eroare este apoi propagată înapoi prin rețea, de la stratul de ieșire către straturile de intrare. Prin intermediul algoritmilor de optimizare (cum ar fi gradient descent, Adam etc.), ponderile filtrelor și ale neuronilor sunt ajustate pentru a minimiza eroarea. Acest proces iterativ de propagare înainte și retropropagare se repetă de mii sau milioane de ori (epoci), permițând rețelei să învețe din date și să-și îmbunătățească performanța de predicție.

Etapele Construirii și Antrenării unei CNN

Dezvoltarea și antrenarea unei CNN implică mai multe etape cruciale:

1. Pregătirea Datelor

Calitatea și cantitatea datelor de antrenament sunt esențiale. Această etapă include:

- Colectarea și Etichetarea: Adunarea unui set mare și divers de imagini relevante, cu etichete precise.

- Preprocesare: Normalizarea valorilor pixelilor (ex. la un interval de la 0 la 1), redimensionarea imaginilor la o dimensiune uniformă.

- Augmentare de Date: Crearea de noi exemple de antrenament prin transformări minore ale imaginilor existente (rotații, răsturnări, decupaje, modificări de luminozitate). Aceasta ajută la creșterea diversității datelor și la prevenirea overfitting-ului.

- Împărțirea Datelor: Setul de date este împărțit în seturi de antrenament, validare și testare. Setul de antrenament este folosit pentru a învăța modelul, cel de validare pentru a ajusta hiperparametrii și a monitoriza performanța în timpul antrenamentului, iar cel de testare pentru a evalua performanța finală a modelului pe date nevăzute.

2. Alegerea Arhitecturii

Se alege o arhitectură CNN adecvată pentru problema specifică. Există numeroase arhitecturi preexistente (LeNet, AlexNet, VGG, ResNet, Inception, EfficientNet) care au demonstrat performanțe excelente pe seturi de date mari. Alternativ, se poate proiecta o arhitectură personalizată.

3. Antrenarea Modelului

Această etapă implică:

- Definirea Funcției de Pierdere: Măsoară eroarea dintre predicțiile modelului și etichetele reale (ex. entropia încrucișată pentru clasificarea multiclase).

- Alegerea Optimizatorului: Algoritmul care ajustează ponderile rețelei pentru a minimiza funcția de pierdere (ex. Adam, SGD cu Momentum).

- Antrenarea Iterativă: Modelul este antrenat pe loturi mici de date (batch size) pentru un număr predefinit de epoci (treceri complete prin setul de date de antrenament).

- Transfer Learning: O tehnică extrem de eficientă care implică utilizarea unei CNN pre-antrenate pe un set de date foarte mare (cum ar fi ImageNet) și apoi "reglarea fină" a acesteia pe setul de date mai mic și specific problemei curente. Aceasta economisește timp și resurse computaționale și este deosebit de utilă atunci când datele disponibile sunt limitate.

4. Evaluarea și Optimizarea

Performanța modelului este evaluată pe setul de validare folosind metrici relevante (precizie, acuratețe, recall, scor F1). Dacă performanța nu este satisfăcătoare, se pot ajusta hiperparametrii (rata de învățare, dimensiunea lotului, numărul de epoci, rata de dropout) sau se pot modifica arhitectura rețelei. Procesul de antrenament și evaluare este iterativ până când se atinge performanța dorită.

Aplicații Practice ale CNN-urilor

CNN-urile au revoluționat o gamă largă de domenii, inclusiv:

- Recunoașterea și Clasificarea Imaginilor: Identificarea obiectelor, animalelor, persoanelor în imagini și videoclipuri. De exemplu, clasificarea imaginilor medicale (detectarea tumorilor), recunoașterea facială.

- Detecția Obiectelor: Localizarea și identificarea mai multor obiecte într-o singură imagine, desenând cutii de delimitare în jurul lor (ex. în vehicule autonome pentru a detecta pietoni, mașini, semne de circulație).

- Segmentarea Semantică: Clasificarea fiecărui pixel dintr-o imagine într-o anumită categorie, permițând o înțelegere detaliată a scenei (ex. în robotică, medicină pentru delimitarea organelor).

- Generarea de Imagini: Rețelele Generative Adversariale (GANs), care utilizează CNN-uri, pot genera imagini noi, realiste, care nu au existat niciodată.

- Procesarea Limbajului Natural (NLP): Deși RNN-urile și, mai recent, arhitecturile Transformer sunt dominante în NLP, CNN-urile pot fi utilizate pentru sarcini precum clasificarea textului, analiza sentimentelor și extragerea de caracteristici locale din secvențe de text.

- Sisteme de Recomandare: Analizând imagini de produse pentru a face recomandări mai precise.

Avantaje și Dezavantaje

Avantaje:

- Extracție Automată a Caracteristicilor: Elimină nevoia de inginerie manuală a caracteristicilor, economisind timp și efort.

- Performanță Superioară: Ating performanțe de ultimă generație în sarcinile de viziune computerizată.

- Partajarea Parametrilor: Reduce numărul de parametri, făcând modelul mai eficient și mai puțin predispus la overfitting, mai ales cu date limitate (prin transfer learning).

- Invarianță la Translație: Capacitatea de a recunoaște caracteristici indiferent de poziția lor în imagine.

Dezavantaje:

- Necesită Cantități Mari de Date: Pentru a antrena o CNN de la zero, este nevoie de un volum considerabil de date etichetate.

- Intensive Computațional: Antrenarea CNN-urilor necesită resurse computaționale semnificative (GPU-uri puternice).

- "Cutie Neagră": Poate fi dificil de interpretat exact cum ajunge o CNN la o anumită decizie, ceea ce ridică probleme de explicabilitate în anumite domenii critice (ex. medicină, justiție).

Tabel Comparativ: CNN vs. Rețele Neuronale Tradiționale (MLP)

| Caracteristică | Rețele Neuronale Convoluționale (CNN) | Rețele Neuronale Tradiționale (MLP) |

|---|---|---|

| Tip de Intrare | Date cu structură spațială (imagini, video) | Vectori liniari (date tabulare) |

| Extracție Caracteristici | Automată, ierarhică | Manuală sau lipsă (necesită pre-procesare) |

| Partajarea Parametrilor | Da (filtrele sunt reutilizate) | Nu (fiecare neuron are ponderi unice) |

| Performanță pe Imagini | Excelentă, de ultimă generație | Slabă, nu captează relațiile spațiale |

| Complexitate | Mai complexă structural | Mai simplă structural |

| Necesitate GPU | Recomandat/Esențial pentru antrenament | Mai puțin critică |

Întrebări Frecvente (FAQ)

1. Ce este Transfer Learning și de ce este important pentru CNN-uri?

Transfer Learning este o tehnică în care un model (în acest caz, o CNN) pre-antrenat pe un set de date foarte mare și general (cum ar fi ImageNet, care conține milioane de imagini din mii de categorii) este folosit ca punct de plecare pentru o nouă sarcină cu un set de date mai mic. Este important deoarece permite obținerea unor performanțe excelente chiar și cu date limitate, reduce semnificativ timpul de antrenament și necesarul de resurse computaționale, valorificând cunoștințele generice învățate anterior de model.

2. De ce este funcția de activare ReLU atât de populară în CNN-uri?

ReLU (Rectified Linear Unit) este populară datorită simplității și eficienței sale. Introduce non-liniaritate, permițând rețelei să învețe modele complexe, dar evită problema gradientului care dispare (vanishing gradient problem) întâlnită la alte funcții precum sigmoid sau tanh, mai ales în rețelele profunde. Este, de asemenea, computațional eficientă, deoarece implică doar o operație simplă (max(0, x)).

3. Câtă putere de calcul am nevoie pentru a antrena o CNN?

Antrenarea unei CNN de la zero, în special a unei arhitecturi mari pe un set de date extins, necesită o putere de calcul considerabilă. GPU-urile (Graphics Processing Units) sunt esențiale, deoarece sunt optimizate pentru operații paralele necesare în calculul matricial al rețelelor neuronale. Pentru proiecte de cercetare sau aplicații complexe, sunt adesea folosite multiple GPU-uri sau chiar clustere de calcul. Pentru sarcini mai simple sau cu transfer learning, un GPU de consum poate fi suficient.

4. Pot folosi CNN-uri pentru date non-imagini?

Da, deși CNN-urile sunt cel mai adesea asociate cu imaginile, ele pot fi adaptate și pentru alte tipuri de date, cu condiția ca acestea să poată fi reprezentate într-un format de grilă sau secvențial. De exemplu, în procesarea limbajului natural, un text poate fi transformat într-o matrice (prin încorporări de cuvinte), iar filtrele convoluționale pot detecta caracteristici locale precum n-grame sau fraze. De asemenea, CNN-urile sunt folosite în analiza seriilor temporale (ex. date de senzori, semnale audio), tratând secvențele ca pe o "imagine" unidimensională.

Concluzie

Rețelele Neuronale Convoluționale reprezintă o piatră de temelie a învățării profunde moderne, în special în domeniul viziunii computerizate. Prin capacitatea lor unică de a extrage automat caracteristici ierarhice și de a învăța din date spațiale, CNN-urile au deschis noi orizonturi pentru inteligența artificială, transformând modul în care mașinile "văd" și înțeleg lumea. Pe măsură ce tehnologia avansează, ne putem aștepta ca CNN-urile să continue să evolueze și să găsească aplicații chiar mai inovatoare, consolidându-și poziția ca un instrument indispensabil în arsenalul oricărui specialist în AI.

Dacă vrei să descoperi și alte articole similare cu CNN-uri în Deep Learning: Ghidul Complet, poți vizita categoria Fitness.