20/02/2026

Pășind în lumea fascinantă a învățării profunde, mulți dezvoltatori se aventurează în construcția rețelelor neurale, doar pentru a se confrunta cu rezultate adesea dezamăgitoare. Este un scenariu comun să observi că procesul de antrenare nu reușește să actualizeze corect ponderile rețelei sau că modelul nu este capabil să găsească minimul funcției de cost. Acestea sunt probleme foarte frecvente în antrenarea rețelelor neurale, iar pentru a le depăși cu succes, este absolut esențial să dispunem de o strategie bine definită și robustă. Fără o abordare strategică, eforturile noastre pot fi în zadar, iar potențialul enorm al inteligenței artificiale rămâne neexploatat. Acest articol este conceput pentru a vă ghida prin cele mai presante provocări întâlnite în antrenarea rețelelor neurale și pentru a vă oferi soluții practice și eficiente, bazate pe principii fundamentale ale învățării automate. Vom explora în detaliu aspecte cruciale care pot face diferența între un model performant și unul care eșuează să îndeplinească așteptările.

Vom aborda și rezolva următoarele probleme esențiale în antrenarea rețelelor neurale:

- Supraînvățare vs. Subînvățare

- Gradientul Disparut

- Minimele Locale

- Setarea Strategiei Ratei de Învățare Corecte

- Alegerea Dimensiunii Mini-Lotului

Supraînvățare vs. Subînvățare

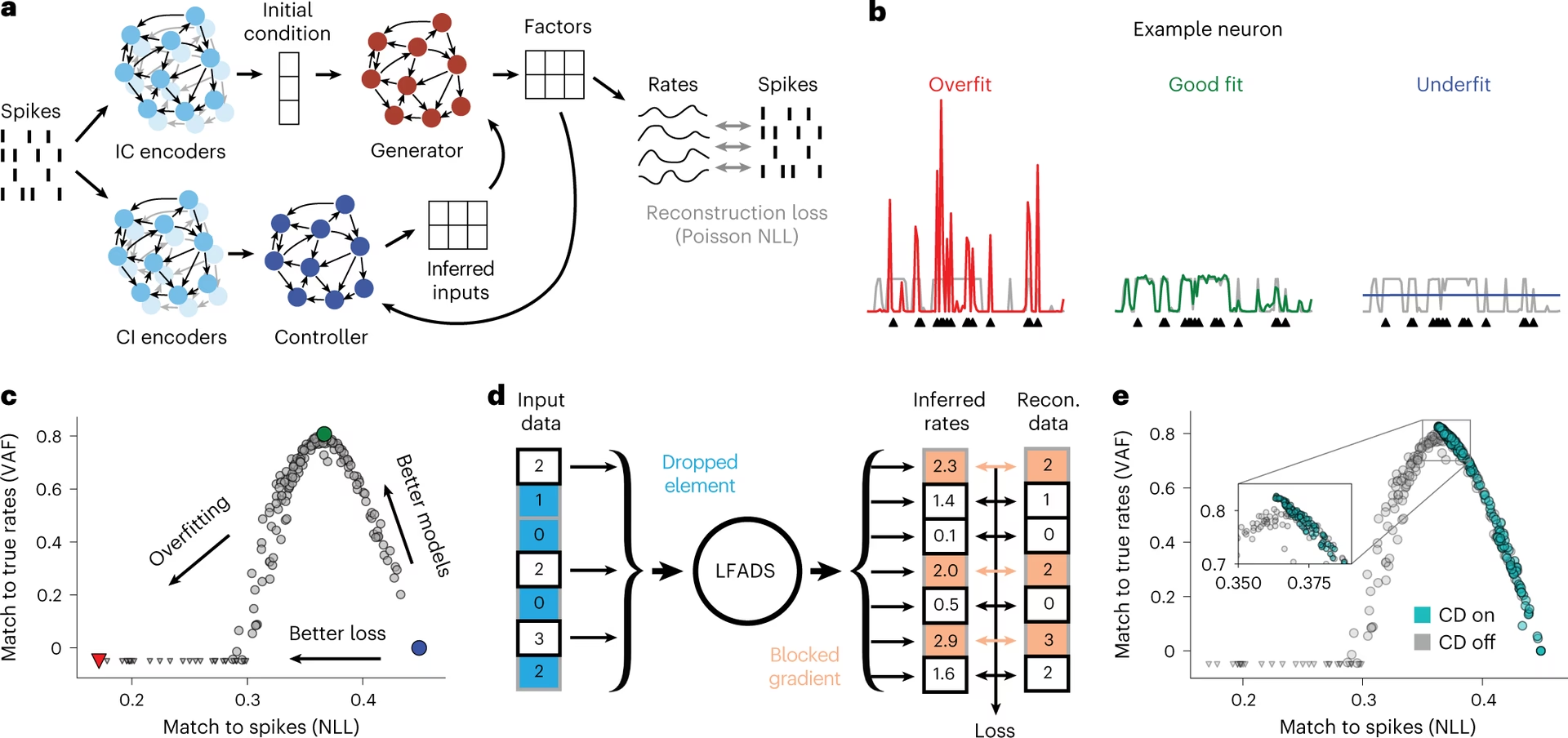

Una dintre cele mai comune și frustrante probleme este echilibrul delicat dintre supraînvățare (overfitting) și subînvățare (underfitting). Supraînvățarea apare atunci când un model învață detaliile și zgomotul din datele de antrenare într-o măsură atât de mare încât performanța sa pe date noi, nevăzute, este negativ afectată. Practic, modelul memorează fluctuațiile aleatorii și irelevante din datele de antrenare ca și concepte valide. Problema este că aceste concepte nu se aplică datelor noi, compromițând grav capacitatea modelului de a generaliza. Supraînvățarea este mai probabilă în cazul modelelor neliniare și neparametrice, care oferă o flexibilitate mai mare în optimizarea funcției de pierdere, permițându-le să se adapteze excesiv la datele de antrenare. Pe de altă parte, subînvățarea se referă la un model care nu reușește să modeleze nici măcar datele de antrenare și, prin urmare, nu poate generaliza deloc la date noi. Este ca și cum modelul ar fi prea simplu pentru complexitatea problemei pe care încearcă să o rezolve, ignorând relațiile esențiale din date.

Conceptul de supraînvățare/subînvățare este strâns legat de compromisul dintre varianță și bias (eroare sistematică). Varianța măsoară cât de mult se va schimba estimarea funcției de pierdere dacă se utilizează un alt set de date de antrenare. O varianță scăzută sugerează modificări mici ale estimării funcției țintă cu modificări ale setului de date de antrenare, indicând o consistență bună a modelului. O varianță ridicată, în schimb, sugerează modificări mari, indicând o sensibilitate excesivă la datele specifice de antrenare.

Pe de altă parte, biasul se referă la ipotezele simplificatoare făcute de un model pentru a facilita învățarea funcției de pierdere. Un bias scăzut sugerează mai puține ipoteze despre forma funcției de pierdere, permițând modelului să fie mai flexibil. Un bias ridicat sugerează mai multe ipoteze, ceea ce poate duce la un model prea simplu pentru a capta complexitatea reală a datelor. Pentru a înțelege mai bine acest compromis, putem vizualiza relația astfel:

| Bias Scăzut | Bias Ridicat | |

|---|---|---|

| Varianță Scăzută | Ideal (model bun, generalizează bine) | Subînvățare (model prea simplu, nu captează relații) |

| Varianță Ridicată | Supraînvățare (model prea complex, se adaptează zgomotului) | De dorit evitat (model slab, nici nu învață, nici nu generalizează) |

Pentru a identifica potrivirea corectă a unui model, putem analiza performanța unui algoritm de învățare automată pe seturile de date de antrenare și de testare pe parcursul numărului de iterații/epoci de antrenare. Pe măsură ce algoritmul învață, eroarea modelului scade atât pe datele de antrenare, cât și pe cele de testare. Însă, după un anumit punct, performanța pe setul de date de antrenare continuă să scadă, dar modelul începe să învețe și zgomotul din datele de antrenare. Acest lucru se manifestă printr-o creștere a erorii pe setul de testare. Punctul optim este chiar înainte ca eroarea pe datele de testare să înceapă să crească. Acest moment este crucial și indică echilibrul ideal între învățare și generalizare.

Pe lângă numărul de epoci, problema supraînvățării/subînvățării este un factor cheie în decizia privind numărul de neuroni ascunși și numărul de straturi ascunse. Acestea determină capacitatea modelului de a înțelege relațiile complicate din date. Dar, similar cu numărul de epoci, un număr prea mare de neuroni sau straturi va duce la supraînvățare, în timp ce un număr prea mic va duce la subînvățare.

Soluții pentru Supraînvățare și Subînvățare

Există trei abordări populare pentru a depăși aceste provocări:

- Oprirea timpurie (Early stopping): Această metodă ne permite să specificăm un număr mare de epoci de antrenare și să oprim antrenarea odată ce performanța modelului încetează să se îmbunătățească pe setul de date de testare. Monitorizează progresul antrenării și oprește procesul atunci când sunt îndeplinite anumite condiții, prevenind supraînvățarea. Este o tehnică simplă, dar extrem de eficientă, care ne economisește timp și resurse computaționale.

- Regularizarea: Aceasta este o formă de regresie care fie elimină (regularizarea L1), fie micșorează (regularizarea L2) estimările coeficienților către zero. Astfel, ea descurajează adaptarea unui model prea complicat la date, reducând riscul de supraînvățare. Regularizarea adaugă o penalizare funcției de pierdere, forțând modelul să fie mai simplu și mai generalizabil. Regularizarea L1 (Lasso) tinde să seteze unii coeficienți la zero, realizând selecția de caracteristici, în timp ce L2 (Ridge) tinde să micșoreze coeficienții, prevenind valori extreme.

- Dropout: Dropout se bazează pe ideea de a antrena mai multe rețele neurale pe arhitecturi diferite în paralel. Ideea de bază este că anumite ieșiri ale straturilor sunt "abandonate" aleatoriu în timpul antrenării. Astfel, după fiecare iterație, ieșirile se bazează pe o combinație diferită de neuroni din rețeaua neurală. Acest lucru împiedică neuronii să devină co-dependenți și forțează rețeaua să învețe caracteristici mai robuste, îmbunătățind capacitatea de generalizare.

Pe lângă aceste opțiuni, putem încerca următoarele sfaturi euristice pentru numărul de straturi ascunse și neuroni:

- "În practică, adesea rețelele neurale cu 3 straturi vor depăși rețelele cu 2 straturi, dar a merge chiar mai adânc (4, 5, 6 straturi) rareori ajută mult mai mult. Acest lucru este în contrast puternic cu rețelele convoluționale, unde adâncimea s-a dovedit a fi o componentă extrem de importantă pentru un sistem bun de recunoaștere (de exemplu, de ordinul a 10 straturi antrenabile)."

- Pentru selectarea numărului de neuroni în straturile ascunse, putem urma următoarele reguli:

- Numărul de neuroni ascunși ar trebui să fie între dimensiunea stratului de intrare și cea a stratului de ieșire.

- Cel mai comun număr de neuroni ascunși este radical din (numărul nodurilor stratului de intrare * numărul nodurilor stratului de ieșire).

- Numărul de neuroni ascunși ar trebui să continue să scadă în straturile ulterioare pentru a se apropia din ce în ce mai mult de structura stratului de ieșire.

Este important de reținut că toate acestea sunt reguli euristice și ar trebui ajustate în funcție de problema specifică. Experimentarea este cheia.

Problema Gradientului Disparut

Anumite funcții de activare, cum ar fi funcția sigmoidă, au o derivată foarte mică, mai ales atunci când valorile de intrare sunt departe de centrul funcției. Acest lucru înseamnă că rata la care ponderile rețelei neurale sunt actualizate este foarte mică. Această problemă se agravează pe măsură ce adăugăm mai multe straturi ascunse, deoarece derivatele din diferitele straturi se înmulțesc, iar în consecință, un număr mare de numere mici înmulțite duc la o modificare finală care este aproape de zero. Acest fenomen, cunoscut sub numele de gradient dispărut, înseamnă că modelul nu poate reacționa suficient pentru a găsi valorile optime ale ponderilor. Stratului de intrare îi parvin actualizări minuscule, aproape inexistente, ceea ce duce la o învățare extrem de lentă sau chiar la stagnarea procesului de antrenare.

Soluție pentru Gradientul Disparut

Cea mai bună modalitate de a gestiona problema gradientului dispărut este de a înlocui funcția de activare sigmoidă în straturile ascunse cu alte funcții, cum ar fi ReLU (Rectified Linear Unit) sau Tanh (tangenta hiperbolică). Funcțiile ReLU, în special, au o derivată constantă pentru valorile pozitive, ceea ce ajută la prevenirea dispariției gradientului. Tanh, deși are o formă similară cu sigmoidă, are o ieșire centrată pe zero, ceeața poate ajuta la stabilizarea antrenării în comparație cu sigmoidă.

Problema Minimele Locale

Este foarte comun ca funcțiile de pierdere să aibă un număr de vârfuri și văi. O minimă locală este un punct care reprezintă valoarea minimă în vecinătatea sa, dar nu neapărat valoarea minimă globală a funcției de pierdere. Odată ce modelul nostru atinge o minimă locală, un algoritm simplu de descendență a gradientului nu poate găsi nicio direcție pentru a minimiza în continuare funcția de pierdere în acea vecinătate și va rămâne blocat acolo. Astfel, nu vom putea găsi ponderile optime la nivel global pentru rețeaua noastră neurală. Această problemă este vizualizată ca o bilă care se oprește într-o vale mică, fără a putea ieși pentru a găsi valea cea mai adâncă.

Soluții pentru Minimele Locale

Avem două opțiuni principale pentru a gestiona problema minimelor locale:

- Repornire Aleatorie (Random Restart): Aceasta înseamnă, în esență, că putem începe procesul de antrenare din diferite puncte ale funcției de pierdere și să efectuăm descendența gradientului din toate acestea. Această abordare crește semnificativ șansele noastre de a găsi minima globală, deoarece este mai probabil ca cel puțin una dintre porniri să ducă la o soluție mai bună.

- Momentum: Această abordare este inspirată de ideea unui obiect care se mișcă foarte repede pe o suprafață neuniformă, astfel încât impulsul său îl împinge peste mici denivelări. Ideea de bază este că gradientul la o minimă locală este zero, dar gradientul din epocile anterioare va avea valori diferite de zero, iar luarea mediei lor ne va ajuta să ieșim din denivelarea de la minima locală. Formal, momentumul este o medie ponderată a gradienților trecuți, aplicându-se o pondere mai mare gradienților recenți, ducând la o medie exponențială a gradienților. Ponderea este de obicei numită viteză și variază între 0 și 1. Cea mai bună modalitate de a găsi valoarea vitezei este prin validare încrucișată. Momentumul oferă o inerție procesului de optimizare, permițând modelului să "treacă" peste obstacolele mici reprezentate de minimele locale.

Dimensiunea Mini-Lotului

Descendența gradientului pe mini-loturi (mini-batch gradient descent) este o variație a algoritmului de descendență a gradientului care împarte setul de date de antrenare în loturi mici, utilizate pentru a calcula eroarea modelului și a actualiza coeficienții modelului. Este cea mai comună formă de algoritm de descendență a gradientului (celelalte opțiuni fiind descendența gradientului pe lot întreg și descendența gradientului stocastic). Dimensiunea lotului este determinată de parametrul dimensiunea mini-lotului, iar modul în care îl selectăm are un impact semnificativ asupra cerințelor de resurse și asupra vitezei de antrenare a rețelelor neurale.

O dimensiune prea mică a mini-lotului va duce la un progres lent al antrenării, dar ajută la convergența către minima globală. Aceasta se datorează faptului că actualizările sunt mai frecvente și mai "zgomotoase", ajutând la explorarea spațiului de căutare. În schimb, selectarea unei dimensiuni mari a mini-lotului va duce la o antrenare mai rapidă, dar necesită mai multă memorie și resurse computaționale. De asemenea, prezintă riscul de a rămâne blocat la minimele locale, deoarece actualizările sunt mai puțin frecvente și mai "netede", având mai puțină capacitate de a sări peste obstacolele mici.

Soluție pentru Dimensiunea Mini-Lotului

O dimensiune a mini-lotului de 32 este un bun punct de plecare și putem încerca, de asemenea, 64, 128 și 256 dacă aceasta nu funcționează optim. Cele mai comune seturi de valori utilizate pentru majoritatea problemelor sunt: 1, 2, 4, 16, 32, 64, 128 și 256. Alegerea optimă depinde de arhitectura rețelei, de setul de date și de resursele disponibile. Este adesea necesară o explorare empirică pentru a găsi cea mai bună valoare.

Cum se Setează Rata de Învățare

Rata de învățare se referă la cantitatea cu care ponderile sunt actualizate în timpul antrenării (cunoscută și sub denumirea de dimensiunea pasului) modelelor de învățare automată. Este unul dintre cei mai importanți hiperparametri utilizați în antrenarea rețelelor neurale, iar valorile tipice suspecte sunt 0.1, 0.01, 0.001, 0.0001, 0.00001 și 0.000001. Setarea unei rate de învățare foarte mici face ca modelul nostru să fie foarte lent în identificarea punctului minim al funcției de cost, în timp ce alegerea unei valori mari ne va face să ratăm punctul optim, deoarece modelul va face pași prea mari, sărind peste minim. Privind versiunea extremă a acestui lucru, o rată de învățare mare poate duce la oscilația performanței modelului între epocile de antrenare, ceea ce indică faptul că ponderile diverg de la valoarea optimă. La cealaltă extremă, o valoare foarte mică poate împiedica modelul să converge sau să rămână blocat la o minimă locală. Există, de obicei, 3 scenarii cu care ne vom confrunta:

| Comportamentul erorii de validare | Indicație |

|---|---|

| Eroarea de validare scade rapid în timpul antrenării | Alegere bună a ratei de învățare |

| Eroarea de validare scade foarte lent în timpul antrenării | Rata de învățare trebuie mărită |

| Eroarea de validare crește lent în timpul antrenării | Rata de învățare trebuie scăzută |

Soluție pentru Rata de Învățare

Unele versiuni moderne ale algoritmilor de descendență a gradientului stocastic, cum ar fi Adam, permit rate de învățare adaptative, unde performanța modelului pe setul de date de antrenare este monitorizată de algoritm, iar rata de învățare este ajustată în consecință. Rata de învățare este redusă treptat dacă rata de eroare începe să scadă și este mărită dacă rata de eroare nu se îmbunătățește pentru un număr de epoci. Dacă acest lucru nu funcționează, putem încerca alți optimizatori precum AdaGrad sau RMSProp (care au, de asemenea, un mecanism de rată de învățare adaptativă). Acești optimizatori sunt de obicei prima alegere în multe aplicații practice datorită robusteții lor.

Dacă dorim să setăm manual valoarea parametrului, atunci ar trebui să verificăm dinamica învățării modelului creând un grafic al pierderii pe parcursul epocilor de antrenare. Putem verifica apoi următoarele:

- Este rata de învățare rapidă sau lentă?

- Au existat modificări foarte mici ale ratei de eroare, indicând o valoare scăzută a ratei de învățare?

- Observăm oscilații în pierdere, indicând o valoare ridicată a ratei de învățare?

De asemenea, putem seta manual un program de rată de învățare (learning rate schedule) în care rata de învățare este scăzută liniar/exponențial de la o valoare maximă la o valoare minimă după un anumit număr de epoci. Această metodă oferă un control mai fin asupra procesului de optimizare.

Întrebări Frecvente (FAQ)

- Ce este supraînvățarea și cum o pot detecta?

- Supraînvățarea (overfitting) apare când modelul învață prea mult zgomotul din datele de antrenare, performând slab pe date noi. O detectezi monitorizând eroarea pe setul de testare: dacă eroarea de antrenare continuă să scadă, dar cea de testare începe să crească, modelul se supraînvață.

- Care sunt principalele metode de combatere a supraînvățării?

- Principalele metode includ oprirea timpurie (early stopping), regularizarea (L1, L2) și dropout. Acestea ajută modelul să generalizeze mai bine și să evite memorarea datelor de antrenare.

- De ce este funcția sigmoidă problematică pentru rețelele adânci?

- Funcția sigmoidă suferă de problema gradientului dispărut. Derivata sa devine foarte mică pentru valori mari sau mici ale intrării, ceea ce face ca actualizările ponderilor în straturile anterioare să fie minuscule, încetinind sau oprind antrenarea.

- Ce pot face pentru a evita minimele locale în timpul antrenării?

- Poți folosi reporniri aleatorii (random restarts), începând antrenarea din mai multe puncte diferite. De asemenea, utilizarea momentumului în algoritmul de optimizare poate ajuta modelul să "treacă" peste minimele locale și să găsească o soluție mai bună.

- Cum influențează dimensiunea mini-lotului procesul de antrenare?

- O dimensiune mică a mini-lotului duce la o antrenare mai lentă, dar cu actualizări mai precise și un risc mai mic de a rămâne blocat în minime locale. O dimensiune mare accelerează antrenarea, dar necesită mai multe resurse și poate duce la convergență către minime locale mai puțin optime. Dimensiuni comune sunt 32, 64, 128.

- Ce este o rată de învățare adaptativă și de ce este utilă?

- O rată de învățare adaptativă este un mecanism prin care algoritmul de optimizare (ex. Adam, AdaGrad) ajustează automat rata de învățare pe parcursul antrenării, în funcție de performanța modelului. Este utilă deoarece elimină necesitatea de a seta manual o rată de învățare fixă și ajută la o convergență mai eficientă și stabilă.

Concluzie

Antrenarea eficientă a rețelelor neurale este o artă și o știință care necesită înțelegerea și aplicarea unor strategii solide pentru a depăși provocările comune. Am explorat în acest articol cele mai presante obstacole: supraînvățarea, problema gradientului dispărut, capcanele minimelor locale, importanța dimensiunii mini-lotului și setarea strategică a ratei de învățare. Fiecare dintre aceste aspecte, dacă este neglijat, poate compromite serios performanța modelului. Înțelegerea profundă a compromisului bias-varianță, alegerea funcțiilor de activare potrivite, utilizarea tehnicilor de regularizare și a optimizatorilor avansați sunt pași esențiali către construirea unor modele robuste și generalizabile. Prin aplicarea soluțiilor discutate – de la oprirea timpurie și dropout, la momentum și rate de învățare adaptative – dezvoltatorii pot naviga cu succes prin complexitatea antrenării rețelelor neurale, transformând rezultatele dezamăgitoare în succese remarcabile. Sperăm că acest ghid vă va servi drept o resursă valoroasă în călătoria dumneavoastră prin lumea învățării profunde.

Dacă vrei să descoperi și alte articole similare cu Strategii Eficiente pentru Antrenarea Rețelelor Neurale, poți vizita categoria Fitness.