17/03/2025

În lumea în continuă evoluție a inteligenței artificiale și a învățării automate, rețelele neuronale reprezintă instrumente incredibil de puternice, capabile să descopere tipare complexe în volume uriașe de date. De la recunoașterea imaginilor la prognoza performanțelor sportive, aplicațiile lor sunt vaste și transformatoare. Totuși, există un fenomen paradoxal și des întâlnit în antrenarea acestor rețele: acela de a "învăța prea bine". Ce înseamnă acest lucru și de ce este o problemă?

Imaginați-vă că pregătiți un atlet pentru o competiție specifică. Dacă antrenamentul este prea specific și se concentrează exclusiv pe detaliile minuscule ale acelei competiții, fără a dezvolta abilități generale, atletul ar putea excela în acea singură situație, dar ar eșua lamentabil în oricare alta, chiar și similară. Exact așa se întâmplă și cu o rețea neuronală atunci când suferă de supraînvățare (overfitting).

- Ce Este Supraînvățarea (Overfitting) în Rețelele Neuronale?

- Cum Recunoaștem Supraînvățarea?

- Importanța Validării Încrucișate (Cross-Validation)

- Strategii Eficiente de Combatere a Supraînvățării

- Tabel Comparativ: Regularizare vs. Dropout

- Întrebări Frecvente (FAQ)

- Ce se întâmplă dacă o rețea neuronală "învață prea bine"?

- Care este diferența dintre supraînvățare (overfitting) și subînvățare (underfitting)?

- Pot folosi atât regularizarea, cât și dropout-ul simultan?

- Cât de importantă este validarea încrucișată pentru combaterea supraînvățării?

- Există și alte metode de a combate supraînvățarea?

- Concluzie

Ce Este Supraînvățarea (Overfitting) în Rețelele Neuronale?

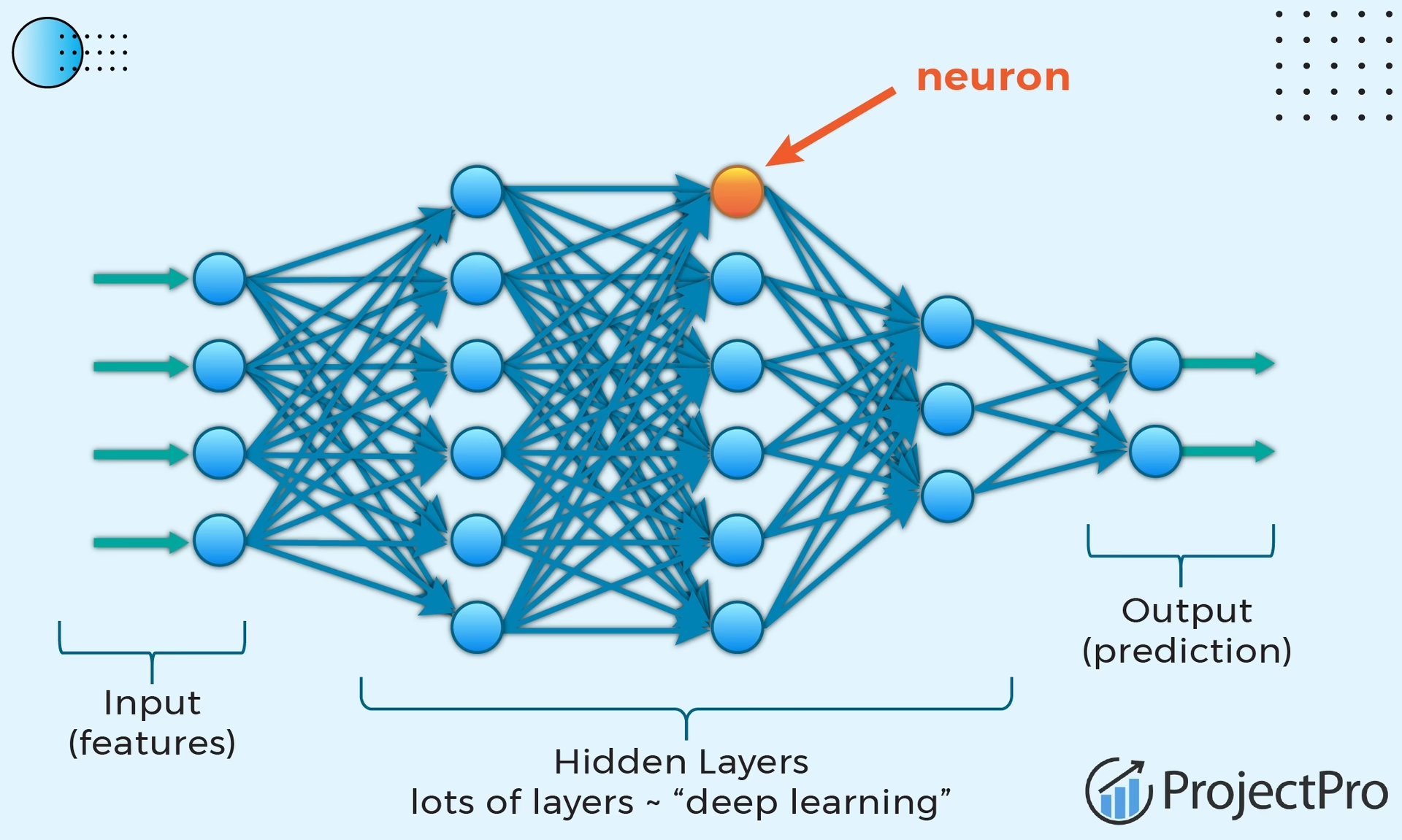

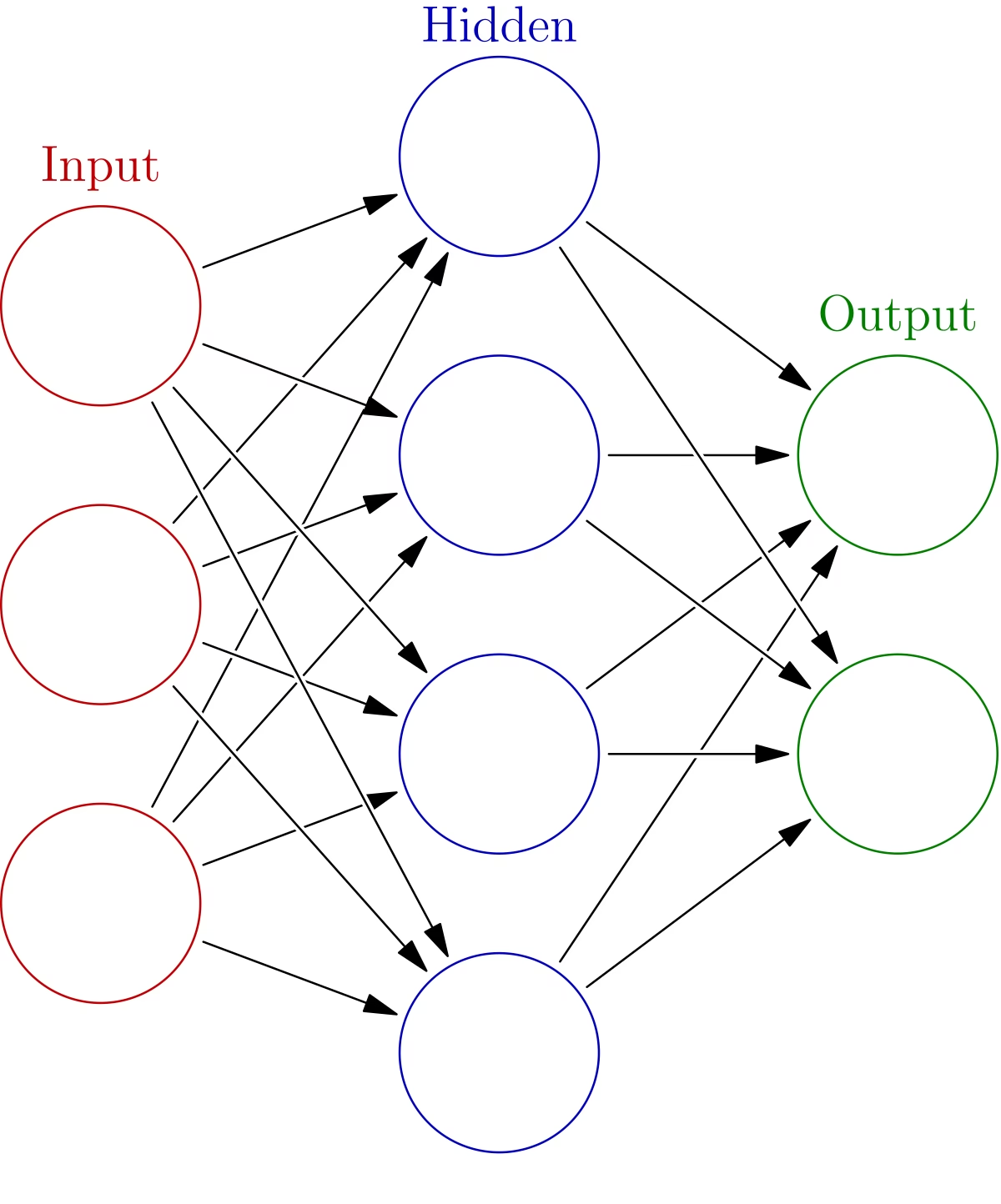

Supraînvățarea apare atunci când o rețea neuronală, în timpul procesului de antrenament, învață nu doar tiparele generale și relevante din datele de antrenament, ci și zgomotul, erorile și particularitățile specifice ale acestora. Altfel spus, rețeaua memorează datele de antrenament în loc să învețe să generalizeze pe baza lor. Rezultatul este un model care performează excepțional de bine pe datele pe care le-a "văzut" deja, dar care eșuează lamentabil atunci când este confruntat cu date noi, nevăzute.

Pentru a înțelege mai bine, putem vizualiza o "frontieră de decizie" – curba imaginară pe care un clasificator o trasează pentru a separa diferite categorii de date. În cazul supraînvățării, această frontieră de decizie devine extrem de complexă și "șerpuitoare", adaptându-se perfect fiecărui punct din setul de antrenament, inclusiv excepțiilor și anomaliilor. Prin contrast, un model bine antrenat ar avea o frontieră de decizie mai lină, care surprinde tendințele generale fără a se agăța de fiecare detaliu.

Acest fenomen este adesea comparat cu un elev care memorează răspunsurile la un set de întrebări fără a înțelege cu adevărat conceptele. Când i se dau întrebări noi, chiar și pe aceeași temă, elevul nu este capabil să răspundă corect.

Cum Recunoaștem Supraînvățarea?

Cea mai clară indicație a supraînvățării este o discrepanță semnificativă între performanța modelului pe datele de antrenament și performanța sa pe datele de validare sau de test. Iată cum se manifestă de obicei:

- Acuratețea antrenamentului este mult mai mare decât acuratețea validării: Modelul face predicții aproape perfecte pe datele cu care a fost antrenat, dar precizia scade dramatic atunci când este testat pe date noi.

- Pierderea (loss) antrenamentului este mult mai mică decât pierderea validării: Funcția de cost, care măsoară "eroarea" modelului, scade continuu pe setul de antrenament, dar începe să crească sau rămâne ridicată pe setul de validare. Aceasta este o alertă roșie, indicând că modelul învață zgomotul din datele de antrenament și nu generalizează.

Este esențial să monitorizăm ambele metrici pe parcursul antrenamentului. O curbă de pierdere a antrenamentului care scade constant, în timp ce curba de pierdere a validării începe să crească după un anumit punct, este o dovadă clară de supraînvățare.

Importanța Validării Încrucișate (Cross-Validation)

Identificarea supraînvățării este crucială, iar aici intervine rolul vital al validării încrucișate. Fără un set de validare dedicat, separat de datele de antrenament, nu am putea niciodată să detectăm că modelul nostru nu reușește să generalizeze. Am fi induși în eroare de performanța aparent excelentă pe datele de antrenament.

Validarea încrucișată implică împărțirea setului total de date în mai multe subseturi. O parte este folosită pentru antrenament, iar o altă parte, nevăzută de model în timpul antrenamentului, este folosită pentru validare. Acest proces poate fi repetat de mai multe ori, cu diferite împărțiri ale datelor, pentru a obține o estimare mai robustă a performanței modelului pe date noi. Este ca și cum am testa atletul nostru nu doar la antrenamente, ci și în simulări de competiții cu adversari și condiții diferite, pentru a vedea dacă abilitățile sale sunt cu adevărat adaptabile.

Strategii Eficiente de Combatere a Supraînvățării

Odată ce am identificat supraînvățarea, următorul pas este să o combatem. Există mai multe tehnici eficiente, dintre care două se remarcă prin simplitatea și eficacitatea lor: regularizarea și dropout-ul.

1. Regularizarea: Ghidarea Modelului Spre Simplitate

Regularizarea este o tehnică puternică ce vizează prevenirea supraînvățării prin ghidarea modelului către o soluție mai simplă și mai generalizabilă. Principiul de bază este de a adăuga un termen de penalizare la funcția de cost a modelului. Această penalizare crește odată cu complexitatea modelului, descurajând rețeaua să devină prea specifică datelor de antrenament.

Imaginați-vă că antrenați un câine. Pe lângă recompensarea comportamentelor dorite, îl și pedepsiți (într-un mod blând) pentru comportamentele nedorite. Regularizarea funcționează similar: modelul este recompensat pentru predicții corecte și "penalizat" pentru a deveni prea complex.

Există mai multe forme de regularizare, dar cele mai comune sunt regularizarea L1 (Lasso) și L2 (Ridge sau Weight Decay). Ambele funcționează prin adăugarea unui termen la funcția de pierdere care depinde de magnitudinea greutăților (ponderilor) rețelei neuronale:

- Regularizarea L2: Adaugă la funcția de pierdere suma pătratelor greutăților. Aceasta încurajează greutățile să fie mici, dar nu neapărat zero. Greutățile mici înseamnă că niciun singur "neuron" sau caracteristică nu domină decizia, ceea ce duce la un model mai robust și mai puțin sensibil la zgomotul din date. Prin micșorarea greutăților, se reduce impactul caracteristicilor mai puțin relevante, lăsând loc "camerei de manevră" necesare generalizării.

- Regularizarea L1: Adaugă la funcția de pierdere suma valorilor absolute ale greutăților. Aceasta are un efect de "selecție a caracteristicilor", deoarece tinde să împingă unele greutăți exact la zero, eliminând practic influența anumitor neuroni sau conexiuni. Acest lucru poate simplifica și mai mult modelul.

Parametrul lambda (λ) controlează intensitatea regularizării. O valoare mai mare a lui lambda înseamnă o penalizare mai puternică pentru complexitate, forțând modelul să fie mai simplu, dar posibil sub-antrenat. O valoare prea mică ar putea să nu aibă suficient efect asupra supraînvățării. Găsirea valorii optime a lui lambda este adesea un proces de experimentare.

2. Dropout: O Metodă Aleatorie și Eficientă

Dropout este o altă tehnică ingenioasă și larg utilizată pentru a combate supraînvățarea. Aceasta implică "ignorarea" aleatorie a unei fracțiuni din unitățile de intrare (neuroni) dintr-un strat al rețelei neuronale în timpul fiecărui pas de antrenament. Este ca și cum, la fiecare sesiune de antrenament, o parte dintre "sportivi" (neuroni) sunt lăsați pe bancă, forțând echipa (rețeaua) să se bazeze pe o configurație diferită.

Există două intuiții principale pentru care dropout-ul ajută la prevenirea supraînvățării:

- Învățare de tip Ansamblu (Ensemble Learning): Dropout-ul poate fi văzut ca o formă de învățare de tip ansamblu. La fiecare iterație de antrenament, o sub-rețea diferită (formată din neuronii rămași activi) este antrenată. Fiecare dintre aceste sub-rețele poate fi considerată un "clasificator slab". La momentul validării sau predicției, întreaga rețea este utilizată, iar rezultatele sunt combinate, în esență, ca o medie a predicțiilor tuturor acestor clasificatori slabi. Un ansamblu de clasificatori slabi este adesea mult mai robust decât un singur clasificator puternic, dar supra-specializat.

- Prevenirea Co-adaptării Neuronilor: Dropout-ul forțează fiecare neuron să învețe caracteristici mai robuste și independente, deoarece nu se poate baza pe existența anumitor alți neuroni pentru a compensa. Altfel spus, previne "co-adaptarea" excesivă a neuronilor, unde doi sau mai mulți neuroni ar putea deveni dependenți unul de celălalt pentru a detecta o anumită caracteristică specifică doar datelor de antrenament. Prin "dezactivarea" aleatorie, se asigură că nicio caracteristică sau neuron nu devine prea influent, evitând astfel concentrarea rețelei pe artefacte specifice doar setului de antrenament.

Un parametru cheie în dropout este rata de dropout, care specifică proporția de neuroni care vor fi "dezactivați" la fiecare pas. O rată tipică este între 0.2 și 0.5. Prea mult dropout poate duce la sub-antrenare, în timp ce prea puțin ar putea să nu aibă un impact suficient.

Tabel Comparativ: Regularizare vs. Dropout

Deși ambele tehnici combat supraînvățarea, ele o fac prin mecanisme diferite și pot fi folosite complementar.

| Caracteristică | Regularizare (L1/L2) | Dropout |

|---|---|---|

| Mecanism Principal | Adaugă o penalizare la funcția de cost bazată pe magnitudinea greutăților. | Dezactivează aleatoriu neuroni în timpul antrenamentului. |

| Efect Asupra Greutăților | Reduce magnitudinea greutăților (L2) sau le duce la zero (L1). | Forțează neuronii să învețe caracteristici mai robuste și independente. |

| Simplificare Model | Ghidează modelul spre o soluție cu greutăți mai mici, mai simplă. | Creează un ansamblu implicit de sub-rețele, prevenind co-adaptarea. |

| Complexitate Matematică | Implică adăugarea unui termen la funcția de pierdere. | Implica dezactivarea aleatorie, nu modifică funcția de pierdere direct. |

| Când se Aplică | La fiecare pas de optimizare, influențând actualizarea greutăților. | Doar în timpul antrenamentului; întreaga rețea este activă la inferență. |

Întrebări Frecvente (FAQ)

Ce se întâmplă dacă o rețea neuronală "învață prea bine"?

Dacă o rețea neuronală "învață prea bine", aceasta înseamnă că a suferit de supraînvățare (overfitting). Va excela în performanță pe datele de antrenament, dar va fi ineficientă și inexactă atunci când va fi expusă la date noi, nevăzute. Practic, modelul a memorat datele de antrenament în loc să învețe tiparele generale, devenind inutilizabil în aplicații practice.

Care este diferența dintre supraînvățare (overfitting) și subînvățare (underfitting)?

Supraînvățarea apare când modelul este prea complex și învață zgomotul din datele de antrenament, performând slab pe date noi. Subînvățarea apare când modelul este prea simplu și nu reușește să capteze tiparele esențiale din datele de antrenament, având o performanță slabă atât pe datele de antrenament, cât și pe cele de validare. Supraînvățarea este un model cu "prea multă memorie", în timp ce subînvățarea este un model cu "prea puțină înțelegere".

Pot folosi atât regularizarea, cât și dropout-ul simultan?

Da, absolut! Regularizarea și dropout-ul abordează supraînvățarea prin mecanisme diferite și adesea complementare. Utilizarea lor combinată poate oferi o apărare și mai robustă împotriva supraînvățării, ducând la modele și mai generalizabile și mai performante. Multe arhitecturi de rețele neuronale moderne folosesc ambele tehnici.

Cât de importantă este validarea încrucișată pentru combaterea supraînvățării?

Validarea încrucișată este fundamentală, nu doar pentru combaterea supraînvățării, ci pentru evaluarea corectă a oricărui model de învățare automată. Fără un set de validare separat, nu am avea un indicator fiabil al performanței modelului pe date nevăzute și nu am putea detecta supraînvățarea. Este singura modalitate de a ne asigura că modelul nostru este cu adevărat util și nu doar un "memorator" de date.

Există și alte metode de a combate supraînvățarea?

Da, pe lângă regularizare și dropout, există și alte metode, cum ar fi:

- Augmentarea datelor: Creșterea artificială a volumului de date de antrenament prin transformări minore (rotații, scalări, inversări etc.) ale datelor existente.

- Oprirea timpurie (Early Stopping): Monitorizarea performanței pe setul de validare și oprirea antrenamentului atunci când performanța pe validare începe să se deterioreze, chiar dacă performanța pe antrenament continuă să se îmbunătățească.

- Reducerea complexității modelului: Utilizarea unei arhitecturi de rețea mai simple (mai puține straturi, mai puțini neuroni pe strat) dacă datele nu justifică o rețea foarte profundă.

Concluzie

Supraînvățarea este o provocare comună, dar critică, în dezvoltarea modelelor de învățare automată. Ignorarea ei poate duce la modele care, deși par impresionante în timpul antrenamentului, sunt total inutile în aplicații reale. Prin înțelegerea și aplicarea corectă a unor tehnici precum regularizarea și dropout-ul, combinate cu o validare încrucișată riguroasă, putem construi rețele neuronale nu doar "inteligente", ci și cu adevărat generalizabile. Scopul final este crearea de modele care nu doar memorizează, ci înțeleg și pot aplica cunoștințele dobândite în situații noi, exact ca un atlet bine antrenat, pregătit pentru orice provocare, nu doar pentru una specifică.

Dacă vrei să descoperi și alte articole similare cu Rețeaua Neuronală Învață Prea Bine?, poți vizita categoria Fitness.