24/03/2026

Când vine vorba de învățare automată și învățare profundă (deep learning), mulți se gândesc automat la Python, limbajul dominant în aceste domenii. Cu toate acestea, R s-a impus încet, dar sigur, ca un instrument extrem de puternic, în special pentru statisticienii și oamenii de știință ai datelor care sunt deja familiarizați cu acest ecosistem. Rețelele neuronale în R ar putea să nu fie primul lucru care îți vine în minte, dar iată o surpriză: integrarea R cu biblioteci precum Keras și TensorFlow oferă aceleași capabilități de învățare profundă ca și Python. Mai mult, sintaxa concisă a R și puterea sa statistică îl fac o opțiune atractivă pentru proiecte complexe, în special pentru data scientists experimentați.

De ce să alegi R pentru rețele neuronale? R oferă mai multe pachete native precum nnet și neuralnet care îți permit să construiești rețele neuronale de la zero. Dar dacă vrei să valorifici potențialul maxim al framework-urilor de deep learning precum TensorFlow, R poate fi cel mai bun prieten al tău. Pachetele precum keras și tensorflow fac R la fel de puternic ca Python în ceea ce privește învățarea profundă, oferind totul, de la rețele feedforward simple la arhitecturi mai complexe precum CNN-uri (rețele neuronale convoluționale) și RNN-uri (rețele neuronale recurente). S-ar putea să te întrebi: De ce să alegi R când Python este atât de popular? Răspunsul constă în flexibilitatea R și legăturile sale strânse cu comunitatea statistică. Cu R, poți combina fără probleme modelarea statistică și fluxurile de lucru de învățare automată. În plus, mulți oameni de știință ai datelor experimentați, în special cei cu un background academic, consideră R mai intuitiv pentru manipulări și vizualizări complexe ale datelor.

Un Proiect Practic: Predicția Retenției Clienților

Să ne scufundăm într-un proiect real care poate face legătura între teorie și practică. Imaginează-ți că suntem însărcinați cu predicția retenției clienților pentru o companie de telecomunicații. Probabil ai mai întâlnit acest caz de utilizare — este un clasic în știința datelor. Dar iată de ce este perfect: este bogat în date categorice, caracteristici numerice și este o problemă de clasificare binară, ceea ce o face ideală pentru a demonstra flexibilitatea rețelelor neuronale în R. Te vom ghida prin tot, de la încărcarea setului de date până la construirea, antrenarea și implementarea unei rețele neuronale folosind R. Până la sfârșitul acestui ghid, vei putea aplica aceste tehnici propriilor proiecte — fie că este vorba de retenția clienților, clasificarea imaginilor sau prognoza seriilor de timp.

Ce vei învăța?

În acest ghid, nu doar că îți voi arăta cum să construiești o rețea neuronală. Vei înțelege cum să abordezi problemele de date din lumea reală folosind R, cum să-ți structurezi eficient modelele de rețele neuronale și cum să efectuezi totul, de la preprocesarea datelor la implementarea modelului. Iată ce vei dobândi:

- Cum să încarci, explorezi și preprocesezi un set de date real în R.

- Arhitectura unei rețele neuronale potrivite pentru problema ta.

- Cum să antrenezi, ajustezi și evaluezi modelul tău, inclusiv optimizarea hiperparametrilor.

- Tehnici pentru implementarea modelului tău într-un mediu de producție.

Selectarea și Preprocesarea Setului de Date

Pentru a face acest lucru cât mai practic posibil, vom folosi un set de date de retenție a clienților de pe Kaggle. Motivul pentru care am selectat acest set de date este simplu: este o problemă clasică de învățare supervizată cu suficientă complexitate pentru a ne provoca, dar suficient de simplă pentru a ne permite să ne concentrăm pe implementarea rețelei neuronale, în loc să petrecem prea mult timp cu curățarea datelor. De ce retenție? Deoarece retenția clienților este o problemă de miliarde de dolari în industrii precum telecomunicațiile, asigurările și SaaS. Predictia dacă un client va pleca sau va rămâne pe baza tiparelor de utilizare, reclamațiilor și informațiilor demografice este o problemă de afaceri cu impact ridicat, care beneficiază în mare măsură de rețelele neuronale. Setul de date poate fi găsit aici: Kaggle: Customer Churn Dataset. Asigură-te că îl descarci, deoarece vom începe cu el!

Încărcarea și Explorarea Datelor în R

Primul pas: să aducem acest set de date în R și să începem să-l explorăm. Iată cum îl încarci folosind dplyr și readr.

# Încărcarea bibliotecilor necesare library(dplyr) library(readr) library(ggplot2) # Încărcarea setului de date churn_data <- read_csv('Telco-Customer-Churn.csv') # O privire rapidă asupra datelor glimpse(churn_data) # Sumarizarea numărului de cazuri de retenție churn_data %>% group_by(Churn) %>% summarize(count = n()) În acest fragment de cod, importăm pachetul readr pentru a încărca fișierul CSV și folosim dplyr pentru a efectua o explorare rapidă. Funcția glimpse() îți oferă o privire asupra structurii setului de date, iar funcția group_by() îți permite să verifici eventualele dezechilibre de clasă (important pentru antrenarea modelului!).

Sfat de explorare: După încărcarea datelor, este important să le vizualizezi. Iată cum poți vizualiza distribuția caracteristicilor numerice:

# Vizualizarea vechimii (tenure) vs. retenție (churn) ggplot(churn_data, aes(x = tenure, fill = Churn)) + geom_histogram(position = 'dodge', bins = 30) + theme_minimal() Această histogramă îți permite să compari cât de diferită este variabila 'tenure' între clienții care renunță și cei care nu renunță. Vizualizarea este esențială pentru a te familiariza cu datele înainte de a te scufunda în rețeaua neuronală.

Preprocesarea Datelor

Aceasta este secțiunea unde se întâmplă magia. Pentru ca rețelele neuronale să funcționeze bine, ai nevoie de date curate, bine preprocesate. Preprocesarea este un pas crucial, deoarece calitatea datelor de intrare influențează direct performanța și acuratețea modelului.

- Scalarea Caracteristicilor (Feature Scaling): Rețelele neuronale prosperă pe date normalizate. Scalarea ajută algoritmii de optimizare, cum ar fi descendența gradientului, să converge mai rapid. Fără scalare, caracteristicile cu valori mari pot domina pe cele cu valori mici, indiferent de importanța lor reală. Vom standardiza caracteristicile numerice (transformarea lor pentru a avea o medie de 0 și o deviație standard de 1), o tehnică cunoscută sub numele de standardizare Z-score. Aceasta asigură că toate caracteristicile numerice contribuie proporțional la procesul de învățare.

- Gestionarea Datelor Lipsă (Handling Missing Data): Vei găsi adesea valori lipsă în seturile de date din lumea reală. Ignorarea lor poate duce la erori sau la pierderea de informații valoroase. În acest caz, vom imputa valorile lipsă din coloana

TotalChargescu mediana. Mediana este o alegere robustă pentru imputare, deoarece este mai puțin sensibilă la valorile aberante decât media. - Codificarea Variabilelor Categorice (Encoding Categorical Variables): Variabilele categorice precum

gender,ContractșiPaymentMethodtrebuie codificate numeric, deoarece rețelele neuronale lucrează cu numere. Vom folosi codificarea one-hot (One-Hot Encoding - OHE). OHE creează noi coloane binare (0 sau 1) pentru fiecare categorie unică, evitând astfel crearea unei ordini artificiale între categorii, ceea ce ar putea induce în eroare modelul. Iată cum poți face acest lucru folosind pachetulrecipes, care oferă un flux de lucru elegant și coerent pentru preprocesare.

# Codificarea one-hot a variabilelor categorice library(recipes) rec <- recipe(Churn ~ ., data = churn_data) %>% step_dummy(all_nominal(), -all_outcomes()) # Pregătirea și aplicarea "rețetei" churn_data_preprocessed <- prep(rec) %>% bake(new_data = churn_data) - Împărțirea Datelor (Splitting the Data): În cele din urmă, vom împărți setul de date în seturi de antrenament, validare și testare. Această împărțire este esențială pentru a evalua performanța modelului într-un mod imparțial și pentru a preveni supraînvățarea (overfitting). Vom folosi o împărțire de 80/10/10. Setul de antrenament este folosit pentru a antrena modelul, setul de validare pentru a ajusta hiperparametrii și a monitoriza performanța în timpul antrenamentului, iar setul de testare pentru o evaluare finală, nedeformată, a performanței modelului pe date nevăzute.

# Împărțirea datelor set.seed(123) # Pentru reproductibilitate train_index <- sample(1:nrow(churn_data_preprocessed), 0.8 * nrow(churn_data_preprocessed)) train_data <- churn_data_preprocessed[train_index, ] test_data <- churn_data_preprocessed[-train_index, ] # Împărțirea ulterioară a datelor de antrenament în seturi de antrenament și validare val_index <- sample(1:nrow(train_data), 0.1 * nrow(train_data)) val_data <- train_data[val_index, ] train_data <- train_data[-val_index, ] Până acum, ar trebui să ai un set de date perfect preprocesat, gata de a fi alimentat unei rețele neuronale. De la standardizarea valorilor numerice la codificarea variabilelor categorice și gestionarea datelor lipsă, am acoperit toți pașii necesari de preprocesare pentru a ne asigura că modelul nostru învață eficient.

Cum Învață o Rețea Neuronală?

O rețea neuronală este un sistem de calcul inspirat de structura și funcționarea creierului uman. Este o colecție de unități de intrare/ieșire interconectate, fiecare conexiune având o greutate asociată. Rețeaua învață prin modificarea acestor greutăți pentru a prezice cu exactitate eticheta clasei pentru intrările furnizate pe parcursul fazei de învățare.

Mecanismul de Învățare:

- Propagarea Înainte (Forward Propagation): Datele de intrare sunt transmise prin rețea, de la stratul de intrare, prin unul sau mai multe straturi ascunse, până la stratul de ieșire. La fiecare nod (neuron), se efectuează o sumă ponderată a intrărilor, la care se adaugă un termen de bias, iar rezultatul este trecut printr-o funcție de activare (de exemplu, logistică/sigmoid, ReLU). Aceasta determină „activarea” neuronului și valoarea pe care o transmite mai departe.

- Funcția de Pierdere (Loss Function): La stratul de ieșire, predicția rețelei este comparată cu valoarea reală. Funcția de pierdere (sau cost) măsoară eroarea dintre predicție și valoarea țintă. Scopul antrenamentului este de a minimiza această pierdere.

- Propagarea Înapoi (Backpropagation): Eroarea calculată de funcția de pierdere este apoi propagată înapoi prin rețea, de la stratul de ieșire spre stratul de intrare. Pe parcurs, algoritmul calculează gradientul (rata de schimbare a pierderii în raport cu greutățile) pentru fiecare greutate din rețea.

- Optimizare (Optimization): Folosind acești gradienți, un algoritm de optimizare (precum Descendența Gradientului Stochastic - SGD sau Adam) ajustează greutățile și bias-urile din rețea. Aceste ajustări sunt făcute într-o direcție care reduce funcția de pierdere. Acest proces iterativ (propagare înainte, calculul pierderii, propagare înapoi, optimizare) se repetă pe parcursul mai multor epoci (treceri complete prin setul de antrenament) până când modelul converge sau performanța sa nu se mai îmbunătățește semnificativ.

Antrenarea unei Rețele Neuronale Simple în R

Vom antrena o rețea neuronală simplă folosind pachetul neuralnet în R. Exemplul de mai jos este pentru o problemă de clasificare binară, similară cu predicția retenției clienților, dar cu un set de date simplificat.

Pasul 1: Definirea setului de antrenament

# Crearea setului de date de antrenament Sci = c(70,71,72,73,68,69,65,69,80,68) Mat = c(91,92,93,94,65,69,61,55,91,79) Eng = c(82,83,84,85,73,66,50,62,95,68) Pass = c(1,1,1,1,0,0,0,0,1,0) df = data.frame(Sci, Mat, Eng, Pass) Creăm un exemplu de dataframe cu trei subiecte – Știință, Matematică, Engleză – și o coloană Pass care indică dacă studentul a trecut sau nu examenul (1 pentru promovat, 0 pentru eșuat). Modelul ar trebui să poată prezice dacă studentul va promova sau va eșua.

Pasul 2: Instalarea și încărcarea pachetului neuralnet

# Instalarea și încărcarea pachetului neuralnet install.packages("neuralnet") library("neuralnet") Pasul 3: Potrivirea rețelei neuronale

# Potrivirea modelului nn = neuralnet(Pass ~ Sci + Mat + Eng, data = df, hidden = 3, act.fct = "logistic", linear.output = FALSE) Aici:

Pass ~ Sci + Mat + Eng:Passeste variabila țintă (eticheta), iarSci,Mat,Engsunt caracteristicile (variabilele de intrare).data = df: Specifica setul de date.hidden = 3: Definește arhitectura rețelei. Aici, indică un singur strat ascuns cu 3 neuroni. Poți specifica mai multe straturi ascunse prin furnizarea unui vector (de exemplu,hidden = c(5, 3)pentru două straturi cu 5 și respectiv 3 neuroni).act.fct = "logistic": Setează funcția de activare pentru neuronii din straturile ascunse la funcția logistică (sigmoid). Aceasta este adesea folosită în probleme de clasificare binară, deoarece produce ieșiri între 0 și 1, care pot fi interpretate ca probabilități.linear.output = FALSE: Specifică faptul că stratul de ieșire nu trebuie să utilizeze o funcție de activare liniară. Pentru probleme de clasificare, vrei ca ieșirea să fie o probabilitate, deciFALSEeste alegerea corectă atunci când folosești o funcție de activare non-liniară la ieșire (implicit sau prinact.fctaplicată și la ieșire dacă nu este specificat altfel pentru stratul de ieșire).

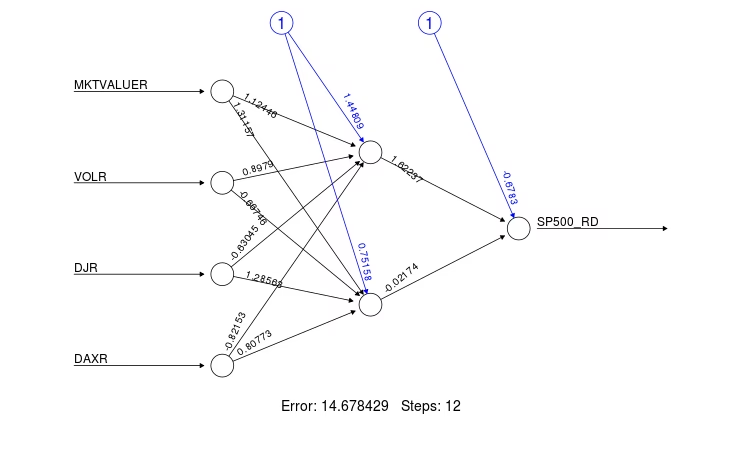

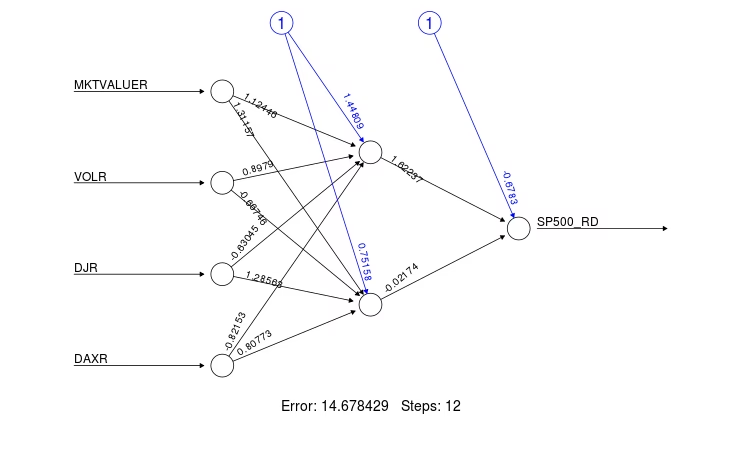

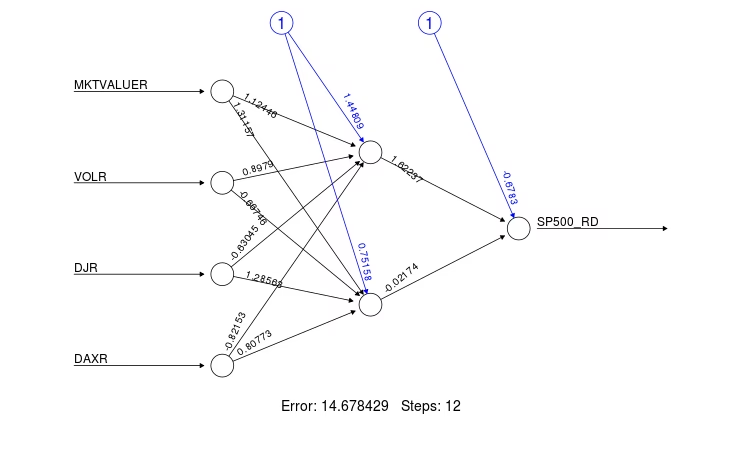

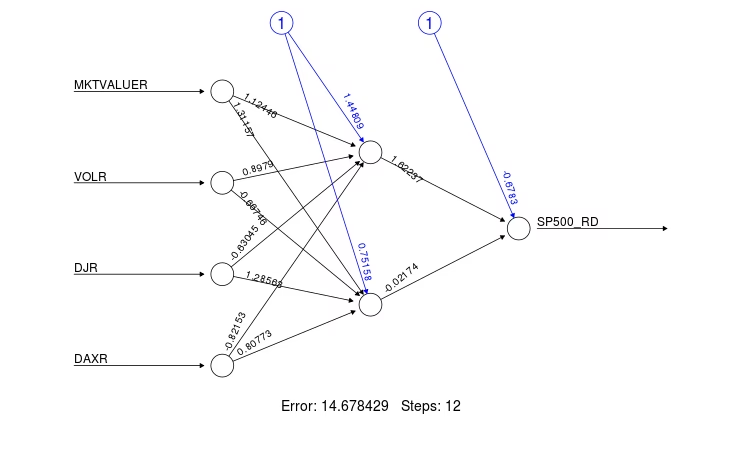

Pasul 4: Vizualizarea rețelei neuronale

plot(nn) Această funcție generează o diagramă vizuală a rețelei neuronale antrenate, arătând straturile, neuronii și greutățile conexiunilor. Este un instrument excelent pentru a înțelege structura modelului tău.

Pasul 5: Crearea unui set de date de testare

# Crearea setului de testare sci = c(80,75,65,68) mat = c(95,92,69,45) eng = c(85,83,55,50) test = data.frame(sci, mat, eng) Pasul 6: Prezicerea rezultatelor pentru setul de testare

# Prezicere predict = compute(nn, test) predict$net.result probab <- predict$net.result # Convertirea probabilităților în 1 și 0 (clasificare binară) pre <- ifelse(probab > 0.5, 1, 0) pre [,1] [1,] 1 [2,] 1 [3,] 1 [4,] 0 Ieșirea prezisă pentru setul de testare este 1, 1, 1, 0. Rețeaua neuronală poate fi folosită în mod similar pentru a face predicții pentru seturi de date reale.

Cum să Găsești Acuratețea unui Model de Rețea Neuronală în R?

Acuratețea este o metrică fundamentală de evaluare a modelului, reprezentând proporția de predicții corecte dintr-un total de predicții. Este deosebit de utilă în problemele de clasificare unde clasele sunt echilibrate. Putem folosi funcția sum pentru a găsi numărul de valori TRUE (predicții corecte) și a-l împărți la numărul total de eșantioane pentru a obține acuratețea.

Să presupunem că ai un set de date de testare cu etichete reale și predicțiile modelului tău. Iată cum ai calcula acuratețea:

# Presupunem că 'true_labels' sunt etichetele reale din setul de testare # și 'predicted_labels' sunt predicțiile generate de model (în format 0/1) true_labels <- c(1, 1, 0, 1, 0, 0, 1, 0, 1, 1) # Exemplu de etichete reale predicted_labels <- c(1, 1, 0, 0, 0, 1, 1, 0, 1, 1) # Exemplu de predicții ale modelului # Calcularea numărului de predicții corecte correct_predictions <- sum(true_labels == predicted_labels) # Calcularea acurateței accuracy <- correct_predictions / length(true_labels) cat("Acuratețea modelului este: ", round(accuracy * 100, 2), "% ") În acest exemplu, modelul a prezis cu o anumită acuratețe. Este important de reținut că, în cazul seturilor de date dezechilibrate (cum ar fi cele de retenție a clienților, unde majoritatea clienților nu renunță), acuratețea singură poate fi o metrică înșelătoare. În astfel de cazuri, este crucial să se ia în considerare și alte metrici de evaluare, cum ar fi:

- Precizia (Precision): Proporția de predicții pozitive corecte din toate predicțiile pozitive. Utile atunci când costul falsurilor pozitive este mare.

- Rechemarea (Recall) / Sensibilitatea: Proporția de predicții pozitive corecte din toate cazurile pozitive reale. Utile atunci când costul falsurilor negative este mare (de exemplu, ratarea unui client care va renunța).

- Scorul F1 (F1-Score): Media armonică a preciziei și rechemării, oferind un echilibru între cele două.

- Curba ROC și AUC (Area Under the Curve): O metodă grafică de evaluare a performanței clasificatorului la diferite praguri de clasificare. AUC oferă o măsură agregată a performanței modelului.

Utilizarea unei combinații de metrici oferă o imagine mai completă și mai robustă a performanței modelului tău de rețea neuronală.

Considerații Avansate și Optimizări

Pentru a construi modele de rețele neuronale robuste și performante, există câteva aspecte avansate de luat în considerare:

- Optimizarea Hiperparametrilor: Performanța unei rețele neuronale depinde în mare măsură de hiperparametri precum rata de învățare (learning rate), numărul de straturi ascunse, numărul de neuroni per strat, dimensiunea lotului (batch size) și numărul de epoci. Ajustarea acestora necesită experimentare. Tehnici precum căutarea în grilă (Grid Search) sau căutarea aleatorie (Random Search) pot automatiza acest proces.

- Gestionarea Supraînvățării (Overfitting): Supraînvățarea apare atunci când modelul învață prea bine datele de antrenament, inclusiv zgomotul, și nu generalizează bine pe date noi. Tehnici de regularizare precum Dropout (dezactivarea aleatorie a neuronilor în timpul antrenamentului) sau regularizarea L1/L2 (adăugarea unui termen de penalizare la funcția de pierdere) pot ajuta la prevenirea supraînvățării.

- Arhitecturi Complexe: Pentru probleme mai complexe, cum ar fi clasificarea imaginilor sau procesarea limbajului natural, se folosesc arhitecturi specializate: Rețele Neuronale Convoluționale (CNNs) pentru imagini și Rețele Neuronale Recurente (RNNs) sau Transformere pentru date secvențiale. R, prin integrarea cu Keras și TensorFlow, permite construirea și antrenarea acestor modele avansate.

- Implementarea Modelului: După ce ai antrenat și validat un model performant, următorul pas este implementarea sa pentru a face predicții pe date noi, în timp real sau aproape real. Acest lucru implică salvarea modelului antrenat și integrarea sa într-o aplicație web, un serviciu API sau un sistem de baze de date.

Întrebări Frecvente (FAQ)

- De ce R și nu Python pentru rețele neuronale?

- R este o alegere excelentă pentru rețele neuronale, mai ales dacă ai deja un background în statistică și analiză de date în R. Oferă instrumente puternice pentru preprocesare, vizualizare și modelare statistică, iar prin pachete precum

kerasșitensorflow, ajunge la paritate cu Python pentru capabilități de deep learning. Alegerea depinde de preferințele personale, ecosistemul existent și cerințele specifice ale proiectului. - Ce pachete sunt esențiale pentru rețele neuronale în R?

- Pentru rețele neuronale de bază,

neuralnetșinnetsunt pachete native excelente. Pentru deep learning avansat,kerasșitensorflowsunt indispensabile, oferind acces la arhitecturi complexe și antrenament pe GPU. Pachete de preprocesare cadplyr,readr,recipesși de vizualizare caggplot2sunt de asemenea cruciale. - Cum gestionez supraînvățarea (overfitting) în R?

- Există mai multe tehnici: Dropout (disponibil în Keras/TensorFlow), regularizarea L1/L2, oprirea timpurie (early stopping) bazată pe performanța pe setul de validare, și creșterea dimensiunii setului de date de antrenament. O bună preprocesare și o arhitectură de rețea adecvată pot, de asemenea, reduce riscul de supraînvățare.

- Este R potrivit pentru deep learning la scară mare?

- Da, prin integrarea sa cu Keras și TensorFlow, R poate gestiona sarcini de deep learning la scară mare, inclusiv antrenament pe GPU. Performanța va depinde de infrastructura hardware disponibilă și de optimizarea codului, similar cu Python. R oferă instrumentele necesare pentru a aborda proiecte complexe, cu volume mari de date.

Acest ghid te-a condus prin aspectele esențiale ale utilizării R pentru rețele neuronale, de la înțelegerea conceptelor fundamentale până la implementarea practică. Sperăm că ai obținut o perspectivă clară asupra puterii și flexibilității pe care R le oferă în domeniul învățării automate și că te simți pregătit să aplici aceste cunoștințe în propriile tale proiecte.

Dacă vrei să descoperi și alte articole similare cu R pentru Retele Neuronale: Ghidul Complet, poți vizita categoria Fitness.