23/07/2022

La fel cum un atlet își antrenează corpul pentru a atinge performanțe de vârf, o rețea neurală artificială necesită un proces riguros de antrenament pentru a-și îndeplini sarcinile cu precizie și eficiență. Acesta este momentul magic în care o structură brută de neuroni virtuali prinde viață, învățând din date pentru a identifica modele, a face predicții sau a lua decizii. În lumea inteligenței artificiale, antrenamentul este inima oricărui sistem performant, transformând potențialul brut în capacitate reală. Să explorăm în detaliu ce înseamnă antrenarea unei rețele neurale și cum funcționează acest proces esențial.

- Ce Este Antrenarea unei Rețele Neurale?

- Tipuri de Învățare în Rețelele Neurale

- Generalizarea și Seturile de Date

- Cadrul de Optimizare pentru Antrenare

- Metode de Optimizare Basate pe Gradient

- Antrenarea Stocastică și Mini-batch

- Calculul Derivatelor: Diferențierea Automată și Retropropagarea

- Criterii de Oprire a Antrenamentului

- Puncte Cheie în Antrenarea Rețelelor Neurale

- Întrebări Frecvente despre Antrenarea Rețelelor Neurale

- De ce este antrenarea esențială pentru rețelele neurale?

- Care este diferența dintre învățarea supervizată și cea nesupervizată?

- Ce este o funcție de pierdere și de ce este importantă?

- Cum funcționează descensul gradientului?

- Ce este rata de învățare și cum o aleg?

- Ce este retropropagarea (backpropagation)?

- De ce este importantă generalizarea?

- Care sunt principalele metode de optimizare avansate?

- Ce este antrenarea mini-batch?

- Cum știu când să opresc antrenamentul?

Ce Este Antrenarea unei Rețele Neurale?

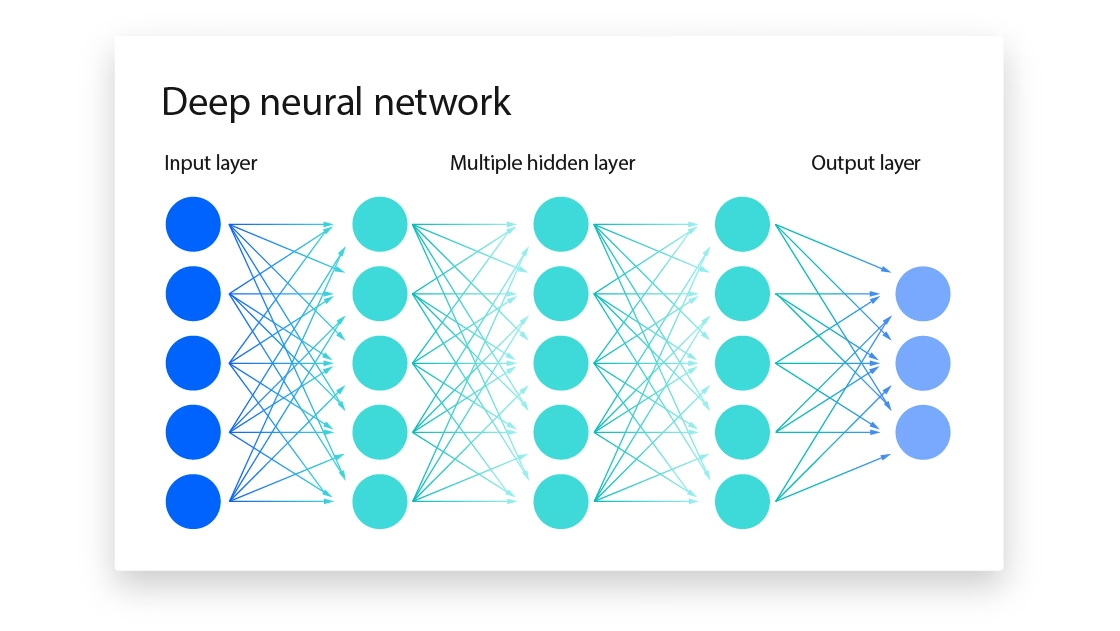

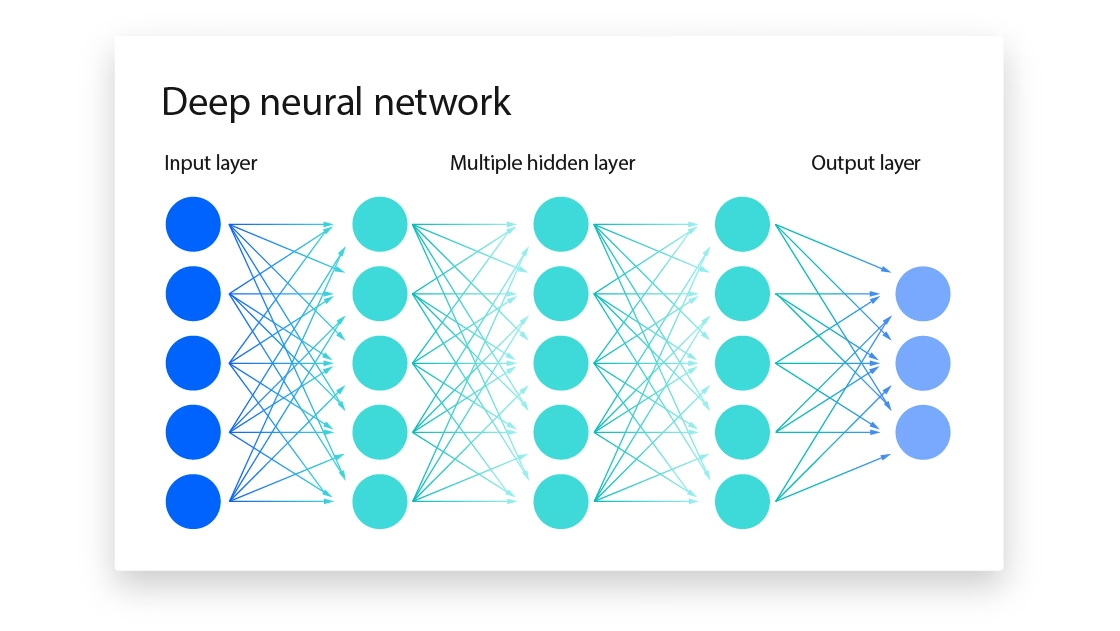

După ce o structură adecvată a rețelei neurale a fost selectată, pasul următor crucial este determinarea valorilor parametrilor săi – greutățile și bias-urile – pentru a obține comportamentul dorit de intrare-ieșire. Acest proces de modificare a parametrilor este denumit, în contextul rețelelor neurale, învățare sau antrenament. Algoritmul de învățare al unei rețele neurale artificiale (RNA) este o secvență de acțiuni care modifică acești parametri, astfel încât rețeaua să poată rezolva o anumită sarcină specifică. Fără un antrenament adecvat, o rețea neurală este doar o colecție goală de conexiuni, incapabilă să genereze rezultate semnificative.

Tipuri de Învățare în Rețelele Neurale

Există mai multe abordări majore pentru problema învățării rețelelor neurale, fiecare cu particularitățile sale, adaptate la tipuri diferite de date și obiective:

- Învățarea nesupervizată (Unsupervised Learning)

- Învățarea supervizată (Supervised Learning)

- Învățarea prin consolidare (Reinforcement Learning)

Învățarea Nesupervizată

În cazul învățării nesupervizate, rețelei i se oferă doar intrările, fără a exista valori de ieșire predefinite sau "etichete" corecte. Scopul este de a descoperi modele inerente sau structuri ascunse în setul de date. Această abordare este aplicată de obicei problemelor de grupare (clustering) și de reducere a dimensionalității datelor, unde rețeaua învață să organizeze informația pe cont propriu.

Învățarea Supervizată

Învățarea supervizată este, probabil, cea mai răspândită formă de antrenament și se află în centrul multor aplicații practice. Aici, comportamentul dorit al rețelei este definit explicit printr-un set de date de antrenament. Fiecare exemplu de antrenament asociază o intrare specifică cu o ieșire dorită corespunzătoare (etichetă). Scopul învățării este de a găsi acele valori ale parametrilor rețelei neurale, astfel încât ieșirile reale ale rețelei să fie cât mai apropiate de cele dorite. Această abordare este utilizată pe scară largă pentru probleme de clasificare, regresie și identificare de sistem. Textul furnizat se concentrează preponderent pe acest tip de învățare, subliniind importanța sa fundamentală.

Există, de asemenea, variații ale învățării supervizate:

- Învățarea incrementală: Dacă setul de date de antrenament nu este cunoscut în avans, ci este prezentat secvențial, câte un exemplu la un moment dat, iar rețeaua neurală trebuie să opereze și să învețe simultan, atunci se spune că efectuează învățare incrementală.

- Adaptarea: Dacă mediul este non-staționar, adică răspunsul dorit la o anumită intrare poate varia în timp, atunci setul de date de antrenament devine inconsecvent și o rețea neurală trebuie să se adapteze. Aici apare dilema stabilitate-plasticitate: o rețea lipsită de plasticitate nu se poate adapta rapid la schimbări, în timp ce una lipsită de stabilitate uită datele învățate anterior.

- Învățarea activă: Aceasta presupune că rețeaua neurală însăși este responsabilă pentru achiziția setului de date. Rețeaua selectează o nouă intrare și solicită unui sistem extern (de exemplu, un senzor) ieșirile dorite corespunzătoare acelei intrări. Astfel, rețeaua neurală este de așteptat să "exploreze" mediul interacționând cu acesta și să "exploateze" datele obținute minimizând un obiectiv. Găsirea unui echilibru între explorare și exploatare devine o problemă importantă.

Învățarea prin Consolidare

Învățarea prin consolidare duce ideea învățării active un pas mai departe, presupunând că sistemul extern nu poate oferi rețelei exemple de comportament dorit – în schimb, poate doar să evalueze comportamentul anterior al rețelei, oferind o "recompensă" sau "penalizare". Această abordare este aplicată de obicei problemelor de control inteligent și de luare a deciziilor, fiind la baza multor sisteme autonome și agenți de jocuri.

Iată o scurtă comparație a acestor tipuri de învățare:

| Tipul de Învățare | Date Necesare | Scop Principal | Exemple de Aplicații |

|---|---|---|---|

| Supervizată | Intrări și ieșiri etichetate | Prezicerea unei ieșiri pe baza intrărilor | Clasificare imagini, Regresie, Identificare sistem |

| Nesupervizată | Doar intrări (fără etichete) | Descoperirea structurilor și modelelor în date | Grupare (Clustering), Reducere dimensionalitate |

| Prin Consolidare | Mediu interactiv, sistem de recompense | Învățarea comportamentelor optime prin încercare-eroare | Robotică, Jocuri, Sisteme de control |

Generalizarea și Seturile de Date

Un aspect crucial al antrenamentului este generalizarea. Scopul real al învățării supervizate nu este de a obține o potrivire perfectă a predicțiilor cu datele de antrenament, ci de a efectua predicții extrem de precise pe date independente, necunoscute anterior, în timpul funcționării rețelei. O rețea care memorează doar datele de antrenament, fără a înțelege modelele subiacente, este inutilă în scenarii reale.

Pentru a evalua capacitatea de generalizare a unei rețele, toate datele experimentale disponibile sunt împărțite în cel puțin două subseturi:

- Setul de antrenament: Pe acest set, modelul învață și își ajustează parametrii.

- Setul de testare: După antrenament, modelul este evaluat pe acest set independent, pentru a măsura performanța sa pe date nevăzute.

Uneori, este rezervat și un al treilea subset, numit set de validare. Acesta este utilizat pentru a selecta hiperparametrii modelului (cum ar fi numărul de straturi sau neuroni) și pentru a monitoriza progresul antrenamentului și a preveni supraînvățarea (overfitting), un fenomen în care modelul performează excelent pe datele de antrenament, dar slab pe date noi.

Cadrul de Optimizare pentru Antrenare

În abordarea învățării supervizate, antrenamentul implică minimizarea unei funcții de eroare (numită și funcție obiectiv, funcție de pierdere sau funcție de cost). Aceasta reprezintă abaterea ieșirilor reale ale rețelei de la valorile lor dorite. Parametrii rețelei sunt reprezentați de un vector finit-dimensional W. Funcția totală de eroare Ē(W) este suma erorilor individuale pentru fiecare exemplu de antrenament. Problema de minimizare este una de optimizare neliniară fără constrângeri: minimizarea Ē(W) în raport cu W.

Pentru ca problema de minimizare să aibă sens, funcția de eroare trebuie să fie mărginită inferior. Minimizarea este realizată prin diverse metode numerice iterative. Aceste metode de optimizare pot fi împărțite în globale și locale, în funcție de tipul de minim pe care îl caută. Metodele de optimizare globală caută un minim global aproximativ, în timp ce metodele locale caută un minim local precis. Majoritatea metodelor de optimizare globală au o natură stocastică (de exemplu, recălire simulată, algoritmi evolutivi, optimizarea roiului de particule) și convergența este obținută aproape sigur și doar la limită. În antrenarea rețelelor neurale, se pune accent pe metodele de optimizare locale, deterministe, bazate pe gradient, care garantează o convergență rapidă către o soluție locală în condiții rezonabile. Pentru a aplica aceste metode, este necesar ca funcția de eroare să fie suficient de netedă, ceea ce este de obicei cazul cu rețelele neurale, cu condiția ca toate funcțiile de activare să fie netede. Metodele de optimizare locale necesită o estimare inițială W(0) pentru valorile parametrilor, care poate fi eșantionată dintr-o distribuție Gaussiană sau prin metode specifice, cum ar fi inițializarea Xavier.

Metode de Optimizare Basate pe Gradient

Metodele de optimizare pot fi clasificate și după ordinul derivatelor funcției de eroare utilizate pentru a ghida procesul de căutare:

- Metode de ordin zero: Folosesc doar valorile funcției de eroare.

- Metode de ordin întâi: Se bazează pe primele derivate (gradientul

∇Ē). - Metode de ordin doi: Utilizează și derivatele de ordin doi (Hessianul

∇²Ē).

Descensul Gradientului (Gradient Descent - GD)

Metoda fundamentală de descens are forma W(k+1) = W(k) + α(k)p(k), unde p(k) este o direcție de căutare și α(k) reprezintă lungimea pasului, numită și rata de învățare. Se cere ca fiecare pas să diminueze funcția de eroare. Pentru a garanta această scădere, direcția de căutare trebuie să fie o direcție de descens. Cel mai simplu exemplu de metodă de descens de ordin întâi este metoda descensului gradientului (GD), care utilizează direcția de căutare a gradientului negativ: p(k) = -∇Ē(W(k)).

Lungimile pasului pot fi atribuite în prealabil, dar dacă pasul α este prea mare, funcția de eroare ar putea crește, iar iterațiile ar diverge. Pe de altă parte, un pas α mic ar duce la o convergență lentă. Pentru a ocoli această problemă, se poate efectua o adaptare a lungimii pasului sau o căutare liniară pentru o lungime optimă a pasului, care oferă reducerea maximă posibilă a funcției de eroare de-a lungul direcției de căutare. Deși metoda GD este simplă, are o rată de convergență liniară, ceea ce o face lentă pentru probleme complexe.

Gradientul Conjugat Neliniar (Nonlinear Conjugate Gradient - CG)

O altă metodă importantă de ordin întâi este metoda gradientului conjugat neliniar (CG). Aceasta este o familie de metode care utilizează direcții de căutare de forma generală: p(0) = -∇Ē(W(0)), p(k) = -∇Ē(W(k)) + β(k)p(k-1). În funcție de alegerea scalarului β(k), se obțin mai multe variante ale metodei, cum ar fi Fletcher-Reeves, Polak-Ribière sau Hestenes-Stiefel. Pentru o funcție de eroare neliniară generală, rata de convergență este liniară; totuși, o funcție de eroare de două ori diferențiabilă cu Hessian nesingular este aproximativ pătratică în vecinătatea soluției, ceea ce duce la o convergență rapidă. Necesită, de asemenea, "restartări" periodice.

Metoda lui Newton

Metoda de bază de ordin doi este metoda lui Newton: p(k) = -[∇²Ē(W(k))]⁻¹ ∇Ē(W(k)). Dacă Hessianul este pozitiv definit, direcția de căutare rezultată este o direcție de descens. Pentru o funcție de eroare netedă, neliniară, cu Hessian pozitiv definit la soluție, convergența este pătratică, cu condiția ca estimarea inițială să fie suficient de aproape de soluție. Dacă un Hessian are valori proprii negative sau zero, trebuie modificat pentru a obține o aproximare pozitiv definită. Computarea Hessianului este foarte costisitoare din punct de vedere computațional, de aceea au fost propuse diverse aproximări.

Variantele precum aproximarea Gauss-Newton și metoda Levenberg-Marquardt sunt derivate din metoda lui Newton, simplificând calculul Hessianului pentru funcții de eroare de tipul sumei pătratelor. Levenberg-Marquardt adaugă o matrice identitate scalată pentru a asigura stabilitatea și a combina avantajele descensului gradientului (pentru μ → ∞) cu cele ale metodei Newton (pentru μ = 0).

Metode Quasi-Newton

O familie de metode quasi-Newton estimează inversul Hessianului prin acumularea modificărilor gradientului. Aceste metode construiesc o aproximare a inversului Hessianului H astfel încât să satisfacă ecuația secantă. Una dintre cele mai populare variații este algoritmul Broyden-Fletcher-Goldfarb-Shanno (BFGS). Algoritmul BFGS are o rată de convergență superlineară. Când numărul de parametri n_w este mare, inversul Hessianului ar putea să nu încapă în memorie. Pentru a ocoli această problemă, a fost propusă o versiune cu memorie limitată a algoritmului (L-BFGS), care stochează doar cele mai recente perechi de vectori.

Metodele Regiunii de Încredere (Trust Region Methods)

O altă strategie, alternativă la metodele de căutare liniară, este familia de metode ale regiunii de încredere. Aceste metode construiesc în mod repetat un model local al funcției de eroare, care este considerat valid într-o vecinătate a punctului curent, și îl minimizează în cadrul acestei vecinătăți. Raza regiunii de încredere este adaptată pe baza raportului dintre reducerea prezisă și cea reală a funcției de eroare. Dacă acest raport este aproape de 1, raza regiunii de încredere este mărită; dacă raportul este aproape de 0, raza este micșorată. Aceste metode sunt robuste și pot asigura o convergență globală la un punct staționar.

Antrenarea Stocastică și Mini-batch

Când o rețea neurală are un număr mare de parametri și setul de date conține un număr mare de exemple de antrenament, calculul valorii funcției de eroare totale, precum și al derivatelor sale, poate fi consumator de timp. Astfel, chiar și pentru o metodă simplă de descens gradient, fiecare actualizare a greutăților durează mult. Atunci, se poate aplica o metodă de descens stocastic al gradientului (SGD), care amestecă aleatoriu exemplele de antrenament, iterează prin ele și actualizează parametrii folosind gradienții erorilor individuale.

Spre deosebire de SGD, descensul gradientului obișnuit este numit metoda "batch" (sau în bloc), deoarece calculează gradientul pe întregul set de date înainte de a face o singură actualizare a greutăților. Deși pasul SGD poate crește eroarea pentru alte exemple, acesta permite metodei să scape de unele minime locale. Pentru o convergență mai "lină" și pentru a beneficia de paralelism, se utilizează adesea strategia "minibatch", care efectuează actualizări ale greutăților pe baza unor subgrupuri aleatorii de exemple de antrenament. Această abordare combină beneficiile stabilității antrenamentului batch cu rapiditatea SGD, fiind adesea cea mai eficientă abordare în practică.

Calculul Derivatelor: Diferențierea Automată și Retropropagarea

Pentru a aplica majoritatea metodelor de optimizare discutate, avem nevoie de un algoritm eficient pentru a calcula gradientul și Hessianul funcției de eroare în raport cu parametrii rețelei. Există mai multe abordări pentru calculul derivatelor funcției de eroare:

- Diferențierea numerică: Se bazează pe definiția derivatei și o aproximează prin diferențe finite. Este simplu de implementat, dar suferă de erori de trunchiere și rotunjire, fiind inexactă pentru derivate de ordin superior.

- Diferențierea simbolică: Transformă o expresie simbolică pentru funcția originală în expresii simbolice pentru derivatele sale, aplicând regula lanțului. Produce valori precise ale derivatelor, dar expresiile rezultate pot fi complexe și pot duce la calcule duplicate.

- Diferențierea automată (sau algoritmică): Calculează derivatele funcției într-un punct aplicând regula lanțului la valorile numerice corespunzătoare, în loc de expresii simbolice. Această metodă produce valori precise ale derivatelor și permite o optimizare semnificativă a performanței. Este extrem de utilă pentru antrenarea rețelelor neurale, deoarece se scalează bine la mai mulți parametri și la derivate de ordin superior.

Diferențierea automată cuprinde două moduri distincte de calcul:

- Modul înainte (Forward mode): Calculează sensibilitățile tuturor variabilelor în raport cu variabilele de intrare, pornind de la intrări și propagând "înainte". Complexitatea computațională este proporțională cu numărul de intrări.

- Modul invers (Reverse mode), cunoscut sub numele de Retropropagare (Backpropagation): Calculează sensibilitățile variabilelor de ieșire în raport cu toate variabilele, pornind de la ieșire și propagând "în revers". În cazul funcției de eroare (care este o singură ieșire scalară) și a multor intrări (parametri), modul invers este semnificativ mai rapid decât modul înainte. Algoritmul de retropropagare este coloana vertebrală a antrenamentului eficient al rețelelor neurale, permițând calculul rapid al gradientului funcției de eroare în raport cu toate greutățile și bias-urile rețelei. Procesul implică o trecere înainte (forward pass) pentru a calcula ieșirile rețelei și apoi o trecere înapoi (backward pass) pentru a propaga erorile și a calcula gradienții, care sunt apoi utilizați pentru a actualiza parametrii.

Algoritmul de retropropagare pentru gradientul funcției de eroare începe cu o trecere înainte pentru a calcula sumele ponderate și activările pentru toți neuronii din fiecare strat. Apoi, sensibilitățile funcției de eroare în raport cu sumele ponderate sunt calculate pentru neuronii din stratul de ieșire și apoi propagate înapoi prin straturile ascunse. În final, derivatele funcției de eroare în raport cu parametrii (bias-uri și greutăți) sunt exprimate în termeni de sensibilități. Similar, se pot calcula derivatele de ordin superior (Jacobian și Hessian) prin extensii ale retropropagării, esențiale pentru metodele de optimizare de ordin doi.

Criterii de Oprire a Antrenamentului

Orice metodă iterativă necesită un criteriu de oprire pentru a termina procedura de antrenament. Cele mai comune criterii includ:

- Pragul de gradient: Când norma gradientului funcției de eroare scade sub un anumit prag (

||∇E(W(k))|| < εg), indicând că s-a ajuns la un minim local. - Lipsa de progres: Dacă nu se înregistrează progrese semnificative în reducerea erorii sau în modificarea parametrilor (

E(W(k)) - E(W(k+1)) < εEsau||W(k) - W(k+1)|| < εw). - Număr maxim de iterații: Pentru a preveni buclele infinite în caz de divergență, antrenamentul poate fi oprit după un anumit număr maxim de epoci sau iterații (

k ≥ k̄).

Puncte Cheie în Antrenarea Rețelelor Neurale

Antrenarea rețelelor neurale este un proces complex, dar esențial, care transformă un model brut într-un sistem inteligent capabil de performanță. Iată o recapitulare a punctelor cheie:

- Definiție: Antrenarea este procesul de ajustare a parametrilor (greutăți și bias-uri) unei rețele neurale pentru a minimiza diferența dintre ieșirile prezise și cele dorite.

- Tipuri de Învățare: Principalele paradigme sunt învățarea supervizată (cu etichete), nesupervizată (fără etichete) și prin consolidare (cu recompense). Învățarea supervizată este fundamentală pentru majoritatea aplicațiilor practice.

- Funcția de Pierdere (Eroare): Cuantifică diferența dintre predicțiile rețelei și etichetele reale. Este obiectivul pe care rețeaua încearcă să-l minimizeze.

- Optimizare (Descensul Gradientului): Este mecanismul prin care greutățile rețelei sunt ajustate. Principiul de bază este de a se deplasa în direcția opusă gradientului funcției de pierdere, care indică panta cea mai abruptă.

- Rata de Învățare: Un hiperparametru crucial care controlează dimensiunea pasului la fiecare actualizare a greutăților. O rată prea mare poate duce la divergență, una prea mică la convergență lentă.

- Retropropagarea (Backpropagation): Algoritmul eficient de calcul al gradientului funcției de pierdere în raport cu toți parametrii rețelei. Este coloana vertebrală computațională a antrenamentului.

- Generalizarea: Capacitatea rețelei de a performa bine pe date noi, nevăzute. Este evaluată prin seturi de testare și validare, pentru a evita supraînvățarea.

- Seturi de Date: Datele sunt împărțite în seturi de antrenament, validare și testare pentru a asigura o evaluare robustă a performanței modelului.

- Metode de Optimizare Avansate: Pe lângă descensul gradientului de bază, există metode mai sofisticate (CG, Newton, Quasi-Newton, Trust Region) care îmbunătățesc rata de convergență și stabilitatea.

- Antrenarea Stocastică și Mini-batch: Tehnici care actualizează parametrii pe subgrupuri de date, accelerând antrenamentul și ajutând la evitarea minimelor locale.

- Criterii de Oprire: Mecanisme pentru a determina când antrenamentul ar trebui să înceteze, bazate pe progres, praguri de eroare sau numărul de iterații.

Întrebări Frecvente despre Antrenarea Rețelelor Neurale

De ce este antrenarea esențială pentru rețelele neurale?

Antrenarea este esențială deoarece îi permite rețelei neurale să învețe din date. Fără antrenament, o rețea este doar o structură goală de conexiuni; prin antrenament, ea ajustează miliarde de parametri pentru a recunoaște modele, a face predicții precise și a îndeplini sarcinile pentru care a fost concepută.

Care este diferența dintre învățarea supervizată și cea nesupervizată?

În învățarea supervizată, rețeaua învață din exemple etichetate (perechi intrare-ieșire dorită), scopul fiind de a prezice ieșiri pentru intrări noi. În învățarea nesupervizată, rețeaua primește doar intrări neetichetate și încearcă să descopere structuri sau modele ascunse în date, cum ar fi gruparea datelor.

Ce este o funcție de pierdere și de ce este importantă?

Funcția de pierdere (sau de eroare) este o măsură cantitativă a discrepanței dintre ieșirea prezisă de rețea și ieșirea reală (eticheta corectă). Este crucială deoarece oferă un semnal de eroare pe care rețeaua îl folosește pentru a-și ajusta parametrii în timpul antrenamentului, ghidând procesul de optimizare spre o performanță mai bună.

Cum funcționează descensul gradientului?

Descensul gradientului este un algoritm de optimizare care ajustează iterativ parametrii rețelei în direcția opusă celei a gradientului funcției de pierdere. Gradientul indică direcția celei mai abrupte creșteri a erorii, astfel că deplasarea în direcția opusă o minimizează. Acest proces se repetă până când eroarea este minimizată.

Ce este rata de învățare și cum o aleg?

Rata de învățare este un hiperparametru care determină cât de mare este pasul pe care rețeaua îl face la fiecare actualizare a parametrilor în timpul descensului gradientului. O rată prea mare poate face ca algoritmul să "sară" peste minim, în timp ce una prea mică poate încetini semnificativ antrenamentul. Alegerea optimă implică adesea experimentare și tehnici de ajustare, cum ar fi căutarea liniară sau planificarea ratei de învățare.

Ce este retropropagarea (backpropagation)?

Retropropagarea este algoritmul cheie care permite rețelelor neurale să învețe eficient. Este o metodă de diferențiere automată în modul invers, care calculează gradienții funcției de pierdere în raport cu fiecare greutate și bias din rețea. Acești gradienți sunt apoi folosiți de algoritmii de optimizare (cum ar fi descensul gradientului) pentru a actualiza parametrii modelului.

De ce este importantă generalizarea?

Generalizarea este capacitatea unui model antrenat de a face predicții precise pe date noi, nevăzute anterior. Dacă un model performează bine doar pe datele de antrenament, dar slab pe date noi, se spune că suferă de supraînvățare (overfitting) și nu este util în aplicațiile din lumea reală. Un model bine generalizat este scopul final al antrenamentului.

Care sunt principalele metode de optimizare avansate?

Pe lângă descensul gradientului de bază, metodele avansate includ Gradientul Conjugat, metodele lui Newton (și variantele lor, cum ar fi Gauss-Newton și Levenberg-Marquardt), precum și metodele Quasi-Newton (cum ar fi BFGS și L-BFGS) și metodele Regiunii de Încredere. Acestea oferă convergență mai rapidă sau o mai bună stabilitate în anumite condiții.

Ce este antrenarea mini-batch?

Antrenarea mini-batch este o strategie care actualizează parametrii rețelei după procesarea unui "mini-batch" (un subgrup de date de antrenament), în loc de a procesa întregul set de date (batch) sau doar un singur exemplu (stocastic). Aceasta oferă un echilibru între stabilitatea antrenamentului batch și rapiditatea SGD, fiind adesea cea mai eficientă abordare în practică.

Cum știu când să opresc antrenamentul?

Antrenamentul este oprit de obicei atunci când performanța modelului pe setul de validare încetează să se îmbunătățească (pentru a preveni supraînvățarea), când gradientul atinge un prag mic (indicând convergența), sau după un număr predefinit de epoci. Monitorizarea graficelor de pierdere și acuratețe pe seturile de antrenament și validare este crucială.

- Pragul de gradient: Când norma gradientului funcției de eroare scade sub un anumit prag (

Dacă vrei să descoperi și alte articole similare cu Antrenarea Rețelelor Neurale: Ghid Complet pentru Performanță Maximă, poți vizita categoria Fitness.