06/10/2023

În era digitală, unde volumele de date cresc exponențial, capacitatea de a extrage informații relevante și de a vizualiza structuri complexe devine crucială. Rețelele Neuronale Kohonen, cunoscute și sub denumirea de Hărți Auto-Organizatoare (Self-Organizing Maps - SOM), reprezintă o soluție elegantă și puternică în acest sens. Acestea fac parte din familia rețelelor neuronale artificiale nesupervizate, distingându-se prin capacitatea lor de a reduce dimensionalitatea datelor și de a le organiza într-o manieră topologică, relevând astfel tipare și relații ascunse.

Spre deosebire de rețelele neuronale supervizate care necesită date etichetate pentru antrenament, SOM-urile învață din structura intrinsecă a datelor de intrare, grupând puncte de date similare împreună. Această proprietate le face extrem de valoroase pentru sarcini precum analiza de clusterizare, vizualizarea datelor de înaltă dimensiune și explorarea seturilor de date complexe. Imaginați-vă că aveți un set de date cu sute sau mii de atribute pentru fiecare intrare; o rețea Kohonen poate proiecta aceste date pe o grilă bidimensională, păstrând în același timp relațiile de proximitate dintre datele originale.

Ce Este o Rețea Neuronală Kohonen (KNN / SOM)?

Rețeaua Neuronală Kohonen (KNN), adesea denumită Harta Auto-Organizatoare (SOM), este o formă specială de rețea neuronală artificială care se antrenează într-un mod nesupervizat. Creată de profesorul finlandez Teuvo Kohonen, această rețea are o arhitectură unică, concepută pentru a realiza o mapare ordonată a datelor de intrare pe o grilă, de obicei bidimensională. Scopul principal este reducerea dimensionalității datelor, transformând intrările complexe într-o reprezentare mai simplă, care conservă structura fundamentală și relațiile topologice dintre datele originale.

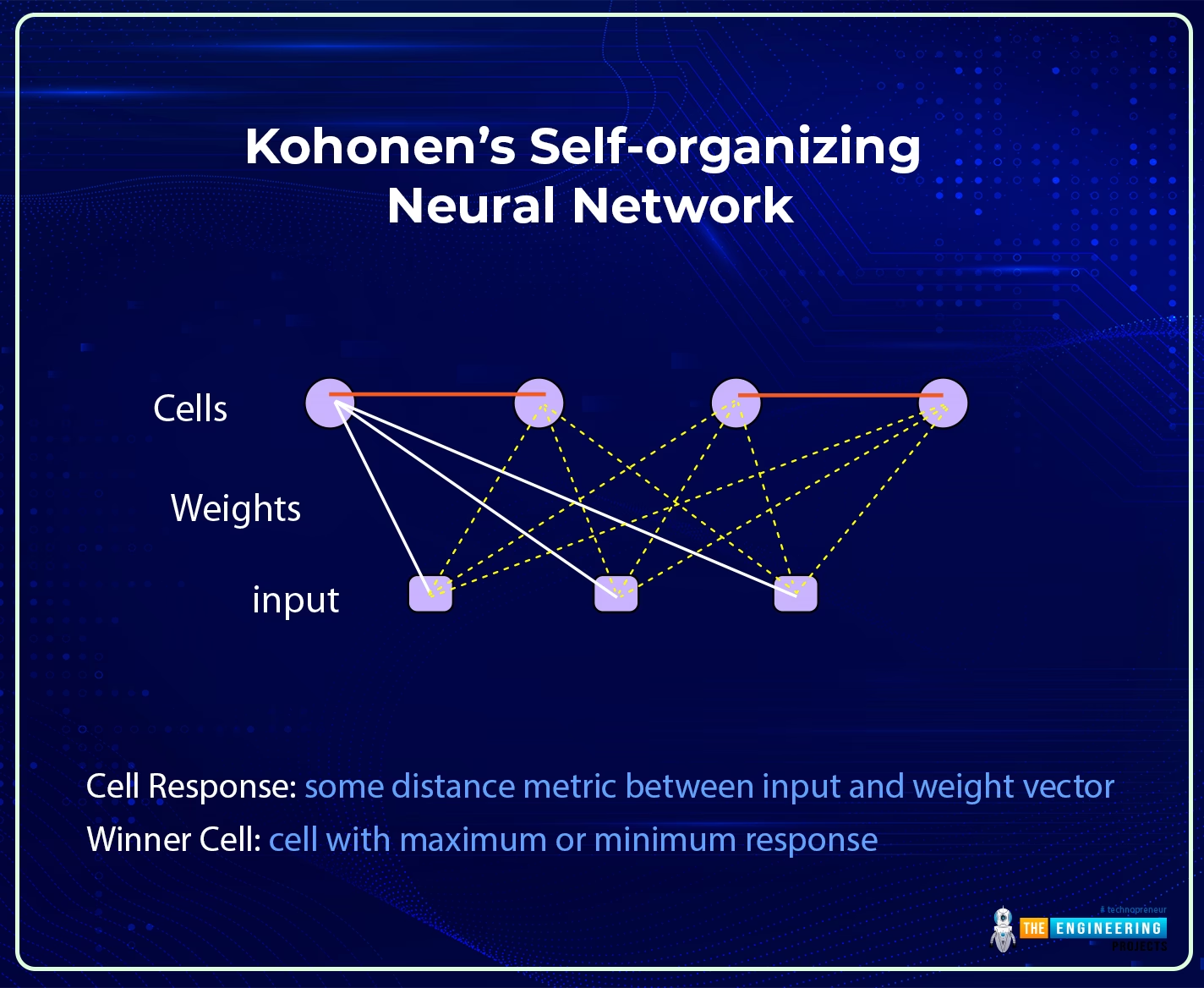

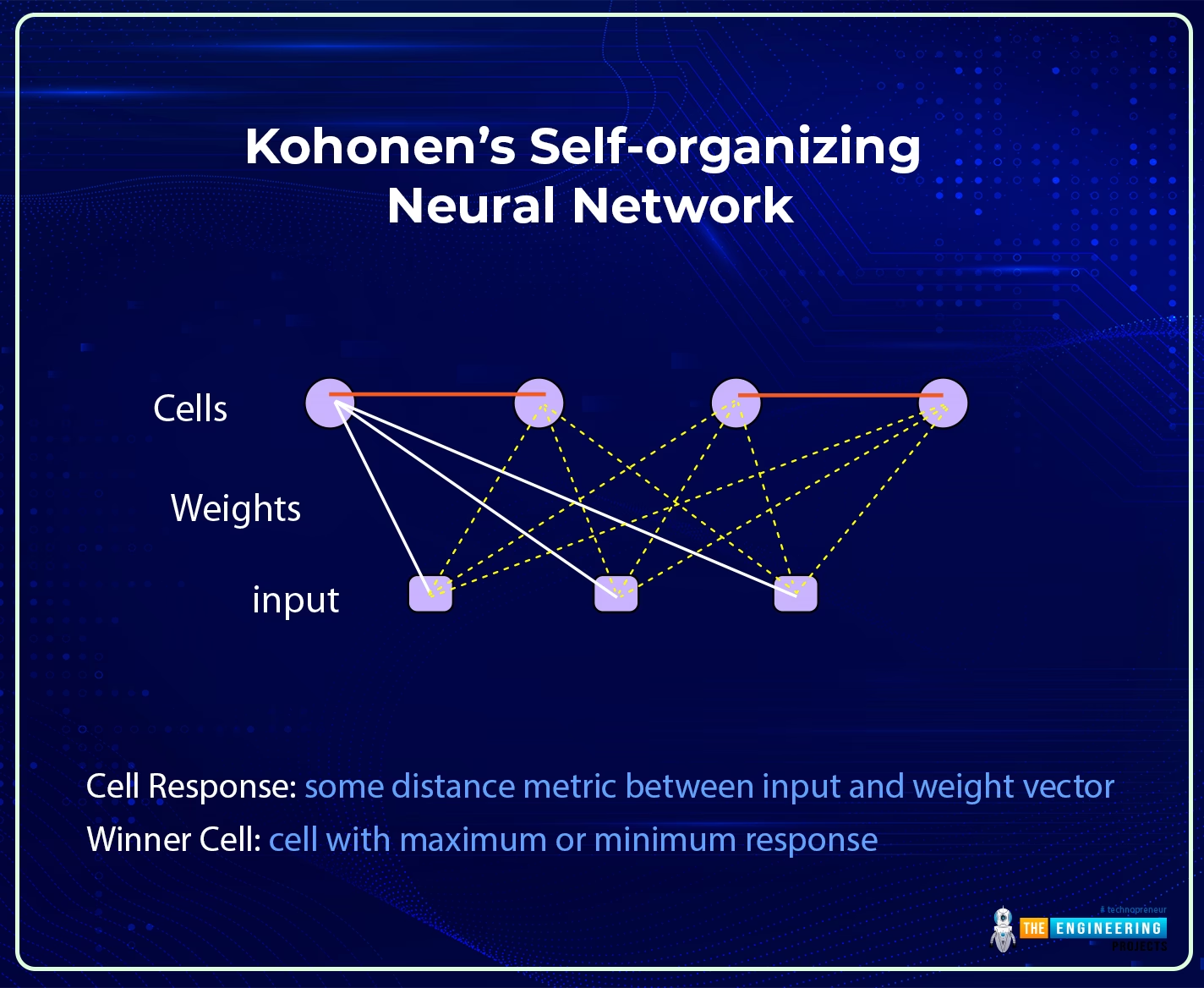

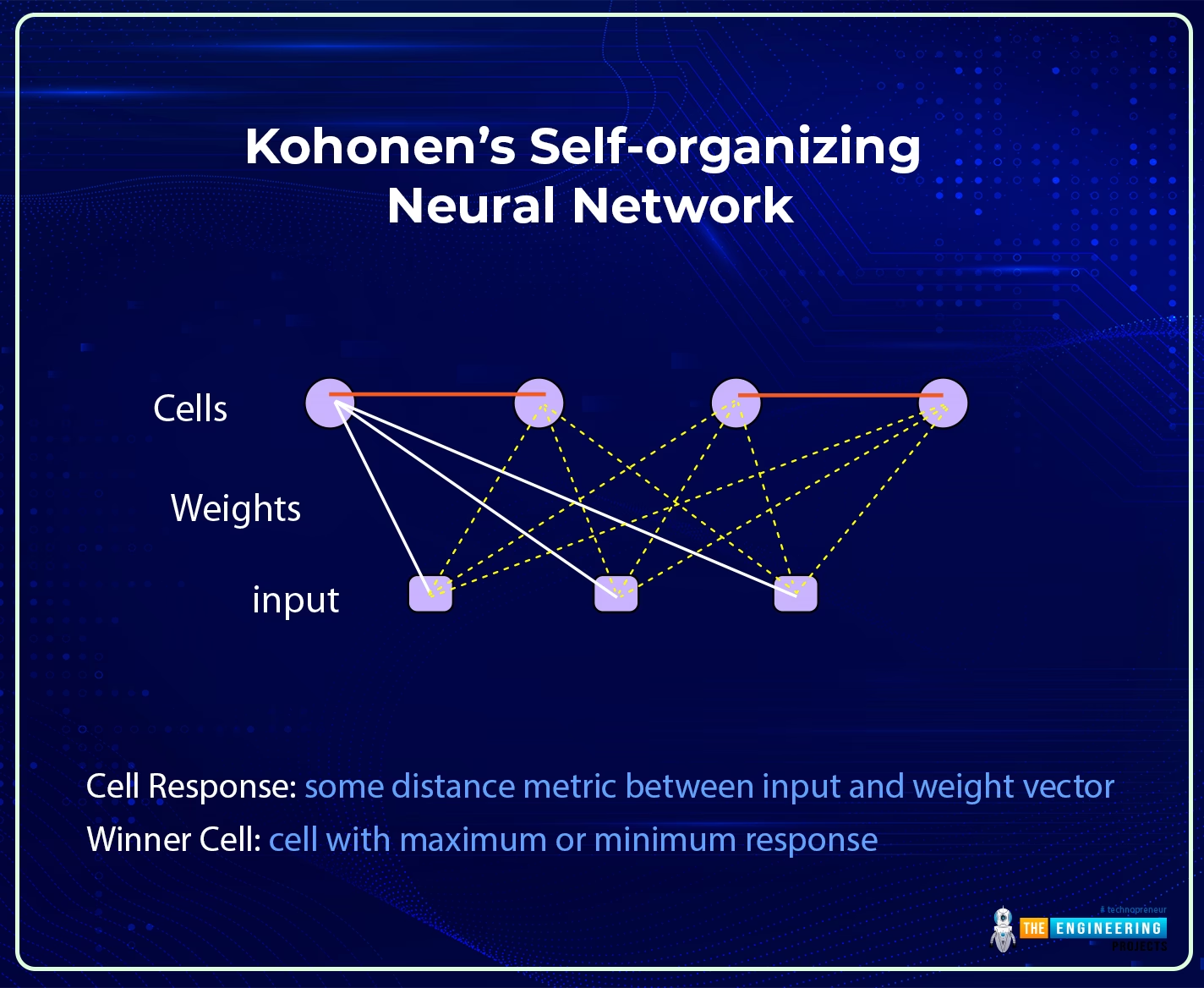

Caracteristica esențială a unei rețele Kohonen este capacitatea sa de auto-organizare. Neuronii din stratul de ieșire se grupează singuri pe baza caracteristicilor datelor de intrare. Putem vizualiza această rețea ca având două straturi principale: un strat de intrare și un strat de ieșire (harta). Neuronii de intrare sunt conectați la neuronii de ieșire prin ponderi (greutăți). Când datele de intrare sunt prezentate, acestea sunt transmise către stratul de ieșire. Neuronul din stratul de ieșire care răspunde cel mai puternic la intrarea curentă este declarat „câștigător” sau Unitatea Cel Mai Bine Potrivită (BMU) și va reprezenta acea intrare.

Cum Funcționează o Rețea Kohonen?

Componentele fundamentale ale rețelei sunt vectorii de ponderi (greutăți) și vectorii de intrare. Fiecare neuron din harta de ieșire are asociat un vector de ponderi, a cărui dimensionalitate este aceeași cu a datelor de intrare. În plus, fiecare neuron are o locație naturală pe grila 2D (coordonate x,y), care definește poziția sa topologică.

Algoritmul de Antrenament al SOM

Algoritmul de antrenament al unei rețele Kohonen urmează o serie de pași iterativi:

Inițializarea Ponderilor: La început, ponderile fiecărui neuron din harta de ieșire sunt inițializate. Aceasta se poate face aleatoriu sau prin selectarea aleatorie a unor exemple din setul de antrenament. O inițializare aleatorie uniformă în intervalul de valori al datelor de intrare este o practică comună.

Selectarea unei Intrări și Găsirea BMU: Se alege aleatoriu un vector de intrare din setul de antrenament. Pentru acest vector de intrare, se calculează distanța euclidiană între acesta și vectorul de ponderi al fiecărui neuron din harta de ieșire. Neuronul al cărui vector de ponderi este cel mai apropiat de vectorul de intrare (adică are cea mai mică distanță euclidiană) este desemnat Unitatea Cel Mai Bine Potrivită (BMU). Această unitate este „câștigătorul” competiției. Formula distanței euclidiene pătrate este:

inputDistance^2 = SUM (Ii - Wi)^2unde

Ieste vectorul de intrare curent,Weste vectorul de ponderi al neuronului, iar suma se realizează pe toate dimensiunile vectorului.Actualizarea Ponderilor BMU și ale Vecinilor Săi: Odată identificată BMU, vectorul său de ponderi este actualizat pentru a se apropia mai mult de vectorul de intrare. Mai mult, ponderile neuronilor vecini ai BMU de pe harta 2D sunt, de asemenea, ajustate. Gradul de ajustare depinde de doi factori principali:

Rata de Învățare (Learning Rate): Aceasta determină cât de mult sunt modificate ponderile la fiecare pas. Rata de învățare scade progresiv pe parcursul antrenamentului (de obicei exponențial), permițând ajustări mari la început și ajustări fine spre final, facilitând convergența.

n(t) = η0 * exp(-t / τ_η)unde

teste epoca curentă,η0este rata de învățare inițială, iarτ_ηeste o constantă de timp.Functia de Vecinătate Topologică (Neighborhood Function): Aceasta definește „raza” vecinătății în jurul BMU și influențează cât de mult sunt afectați neuronii din acea vecinătate. Neuronii mai aproape de BMU sunt ajustați mai mult decât cei mai îndepărtați. Raza vecinătății, similar cu rata de învățare, scade de-a lungul epocilor, permițând o organizare globală la început și o rafinare locală spre final.

σ(t) = σ0 * exp(-t / τ_σ)unde

σ0este raza inițială, iarτ_σeste o constantă de timp.Formula de actualizare a ponderilor este:

Δwj,i = n(t) * Tj,I(x)(t) * (xi - wj,i)unde

teste epoca,ișijsunt indici pentru neuroni/ponderi,I(x)este neuronul câștigător (BMU),n(t)este rata de învățare la epocat,Tj,I(x)(t)este funcția de vecinătate care depinde de distanța topologică dintre neuronuljși BMUI(x)și de raza vecinătății la epocat, iar(xi - wj,i)este diferența dintre intrarea și ponderea curentă.

Apply now. The Kohonen Neural Network (KNN) also known as self organizing maps is a type of unsupervised artificial neural network. This network can be used for clustering analysis and visualization of high-dimension data. It involves ordered mapping where input data are set on a grid, usually 2 dimensional. Repetarea Pașilor: Pașii 2 și 3 sunt repetați pentru un număr predefinit de epoci (sau până la convergență), folosind de fiecare dată un vector de intrare diferit, selectat aleatoriu din setul de antrenament.

Implementare și Vizualizare

Deși nu vom include codul aici, conceptul de implementare a unei rețele Kohonen implică crearea unei grile de neuroni, inițializarea aleatorie a ponderilor acestora și apoi parcurgerea procesului iterativ descris mai sus. Funcțiile cheie includ:

- O funcție pentru a găsi BMU, care calculează distanțele euclidiene.

- O funcție pentru a actualiza ponderile, aplicând rata de învățare și funcția de vecinătate.

- O buclă principală de antrenament care iterează prin epoci și prin datele de antrenament.

Un exemplu clasic de vizualizare a funcționării SOM este utilizarea culorilor RGB ca date de intrare. Inițial, ponderile neuronilor (reprezentând culori) sunt distribuite aleatoriu pe grila 2D. Pe măsură ce rețeaua se antrenează, neuronii vecini pe hartă vor începe să reprezinte culori similare, rezultând o hartă unde tranzițiile de culoare sunt netede și organizate. Acest lucru demonstrează vizual cum rețeaua auto-organizează datele, grupând culorile similare în regiuni adiacente de pe hartă, chiar dacă datele originale au fost prezentate într-o ordine aleatorie.

Complexitatea Algoritmului

Complexitatea temporală a antrenamentului unei rețele Kohonen este influențată de mai mulți factori. În general, aceasta poate fi estimată ca: O(N * C * S^2), unde:

Neste dimensiunea vectorului de intrare (numărul de atribute).Ceste numărul de cicluri sau epoci de antrenament.Seste dimensiunea hărții (numărul de neuroni pe o latură a grilei, deciS^2reprezintă numărul total de neuroni de pe hartă).

Aceasta indică faptul că timpul de antrenament crește liniar cu dimensiunea intrărilor și cu numărul de epoci, dar crește pătratic cu dimensiunea hărții, ceea ce poate deveni un factor limitativ pentru hărți foarte mari.

Aplicații ale Rețelelor Kohonen

Versatilitatea rețelelor Kohonen le-a făcut utile într-o gamă largă de domenii:

Recunoașterea Vorbirii: Unele studii utilizează KNN pentru a crea o reprezentare spectrală a eșantioanelor vocale. Diferitele spectre sunt mapate în diferite părți ale hărții, permițând sistemelor de recunoaștere a vorbirii să identifice și să clasifice foneme sau cuvinte pe baza asemănării lor spectrale.

Recunoașterea Obiectelor: KNN a fost aplicată și în recunoașterea dinamică a obiectelor. În sistemele bazate pe SOM, actualizarea ponderilor și pragurile sunt aspecte cheie abordate pentru a filtra fiecare pixel ca prim-plan sau fundal, contribuind la identificarea și urmărirea obiectelor în imagini sau secvențe video.

Interpretarea Datelor EEG: Rețelele Kohonen au fost folosite pentru analiza datelor de electroencefalogramă (EEG), în special pentru recunoașterea emoțiilor. Caracteristicile extrase din semnalele EEG sunt clasificate, iar KNN este utilizată pentru a identifica granițele dintre diferitele caracteristici EEG asociate cu stări emoționale specifice.

Analiza Financiară: Clusterizarea clienților, detectarea fraudelor sau analiza tendințelor pieței bursiere prin gruparea companiilor sau a acțiunilor cu profiluri similare.

Controlul Calității: Identificarea anomaliilor în procesele de producție prin maparea datelor de senzori și detectarea tiparelor neobișnuite.

Avantaje și Dezavantaje

Avantaje:

Reducerea Dimensionalității și Vizualizare: Capacitatea de a proiecta date de înaltă dimensiune pe o hartă 2D sau 3D, facilitând înțelegerea și vizualizarea structurilor complexe.

Conservarea Topologiei: Păstrează relațiile de proximitate dintre punctele de date originale; punctele similare în spațiul de intrare sunt mapate pe neuroni vecini pe hartă.

Clustering Nesupervizat: Poate fi utilizată eficient pentru sarcini de clusterizare, identificând grupuri naturale în date fără a necesita etichete predefinite.

Robustă la Zgomot: Adesea, este relativ robustă la date zgomotoase sau la valori aberante, deoarece ajustările se bazează pe medierea vecinătății.

Cannot retrieve latest commit at this time. MATLAB implementation of a Kohonen Self Organizing Map (SOM). Using the basic SOM algorithm, a few interesting examples that have mentioned in Self-Organizing Maps Book by Teuvo Kohonen have been implemented using MATLAB.

Dezavantaje:

Sensibilitate la Inițializare: Rezultatele pot varia în funcție de inițializarea aleatorie a ponderilor.

Determinarea Dimensiunii Hărții: Alegerea dimensiunii optime a hărții (numărul de neuroni) este adesea un proces empiric și poate influența calitatea clusterizării și a vizualizării.

Cost Computațional: Pentru seturi de date foarte mari sau hărți foarte dense, timpul de antrenament poate fi considerabil.

Dificultatea Interpretării Neuronilor: Deși organizează datele, interpretarea exactă a ceea ce reprezintă fiecare neuron specific de pe hartă poate fi uneori dificilă fără analize suplimentare.

Întrebări Frecvente (FAQ)

Q: Care este scopul principal al unei Rețele Kohonen?

A: Scopul principal este reducerea dimensionalității datelor și vizualizarea acestora prin maparea pe o grilă de dimensiuni mai mici, păstrând în același timp relațiile topologice și grupând datele similare.

Q: Este KNN o rețea supervizată sau nesupervizată?

A: KNN este o rețea neuronală nesupervizată, ceea ce înseamnă că învață din date fără a necesita etichete sau răspunsuri corecte predefinite.

Q: Ce este Unitatea Cel Mai Bine Potrivită (BMU)?

A: BMU este neuronul din harta de ieșire al cărui vector de ponderi este cel mai apropiat (în sensul distanței euclidiene) de vectorul de intrare curent. Este „câștigătorul” competiției neuronale.

Q: Cum sunt actualizate ponderile într-o rețea Kohonen?

A: Ponderile BMU și ale neuronilor din vecinătatea sa topologică sunt actualizate pentru a se apropia de vectorul de intrare. Mărimea actualizării este dictată de rata de învățare și de funcția de vecinătate, ambele scăzând în timp.

Q: Poate fi utilizată o rețea Kohonen pentru clasificare?

A: Direct, nu. SOM este un algoritm de clusterizare. Însă, odată ce harta este antrenată și neuronii s-au auto-organizat, se pot eticheta neuronii de pe hartă cu clasele majoritare ale datelor de intrare pe care le-au reprezentat. Astfel, se poate folosi harta pentru a clasifica noi intrări, asignându-le clasa neuronului BMU.

Q: Care este rolul funcției de vecinătate?

A: Funcția de vecinătate asigură că nu doar BMU este actualizată, ci și neuronii din jurul său. Acest lucru este crucial pentru menținerea proprietății de conservare a topologiei, asigurând că neuronii vecini pe hartă reprezintă date de intrare similare.

Concluzie

Rețelele Neuronale Kohonen reprezintă un instrument valoros în arsenalul inteligenței artificiale și al analizei datelor. Prin capacitatea lor unică de auto-organizare și de reducere a dimensionalității, acestea oferă o modalitate intuitivă de a descoperi structuri și tipare ascunse în seturi de date complexe. De la recunoașterea vorbirii la analiza datelor medicale și financiare, SOM-urile continuă să demonstreze versatilitatea și eficiența lor în transformarea datelor brute în informații semnificative și ușor de interpretat.

Dacă vrei să descoperi și alte articole similare cu Rețelele Neuronale Kohonen: Auto-Organizare și Descoperire de Modele, poți vizita categoria Fitness.