25/04/2022

Rețelele neurale profunde au revoluționat inteligența artificială, de la recunoașterea imaginilor la procesarea limbajului natural și decizii complexe. Puterea lor derivă din capacitatea de a învăța tipare complexe din volume mari de date, construind abstracții pe mai multe niveluri. Cu toate acestea, antrenarea eficientă și stabilă a acestor rețele nu este întotdeauna un proces direct. Este crucial să înțelegem nu doar cum să inițiem antrenamentul, ci și cum să-i monitorizăm progresul și, mai important, cum să depășim obstacolele comune care pot apărea. Acest ghid detaliat vă va oferi instrumentele necesare pentru a naviga cu succes prin complexitatea antrenării rețelelor neurale, asigurându-vă că modelele dumneavoastră ating performanța optimă. Vom explora metode de monitorizare a progresului și vom aprofunda în provocările inerente, cum ar fi problemele de gradient, oferind soluții practice și strategii eficiente.

- Monitorizarea Progresului Antrenării Rețelelor Neurale

- De Ce Este Dificilă Antrenarea Rețelelor Neurale Profunde?

- Problema Gradientului Evanescent (Vanishing Gradient Problem)

- Problema Gradientului Exploziv (Exploding Gradient Problem)

- Implicațiile Gradientului Instabil și RNN-uri

- Soluții pentru Problemele de Gradient

- Întrebări Frecvente (FAQ)

- Concluzie

Monitorizarea Progresului Antrenării Rețelelor Neurale

Un aspect fundamental în antrenarea cu succes a rețelelor neurale este capacitatea de a monitoriza progresul în timp real. Această monitorizare nu este doar o formalitate, ci o necesitate strategică. Pe măsură ce rețeaua învață, este vital să înțelegem cum se modifică performanța sa, dacă acuratețea se îmbunătățește și, mai ales, dacă modelul începe să se confrunte cu fenomenul de supra-antrenare (overfitting). Supra-antrenarea apare atunci când modelul învață datele de antrenament prea bine, inclusiv zgomotul și particularitățile irelevante, pierzând astfel capacitatea de a generaliza pe date noi, nevăzute.

Funcții precum trainnet, utilizată în anumite cadre de lucru de învățare profundă, simplifică semnificativ acest proces. Când setați opțiunea de antrenament Plots la "training-progress" și începeți antrenamentul, funcția creează automat o fereastră grafică. Aceasta afișează metrici cheie la fiecare iterație, oferind o vizualizare dinamică a performanței. O iterație reprezintă o estimare a gradientului și o actualizare a parametrilor rețelei (ponderi și bias-uri).

Dacă specificați date de validare prin opțiunea ValidationData, graficele vor include și metricile de validare. Acestea sunt cruciale pentru a detecta supra-antrenarea: o pierdere (loss) în scădere pe datele de antrenament, dar o pierdere în creștere sau stagnantă pe datele de validare este un semnal clar de alarmă. Graficele prezintă, de obicei, pierderea și orice alte metrici specificate prin opțiunea Metrics, cum ar fi acuratețea. Scala implicită este liniară, dar puteți opta pentru o scară logaritmică pe axa Y pentru o vizualizare mai clară a variațiilor mici.

În timpul antrenamentului, aveți flexibilitatea de a opri procesul oricând, prin simpla apăsare a butonului "stop". Odată oprit, trainnet returnează starea curentă a rețelei, permițându-vă să inspectați progresul sau să reluați antrenamentul de la acel punct. Pentru a obține rețeaua care a avut cea mai bună performanță pe setul de validare (conform metricii specificate de ObjectiveMetricName), puteți seta opțiunea OutputNetwork la "best-validation". Alternativ, "last-iteration" va returna rețeaua în starea sa finală, după ultima iterație de antrenament.

Opțiune OutputNetwork | Descriere |

|---|---|

"best-validation" | Rețeaua returnată corespunde iterației cu cea mai bună performanță pe setul de validare (conform ObjectiveMetricName). Ideal pentru a obține un model generalizabil. |

"last-iteration" | Rețeaua returnată corespunde stării de la sfârșitul antrenamentului, indiferent de performanța pe validare. Utilă pentru analize post-antrenament sau dacă validarea nu este prioritară. |

Pe lângă grafice, fereastra de antrenament oferă și informații despre timpul total de antrenament și setările curente, oferind o imagine completă a sesiunii de antrenament. Pentru bucle de antrenament personalizate, unde nu se utilizează trainnet, obiecte precum trainingProgressMonitor pot fi folosite pentru a vizualiza metricile în mod similar. Odată finalizat antrenamentul, aveți opțiunea de a exporta graficele de progres în diverse formate de imagine (PNG, JPEG, TIFF, PDF), pentru documentare sau analiză ulterioară.

De Ce Este Dificilă Antrenarea Rețelelor Neurale Profunde?

Modelele de învățare profundă sunt, în esență, rețele neurale cu straturi multiple, profunde, care încearcă să descopere tipare și informații ascunse prin abstracții succesive. Această capacitate de a construi reprezentări complexe pe mai multe niveluri este motivul pentru care rețelele neurale profunde au un avantaj semnificativ față de algoritmii tradiționali de învățare automată atunci când se lucrează cu volume mari și complexe de date.

Cheia învățării și antrenării acestor rețele este algoritmul de backpropagation. Acesta este mecanismul prin care erorile sunt propagate înapoi prin rețea, permițând ajustarea ponderilor și bias-urilor pentru a minimiza diferența dintre predicțiile rețelei și valorile reale. Cu toate acestea, matematica din spatele backpropagationului ne dezvăluie de ce antrenarea simultană a tuturor straturilor unei rețele profunde poate fi o provocare imensă.

La nivelul fiecărui neuron (nod) din rețea, învățarea se desfășoară cu viteze diferite, determinate de valorile gradientului. Un gradient este o măsură a ratei de schimbare a funcției de pierdere în raport cu un anumit parametru (o pondere sau un bias). Cu cât gradientul este mai mare, cu atât parametrul se ajustează mai rapid; cu cât este mai mic, cu atât învățarea este mai lentă. În rețelele profunde, aceste viteze de învățare pot varia drastic între straturi.

De ce, atunci, aceste modele de învățare profundă sunt greu de antrenat? De ce, uneori, pierderea de antrenament se blochează la o valoare constantă după un anumit număr de iterații? Sau de ce, în alte cazuri, eroarea de antrenament crește treptat după un timp? Răspunsul se află în modul în care gradienții se propagă prin straturi.

Învățarea, sau antrenarea, se întâmplă de la straturile finale (cele mai apropiate de ieșire) către straturile inițiale (cele mai apropiate de intrare). Ca urmare, straturile ulterioare învață bine și rapid, în timp ce straturile timpurii învață foarte puțin în timpul procesului de backpropagation. Această problemă se agravează odată cu creșterea numărului de straturi. În cazuri extreme, straturile anterioare pot învăța extrem de repede, în timp ce straturile ulterioare se confruntă cu o încetinire drastică. Înțelegerea acestor dificultăți și a cauzelor lor ne ajută să găsim soluții rezonabile. Nu este magie, ci matematică.

Problema Gradientului Evanescent (Vanishing Gradient Problem)

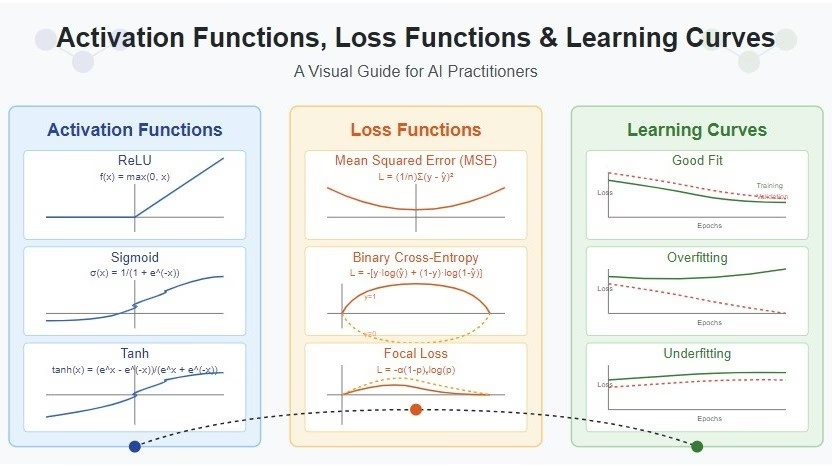

În timpul antrenării rețelelor neurale profunde, o problemă frecventă este cea a gradientului evanescent. Aceasta se manifestă prin faptul că valorile gradientului devin extrem de mici pe măsură ce se propagă înapoi prin straturile rețelei, de la ieșire spre intrare. Imaginați-vă o rețea neurală simplă, cu mai multe straturi, fiecare având un singur neuron, și să presupunem că folosim funcția de activare sigmoidă (sau tangenta hiperbolică, tanh). Aceste funcții de activare comprimă intrarea într-un interval restrâns (de exemplu, între 0 și 1 pentru sigmoidă sau -1 și 1 pentru tanh).

În timpul procesului de backpropagation, gradienții sunt calculați prin înmulțirea derivatelor funcțiilor de activare de la fiecare strat. Derivata funcției sigmoidă, de exemplu, are o valoare maximă de 0.25 (atunci când inputul este 0) și tinde rapid către zero pe măsură ce inputul se îndepărtează de 0. Aceasta înseamnă că, pe măsură ce ne propagăm înapoi prin straturi, înmulțim continuu valori mici (între 0 și 0.25). Rezultatul acestei înmulțiri repetate este că gradienții devin exponențial mai mici pe măsură ce ajung la straturile inițiale ale rețelei. Practic, informația despre eroare care ar trebui să ghideze învățarea straturilor timpurii se 'evaporează', iar aceste straturi învață extrem de lent sau deloc. Această încetinire a învățării în straturile inițiale împiedică rețeaua să captureze tipare complexe la nivel fundamental, afectând performanța generală a modelului.

Problema Gradientului Exploziv (Exploding Gradient Problem)

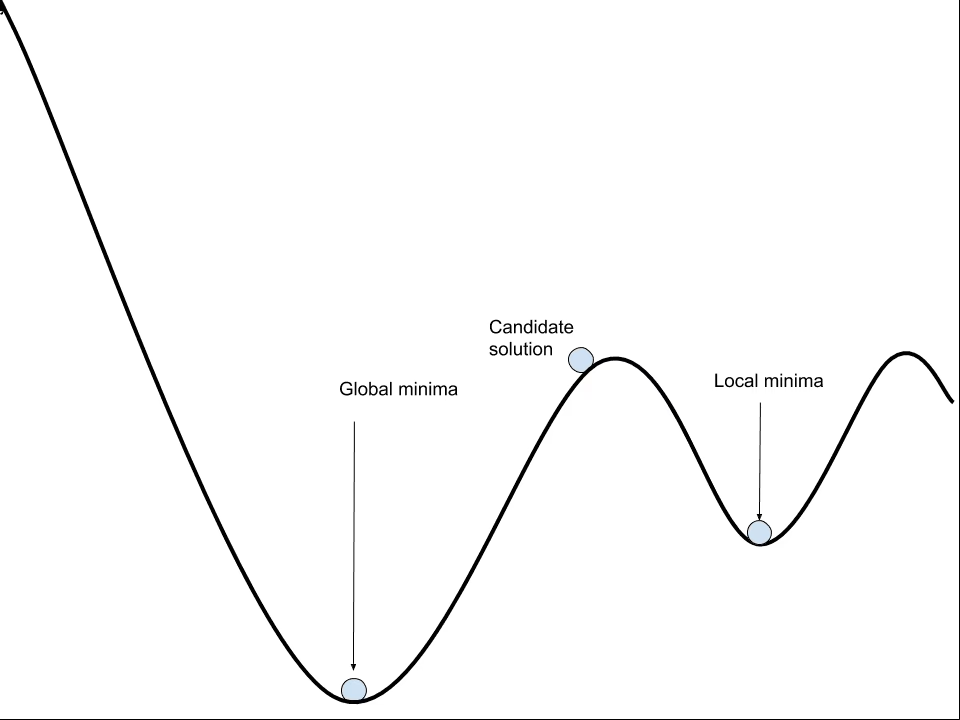

Pe de altă parte, problema gradientului exploziv apare atunci când gradienții devin extrem de mari în timpul backpropagationului. Aceasta se întâmplă adesea când ponderile rețelei cresc necontrolat în timpul antrenamentului. Dacă, în timpul backpropagation, avem ponderi mari și/sau derivate ale funcțiilor de activare care sunt mari (de exemplu, în cazul funcțiilor liniare sau a unor anumite inițializări), produsul lor poate duce la o creștere exponențială a valorii gradientului pe măsură ce se propagă înapoi prin straturi. Un gradient exploziv poate face ca actualizările ponderilor să fie atât de mari încât modelul 'sare' peste minimul optim al funcției de pierdere, ducând la divergență sau la oscilații sălbatice ale pierderii de antrenament. Antrenamentul devine astfel instabil și ineficient, iar modelul nu reușește să converge spre o soluție optimă. Acest fenomen este mai puțin comun decât gradientul evanescent în rețelele Feedforward, dar este o preocupare majoră în rețelele recurente.

Implicațiile Gradientului Instabil și RNN-uri

Din analiza problemelor de gradient evanescent și gradient exploziv, putem concluziona că ne confruntăm cu o problemă fundamentală de instabilitate a gradientului în modelele noastre de învățare profundă. Cu cât adăugăm mai multe straturi ascunse, cu atât adăugăm mai multă instabilitate. Chiar dacă straturile ulterioare învață corect, antrenamentul general se confruntă cu dificultăți în clasificarea corectă a intrărilor, deoarece învățarea în straturile anterioare a fost împiedicată. Deoarece aceste straturi timpurii poartă abstracția inițială, performanța lor afectează în mod direct abstracția din straturile ulterioare.

Aceste probleme sunt deosebit de pronunțate în cazul Rețelelor Neurale Recurente (RNN-uri), unde backpropagation se realizează prin timp. În RNN-uri, problema gradientului evanescent duce la pierderea dependențelor pe termen lung și a cunoștințelor stocate în memorie. Din această cauză, au fost dezvoltate unități celulare RNN diferite, cum ar fi LSTMs (Long Short-Term Memory) și GRUs (Gated Recurrent Units). Acestea au atribute de "porți" care le permit să gestioneze mai eficient fluxul de informație și să atenueze problema gradientului evanescent, permițând RNN-urilor să învețe dependențe pe durate mai lungi.

Soluții pentru Problemele de Gradient

Din fericire, există mai multe soluții practice pe care le puteți aplica pentru a combate problemele de gradient și a îmbunătăți stabilitatea și eficiența antrenării rețelelor neurale profunde:

1. Funcții de Activare Alternative

Înlocuirea funcțiilor de activare tradiționale precum sigmoidă și tanh, care contribuie la problema gradientului evanescent, cu alternative moderne este o primă soluție eficientă:

- ReLU (Rectified Linear Unit): Cu formula

f(x) = max(0, x), derivata ReLU este 1 pentru x > 0 și 0 pentru x <= 0. Aceasta ajută la evitarea dispariției gradientului pentru intrările pozitive, permițând o propagare mai bună a gradientului. Este foarte populară datorită simplității și eficienței sale. - Leaky ReLU, ELU (Exponential Linear Unit), PReLU (Parametric ReLU): Acestea sunt variante ale ReLU care abordează problema "neuronilor morți" (neuroni care nu se activează niciodată și, prin urmare, nu primesc actualizări de gradient). Ele introduc o pantă mică, non-zero, pentru intrările negative, asigurându-se că există întotdeauna un gradient, chiar și mic.

| Funcție de Activare | Avantaje | Dezavantaje |

|---|---|---|

| Sigmoidă / Tanh | Produce ieșiri normalizate. | Suferă de gradient evanescent, costuri de calcul mai mari. |

| ReLU | Rezolvă gradientul evanescent (pentru x > 0), rapidă, simplă. | Poate crea "neuroni morți". |

| Leaky ReLU / ELU | Rezolvă "neuronii morți", rapidă, ajută la convergență. | Poate fi mai complexă de implementat, rezultate inconsistente. |

2. Optimizatori cu Momentum

Utilizarea optimizatorilor avansați, cum ar fi Descendenta Stochastică cu Momentum (Momentum-based SGD), Adam, RMSprop, poate îmbunătăți semnificativ procesul de antrenament. Momentumul ajută la accelerarea convergenței, în special în direcțiile relevante, și la reducerea oscilațiilor, permițând gradientului să "treacă" peste minimele locale și să ajungă mai rapid la o soluție optimă. Acești optimizatori acumulează o fracțiune din gradientul anterior, adăugând inerție mișcării și stabilizând calea de actualizare a ponderilor.

3. Inițializarea Corectă a Ponderilor și Bias-urilor

Modul în care sunt inițializate ponderile și bias-urile la începutul antrenamentului are un impact major asupra stabilității gradientului. O inițializare necorespunzătoare poate duce rapid la saturarea funcțiilor de activare și la probleme de gradient încă de la primele iterații. Metode precum inițializarea Xavier/Glorot (potrivită pentru funcțiile sigmoidă și tanh) sau inițializarea He (pentru funcțiile ReLU și variantele sale) sunt concepute pentru a menține varianța activărilor și a gradienților relativ constantă pe parcursul straturilor, prevenind atât gradientul evanescent, cât și cel exploziv în fazele inițiale ale antrenamentului.

4. Regularizare

Regularizarea este o tehnică esențială pentru a preveni supra-antrenarea și pentru a îmbunătăți generalizarea modelului. Deși nu abordează direct problemele de gradient în sensul propagării, o regularizare eficientă poate contribui la un antrenament mai stabil și la un model mai robust, care este mai puțin predispus la valori extreme ale ponderilor care ar putea contribui la explozia gradientului.

- Regularizarea L1 și L2: Acestea adaugă un termen de penalizare la funcția de pierdere, descurajând ponderile mari. Regularizarea L2 (ridge regression) tinde să facă ponderile mici, dar non-zero, în timp ce L1 (lasso regression) poate forța unele ponderi să devină exact zero, realizând o selecție de caracteristici.

- Dropout: Această tehnică "dezactivează" aleatoriu un anumit procent de neuroni (și conexiunile lor) în timpul fiecărei iterații de antrenament. Acest lucru forțează rețeaua să învețe caracteristici mai robuste și mai redundante, prevenind dependența excesivă de anumite căi sau neuroni și reducând supra-antrenarea.

Întrebări Frecvente (FAQ)

Q: Ce este backpropagation și de ce este importantă?

A: Backpropagation este algoritmul fundamental prin care o rețea neurală își ajustează ponderile și bias-urile. Calculează gradientul funcției de pierdere în raport cu parametrii rețelei, permițând actualizarea acestora pentru a minimiza eroarea dintre predicțiile modelului și rezultatele reale. Fără backpropagation, antrenarea eficientă a rețelelor profunde ar fi imposibilă, deoarece nu am avea o metodă sistematică de a ști cum să ajustăm milioanele de parametri pentru a îmbunătăți performanța.

Q: De ce ar trebui să folosesc o funcție de activare diferită de sigmoidă sau tanh?

A: Sigmoida și tanh suferă de problema gradientului evanescent, în special în rețelele profunde. Derivatele lor devin foarte mici la valorile extreme ale intrării, încetinind drastic învățarea în straturile timpurii. Funcțiile precum ReLU, Leaky ReLU sau ELU au derivate mai mari și mai constante pe porțiuni semnificative ale domeniului lor, ajutând la propagarea eficientă a gradientului și la accelerarea antrenamentului. Ele contribuie la prevenirea "morții" neuronilor și la o convergență mai rapidă și mai stabilă.

Q: Cum știu dacă modelul meu se supra-antrenează?

A: Supra-antrenarea apare atunci când modelul învață prea bine datele de antrenament, inclusiv zgomotul, și pierde capacitatea de a generaliza pe date noi, nevăzute. Pe graficele de monitorizare a progresului, veți observa un decalaj crescător între performanța pe setul de antrenament și cea pe setul de validare. Mai exact, pierderea (loss) pe setul de antrenament continuă să scadă, în timp ce pierderea pe setul de validare începe să crească sau stagnează după un anumit punct. Acuratețea pe validare va începe, de asemenea, să scadă, chiar dacă acuratețea pe antrenament rămâne ridicată sau continuă să crească.

Q: Ce rol are regularizarea în antrenarea rețelelor neurale?

A: Regularizarea este o tehnică utilizată pentru a preveni supra-antrenarea și pentru a îmbunătăți capacitatea de generalizare a modelului. Ea adaugă o penalizare la funcția de pierdere, descurajând complexitatea excesivă a modelului (de exemplu, prin menținerea ponderilor mici, cum ar fi în cazul regularizării L1 și L2) sau prin introducerea de zgomot (cum ar fi în cazul Dropout). Acest lucru forțează rețeaua să învețe caracteristici mai robuste și mai generalizabile, reducând dependența de anumite caracteristici specifice din setul de antrenament și făcând modelul mai rezistent la variațiile din datele noi.

Concluzie

Antrenarea rețelelor neurale profunde este o artă și o știință, o balanță delicată între complexitatea modelului și stabilitatea procesului de învățare. Înțelegerea profundă a mecanismelor de monitorizare și a provocărilor precum problemele de gradient evanescent și gradient exploziv este absolut esențială pentru a construi modele robuste și performante. Prin aplicarea soluțiilor discutate – de la alegerea funcțiilor de activare potrivite și utilizarea optimizatorilor avansați, la tehnicile de inițializare inteligentă a ponderilor și strategiile de regularizare – puteți depăși obstacolele și puteți debloca întregul potențial al inteligenței artificiale. Nu uitați, experimentarea constantă, analiza atentă a progresului și o înțelegere solidă a principiilor matematice subiacente sunt cheile succesului în acest domeniu dinamic și în continuă evoluție.

Dacă vrei să descoperi și alte articole similare cu Antrenarea Rețelelor Neurale: Ghid Complet, poți vizita categoria Fitness.