10/05/2026

Antrenarea unei rețele neurale este procesul fundamental prin care aceste sisteme computaționale, inspirate de creierul uman, învață să îndeplinească sarcini specifice, cum ar fi recunoașterea imaginilor, procesarea limbajului natural sau predicția datelor. Este o etapă iterativă și complexă, esențială pentru ca o rețea să poată transforma datele brute în cunoștințe utile și să generalizeze pe exemple noi, nevăzute anterior. Fără o antrenare adecvată, chiar și cea mai sofisticată arhitectură de rețea neurală ar rămâne doar o structură goală, incapabilă să rezolve probleme din lumea reală.

În esență, antrenarea implică ajustarea continuă a parametrilor interni ai rețelei, cunoscuți sub numele de greutăți și bias-uri, pe baza unui set vast de date de antrenament. Fiecare iterație a acestui proces rafinează capacitatea rețelei de a face predicții sau clasificări mai precise. Este similar cu modul în care un student învață dintr-un manual, rezolvând probleme și primind feedback pentru a-și îmbunătăți înțelegerea și performanța.

- Ce Este Antrenarea unei Rețele Neurale?

- Cum Sunt Construite Rețelele Neurale pentru Antrenare?

- Procedura Tipică de Antrenare a unei Rețele Neurale

- Funcția de Pierdere: Măsurarea Erorii

- Retropropagarea: Mecanismul de Învățare

- Tipuri de Rețele Neurale și Particularități de Antrenament

- Considerații Cheie în Antrenamentul Rețelelor Neurale

- Tabel Comparativ: Aspecte de Antrenament ale Diferitelor Rețele Neurale

- Întrebări Frecvente (FAQ)

Ce Este Antrenarea unei Rețele Neurale?

Antrenarea unei rețele neurale este, prin definiție, un proces iterativ. Aceasta înseamnă că se repetă de nenumărate ori, ajustând parametrii rețelei pas cu pas. În fiecare iterație, rețeaua efectuează o „trecere înainte” (forward pass) prin toate straturile sale. În acest pas, datele de intrare sunt procesate de la un strat la altul, până când rețeaua produce o ieșire sau o predicție. Pentru fiecare exemplu din lotul de date de antrenament, se calculează o ieșire specifică.

Această ieșire este apoi comparată cu rezultatul corect așteptat (eticheta reală). Diferența dintre predicția rețelei și valoarea reală este cuantificată printr-o funcție de pierdere (loss function). Valoarea obținută de la funcția de pierdere indică cât de „greșită” este predicția rețelei. Scopul antrenării este de a minimiza această valoare de pierdere, adică de a face predicțiile rețelei cât mai apropiate de realitate.

Cum Sunt Construite Rețelele Neurale pentru Antrenare?

Construirea unei rețele neurale, în contextul antrenării, implică definirea arhitecturii sale, adică a numărului de straturi, a tipului de neuroni din fiecare strat și a modului în care aceștia sunt conectați. Instrumente software moderne, cum ar fi pachetul torch.nn în PyTorch (o platformă populară pentru învățare automată), facilitează enorm acest proces. Conceptul central este nn.Module, care conține straturile rețelei și o metodă cheie numită forward(input). Această metodă specifică modul în care datele de intrare sunt prelucrate secvențial prin straturile rețelei pentru a produce o ieșire.

De exemplu, o rețea simplă de tip feed-forward, folosită pentru clasificarea imaginilor cu cifre, ia o intrare (imaginea cifrei), o trece prin mai multe straturi, unul după altul, aplicând transformări matematice și funcții de activare, și în cele din urmă produce o ieșire care reprezintă predicția clasei (ce cifră este).

Procedura Tipică de Antrenare a unei Rețele Neurale

Antrenarea unei rețele neurale urmează un set bine definit de pași, care se repetă de nenumărate ori (epoci) pe întregul set de date de antrenament. Această buclă de antrenare este inima procesului de învățare:

- Definirea Rețelei Neurale: Primul pas este să se definească arhitectura rețelei, care include numărul de straturi, numărul de neuroni pe strat și tipul de conexiuni. Această definiție stabilește parametrii antrenabili (sau greutățile) ai rețelei.

- Iterarea Peste un Set de Date: Datele de antrenament sunt împărțite în loturi (batches). Rețeaua procesează aceste loturi secvențial.

- Procesarea Intrare Prin Rețea (Forward Pass): Pentru fiecare lot de intrare, datele sunt transmise prin straturile rețelei, generând o predicție sau o ieșire.

- Calcularea Pierderii (Loss): Predicția rețelei este comparată cu valoarea reală (ținta). O funcție de pierdere (sau funcție de cost) cuantifică discrepanța dintre predicție și țintă, indicând cât de „greșită” este predicția.

- Propagarea Retrogradă a Gradienților (Backpropagation): Pe baza valorii pierderii, se calculează gradienții pierderii în raport cu fiecare parametru (greutate) al rețelei. Acești gradienți indică direcția și magnitudinea cu care trebuie ajustați parametrii pentru a reduce pierderea.

- Actualizarea Greutăților Rețelei: În cele din urmă, greutățile rețelei sunt ajustate folosind o regulă de actualizare simplă, dar puternică:

greutate = greutate - rata_de_învățare * gradient. Rata de învățare (learning rate) este un hiperparametru crucial care controlează cât de mare este pasul făcut în direcția descendentă a gradientului. O rată prea mare poate duce la instabilitate, în timp ce una prea mică poate încetini antrenarea excesiv.

Funcția de Pierdere: Măsurarea Erorii

O funcție de pierdere (Loss Function) este o componentă esențială în antrenarea rețelelor neurale, având rolul de a măsura „penalizarea” rețelei pentru predicțiile sale incorecte. Ea ia ca intrări perechea (ieșire, țintă) – adică predicția rețelei și valoarea corectă așteptată – și calculează o valoare scalară care estimează cât de departe este ieșirea de țintă. Cu cât valoarea pierderii este mai mică, cu atât predicția rețelei este mai precisă.

Există mai multe funcții de pierdere disponibile în pachetul nn, fiecare potrivită pentru diferite tipuri de probleme. Un exemplu simplu și des întâlnit este nn.MSELoss, care calculează eroarea medie pătratică (Mean Squared Error - MSE) între ieșire și țintă. De exemplu, dacă o rețea prezice o valoare, iar ținta reală este alta, MSELoss va calcula pătratul diferenței dintre cele două, iar apoi va face media pe întregul lot de date. Minimizarea acestei funcții înseamnă reducerea erorilor medii pătratice ale predicțiilor.

Retropropagarea: Mecanismul de Învățare

Retropropagarea (Backpropagation) este algoritmul fundamental care permite rețelelor neurale să învețe eficient. După ce funcția de pierdere calculează eroarea, retropropagarea distribuie această eroare înapoi prin rețea, de la stratul de ieșire până la stratul de intrare. În timpul acestui proces, sunt calculați gradienții pierderii în raport cu fiecare greutate și bias din rețea. Acești gradienți sunt esențialii indicatori care arată cum trebuie ajustați parametrii pentru a reduce eroarea.

Conceptul .grad_fn, menționat în contextul PyTorch, este o referință la funcția care a creat un anumit tensor. Urmărind acest atribut înapoi de la tensorul pierderii, se poate vizualiza graful de calcul al operațiilor care au dus la acea pierdere. Acest graf este apoi diferențiat automat. Când se apelează loss.backward(), întregul graf este diferențiat în raport cu parametrii rețelei neurale, iar toți tensorii din graf care au proprietatea requires_grad=True își vor acumula gradientul în atributul lor .grad. Acest lucru permite algoritmilor de optimizare să știe exact cum să ajusteze fiecare greutate pentru a minimiza pierderea.

Tipuri de Rețele Neurale și Particularități de Antrenament

Diferite arhitecturi de rețele neurale sunt concepute pentru sarcini specifice și, prin urmare, au particularități în procesul lor de antrenament:

Rețele Neurale Artificiale (ANN)

ANN-urile sunt imitații ale sistemului nervos uman, capabile să învețe cunoștințe din experiență și să facă predicții. Ele operează în două faze: învățare și reamintire. În faza de învățare, greutățile conexiunilor sunt ajustate pentru a se adapta la modelul datelor de antrenament. În faza de reamintire, rețeaua antrenată generează răspunsuri pentru datele de testare pe baza parametrilor învățați. Antrenarea ANN-urilor poate dura mai mult, mai ales când se efectuează validare încrucișată. Algoritmii de corectare a erorilor, cum ar fi retropropagarea sau variantele de descendență a gradientului (batch, mini-batch, stocastic – SGD), sunt esențiali. Selecția numărului de straturi ascunse și a funcțiilor de activare este crucială și adesea se face euristic. ANN-urile demonstrează o bună capacitate de generalizare, robustețe și imunitate la zgomot.

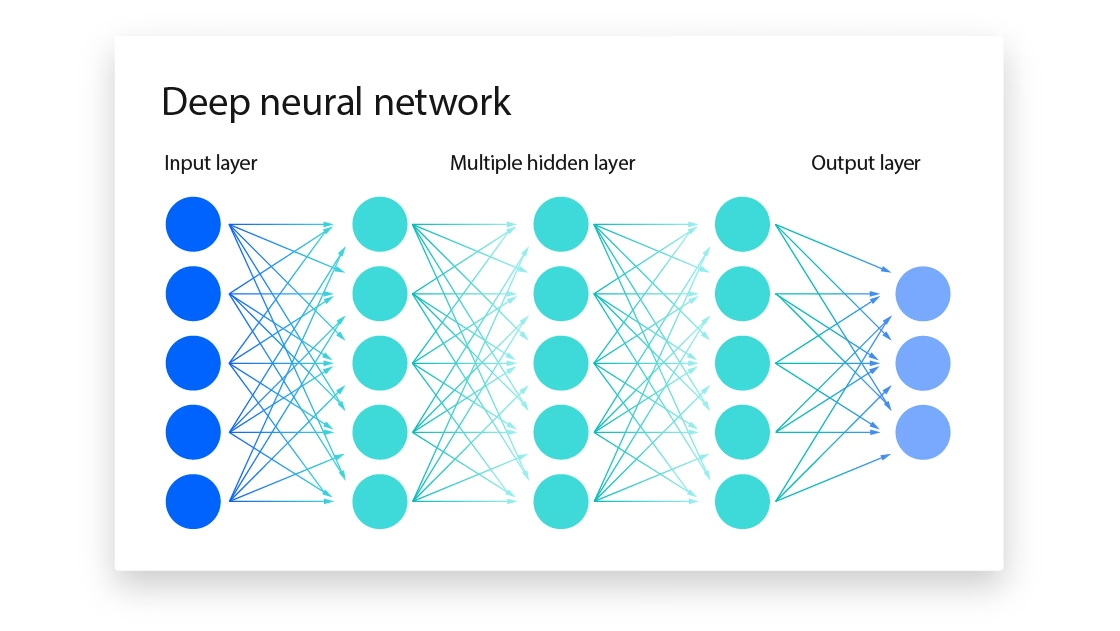

Rețele Neurale Profunde (DNN)

DNN-urile sunt, în esență, ANN-uri cu multiple straturi ascunse. Fiecare strat extrage un set diferit de caracteristici din date, permițând modelarea relațiilor non-liniare complexe. Procesul de antrenare pentru DNN-uri poate fi extrem de intensiv computațional și necesită cantități mari de date. Tehnicile de preprocesare a datelor, cum ar fi K-means clustering sau transformata wavelet discretă (DWT), sunt adesea folosite pentru a pregăti datele pentru antrenament. Algoritmi avansați, cum ar fi Levenberg-Marquardt (LM) sau SGD, sunt utilizați pentru optimizarea greutăților. DNN-urile sunt excelente pentru diagnoza erorilor în sisteme complexe, chiar și în timp real.

Rețele Neurale Convoluționale (CNN)

CNN-urile sunt specializate în procesarea datelor cu o structură de grilă, cum ar fi imaginile. Antrenarea lor implică straturi convoluționale care extrag automat caracteristici ierarhice din date. Deși renumite pentru recunoașterea imaginilor, CNN-urile sunt aplicate și în analiza semnalelor (de exemplu, semnale de eroare în sistemele energetice), unde transformata wavelet continuă poate converti semnalele în imagini grayscale pentru a fi procesate de CNN. Sunt robuste la variațiile de scară și translație.

Mașini de Învățare Extreme (ELM)

ELM-urile sunt rețele neurale feed-forward cu un singur strat ascuns. Spre deosebire de alte tehnici NN, greutățile de intrare și bias-urile nodurilor stratului ascuns în ELM sunt generate aleatoriu și nu sunt ajustate în timpul antrenării. Doar greutățile stratului de ieșire sunt învățate. Această abordare conferă ELM-urilor avantaje semnificative: simplitate în implementare, viteză de învățare mult mai mare, performanță mai bună de generalizare și sunt imune la probleme precum minimele locale și supraînvățarea (over-fitting) care apar în antrenarea bazată pe descendența gradientului. Ele sunt compatibile cu orice funcție de activare non-liniară.

Rețele Neurale ART (Adaptive Resonance Theory)

ART NN-urile includ atât învățarea nesupravegheată, cât și pe cea supravegheată. Ele sunt compuse din trei seturi de neuroni: unitatea de procesare a intrării, unitatea de cluster și unitatea de verificare a similarității. ART1 și ART2 sunt nesupravegheate, în timp ce fuzzy ARTMAP este supravegheată. Acestea sunt utilizate în recunoașterea modelelor și clasificarea erorilor.

Rețele Neurale pe Graf (GCN)

Modelul GCN este propus pentru identificarea și localizarea erorilor în sistemele de distribuție. Acestea sunt robuste la erorile de măsurare și adaptabile la dinamica sistemului de distribuție, oferind o estimare mai bună a localizării erorilor comparativ cu rețelele neuronale complet conectate (FCNN).

Sistemul de Recunoaștere Imunitar Artificial (AIRS)

AIRS este un algoritm de învățare supravegheată inspirat de sistemul imunitar uman. Memoria sa învață caracteristicile fiecărei clase din eșantioanele de antrenament și clasifică noi eșantioane pe baza acestor caracteristici memorate. Acesta poate depăși ANN-urile în multe cazuri, cu o selecție adecvată a valorii pragului.

Considerații Cheie în Antrenamentul Rețelelor Neurale

Antrenarea eficientă a unei rețele neurale depinde de mai mulți factori cruciali:

- Calitatea și Preprocesarea Datelor: Datele curate, relevante și bine structurate sunt fundamentale. Tehnicile de preprocesare, cum ar fi normalizarea, standardizarea, eliminarea zgomotului sau extragerea de caracteristici (folosind, de exemplu, DWT sau HHT), pot influența dramatic performanța antrenamentului. De exemplu, K-means clustering poate fi utilizat pentru preprocesarea datelor și etichetarea acestora.

- Selecția Arhitecturii: Alegerea numărului de straturi ascunse și a numărului de neuroni din fiecare strat este adesea o artă, fără reguli stricte, fiind ghidată de abordări euristice și experimentare.

- Hiperparametri:Rata de învățare, dimensiunea lotului (batch size), numărul de epoci (treceri complete prin setul de date), și funcțiile de activare sunt toți hiperparametri care trebuie ajustați cu grijă. O rată de învățare prea mare poate împiedica convergența, în timp ce una prea mică poate face antrenarea extrem de lentă.

- Algoritmi de Optimizare: Alegerea algoritmului de optimizare (e.g., SGD, Adam, RMSprop, Levenberg-Marquardt) influențează viteza și eficiența convergenței. Unii algoritmi, cum ar fi LM, pot oferi rezultate mai bune decât retropropagarea simplă în anumite scenarii.

- Validare și Generalizare: O rețea bine antrenată nu doar memorează datele de antrenament, ci generalizează bine pe date noi. Tehnicile de validare încrucișată sunt esențiale pentru a evalua capacitatea de generalizare și pentru a preveni supraînvățarea (overfitting).

- Resurse Computaționale: Antrenarea rețelelor profunde necesită timp și resurse computaționale considerabile, mai ales pentru seturi mari de date și arhitecturi complexe. Cu toate acestea, algoritmi precum SGD pot fi mai rapizi decât alte metode.

Tabel Comparativ: Aspecte de Antrenament ale Diferitelor Rețele Neurale

| Tip de Rețea Neurală | Avantaje de Antrenament | Dezavantaje / Considerații | Aplicații Tipice |

|---|---|---|---|

| Rețea Neurală Artificială (ANN) | Robustă, bună generalizare, imunitate la zgomot | Timp de antrenament prelungit, selecția straturilor euristice | Clasificare, regresie, recunoaștere modele |

| Rețea Neurală Profundă (DNN) | Modelare relații non-liniare complexe, extragere automată caracteristici | Necesită date masive și resurse computaționale mari, timp de antrenament lung | Viziune computerizată, procesarea limbajului natural, diagnoza erorilor |

| Rețea Neurală Convoluțională (CNN) | Excelentă pentru date structurate (imagini), extragere ierarhică de caracteristici | Specifică pentru anumite tipuri de date, poate necesita preprocesare complexă | Recunoaștere imagini, analiza semnalelor, clasificarea video |

| Mașină de Învățare Extremă (ELM) | Viteză de învățare foarte mare, evită minimele locale și supraînvățarea, simplitate | Mai puțină flexibilitate arhitecturală față de alte NNs | Clasificare, regresie, sisteme de detectare a erorilor |

| Rețea Neurală ART | Învățare supravegheată și nesupravegheată, adaptabilitate la date noi | Complexitate în ajustarea parametrilor de similaritate | Recunoaștere modele, clasificare dinamică |

Întrebări Frecvente (FAQ)

Q: Cât durează antrenarea unei rețele neurale?

A: Durata antrenării variază enorm în funcție de complexitatea rețelei, dimensiunea și calitatea setului de date, puterea de calcul disponibilă (CPU vs. GPU) și hiperparametrii aleși. Poate dura de la câteva minute pentru modele simple și seturi mici de date, până la zile sau chiar săptămâni pentru rețele profunde, cu miliarde de parametri și seturi de date gigantice. Validarea încrucișată poate prelungi, de asemenea, timpul total de antrenament.

Q: De ce este crucială funcția de pierdere în antrenament?

A: Funcția de pierdere este esențială deoarece oferă un feedback cantitativ despre cât de bine performează rețeaua. Fără ea, nu am avea o metrică obiectivă pentru a măsura eroarea și, prin urmare, nu am ști în ce direcție să ajustăm greutățile rețelei pentru a o îmbunătăți. Este busola care ghidează procesul de învățare.

Q: Ce este rata de învățare și de ce este importantă?

A: Rata de învățare este un hiperparametru care controlează mărimea pasului la fiecare iterație în timpul actualizării greutăților rețelei. Este importantă deoarece o valoare prea mare poate face ca algoritmul să „sară” peste minimul global al funcției de pierdere, ducând la divergență sau instabilitate. O valoare prea mică poate face ca antrenarea să fie extrem de lentă, necesitând un număr mare de iterații pentru a ajunge la convergență. Găsirea unei rate de învățare optime este adesea o parte critică a procesului de antrenament.

Q: Ce se întâmplă dacă o rețea neurală se supraînvăță (overfitting)?

A: Supraînvățarea apare atunci când o rețea neurală învață „prea bine” datele de antrenament, memorând zgomotul și particularitățile specifice setului de antrenament, în loc să învețe modelele generale. Ca rezultat, performanța rețelei este excelentă pe datele de antrenament, dar scade dramatic pe date noi, nevăzute. Tehnici precum regularizarea, abandonul (dropout) sau utilizarea mai multor date de antrenament pot ajuta la prevenirea supraînvățării.

Q: Ce este un algoritm de retropropagare?

A: Algoritmul de retropropagare este o metodă eficientă de calcul a gradientului funcției de pierdere în raport cu greutățile unei rețele neurale. El funcționează prin aplicarea regulii înlănțuirii din calculul diferențial, propagând eroarea înapoi de la stratul de ieșire la straturile anterioare. Acest algoritm este fundamental pentru aproape toate metodele moderne de antrenare a rețelelor neurale, permițând ajustarea precisă a greutăților pentru a minimiza eroarea.

Dacă vrei să descoperi și alte articole similare cu Antrenarea Rețelelor Neurale: Ghid Complet, poți vizita categoria Fitness.