29/09/2022

În lumea dinamică a inteligenței artificiale și a învățării automate, rețelele neuronale reprezintă un pilon fundamental, capabile să rezolve probleme complexe, de la recunoașterea imaginilor la procesarea limbajului natural. Dar cum ajung aceste rețele să „învețe”? Răspunsul stă în algoritmii lor de antrenare, mecanisme sofisticate care le permit să-și ajusteze parametrii pentru a minimiza erorile și a face predicții cât mai precise. Înțelegerea acestor algoritmi nu este doar o chestiune academică, ci o necesitate practică pentru oricine dorește să construiască și să optimizeze modele de inteligență artificială performante.

Fundamentele Antrenării Rețelelor Neurale

Pentru a înțelege pe deplin cum funcționează algoritmii de antrenare, este crucial să ne familiarizăm cu câțiva termeni cheie. Acești termeni definesc modul în care datele sunt procesate și cum progresează învățarea:

- Lot (Batch): Reprezintă setul complet de date de antrenare disponibile. Dimensiunea lotului este numărul total de exemple de antrenare din setul de date. Atunci când se lucrează cu un lot complet, algoritmul procesează toate datele simultan înainte de a efectua o actualizare a parametrilor.

- Dimensiunea Mini-lotului (Mini-batch size): Este numărul de exemple pe care algoritmul de învățare le procesează într-o singură trecere (înainte și înapoi). Aceasta este o submulțime a lotului complet. Alegerea dimensiunii mini-lotului este un aspect crucial care influențează atât viteza, cât și stabilitatea antrenării.

- Mini-lot (Mini-batch): O mică parte a setului de date, având o dimensiune predefinită a mini-lotului. Rețelele neuronale sunt adesea antrenate pe mini-loturi pentru a echilibra eficiența computațională cu stabilitatea antrenării.

- Iterații (Iterations): Numărul de mini-loturi de date pe care algoritmul le-a „văzut” sau, mai simplu, numărul de treceri pe care algoritmul le-a efectuat pe o parte a setului de date. Dacă setul de date este împărțit în N mini-loturi, atunci pentru a parcurge o dată întregul set de date, vor fi necesare N iterații.

- Epoci (Epochs): Numărul de ori în care un algoritm de învățare a parcurs întregul set de date de antrenare. O singură epocă înseamnă că fiecare exemplu din setul de date a fost utilizat cel puțin o dată pentru a actualiza ponderile rețelei. Numărul de epoci este un hyperparametru important care controlează cât de mult timp se antrenează rețeaua.

Algoritmul Gradient Descent și Variantele Sale

La inima majorității algoritmilor de antrenare a rețelelor neuronale se află conceptul de Gradient Descent. Acesta este un algoritm de optimizare iterativ care are scopul de a găsi minimul unei funcții de cost. Practic, Gradient Descent calculează panta (gradientul) funcției de cost în raport cu parametrii rețelei și apoi ajustează acești parametri într-o direcție care reduce costul. Imaginați-vă că sunteți într-o vale cu ceață densă și încercați să găsiți cel mai jos punct; Gradient Descent este ca și cum ați face pași mici în direcția în care panta este cea mai abruptă în jos.

Gradient Descent pe Lot (Batch Gradient Descent - BGD)

În Batch Gradient Descent, întregul set de date de antrenare este procesat înainte de a efectua o singură actualizare a ponderilor rețelei. Aceasta înseamnă că gradientul este calculat pe baza tuturor exemplelor din setul de date. Dezavantajul principal este că poate fi extrem de lent pentru seturi de date mari, deoarece necesită multă memorie și timp de calcul pentru fiecare actualizare. Cu toate acestea, oferă o convergență mai lină și este garantat să găsească un optim (local sau global, în funcție de funcția de cost) dacă acesta există.

Gradient Descent Stocastic (Stochastic Gradient Descent - SGD)

Stochastic Gradient Descent este un caz special al Gradient Descent pe mini-loturi, în care dimensiunea mini-lotului este 1. Adică, pentru fiecare actualizare a ponderilor, se folosește un singur exemplu de antrenare. Acest lucru face ca procesul să fie mult mai rapid și mai eficient din punct de vedere computațional, mai ales pentru seturi de date foarte mari. Însă, gradientul calculat pe un singur exemplu este mult mai zgomotos, ceea ce duce la o convergență mai fluctuantă. SGD poate fi mai bun la evitarea minimelor locale, „sărind” peste ele datorită zgomotului.

Gradient Descent pe Mini-Loturi (Mini-batch Gradient Descent)

Acesta este cel mai comun și adesea cel mai eficient algoritm de antrenare în practică. Mini-batch Gradient Descent combină avantajele BGD și SGD. În loc să proceseze întregul set de date sau un singur exemplu, el procesează un mini-lot de exemple (de obicei între 16 și 256 de exemple) pentru fiecare actualizare a ponderilor. Acest lucru oferă un echilibru bun între stabilitatea convergenței (mai puțin zgomotos decât SGD) și eficiența computațională (mult mai rapid decât BGD pentru seturi mari de date).

Tabel Comparativ: Variantele Gradient Descent

Pentru a înțelege mai bine diferențele, iată o comparație concisă:

| Caracteristică | Batch Gradient Descent (BGD) | Stochastic Gradient Descent (SGD) | Mini-batch Gradient Descent |

|---|---|---|---|

| Dimensiunea Lotului | Întregul set de date | 1 exemplu | Între 16 și 256 de exemple |

| Frecvența Actualizării | O dată per epocă | De mai multe ori per epocă (pentru fiecare exemplu) | De mai multe ori per epocă (pentru fiecare mini-lot) |

| Viteza Antrenării | Foarte lentă | Foarte rapidă (per iterație), dar zgomotoasă | Echilibrată, rapidă în practică |

| Stabilitatea Convergenței | Lină, stabilă | Zgomotoasă, fluctuantă | Relativ lină, echilibrată |

| Utilizarea Memoriei | Mare | Mică | Moderată |

| Risc de Minime Locale | Mai mare | Mai mic (poate sări peste ele) | Moderat |

Optimizarea Procesului de Antrenare

Pe lângă alegerea algoritmului de Gradient Descent, există și alți factori cruciali care influențează succesul antrenării:

- Rata de Învățare (Learning Rate): Acest hyperparametru controlează mărimea pașilor făcuți în direcția gradientului. O rată de învățare prea mare poate face ca algoritmul să „sară” peste minim, în timp ce o rată prea mică poate duce la o convergență lentă sau la blocarea într-un minim local. Optimizarea ratei de învățare este esențială și adesea se folosesc programe de scădere a ratei de învățare pe parcursul antrenării.

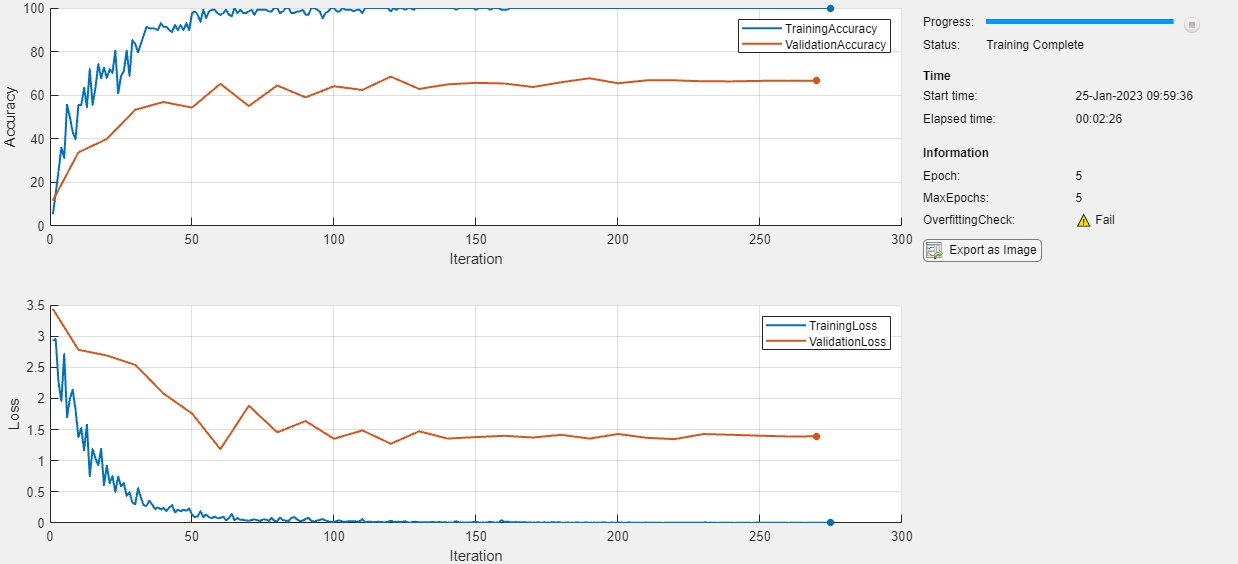

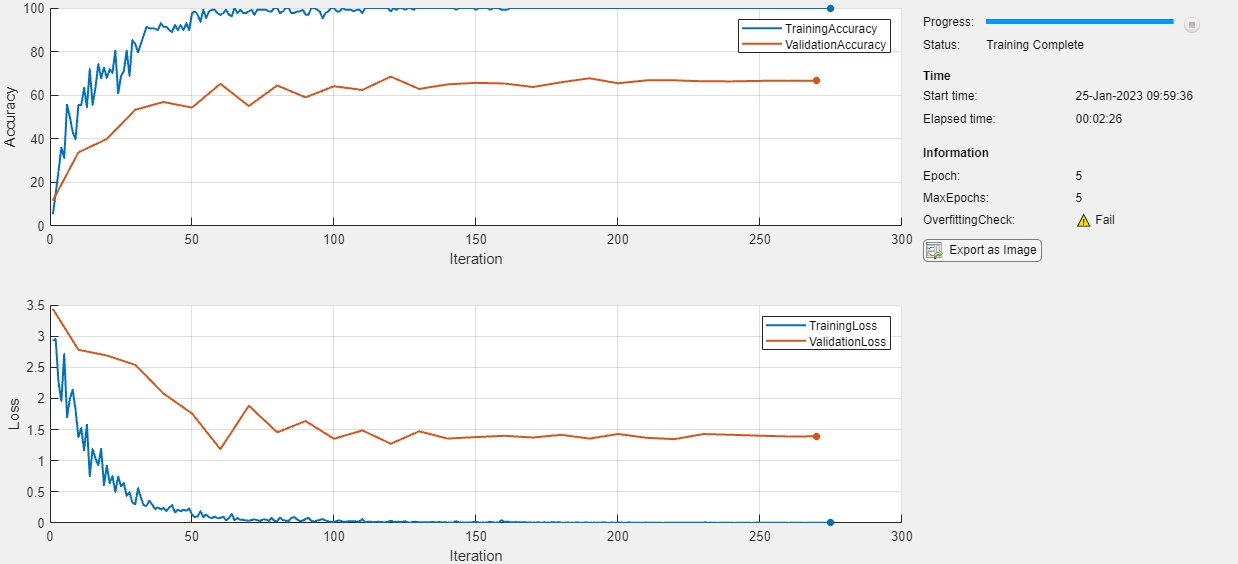

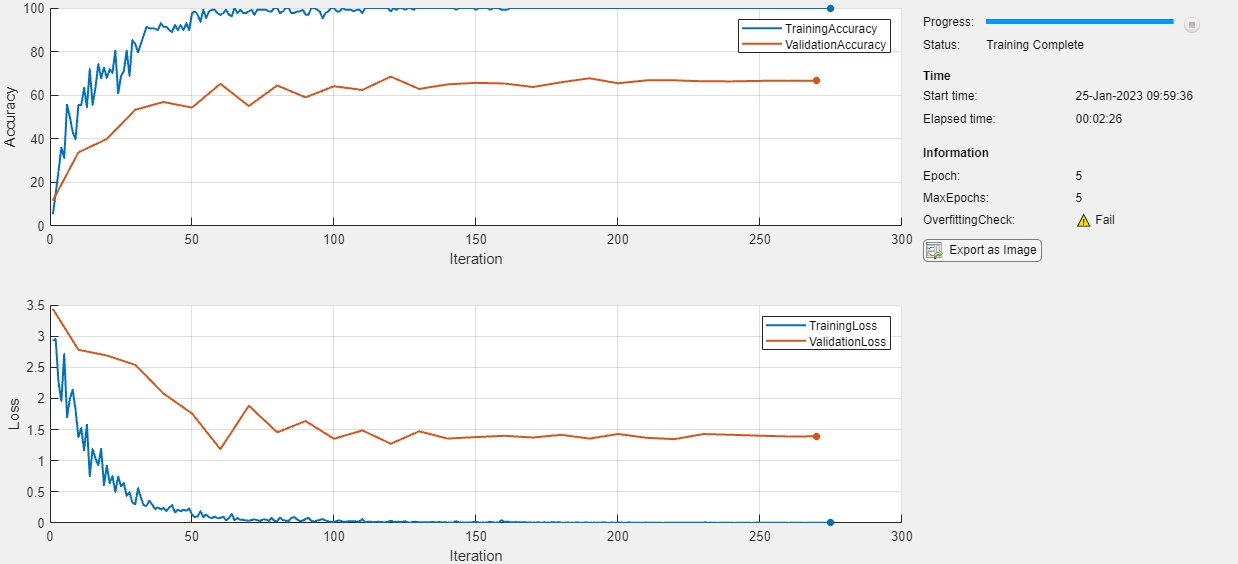

- Prevenirea Supra-antrenării (Overfitting): Un model supra-antrenare performează excelent pe datele de antrenare, dar slab pe date noi, nevăzute. Acest lucru se întâmplă când modelul învață prea mult „zgomot” din datele de antrenare. Strategii cheie pentru a combate supra-antrenarea includ:

- Regularizarea (L1, L2): Adaugă un termen de penalizare la funcția de cost pentru a descuraja ponderile mari, forțând modelul să fie mai simplu.

- Oprirea Timpurie (Early Stopping): Monitorizează performanța modelului pe un set de validare separat și oprește antrenarea atunci când performanța pe setul de validare începe să se deterioreze, chiar dacă performanța pe setul de antrenare continuă să se îmbunătățească.

- Augmentarea Datelor: Crearea de noi exemple de antrenare prin aplicarea unor transformări (rotații, scalări, răsturnări) datelor existente. Aceasta ajută la creșterea diversității setului de antrenare fără a colecta date suplimentare, făcând modelul mai robust.

- Dropout: O tehnică în care neuroni aleatori sunt „dezactivați” temporar în timpul antrenării, forțând rețeaua să nu se bazeze prea mult pe un singur neuron și să învețe caracteristici mai robuste.

Antrenarea Rețelelor Neurale cu MATLAB

MATLAB oferă un mediu puternic și intuitiv pentru dezvoltarea și antrenarea rețelelor neuronale, în special prin Toolbox-ul de Rețele Neurale. Acesta simplifică multe aspecte complexe ale procesului, oferind funcții predefinite pentru configurare și antrenare.

Setarea Opțiunilor de Antrenare

Când antrenați o rețea în MATLAB, folosiți funcția trainingOptions pentru a configura hyperparametrii algoritmului de antrenare. De exemplu, options = trainingOptions('sgdm', 'InitialLearnRate', 0.03, 'MaxEpochs', 10, 'ValidationData', set9, 'ValidationFrequency', 5, 'Verbose', false, 'ValidationPatience', Inf, 'Plots', 'training-progress'); setează un optimizator SGD cu impuls (momentum), rata de învățare inițială, numărul maxim de epoci, setul de validare și alte opțiuni.

Clarificarea „Iterațiilor per Epocă” în MATLAB

Există uneori confuzie legată de termenul „iterații per epocă” în MATLAB. Unii utilizatori pot seta o valoare fixă pentru aceasta, așteptându-se ca MATLAB să o respecte literal. Este important să înțelegem că o epocă reprezintă o singură trecere completă prin întregul set de date de antrenare. Dacă antrenarea se face pe mini-loturi, atunci o epocă va necesita un număr de iterații (egal cu numărul de mini-loturi necesare pentru a acoperi întregul set de date). Dacă observați că MATLAB „crește” numărul de iterații per epocă, cel mai probabil nu se referă la un număr fix setat de dvs., ci la numărul de mini-loturi pe care le procesează pentru a finaliza o epocă, care poate varia în funcție de modul în care își gestionează datele sau dacă face ajustări interne. Setarea MaxEpochs la 10 și ValidationFrequency la 5 înseamnă că validarea se va realiza la fiecare 5 epoci, nu că veți avea doar 5 iterații. Numărul total de iterații este determinat de MaxEpochs și de raportul dintre dimensiunea setului de date și dimensiunea mini-lotului.

Antrenarea Paralelă pentru Eficiență

Pentru seturi de date mari sau rețele complexe, antrenarea poate dura mult timp. MATLAB, în combinație cu Parallel Computing Toolbox™, permite antrenarea rețelelor în paralel, distribuind sarcina computațională pe mai multe procesoare sau mașini. Aceasta accelerează semnificativ procesul de antrenare, utilizând resursele hardware disponibile la maximum. Exemplul net = train(net,X,T, 'useParallel', 'yes', 'showResources', 'yes' ); demonstrează activarea antrenării paralele.

Distribuirea Manuală a Datelor cu Valori Composite

Când setul de date este atât de mare încât nu încape în memoria RAM a unui singur worker, puteți distribui manual datele folosind valori Composite. Această metodă permite ca fiecare parte a setului de date să încapă în RAM-ul unui worker individual, iar întregul set de date este limitat doar de RAM-ul total al tuturor worker-ilor combinați. Această abordare este extrem de utilă pentru gestionarea eficientă a datelor la scară largă în medii de calcul paralel.

Numărul de Iterații și Dimensiunea Setului de Antrenare

O întrebare frecventă este legată de numărul optim de iterații și de dimensiunea setului de antrenare. De exemplu, dacă aveți un set de antrenare de 350 de exemple și unul de test de 150, este suficient un număr mare de iterații (să zicem 1000) fără a risca supra-antrenarea?

Numărul de iterații (și implicit de epoci) necesar depinde de complexitatea problemei, de dimensiunea și diversitatea setului de date, de arhitectura rețelei și de rata de învățare. Un număr prea mare de iterații, mai ales pe un set de date mic, crește semnificativ riscul de supra-antrenare. Modelul începe să memoreze zgomotul și specificul datelor de antrenare, pierzând capacitatea de a generaliza pe date noi.

Pentru a evita supra-antrenarea, este esențial să monitorizați performanța modelului pe un set de validare separat. Dacă performanța pe setul de antrenare continuă să se îmbunătățească, dar performanța pe setul de validare stagnează sau începe să scadă, acesta este un semn clar de supra-antrenare și ar trebui să opriți antrenarea (folosind Early Stopping) sau să aplicați tehnici de regularizare. Nu există un număr magic de iterații; este un proces iterativ de experimentare și monitorizare.

Întrebări Frecvente (FAQ)

- Ce este o epocă?

- O epocă reprezintă o trecere completă a algoritmului de antrenare prin întregul set de date de antrenare. La sfârșitul fiecărei epoci, toate exemplele din setul de date au fost utilizate cel puțin o dată pentru a actualiza ponderile rețelei.

- Câte iterații sunt într-o epocă?

- Numărul de iterații dintr-o epocă depinde de dimensiunea setului de date și de dimensiunea mini-lotului. Formula este:

Număr de Iterații per Epocă = Ceil(Dimensiunea Setului de Date / Dimensiunea Mini-lotului). De exemplu, dacă aveți 1000 de exemple și o dimensiune a mini-lotului de 32, o epocă va aveaCeil(1000/32) = 32iterații. - Cum aleg dimensiunea mini-lotului?

- Alegerea dimensiunii mini-lotului este un compromis. Dimensiuni mici (ex. 1) duc la SGD, care este rapid dar zgomotos. Dimensiuni mari (ex. întregul lot) duc la BGD, care este lent dar stabil. Dimensiunile moderate (ex. 32, 64, 128, 256) sunt adesea cele mai eficiente în practică, oferind un echilibru bun între viteză și stabilitate. Experimentarea este cheia.

- Cum evit supra-antrenarea?

- Utilizează tehnici precum Oprirea Timpurie (Early Stopping), regularizarea (L1, L2), Dropout, și augmentarea datelor. Monitorizează constant performanța pe un set de validare și oprește antrenarea când performanța pe acest set începe să scadă.

- De ce MATLAB îmi modifică numărul de iterații?

- Dacă ați setat

'Iterations per epoch'la o valoare specifică și observați că MATLAB o crește, este posibil să fie o confuzie terminologică sau o optimizare internă a MATLAB. De obicei, numărul de iterații este calculat automat pentru a asigura că o epocă este o trecere completă prin toate datele. MATLAB ar putea ajusta dinamic modul în care procesează mini-loturile pentru a optimiza performanța sau pentru a se asigura că toate datele sunt văzute un număr specific de ori în cadrul epocilor definite. Asigurați-vă că distingeți între numărul total de iterații necesare pentru a finaliza o epocă și frecvența de validare sau alte setări.

Concluzie

Antrenarea rețelelor neuronale este un proces complex, dar fundamental pentru succesul aplicațiilor de inteligență artificială. Înțelegerea algoritmilor precum Gradient Descent și a variantelor sale, împreună cu gestionarea eficientă a hyperparametrilor și a tehnicilor de optimizare precum prevenirea supra-antrenării, este esențială. Indiferent dacă folosiți MATLAB sau alte platforme, stăpânirea acestor concepte vă va permite să construiți modele mai robuste, mai precise și mai eficiente, deschizând noi orizonturi în explorarea potențialului vast al învățării automate.

Dacă vrei să descoperi și alte articole similare cu Algoritmi de Antrenare Rețele Neurale: Ghid Complet, poți vizita categoria Fitness.