13/10/2021

În era digitală actuală, volumul de date generat crește exponențial. De la analize financiare la imagini medicale și interacțiuni pe rețelele sociale, seturile de date pot deveni rapid atât de masive încât depășesc capacitatea memoriei principale a unui computer. Această provocare majoră necesită abordări inovatoare pentru antrenarea modelelor de Machine Learning. Scikit-learn, una dintre cele mai populare biblioteci de învățare automată în Python, oferă o soluție elegantă pentru această problemă prin metoda sa partial_fit(), permițând învățarea incrementală pe loturi de date. Acest articol vă va ghida prin conceptul, utilizările și avantajele acestei funcții esențiale.

De Ce Avem Nevoie de partial_fit()?

Scikit-learn este larg recunoscută și utilizată în comunitatea de Machine Learning datorită API-ului său simplu și intuitiv. Permite dezvoltatorilor să antreneze rapid modele complexe cu doar câteva linii de cod, fără a necesita o înțelegere profundă a mecanismelor interne ale fiecărui algoritm. Cu toate acestea, majoritatea algoritmilor disponibili prin Scikit-learn au o limitare semnificativă: ei necesită ca întregul set de date de antrenament să încapă în memoria RAM a computerului.

Problema apare când ne confruntăm cu date masive, care sunt tot mai comune în prezent. Seturile de date de zeci sau sute de gigabytes nu mai sunt o excepție, iar acestea pur și simplu nu pot fi încărcate în întregime în memoria principală. Bibliotecile de rețele neuronale profunde, precum PyTorch, TensorFlow sau Keras, au abordat de mult timp această problemă, permițând antrenarea pe loturi de date, unde doar o mică porțiune din date este încărcată în memorie la un moment dat. Această metodă este extrem de eficientă pentru gestionarea datelor mari.

Pentru a rezolva această limitare și în Scikit-learn, funcția partial_fit() a fost introdusă. Aceasta permite antrenarea modelelor într-un mod incremental, procesând datele în loturi mici. Astfel, chiar și cu seturi de date care nu se potrivesc în întregime în memoria principală, puteți continua să utilizați puterea și flexibilitatea Scikit-learn.

Cum Funcționează partial_fit()?

Metoda partial_fit() permite unui estimator să învețe din date în mod incremental, actualizându-și parametrii cu fiecare lot de date procesat. Spre deosebire de metoda tradițională fit(), care antrenează modelul o singură dată pe întregul set de date și actualizează greutățile odată, partial_fit() actualizează greutățile modelului pentru fiecare lot individual. Acest proces se repetă, parcurgând întregul set de date în mai multe "epoci" (treceri complete prin toate loturile de date).

Fluxul de lucru tipic implică:

- Împărțirea setului de date mare în loturi mai mici, care pot fi încărcate în memorie.

- Crearea unei instanțe a unui estimator Scikit-learn care suportă

partial_fit(). - Iterarea prin loturile de date.

- Pentru fiecare lot, apelarea metodei

partial_fit()pe estimator, furnizând lotul curent de date. - Repetarea acestui proces pentru un număr predefinit de epoci, până când modelul atinge o performanță satisfăcătoare.

Este crucial de reținut că nu toți estimatorii din Scikit-learn dispun de metoda partial_fit(). Doar anumiți algoritmi, proiectați pentru învățare incrementală sau online, o suportă. Acești estimatori sunt adesea algoritmi de tip "online learning" sau "mini-batch learning".

Estimatori Scikit-learn care Suportă Învățarea Incrementală

Iată o listă a categoriilor de algoritmi și a estimatorilor specifici din Scikit-learn care oferă suport pentru metoda partial_fit(), permițând procesarea incrementală a datelor:

| Categorie ML | Estimatori cu partial_fit() |

|---|---|

| Regresie | sklearn.linear_model.SGDRegressorsklearn.linear_model.PassiveAggressiveRegressorsklearn.neural_network.MLPRegressor |

| Clasificare | sklearn.naive_bayes.MultinomialNBsklearn.naive_bayes.BernoulliNBsklearn.linear_model.Perceptronsklearn.linear_model.SGDClassifiersklearn.linear_model.PassiveAggressiveClassifiersklearn.neural_network.MLPClassifier |

| Clustering | sklearn.cluster.MiniBatchKMeanssklearn.cluster.Birch |

| Preprocesare | sklearn.preprocessing.StandardScalersklearn.preprocessing.MinMaxScalersklearn.preprocessing.MaxAbsScaler |

| Reducerea Dimensionalității | sklearn.decomposition.MiniBatchDictionaryLearningsklearn.decomposition.IncrementalPCAsklearn.decomposition.LatentDirichletAllocation |

Exemple Practice de Utilizare a partial_fit()

Pentru a ilustra modul în care partial_fit() este utilizat în diverse sarcini de Machine Learning, vom descrie procesul pentru fiecare categorie, simulând scenarii cu seturi de date mari, împărțite în loturi.

Regresie Incrementală

În sarcinile de regresie, prezicem o valoare continuă. Atunci când setul de date este prea mare pentru a fi încărcat integral, putem folosi estimatori precum SGDRegressor. Acest model liniar, bazat pe descendentul de gradient stocastic (SGD), este ideal pentru învățarea incrementală.

Procesul implică generarea unui set de date artificial mare (de exemplu, 240.000 de eșantioane cu 100 de caracteristici), împărțirea acestuia în seturi de antrenament și test, și apoi rearanjarea datelor în loturi. De exemplu, loturi de câte 24 de eșantioane. Modelul SGDRegressor este inițializat și apoi antrenat într-o buclă, unde la fiecare pas se alimentează un lot de date prin partial_fit(). Această buclă se repetă pentru un număr fix de epoci (de exemplu, 10), asigurând că modelul parcurge toate datele de mai multe ori. După antrenament, performanța modelului este evaluată pe datele de test și de antrenament folosind metrici precum Eroarea Pătratică Medie (MSE) și scorul R^2, demonstrând acuratețea obținută prin învățarea incrementală.

Clasificare Incrementală

Pentru sarcinile de clasificare, unde prezicem o categorie, partial_fit() este la fel de util. Estimatori precum SGDClassifier, care de asemenea utilizează descendentul de gradient stocastic, pot gestiona eficient seturi de date mari.

Aici, un set de date de clasificare (de exemplu, 32.000 de eșantioane cu 30 de caracteristici și 2 clase) este generat și împărțit în loturi (de exemplu, 32 de eșantioane pe lot). Un SGDClassifier este inițializat. Antrenarea se realizează prin iterarea pe loturile de date și apelarea partial_fit() pentru fiecare lot. Este important să se specifice toate clasele posibile la primul apel partial_fit() dacă acestea nu sunt prezente în primul lot. După antrenament pe parcursul mai multor epoci, acuratețea modelului este calculată pe seturile de date de test și de antrenament. Acest exemplu subliniază cum clasificarea poate fi realizată eficient chiar și cu constrângeri de memorie.

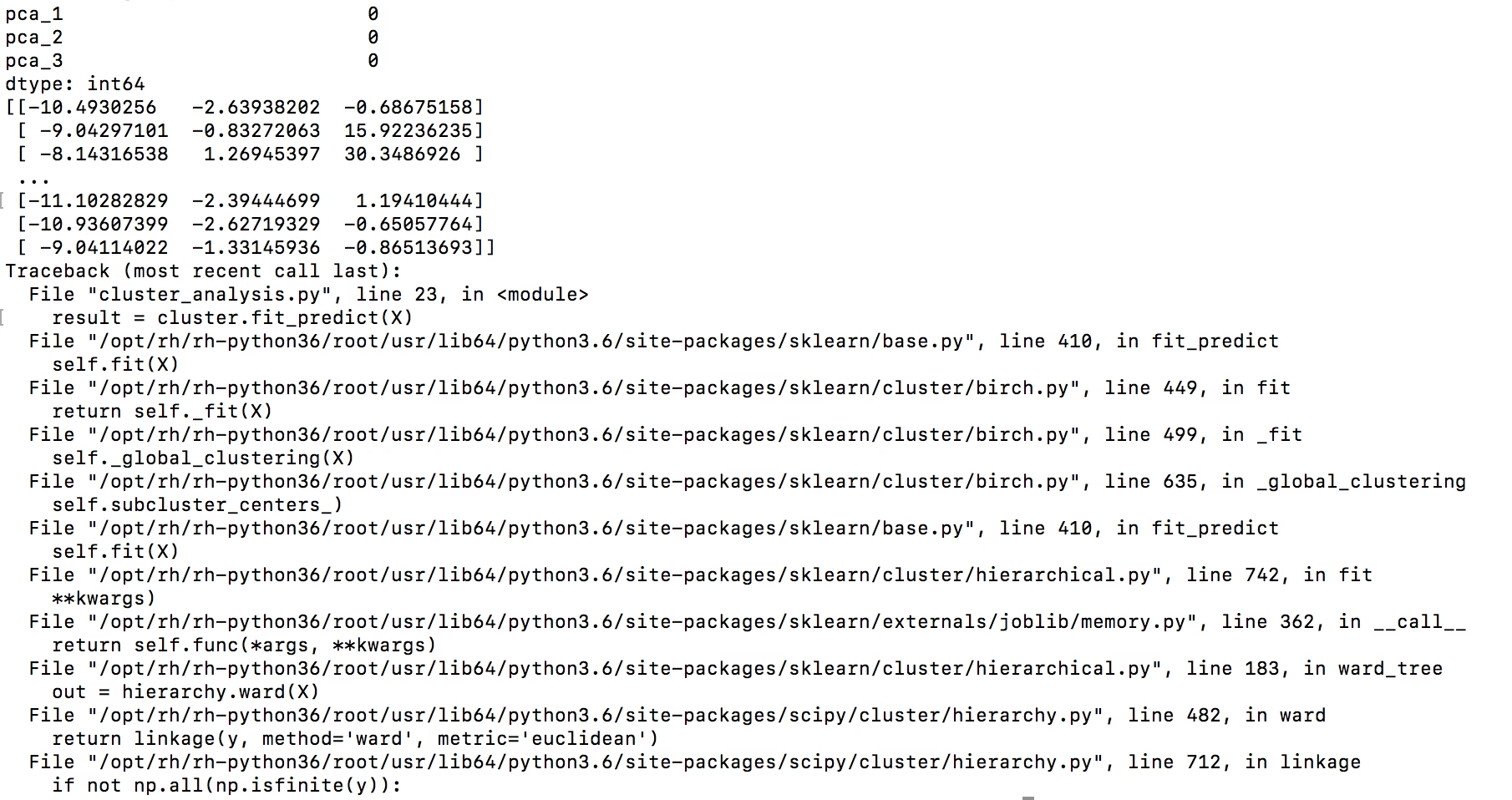

Clustering Incremental

Clusteringul este o sarcină de învățare nesupravegheată, unde datele sunt grupate în clustere bazate pe similaritate. Pentru seturi de date mari, algoritmi precum MiniBatchKMeans sunt esențiali. MiniBatchKMeans este o variantă a algoritmului K-Means care utilizează mini-loturi pentru a reduce timpul de calcul și memoria necesară.

Un set de date de clustering (de exemplu, 32.000 de eșantioane cu 30 de caracteristici și 5 clustere) este creat și împărțit în loturi. O instanță de MiniBatchKMeans este inițializată cu numărul dorit de clustere. Procesul de antrenament implică parcurgerea loturilor de date și apelarea partial_fit() pentru fiecare lot. Acest estimator actualizează centrele clusterelor incremental. Evaluarea performanței clusteringului se face folosind metrici precum adjusted_rand_score(), care măsoară similaritatea dintre clusterii prezisi și etichetele reale (dacă sunt disponibile), demonstrând capacitatea de a grupa eficient datele masive.

Preprocesare Incrementală a Datelor

Preprocesarea datelor, cum ar fi scalarea, este un pas crucial în multe pipeline-uri de Machine Learning. Pentru seturi de date mari, chiar și calcularea mediei și a deviației standard pentru scalare poate fi o provocare. Estimatori precum StandardScaler, MinMaxScaler și MaxAbsScaler suportă partial_fit() pentru a învăța parametrii de scalare incremental.

Un set de date de regresie mare (similar cu exemplul de regresie) este generat. Mai întâi, un StandardScaler este antrenat incremental pe loturi de date de antrenament folosind partial_fit(). Astfel, scalerul își ajustează parametrii (media și varianța) pe măsură ce vede mai multe date, fără a încărca totul în memorie. După ce scalerul este "învățat", datele (atât de antrenament, cât și de test) sunt transformate lot cu lot folosind metoda transform(). Apoi, un model de regresie (SGDRegressor) este antrenat pe aceste date scalate, tot incremental, cu partial_fit(). Această abordare demonstrează cum chiar și etapele de preprocesare pot fi optimizate pentru date masive, asigurând că întregul pipeline de Machine Learning rămâne eficient.

Reducerea Incrementală a Dimensionalității

Reducerea dimensionalității este o tehnică utilizată pentru a reduce numărul de caracteristici dintr-un set de date, menținând în același timp cât mai multă informație posibilă. Aceasta este esențială pentru a gestiona complexitatea și timpul de calcul al modelelor. Pentru seturi de date mari, estimatori precum IncrementalPCA permit reducerea dimensionalității în mod incremental.

Un set de date de clasificare mare este generat. Un IncrementalPCA este inițializat cu un număr dorit de componente (de exemplu, reducând 30 de caracteristici la 20). Acest estimator este apoi antrenat incremental pe loturi de date de antrenament folosind partial_fit(), învățând componentele principale pe măsură ce procesează datele. După ce IncrementalPCA este "învățat", datele (atât de antrenament, cât și de test) sunt transformate în dimensiunea redusă, lot cu lot, folosind metoda transform(). În final, un model de clasificare (SGDClassifier) este antrenat pe aceste date cu dimensiune redusă, tot incremental, cu partial_fit(). Acest exemplu ilustrează cum reducerea dimensionalității poate fi aplicată eficient pe seturi de date uriașe, îmbunătățind performanța și eficiența antrenamentului modelului final.

Întrebări Frecvente (FAQ)

Pentru a clarifica aspectele cheie ale utilizării partial_fit(), iată câteva întrebări frecvente:

Toți estimatorii Scikit-learn suportă partial_fit()?

Nu. Doar anumiți estimatori, proiectați pentru învățare incrementală sau online, dispun de această metodă. Lista include algoritmi precum SGDClassifier, MiniBatchKMeans, StandardScaler și IncrementalPCA.

Când ar trebui să folosesc partial_fit()?partial_fit() este ideal în două scenarii principale: 1) când setul de date este prea mare pentru a încăpea în întregime în memoria RAM a computerului; 2) când lucrați cu fluxuri de date (data streaming) și datele ajung incremental, permițând modelului să se adapteze continuu.

Ce sunt "epocile" în contextul partial_fit()?

O epocă reprezintă o trecere completă prin întregul set de date de antrenament. Atunci când folosiți partial_fit(), de obicei, iterați prin toate loturile de date pentru a finaliza o epocă. Repetarea acestui proces pentru mai multe epoci ajută modelul să învețe mai bine din date.

Este partial_fit() la fel de precis ca fit()?

În multe cazuri, un model antrenat cu partial_fit() pe parcursul mai multor epoci poate atinge o performanță comparabilă cu un model antrenat cu fit(), presupunând că parametrii (rata de învățare, numărul de epoci) sunt bine ajustați. Avantajul major este capacitatea de a antrena pe seturi de date ce depășesc memoria disponibilă.

Pot salva un model antrenat cu partial_fit()?

Da, un model antrenat incremental cu partial_fit() poate fi serializat (salvat) și deserializat (încărcat) la fel ca orice alt model Scikit-learn, folosind biblioteci precum pickle sau joblib.

Concluzie

Metoda partial_fit() din Scikit-learn este o unealtă puternică și indispensabilă în arsenalul oricărui specialist în Machine Learning care se confruntă cu loturi de date uriașe. Ea transformă o limitare tehnică majoră (memoria RAM) într-o oportunitate de a construi modele robuste și eficiente pe seturi de date la scară largă, deschizând calea către aplicații mai complexe și mai performante. Prin înțelegerea și aplicarea corectă a învățării incrementale, puteți debloca potențialul deplin al datelor dumneavoastră, indiferent de dimensiunea acestora.

Dacă vrei să descoperi și alte articole similare cu Antrenament Incremental cu Scikit-learn, poți vizita categoria Fitness.