27/12/2023

În vasta și dinamică lume a inteligenței artificiale și a învățării automate (Machine Learning), există concepte fundamentale care au pus bazele dezvoltării algoritmilor complecși pe care îi vedem astăzi. Unul dintre aceste concepte pilon este Perceptronul. Inventat de Frank Rosenblatt în 1957, Perceptronul reprezintă una dintre cele mai timpurii forme de rețea neuronală artificială și un clasificator liniar esențial. Deși simplu în concepție și limitat la problemele liniar separabile, a deschis calea pentru înțelegerea și dezvoltarea rețelelor neuronale mult mai sofisticate. În acest articol, vom explora în detaliu ce este un Perceptron, cum funcționează, cum este antrenat și cum putem evalua performanța sa, concentrându-ne pe sarcina de clasificare binară – adică distingerea între două categorii distincte.

- Ce Este un Perceptron?

- Cum Funcționează Perceptronul? O Rețetă în 5 Pași

- Avantaje și Dezavantaje ale Algoritmului Perceptron

- Întrebări Frecvente despre Perceptron

- 1. Ce este diferența cheie între un Perceptron și o rețea neuronală modernă?

- 2. De ce este important să studiem Perceptronul dacă are limitări?

- 3. Poate Perceptronul să rezolve probleme de clasificare multi-clasă?

- 4. Ce se întâmplă dacă un set de date nu este liniar separabil?

- 5. Este Perceptronul utilizat în practică astăzi?

Ce Este un Perceptron?

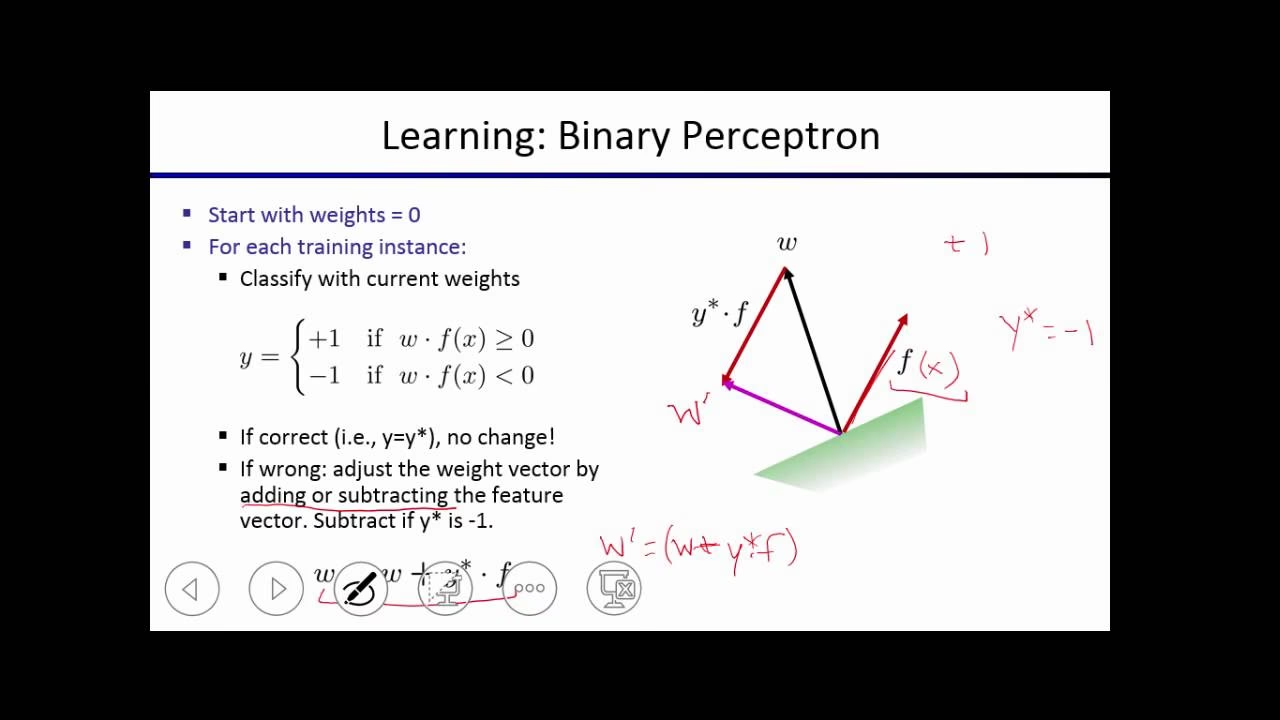

Perceptronul este, în esență, un algoritm de învățare supervizată pentru clasificarea binară. Imaginează-ți că ai o mulțime de puncte pe un grafic și vrei să le separi în două grupuri distincte printr-o linie dreaptă. Perceptronul face exact asta: găsește o "linie" (sau o hiperplană în spații multidimensionale) care separă clasele. Este un clasificator liniar, ceea ce înseamnă că ia decizii bazate pe o combinație liniară a intrărilor sale. Pentru clasificare binară, avem două clase: pozitive și negative, adesea reprezentate ca +1 și -1.

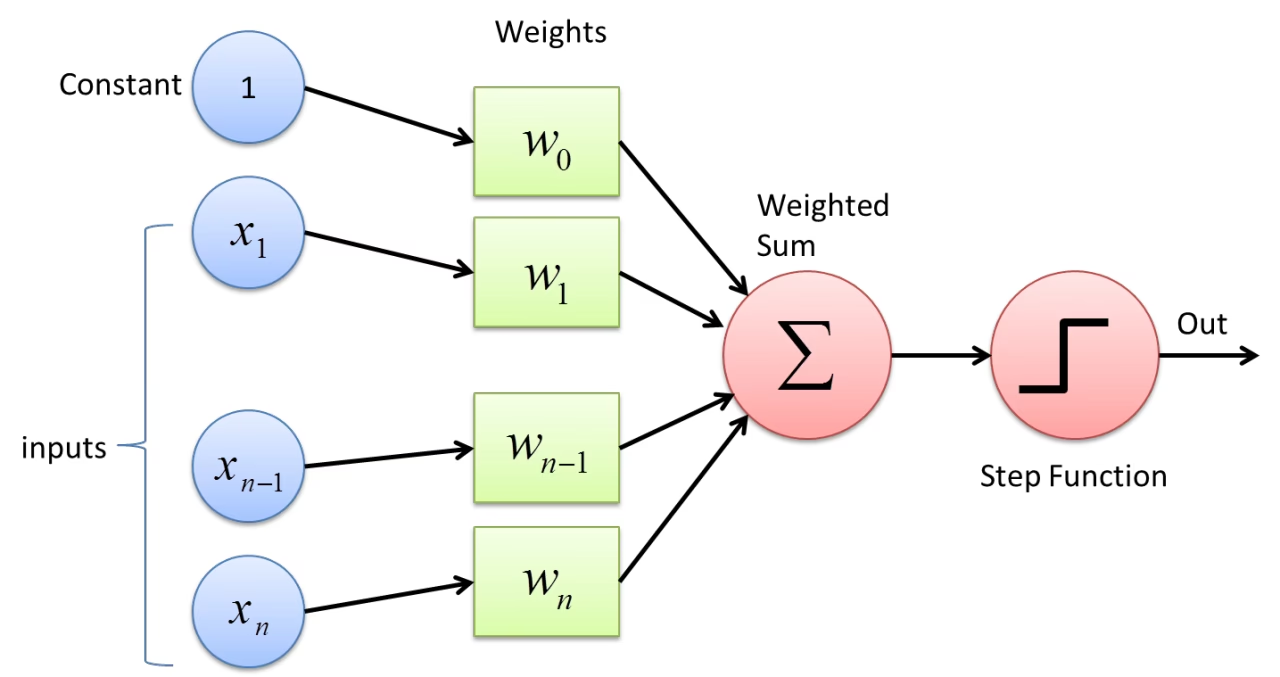

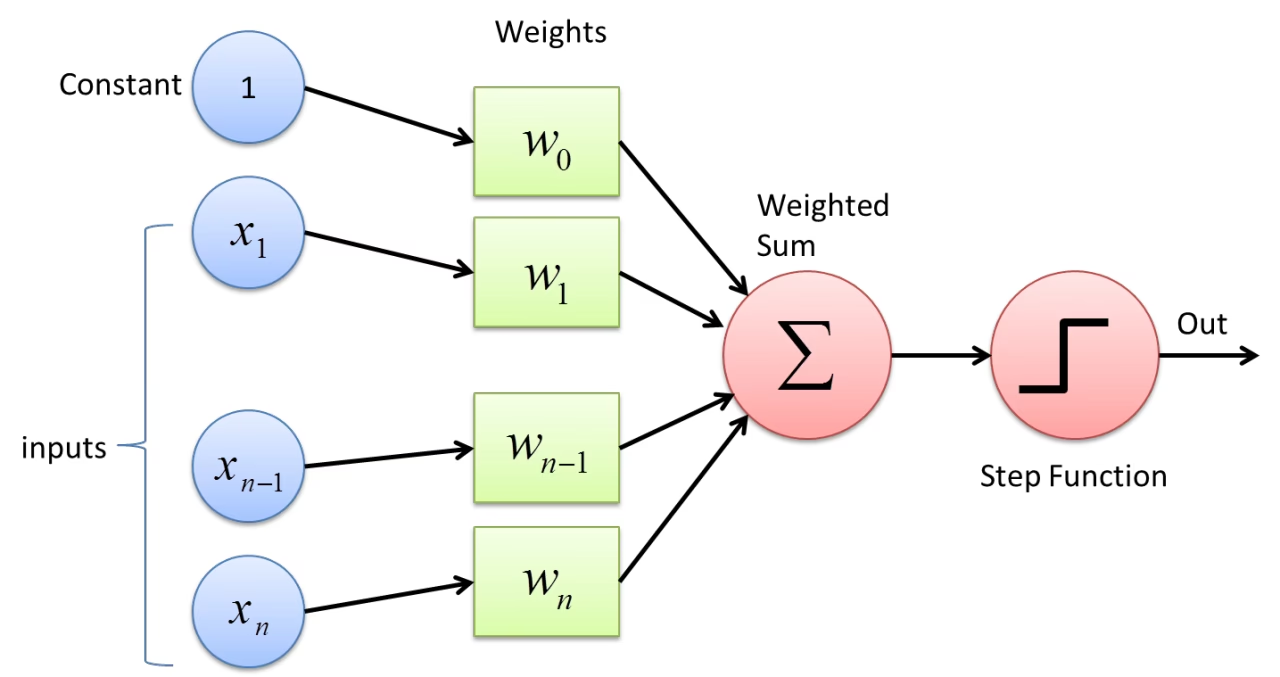

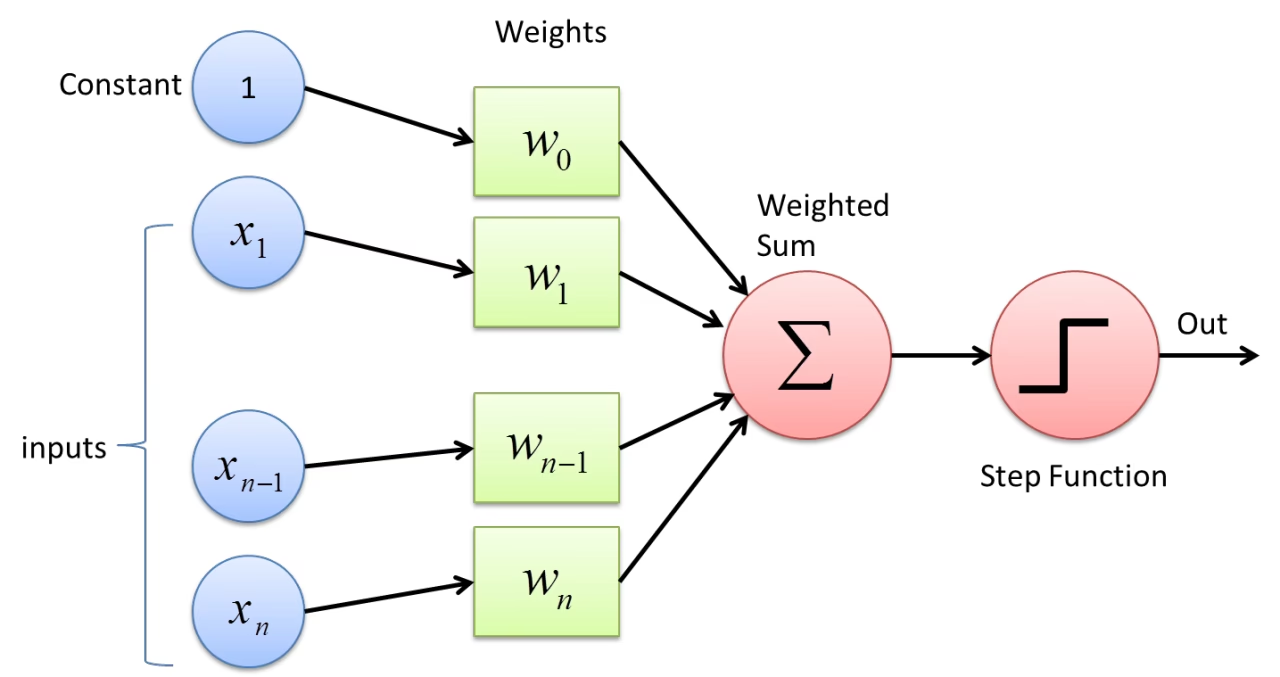

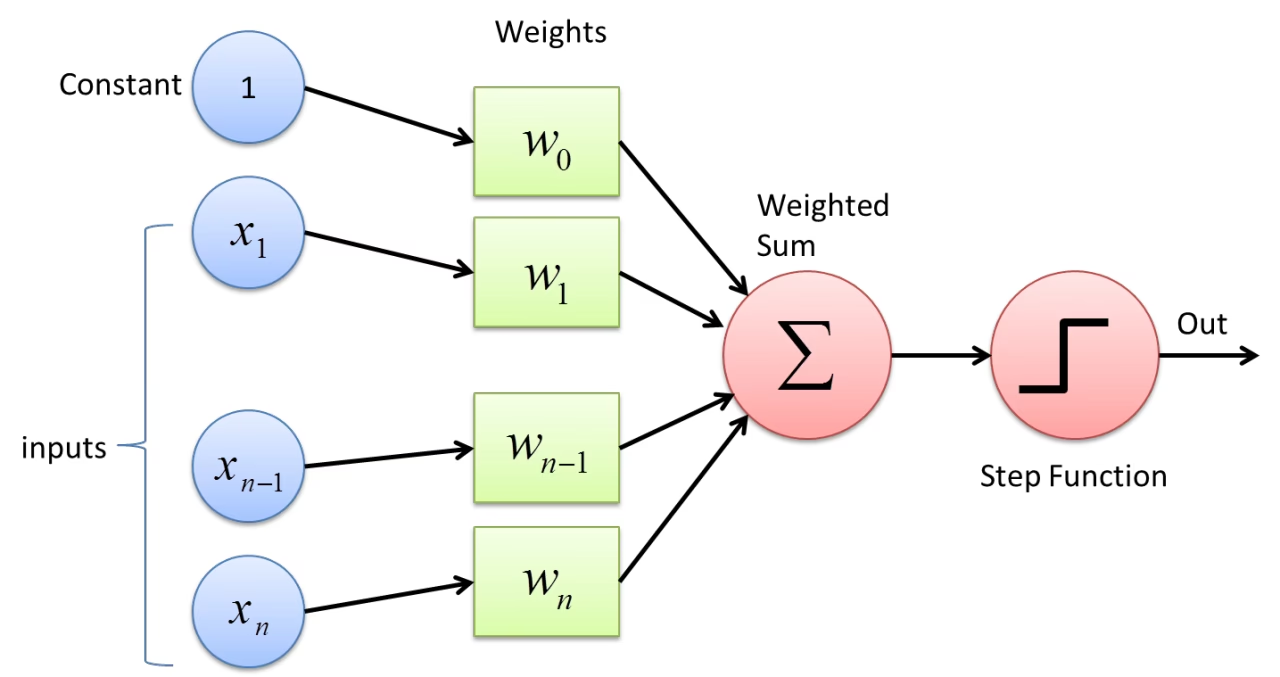

Funcționarea sa se bazează pe o funcție predictor liniară care combină un set de ponderi (greutăți) cu vectorul de caracteristici (input-ul). Algoritmul învață aceste ponderi ajustându-le iterativ, în funcție de eroarea dintre rezultatul său și rezultatul așteptat. Simplitatea sa este una dintre cele mai mari calități, permițând o înțelegere clară a conceptelor de bază ale învățării automate.

Cum Funcționează Perceptronul? O Rețetă în 5 Pași

Pentru a înțelege pe deplin cum antrenăm un Perceptron și cum acesta învață să clasifice, vom parcurge o "rețetă" în cinci pași esențiali. Vom folosi un exemplu ilustrativ de clasificare a e-mailurilor ca "spam" sau "non-spam" (ham) pentru a face lucrurile mai concrete.

Pasul 1: Pregătirea Datelor

Orice algoritm de Machine Learning începe cu date. În cazul clasificării spam-ului, scopul nostru este să etichetăm e-mailurile fie ca "spam", fie ca "non-spam". Acest pas implică două aspecte cheie:

- Caracteristici (Features): Acestea sunt atributele numerice ale e-mailului pe care Perceptronul le va "învăța". Exemple comune includ frecvența anumitor cuvinte cheie ("gratuit", "ofertă", "câștigător", "viagra"), reputația expeditorului, prezența atașamentelor sau utilizarea literelor majuscule. Fiecare e-mail este transformat într-un vector de numere (

x). - Etichete (Labels): Fiecare e-mail din setul nostru de date de antrenament este etichetat corespunzător:

+1pentru spam și-1pentru non-spam. Acestea sunt variabilele țintă (y) pe care modelul nostru trebuie să le prezică.

Adunăm un set de date de antrenament format dintr-un număr mare de perechi (x, y), unde M este numărul total de exemple de antrenament.

Pasul 2: Modelul Liniar

Odată ce datele sunt pregătite, definim modelul Perceptronului. Modelul încearcă să găsească o modalitate de a separa clasa pozitivă de clasa negativă. Funcția modelului este definită ca:

f(x) = sign(w^T x + b)Unde:

weste vectorul de ponderi (greutăți), care determină importanța fiecărei caracteristici.beste bias-ul (termenul de polarizare), care permite liniei de decizie să se deplaseze independent de origine.sign(·)este funcția de activare care mapează suma ponderată a intrărilor la+1sau-1.

În exemplul cu spam-ul, modelul Perceptronului va încerca să separe e-mailurile spam de cele non-spam folosind o graniță de decizie liniară. Odată ce w și b sunt învățate, f(x) va fi eticheta prezisă (+1 înseamnă spam, -1 înseamnă non-spam).

Pasul 3: Funcția de Pierdere

Pentru ca Perceptronul să învețe, avem nevoie de o modalitate de a măsura cât de "greșit" este modelul nostru. Aceasta este funcția de pierdere (loss function). Intuiția inițială ar putea fi utilizarea pierderii 0/1, care penalizează fiecare clasificare greșită în mod egal. Cu toate acestea, pierderea 0/1 este non-continuă și non-diferențiabilă, ceea ce o face nepotrivită pentru optimizarea bazată pe gradient. Pentru a depăși această problemă, se introduce pierderea Perceptronului:

L_Perceptron(w, b) = SUM(max(0, -y^(i) (w^T x^(i) + b)))Observă termenul max(0, -y^(i) (w^T x^(i) + b)):

- Dacă

y^(i) (w^T x^(i) + b) >= 0, înseamnă căy^(i)și(w^T x^(i) + b)au același semn, deci exemplul este clasificat corect. În acest caz, pierderea este zero. - Dacă

y^(i) (w^T x^(i) + b) < 0, înseamnă căy^(i)și(w^T x^(i) + b)au semne diferite, deci exemplul este clasificat greșit. În acest caz, pierderea este-y^(i) (w^T x^(i) + b), care este un număr pozitiv.

Această funcție de pierdere încurajează modelul să ajusteze w și b pentru a clasifica corect exemplele care sunt greșit clasificate. Spre deosebire de pierderea 0/1, care penalizează toate clasificările greșite în mod egal, pierderea Perceptronului penalizează clasificările greșite proporțional cu distanța lor față de granița de decizie. Cu cât un punct este mai "greșit" (mai departe de granița corectă), cu atât pierderea este mai mare, iar algoritmul va face o ajustare mai mare.

Pasul 4: Algoritmul de Optimizare: Algoritmul Perceptron

Acum că avem o funcție de pierdere, trebuie să găsim o modalitate de a minimiza această pierdere. Algoritmul Perceptron este metoda de optimizare care face acest lucru, ajustând ponderile și bias-ul modelului. Este o formă de descendent subgradient stocastic.

Subgradientul Funcției de Pierdere Perceptron

Pentru a efectua optimizarea bazată pe gradient, trebuie să calculăm subgradientul pierderii Perceptronului în raport cu w și b. Pentru un exemplu de antrenament clasificat greșit (unde y^(i) (w^T x^(i) + b) < 0, adică -y^(i) (w^T x^(i) + b) > 0), subgradientul în raport cu w este -y^(i) x^(i), iar în raport cu b este -y^(i). Pentru exemplele clasificate corect, unde pierderea este zero, subgradientul este zero. Aceste subgradiente indică direcția în care w și b ar trebui ajustate pentru a crește "marginea" pentru acel exemplu clasificat greșit, împingându-l spre partea corectă a graniței de decizie.

Perceptronul ca Descendent Subgradient Stocastic

Algoritmul Perceptron actualizează ponderile și bias-ul luând în considerare un singur exemplu de antrenament la un moment dat, ceea ce îl face o formă de descendent subgradient stocastic. Regula de actualizare este simplă și puternică:

w := w + η * y^(i) * x^(i)b := b + η * y^(i)Unde η (eta) este rata de învățare. În algoritmul Perceptron de bază, η este adesea setată la 1. Acestă regulă de actualizare minimizează direct pierderea Perceptronului, ajustând w și b pentru a corecta clasificarea greșită a exemplului curent.

Pașii algoritmului sunt:

- Inițializează

wșibcu valori zero sau valori aleatoare mici. - Pentru fiecare exemplu de antrenament

(x^(i), y^(i)):- Calculează prezicerea modelului:

y_pred = sign(w^T x^(i) + b). - Dacă

y_predeste diferit dey^(i)(adică, exemplul este clasificat greșit):- Actualizează ponderile:

w := w + η * y^(i) * x^(i) - Actualizează bias-ul:

b := b + η * y^(i)

- Actualizează ponderile:

- Calculează prezicerea modelului:

- Repetă pașii 2 până când modelul converge (toate punctele sunt clasificate corect) sau s-a atins un număr maxim de iterații (epoci).

Convergența Algoritmului Perceptron

Una dintre proprietățile remarcabile ale algoritmului Perceptron este garanția sa de convergență în anumite condiții. Mai exact, dacă setul de date este liniar separabil – adică există cel puțin o hiperplană care poate separa perfect cele două clase fără eroare – atunci algoritmul Perceptron este garantat să găsească o astfel de hiperplană. Și o va face într-un număr finit de pași.

Această garanție de convergență are implicații importante:

- Garanția unei Soluții: Pentru seturi de date liniar separabile, Perceptronul va găsi întotdeauna o soluție.

- Număr Finit de Iterații: Algoritmul va converge într-un număr finit de pași, deși numărul exact de iterații poate depinde de ponderile inițiale, rata de învățare și geometria setului de date.

- Sensibilitate la Date și Inițializare: Deși convergența este garantată, modelul final poate varia în funcție de condițiile inițiale și de ordinea în care sunt prezentate exemplele.

Rolul Ratei de Învățare

Poate te întrebi dacă rata de învățare (η) este un hiperparametru crucial de ajustat, la fel ca în alte rețele neuronale. În cazul algoritmului Perceptron de bază, cu o rată de învățare constantă, magnitudinea ratei de învățare scalează pur și simplu lungimea vectorului de ponderi. Granița de decizie depinde de direcția vectorului de ponderi, nu de magnitudinea sa. Prin urmare, presupunând că exemplele sunt introduse în algoritm în aceeași ordine (și ai o rată de învățare pozitivă), vei obține aceeași graniță de decizie exactă, indiferent de rata de învățare constantă. Discuția despre "depășirea minimului" nu se aplică aici, deoarece există un număr infinit de vectori de ponderi cu magnitudini diferite care sunt echivalenți. Frumoasa simplitate a algoritmului Perceptron îl face mai puțin sensibil la hiperparametri precum rata de învățare decât, de exemplu, rețelele neuronale mai complexe. Cu toate acestea, implementări mai avansate ale ratelor de învățare, cum ar fi AdaGrad (care menține o rată de învățare separată pentru fiecare caracteristică), pot accelera convergența.

Pasul 5: Criterii de Evaluare și Inferenză

După ce modelul Perceptronului a fost antrenat (adică, am obținut ponderile w și bias-ul b optime), putem utiliza modelul pentru a face predicții pe date noi, nevăzute. La momentul testării, pentru un exemplu de test x_test, eticheta prezisă y_pred este obținută astfel:

y_pred = sign(w^T x_test + b)Performanța modelului Perceptron este evaluată folosind metrici standard de clasificare binară. Acestea oferă o imagine cuprinzătoare a cât de bine se descurcă modelul nostru. Iată câteva dintre cele mai comune:

| Metrică | Descriere | Formulă |

|---|---|---|

| Acuratețe (Accuracy) | Proporția de predicții corecte din totalul predicțiilor. | (Nr. Predicții Corecte) / (Nr. Total Predicții) |

| Precizie (Precision) | Proporția de cazuri pozitive (ex: spam) identificate corect din toate cazurile pe care modelul le-a etichetat ca pozitive. Importantă când costul "falsului pozitiv" (ex: e-mail non-spam marcat ca spam) este mare. | TP / (TP + FP) |

| Amintire / Sensibilitate (Recall) | Proporția de cazuri pozitive reale (ex: spam real) pe care modelul le-a identificat corect. Importantă când costul "falsului negativ" (ex: spam real marcat ca non-spam) este mare. | TP / (TP + FN) |

| Scorul F1 (F1 Score) | Media armonică a Preciziei și Amintirii. Oferă un echilibru între cele două și este utilă când există un dezechilibru între clase. | 2 * (Precision * Recall) / (Precision + Recall) |

Unde TP = True Positives (adevărat pozitive), FP = False Positives (fals pozitive), FN = False Negatives (fals negative).

Pentru clasificarea spam-ului, de exemplu, precizia și amintirea sunt deosebit de importante pentru a echilibra costul clasificării greșite a unui e-mail non-spam ca spam și invers. Aceste metrici ne ajută să înțelegem eficacitatea modelului nostru în clasificarea noilor exemple.

Avantaje și Dezavantaje ale Algoritmului Perceptron

Ca orice algoritm, Perceptronul are punctele sale forte și limitările sale. Înțelegerea acestora este crucială pentru a decide când și cum să-l aplici eficient.

Avantaje:

- Simplitate: Algoritmul Perceptron este remarcabil de simplu de implementat și de înțeles. Această simplitate îl face un punct de plecare excelent pentru oricine dorește să învețe conceptele de bază ale învățării automate și ale clasificării liniare. Nu necesită calcule complexe de gradient sau optimizatori sofisticați.

- Eficiență: Datorită simplității sale, Perceptronul este eficient din punct de vedere computațional. Necesită relativ puține resurse pentru a rula, făcându-l potrivit pentru seturi de date de dimensiuni moderate și pentru aplicații în timp real unde viteza este esențială. Timpul de antrenament este adesea foarte scurt comparativ cu modele mai complexe.

- Garanția Convergenței: Așa cum am discutat, pentru seturile de date care sunt liniar separabile, algoritmul Perceptron este garantat să găsească o soluție care separă perfect clasele. Mai mult, o va face într-un număr finit de iterații. Această garanție oferă o încredere considerabilă în aplicabilitatea sa pentru anumite tipuri de probleme.

- Învățare Online: Perceptronul poate fi ușor adaptat pentru învățarea online. Aceasta înseamnă că modelul poate fi actualizat incremental pe măsură ce sosesc date noi, fără a fi nevoie să reantrenezi întregul model de la zero. Această caracteristică este extrem de valoroasă în medii unde datele sunt primite secvențial și modelul trebuie să se adapteze continuu.

Dezavantaje:

- Limitare la Probleme Liniar Separabile: Acesta este cel mai mare dezavantaj al Perceptronului. Dacă datele nu pot fi separate printr-o singură linie dreaptă (sau o hiperplană), Perceptronul nu va converge și nu va găsi o soluție. Probleme precum clasificarea XOR, unde datele sunt non-liniar separabile, nu pot fi rezolvate de un Perceptron singur. Acesta este motivul pentru care au fost dezvoltate ulterior rețele neuronale cu straturi multiple (Multi-Layer Perceptrons - MLP).

- Sensibilitate la Zgomot: Chiar și în cazul seturilor de date liniar separabile, dacă există zgomot (puncte greșite sau aberante) aproape de granița de decizie, Perceptronul poate fi sensibil la acestea, iar performanța sa poate fi afectată. Nu este robust la datele zgomotoase.

- Nu Oferă o Margine de Confidență: Perceptronul oferă o clasificare binară (+1 sau -1), dar nu oferă o "probabilitate" sau o "margine de confidență" pentru predicția sa. Nu știm cât de "sigur" este modelul de predicția sa, ci doar dacă este pozitiv sau negativ. Aceasta poate fi o limitare în aplicațiile unde este necesară o măsură a incertitudinii.

- Unicitatea Soluției: Deși este garantat să găsească o soluție pentru datele liniar separabile, soluția găsită nu este neapărat unică și poate depinde de ordinea în care sunt prezentate exemplele de antrenament și de inițializarea ponderilor. Acesta poate fi un aspect problematic dacă se dorește o soluție optimă globală sau o stabilitate a modelului.

Întrebări Frecvente despre Perceptron

1. Ce este diferența cheie între un Perceptron și o rețea neuronală modernă?

Un Perceptron este cea mai simplă formă de rețea neuronală, având un singur strat și fiind capabil să rezolve doar probleme liniar separabile. Rețelele neuronale moderne, cum ar fi rețelele neuronale cu convoluție (CNN) sau cele recurente (RNN), au multiple straturi (ascunse) și funcții de activare non-liniare, permițându-le să învețe și să rezolve probleme mult mai complexe, non-liniar separabile.

2. De ce este important să studiem Perceptronul dacă are limitări?

Perceptronul este fundamental pentru înțelegerea conceptelor de bază ale învățării automate și ale rețelelor neuronale. Oferă o bază solidă pentru a înțelege cum funcționează ponderile, bias-ul, funcțiile de activare și algoritmii de optimizare. Este un punct de plecare excelent înainte de a aborda arhitecturi mai complexe.

3. Poate Perceptronul să rezolve probleme de clasificare multi-clasă?

Perceptronul, în forma sa originală, este un clasificator binar. Pentru probleme multi-clasă, se pot folosi strategii precum "One-vs-All" sau "One-vs-One", unde se antrenează mai multe Perceptroane, fiecare dedicat separării unei clase de restul sau a unei clase de o altă clasă specifică.

4. Ce se întâmplă dacă un set de date nu este liniar separabil?

Dacă un set de date nu este liniar separabil, algoritmul Perceptron de bază nu va converge niciodată. Va continua să ajusteze ponderile la infinit, fără a găsi o soluție care să clasifice perfect toate exemplele. Pentru astfel de probleme, sunt necesare modele mai complexe, cum ar fi rețelele neuronale cu mai multe straturi, Mașinile cu Vector Suport (SVM) cu kernel-uri non-liniare sau alte clasificatoare non-liniare.

5. Este Perceptronul utilizat în practică astăzi?

Perceptronul simplu este rar folosit singur în aplicații practice moderne, datorită limitării sale la probleme liniar separabile. Cu toate acestea, conceptele sale fundamentale sunt integrate în algoritmi mai complecși. De exemplu, "Multi-Layer Perceptrons" (MLP) sunt rețele neuronale cu straturi ascunse care depășesc limitările unui singur Perceptron și sunt utilizate pe scară largă.

În concluzie, Perceptronul rămâne o piatră de temelie în istoria inteligenței artificiale și un instrument didactic valoros. Deși simplu și cu limitări evidente în fața complexității datelor din lumea reală, înțelegerea sa este esențială pentru oricine dorește să exploreze universul fascinant al Machine Learning-ului și să construiască sisteme inteligente capabile să învețe și să ia decizii.

Dacă vrei să descoperi și alte articole similare cu Perceptronul: Ghid Complet pentru Înțelegere și Antrenament, poți vizita categoria Fitness.