03/12/2024

În era digitală actuală, inteligența artificială (AI) nu mai este un concept SF, ci o realitate care ne modelează viețile, de la recomandările personalizate pe care le primim online, până la sistemele complexe din spatele mașinilor autonome. Dar cum funcționează de fapt această inteligență? La baza multor progrese în domeniul AI stă un concept surprinzător de simplu, dar fundamental: perceptronul. Gândește-te la el ca la cea mai mică și mai elementară "celulă cerebrală" dintr-o rețea neuronală artificială. În acest articol, vom explora ce este un perceptron, cum este construit și, cel mai important, cum "învață" să ia decizii, transformând datele brute în predicții utile.

Ce Este un Perceptron? O Privire Asupra Neuronului Artificial

Perceptronul a fost introdus de Frank Rosenblatt în 1957 și reprezintă o piatră de temelie în dezvoltarea rețelelor neuronale. Inspirat de modul în care funcționează neuronii biologici din creierul uman, un perceptron este proiectat să preia mai multe intrări binare (0 sau 1) și să producă o singură ieșire binară (tot 0 sau 1). Ideea centrală este că fiecare intrare are o anumită "importanță" sau "pondere", iar perceptronul ia o decizie bazată pe suma ponderată a acestor intrări, comparată cu un anumit prag.

Componentele Cheie ale unui Perceptron

Pentru a înțelege cum funcționează, să descompunem un perceptron în elementele sale constitutive:

- Intrări (Noduri de Intrare): Acestea sunt datele pe care perceptronul le primește. De exemplu, într-un scenariu de fitness, ar putea fi "Am dormit 8 ore?" (1/0), "Am mâncat sănătos?" (1/0), "Am făcut sport astăzi?" (1/0).

- Ponderi (Greutăți): Fiecare intrare are asociată o pondere. Ponderile reflectă importanța sau influența fiecărei intrări asupra deciziei finale. O pondere mai mare înseamnă că acea intrare este mai relevantă. Aceste ponderi sunt ajustate în timpul procesului de învățare.

- Suma Ponderată: Perceptronul calculează suma produselor dintre fiecare intrare și ponderea sa corespunzătoare. Aceasta este esența procesării informației.

- Funcția de Activare: După ce suma ponderată este calculată, aceasta trece printr-o funcție de activare. În cazul unui perceptron simplu, această funcție este adesea o funcție pas, care produce 1 dacă suma depășește un anumit prag și 0 în caz contrar.

- Prag (Threshold): Această valoare determină "sensibilitatea" perceptronului. Dacă suma ponderată depășește pragul, perceptronul "se activează" (produce 1); altfel, rămâne inactiv (produce 0).

- Bias (Biaș): Uneori, chiar dacă toate intrările sunt zero, perceptronul ar putea produce o ieșire incorectă. Pentru a evita acest lucru, se adaugă o intrare suplimentară cu o valoare constantă (de obicei 1), numită bias. Acesta funcționează ca un "offset" sau o constantă care poate fi ajustată, similar cu o pondere, permițând perceptronului să-și modifice pragul de activare independent de intrări.

Exemplu: Decizia de a Merge la un Concert

Să ne imaginăm un perceptron care decide dacă ar trebui să mergi la un concert. Iată cum ar putea arăta intrările și ponderile:

| Criteriu | Intrare (x) | Pondere (w) | Produs (x * w) |

|---|---|---|---|

| Artistul este bun? | 1 (Da) | 0.7 | 0.7 |

| Vremea este bună? | 0 (Nu) | 0.6 | 0.0 |

| Prietenul vine? | 1 (Da) | 0.5 | 0.5 |

| Se servește mâncare? | 0 (Nu) | 0.3 | 0.0 |

| Se servește alcool? | 1 (Da) | 0.4 | 0.4 |

| Suma Ponderată Totală: | 1.6 | ||

Dacă pragul tău personal este 1.5, iar suma ponderată este 1.6, perceptronul va "decide" să mergi la concert (1.6 > 1.5). Dacă suma ar fi fost 1.4, decizia ar fi fost să nu mergi.

Cum Învață un Perceptron? Secretul Ajustării Ponderilor

Partea cu adevărat fascinantă a perceptronului este capacitatea sa de a învăța. Inițial, ponderile sunt setate aleatoriu. Perceptronul face "ghiciri", iar dacă ghicirea este incorectă, își ajustează ponderile pentru a se apropia de răspunsul corect. Acest proces iterativ de ajustare este ceea ce îi permite să învețe din exemple.

Procesul de Antrenare

Antrenarea unui perceptron implică parcurgerea repetată a unui set de date de antrenament, unde fiecare exemplu are o intrare și o ieșire dorită (corectă). Pașii sunt următorii:

- Gândirea (Guess): Perceptronul primește intrările și, folosind ponderile curente, calculează o ieșire.

- Calculul Erorii: Această ieșire (ghicirea) este comparată cu ieșirea dorită (răspunsul corect). Diferența dintre ele este eroarea.

- Ajustarea Ponderilor (The Perceptron Trick): Dacă există o eroare (ghicirea nu a fost corectă), ponderile perceptronului sunt ajustate. Aceasta este inima procesului de învățare și se numește "trucul perceptronului" (Perceptron Trick).

Rata de Învățare (Learning Rate)

Când perceptronul face o greșeală, ponderile sale sunt ajustate cu o fracțiune mică. Această fracțiune este "rata de învățare" (learningRate sau learnc). O rată de învățare mică înseamnă ajustări fine și lente, în timp ce o rată mare poate duce la ajustări prea agresive, care pot împiedica perceptronul să găsească soluția optimă.

Mecanismul de Ajustare a Ponderilor (Backpropagation Simplificată)

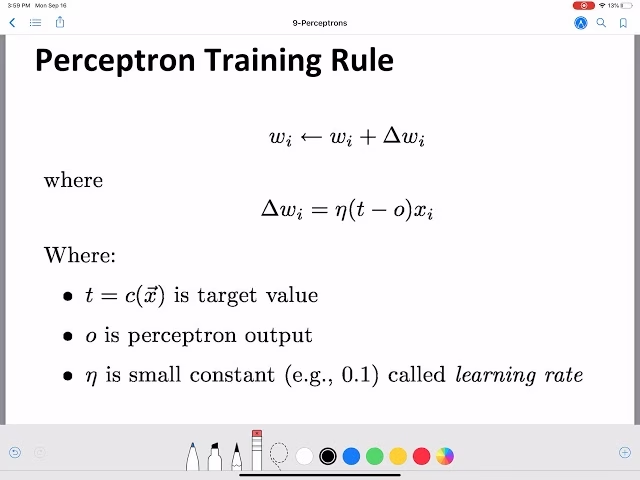

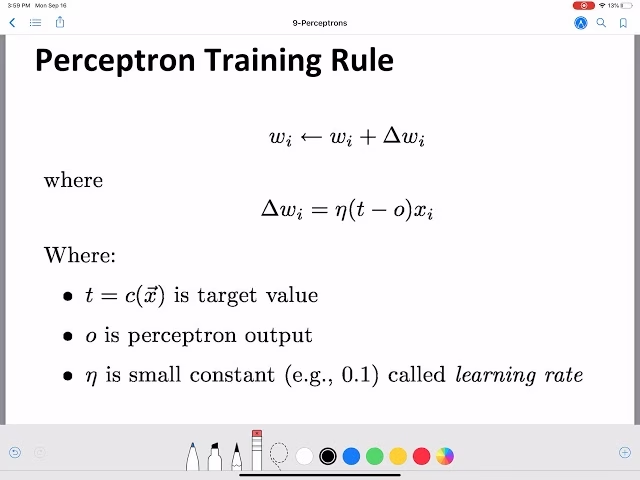

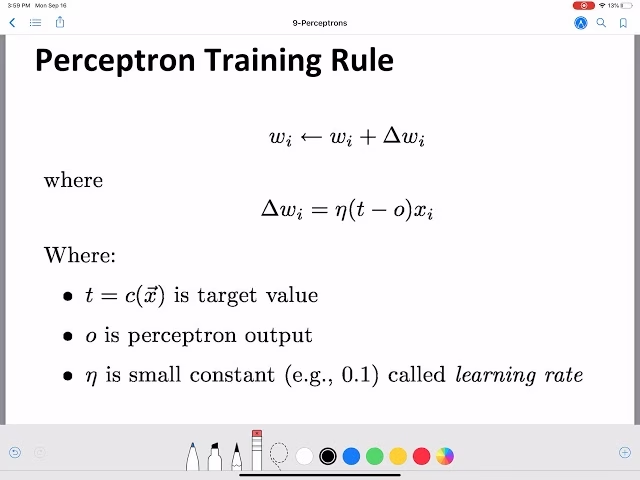

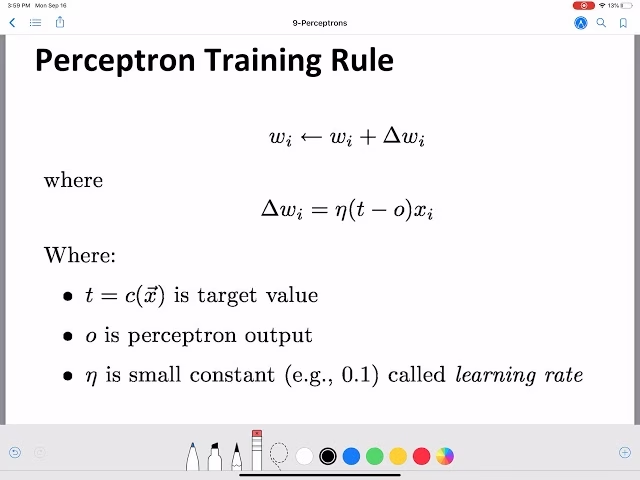

Formula de ajustare a ponderilor este esențială:

noua_pondere = pondere_curentă + (rata_invatare * eroare * intrare)

Să analizăm această formulă simplu:

- Dacă perceptronul a ghicit 0, dar răspunsul corect era 1 (eroare = 1), atunci ponderile asociate cu intrările care au contribuit la ghicirea greșită sunt mărite, în speranța că data viitoare suma ponderată va fi mai mare și va depăși pragul.

- Dacă perceptronul a ghicit 1, dar răspunsul corect era 0 (eroare = -1), atunci ponderile asociate cu intrările care au contribuit la ghicirea greșită sunt diminuate, pentru ca data viitoare suma ponderată să fie mai mică și să nu depășească pragul.

Acest proces de propagare a erorii înapoi prin rețea pentru a ajusta ponderile este o formă simplificată de backpropagation, un concept fundamental în rețelele neuronale mai complexe.

Antrenarea pe un Exemplu Concret: Clasificarea Punctelor

Imaginați-vă un spațiu bidimensional (cu puncte x și y) și o linie dreaptă. Sarcina perceptronului este să învețe să clasifice punctele care se află deasupra liniei (să zicem, ieșire 1) și pe cele care se află sub linie (ieșire 0). Inițial, cu ponderi aleatorii, perceptronul va face multe greșeli. Dar, pe măsură ce este antrenat cu mii de exemple (puncte cu poziția lor reală față de linie), el va ajusta continuu ponderile și bias-ul. În cele din urmă, perceptronul va fi capabil să traseze o "linie de decizie" care separă corect majoritatea punctelor, indiferent dacă sunt deasupra sau sub linie. Este un exemplu clasic de cum un perceptron învață să recunoască un model liniar.

Crearea și Antrenarea Unui Perceptron: Pași Conceptuali

Deși nu vom intra în detalii de cod, iată cum ar fi structurată logic "crearea" și "antrenarea" unui perceptron:

1. Crearea Obiectului Perceptron

Acest pas implică definirea proprietăților inițiale ale perceptronului:

- Numărul de intrări: Câte valori va primi perceptronul? (e.g., 2 pentru puncte x,y).

- Rata de învățare: Cât de mult să se ajusteze ponderile la fiecare greșeală (valori tipice foarte mici, e.g., 0.00001).

- Ponderi inițiale: Acestea sunt generate aleatoriu, de obicei între -1 și 1. Ele sunt punctul de plecare al învățării.

- Bias: O valoare constantă (de obicei 1) adăugată ca o intrare suplimentară, cu ponderea sa ajustabilă.

2. Funcția de Activare

Aceasta este inima deciziei. Primește un set de intrări, le înmulțește cu ponderile corespunzătoare (și adaugă bias-ul), le sumează, apoi aplică funcția pas: dacă suma depășește zero, returnează 1; altfel, returnează 0.

3. Funcția de Antrenare

Aceasta este funcția care "educă" perceptronul:

- Primește intrările și răspunsul dorit pentru acel exemplu.

- Adaugă bias-ul la intrări.

- Folosește funcția de activare pentru a obține o ghicire.

- Calculează eroarea (răspuns dorit - ghicire).

- Dacă eroarea nu este zero, ajustează fiecare pondere folosind formula de ajustare (rata_invatare * eroare * intrare).

Acest ciclu se repetă de mii sau chiar zeci de mii de ori cu diferite exemple din setul de antrenament. După suficient de multe iterații, ponderile se stabilizează, iar perceptronul devine capabil să facă predicții corecte pentru majoritatea intrărilor noi, necunoscute.

Limitări și Evoluția Perceptronului

Deși perceptronul este un concept revoluționar, el are o limitare fundamentală: poate învăța doar modele care sunt liniar separabile. Aceasta înseamnă că poate clasifica datele doar dacă există o linie dreaptă (sau un hiperplan în dimensiuni superioare) care le poate separa perfect în cele două categorii. De exemplu, problema clasică "XOR" (sau exclusiv) nu poate fi rezolvată de un singur perceptron, deoarece punctele care ar trebui să aparțină aceleiași categorii nu pot fi separate printr-o singură linie dreaptă.

Această limitare a fost un obstacol major în primele zile ale AI. Soluția a venit prin combinarea mai multor perceptroni în straturi, creând ceea ce numim Perceptroni Multi-Strat (MLP) sau rețele neuronale profunde (Deep Neural Networks). Prin adăugarea mai multor straturi și utilizarea unor funcții de activare non-liniare, aceste rețele pot învăța și recunoaște modele mult mai complexe, depășind limitările unui singur perceptron și deschizând calea pentru aplicațiile moderne de inteligență artificială, de la recunoașterea facială la procesarea limbajului natural.

Întrebări Frecvente Despre Perceptroni

Ce este un perceptron?

Un perceptron este cel mai simplu tip de rețea neuronală artificială, funcționând ca un singur neuron artificial. El primește mai multe intrări, le ponderează, le sumează și produce o ieșire binară (0 sau 1) pe baza unui prag de activare.

De ce este importantă rata de învățare?

Rata de învățare controlează cât de mult se ajustează ponderile perceptronului la fiecare eroare. O rată prea mare poate face ca învățarea să "sare" peste soluția optimă, în timp ce o rată prea mică poate face ca învățarea să fie extrem de lentă.

Ce este bias-ul în contextul perceptronului?

Bias-ul este o intrare suplimentară, cu o valoare constantă (de obicei 1), care are o pondere ajustabilă. Rolul său este de a permite perceptronului să-și modifice pragul de activare, oferind o flexibilitate suplimentară în clasificarea datelor, chiar și atunci când intrările sunt zero.

Ce înseamnă backpropagation?

Backpropagation (propagarea înapoi) este un algoritm folosit pentru a antrena rețelele neuronale. În contextul perceptronului, este procesul prin care eroarea de predicție este folosită pentru a calcula și a ajusta ponderile (și bias-ul) înapoi, de la ieșire către intrări, pentru a minimiza greșelile viitoare.

Poate un perceptron să rezolve orice problemă?

Nu. Un singur perceptron este limitat la rezolvarea problemelor care sunt liniar separabile, adică cele în care datele pot fi împărțite în categorii de o singură linie dreaptă (sau un hiperplan). Pentru probleme mai complexe, non-liniare, sunt necesare rețele neuronale cu mai multe straturi (Perceptroni Multi-Strat).

Concluzie

Perceptronul, deși simplu în structura sa, reprezintă un concept colosal în lumea inteligenței artificiale. Este prima dovadă că mașinile pot "învăța" din date și își pot ajusta comportamentul pentru a îmbunătăți performanța. De la umilele sale începuturi, a deschis calea către rețele neuronale mult mai complexe și capabile, care stau la baza inovațiilor tehnologice de astăzi. Înțelegerea modului în care un perceptron învață este nu doar o incursiune în istoria AI, ci și o perspectivă esențială asupra modului în care funcționează creierul digital care ne înconjoară.

Dacă vrei să descoperi și alte articole similare cu Perceptronul: Cum Învață Celula Cerebrală AI, poți vizita categoria Fitness.