14/02/2022

În lumea dinamică a inteligenței artificiale și a învățării automate, capacitatea de a înțelege și previziona secvențe de date este esențială. De la limbajul uman la seriile temporale financiare, datele vin adesea sub formă de succesiuni, unde ordinea și dependențele dintre elemente sunt la fel de importante ca și elementele în sine. Modelele tradiționale de rețele neuronale, precum perceptronii multistrat (MLP) sau rețelele neuronale convoluționale (CNN), au excelență în multe domenii, dar se confruntă cu limitări semnificative atunci când vine vorba de gestionarea dependențelor pe termen lung în datele secvențiale. Aici intervin Rețelele Neuronale Recurente cu Memorie pe Termen Scurt-Lung, sau pe scurt, LSTM-uri – o inovație care a transformat modul în care abordăm problemele de previziune secvențială.

- Ce sunt Rețelele Neuronale Tradiționale? O Recapitulare Rapidă

- Rețele Neuronale Recurente (RNN) – Precursorul LSTM

- LSTM: Soluția pentru Dependențe pe Termen Lung

- LSTM vs. MLP vs. CNN: O Comparație Detaliată

- Aplicații Revoluționare ale Modelelor LSTM

- Implementarea LSTM-urilor cu Keras: Simplitate și Putere

- Provocări și Considerații în Utilizarea LSTM-urilor

- Întrebări Frecvente (FAQ)

- Q: Ce este principala diferență dintre un LSTM și un RNN tradițional?

- Q: De ce sunt LSTM-urile mai bune pentru date secvențiale decât MLP-urile sau CNN-urile?

- Q: Este Keras singura modalitate de a implementa LSTM-uri?

- Q: Sunt LSTM-urile întotdeauna cea mai bună alegere pentru previziunea secvențială?

- Q: Cât de dificil este să antrenezi un model LSTM?

- Concluzie

Ce sunt Rețelele Neuronale Tradiționale? O Recapitulare Rapidă

Pentru a înțelege pe deplin de ce LSTM-urile sunt atât de speciale, este util să revedem scurt conceptele de bază ale MLP-urilor și CNN-urilor și să înțelegem de ce acestea nu sunt cele mai potrivite pentru datele secvențiale.

Perceptroni Multistrat (MLP)

Perceptronii Multistrat sunt cele mai simple forme de rețele neuronale feedforward. Ele constau dintr-un strat de intrare, unul sau mai multe straturi ascunse și un strat de ieșire. Informația curge într-o singură direcție, de la intrare la ieșire, fără bucle sau conexiuni de feedback. MLP-urile sunt excelente pentru sarcini precum clasificarea sau regresia pe seturi de date tabulare, unde fiecare punct de date este considerat independent de celelalte. Cu toate acestea, ele nu au o memoria inerentă; nu pot reține informații despre intrările anterioare pentru a influența ieșirile curente, ceea ce le face ineficiente pentru secvențe.

Rețele Neuronale Convoluționale (CNN)

Rețelele Neuronale Convoluționale au revoluționat domeniul viziunii computerizate. Ele utilizează straturi convoluționale pentru a detecta caracteristici locale în date, cum ar fi marginile sau texturile dintr-o imagine. CNN-urile sunt excepționale pentru recunoașterea imaginilor, detecția obiectelor și alte sarcini spațiale. Deși pot fi adaptate într-o oarecare măsură pentru date secvențiale (de exemplu, prin utilizarea convoluțiilor 1D), ele nu sunt proiectate fundamental pentru a înțelege și a modela dependențele pe termen lung în timpul, adică relațiile dintre elemente care sunt separate de multe alte elemente în secvență. Memoria lor este locală și nu se extinde pe întreaga lungime a unei secvențe.

Rețele Neuronale Recurente (RNN) – Precursorul LSTM

Încercarea de a dota rețelele neuronale cu o formă de memorie a dus la dezvoltarea Rețelelor Neuronale Recurente (RNN). Spre deosebire de MLP-uri, RNN-urile au bucle de feedback care permit informației să persiste. Aceasta înseamnă că ieșirea unui pas de timp poate fi alimentată înapoi ca intrare pentru pasul următor, oferind rețelei o formă de memorie pe termen scurt. RNN-urile au fost un pas crucial înainte pentru procesarea secvențelor. Cu toate acestea, ele suferă de probleme precum gradientul care dispare (vanishing gradient) sau gradientul care explodează (exploding gradient), ceea ce le face ineficiente pentru învățarea dependențele pe termen lung. Pe măsură ce secvențele devin mai lungi, abilitatea RNN-urilor de a reține informații relevante din trecutul îndepărtat scade drastic.

LSTM: Soluția pentru Dependențe pe Termen Lung

LSTM-urile au fost introduse pentru a aborda direct problemele de gradient ale RNN-urilor și pentru a permite modelelor să învețe și să rețină informații pe perioade mult mai lungi. Ele sunt o variantă specială de RNN-uri, concepute în mod explicit pentru a evita problema dependențelor pe termen lung. În loc de un singur strat de rețea neuronală în fiecare celulă, LSTM-urile au patru straturi care interacționează într-un mod foarte specific.

Arhitectura Unică a LSTM-urilor

Elementul cheie al unui LSTM este starea celulei (cell state), care acționează ca o bandă transportoare. Această stare a celulei rulează prin întregul lanț, cu modificări minore. Informațiile pot fi adăugate la sau eliminate din starea celulei prin intermediul unor structuri numite „porți”. Aceste porți sunt compuse dintr-un strat de rețea neuronală sigmoidă și o operație de înmulțire punctuală. Straturile sigmoide produc numere între 0 și 1, descriind cât de mult din fiecare componentă ar trebui să treacă. Un 0 înseamnă „nimic nu trece”, în timp ce un 1 înseamnă „totul trece”. LSTM-urile sunt special proiectate pentru probleme de previziune secvențială, de la recunoașterea vorbirii la traducerea automată, datorită capacitatea lor de a modela dependențele pe termen lung.

Cum Funcționează Porțile LSTM

- Poarta de Uitarea (Forget Gate): Decide ce informații din starea celulei (h_t-1 și x_t) trebuie uitate. Iese un număr între 0 și 1 pentru fiecare număr din starea celulei anterioare C_t-1.

- Poarta de Intrare (Input Gate): Decide ce informații noi vor fi stocate în starea celulei. Aceasta constă din două părți: un strat sigmoid care decide ce valori vom actualiza și un strat tanh care creează un vector de candidați, C_tilda, pentru a fi adăugat la starea celulei.

- Poarta de Ieșire (Output Gate): Decide ce valoare vom scoate. Se bazează pe starea celulei filtrate (după aplicarea porții de uitare și de intrare) și pe intrarea curentă.

Acest mecanism complex de porți permite LSTM-urilor să adauge sau să elimine selectiv informații din starea celulei, permițându-le să mențină informații relevante pe perioade lungi și să le ignore pe cele irelevante. Această capacitate de a gestiona fluxul de informații este ceea ce le face superioare RNN-urilor tradiționale și le permite să abordeze cu succes problemele cu dependențe pe termen lung.

LSTM vs. MLP vs. CNN: O Comparație Detaliată

Pentru a sublinia diferențele fundamentale și avantajele LSTM-urilor, să aruncăm o privire la o comparație directă între cele trei tipuri de rețele neuronale:

| Caracteristică | Perceptron Multistrat (MLP) | Rețea Neuronală Convoluțională (CNN) | Rețea Neuronală Recurentă cu Memorie pe Termen Scurt-Lung (LSTM) |

|---|---|---|---|

| Tip de Date Ideal | Date tabulare, independente | Date spațiale (imagini, video), locale | Date secvențiale (text, serii temporale, audio) |

| Memorie Inerentă | Nu are | Memorie locală, pentru caracteristici spațiale | Da, memorie pe termen lung prin starea celulei |

| Gestionarea Dependențelor Temporale | Nu gestionează | Nu gestionează direct (necesită adaptări complexe) | Excelentă, special concepută pentru acest scop |

| Complexitate Arhitecturală | Scăzută | Medie spre ridicată | Ridicată |

| Probleme de Gradient | Nu aplicabil în context secvențial | Nu aplicabil în context secvențial | Atenuează semnificativ problemele de gradient |

| Exemple de Aplicații | Clasificare Iris, regresie prețuri locuințe | Recunoaștere facială, detecție obiecte, segmentare imagini | Traducere automată, previziuni serii temporale, generare de text, recunoaștere vocală |

Aplicații Revoluționare ale Modelelor LSTM

Datorită capacității lor unice de a procesa și înțelege secvențe, LSTM-urile au găsit aplicații vaste și de impact în numeroase domenii:

- Procesarea Limbajului Natural (NLP): LSTM-urile sunt coloana vertebrală a multor sisteme moderne de NLP. Ele sunt utilizate pentru traducerea automată (ex: Google Translate), generarea de text (chatbot-uri, asistenți virtuali), analiză de sentimente, recunoașterea entităților numite și răspunsuri la întrebări.

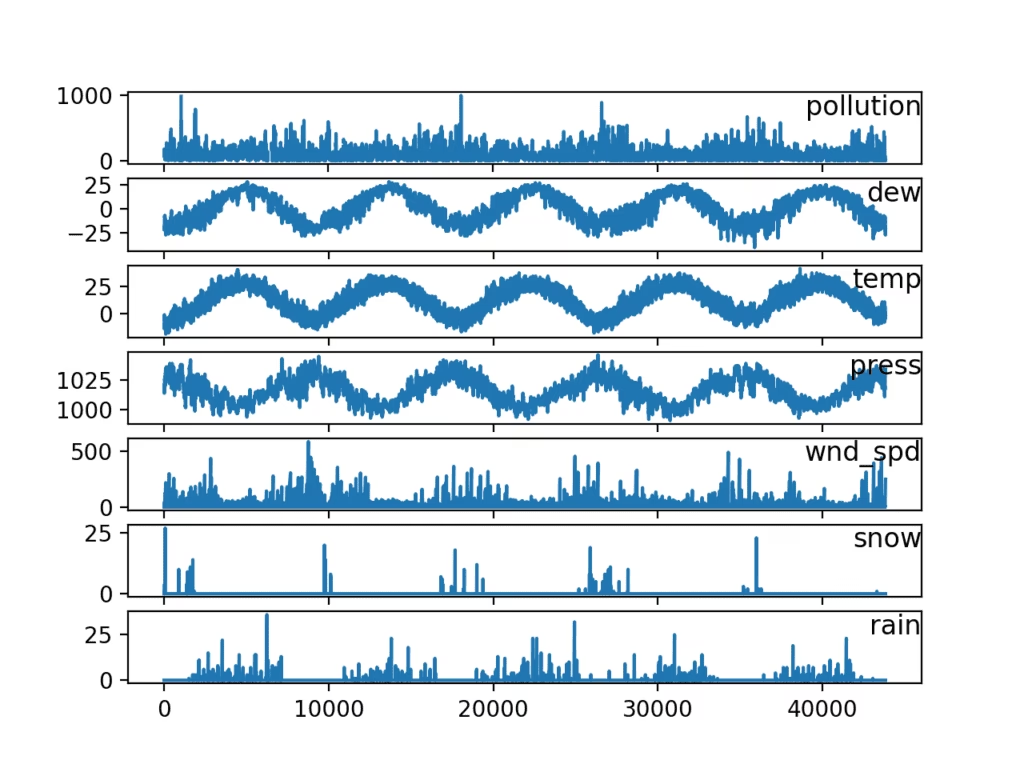

- Serii Temporale și Previziuni: De la previziuni meteo și estimarea cererii de energie electrică, la previziunea prețurilor acțiunilor și a traficului, LSTM-urile pot modela eficient tiparele complexe și dependențele din datele temporale.

- Recunoaștere Vocală și Generare Audio: Sunt folosite pentru a transcrie vorbirea în text (sisteme de dictare, asistenți vocali) și chiar pentru a genera muzică sau sunete sintetice.

- Generare de Cod: Există aplicații care utilizează LSTM-uri pentru a genera secvențe de cod de programare, ajutând dezvoltatorii.

- Descriere Imagini: Combinate cu CNN-uri, LSTM-urile pot genera descrieri textuale ale imaginilor, înțelegând nu doar ce este în imagine, ci și relațiile dintre obiecte.

Implementarea LSTM-urilor cu Keras: Simplitate și Putere

Deși complexitatea arhitecturală a LSTM-urilor este semnificativă, framework-uri de învățare automată precum Keras (care rulează pe TensorFlow) au simplificat enorm procesul de implementare și antrenare. Keras oferă o interfață de programare (API) de nivel înalt, intuitivă, care permite dezvoltatorilor să construiască și să experimenteze rapid cu modele LSTM fără a fi nevoie să se scufunde în detaliile complicate ale implementării subiacente.

Cu Keras, adăugarea unui strat LSTM la un model secvențial este la fel de simplă ca o singură linie de cod. Acest lucru permite prototiparea rapidă și explorarea diferitelor arhitecturi de rețele neuronale recurente, accelerând semnificativ procesul de dezvoltare pentru problemele de previziune secvențială. Flexibilitatea Keras permite, de asemenea, configurarea ușoară a numărului de unități LSTM, a straturilor, a metodelor de regularizare (dropout), și a altor hiperparametri esențiali, oferind un control fin asupra modelului, dar fără a impune o cale rigidă sau un ciclu de viață predefinit în 5 pași. Keras se concentrează pe modularitate și ușurință în utilizare, permițând utilizatorilor să combine straturi LSTM cu alte tipuri de straturi (dense, convoluționale) pentru a construi arhitecturi hibride puternice.

Provocări și Considerații în Utilizarea LSTM-urilor

Deși puternice, LSTM-urile nu sunt o soluție magică și vin cu propriile provocări:

- Complexitate Computațională: Datorită arhitecturii lor complexe și a numărului mare de parametri, antrenarea modelelor LSTM poate fi intensivă din punct de vedere computațional și necesită resurse hardware semnificative (GPU-uri).

- Volum Mare de Date: Pentru a învăța dependențe pe termen lung și pentru a generaliza bine, LSTM-urile necesită, în general, un volum mare de date de antrenament.

- Hyperparametrizare: Alegerea numărului optim de unități LSTM, a numărului de straturi, a ratei de învățare, a mărimii lotului (batch size) și a altor hiperparametri poate fi un proces dificil și consumator de timp, necesitând adesea experimentare și validare încrucișată.

- Interpretare: Ca și în cazul altor rețele neuronale profunde, interpretarea exactă a modului în care un model LSTM ia decizii poate fi dificilă, deoarece sunt adesea considerate „cutii negre”.

Întrebări Frecvente (FAQ)

Q: Ce este principala diferență dintre un LSTM și un RNN tradițional?

A: Principala diferență constă în capacitatea LSTM-urilor de a gestiona dependențele pe termen lung. RNN-urile tradiționale suferă de problema gradientului care dispare, ceea ce le împiedică să rețină informații pe perioade lungi. LSTM-urile rezolvă această problemă prin utilizarea unei „stări a celulei” și a unor „porți” (de uitare, intrare, ieșire) care controlează fluxul de informații, permițându-le să rețină și să transmită informații relevante pe durate mult mai lungi.

Q: De ce sunt LSTM-urile mai bune pentru date secvențiale decât MLP-urile sau CNN-urile?

A: MLP-urile nu au memorie și tratează fiecare intrare independent, fiind nepotrivite pentru secvențe. CNN-urile sunt excelente pentru date spațiale și detectarea caracteristicilor locale, dar nu au o memorie inerentă pentru dependențele temporale pe termen lung. LSTM-urile, prin designul lor, includ o stare a celulei și porți care le permit să „memoreze” informații din pașii anteriori ai secvenței și să înțeleagă contextul pe termen lung, ceea ce este crucial pentru datele secvențiale.

Q: Este Keras singura modalitate de a implementa LSTM-uri?

A: Nu, Keras este doar unul dintre framework-urile populare care facilitează implementarea LSTM-urilor. Alte framework-uri majore includ PyTorch, TensorFlow (fără API-ul Keras), și altele. Keras este apreciat pentru simplitatea și ușurința sa în utilizare, fiind o alegere excelentă pentru începători și pentru prototipare rapidă.

Q: Sunt LSTM-urile întotdeauna cea mai bună alegere pentru previziunea secvențială?

A: Nu neapărat. Deși LSTM-urile sunt extrem de puternice, ele pot fi complexe și costisitoare din punct de vedere computațional. Pentru secvențe foarte scurte sau probleme mai simple, un RNN tradițional (dacă problema gradientului nu este severă) sau chiar alte metode statistice pot fi suficiente. De asemenea, noi arhitecturi, cum ar fi modelele Transformer, au depășit uneori performanța LSTM-urilor în anumite sarcini de NLP, în special datorită capacității lor de a procesa secvențe în paralel și a mecanismului de atenție.

Q: Cât de dificil este să antrenezi un model LSTM?

A: Antrenarea unui model LSTM poate fi mai dificilă decât a unui MLP sau CNN, în special din cauza complexității arhitecturii și a nevoii de a gestiona secvențe de lungimi variabile. Necesită adesea mai multe resurse computaționale (GPU-uri) și o ajustare atentă a hiperparametrilor. Cu toate acestea, framework-uri precum Keras simplifică mult procesul, abstrahând multe dintre complexitățile subiacente.

Concluzie

LSTM-urile reprezintă un salt uriaș în capacitatea noastră de a modela și previziona date secvențiale. Prin adăugarea unei memorii inteligente și a unui control fin asupra fluxului de informații, ele depășesc limitările rețelelor neuronale tradiționale și ale RNN-urilor simple, deschizând noi orizonturi în domenii precum procesarea limbajului natural, analiza seriilor temporale și multe altele. Deși vin cu propriile provocări legate de complexitatea computațională și optimizarea hiperparametrilor, puterea lor de a înțelege și exploata dependențele pe termen lung le consolidează locul ca instrumente indispensabile în arsenalul oricărui specialist în învățare automată.

Dacă vrei să descoperi și alte articole similare cu LSTM: Puterea Previziunii Secvențiale, poți vizita categoria Fitness.