15/03/2023

În era digitală actuală, Modelele Lingvistice Mari (LLM-uri) au revoluționat modul în care interacționăm cu tehnologia, de la generarea de text coerent la rezolvarea problemelor complexe. Cu toate acestea, pentru ca aceste modele să atingă performanțe optime și să se adapteze la sarcini specifice, este adesea necesară o etapă suplimentară de antrenament, cunoscută sub numele de fine-tuning. Dintre diversele metode de fine-tuning, Supervised Fine-Tuning (SFT) se distinge ca o tehnică fundamentală și larg răspândită, oferind o abordare directă și eficientă pentru a modela comportamentul LLM-urilor. Această metodă implică antrenarea modelului pe un set de date curat și etichetat, permițându-i să învețe tipare specifice și să își îmbunătățească semnificativ capacitățile pentru sarcini bine definite.

SFT nu este doar o simplă ajustare; este un proces de rafinare care transformă un model generalist într-un expert într-un domeniu particular. Prin SFT, un LLM este expus la exemple concrete de intrări și ieșiri dorite, învățând astfel să genereze răspunsuri de o calitate superioară, mai precise și mai relevante pentru contextul dat. Acest articol va explora în profunzime conceptul de SFT, modul în care funcționează și, în special, cum clasa SFTTrainer din biblioteca TRL facilitează implementarea eficientă a acestei tehnici esențiale.

- Ce Este Supervised Fine-Tuning (SFT)?

- Clasa SFTTrainer: Un Instrument Esențial

- Cum Funcționează SFTTrainer în Detaliu

- Personalizarea Procesului de Antrenament cu SFTTrainer

- Exemple Avansate de Utilizare a SFTTrainer

- Beneficiile Supervised Fine-Tuning (SFT)

- Provocări și Limitări ale SFT

- Alternative la SFT în Post-Antrenarea LLM-urilor

- Considerații Etice în Utilizarea SFT

- Întrebări Frecvente

- Concluzie

Ce Este Supervised Fine-Tuning (SFT)?

Supervised Fine-Tuning (SFT) este o metodă de post-antrenament utilizată pentru a adapta Modelele Lingvistice Mari (LLM-uri) la un set de date țintă. Este cea mai simplă și mai frecvent utilizată abordare pentru a specializa un model de limbaj. În esență, SFT implică antrenarea modelului într-o manieră complet supravegheată, folosind perechi de secvențe de intrare și ieșire. Scopul principal este de a minimiza log-likelihood-ul negativ (NLL) al secvenței țintă, condiționând-o pe intrare.

Imaginați-vă că aveți un LLM pre-antrenat care înțelege limbajul în general. Prin SFT, îi oferiți exemple specifice, cum ar fi întrebări și răspunsuri corecte, sau instrucțiuni și rezultatele dorite. Modelul învață din aceste exemple etichetate, ajustându-și parametrii pentru a produce ieșiri care se aliniază mai bine cu tiparele observate în setul de date de fine-tuning. Acest proces permite modelului să capete nuanțe specifice sarcinii, îmbunătățind performanța în domenii precum generarea de cod, rezumarea textului sau răspunsul la întrebări. De exemplu, un model generalist poate fi transformat într-un asistent de cod capabil să genereze fragmente de cod de înaltă calitate, prin antrenarea pe un set de date vast de exemple de cod și feedback uman.

Clasa SFTTrainer: Un Instrument Esențial

Pentru a simplifica și eficientiza procesul de Supervised Fine-Tuning, biblioteca TRL oferă clasa SFTTrainer. Aceasta este o extensie puternică a clasei Trainer din biblioteca Hugging Face Transformers, moștenind toate atributele și metodele sale, dar adăugând funcționalități specifice și optimizări pentru SFT. SFTTrainer a fost contribuția lui Younes Belkada și a devenit un pilon în antrenarea modelelor de limbaj.

Utilizarea SFTTrainer este intuitivă. Practic, se specifică modelul de antrenat, setul de date de antrenament și, opțional, anumite argumente de configurare. De exemplu, pentru a antrena un model pe un set de date specific, procesul implică încărcarea modelului pre-antrenat, încărcarea setului de date (care poate fi un set de date conversațional sau de tip prompt-completare) și apoi inițializarea și rularea antrenorului. Este o soluție rapidă și eficientă pentru a începe fine-tuning-ul.

Tipuri de Seturi de Date Suportate de SFTTrainer

Flexibilitatea este o caracteristică cheie a SFTTrainer, care suportă atât seturi de date de modelare a limbajului, cât și seturi de date de tip prompt-completare. Mai mult, este compatibil cu formate de seturi de date standard și conversaționale. Atunci când se utilizează un set de date conversațional, antrenorul aplică automat șablonul de chat corespunzător setului de date, asigurând formatarea corectă pentru dialoguri.

Formatele acceptate includ:

- Text Simplu: Fiecare eșantion conține un câmp

"text"cu textul brut. - Mesaje Structurate (Conversaționale): Fiecare eșantion conține un câmp

"messages", care este o listă de dicționare, fiecare cu un"role"(ex: user, assistant) și"content". - Prompt-Completare: Fiecare eșantion are un câmp

"prompt"și un câmp"completion", fie ca șiruri de caractere, fie ca liste de mesaje structurate.

Dacă setul de date nu se află într-unul dintre aceste formate, SFTTrainer permite preprocesarea acestuia pentru a-l converti în formatul așteptat. Acest lucru asigură că aproape orice set de date poate fi adaptat pentru fine-tuning, oferind o mare libertate în alegerea surselor de date.

Cum Funcționează SFTTrainer în Detaliu

Înțelegerea mecanismelor interne ale SFTTrainer este crucială pentru a exploata pe deplin capacitățile sale. Procesul de fine-tuning supravegheat se bazează pe câțiva pași cheie: preprocesarea, tokenizarea și calculul pierderii.

Preprocesarea și Tokenizarea

În timpul antrenamentului, SFTTrainer se așteaptă ca fiecare exemplu să conțină un câmp de text sau o pereche (prompt, completion), în funcție de formatul setului de date. Antrenorul tokenizează fiecare intrare folosind tokenizatorul modelului. Dacă atât prompt-ul, cât și completarea sunt furnizate separat, acestea sunt concatenate înainte de tokenizare, asigurând că modelul procesează secvența completă pentru a genera răspunsul.

Calculul Pierderii

Pierderea utilizată în SFT este pierderea de tip cross-entropy la nivel de token. Această funcție de pierdere măsoară cât de bine modelul prezice următorul token dintr-o secvență, având în vedere tokenii anteriori. Practic, modelul este antrenat să minimizeze diferența dintre distribuția de probabilitate prezisă pentru următorul token și distribuția reală (adică tokenul țintă). Tokenii de padding (dacă sunt prezenți) sunt mascați în timpul calculului pierderii, asigurându-se că doar tokenii semnificativi, non-padding, contribuie la valoarea pierderii.

Decalarea Etichetelor și Mascarea

Un aspect important al calculului pierderii este decalarea cu un singur token. În timpul antrenamentului, modelul este antrenat să prezică fiecare token din secvență pe baza tuturor tokenilor anteriori. Secvența de intrare este decalată la dreapta cu o poziție pentru a forma etichetele țintă. Tokenilor de padding, dacă există, li se aplică un indice de ignorare (implicit: -100) în pozițiile corespunzătoare. Acest mecanism asigură că pierderea se concentrează exclusiv pe tokenii relevanți, non-padding, evitând penalizarea modelului pentru predicții greșite pe zonele de padding.

Metricele Înregistrate

În timpul procesului de antrenament, SFTTrainer înregistrează o serie de metrice utile pentru monitorizarea progresului și evaluarea performanței. Acestea includ:

global_step: Numărul total de pași de optimizare efectuați până în prezent.epoch: Numărul curent de epoci, bazat pe iterarea setului de date.num_tokens: Numărul total de tokeni procesați până în prezent.loss: Pierderea medie de cross-entropy calculată pe tokenii nemascați în intervalul curent de logare.mean_token_accuracy: Proporția tokenilor nemascați pentru care predicția top-1 a modelului se potrivește cu tokenul real.learning_rate: Rata de învățare curentă, care se poate schimba dinamic dacă este utilizat un scheduler.grad_norm: Norma L2 a gradienților, calculată înainte de tăierea gradientului.

Personalizarea Procesului de Antrenament cu SFTTrainer

SFTTrainer oferă numeroase opțiuni de personalizare prin intermediul clasei SFTConfig, permițând utilizatorilor să ajusteze fin procesul de antrenament pentru a se potrivi nevoilor specifice.

Inițializarea Modelului

Puteți transmite direct argumente suplimentare metodei from_pretrained() a modelului prin intermediul parametrului model_init_kwargs din SFTConfig. Acest lucru este util, de exemplu, pentru a încărca un model într-o precizie diferită (ex: torch.bfloat16), fără a modifica direct codul de încărcare a modelului.

Ambalarea (Packing)

SFTTrainer suportă ambalarea exemplelor (packing), unde multiple exemple sunt grupate în aceeași secvență de intrare pentru a crește eficiența antrenamentului. Prin setarea packing=True în SFTConfig, se reduce semnificativ cantitatea de padding, utilizând mai eficient resursele GPU și permițând procesarea unor secvențe de context mai lungi. Această tehnică este deosebit de utilă pentru seturi de date cu exemple scurte și variate.

Antrenarea Doar pe Mesajele Asistentului

Pentru seturile de date conversaționale, există opțiunea de a calcula pierderea doar pe răspunsurile asistentului, ignorând mesajele utilizatorului sau ale sistemului. Această funcționalitate, activată prin assistant_only_loss=True în SFTConfig, este crucială pentru a ghida modelul să genereze răspunsuri relevante și coerente, fără a fi penalizat pentru replicarea instrucțiunilor inițiale ale utilizatorului.

Antrenarea Doar pe Completare

Similar, pentru seturile de date de tip prompt-completare, SFTTrainer poate calcula pierderea doar pe tokenii de completare, ignorând tokenii din prompt. Comportamentul implicit este de a calcula pierderea doar pe completare pentru aceste tipuri de seturi de date, dar poate fi ajustat prin completion_only_loss=False dacă se dorește antrenarea pe întreaga secvență.

Integrarea cu PEFT (Parameter-Efficient Fine-Tuning)

Unul dintre cele mai puternice aspecte ale SFTTrainer este integrarea strânsă cu biblioteca 🤗 PEFT (Parameter-Efficient Fine-Tuning). Aceasta permite utilizatorilor să antreneze doar un set mic de parametri adiționali (numiți adaptoare), în loc să antreneze întregul model. Tehnici precum LoRA (Low-Rank Adaptation) sunt compatibile, reducând semnificativ cerințele de resurse computaționale și timpul de antrenament. De obicei, când se antrenează adaptoare, se utilizează o rată de învățare mai mare (de exemplu, 1e-4), deoarece se învață doar parametri noi.

Integrarea cu Nuclee Optimizate

SFTTrainer suportă integrarea cu nuclee optimizate, cum ar fi Liger Kernel și Unsloth. Acestea sunt framework-uri open-source care îmbunătățesc performanța antrenamentului LLM-urilor, crescând throughput-ul multi-GPU, reducând utilizarea memoriei și accelerând procesul de fine-tuning. Aceste integrări permit utilizatorilor să beneficieze de optimizări hardware-software fără a modifica în profunzime codul de antrenament.

Exemple Avansate de Utilizare a SFTTrainer

Pe lângă cazurile de utilizare de bază, SFTTrainer este suficient de robust pentru a gestiona scenarii de antrenament mai complexe.

Reglajul Bazat pe Instrucțiuni (Instruction Tuning)

Reglajul bazat pe instrucțiuni (Instruction Tuning) este un proces prin care un model lingvistic de bază este învățat să urmeze instrucțiuni utilizatorului și să se angajeze în conversații. Acest lucru necesită un șablon de chat care definește cum să se structureze conversațiile în secvențe de text (incluzând markeri de rol și tokeni speciali) și un set de date conversațional care conține perechi instrucțiune-răspuns. SFTTrainer gestionează automat actualizările tokenizatorului și configurarea tokenilor speciali, simplificând transformarea unui model de bază într-unul capabil să urmeze instrucțiuni.

Apelarea Instrumentelor (Tool Calling)

SFTTrainer suportă pe deplin fine-tuning-ul modelelor cu capabilități de apelare a instrumentelor. Aceasta înseamnă că modelul poate fi antrenat să identifice când are nevoie de un instrument extern (de exemplu, o API de căutare, o bază de date) pentru a răspunde unei cereri și să genereze formatul corect de apelare a acelui instrument. Seturile de date pentru acest scenariu includ mesajele conversaționale, apelurile de instrumente și răspunsurile instrumentelor, alături de scheme JSON pentru instrumentele disponibile.

Extinderea pentru Modele Viziune-Limbaj (VLM)

Deși SFTTrainer nu suportă nativ date viziune-limbaj, este posibil să-l adaptezi. Acest lucru necesită utilizarea unui colator de date personalizat (custom data collator) care este compatibil cu datele multi-modale. Colatorul personalizat procesează atât textul, cât și imaginile "din mers", în timpul procesului de colare a datelor. De asemenea, trebuie setate anumite argumente în SFTConfig, cum ar fi remove_unused_columns=False și skip_prepare_dataset=True, pentru a evita procesarea implicită a setului de date ca fiind exclusiv text.

Beneficiile Supervised Fine-Tuning (SFT)

SFT oferă avantaje semnificative în îmbunătățirea calității ieșirilor LLM-urilor, în special în contextul generării de cod, dar principiile se aplică la orice domeniu:

- Acuratețe Îmbunătățită: Prin antrenarea pe exemple precise și etichetate, SFT permite LLM-urilor să genereze rezultate mult mai corecte și mai exacte.

- Eficiență Sporită: Antrenamentul pe date optimizate și relevante ajută modelul să producă ieșiri mai eficiente din punct de vedere al resurselor și al vitezei de execuție.

- Lizibilitate Crescută: Expunerea la stiluri de scriere și convenții preferate de oameni duce la un text (sau cod) mai ușor de citit și de înțeles.

- Reducerea Erorilor: Învățând din erori identificate de oameni și din corecții, SFT ajută la diminuarea probabilității de a genera rezultate defectuoase.

- Securitate Consolidată: În domenii sensibile, cum ar fi generarea de cod, SFT poate încorpora cele mai bune practici de securitate în datele de antrenament, conducând la rezultate mai sigure.

Provocări și Limitări ale SFT

În ciuda beneficiilor sale, SFT prezintă și anumite provocări și limitări:

- Dependența de Date: Eficacitatea SFT depinde puternic de calitatea și cantitatea datelor etichetate. Crearea și curatarea seturilor de date de înaltă calitate poate fi un proces consumator de timp și costisitor.

- Supra-antrenarea (Overfitting): Dacă setul de date de fine-tuning este prea mic sau nu este reprezentativ pentru domeniul țintă, LLM-ul se poate supra-antrena (overfit) pe datele de antrenament și poate performa slab pe exemplele nevăzute.

- Uitarea Catastrofală (Catastrophic Forgetting): În unele cazuri, SFT poate duce la uitare catastrofală, unde LLM-ul pierde o parte din cunoștințele sau abilitățile învățate anterior, în timp ce se adaptează la noua sarcină.

Alternative la SFT în Post-Antrenarea LLM-urilor

Pe lângă SFT, există și alte abordări pentru post-antrenarea LLM-urilor, fiecare cu propriile sale avantaje și dezavantaje:

- Generarea Augmentată cu Recuperare (RAG): Îmbunătățește LLM-urile prin recuperarea informațiilor relevante din surse de cunoștințe externe (ex: baze de date, documentație) în timpul generării răspunsurilor. Aceasta poate spori acuratețea și relevanța, dar poate fi costisitoare din punct de vedere computațional și necesită eforturi semnificative de inginerie.

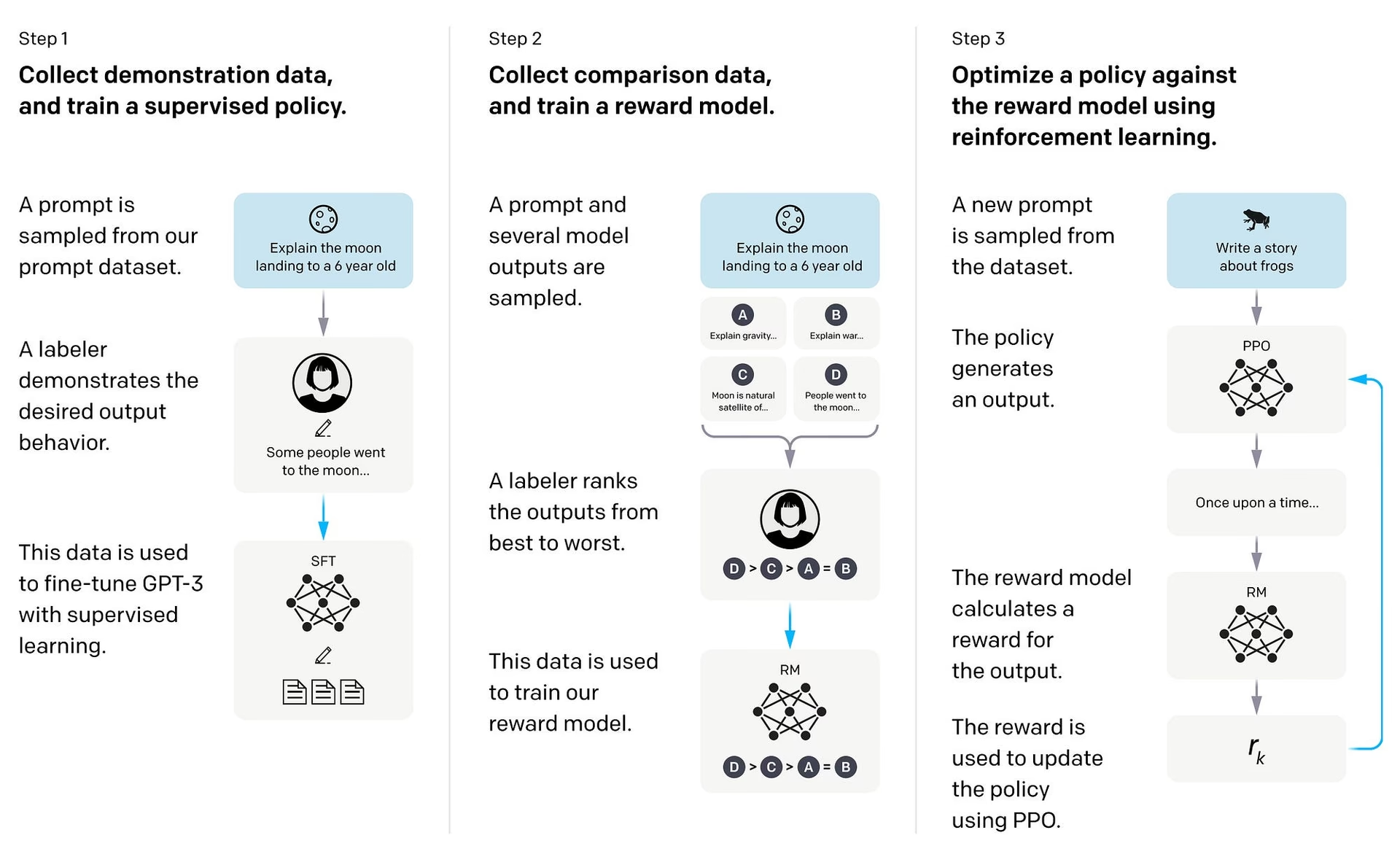

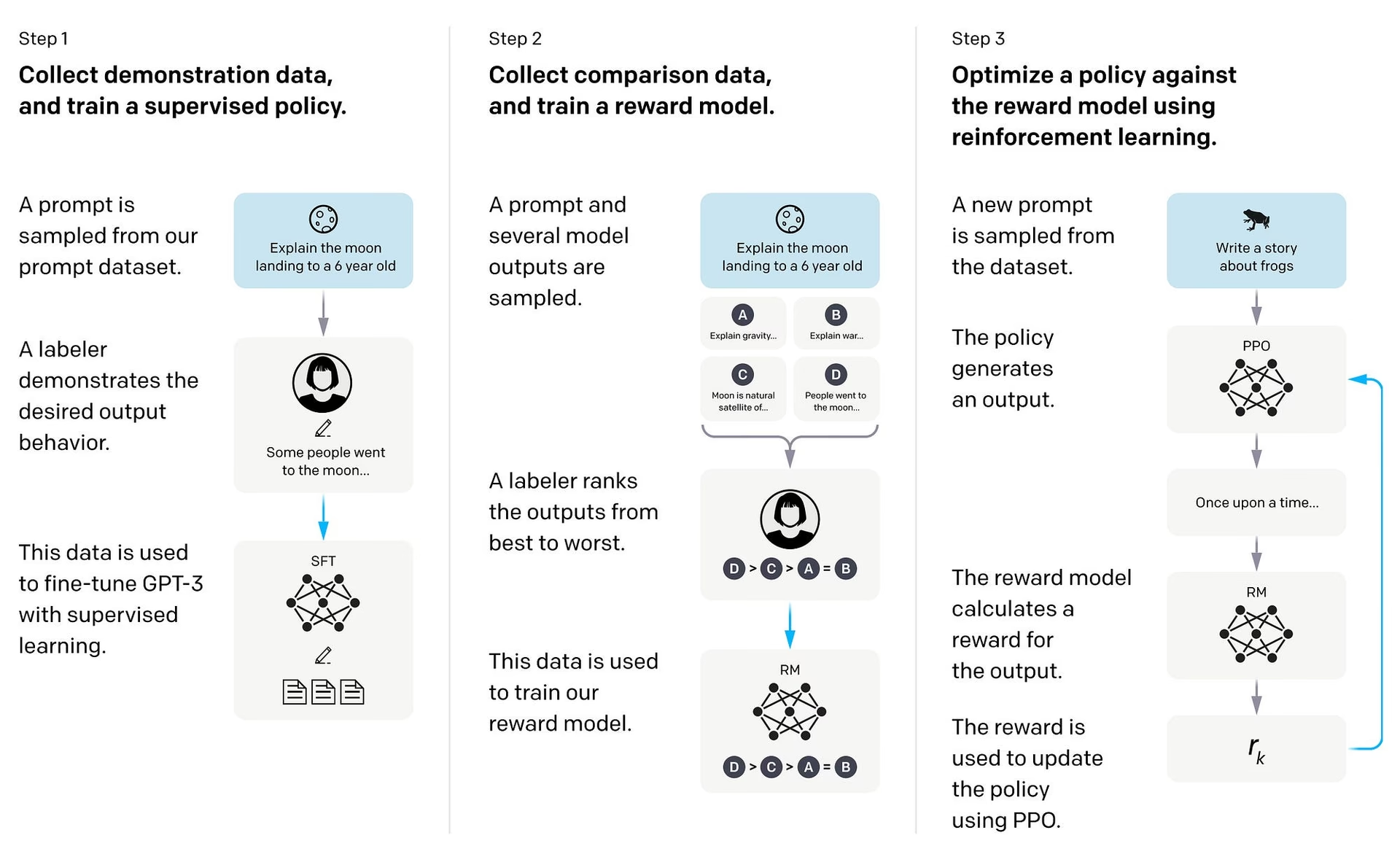

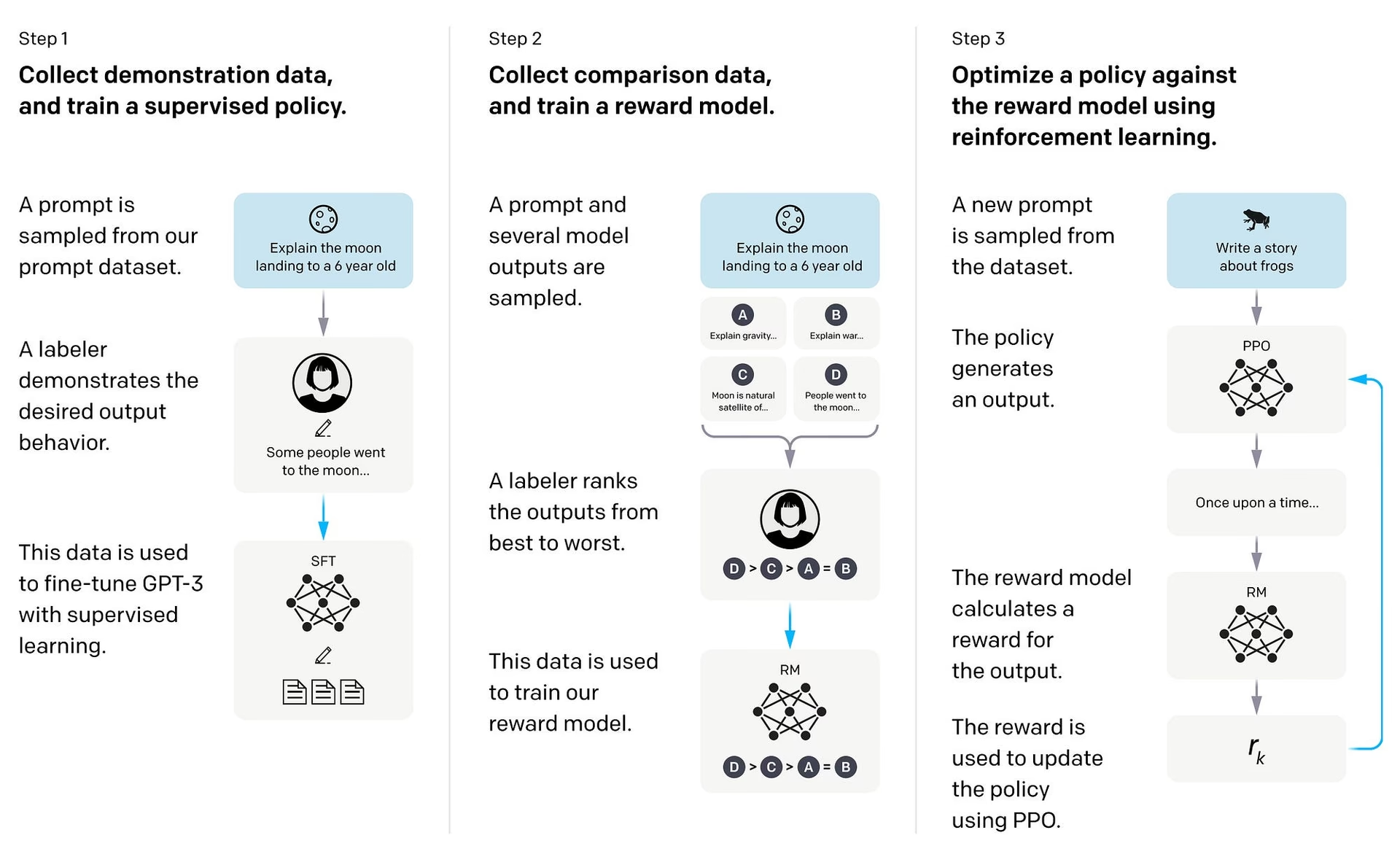

- Învățarea prin Consolidare din Feedback Uman (RLHF): Utilizează feedback-ul uman pentru a antrena un model de recompensă, care apoi ghidează LLM-ul să genereze răspunsuri care se aliniază cu preferințele umane. Aceasta poate duce la modele care generează rezultate mai aliniate cu așteptările umane, dar este mai intensivă în resurse decât SFT, necesitând feedback uman continuu și optimizare iterativă.

- Optimizarea Directă a Preferințelor (DPO): Optimizează direct parametrii LLM-ului pe baza preferințelor umane, simplificând procesul de antrenament. Poate fi mai eficientă decât RLHF și necesită mai puțină putere de calcul, dar s-ar putea să nu fie la fel de eficientă în capturarea preferințelor umane complexe.

Următorul tabel compară succint aceste abordări:

| Metodă | Complexitate | Dependența de Date | Intensitate Resurse | Beneficiu Principal |

|---|---|---|---|---|

| SFT | Simplă | Date etichetate de înaltă calitate | Medie | Adaptare rapidă la sarcini specifice |

| RAG | Medie-Înaltă | Surse de cunoștințe externe | Medie-Înaltă | Acuratețe și relevanță crescute |

| RLHF | Înaltă | Feedback uman iterativ | Foarte Înaltă | Aliniere superioară cu preferințele umane |

| DPO | Medie | Perechi de preferințe umane | Medie | Eficiență în alinierea preferințelor |

Considerații Etice în Utilizarea SFT

Utilizarea datelor umane în antrenarea LLM-urilor, inclusiv prin SFT, ridică importante considerații etice. Un aspect crucial este potențialul de prejudecăți (bias) în datele de antrenament. Dacă setul de date etichetat utilizat pentru SFT reflectă prejudecăți existente în societate sau în datele colectate, LLM-ul poate învăța și perpetua acele prejudecăți în ieșirile sale. Acest lucru poate avea implicații grave, de exemplu, în generarea de cod care conține vulnerabilități sau în crearea de texte discriminatorii.

O altă preocupare etică este potențialul de dislocare a locurilor de muncă. Pe măsură ce LLM-urile devin tot mai competente în sarcini precum generarea de cod, există riscul ca acestea să automatizeze sarcini îndeplinite în prezent de dezvoltatorii umani, ducând la pierderi de locuri de muncă. Este esențial să se abordeze aceste aspecte prin dezvoltarea responsabilă a AI, prin auditarea continuă a datelor și modelelor pentru prejudecăți și prin crearea de politici care să gestioneze tranziția forței de muncă.

Întrebări Frecvente

- Care este scopul principal al SFT?

Scopul principal al SFT este de a adapta un Model Lingvistic Mare pre-antrenat la o sarcină specifică sau la un set de date țintă, îmbunătățind acuratețea și relevanța ieșirilor sale prin antrenament supravegheat pe perechi de intrare-ieșire etichetate. - Ce tipuri de seturi de date suportă SFTTrainer?

SFTTrainer suportă atât seturi de date de modelare a limbajului (text simplu), cât și seturi de date de tip prompt-completare. De asemenea, este compatibil cu formate standard și conversaționale, aplicând automat șabloane de chat pentru acestea din urmă. - Poate fi SFTTrainer utilizat cu PEFT?

Da, SFTTrainer are o integrare strânsă cu biblioteca PEFT, permițând antrenarea adaptoarelor (cum ar fi LoRA) în loc de întregul model. Acest lucru reduce semnificativ cerințele de resurse computaționale și accelerează procesul de fine-tuning. - Ce înseamnă "ambalare" (packing) în SFTTrainer?

Ambalarea este o tehnică de optimizare în SFTTrainer care grupează mai multe exemple scurte într-o singură secvență de intrare de lungime fixă. Aceasta reduce padding-ul, îmbunătățește utilizarea GPU-ului și crește eficiența antrenamentului, mai ales pentru seturi de date cu eșantioane de lungimi variate. - Ce este decalarea etichetelor și mascarea în calculul pierderii?

Decalarea etichetelor implică deplasarea secvenței de intrare cu un token la dreapta pentru a forma etichetele țintă, permițând modelului să prezică următorul token. Mascarea înseamnă ignorarea tokenilor de padding în calculul pierderii (prin setarea lor la un indice special, de obicei -100), asigurându-se că doar tokenii reali contribuie la valoarea pierderii.

Concluzie

Supervised Fine-Tuning (SFT), facilitat de clasa SFTTrainer din biblioteca TRL, este o tehnică de neînlocuit pentru a maximiza potențialul Modelelor Lingvistice Mari. Prin acest proces, modelele generale sunt transformate în instrumente specializate, capabile să genereze rezultate de o calitate remarcabilă, adaptate la nevoi specifice. De la înțelegerea detaliilor de preprocesare și calcul al pierderii, la explorarea opțiunilor avansate de personalizare, cum ar fi ambalarea sau integrarea PEFT, SFTTrainer oferă un cadru robust și flexibil pentru dezvoltatori.

Deși SFT aduce beneficii semnificative în acuratețe, eficiență și lizibilitate, este important să fim conștienți de provocările sale, precum dependența de date de înaltă calitate, riscul de supra-antrenare și uitarea catastrofală. De asemenea, considerentele etice legate de prejudecățile în date și impactul asupra pieței muncii trebuie abordate cu seriozitate. Cu toate acestea, prin cercetare continuă și dezvoltare responsabilă, SFT va continua să joace un rol central în modelarea viitorului inteligenței artificiale și a aplicațiilor sale.

Dacă vrei să descoperi și alte articole similare cu Antrenarea Modelelor Lingvistice cu SFTTrainer, poți vizita categoria Fitness.